Technologie-Peripheriegeräte

Technologie-Peripheriegeräte

KI

KI

Ein Artikel über das Verkehrszeichenerkennungssystem beim autonomen Fahren

Ein Artikel über das Verkehrszeichenerkennungssystem beim autonomen Fahren

Ein Artikel über das Verkehrszeichenerkennungssystem beim autonomen Fahren

Was ist ein Verkehrszeichenerkennungssystem?

Das Verkehrszeichenerkennungssystem des Autosicherheitssystems, dessen englische Übersetzung: Traffic Sign Recognition, kurz TSR, lautet, nutzt die Frontkamera in Kombination mit dem Modus, um gängige Verkehrszeichen (Geschwindigkeitsbegrenzung, Parken, Kehrtwende) zu erkennen , usw.). Diese Funktion macht den Fahrer auf vorausliegende Verkehrszeichen aufmerksam, damit er diese befolgen kann. Die TSR-Funktion verbessert die Sicherheit, indem sie die Wahrscheinlichkeit verringert, dass Fahrer Verkehrsregeln wie Stoppschilder nicht befolgen und illegales Linksabbiegen oder andere unbeabsichtigte Verkehrsverstöße vermeiden. Diese Systeme erfordern flexible Softwareplattformen zur Verbesserung der Erkennungsalgorithmen und zur Anpassung an Verkehrszeichen in verschiedenen Bereichen.

Prinzip der Verkehrszeichenerkennung

Die Verkehrszeichenerkennung, auch bekannt als TSR (Traffic Sign Recognition), bezieht sich auf die Fähigkeit, Verkehrszeicheninformationen zu sammeln und zu identifizieren, die während der Fahrt des Fahrzeugs angezeigt werden, und rechtzeitig Anweisungen oder Warnungen bereitzustellen an den Fahrer weiterzuleiten oder das Fahrzeug direkt zu steuern, um einen reibungslosen Verkehr zu gewährleisten und Unfälle zu verhindern. Wenn das Fahrzeug in Fahrzeugen, die mit sicherheitsunterstützten Fahrsystemen ausgestattet sind, über ein effizientes TSR-System verfügt, kann es den Fahrern zeitnah zuverlässige Verkehrszeicheninformationen liefern und so die Fahrsicherheit und den Fahrkomfort effektiv verbessern.

Im Folgenden wird eine typische Methode zur Erkennung von Verkehrszeichen vorgestellt.

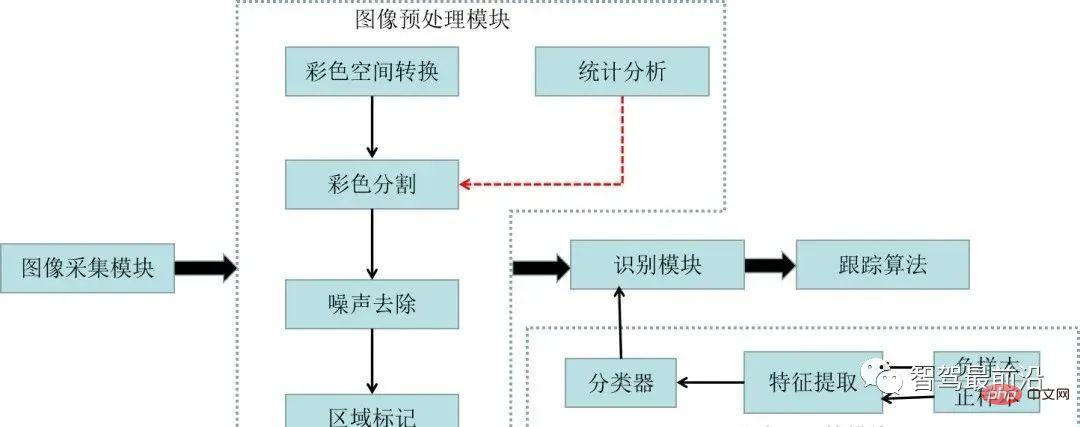

TSR basiert auf den Eigenschaften von Objekten, die vom menschlichen visuellen System erkannt werden. Sein Erkennungsprinzip besteht darin, die reichhaltigen Farbinformationen und festen Forminformationen von Verkehrsschildern zur Merkmalserkennung zu nutzen. Konkret kann der Anerkennungsprozess in zwei Schritte unterteilt werden: „Trennung“ und „Anerkennung“. Bei der Trennung geht es darum, mögliche Ziele in den erfassten Bildern zu finden und eine entsprechende Vorverarbeitung durchzuführen, gefolgt von der Verkehrszeichenerkennung, einschließlich Merkmalsextraktion und -klassifizierung, und schließlich der weiteren Bestimmung der Authentizität des Ziels.

1. Verkehrszeichentrennung

Die Verkehrszeichentrennung erfordert tatsächlich die schnelle Ermittlung von Interessenbereichen, bei denen es sich möglicherweise um Verkehrszeichen handelt, aus komplexen Szenenbildern. Anschließend wird die Mustererkennungsmethode verwendet, um den interessierenden Bereich weiter zu identifizieren und seinen spezifischen Standort zu lokalisieren. Da Verkehrszeichen als Indikatoren, Erinnerungen und Warnungen fungieren, sind sie so gestaltet, dass sie ins Auge fallen, leuchtende Farben, prägnante Grafiken und eine klare Bedeutung haben. Daher werden interessierende Regionen normalerweise anhand ihrer Farbe und Form kartiert.

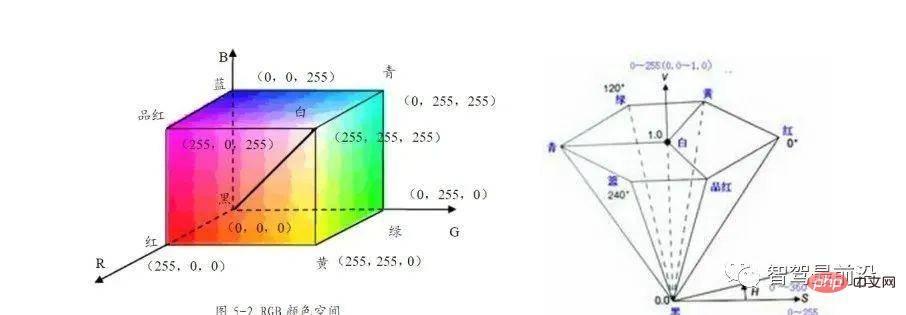

Zu den derzeit häufig verwendeten Farbräumen bei der Verkehrszeichenerkennung gehören RGB, HIS und CIE. Als die drei in der Bildverarbeitung häufig verwendeten Primärfarben ist RGB die Grundlage für die Konstruktion verschiedener anderer Farbdarstellungsmethoden Verwandelt.

Wir wissen, dass die meisten Verkehrszeichen relativ einfarbig und fest sind. Beispielsweise weisen rote Schilder im Allgemeinen auf Verbote hin, blaue Schilder weisen im Allgemeinen auf Anweisungen hin und gelbe Schilder weisen im Allgemeinen auf Warnungen hin. Die drei Grundfarben von RGB sind Rot, Gelb und Blau werden hier durch identifizierende Übereinstimmungen dargestellt.

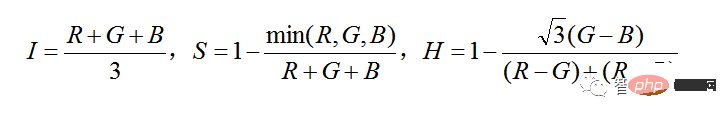

Da der Farbraum auch mehr Informationen wie Sättigung enthält, verwenden Forscher zur besseren Unterscheidung von Farb- und Helligkeitsinformationen das für menschliche visuelle Merkmale geeignete Farbmodell HSI, um die Verkehrszeichenerkennung zu verarbeiten. S steht für die Farbtiefe und I für den Helligkeits- und Dunkelheitsgrad. Das größte Merkmal von HSI ist die minimale Korrelation zwischen H, S und I. Jedes Farbbild im HSI-Raum entspricht einem relativ konsistenten Farbton H.

2. Verkehrszeichenerkennung

Nachdem der Interessenbereich der Verkehrszeicheninformationen in der Testfahrumgebung segmentiert wurde, muss ein bestimmter Algorithmus verwendet werden, um ihn zu identifizieren, um zu bestimmen, welches spezifische Verkehrszeichen es gibt Zu den allgemeinen Unterscheidungsmethoden gehören Vorlagenvergleichsmethoden, auf Clusteranalysen basierende Methoden, auf neuronalen Netzwerken basierende Methoden und auf Support-Vektor-Maschinen basierende Methoden.

(1) Basierend auf der Template-Matching-Methode

(2) Basierend auf der Cluster-Analyse-Methode

(3) Auf einem neuronalen Netzwerk basierende Methode

(4) Support-Vector-Machine-Methode

Support-Vector-Machine ist A Die typische Feedforward-Neuronale-Netzwerk-Methode wird zur Lösung von Musterklassifizierungs- und nichtlinearen Problemen verwendet. Ihre Hauptidee besteht darin, eine optimale Entscheidungshyperebene zu erstellen, um den Abstand zwischen den beiden Arten von Stichproben zu maximieren, die der Ebene auf beiden Seiten der Ebene am nächsten liegen, und so eine bessere Verallgemeinerung zu ermöglichen Fähigkeit zur Klassifizierung. Bei nichtlinearen trennbaren Musterklassifizierungsproblemen muss das verantwortliche Musterklassifizierungsproblem nichtlinear in einen hochdimensionalen Merkmalsraum projiziert werden. Daher kann der ursprüngliche Musterraum zu einem werden, solange die Transformation nichtlinear ist und die Merkmalsraumdimension hoch genug ist neu Ein hochdimensionaler Merkmalsraum, in dem Muster mit hoher Wahrscheinlichkeit linear trennbar werden. Der Transformationsprozess erfordert die Generierung einer Kernelfunktion für die Faltung. Die entsprechende typische Kernelfunktion wird wie folgt ausgedrückt:

Gaussian-Funktion: Bild; wird für den Klassifikator für radiale Mengen verwendet Netzwerk.

Einige spezifische Anwendungsszenarien von TSR

Denn die Komplexität der Straßenverkehrsbedingungen kann dazu führen, dass sich Verkehrszeichen verfärben, ihre Farbe und Form ändern und die Behinderung durch Bäume und Gebäude dazu führen kann, dass sie nicht rechtzeitig erkannt werden Gleichzeitig können Faktoren wie Fahrzeugzittern bei Hochgeschwindigkeitsfahrten zu Fehlern beim Bildabgleich führen, sodass die entsprechenden Verkehrszeichen nicht stabil erkannt werden können. Daher ist die Verkehrszeichenerkennung im Bereich der Fahrassistenz noch nicht weit verbreitet. Die ausgereifteren Anwendungslösungen sind wie folgt:

Automatische Geschwindigkeitsbegrenzung hauptsächlich auf der Grundlage von Geschwindigkeitsbegrenzungsschildern Der vom erkannten Geschwindigkeitsbegrenzungsschild angezeigte Geschwindigkeitsbegrenzungswert wird vom Fahrzeug zur Voraussage verwendet. Hier stellen wir mehrere verschiedene Geschwindigkeitswerte zum Vergleich ein.

VReal stellt die aktuelle tatsächliche Reisegeschwindigkeit des Fahrzeugs dar, Vtarget stellt die Soll-Reisegeschwindigkeit des Fahrzeugs dar, Vlim stellt die Informationen zum Geschwindigkeitsgrenzwert dar und Vfront stellt die erkannte Geschwindigkeit des vorausfahrenden Fahrzeugs dar.

Entsprechend den sensiblen Informationen über die Geschwindigkeit des eigenen Fahrzeugs werden die folgenden Geschwindigkeitsbegrenzungsstrategien in unterschiedlichem Ausmaß durchgeführt:

1) Die Geschwindigkeit des Fahrzeugs mit fester Geschwindigkeit

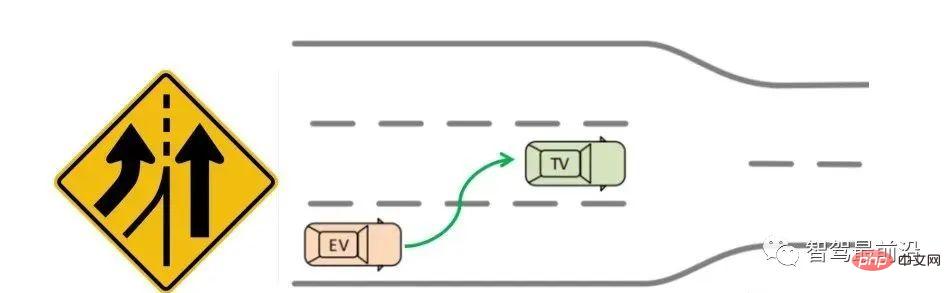

2) Das Fahrzeug folgt dem Fahrzeug vorne Vorgezogenes Zusammenführen basierend auf der Zusammenführungsstrategie Für Fahrzeuge, die auf Autobahnen fahren, müssen fahrende Fahrzeuge das Problem eines frühen Spurwechsels in verschiedenen Szenarien berücksichtigen. Es gibt derzeit zwei mögliche Lösungen: Erstens, wenn a Werden zusammenführende Schilderinformationen in einer bestimmten Entfernung erkannt, wird der Fahrer im Voraus per Sprache oder Instrumentenbild aufgefordert, den Spurwechsel des Fahrzeugs zu steuern und das Fahrzeug auf die Zielspur zu wechseln. Durch die Kombination der Entwicklung der Technologie selbst und des chinesischen Straßenverkehrsumfelds mit den spezifischen Bedürfnissen der Verbraucher können wir den Entwicklungstrend fortschrittlicher Fahrassistenzsysteme auf dem chinesischen Markt zusammenfassen: (1) Aus Sicht der technologischen Entwicklung werden fortschrittliche Fahrassistenzsysteme noch lange Zeit einen kontinuierlichen Entwicklungstrend beibehalten, da die Verbraucher der Fahrzeugsicherheit immer mehr Aufmerksamkeit schenken werden. Gleichzeitig wandeln sich fortschrittliche Fahrassistenzsysteme von der unabhängigen Entwicklung einer einzelnen Technologie hin zur Entwicklung integrierter aktiver Sicherheitssysteme, die Plattformen wie Sensoren und Steuerungssysteme gemeinsam nutzen können. Sobald das Fahrzeug mit grundlegendem ESP und ACC ausgestattet ist und anderen Technologien kann es einfach sein. Und die Hinzufügung anderer sicherer Fahrassistenztechnologien zu geringeren Kosten wird die Anwendung fortschrittlicher Fahrassistenzsystemtechnologien in Automobilen weiter fördern. (2) Einige relativ preisgünstige und sehr praktische fortschrittliche Fahrassistenzsysteme, wie Reifendrucküberwachungssysteme, elektronische Stabilitätssysteme ESP usw., wurden vom Markt aufgrund der starken Nachfrage voll und ganz anerkannt Die Penetrationsrate im Low-End-Markt wird stetig zunehmen. (3) Chinesische Verbraucher haben offensichtlich Aufmerksamkeit und Nachfrage nach Technologien zur Absicherungsunterstützung und Sehverbesserung gezeigt, die in der nächsten Phase sicherlich zum Hauptwachstumspunkt in diesem Bereich werden werden. (4) Einige Technologien, die höhere Anforderungen an Straßen stellen, wie z. B. Spurwechselassistent, Spurverlassenswarnung, ACC usw., sowie Technologien, die nicht mit den Fahrgewohnheiten chinesischer Verbraucher vereinbar sind, wie z. B. Spurhaltesysteme , Fahrerermüdungserkennung und alkoholfreie Sperrsysteme usw. werden möglicherweise über einen längeren Zeitraum nur langsam weiterentwickelt. Heutzutage kann die aktuelle Technologie nicht alle Verkehrszeichen erkennen und auch nicht unter allen Bedingungen funktionieren. Es gibt mehrere Bedingungen, die die Leistung des TSR-Systems einschränken, darunter die folgenden: Während TSR und ähnliche Fahrzeugsensortechnologien auf dem Weg zum vollständig autonomen Fahren hilfreich sind, sind wir noch nicht am Ziel. Selbst TSR ist nur ein Fahrassistenzsystem. Fahrer können sich beim Fahren nicht ausschließlich auf ein ADAS-System verlassen. Im Allgemeinen sind die Grundfunktionen von TSR relativ ausgereift, bei erweiterten Funktionen und der Vereinfachung der ökologischen Kette ist jedoch noch einiges zu tun.

Wenn erkannt wird, dass das Fahrzeug VReal>Vlim ist und Vtarget

Wenn die VReal des Fahrzeugs erkannt wird

Wenn es erkennt, dass das Fahrzeug VReal

Das auf Ampelzeichenerkennung basierende Fahrassistenzsystem erfordert, dass das System das Fahren und Spurwechseln von Fahrzeugen anhand der erkannten Ampeln im Voraus steuert.  Es gibt hauptsächlich die folgenden Steuerungsszenenstrategien:

Es gibt hauptsächlich die folgenden Steuerungsszenenstrategien:

Der Entwicklungsstand fortschrittlicher Fahrassistenzsysteme in China

Einige Schwierigkeiten von TSR

Das obige ist der detaillierte Inhalt vonEin Artikel über das Verkehrszeichenerkennungssystem beim autonomen Fahren. Für weitere Informationen folgen Sie bitte anderen verwandten Artikeln auf der PHP chinesischen Website!

Heiße KI -Werkzeuge

Undresser.AI Undress

KI-gestützte App zum Erstellen realistischer Aktfotos

AI Clothes Remover

Online-KI-Tool zum Entfernen von Kleidung aus Fotos.

Undress AI Tool

Ausziehbilder kostenlos

Clothoff.io

KI-Kleiderentferner

Video Face Swap

Tauschen Sie Gesichter in jedem Video mühelos mit unserem völlig kostenlosen KI-Gesichtstausch-Tool aus!

Heißer Artikel

Heiße Werkzeuge

Notepad++7.3.1

Einfach zu bedienender und kostenloser Code-Editor

SublimeText3 chinesische Version

Chinesische Version, sehr einfach zu bedienen

Senden Sie Studio 13.0.1

Leistungsstarke integrierte PHP-Entwicklungsumgebung

Dreamweaver CS6

Visuelle Webentwicklungstools

SublimeText3 Mac-Version

Codebearbeitungssoftware auf Gottesniveau (SublimeText3)

Heiße Themen

1393

1393

52

52

1205

1205

24

24

Warum ist Gaussian Splatting beim autonomen Fahren so beliebt, dass NeRF allmählich aufgegeben wird?

Jan 17, 2024 pm 02:57 PM

Warum ist Gaussian Splatting beim autonomen Fahren so beliebt, dass NeRF allmählich aufgegeben wird?

Jan 17, 2024 pm 02:57 PM

Oben geschrieben und persönliches Verständnis des Autors. Dreidimensionales Gaussplatting (3DGS) ist eine transformative Technologie, die in den letzten Jahren in den Bereichen explizite Strahlungsfelder und Computergrafik entstanden ist. Diese innovative Methode zeichnet sich durch die Verwendung von Millionen von 3D-Gaußkurven aus, was sich stark von der Neural Radiation Field (NeRF)-Methode unterscheidet, die hauptsächlich ein implizites koordinatenbasiertes Modell verwendet, um räumliche Koordinaten auf Pixelwerte abzubilden. Mit seiner expliziten Szenendarstellung und differenzierbaren Rendering-Algorithmen garantiert 3DGS nicht nur Echtzeit-Rendering-Fähigkeiten, sondern führt auch ein beispielloses Maß an Kontrolle und Szenenbearbeitung ein. Dies positioniert 3DGS als potenziellen Game-Changer für die 3D-Rekonstruktion und -Darstellung der nächsten Generation. Zu diesem Zweck geben wir erstmals einen systematischen Überblick über die neuesten Entwicklungen und Anliegen im Bereich 3DGS.

Wie lässt sich das Long-Tail-Problem in autonomen Fahrszenarien lösen?

Jun 02, 2024 pm 02:44 PM

Wie lässt sich das Long-Tail-Problem in autonomen Fahrszenarien lösen?

Jun 02, 2024 pm 02:44 PM

Gestern wurde ich während des Interviews gefragt, ob ich irgendwelche Long-Tail-Fragen gestellt hätte, also dachte ich, ich würde eine kurze Zusammenfassung geben. Das Long-Tail-Problem des autonomen Fahrens bezieht sich auf Randfälle bei autonomen Fahrzeugen, also mögliche Szenarien mit geringer Eintrittswahrscheinlichkeit. Das wahrgenommene Long-Tail-Problem ist einer der Hauptgründe, die derzeit den betrieblichen Designbereich intelligenter autonomer Einzelfahrzeugfahrzeuge einschränken. Die zugrunde liegende Architektur und die meisten technischen Probleme des autonomen Fahrens wurden gelöst, und die verbleibenden 5 % der Long-Tail-Probleme wurden nach und nach zum Schlüssel zur Einschränkung der Entwicklung des autonomen Fahrens. Zu diesen Problemen gehören eine Vielzahl fragmentierter Szenarien, Extremsituationen und unvorhersehbares menschliches Verhalten. Der „Long Tail“ von Randszenarien beim autonomen Fahren bezieht sich auf Randfälle in autonomen Fahrzeugen (AVs). Randfälle sind mögliche Szenarien mit geringer Eintrittswahrscheinlichkeit. diese seltenen Ereignisse

Kamera oder Lidar wählen? Eine aktuelle Übersicht über die Erzielung einer robusten 3D-Objekterkennung

Jan 26, 2024 am 11:18 AM

Kamera oder Lidar wählen? Eine aktuelle Übersicht über die Erzielung einer robusten 3D-Objekterkennung

Jan 26, 2024 am 11:18 AM

0. Vorab geschrieben&& Persönliches Verständnis, dass autonome Fahrsysteme auf fortschrittlichen Wahrnehmungs-, Entscheidungs- und Steuerungstechnologien beruhen, indem sie verschiedene Sensoren (wie Kameras, Lidar, Radar usw.) verwenden, um die Umgebung wahrzunehmen, und Algorithmen und Modelle verwenden für Echtzeitanalysen und Entscheidungsfindung. Dies ermöglicht es Fahrzeugen, Verkehrszeichen zu erkennen, andere Fahrzeuge zu erkennen und zu verfolgen, das Verhalten von Fußgängern vorherzusagen usw. und sich so sicher an komplexe Verkehrsumgebungen anzupassen. Diese Technologie erregt derzeit große Aufmerksamkeit und gilt als wichtiger Entwicklungsbereich für die Zukunft des Transportwesens . eins. Aber was autonomes Fahren schwierig macht, ist herauszufinden, wie man dem Auto klarmachen kann, was um es herum passiert. Dies erfordert, dass der dreidimensionale Objekterkennungsalgorithmus im autonomen Fahrsystem Objekte in der Umgebung, einschließlich ihrer Standorte, genau wahrnehmen und beschreiben kann.

Beherrschen Sie die Koordinatensystemkonvertierung wirklich? Multisensorik-Themen, die für das autonome Fahren unverzichtbar sind

Oct 12, 2023 am 11:21 AM

Beherrschen Sie die Koordinatensystemkonvertierung wirklich? Multisensorik-Themen, die für das autonome Fahren unverzichtbar sind

Oct 12, 2023 am 11:21 AM

Der erste Pilot- und Schlüsselartikel stellt hauptsächlich mehrere häufig verwendete Koordinatensysteme in der autonomen Fahrtechnologie vor und erläutert, wie die Korrelation und Konvertierung zwischen ihnen abgeschlossen und schließlich ein einheitliches Umgebungsmodell erstellt werden kann. Der Schwerpunkt liegt hier auf dem Verständnis der Umrechnung vom Fahrzeug in den starren Kamerakörper (externe Parameter), der Kamera-in-Bild-Konvertierung (interne Parameter) und der Bild-in-Pixel-Einheitenkonvertierung. Die Konvertierung von 3D in 2D führt zu entsprechenden Verzerrungen, Verschiebungen usw. Wichtige Punkte: Das Fahrzeugkoordinatensystem und das Kamerakörperkoordinatensystem müssen neu geschrieben werden: Das Ebenenkoordinatensystem und das Pixelkoordinatensystem. Schwierigkeit: Sowohl die Entzerrung als auch die Verzerrungsaddition müssen auf der Bildebene kompensiert werden. 2. Einführung Insgesamt gibt es vier visuelle Systeme Koordinatensystem: Pixelebenenkoordinatensystem (u, v), Bildkoordinatensystem (x, y), Kamerakoordinatensystem () und Weltkoordinatensystem (). Es gibt eine Beziehung zwischen jedem Koordinatensystem,

Dieser Artikel reicht aus, um etwas über autonomes Fahren und Flugbahnvorhersage zu lesen!

Feb 28, 2024 pm 07:20 PM

Dieser Artikel reicht aus, um etwas über autonomes Fahren und Flugbahnvorhersage zu lesen!

Feb 28, 2024 pm 07:20 PM

Die Trajektorienvorhersage spielt eine wichtige Rolle beim autonomen Fahren. Unter autonomer Fahrtrajektorienvorhersage versteht man die Vorhersage der zukünftigen Fahrtrajektorie des Fahrzeugs durch die Analyse verschiedener Daten während des Fahrvorgangs. Als Kernmodul des autonomen Fahrens ist die Qualität der Trajektorienvorhersage von entscheidender Bedeutung für die nachgelagerte Planungssteuerung. Die Trajektorienvorhersageaufgabe verfügt über einen umfangreichen Technologie-Stack und erfordert Vertrautheit mit der dynamischen/statischen Wahrnehmung des autonomen Fahrens, hochpräzisen Karten, Fahrspurlinien, Fähigkeiten in der neuronalen Netzwerkarchitektur (CNN&GNN&Transformer) usw. Der Einstieg ist sehr schwierig! Viele Fans hoffen, so schnell wie möglich mit der Flugbahnvorhersage beginnen zu können und Fallstricke zu vermeiden. Heute werde ich eine Bestandsaufnahme einiger häufiger Probleme und einführender Lernmethoden für die Flugbahnvorhersage machen! Einführungsbezogenes Wissen 1. Sind die Vorschaupapiere in Ordnung? A: Schauen Sie sich zuerst die Umfrage an, S

Sprechen wir über End-to-End- und autonome Fahrsysteme der nächsten Generation sowie über einige Missverständnisse über End-to-End-Autonomes Fahren?

Apr 15, 2024 pm 04:13 PM

Sprechen wir über End-to-End- und autonome Fahrsysteme der nächsten Generation sowie über einige Missverständnisse über End-to-End-Autonomes Fahren?

Apr 15, 2024 pm 04:13 PM

Im vergangenen Monat hatte ich aus bekannten Gründen einen sehr intensiven Austausch mit verschiedenen Lehrern und Mitschülern der Branche. Ein unvermeidliches Thema im Austausch ist natürlich End-to-End und der beliebte Tesla FSDV12. Ich möchte diese Gelegenheit nutzen, einige meiner aktuellen Gedanken und Meinungen als Referenz und Diskussion darzulegen. Wie definiert man ein durchgängiges autonomes Fahrsystem und welche Probleme sollten voraussichtlich durchgängig gelöst werden? Gemäß der traditionellsten Definition bezieht sich ein End-to-End-System auf ein System, das Rohinformationen von Sensoren eingibt und für die Aufgabe relevante Variablen direkt ausgibt. Bei der Bilderkennung kann CNN beispielsweise als End-to-End bezeichnet werden, verglichen mit der herkömmlichen Methode zum Extrahieren von Merkmalen + Klassifizieren. Bei autonomen Fahraufgaben werden Eingabedaten verschiedener Sensoren (Kamera/LiDAR) benötigt

SIMPL: Ein einfacher und effizienter Multi-Agent-Benchmark zur Bewegungsvorhersage für autonomes Fahren

Feb 20, 2024 am 11:48 AM

SIMPL: Ein einfacher und effizienter Multi-Agent-Benchmark zur Bewegungsvorhersage für autonomes Fahren

Feb 20, 2024 am 11:48 AM

Originaltitel: SIMPL: ASimpleandEfficientMulti-agentMotionPredictionBaselineforAutonomousDriving Paper-Link: https://arxiv.org/pdf/2402.02519.pdf Code-Link: https://github.com/HKUST-Aerial-Robotics/SIMPL Autor: Hong Kong University of Science und Technologie DJI-Papieridee: Dieses Papier schlägt eine einfache und effiziente Bewegungsvorhersagebasislinie (SIMPL) für autonome Fahrzeuge vor. Im Vergleich zum herkömmlichen Agent-Cent

FisheyeDetNet: der erste Zielerkennungsalgorithmus basierend auf einer Fischaugenkamera

Apr 26, 2024 am 11:37 AM

FisheyeDetNet: der erste Zielerkennungsalgorithmus basierend auf einer Fischaugenkamera

Apr 26, 2024 am 11:37 AM

Die Zielerkennung ist ein relativ ausgereiftes Problem in autonomen Fahrsystemen, wobei die Fußgängererkennung einer der ersten Algorithmen ist, die eingesetzt werden. In den meisten Arbeiten wurde eine sehr umfassende Recherche durchgeführt. Die Entfernungswahrnehmung mithilfe von Fischaugenkameras für die Rundumsicht ist jedoch relativ wenig untersucht. Aufgrund der großen radialen Verzerrung ist es schwierig, die standardmäßige Bounding-Box-Darstellung in Fischaugenkameras zu implementieren. Um die obige Beschreibung zu vereinfachen, untersuchen wir erweiterte Begrenzungsrahmen-, Ellipsen- und allgemeine Polygondesigns in Polar-/Winkeldarstellungen und definieren eine mIOU-Metrik für die Instanzsegmentierung, um diese Darstellungen zu analysieren. Das vorgeschlagene Modell „fisheyeDetNet“ mit polygonaler Form übertrifft andere Modelle und erreicht gleichzeitig 49,5 % mAP auf dem Valeo-Fisheye-Kameradatensatz für autonomes Fahren