Technologie-Peripheriegeräte

Technologie-Peripheriegeräte

KI

KI

Datenschutz: KI anonymisiert klinische Daten im Gesundheitswesen

Datenschutz: KI anonymisiert klinische Daten im Gesundheitswesen

Datenschutz: KI anonymisiert klinische Daten im Gesundheitswesen

Angesichts der plötzlichen COVID-19-Epidemie haben wir rekordverdächtige Datenschutzverletzungen erlebt. Ein aktueller IBM-Bericht ergab, dass auch die Kosten von Datenschutzverletzungen dramatisch steigen.

Das Gesundheitswesen ist zweifellos eine der am stärksten von Datenschutzverletzungen betroffenen Branchen, mit einem durchschnittlichen Verlust von 9,2 Millionen US-Dollar pro Datenschutzverletzung. Bei solchen Verstößen handelt es sich bei den Informationen, die am häufigsten offengelegt werden, um sensible Kundendaten.

Pharma- und Gesundheitsunternehmen sind verpflichtet, sich nach strengen Richtlinien zu organisieren und zu operieren und gleichzeitig Patientendaten zu schützen. Daher kann jeder Verstoß kostspielig sein. Beispielsweise müssen Unternehmen während der gesamten Arzneimittelentwicklungsphase personenbezogene Daten (PII) sammeln, verarbeiten und speichern. Wenn Studien abgeschlossen und klinische Anträge eingereicht werden, muss darauf geachtet werden, dass die Privatsphäre der Patienten bei veröffentlichten Ergebnissen geschützt wird.

Die Verordnung Nr. 0070 der Europäischen Arzneimittel-Agentur (EMA) und die von Health Canada herausgegebenen Vorschriften zur „Veröffentlichung klinischer Informationen“ machen jeweils spezifische Vorschläge zur Datenanonymisierung, in der Hoffnung, das Risiko der Verwendung der Ergebnisse zur Wiederherstellung von Patientenidentitätsinformationen zu minimieren .

Diese Vorschriften setzen sich nicht nur für den Datenschutz ein, sondern erfordern auch die Weitergabe von Testdaten, um sicherzustellen, dass die Community daran arbeiten kann. Aber das bringt Unternehmen zweifellos in ein Dilemma.

Wie schaffen Pharmaunternehmen also ein Gleichgewicht zwischen Datenschutz und Transparenz und veröffentlichen gleichzeitig Forschungsergebnisse zeitnah, kostengünstig und effizient? Fakten haben gezeigt, dass KI-Technologie mehr als 97 % der Arbeitslast im Einreichungsprozess übernehmen kann, wodurch die betriebliche Belastung von Unternehmen erheblich reduziert wird.

Warum ist es so schwierig, klinische Forschungsergebnisse (CSR) zu anonymisieren?

Bei der Umsetzung der Anonymisierung klinischer Einreichungen stehen Unternehmen vor allem vor drei zentralen Herausforderungen:

Unstrukturierte Daten sind schwer zu verarbeiten: Ein großer Teil der Daten klinischer Studien sind unstrukturierte Daten. Die Forschungsergebnisse enthalten eine große Menge an Textdaten, gescannten Bildern und Tabellen, was die Verarbeitung ineffizient macht. Forschungsberichte umfassen oft Tausende von Seiten, und die Identifizierung vertraulicher Informationen darin gleicht der Suche nach der Nadel im Heuhaufen. Darüber hinaus gibt es keine standardisierten technischen Schulungslösungen, die diese Art der Verarbeitung automatisieren können.

Manuelle Prozesse sind umständlich und fehleranfällig: Pharmaunternehmen müssen heute Hunderte von Mitarbeitern beschäftigen, um die Einreichung klinischer Studien zu anonymisieren. Das gesamte Team muss mehr als 25 komplexe Schritte durchlaufen und die Bearbeitung eines typischen zusammenfassenden Dokuments kann bis zu 45 Tage dauern. Und bei der manuellen Durchsicht tausender Seiten an Material führt der langwierige Prozess oft zu Fehlern.

Offene Auslegung der Regulierungsvorgaben: Obwohl es viele detaillierte Anregungen in den Verordnungen gibt, sind die Details noch unvollständig. Beispielsweise verlangen die Vorschriften von Health Canada zur „öffentlichen Veröffentlichung klinischer Informationen“, dass das Risiko der Wiederherstellung von Identitätsinformationen weniger als 9 % betragen sollte, die spezifische Methode zur Risikoberechnung wird jedoch nicht detailliert beschrieben.

Im Folgenden stellen wir uns konkrete Lösungen vor, die solche Anonymisierungsbedürfnisse aus der Perspektive der Problemlösung bewältigen können.

Verwenden Sie Augmented Analytics, um sensible Informationen in menschlicher Sprache zu identifizieren

Die folgenden drei Elemente helfen beim Aufbau technologiegesteuerter Anonymisierungslösungen:

KI-Sprachmodelle für die Verarbeitung natürlicher Sprache (NLP)

Heute kann KI bereits wie ein Künstler kreieren und diagnostizieren wie ein Arzt. Die Deep-Learning-Technologie hat viele Fortschritte in der KI vorangetrieben, und KI-Sprachmodelle sind eines der Rückgrate. Als Zweig von Algorithmen zur Verarbeitung menschlicher Sprache sind KI-Sprachmodelle besonders gut darin, benannte Entitäten wie Patientennamen, Sozialversicherungsnummern und Postleitzahlen zu erkennen.

Unbewusst sind diese leistungsstarken KI-Modelle in jeden Winkel des öffentlichen Bereichs vorgedrungen und wurden anhand öffentlicher Dokumente in großem Umfang trainiert. Neben der bekannten Wikipedia ist auch die Datenbank MIMIC-III v1.4 mit Desensibilisierungsdaten von 40.000 Patienten zu einer wertvollen Ressource für das Training von KI-Modellen geworden. Um die Modellleistung zu verbessern, müssen Fachexperten natürlich auch eine anschließende Neuschulung des Modells auf der Grundlage interner klinischer Studienberichte durchführen.

Verbesserung der Genauigkeit durch Mensch-Maschine-Schleifendesign

Der von Health Canada vorgeschlagene Risikoschwellenwert von 9 % kann grob in eine Modellgenauigkeitsanforderung von etwa 95 % umgewandelt werden (im Allgemeinen gemessen durch Rückruf oder Präzision). KI-Algorithmen sind in der Lage, große Datenmengen zu betrachten und mehrere Trainingszyklen durchzuführen, um ihre Genauigkeit zu verbessern. Allerdings reichen technologische Verbesserungen allein nicht aus, um für die klinische Anwendung geeignet zu sein; diese Modelle erfordern auch menschliche Anleitung und Unterstützung.

Um die Subjektivität klinischer Studiendaten anzugehen und die Ergebnisse zu verbessern, sind Analyselösungen so konzipiert, dass sie mit Menschen zusammenarbeiten – dies wird als Augmented Intelligence bezeichnet. Das heißt, der Mensch wird als Teil des Mensch-Maschine-Kreislaufs betrachtet. Er ist nicht nur für die Datenkennzeichnung und das Modelltraining verantwortlich, sondern gibt auch regelmäßig Feedback, nachdem die Lösung wirksam ist. Auf diese Weise werden die Genauigkeit und Ausgabeleistung des Modells verbessert.

Probleme in einem kollaborativen Ansatz lösen

Nehmen wir an, dass eine Studie insgesamt 1.000 Patienten umfasst, von denen 980 aus den kontinentalen Vereinigten Staaten und die restlichen 20 aus Südamerika stammen . Müssen die Daten dieser 20 Patienten also bearbeitet (geschwärzt) oder anonymisiert werden? Ist es notwendig, Patientenproben innerhalb desselben Landes oder Kontinents auszuwählen? Auf welche Weise könnte ein Angreifer diese anonymisierten Informationen mit Alter, Postleitzahl und anderen Daten kombinieren, um letztendlich die Identität des Patienten wiederherzustellen?

Leider gibt es auf diese Fragen keine Standardantworten. Um die Richtlinien zur klinischen Einreichung klarer zu interpretieren, müssen Pharmahersteller, klinische Forschungsorganisationen (CROs), Anbieter von Technologielösungen und Forscher aus der Wissenschaft ihre Kräfte bündeln und zusammenarbeiten.

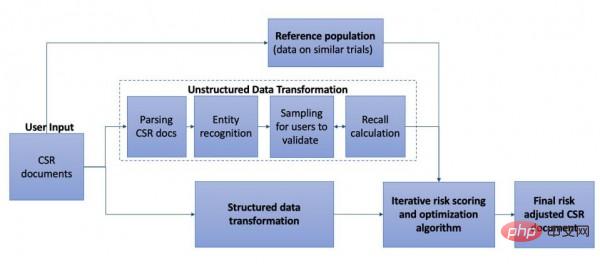

KI-gesteuerte Anonymisierungsmethode

Mit den oben genannten Grundideen besteht der nächste Schritt darin, sie zu einem vollständigen Lösungsprozess zusammenzufügen. Die verschiedenen Technologien der gesamten Anonymisierungslösung sollten auf den tatsächlichen Methoden basieren, die wir bereits in unserer Arbeit verwenden.

Klinische Studienberichte enthalten eine Vielzahl strukturierter Daten (numerische und Identitätseinheiten, wie demografische Informationen und Adresseinträge) sowie verschiedene unstrukturierte Datenelemente, die wir zuvor besprochen haben. Dies muss ordnungsgemäß gehandhabt werden, um zu verhindern, dass böswillige Hacker diese auf sensiblen benannten Entitäten wiederherstellen. Strukturierte Daten sind relativ einfach zu verarbeiten, aber KI-Algorithmen müssen noch die Schwierigkeit unstrukturierter Daten überwinden.

Unstrukturierte Daten (normalerweise in einem Format wie gescannte Bilder oder PDFs) werden zunächst mithilfe von Technologien wie optischer Zeichenerkennung (OCR) oder Computer Vision in eine lesbare Form umgewandelt. Anschließend werden KI-Algorithmen auf die Dokumente angewendet, um personenbezogene Daten zu erkennen. Um die Leistung des Algorithmus zu verbessern, können Benutzer Feedback zu Beispielergebnissen geben, um dem System zu helfen, zu verstehen, wie diese Analysen mit geringerer Zuverlässigkeit zu handhaben sind.

KI-gesteuerte Anonymisierungsmethode

Nach Abschluss der Anonymisierung müssen auch die entsprechenden Risiken der Identitätswiederherstellung bewertet werden. Diese Arbeit erfordert in der Regel einen Bezug zum Hintergrund der Bevölkerung und die Kombination mit Daten aus anderen ähnlichen Studien. Die Risikobewertung konzentriert sich auf die Identifizierung von drei Hauptrisikoszenarien – Staatsanwälte, Journalisten und Vermarkter – anhand einer Reihe von Elementen. Diese drei Gruppen werden versuchen, Patienteninformationen basierend auf ihren eigenen Bedürfnissen wiederherzustellen.

Bevor das Risikoniveau 9 % der vorgeschriebenen Empfehlungen erreicht, werden durch den Anonymisierungsprozess weitere Geschäftsregeln und Algorithmusverbesserungen eingeführt, um die Wirksamkeit in einem sich wiederholenden Zyklus zu steigern. Durch die Integration mit anderen Technologieanwendungen und die Einrichtung eines Prozesses für maschinelle Lernvorgänge (ML Ops) kann die gesamte Anonymisierungslösung dann in den tatsächlichen Arbeitsablauf integriert werden.

Eine schwierigere Herausforderung als der Algorithmus – Datenqualität

Für Pharmaunternehmen können solche Anonymisierungslösungen den Einreichungszyklus um bis zu 97 % verkürzen. Noch wichtiger ist, dass dieser halbautomatische Arbeitsablauf die Effizienz verbessert und gleichzeitig die Einbindung des Menschen gewährleistet. Doch was sind die größten Herausforderungen beim Aufbau KI-gesteuerter Anonymisierungslösungen?

Tatsächlich ist das größte Hindernis für diese Arbeit, wie bei den meisten Data-Science-Praktiken, nicht der KI-Algorithmus, der zur Identifizierung benannter Entitäten verwendet wird, sondern die Art und Weise, wie Forschungsberichte in qualitativ hochwertige Daten umgewandelt werden können von KI verarbeitet. Bei Dokumenten mit unterschiedlichen Formaten, Stilen und Strukturen ist die entsprechende Content-Ingestion-Pipeline oft ratlos.

Daher müssen KI-Anonymisierungslösungen kontinuierlich verfeinert werden, um sich an neue Dokumentkodierungsformate anzupassen oder die Start- und Endpositionen in Bild-/Tabellenscans genau zu erkennen. Offensichtlich ist dieser Arbeitsaspekt der zeitaufwändigste und energieintensivste Bereich der KI-Anonymisierung.

Neue Herausforderungen der Anonymisierung in der klinischen Forschung

Wird die Anonymisierung der klinischen Forschung mit der rasanten Weiterentwicklung der Technologie schwieriger und effizienter? Während KI-gestützte Lösungen in der Tat beeindruckend sind, wird es neue Herausforderungen geben, die Aufmerksamkeit erfordern.

Erstens erhöhen Verbraucherdaten, die über soziale Medien, Gerätenutzung und Online-Tracking gesammelt werden, das Risiko einer Identitätswiederherstellung erheblich. Angreifer können diese öffentlichen Informationen mit klinischen Forschungsdaten kombinieren, um Patienten genau zu identifizieren. Noch besorgniserregender ist, dass böswillige Hacker sehr aktiv KI-Ergebnisse anwenden und möglicherweise sogar Pharmaunternehmen einen Schritt voraus sind.

Schließlich entwickeln sich die Vorschriften weiter, um länderspezifische Praktiken zu berücksichtigen. Vielleicht werden einige Länder bald spezifische Vorschriften für die Anonymisierung klinischer Einreichungen bekannt geben, was sicherlich die Komplexität und Kostenbelastung für Unternehmen bei der Einhaltung der Vorschriften erhöhen wird. Aber wie heißt es so schön: Die Zukunft ist rosig, aber der Weg ist beschwerlich. Die ausgereifte Entwicklung der KI-Technologie gibt der gesamten Branche zumindest Hoffnung, Probleme zu überwinden.

Das obige ist der detaillierte Inhalt vonDatenschutz: KI anonymisiert klinische Daten im Gesundheitswesen. Für weitere Informationen folgen Sie bitte anderen verwandten Artikeln auf der PHP chinesischen Website!

Heiße KI -Werkzeuge

Undresser.AI Undress

KI-gestützte App zum Erstellen realistischer Aktfotos

AI Clothes Remover

Online-KI-Tool zum Entfernen von Kleidung aus Fotos.

Undress AI Tool

Ausziehbilder kostenlos

Clothoff.io

KI-Kleiderentferner

Video Face Swap

Tauschen Sie Gesichter in jedem Video mühelos mit unserem völlig kostenlosen KI-Gesichtstausch-Tool aus!

Heißer Artikel

Heiße Werkzeuge

Notepad++7.3.1

Einfach zu bedienender und kostenloser Code-Editor

SublimeText3 chinesische Version

Chinesische Version, sehr einfach zu bedienen

Senden Sie Studio 13.0.1

Leistungsstarke integrierte PHP-Entwicklungsumgebung

Dreamweaver CS6

Visuelle Webentwicklungstools

SublimeText3 Mac-Version

Codebearbeitungssoftware auf Gottesniveau (SublimeText3)

Heiße Themen

Worldcoin (WLD) Preisprognose 2025-2031: Wird WLD bis 2031 $ erreichen?

Apr 21, 2025 pm 02:42 PM

Worldcoin (WLD) Preisprognose 2025-2031: Wird WLD bis 2031 $ erreichen?

Apr 21, 2025 pm 02:42 PM

Worldcoin (WLD) fällt auf dem Kryptowährungsmarkt mit seinen einzigartigen biometrischen Überprüfungs- und Datenschutzschutzmechanismen auf, die die Aufmerksamkeit vieler Investoren auf sich ziehen. WLD hat mit seinen innovativen Technologien, insbesondere in Kombination mit OpenAI -Technologie für künstliche Intelligenz, außerdem unter Altcoins gespielt. Aber wie werden sich die digitalen Vermögenswerte in den nächsten Jahren verhalten? Lassen Sie uns den zukünftigen Preis von WLD zusammen vorhersagen. Die Preisprognose von 2025 WLD wird voraussichtlich im Jahr 2025 ein signifikantes Wachstum in WLD erzielen. Die Marktanalyse zeigt, dass der durchschnittliche WLD -Preis 1,31 USD mit maximal 1,36 USD erreichen kann. In einem Bärenmarkt kann der Preis jedoch auf rund 0,55 US -Dollar fallen. Diese Wachstumserwartung ist hauptsächlich auf Worldcoin2 zurückzuführen.

Web3 Trading Platform Ranking_Web3 Globale Top Ten Summary Top Ten Summary

Apr 21, 2025 am 10:45 AM

Web3 Trading Platform Ranking_Web3 Globale Top Ten Summary Top Ten Summary

Apr 21, 2025 am 10:45 AM

Binance ist der Overlord des Global Digital Asset Trading -Ökosystems, und seine Merkmale umfassen: 1. Das durchschnittliche tägliche Handelsvolumen übersteigt 150 Milliarden US -Dollar, unterstützt 500 Handelspaare, die 98% der Mainstream -Währungen abdecken. 2. Die Innovationsmatrix deckt den Markt für Derivate, das Web3 -Layout und den Bildungssystem ab; 3. Die technischen Vorteile sind Millisekunden -Matching -Engines mit Spitzenvolumina von 1,4 Millionen Transaktionen pro Sekunde. 4. Compliance Progress hält 15 Länderlizenzen und legt konforme Einheiten in Europa und den Vereinigten Staaten ein.

Was bedeutet Cross-Chain-Transaktion? Was sind die Cross-Chain-Transaktionen?

Apr 21, 2025 pm 11:39 PM

Was bedeutet Cross-Chain-Transaktion? Was sind die Cross-Chain-Transaktionen?

Apr 21, 2025 pm 11:39 PM

Börsen, die Cross-Chain-Transaktionen unterstützen: 1. Binance, 2. Uniswap, 3. Sushiswap, 4. Kurvenfinanzierung, 5. Thorchain, 6. 1inch Exchange, 7. DLN-Handel, diese Plattformen unterstützen Multi-Chain-Asset-Transaktionen durch verschiedene Technologien.

Rangliste der Hebelbörsen im Währungskreis Die neuesten Empfehlungen der zehn meistgezogenen Börsen im Währungskreis

Apr 21, 2025 pm 11:24 PM

Rangliste der Hebelbörsen im Währungskreis Die neuesten Empfehlungen der zehn meistgezogenen Börsen im Währungskreis

Apr 21, 2025 pm 11:24 PM

Die Plattformen, die im Jahr 2025 im Leveraged Trading, Security und Benutzererfahrung hervorragende Leistung haben, sind: 1. OKX, geeignet für Hochfrequenzhändler und bieten bis zu 100-fache Hebelwirkung; 2. Binance, geeignet für Mehrwährungshändler auf der ganzen Welt und bietet 125-mal hohe Hebelwirkung; 3. Gate.io, geeignet für professionelle Derivate Spieler, die 100 -fache Hebelwirkung bietet; 4. Bitget, geeignet für Anfänger und Sozialhändler, die bis zu 100 -fache Hebelwirkung bieten; 5. Kraken, geeignet für stetige Anleger, die fünfmal Hebelwirkung liefert; 6. Bybit, geeignet für Altcoin -Entdecker, die 20 -fache Hebelwirkung bietet; 7. Kucoin, geeignet für kostengünstige Händler, die 10-fache Hebelwirkung bietet; 8. Bitfinex, geeignet für das Seniorenspiel

Warum ist der Anstieg oder Abfall der virtuellen Währungspreise? Warum ist der Anstieg oder Abfall der virtuellen Währungspreise?

Apr 21, 2025 am 08:57 AM

Warum ist der Anstieg oder Abfall der virtuellen Währungspreise? Warum ist der Anstieg oder Abfall der virtuellen Währungspreise?

Apr 21, 2025 am 08:57 AM

Faktoren der steigenden Preise für virtuelle Währung sind: 1. Erhöhte Marktnachfrage, 2. Verringertes Angebot, 3.. Rückgangsfaktoren umfassen: 1. Verringerte Marktnachfrage, 2. Erhöhtes Angebot, 3. Streik der negativen Nachrichten, 4. Pessimistische Marktstimmung, 5. makroökonomisches Umfeld.

So gewinnen Sie Kernel Airdrop -Belohnungen für Binance vollständige Prozessstrategie

Apr 21, 2025 pm 01:03 PM

So gewinnen Sie Kernel Airdrop -Belohnungen für Binance vollständige Prozessstrategie

Apr 21, 2025 pm 01:03 PM

In der geschäftigen Welt der Kryptowährungen entstehen immer neue Möglichkeiten. Gegenwärtig zieht Kerneldao (Kernel) Airdrop -Aktivität viel Aufmerksamkeit auf sich und zieht die Aufmerksamkeit vieler Investoren auf sich. Also, was ist der Ursprung dieses Projekts? Welche Vorteile können BNB -Inhaber davon bekommen? Machen Sie sich keine Sorgen, das Folgende wird es einzeln für Sie enthüllen.

Aavenomics ist eine Empfehlung, das Aave -Protokoll -Token zu ändern und Token -Rückkauf einzuführen, die die Quorum -Anzahl von Personen erreicht hat.

Apr 21, 2025 pm 06:24 PM

Aavenomics ist eine Empfehlung, das Aave -Protokoll -Token zu ändern und Token -Rückkauf einzuführen, die die Quorum -Anzahl von Personen erreicht hat.

Apr 21, 2025 pm 06:24 PM

Aavenomics ist ein Vorschlag zur Änderung des Aave -Protokoll -Tokens und zur Einführung von Token -Repos, die ein Quorum für Aavedao implementiert hat. Marc Zeller, Gründer der AAVE -Projektkette (ACI), kündigte dies auf X an und stellte fest, dass sie eine neue Ära für die Vereinbarung markiert. Marc Zeller, Gründer der Aave Chain Initiative (ACI), kündigte auf X an, dass der Aavenomics -Vorschlag das Modifizieren des Aave -Protokoll -Tokens und die Einführung von Token -Repos umfasst, hat ein Quorum für Aavedao erreicht. Laut Zeller ist dies eine neue Ära für die Vereinbarung. AVEDAO -Mitglieder stimmten überwiegend für die Unterstützung des Vorschlags, der am Mittwoch 100 pro Woche betrug

Top 10 Cryptocurrency Exchange -Plattformen Die weltweit größte Liste der digitalen Währung

Apr 21, 2025 pm 07:15 PM

Top 10 Cryptocurrency Exchange -Plattformen Die weltweit größte Liste der digitalen Währung

Apr 21, 2025 pm 07:15 PM

Börsen spielen eine wichtige Rolle auf dem heutigen Kryptowährungsmarkt. Sie sind nicht nur Plattformen, an denen Investoren handeln, sondern auch wichtige Quellen für Marktliquidität und Preisentdeckung. Der weltweit größte virtuelle Währungsbörsen gehören zu den Top Ten, und diese Börsen sind nicht nur im Handelsvolumen weit voraus, sondern haben auch ihre eigenen Vorteile in Bezug auf Benutzererfahrung, Sicherheit und innovative Dienste. Börsen, die über die Liste stehen, haben normalerweise eine große Benutzerbasis und einen umfangreichen Markteinfluss, und deren Handelsvolumen und Vermögenstypen sind häufig mit anderen Börsen schwer zu erreichen.