Technologie-Peripheriegeräte

Technologie-Peripheriegeräte

KI

KI

Das Open-Source-Modell und das Einzelkarten-Training vermitteln Ihnen das Verständnis der beliebten textgesteuerten Audiogenerierungstechnologie AudioLDM

Das Open-Source-Modell und das Einzelkarten-Training vermitteln Ihnen das Verständnis der beliebten textgesteuerten Audiogenerierungstechnologie AudioLDM

Das Open-Source-Modell und das Einzelkarten-Training vermitteln Ihnen das Verständnis der beliebten textgesteuerten Audiogenerierungstechnologie AudioLDM

Anhand eines Textes kann künstliche Intelligenz Musik, Stimme, verschiedene Soundeffekte und sogar imaginäre Geräusche wie schwarze Löcher und Laserpistolen erzeugen. AudioLDM wurde kürzlich gemeinsam von der University of Surrey und dem Imperial College London ins Leben gerufen und erfreute sich nach seiner Veröffentlichung schnell großer Beliebtheit. Innerhalb einer Woche erhielt es fast 300 Retweets und 1.500 Likes auf Twitter. Am zweiten Tag, nachdem das Modell als Open-Source-Version veröffentlicht wurde, stürmte AudioLDM an die Spitze der Hot Search-Liste von Hugging Face, landete innerhalb einer Woche in der Liste der 40 beliebtesten Anwendungen von Hugging Face (insgesamt etwa 25.000) und tauchte schnell in vielen auf Abgeleitete Arbeit basierend auf AudioLDM.

Das AudioLDM-Modell weist folgende Highlights auf:

- Das erste Open-Source-Modell, das gleichzeitig Musik, Sprache und Soundeffekte aus Text generieren kann.

- Von der Wissenschaft entwickelt, verbraucht es weniger Daten, eine einzige GPU und kleinere Modelle, um derzeit die besten Ergebnisse zu erzielen.

- Schlägt vor, das generative Modell selbstüberwacht zu trainieren, sodass die textgesteuerte Audiogenerierung nicht mehr durch das Problem fehlender (Text-Audio-)Datenpaare eingeschränkt wird.

- Das Modell kann ohne zusätzliches Training (Zero-Shot) eine Audiostilübertragung, eine fehlende Audiofüllung und eine Audio-Superauflösung erreichen.

- Projekthomepage: https://audioldm.github.io/

- Papier: https://arxiv.org/abs/2301.12503

- Open-Source-Code und -Modell: https://github.com/haoheliu/AudioLDM

- Hugging Face Space: https://huggingface.co/spaces/haoheliu/audioldm-text-to-audio-generation

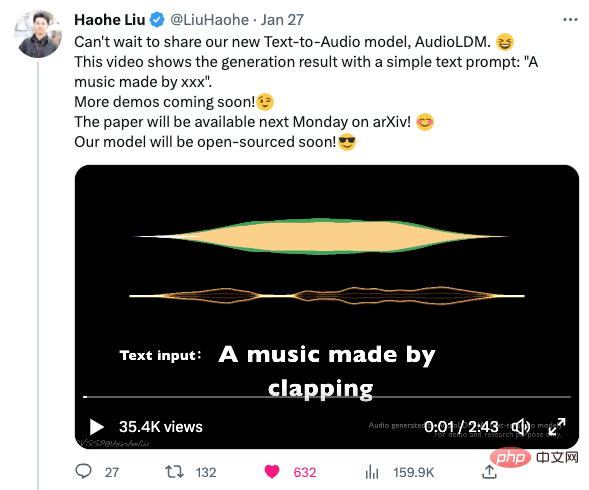

Der Autor veröffentlichte am 27. Januar erstmals eine Vorschau des Modells, die einen sehr einfachen Text zeigte: „Eine Musik von []“ (ein von [] generiertes Musikstück), um verschiedene Soundeffekte zu erzeugen. Das Video, das Musik zeigt, die mit verschiedenen Instrumenten und sogar einer Mücke gemacht wurde, fand auf Twitter schnell Anklang, wurde über 35,4.000 Mal abgespielt und über 130 Mal retweetet.

Dann veröffentlichte der Autor den Artikel und ein neues Video. In diesem Video demonstriert der Autor die meisten Funktionen des Modells sowie die Auswirkungen der Arbeit mit ChatGPT auf die Generierung von Sounds. AudioLDM kann sogar Geräusche aus dem Weltraum erzeugen.

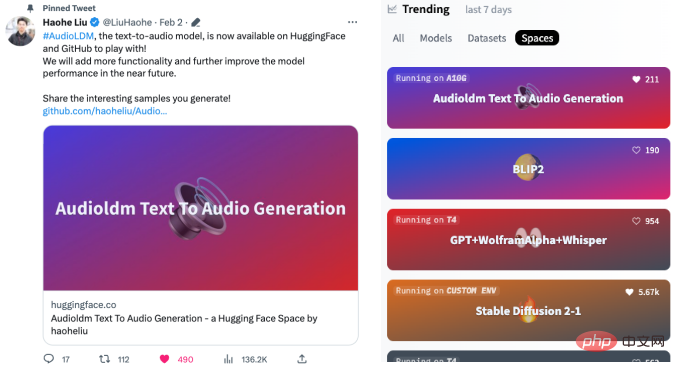

Dann veröffentlichte der Autor ein Papier, ein vorab trainiertes Modell und eine spielbare Benutzeroberfläche, was die Begeisterung der Twitter-Internetnutzer entfachte und am nächsten Tag schnell ganz oben auf der Hot Search-Liste „Hugging Face“ stand:

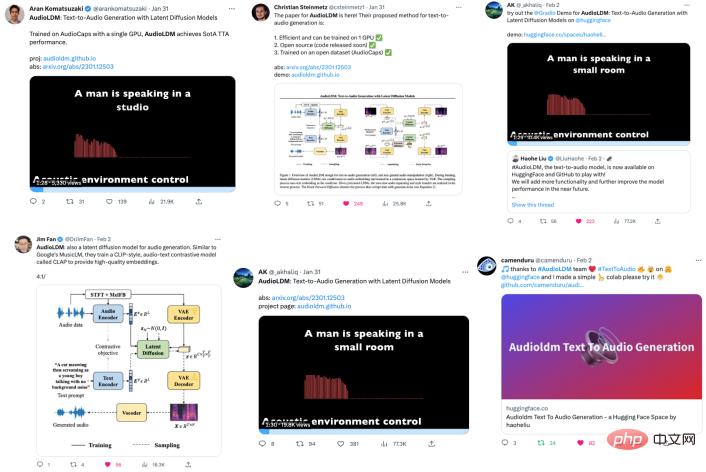

Diese Arbeit hat auf Twitter große Beachtung gefunden, und Wissenschaftler der Branche haben Folgendes weitergeleitet und kommentiert:

Internetnutzer haben AudioLDM verwendet, um eine Vielzahl von Sounds zu erzeugen.

Zum Beispiel gibt es erzeugte Geräusche des zweidimensionalen schnarchenden Katzenmädchens:

und Geistergeräusche:

Einige Internetnutzer synthetisierten: „Der Klang einer Mumie, niedrige Frequenz, mit einigen schmerzhaften Stöhnen.“

Einige Internetnutzer synthetisierten sogar: „Melodie-Furz-Sound“.

Ich muss die reiche Fantasie der Internetnutzer beklagen.

Einige Internetnutzer nutzten AudioLDM direkt, um eine Reihe von Musikalben in verschiedenen Stilrichtungen zu erstellen, darunter Jazz, Funk, Elektronik und Klassik. Teilweise ist die Musik recht einfallsreich.

Zum Beispiel „Erstellen Sie eine Ambient-Musik mit dem Thema des Universums und des Mondes“:

#🎜🎜 #

und „Erstelle eine Musik mit den Klängen der Zukunft“:

#🎜🎜 #

Interessierte Leser können diese Musikalbum-Website besuchen: https://www.latent.store/albums#🎜 🎜##🎜🎜 # Einige Internetnutzer nutzten auch ihre Fantasie, um eine Anwendung zu entwickeln, die Bilder verwendet, um die Erzeugung von Soundeffekten zu steuern, indem sie das Modell der Texterzeugung aus Bildern und AudioLDM kombiniert.

Wenn Sie AudioLDM beispielsweise diesen Text geben: „Ein Hund, der mit einem Frisbee im Wasser läuft“ (ein Hund, der mit einem Frisbee im Maul im Wasser läuft ):

kann das folgende Geräusch eines Hundes erzeugen, der auf das Wasser schlägt.

kann das folgende Geräusch eines Hundes erzeugen, der auf das Wasser schlägt.

Sie können sogar die Töne in alten Fotos wiederherstellen, wie zum Beispiel im Bild unten:

#🎜 🎜#

Nach Erhalt des Textes „Ein Mann und eine Frau sitzen an einer Bar“ (ein Mann und eine Frau sitzen an einer Bar) kann das Modell generieren Das folgende Geräusch ist zu hören, undeutliche Stimmen sind zu hören, außerdem ist im Hintergrund das Klirren von Weingläsern zu hören.

Einige Internetnutzer verwendeten AudioLDM, um den Klang des brennenden Hundes zu erzeugen, was sehr interessant ist.

Der Autor hat auch ein Video produziert, um die Fähigkeit des Modells zur Erzeugung von Soundeffekten zu demonstrieren und zu zeigen, wie AudioLDM Samples in der Nähe der Soundeffektbibliothek generiert.

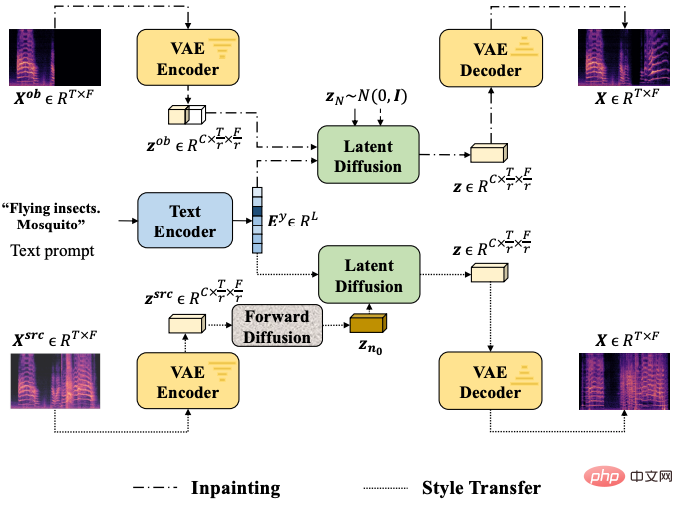

Tatsächlich ist die Text-Audio-Erzeugung nur ein Teil der Funktionen von AudioLDM. AudioLDM kann auch Klangfarbenkonvertierung, fehlende Füllung und Superauflösung erreichen.

Die beiden Bilder unten zeigen die Klangfarbentransformation von (1) Schlagzeug zu Ambient-Musik und (2) Trompete zu Kindergesang.

Das Folgende ist die Wirkung von Percussion auf Umgebungsmusik (progressive Konvertierungsintensität).

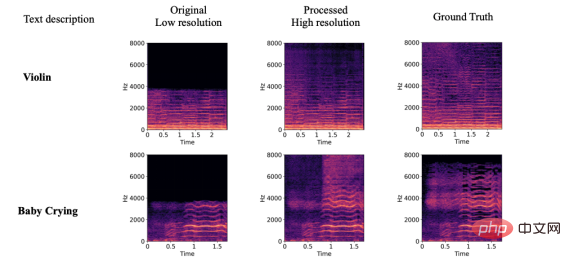

Nachfolgend zeigen wir die Auswirkung des Modells auf die Audio-Superauflösung, die fehlende Audiofüllung und die Steuerung des schallemittierenden Materials. Aufgrund der begrenzten Länge des Artikels wird der Ton hauptsächlich in Form von Spektrogrammen angezeigt. Interessierte Leser besuchen bitte die AudioLDM-Projekthomepage: https://audioldm.github.io/

In Bezug auf die Audio-Superauflösung ist die Wirkung von AudioLDM ebenfalls sehr gut. Im Vergleich zum vorherigen Superauflösungsmodell ist AudioLDM ein universelles Superauflösungsmodell und ist nicht auf die Verarbeitung von Musik und Sprache beschränkt.

In Bezug auf das Ausfüllen fehlender Audioinhalte kann AudioLDM je nach gegebenem Text unterschiedliche Audioinhalte ergänzen, und der Übergang an der Grenze ist natürlicher.

Darüber hinaus zeigt AudioLDM auch starke Steuerungsfähigkeiten, wie z. B. die Fähigkeit, die akustische Umgebung, die Stimmung und Geschwindigkeit von Musik, Objektmaterialien, Tonhöhe und Reihenfolge usw. zu steuern. Interessierte Leser können zum AudioLDM-Papier gehen oder Projekt-Homepage zum Ansehen.

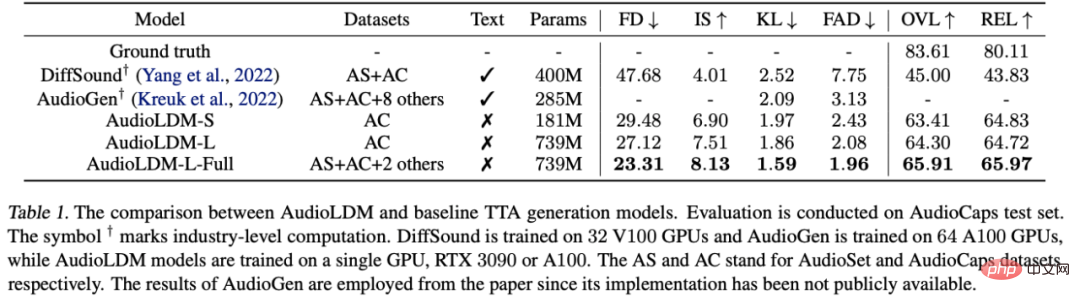

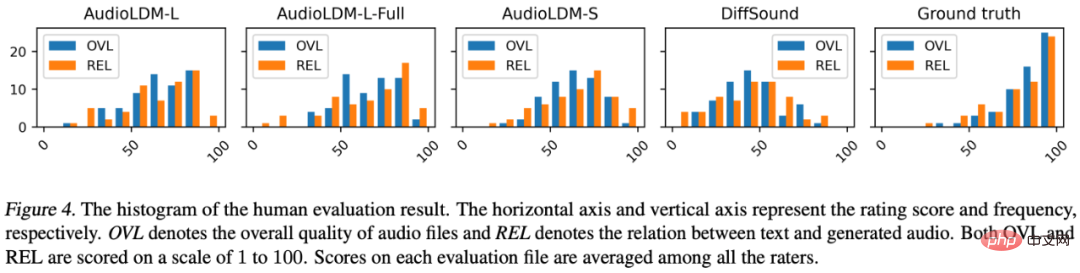

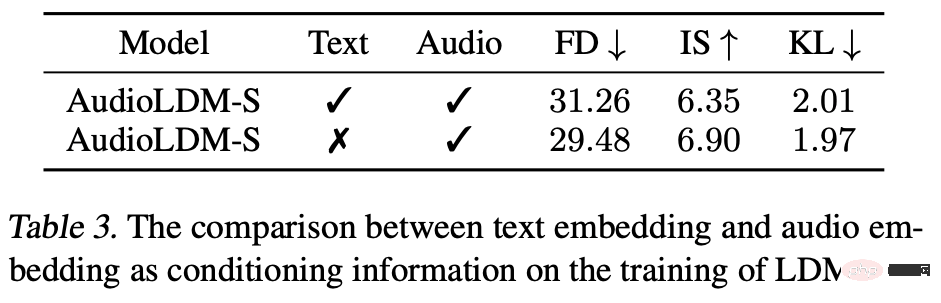

In dem Artikel führte der Autor eine subjektive Bewertung und eine objektive Indikatorbewertung des AudioLDM-Modells durch. Die Ergebnisse zeigten, dass es das vorherige optimale Modell deutlich übertreffen kann:

Unter ihnen AudioGen ist Facebooks 2022 Oktober Das vorgeschlagene Modell verwendet zehn Datensätze, 64 GPUs und 285 MB Parameter. Im Vergleich dazu kann AudioLDM-S mit einem einzigen Datensatz, 1 GPU und 181 MB Parametern bessere Ergebnisse erzielen.

Subjektive Bewertung zeigt auch, dass AudioLDM deutlich besser ist als die bisherige Lösung DiffSound. Welche Verbesserungen hat AudioLDM also vorgenommen, um dem Modell eine so hervorragende Leistung zu verleihen?

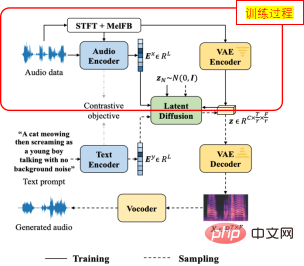

Um das Problem zu geringer Text-Audio-Datenpaare zu lösen, schlug der Autor zunächst eine selbstüberwachte Methode zum Trainieren von AudioLDM vor.

Insbesondere verwendet der Autor beim Training der Kernmodul-LDMs die Einbettung des Audios selbst als Bedingungssignal der LDMs. Der gesamte Prozess beinhaltet nicht die Verwendung von Text (wie in der Abbildung gezeigt). Abbildung oben). Dieses Schema basiert auf einem Paar vorab trainierter Audio-Text-Kontrastive-Learning-Encoder (CLAP), die im ursprünglichen CLAP-Text gute Generalisierungsfähigkeiten gezeigt haben. AudioLDM nutzt die hervorragenden Generalisierungsfähigkeiten von CLAP, um ein Modelltraining für große Audiodaten durchzuführen, ohne dass Textbezeichnungen erforderlich sind.

Tatsächlich stellte der Autor fest, dass die Verwendung von Audiotraining allein sogar noch besser ist als die Verwendung von Audio-Text-Datenpaaren:

Der Autor analysierte zwei Gründe: (1) Textanmerkungen selbst sind schwierig Alle Informationen wie akustische Umgebung, Frequenzverteilung usw. werden in den Text eingebunden, der den Ton nicht gut wiedergeben kann. (2) Die Qualität des Textes selbst ist beispielsweise nicht perfekt Anmerkung „Boote: Schlachtschiffe – 5,25 Förderraum“, diese Art von Anmerkung ist selbst für Menschen schwer vorstellbar, was der spezifische Klang ist, was zu Problemen beim Modelltraining führen wird. Im Gegensatz dazu kann die Verwendung des Audios selbst als LDM-Bedingung eine starke Korrelation zwischen dem Zielaudio und der Bedingung gewährleisten und so bessere Generierungsergebnisse erzielen.

Darüber hinaus ermöglicht die vom Autor übernommene Latent Diffusion-Lösung die Berechnung des Diffusionsmodells auf kleinerem Raum, wodurch der Rechenleistungsbedarf des Modells erheblich reduziert wird.

Viele detaillierte Untersuchungen zum Modelltraining und zur Modellstruktur verhelfen AudioLDM ebenfalls zu einer hervorragenden Leistung.

Der Autor hat auch ein einfaches Strukturdiagramm gezeichnet, um die beiden wichtigsten nachgelagerten Aufgaben vorzustellen:

Der Autor führte außerdem detaillierte Experimente mit verschiedenen Modellstrukturen, Modellgrößen, DDIM-Stichprobenschritten und verschiedenen klassifikatorfreien Leitskalen durch.

Während die Autoren das Modell veröffentlichten, legten sie auch die Codebasis ihres generativen Modellbewertungssystems offen, um die Bewertungsmethoden der akademischen Gemeinschaft zu solchen Themen in Zukunft zu vereinheitlichen . Um den Vergleich zwischen den Artikeln zu erleichtern, finden Sie den Code unter folgendem Link: https://github.com/haoheliu/audioldm_eval

Während diese Technologie boomt, gibt es einige Internetnutzer stellte auch die Sicherheit der Technologie in Frage:

#🎜🎜 ##🎜 🎜#

Autoreninformationen

Der Artikel hat zwei Co-Autoren: Liu Haohe (University of Surrey, UK) und Chen Zehua (Imperial College London). , Großbritannien).

# 🎜🎜 #

Das obige ist der detaillierte Inhalt vonDas Open-Source-Modell und das Einzelkarten-Training vermitteln Ihnen das Verständnis der beliebten textgesteuerten Audiogenerierungstechnologie AudioLDM. Für weitere Informationen folgen Sie bitte anderen verwandten Artikeln auf der PHP chinesischen Website!

Heiße KI -Werkzeuge

Undresser.AI Undress

KI-gestützte App zum Erstellen realistischer Aktfotos

AI Clothes Remover

Online-KI-Tool zum Entfernen von Kleidung aus Fotos.

Undress AI Tool

Ausziehbilder kostenlos

Clothoff.io

KI-Kleiderentferner

AI Hentai Generator

Erstellen Sie kostenlos Ai Hentai.

Heißer Artikel

Heiße Werkzeuge

Notepad++7.3.1

Einfach zu bedienender und kostenloser Code-Editor

SublimeText3 chinesische Version

Chinesische Version, sehr einfach zu bedienen

Senden Sie Studio 13.0.1

Leistungsstarke integrierte PHP-Entwicklungsumgebung

Dreamweaver CS6

Visuelle Webentwicklungstools

SublimeText3 Mac-Version

Codebearbeitungssoftware auf Gottesniveau (SublimeText3)

Heiße Themen

1376

1376

52

52

Das weltweit leistungsstärkste Open-Source-MoE-Modell ist da, mit chinesischen Fähigkeiten, die mit GPT-4 vergleichbar sind, und der Preis beträgt nur fast ein Prozent von GPT-4-Turbo

May 07, 2024 pm 04:13 PM

Das weltweit leistungsstärkste Open-Source-MoE-Modell ist da, mit chinesischen Fähigkeiten, die mit GPT-4 vergleichbar sind, und der Preis beträgt nur fast ein Prozent von GPT-4-Turbo

May 07, 2024 pm 04:13 PM

Stellen Sie sich ein Modell der künstlichen Intelligenz vor, das nicht nur die Fähigkeit besitzt, die traditionelle Datenverarbeitung zu übertreffen, sondern auch eine effizientere Leistung zu geringeren Kosten erzielt. Dies ist keine Science-Fiction, DeepSeek-V2[1], das weltweit leistungsstärkste Open-Source-MoE-Modell, ist da. DeepSeek-V2 ist ein leistungsstarkes MoE-Sprachmodell (Mix of Experts) mit den Merkmalen eines wirtschaftlichen Trainings und einer effizienten Inferenz. Es besteht aus 236B Parametern, von denen 21B zur Aktivierung jedes Markers verwendet werden. Im Vergleich zu DeepSeek67B bietet DeepSeek-V2 eine stärkere Leistung, spart gleichzeitig 42,5 % der Trainingskosten, reduziert den KV-Cache um 93,3 % und erhöht den maximalen Generierungsdurchsatz auf das 5,76-fache. DeepSeek ist ein Unternehmen, das sich mit allgemeiner künstlicher Intelligenz beschäftigt

KI untergräbt die mathematische Forschung! Der Gewinner der Fields-Medaille und der chinesisch-amerikanische Mathematiker führten 11 hochrangige Arbeiten an | Gefällt mir bei Terence Tao

Apr 09, 2024 am 11:52 AM

KI untergräbt die mathematische Forschung! Der Gewinner der Fields-Medaille und der chinesisch-amerikanische Mathematiker führten 11 hochrangige Arbeiten an | Gefällt mir bei Terence Tao

Apr 09, 2024 am 11:52 AM

KI verändert tatsächlich die Mathematik. Vor kurzem hat Tao Zhexuan, der diesem Thema große Aufmerksamkeit gewidmet hat, die neueste Ausgabe des „Bulletin of the American Mathematical Society“ (Bulletin der American Mathematical Society) weitergeleitet. Zum Thema „Werden Maschinen die Mathematik verändern?“ äußerten viele Mathematiker ihre Meinung. Der gesamte Prozess war voller Funken, knallhart und aufregend. Der Autor verfügt über eine starke Besetzung, darunter der Fields-Medaillengewinner Akshay Venkatesh, der chinesische Mathematiker Zheng Lejun, der NYU-Informatiker Ernest Davis und viele andere bekannte Wissenschaftler der Branche. Die Welt der KI hat sich dramatisch verändert. Viele dieser Artikel wurden vor einem Jahr eingereicht.

KAN, das MLP ersetzt, wurde durch Open-Source-Projekte auf Faltung erweitert

Jun 01, 2024 pm 10:03 PM

KAN, das MLP ersetzt, wurde durch Open-Source-Projekte auf Faltung erweitert

Jun 01, 2024 pm 10:03 PM

Anfang dieses Monats schlugen Forscher des MIT und anderer Institutionen eine vielversprechende Alternative zu MLP vor – KAN. KAN übertrifft MLP in Bezug auf Genauigkeit und Interpretierbarkeit. Und es kann MLP, das mit einer größeren Anzahl von Parametern ausgeführt wird, mit einer sehr kleinen Anzahl von Parametern übertreffen. Beispielsweise gaben die Autoren an, dass sie KAN nutzten, um die Ergebnisse von DeepMind mit einem kleineren Netzwerk und einem höheren Automatisierungsgrad zu reproduzieren. Konkret verfügt DeepMinds MLP über etwa 300.000 Parameter, während KAN nur etwa 200 Parameter hat. KAN hat eine starke mathematische Grundlage wie MLP und basiert auf dem universellen Approximationssatz, während KAN auf dem Kolmogorov-Arnold-Darstellungssatz basiert. Wie in der folgenden Abbildung gezeigt, hat KAN

Hallo, elektrischer Atlas! Der Boston Dynamics-Roboter erwacht wieder zum Leben, seltsame 180-Grad-Bewegungen machen Musk Angst

Apr 18, 2024 pm 07:58 PM

Hallo, elektrischer Atlas! Der Boston Dynamics-Roboter erwacht wieder zum Leben, seltsame 180-Grad-Bewegungen machen Musk Angst

Apr 18, 2024 pm 07:58 PM

Boston Dynamics Atlas tritt offiziell in die Ära der Elektroroboter ein! Gestern hat sich der hydraulische Atlas einfach „unter Tränen“ von der Bühne der Geschichte zurückgezogen. Heute gab Boston Dynamics bekannt, dass der elektrische Atlas im Einsatz ist. Es scheint, dass Boston Dynamics im Bereich kommerzieller humanoider Roboter entschlossen ist, mit Tesla zu konkurrieren. Nach der Veröffentlichung des neuen Videos wurde es innerhalb von nur zehn Stunden bereits von mehr als einer Million Menschen angesehen. Die alten Leute gehen und neue Rollen entstehen. Das ist eine historische Notwendigkeit. Es besteht kein Zweifel, dass dieses Jahr das explosive Jahr der humanoiden Roboter ist. Netizens kommentierten: Die Weiterentwicklung der Roboter hat dazu geführt, dass die diesjährige Eröffnungsfeier wie Menschen aussieht, und der Freiheitsgrad ist weitaus größer als der von Menschen. Aber ist das wirklich kein Horrorfilm? Zu Beginn des Videos liegt Atlas ruhig auf dem Boden, scheinbar auf dem Rücken. Was folgt, ist atemberaubend

Google ist begeistert: JAX-Leistung übertrifft Pytorch und TensorFlow! Es könnte die schnellste Wahl für das GPU-Inferenztraining werden

Apr 01, 2024 pm 07:46 PM

Google ist begeistert: JAX-Leistung übertrifft Pytorch und TensorFlow! Es könnte die schnellste Wahl für das GPU-Inferenztraining werden

Apr 01, 2024 pm 07:46 PM

Die von Google geförderte Leistung von JAX hat in jüngsten Benchmark-Tests die von Pytorch und TensorFlow übertroffen und belegt bei 7 Indikatoren den ersten Platz. Und der Test wurde nicht auf der TPU mit der besten JAX-Leistung durchgeführt. Obwohl unter Entwicklern Pytorch immer noch beliebter ist als Tensorflow. Aber in Zukunft werden möglicherweise mehr große Modelle auf Basis der JAX-Plattform trainiert und ausgeführt. Modelle Kürzlich hat das Keras-Team drei Backends (TensorFlow, JAX, PyTorch) mit der nativen PyTorch-Implementierung und Keras2 mit TensorFlow verglichen. Zunächst wählen sie eine Reihe von Mainstream-Inhalten aus

Empfohlen: Ausgezeichnetes JS-Open-Source-Projekt zur Gesichtserkennung und -erkennung

Apr 03, 2024 am 11:55 AM

Empfohlen: Ausgezeichnetes JS-Open-Source-Projekt zur Gesichtserkennung und -erkennung

Apr 03, 2024 am 11:55 AM

Die Technologie zur Gesichtserkennung und -erkennung ist bereits eine relativ ausgereifte und weit verbreitete Technologie. Derzeit ist JS die am weitesten verbreitete Internetanwendungssprache. Die Implementierung der Gesichtserkennung und -erkennung im Web-Frontend hat im Vergleich zur Back-End-Gesichtserkennung Vor- und Nachteile. Zu den Vorteilen gehören die Reduzierung der Netzwerkinteraktion und die Echtzeiterkennung, was die Wartezeit des Benutzers erheblich verkürzt und das Benutzererlebnis verbessert. Die Nachteile sind: Es ist durch die Größe des Modells begrenzt und auch die Genauigkeit ist begrenzt. Wie implementiert man mit js die Gesichtserkennung im Web? Um die Gesichtserkennung im Web zu implementieren, müssen Sie mit verwandten Programmiersprachen und -technologien wie JavaScript, HTML, CSS, WebRTC usw. vertraut sein. Gleichzeitig müssen Sie auch relevante Technologien für Computer Vision und künstliche Intelligenz beherrschen. Dies ist aufgrund des Designs der Webseite erwähnenswert

Das multimodale Dokumentenverständnis-Großmodell Alibaba 7B gewinnt neue SOTA

Apr 02, 2024 am 11:31 AM

Das multimodale Dokumentenverständnis-Großmodell Alibaba 7B gewinnt neue SOTA

Apr 02, 2024 am 11:31 AM

Neues SOTA für multimodale Dokumentverständnisfunktionen! Das Alibaba mPLUG-Team hat die neueste Open-Source-Arbeit mPLUG-DocOwl1.5 veröffentlicht, die eine Reihe von Lösungen zur Bewältigung der vier großen Herausforderungen der hochauflösenden Bildtexterkennung, des allgemeinen Verständnisses der Dokumentstruktur, der Befolgung von Anweisungen und der Einführung externen Wissens vorschlägt. Schauen wir uns ohne weitere Umschweife zunächst die Auswirkungen an. Ein-Klick-Erkennung und Konvertierung von Diagrammen mit komplexen Strukturen in das Markdown-Format: Es stehen Diagramme verschiedener Stile zur Verfügung: Auch eine detailliertere Texterkennung und -positionierung ist einfach zu handhaben: Auch ausführliche Erläuterungen zum Dokumentverständnis können gegeben werden: Sie wissen schon, „Document Understanding“. " ist derzeit ein wichtiges Szenario für die Implementierung großer Sprachmodelle. Es gibt viele Produkte auf dem Markt, die das Lesen von Dokumenten unterstützen. Einige von ihnen verwenden hauptsächlich OCR-Systeme zur Texterkennung und arbeiten mit LLM zur Textverarbeitung zusammen.

Tesla-Roboter arbeiten in Fabriken, Musk: Der Freiheitsgrad der Hände wird dieses Jahr 22 erreichen!

May 06, 2024 pm 04:13 PM

Tesla-Roboter arbeiten in Fabriken, Musk: Der Freiheitsgrad der Hände wird dieses Jahr 22 erreichen!

May 06, 2024 pm 04:13 PM

Das neueste Video von Teslas Roboter Optimus ist veröffentlicht und er kann bereits in der Fabrik arbeiten. Bei normaler Geschwindigkeit sortiert es Batterien (Teslas 4680-Batterien) so: Der Beamte hat auch veröffentlicht, wie es bei 20-facher Geschwindigkeit aussieht – auf einer kleinen „Workstation“, pflücken und pflücken und pflücken: Dieses Mal wird es freigegeben. Eines der Highlights Der Vorteil des Videos besteht darin, dass Optimus diese Arbeit in der Fabrik völlig autonom und ohne menschliches Eingreifen während des gesamten Prozesses erledigt. Und aus Sicht von Optimus kann es auch die krumme Batterie aufnehmen und platzieren, wobei der Schwerpunkt auf der automatischen Fehlerkorrektur liegt: In Bezug auf die Hand von Optimus gab der NVIDIA-Wissenschaftler Jim Fan eine hohe Bewertung ab: Die Hand von Optimus ist der fünffingrige Roboter der Welt am geschicktesten. Seine Hände sind nicht nur taktil