Technologie-Peripheriegeräte

Technologie-Peripheriegeräte

KI

KI

Berkeley hat den ersten hochauflösenden Datensatz und das erste Vorhersagemodell für Parkszenarien als Open-Source-Lösung bereitgestellt, die die Zielerkennung und Flugbahnvorhersage unterstützen.

Berkeley hat den ersten hochauflösenden Datensatz und das erste Vorhersagemodell für Parkszenarien als Open-Source-Lösung bereitgestellt, die die Zielerkennung und Flugbahnvorhersage unterstützen.

Berkeley hat den ersten hochauflösenden Datensatz und das erste Vorhersagemodell für Parkszenarien als Open-Source-Lösung bereitgestellt, die die Zielerkennung und Flugbahnvorhersage unterstützen.

Da sich die Technologie des autonomen Fahrens immer weiter entwickelt, sind Fahrzeugverhalten und Flugbahnvorhersage von äußerst wichtiger Bedeutung für effizientes und sicheres Fahren. Obwohl herkömmliche Trajektorienvorhersagemethoden wie die dynamische Modellableitung und die Zugänglichkeitsanalyse die Vorteile einer klaren Form und einer guten Interpretierbarkeit bieten, ist ihre Fähigkeit, die Interaktion zwischen der Umgebung und Objekten zu modellieren, in komplexen Verkehrsumgebungen relativ begrenzt. Daher basierten in den letzten Jahren zahlreiche Forschungen und Anwendungen auf verschiedenen Deep-Learning-Methoden (wie LSTM, CNN, Transformer, GNN usw.) und verschiedenen Datensätzen wie BDD100K, nuScenes, Stanford Drone, ETH /UCY, INTERACTION, ApolloScape usw. sind ebenfalls entstanden und bieten starke Unterstützung für das Training und die Bewertung tiefer neuronaler Netzwerkmodelle. Viele SOTA-Modelle wie GroupNet, Trajectron++, MultiPath usw. haben eine gute Leistung gezeigt.

Die oben genannten Modelle und Datensätze konzentrieren sich auf normale Straßenfahrszenarien und nutzen die Infrastruktur und Funktionen wie Fahrspurlinien und Ampeln vollständig aus, um den Vorhersageprozess aufgrund von Einschränkungen durch Verkehrsvorschriften und Bewegungsmuster zu unterstützen der meisten Fahrzeuge sind ebenfalls begrenzt. Auf der „letzten Meile“ des autonomen Fahrens – autonomen Parkszenarien – werden wir jedoch mit vielen neuen Schwierigkeiten konfrontiert:

- Die Verkehrsregeln und Spurlinienanforderungen auf dem Parkplatz sind nicht streng, und die Fahrzeuge sind nicht streng. Häufig nach Belieben fahren und „Abkürzungen nehmen“

- Um die Parkaufgabe zu erfüllen, muss das Fahrzeug komplexere Parkaktionen ausführen, einschließlich häufigem Rückwärtsfahren, Parken, Lenken usw. Wenn der Fahrer unerfahren ist, kann das Parken zu einem langwierigen Prozess werden

- Auf dem Parkplatz gibt es viele Hindernisse und Unordnung, und der Abstand zwischen den Fahrzeugen ist gering. Eine kleine Unachtsamkeit kann zu Kollisionen und Kratzern führen.

-

Einparkende Fußgänger Laufen Sie oft nach Belieben durch den Veranstaltungsort und Fahrzeuge benötigen mehr Ausweichmaßnahmen

In einem solchen Szenario ist es schwierig, den gewünschten Effekt durch einfache Anwendung des vorhandenen Flugbahnvorhersagemodells zu erzielen, und dem Umschulungsmodell fehlt die Unterstützung entsprechender Daten. Aktuelle Parkszenen-basierte Datensätze wie CNRPark+EXT und CARPK sind nur für die Erkennung freier Parkplätze konzipiert. Die Bilder stammen aus der Ich-Perspektive von Überwachungskameras, weisen niedrige Abtastraten auf und weisen viele Verdeckungen auf, sodass sie nicht in der Lage sind zur Flugbahnvorhersage verwendet werden.

Auf der gerade zu Ende gegangenen 25. IEEE International Conference on Intelligent Transportation Systems (IEEE ITSC 2022) im Oktober 2022 veröffentlichten Forscher der University of California, Berkeley, das erste hochauflösende Video einer Parkszene &. Trajektoriendatensatz, und basierend auf diesem Datensatz wurde ein Trajektorienvorhersagemodell namens „ParkPredict+“ unter Verwendung der CNN- und Transformer-Architektur vorgeschlagen. 🔜 /berkeley.edu/dlp-dataset (Wenn Sie nicht darauf zugreifen können, können Sie die alternative Seite https://www.php.cn/link/966eaa9527eb956f0dc8788132986707 ausprobieren)

Dataset Python API: https://github .com/ MPC-Berkeley/dlp-dataset

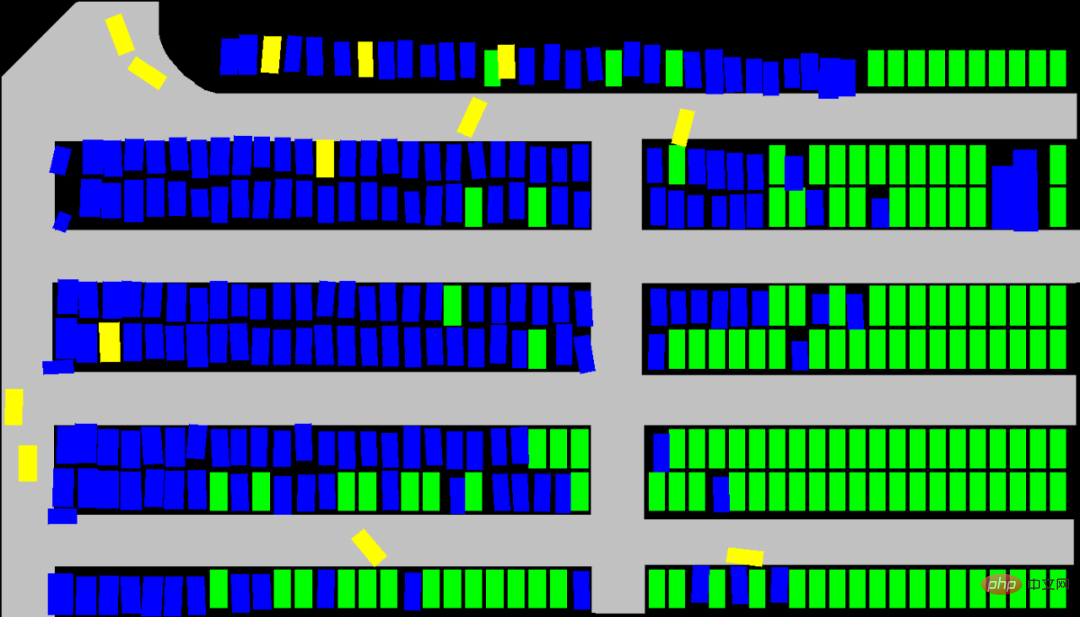

- Informationen zum DatensatzDer Datensatz wurde von einer Drohne mit einer Gesamtdauer von 3,5 Stunden, einer Videoauflösung von 4K und einer Abtastrate von 25 Hz erfasst. Die Ansicht umfasst eine Parkplatzfläche von ca. 140m x 80m, mit insgesamt ca. 400 Stellplätzen. Der Datensatz ist genau kommentiert und es wurden insgesamt 1216 Kraftfahrzeuge, 3904 Fahrräder und 3904 Fußgängerwege erfasst.

- Nach der erneuten Verarbeitung können Trajektoriendaten in Form von JSON gelesen werden

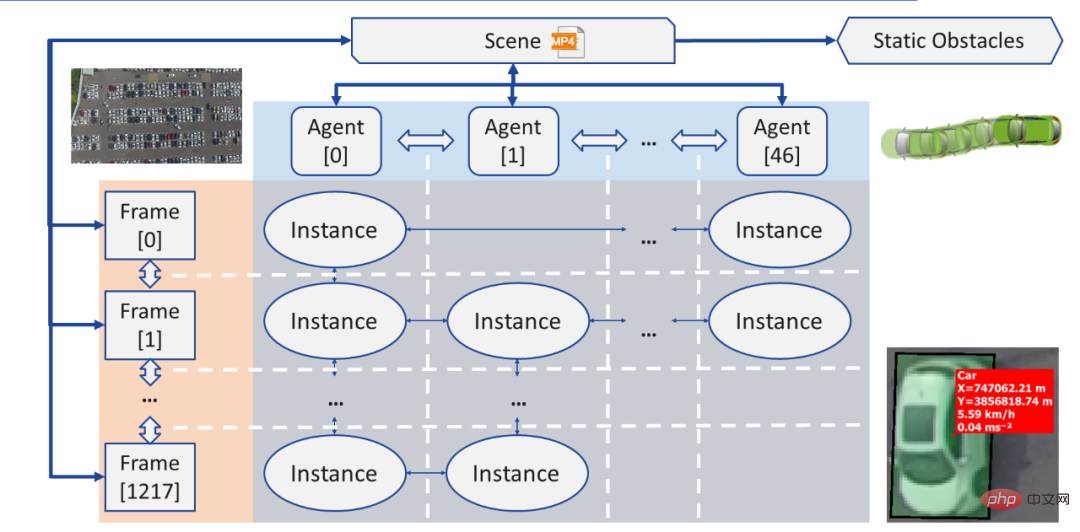

- und in die Datenstruktur des Verbindungsdiagramms (Graph) geladen werden:

- Individuell (Agent): Jeder Agent (Agent) ist ein Objekt, das sich in der aktuellen Szene (Szene) bewegt. Es verfügt über Attribute wie geometrische Form und Typ. Seine Bewegungsbahn wird als verknüpfte Liste mit Instanzen gespeichert. (Verknüpfte Liste)

- Instanz: Jede Instanz ist der Zustand einer Person (Agent) in einem Frame (Frame), einschließlich ihrer Position, ihres Drehwinkels, ihrer Geschwindigkeit und Beschleunigung. Jede Instanz enthält Zeiger auf die Instanz der Person im vorherigen Frame und im nächsten Frame

- Frame (Frame): Jeder Frame (Frame) ist ein Abtastpunkt, der alle zum aktuellen Zeitpunkt sichtbaren Instanzen (Instanz) enthält. und Zeiger, die auf das vorherige und das nächste Bild zeigen

- Hindernis (Hindernis): Hindernisse sind Objekte, die sich in dieser Aufzeichnung überhaupt nicht bewegt haben, einschließlich der Position, Ecke und geometrischen Größe jedes Objekts

- Szene ( Szene): Jede Szene (Szene) entspricht einer aufgezeichneten Videodatei, die Zeiger enthält, die auf das erste und letzte Bild der Aufnahme, alle Personen (Agenten) und alle Hindernisse (Obstacles) zeigen.

Die Daten set ist in zwei Downloadformaten verfügbar:

Nur JSON (empfohlen) : JSON-Dateien enthalten den Typ, die Form, die Flugbahn und andere Informationen aller Personen und können über das Open-Source-Programm Python The heruntergeladen werden Die API liest semantische Bilder (Semantic Images) direkt, zeigt eine Vorschau an und generiert sie. Wenn das Forschungsziel nur die Flugbahn- und Verhaltensvorhersage ist, kann das JSON-Format alle Anforderungen erfüllen.

Originalvideo und Anmerkung: Wenn die Forschung auf maschinellen Sichtfeldthemen wie Zielerkennung, -trennung und -verfolgung basierend auf dem Rohbild der Kamera (Rohbild) basiert, Dann müssen Sie möglicherweise das Originalvideo und das Originallabel herunterladen. Wenn dies erforderlich ist, muss der Forschungsbedarf im Datensatzantrag klar beschrieben werden. Darüber hinaus muss die Anmerkungsdatei selbst analysiert werden.

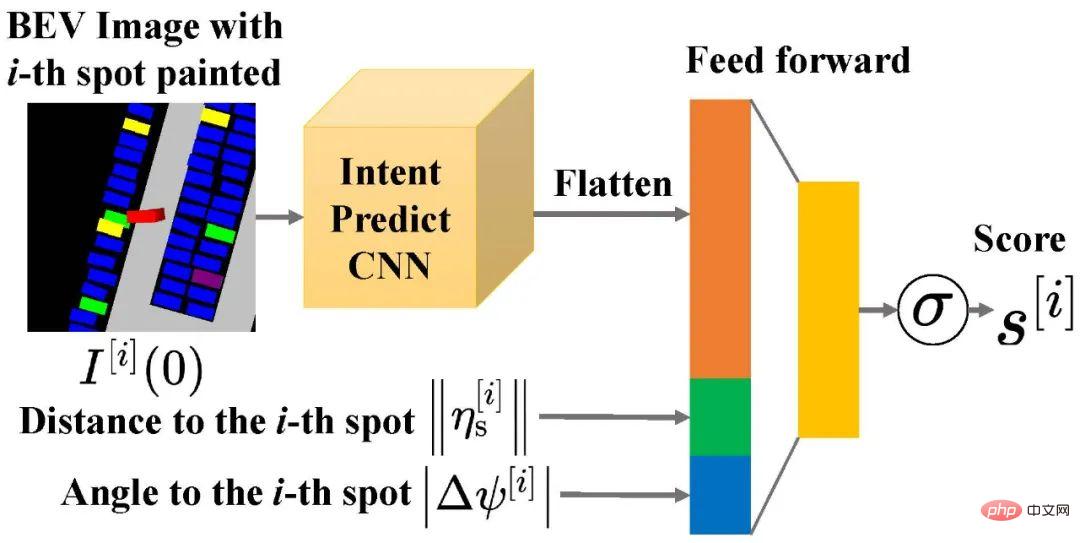

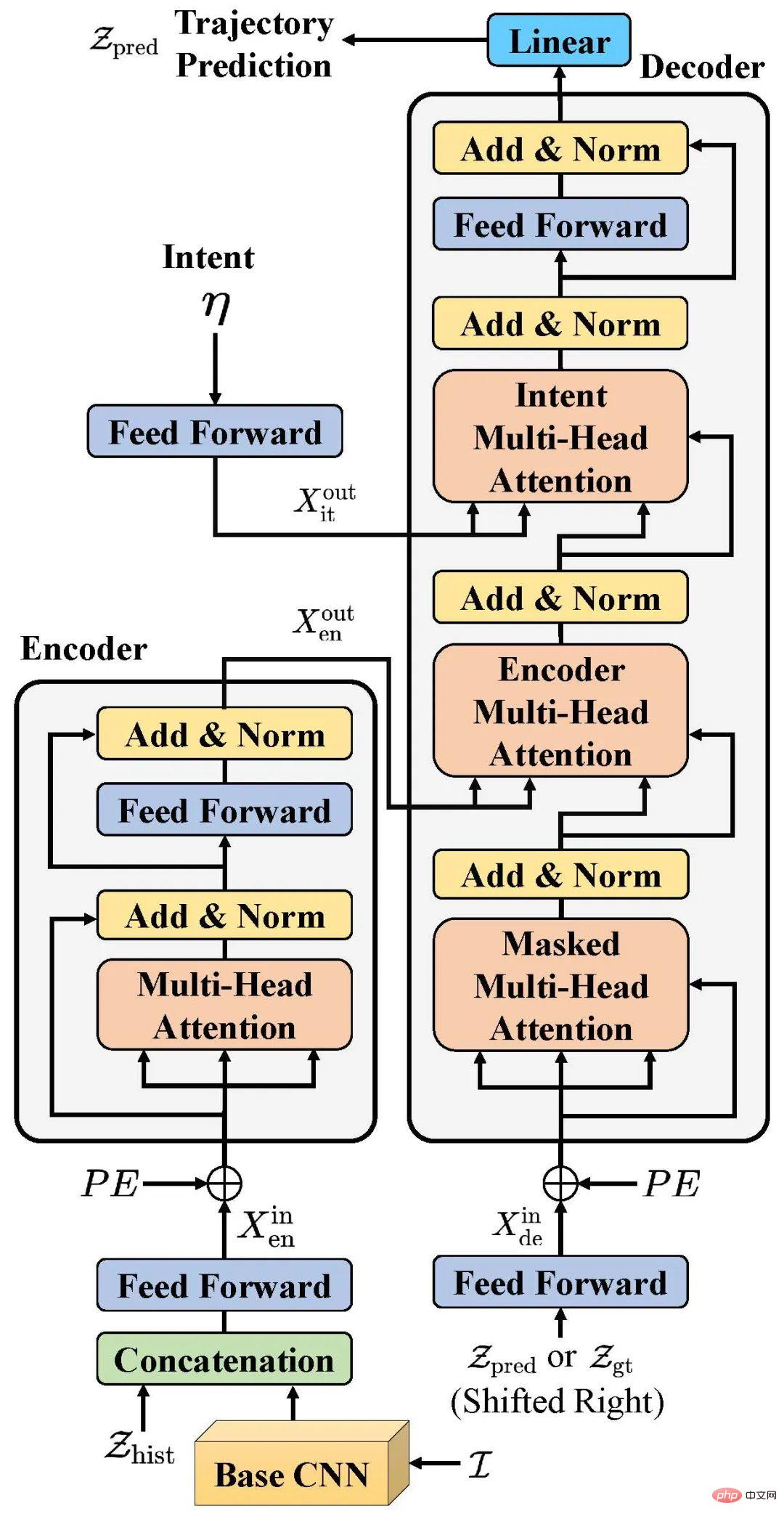

Verhaltens- und Flugbahnvorhersagemodell: ParkPredict+

Als Anwendungsbeispiel verwendete das Forschungsteam diese Daten im Artikel „ParkPredict+: Multimodal Intent and Motion Prediction for Vehicles in Parking Lots with CNN and Transformer“ auf der IEEE ITSC 2022 eingestellt, Basierend auf der CNN- und Transformer-Architektur werden die Absicht (Intent) und die Flugbahn (Trajectory) des Fahrzeugs in der Parkplatzszene vorhergesagt.

Das Team nutzte das CNN-Modell, um die Verteilungswahrscheinlichkeit der Fahrzeugabsicht (Intent) durch die Konstruktion semantischer Bilder vorherzusagen. Dieses Modell muss nur lokale Umgebungsinformationen des Fahrzeugs erstellen und kann die Anzahl der verfügbaren Absichten kontinuierlich entsprechend der aktuellen Umgebung ändern.

Das Team erreichte eine multimodale Absichts- und Verhaltensvorhersage, indem es das Transformer-Modell verbesserte und die Ergebnisse der Absichtsvorhersage, den Bewegungsverlauf des Fahrzeugs und die semantische Karte der Umgebung als Eingabe bereitstellte.

Zusammenfassung

- Als erster hochpräziser Datensatz für Parkszenarien kann der Dragon Lake Parking (DLP)-Datensatz dabei eine groß angelegte Zielerkennung und -verfolgung, die Erkennung freier Parkplätze sowie das Verhalten und die Trajektorien von Fahrzeugen und Fußgängern ermöglichen Szenariodaten und API-Unterstützung werden für Vorhersagen, Nachahmungslernen und andere Forschung bereitgestellt. Durch die Verwendung von CNN und Transformer-Architektur zeigt das ParkPredict+-Modell gute Fähigkeiten bei der Verhaltens- und Flugbahnvorhersage in Parkszenarien. Dragon Lake Parking (DLP) Der Datensatz kann getestet und angewendet werden. Weitere Informationen finden Sie auf der Datensatz-Homepage https://sites.google.com/berkeley.edu/dlp-dataset (falls Sie nicht darauf zugreifen können, können Sie die alternative Seite ausprobieren ).

- https://www.php.cn/link/966eaa9527eb956f0dc8788132986707

- )

Das obige ist der detaillierte Inhalt vonBerkeley hat den ersten hochauflösenden Datensatz und das erste Vorhersagemodell für Parkszenarien als Open-Source-Lösung bereitgestellt, die die Zielerkennung und Flugbahnvorhersage unterstützen.. Für weitere Informationen folgen Sie bitte anderen verwandten Artikeln auf der PHP chinesischen Website!

Heiße KI -Werkzeuge

Undresser.AI Undress

KI-gestützte App zum Erstellen realistischer Aktfotos

AI Clothes Remover

Online-KI-Tool zum Entfernen von Kleidung aus Fotos.

Undress AI Tool

Ausziehbilder kostenlos

Clothoff.io

KI-Kleiderentferner

AI Hentai Generator

Erstellen Sie kostenlos Ai Hentai.

Heißer Artikel

Heiße Werkzeuge

Notepad++7.3.1

Einfach zu bedienender und kostenloser Code-Editor

SublimeText3 chinesische Version

Chinesische Version, sehr einfach zu bedienen

Senden Sie Studio 13.0.1

Leistungsstarke integrierte PHP-Entwicklungsumgebung

Dreamweaver CS6

Visuelle Webentwicklungstools

SublimeText3 Mac-Version

Codebearbeitungssoftware auf Gottesniveau (SublimeText3)

Heiße Themen

1376

1376

52

52

Zehn empfohlene Open-Source-Tools für kostenlose Textanmerkungen

Mar 26, 2024 pm 08:20 PM

Zehn empfohlene Open-Source-Tools für kostenlose Textanmerkungen

Mar 26, 2024 pm 08:20 PM

Bei der Textanmerkung handelt es sich um die Arbeit mit entsprechenden Beschriftungen oder Tags für bestimmte Inhalte im Text. Sein Hauptzweck besteht darin, zusätzliche Informationen zum Text für eine tiefere Analyse und Verarbeitung bereitzustellen, insbesondere im Bereich der künstlichen Intelligenz. Textanmerkungen sind für überwachte maschinelle Lernaufgaben in Anwendungen der künstlichen Intelligenz von entscheidender Bedeutung. Es wird zum Trainieren von KI-Modellen verwendet, um Textinformationen in natürlicher Sprache genauer zu verstehen und die Leistung von Aufgaben wie Textklassifizierung, Stimmungsanalyse und Sprachübersetzung zu verbessern. Durch Textanmerkungen können wir KI-Modellen beibringen, Entitäten im Text zu erkennen, den Kontext zu verstehen und genaue Vorhersagen zu treffen, wenn neue ähnliche Daten auftauchen. In diesem Artikel werden hauptsächlich einige bessere Open-Source-Textanmerkungstools empfohlen. 1.LabelStudiohttps://github.com/Hu

15 empfohlene kostenlose Open-Source-Bildanmerkungstools

Mar 28, 2024 pm 01:21 PM

15 empfohlene kostenlose Open-Source-Bildanmerkungstools

Mar 28, 2024 pm 01:21 PM

Bei der Bildanmerkung handelt es sich um das Verknüpfen von Beschriftungen oder beschreibenden Informationen mit Bildern, um dem Bildinhalt eine tiefere Bedeutung und Erklärung zu verleihen. Dieser Prozess ist entscheidend für maschinelles Lernen, das dabei hilft, Sehmodelle zu trainieren, um einzelne Elemente in Bildern genauer zu identifizieren. Durch das Hinzufügen von Anmerkungen zu Bildern kann der Computer die Semantik und den Kontext hinter den Bildern verstehen und so den Bildinhalt besser verstehen und analysieren. Die Bildanmerkung hat ein breites Anwendungsspektrum und deckt viele Bereiche ab, z. B. Computer Vision, Verarbeitung natürlicher Sprache und Diagramm-Vision-Modelle. Sie verfügt über ein breites Anwendungsspektrum, z. B. zur Unterstützung von Fahrzeugen bei der Identifizierung von Hindernissen auf der Straße und bei der Erkennung und Diagnose von Krankheiten durch medizinische Bilderkennung. In diesem Artikel werden hauptsächlich einige bessere Open-Source- und kostenlose Bildanmerkungstools empfohlen. 1.Makesens

Verwenden Sie ddrescue, um Daten unter Linux wiederherzustellen

Mar 20, 2024 pm 01:37 PM

Verwenden Sie ddrescue, um Daten unter Linux wiederherzustellen

Mar 20, 2024 pm 01:37 PM

DDREASE ist ein Tool zum Wiederherstellen von Daten von Datei- oder Blockgeräten wie Festplatten, SSDs, RAM-Disks, CDs, DVDs und USB-Speichergeräten. Es kopiert Daten von einem Blockgerät auf ein anderes, wobei beschädigte Blöcke zurückbleiben und nur gute Blöcke verschoben werden. ddreasue ist ein leistungsstarkes Wiederherstellungstool, das vollständig automatisiert ist, da es während der Wiederherstellungsvorgänge keine Unterbrechungen erfordert. Darüber hinaus kann es dank der ddasue-Map-Datei jederzeit gestoppt und fortgesetzt werden. Weitere wichtige Funktionen von DDREASE sind: Es überschreibt die wiederhergestellten Daten nicht, füllt aber die Lücken im Falle einer iterativen Wiederherstellung. Es kann jedoch gekürzt werden, wenn das Tool explizit dazu aufgefordert wird. Stellen Sie Daten aus mehreren Dateien oder Blöcken in einer einzigen wieder her

Open Source! Jenseits von ZoeDepth! DepthFM: Schnelle und genaue monokulare Tiefenschätzung!

Apr 03, 2024 pm 12:04 PM

Open Source! Jenseits von ZoeDepth! DepthFM: Schnelle und genaue monokulare Tiefenschätzung!

Apr 03, 2024 pm 12:04 PM

0.Was bewirkt dieser Artikel? Wir schlagen DepthFM vor: ein vielseitiges und schnelles generatives monokulares Tiefenschätzungsmodell auf dem neuesten Stand der Technik. Zusätzlich zu herkömmlichen Tiefenschätzungsaufgaben demonstriert DepthFM auch hochmoderne Fähigkeiten bei nachgelagerten Aufgaben wie dem Tiefen-Inpainting. DepthFM ist effizient und kann Tiefenkarten innerhalb weniger Inferenzschritte synthetisieren. Lassen Sie uns diese Arbeit gemeinsam lesen ~ 1. Titel der Papierinformationen: DepthFM: FastMonocularDepthEstimationwithFlowMatching Autor: MingGui, JohannesS.Fischer, UlrichPrestel, PingchuanMa, Dmytr

Google ist begeistert: JAX-Leistung übertrifft Pytorch und TensorFlow! Es könnte die schnellste Wahl für das GPU-Inferenztraining werden

Apr 01, 2024 pm 07:46 PM

Google ist begeistert: JAX-Leistung übertrifft Pytorch und TensorFlow! Es könnte die schnellste Wahl für das GPU-Inferenztraining werden

Apr 01, 2024 pm 07:46 PM

Die von Google geförderte Leistung von JAX hat in jüngsten Benchmark-Tests die von Pytorch und TensorFlow übertroffen und belegt bei 7 Indikatoren den ersten Platz. Und der Test wurde nicht auf der TPU mit der besten JAX-Leistung durchgeführt. Obwohl unter Entwicklern Pytorch immer noch beliebter ist als Tensorflow. Aber in Zukunft werden möglicherweise mehr große Modelle auf Basis der JAX-Plattform trainiert und ausgeführt. Modelle Kürzlich hat das Keras-Team drei Backends (TensorFlow, JAX, PyTorch) mit der nativen PyTorch-Implementierung und Keras2 mit TensorFlow verglichen. Zunächst wählen sie eine Reihe von Mainstream-Inhalten aus

Langsame Internetgeschwindigkeiten für Mobilfunkdaten auf dem iPhone: Korrekturen

May 03, 2024 pm 09:01 PM

Langsame Internetgeschwindigkeiten für Mobilfunkdaten auf dem iPhone: Korrekturen

May 03, 2024 pm 09:01 PM

Stehen Sie vor einer Verzögerung oder einer langsamen mobilen Datenverbindung auf dem iPhone? Normalerweise hängt die Stärke des Mobilfunk-Internets auf Ihrem Telefon von mehreren Faktoren ab, wie z. B. der Region, dem Mobilfunknetztyp, dem Roaming-Typ usw. Es gibt einige Dinge, die Sie tun können, um eine schnellere und zuverlässigere Mobilfunk-Internetverbindung zu erhalten. Fix 1 – Neustart des iPhone erzwingen Manchmal werden durch einen erzwungenen Neustart Ihres Geräts viele Dinge zurückgesetzt, einschließlich der Mobilfunkverbindung. Schritt 1 – Drücken Sie einfach einmal die Lauter-Taste und lassen Sie sie los. Drücken Sie anschließend die Leiser-Taste und lassen Sie sie wieder los. Schritt 2 – Der nächste Teil des Prozesses besteht darin, die Taste auf der rechten Seite gedrückt zu halten. Lassen Sie das iPhone den Neustart abschließen. Aktivieren Sie Mobilfunkdaten und überprüfen Sie die Netzwerkgeschwindigkeit. Überprüfen Sie es erneut. Fix 2 – Datenmodus ändern 5G bietet zwar bessere Netzwerkgeschwindigkeiten, funktioniert jedoch besser, wenn das Signal schwächer ist

Die Vitalität der Superintelligenz erwacht! Aber mit der Einführung der sich selbst aktualisierenden KI müssen sich Mütter keine Sorgen mehr über Datenengpässe machen

Apr 29, 2024 pm 06:55 PM

Die Vitalität der Superintelligenz erwacht! Aber mit der Einführung der sich selbst aktualisierenden KI müssen sich Mütter keine Sorgen mehr über Datenengpässe machen

Apr 29, 2024 pm 06:55 PM

Ich weine zu Tode. Die Daten im Internet reichen überhaupt nicht aus. Das Trainingsmodell sieht aus wie „Die Tribute von Panem“, und KI-Forscher auf der ganzen Welt machen sich Gedanken darüber, wie sie diese datenhungrigen Esser ernähren sollen. Dieses Problem tritt insbesondere bei multimodalen Aufgaben auf. Zu einer Zeit, als sie ratlos waren, nutzte ein Start-up-Team der Abteilung der Renmin-Universität von China sein eigenes neues Modell, um als erstes in China einen „modellgenerierten Datenfeed selbst“ in die Realität umzusetzen. Darüber hinaus handelt es sich um einen zweigleisigen Ansatz auf der Verständnisseite und der Generierungsseite. Beide Seiten können hochwertige, multimodale neue Daten generieren und Datenrückmeldungen an das Modell selbst liefern. Was ist ein Modell? Awaker 1.0, ein großes multimodales Modell, das gerade im Zhongguancun-Forum erschienen ist. Wer ist das Team? Sophon-Motor. Gegründet von Gao Yizhao, einem Doktoranden an der Hillhouse School of Artificial Intelligence der Renmin University.

Die U.S. Air Force präsentiert ihren ersten KI-Kampfjet mit großem Aufsehen! Der Minister führte die Testfahrt persönlich durch, ohne in den gesamten Prozess einzugreifen, und 100.000 Codezeilen wurden 21 Mal getestet.

May 07, 2024 pm 05:00 PM

Die U.S. Air Force präsentiert ihren ersten KI-Kampfjet mit großem Aufsehen! Der Minister führte die Testfahrt persönlich durch, ohne in den gesamten Prozess einzugreifen, und 100.000 Codezeilen wurden 21 Mal getestet.

May 07, 2024 pm 05:00 PM

Kürzlich wurde die Militärwelt von der Nachricht überwältigt: US-Militärkampfflugzeuge können jetzt mithilfe von KI vollautomatische Luftkämpfe absolvieren. Ja, erst kürzlich wurde der KI-Kampfjet des US-Militärs zum ersten Mal der Öffentlichkeit zugänglich gemacht und sein Geheimnis gelüftet. Der vollständige Name dieses Jägers lautet „Variable Stability Simulator Test Aircraft“ (VISTA). Er wurde vom Minister der US-Luftwaffe persönlich geflogen, um einen Eins-gegen-eins-Luftkampf zu simulieren. Am 2. Mai startete US-Luftwaffenminister Frank Kendall mit einer X-62AVISTA auf der Edwards Air Force Base. Beachten Sie, dass während des einstündigen Fluges alle Flugaktionen autonom von der KI durchgeführt wurden! Kendall sagte: „In den letzten Jahrzehnten haben wir über das unbegrenzte Potenzial des autonomen Luft-Luft-Kampfes nachgedacht, aber es schien immer unerreichbar.“ Nun jedoch,