Technologie-Peripheriegeräte

Technologie-Peripheriegeräte

KI

KI

Fügen Sie Videos in einem Satz Spezialeffekte hinzu; die bisher umfassendste Karte des Insektengehirns

Fügen Sie Videos in einem Satz Spezialeffekte hinzu; die bisher umfassendste Karte des Insektengehirns

Fügen Sie Videos in einem Satz Spezialeffekte hinzu; die bisher umfassendste Karte des Insektengehirns

Verzeichnis:

- Komponist: Kreative und kontrollierbare Bildsynthese mit zusammensetzbaren Bedingungen

- Struktur- und inhaltsgesteuerte Videosynthese mit Diffusion. Modelle

- Die Konnektom eines Insektengehirns

- Unsicherheitsgesteuerte Dynamik für aktives Lernen interatomarer Potenziale

- Kombinatorische Synthese für KI-gesteuerte Materialentdeckung

- Maskierte Bilder sind kontrafaktische Beispiele für robuste Feinabstimmung

- Ein Transformator passt für alle Verteilungen in Multi- Modale Diffusion im Maßstab

- ArXiv Weekly Radiostation: NLP, CV, ML Weitere ausgewählte Artikel (mit Audio)

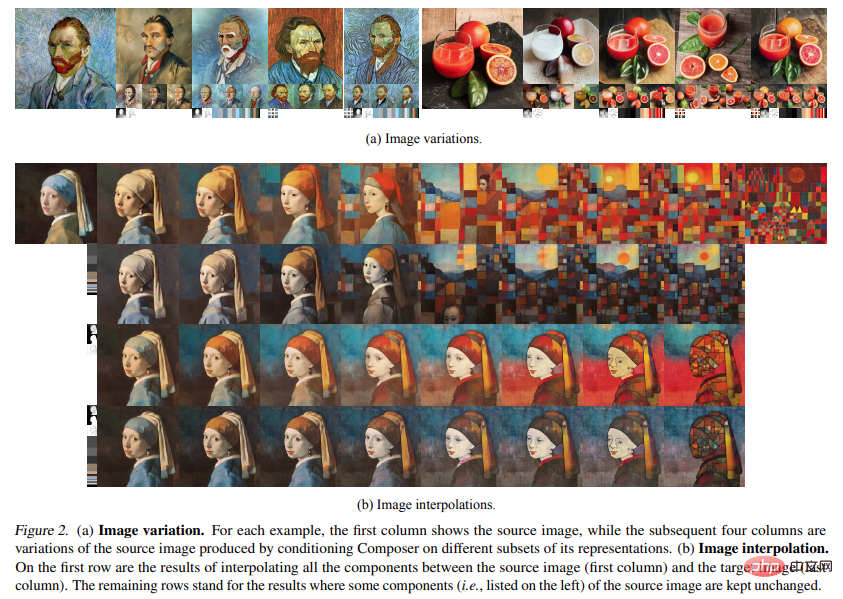

Aufsatz 1: Komponist: Kreative und kontrollierbare Bildsynthese mit zusammensetzbaren Bedingungen

- Autor: Lianghua Huang et al um die Steuerbarkeit von KI-Malmodellen zu verbessern, d. h. die von den Modellen erzeugten Bilder besser an die menschlichen Anforderungen anzupassen. Vor einiger Zeit hat ein Modell namens ControlNet diese Steuerbarkeit auf einen neuen Höhepunkt gebracht. Etwa zur gleichen Zeit erzielten auch Forscher von Alibaba und Ant Group Ergebnisse auf demselben Gebiet. Dieser Artikel ist eine detaillierte Einführung zu diesem Ergebnis.

Neue Ideen für die KI-Malerei: Inländisches Open-Source-Modell mit 5 Milliarden Parametern, das einen Sprung in der synthetischen Steuerbarkeit und Qualität erzielt.

Artikel 2: Struktur- und inhaltsgesteuerte Videosynthese mit Diffusionsmodellen

Autor: Patrick Esser et al

Papieradresse: https://arxiv.org/pdf/ 2302.0301 1 .pdf

- Zusammenfassung: Ich glaube, dass viele Menschen den Charme der generativen KI-Technologie bereits verstanden haben, insbesondere nachdem sie den AIGC-Ausbruch im Jahr 2022 erlebt haben. Die von Stable Diffusion repräsentierte Technologie zur Text-zu-Bild-Generierung war einst auf der ganzen Welt beliebt, und unzählige Benutzer strömten herbei, um ihre künstlerische Fantasie mithilfe von KI auszudrücken ...

- Im Vergleich zur Bildbearbeitung ist die Videobearbeitung eine Anspruchsvolleres Aufgabenproblem, das die Synthese neuer Aktionen erfordert, nicht nur die Änderung des visuellen Erscheinungsbilds, sondern auch die Wahrung der zeitlichen Konsistenz. Es gibt auch viele Unternehmen, die diesen Weg erkunden. Vor einiger Zeit hat Google Dreamix veröffentlicht, um das textbedingte Videodiffusionsmodell (VDM) auf die Videobearbeitung anzuwenden. Kürzlich hat Runway, ein Unternehmen, das an der Entwicklung von Stable Diffusion beteiligt war, ein neues künstliches Intelligenzmodell „Gen-1“ auf den Markt gebracht, das vorhandene Videos in neue umwandeln kann, indem es Textaufforderungen oder einen durch Referenzbilder festgelegten Stil anwendet .Video. Um beispielsweise „Menschen auf der Straße“ in „Tonpuppen“ zu verwandeln, ist nur eine Eingabezeile erforderlich.

Empfohlen: Spezialeffekte mit nur einem Satz oder einem Bild hinzufügen, die Firma Stable Diffusion hat mit AIGC einen neuen Streich gespielt.

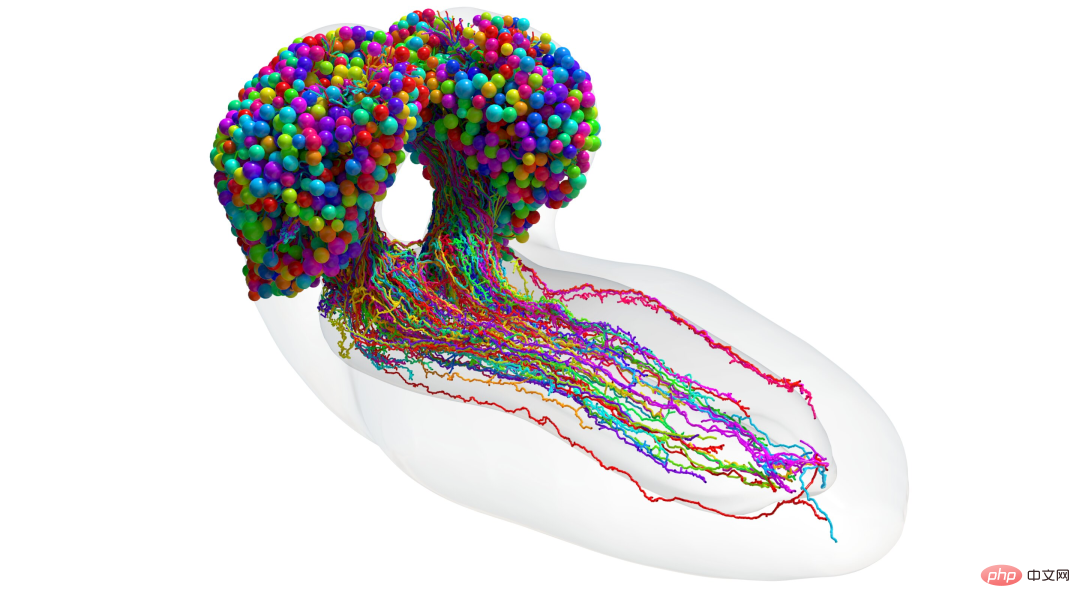

Aufsatz 3: Das Konnektom eines Insektengehirns

Autor: MICHAEL WINDING et al

Aufsatzadresse: https://www.science.org/doi/10.1126/ science .add9330

-

Zusammenfassung: Forscher haben den bisher fortschrittlichsten Atlas des Insektengehirns fertiggestellt, eine bahnbrechende Errungenschaft in der Neurowissenschaft, die Wissenschaftler einem echten Verständnis der Mechanismen des Geistes näher bringt.

Ein internationales Team unter der Leitung der Johns Hopkins University und der University of Cambridge hat eine erstaunlich detaillierte Karte aller neuronalen Verbindungen im Gehirn einer Fruchtfliegenlarve erstellt, einen wissenschaftlichen Prototyp, der mit dem menschlichen Gehirnmodell vergleichbar ist. Die Forschung könnte die zukünftige Hirnforschung unterstützen und neue Architekturen für maschinelles Lernen inspirieren.

Empfehlung: Die bisher vollständigste Insektengehirnkarte, die möglicherweise neue Architekturen für maschinelles Lernen inspiriert.

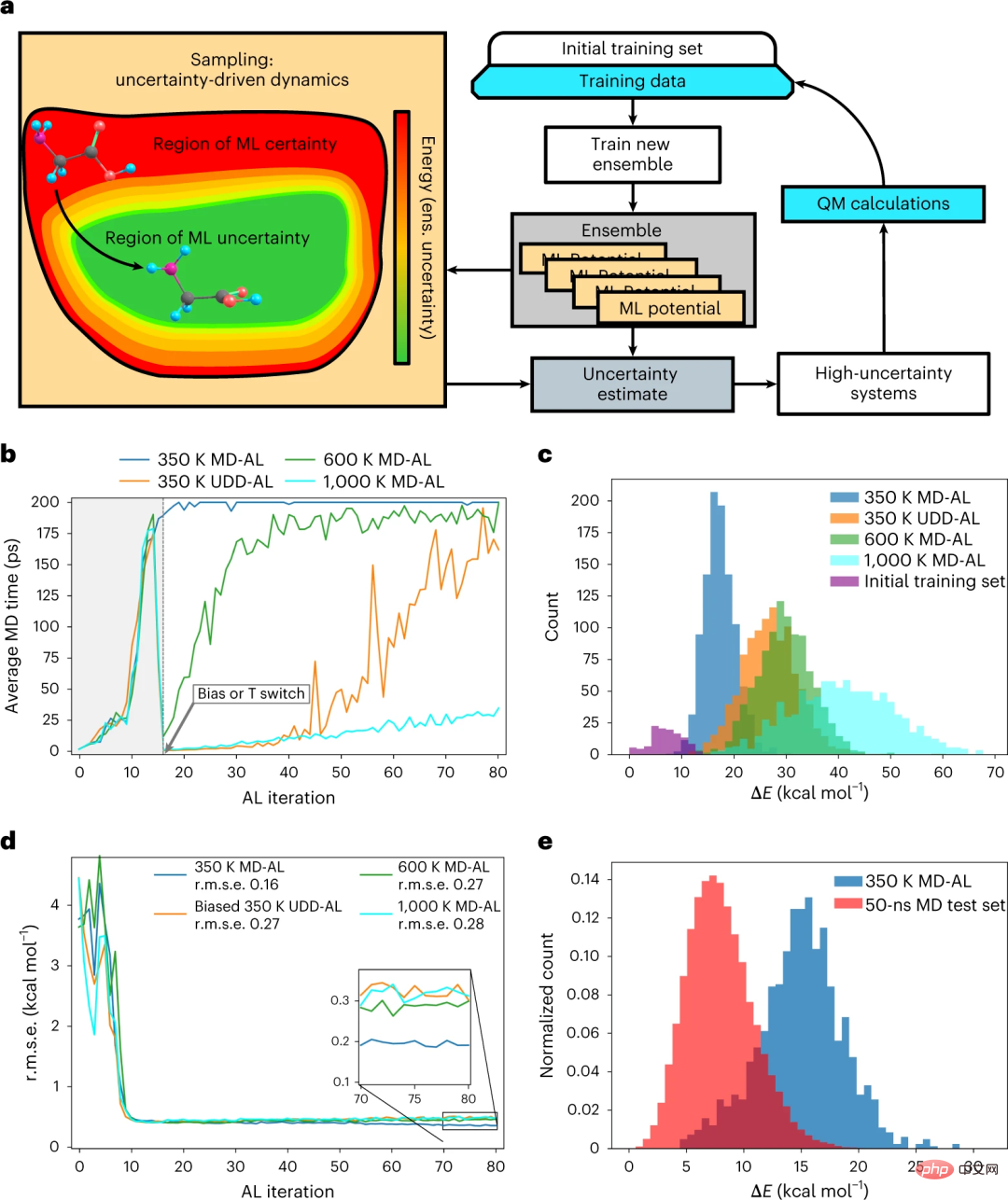

Aufsatz 4: Unsicherheitsgesteuerte Dynamik für aktives Lernen interatomarer Potentiale

- Autor: Maksim Kulichenko et al

- Aufsatzadresse: https://www.nature.com/ Artikel /s43588-023-00406-5

Zusammenfassung: Modelle des maschinellen Lernens (ML), wenn sie auf Datensätzen aus hochpräzisen Quantensimulationen trainiert werden, können genaue und effiziente interatomare Potentiale erzeugen. Aktives Lernen (AL) ist ein leistungsstarkes Werkzeug zur iterativen Generierung verschiedener Datensätze. Bei diesem Ansatz liefert das ML-Modell Unsicherheitsschätzungen und Vorhersagen für jede neue Atomkonfiguration. Wenn die Unsicherheitsschätzung einen bestimmten Schwellenwert überschreitet, wird die Konfiguration in den Datensatz aufgenommen.

Kürzlich haben Forscher des Los Alamos National Laboratory in den Vereinigten Staaten eine Strategie entwickelt: Uncertainty-Driven Dynamics of Active Learning (UDD-AL), um sinnvoll erweiterte Trainingsdaten schneller zu entdecken und die Konfiguration festzulegen. UDD-AL modifiziert die potenziellen Energieoberflächen, die in Molekulardynamiksimulationen verwendet werden, um Bereiche des Konfigurationsraums zu unterstützen, in denen große Modellunsicherheiten bestehen. Die Leistung von UDD-AL wird an zwei AL-Aufgaben demonstriert. Die folgende Abbildung zeigt einen Vergleich der UDD-AL- und MD-AL-Methoden für den Glycin-Testfall.

Empfohlen: Unsicherheitsgesteuerte Dynamik für aktives Lernen für automatische Probenahme.

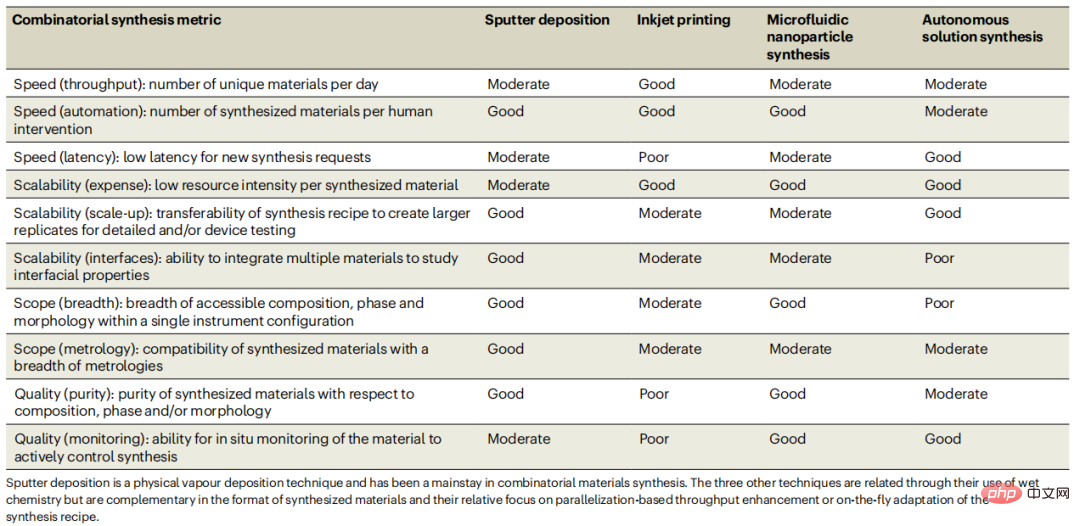

Aufsatz 5: Kombinatorische Synthese für KI-gesteuerte Materialentdeckung

- Autor: John M. Gregoire et al

- Aufsatzadresse: https://www.nature.com/ Artikel /s44160-023-00251-4

Zusammenfassung: Synthese ist der Eckpfeiler des Experimentierens mit Festkörpermaterialien, und jede Synthesetechnik erfordert notwendigerweise die Änderung einiger Syntheseparameter, am häufigsten der Zusammensetzung und der Glühtemperatur. Unter kombinatorischer Synthese versteht man im Allgemeinen die automatisierte/parallele Materialsynthese zur Erstellung von Materialsammlungen mit systematischen Variationen eines oder mehrerer Syntheseparameter. Durch künstliche Intelligenz gesteuerte experimentelle Arbeitsabläufe stellen neue Anforderungen an die kombinatorische Synthese.

Hier geben Caltech-Forscher einen Überblick über die kombinatorische Synthese und stellen sich eine Zukunft der beschleunigten Materialwissenschaft vor, die durch die gemeinsame Entwicklung von kombinatorischer Synthese und KI-Technologien vorangetrieben wird. und zehn Metriken zur Bewertung der Kompromisse zwischen verschiedenen Technologien festgelegt, die Geschwindigkeit, Skalierbarkeit, Umfang und Qualität abdecken. Diese Metriken helfen bei der Bewertung der Eignung einer Technologie für einen bestimmten Arbeitsablauf und veranschaulichen, wie Fortschritte in der kombinatorischen Synthese eine neue Ära der beschleunigten Materialwissenschaft einleiten werden. Im Folgenden sind die Syntheseindikatoren und jeweiligen Bewertungen der kombinierten Syntheseplattform aufgeführt.

Empfohlen: Nature Synthesis Review: Kombinatorische Synthese für die durch künstliche Intelligenz gesteuerte Materialentdeckung.

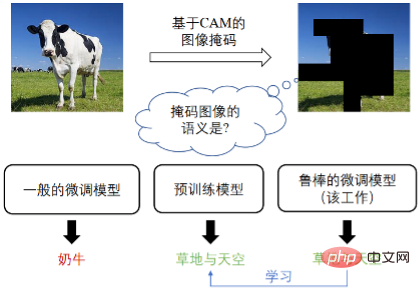

Aufsatz 6: Maskierte Bilder sind kontrafaktische Beispiele für eine robuste Feinabstimmung

- Autor: Yao Xiao et al.

- Papieradresse: https://arxiv.org/abs/2303.03052

Zusammenfassung: Sun Yat-sen University Intelligenzkonvergenz Laboratory (HCP) hat fruchtbare Erfolge bei AIGC und multimodalen Großmodellen erzielt. In der jüngsten AAAI 2023 und CVPR 2023 wurden mehr als zehn Arbeiten ausgewählt, die zu den Spitzenreitern globaler Forschungseinrichtungen zählen. Eine der Arbeiten implementierte den Einsatz von Kausalmodellen, um die Kontrollierbarkeit und Generalisierung multimodaler großer Modelle beim Tuning deutlich zu verbessern – „Masked Images Are Counterfactual Samples for Robust Fine-tuning“.

Empfehlung: Neuer Durchbruch im HCP-Labor der Sun Yat-sen-Universität: Aktualisierung multimodaler großer Modelle mit Kausalparadigma.

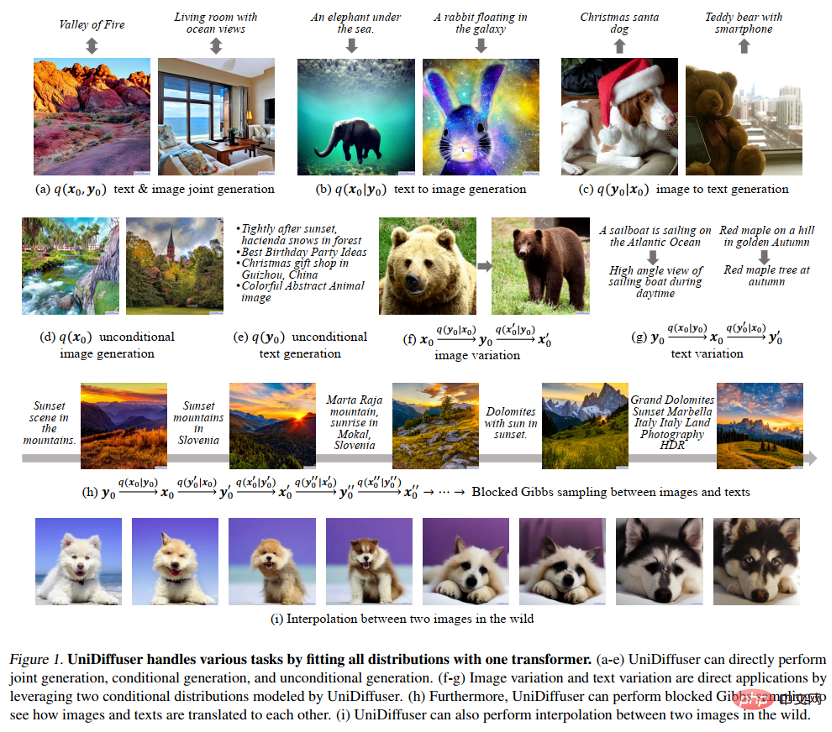

Aufsatz 7: Ein Transformator passt alle Verteilungen in multimodaler Diffusion im Maßstab an

- Autor: Fan Bao et al.

- Aufsatzadresse: https://ml.cs. tsinghua .edu.cn/diffusion/unidiffuser.pdf

Zusammenfassung: Dieses Papier schlägt ein probabilistisches Modellierungsframework UniDiffuser vor, das für Multimodalität entwickelt wurde, und übernimmt die transformatorbasierte Netzwerkarchitektur U-, die vom Team ViT vorgeschlagen wurde trainierte ein Modell mit einer Milliarde Parametern auf dem Open-Source-Bild- und Textdatensatz LAION-5B in großem Maßstab, wodurch ein zugrunde liegendes Modell eine Vielzahl von Generierungsaufgaben mit hoher Qualität erledigen konnte (Abbildung 1). Vereinfacht ausgedrückt kann es neben der unidirektionalen Textgenerierung auch mehrere Funktionen wie Bildgenerierung, gemeinsame Bild- und Textgenerierung, bedingungslose Bild- und Textgenerierung, Bild- und Textumschreibung usw. realisieren, was die Produktion erheblich verbessert Effizienz von Text- und Bildinhalten und verbessert die Generierung von Text und Grafiken weiter.

Empfehlung: Das Team von Tsinghua Zhu Jun hat das erste große multimodale Diffusionsmodell auf Basis von Transformer als Open Source bereitgestellt, bei dem Text und Grafiken zusammenarbeiten und neu geschrieben werden.

ArXiv Weekly Radiostation

Heart of Machine kooperiert mit der von Chu Hang, Luo Ruotian und Mei Hongyuan initiierten ArXiv Weekly Radiostation und wählt diese Woche weitere wichtige Artikel auf der Grundlage von 7 Artikeln aus, darunter NLP, CV, ML. Es gibt 10 Es werden ausgewählte Artikel in jedem Fachgebiet sowie abstrakte Einführungen der Beiträge in Audioform bereitgestellt.

Die 10 ausgewählten NLP-Artikel dieser Woche sind:

1. GLEN: General-Purpose Event Detection for Thousands of Types

2 Modelle: Aktuelle Entwicklungen und Ausblick. (von C.-C. Jay Kuo)

und GPT-4 mit schnellem Lernen: Vielversprechende Ergebnisse, Einschränkungen und Potenzial 6. Analysieren Transformer beim Vorhersagen des maskierten Wortes? (von Sanjeev Arora) 7. Die Erlernbarkeit des kontextbezogenen Lernens für Abstractive Discharge Summary Generation? (von Yuji Matsumoto)

9

1. Von lokalen Binärmustern zu Pixeldifferenznetzwerken für effizientes visuelles Repräsentationslernen (von Matti Pietikäinen, Li Liu)

2. Mehrteilige 3D-Formbaugruppe mit mehreren Gelenken auf Kategorieebene. (von Wojciech Matusik, Leonidas Guibas)

3. PartNeRF: Generieren teilebewusster, bearbeitbarer 3D-Formen ohne 3D-Überwachung. (von Leonidas Guibas)

4. Erforschung der wiederkehrenden langfristigen zeitlichen Fusion für die 3D-Wahrnehmung in mehreren Ansichten. (von Xiangyu Zhang)

5. Schnappen Sie sich, was Sie brauchen: Überdenken Sie die Erkennung komplexer Tabellenstrukturen mit flexibler Komponentenberatung. (von Bing Liu)

6. Einheitliche visuelle Beziehungserkennung mit Seh- und Sprachmodellen. (von Ming-Hsuan Yang)

7. Kontrastives halbüberwachtes Lernen für die Wiederherstellung von Unterwasserbildern über eine zuverlässige Bank. (von Huan Liu)

8. InstMove: Instanzbewegung für objektzentrierte Videosegmentierung. (von Xiang Bai, Alan Yuille)

9. ViTO: Vision Transformer-Operator. (von George Em Karniadakis)

10. Ein einfaches Framework für die Segmentierung und Erkennung von offenem Vokabular. (von Jianfeng Gao, Lei Zhang)

本周 10 篇 ML 精选论文是:

1. Generalisierung und Entkopplung des neuronalen Kollapses über die Hyperspherical Uniformity Gap. (von Bernhard Schölkopf)

2. AutoTransfer: AutoML mit Wissenstransfer – eine Anwendung zur grafischen Darstellung neuronaler Netze. (von Jure Leskovec)

3. Relationales Multitasking-Lernen: Modellierung von Beziehungen zwischen Daten und Aufgaben. (von Jure Leskovec)

4. Interpretierbare Ausreißerzusammenfassung. (von Samuel Madden)

5. Auf visuellen Eingabeaufforderungen basierendes personalisiertes föderiertes Lernen. (von Dacheng Tao)

6. Interpretierbare gemeinsame Ereignis-Teilchen-Rekonstruktion für die Neutrinophysik bei NOvA mit spärlichen CNNs und Transformatoren. (von Pierre Baldi)

7. FedLP: Schichtweiser Bereinigungsmechanismus für kommunikations- und recheneffizientes föderiertes Lernen. (von Fei Wang, Khaled B. Letaief)

8. Traffic4cast auf der NeurIPS 2022 – Prognostizieren Sie die Dynamik entlang von Diagrammkanten anhand spärlicher Knotendaten: Gesamtstadtverkehr und voraussichtliche Ankunftszeit mithilfe stationärer Fahrzeugdetektoren. (von Sepp Hochreiter)

9. Erreichen eines besseren Stabilitäts-Plastizitäts-Kompromisses durch Hilfsnetzwerke beim kontinuierlichen Lernen. (von Thomas Hofmann)

10. Lenkungsprototyp mit zeitnaher Abstimmung für probenfreies kontinuierliches Lernen. (von Dimitris N. Metaxas)

Das obige ist der detaillierte Inhalt vonFügen Sie Videos in einem Satz Spezialeffekte hinzu; die bisher umfassendste Karte des Insektengehirns. Für weitere Informationen folgen Sie bitte anderen verwandten Artikeln auf der PHP chinesischen Website!

Heiße KI -Werkzeuge

Undresser.AI Undress

KI-gestützte App zum Erstellen realistischer Aktfotos

AI Clothes Remover

Online-KI-Tool zum Entfernen von Kleidung aus Fotos.

Undress AI Tool

Ausziehbilder kostenlos

Clothoff.io

KI-Kleiderentferner

AI Hentai Generator

Erstellen Sie kostenlos Ai Hentai.

Heißer Artikel

Heiße Werkzeuge

Notepad++7.3.1

Einfach zu bedienender und kostenloser Code-Editor

SublimeText3 chinesische Version

Chinesische Version, sehr einfach zu bedienen

Senden Sie Studio 13.0.1

Leistungsstarke integrierte PHP-Entwicklungsumgebung

Dreamweaver CS6

Visuelle Webentwicklungstools

SublimeText3 Mac-Version

Codebearbeitungssoftware auf Gottesniveau (SublimeText3)

Heiße Themen

1371

1371

52

52

Bytedance Cutting führt SVIP-Supermitgliedschaft ein: 499 Yuan für ein fortlaufendes Jahresabonnement, das eine Vielzahl von KI-Funktionen bietet

Jun 28, 2024 am 03:51 AM

Bytedance Cutting führt SVIP-Supermitgliedschaft ein: 499 Yuan für ein fortlaufendes Jahresabonnement, das eine Vielzahl von KI-Funktionen bietet

Jun 28, 2024 am 03:51 AM

Diese Seite berichtete am 27. Juni, dass Jianying eine von FaceMeng Technology, einer Tochtergesellschaft von ByteDance, entwickelte Videobearbeitungssoftware ist, die auf der Douyin-Plattform basiert und grundsätzlich kurze Videoinhalte für Benutzer der Plattform produziert Windows, MacOS und andere Betriebssysteme. Jianying kündigte offiziell die Aktualisierung seines Mitgliedschaftssystems an und führte ein neues SVIP ein, das eine Vielzahl von KI-Schwarztechnologien umfasst, wie z. B. intelligente Übersetzung, intelligente Hervorhebung, intelligente Verpackung, digitale menschliche Synthese usw. Preislich beträgt die monatliche Gebühr für das Clipping von SVIP 79 Yuan, die Jahresgebühr 599 Yuan (Hinweis auf dieser Website: entspricht 49,9 Yuan pro Monat), das fortlaufende Monatsabonnement beträgt 59 Yuan pro Monat und das fortlaufende Jahresabonnement beträgt 499 Yuan pro Jahr (entspricht 41,6 Yuan pro Monat). Darüber hinaus erklärte der Cut-Beamte auch, dass diejenigen, die den ursprünglichen VIP abonniert haben, das Benutzererlebnis verbessern sollen

Kontexterweiterter KI-Codierungsassistent mit Rag und Sem-Rag

Jun 10, 2024 am 11:08 AM

Kontexterweiterter KI-Codierungsassistent mit Rag und Sem-Rag

Jun 10, 2024 am 11:08 AM

Verbessern Sie die Produktivität, Effizienz und Genauigkeit der Entwickler, indem Sie eine abrufgestützte Generierung und ein semantisches Gedächtnis in KI-Codierungsassistenten integrieren. Übersetzt aus EnhancingAICodingAssistantswithContextUsingRAGandSEM-RAG, Autor JanakiramMSV. Obwohl grundlegende KI-Programmierassistenten natürlich hilfreich sind, können sie oft nicht die relevantesten und korrektesten Codevorschläge liefern, da sie auf einem allgemeinen Verständnis der Softwaresprache und den gängigsten Mustern beim Schreiben von Software basieren. Der von diesen Coding-Assistenten generierte Code eignet sich zur Lösung der von ihnen zu lösenden Probleme, entspricht jedoch häufig nicht den Coding-Standards, -Konventionen und -Stilen der einzelnen Teams. Dabei entstehen häufig Vorschläge, die geändert oder verfeinert werden müssen, damit der Code in die Anwendung übernommen wird

Kann LLM durch Feinabstimmung wirklich neue Dinge lernen: Die Einführung neuen Wissens kann dazu führen, dass das Modell mehr Halluzinationen hervorruft

Jun 11, 2024 pm 03:57 PM

Kann LLM durch Feinabstimmung wirklich neue Dinge lernen: Die Einführung neuen Wissens kann dazu führen, dass das Modell mehr Halluzinationen hervorruft

Jun 11, 2024 pm 03:57 PM

Large Language Models (LLMs) werden auf riesigen Textdatenbanken trainiert und erwerben dort große Mengen an realem Wissen. Dieses Wissen wird in ihre Parameter eingebettet und kann dann bei Bedarf genutzt werden. Das Wissen über diese Modelle wird am Ende der Ausbildung „verdinglicht“. Am Ende des Vortrainings hört das Modell tatsächlich auf zu lernen. Richten Sie das Modell aus oder verfeinern Sie es, um zu erfahren, wie Sie dieses Wissen nutzen und natürlicher auf Benutzerfragen reagieren können. Aber manchmal reicht Modellwissen nicht aus, und obwohl das Modell über RAG auf externe Inhalte zugreifen kann, wird es als vorteilhaft angesehen, das Modell durch Feinabstimmung an neue Domänen anzupassen. Diese Feinabstimmung erfolgt mithilfe von Eingaben menschlicher Annotatoren oder anderer LLM-Kreationen, wobei das Modell auf zusätzliches Wissen aus der realen Welt trifft und dieses integriert

Keine OpenAI-Daten erforderlich, schließen Sie sich der Liste der großen Codemodelle an! UIUC veröffentlicht StarCoder-15B-Instruct

Jun 13, 2024 pm 01:59 PM

Keine OpenAI-Daten erforderlich, schließen Sie sich der Liste der großen Codemodelle an! UIUC veröffentlicht StarCoder-15B-Instruct

Jun 13, 2024 pm 01:59 PM

An der Spitze der Softwaretechnologie kündigte die Gruppe von UIUC Zhang Lingming zusammen mit Forschern der BigCode-Organisation kürzlich das StarCoder2-15B-Instruct-Großcodemodell an. Diese innovative Errungenschaft erzielte einen bedeutenden Durchbruch bei Codegenerierungsaufgaben, übertraf erfolgreich CodeLlama-70B-Instruct und erreichte die Spitze der Codegenerierungsleistungsliste. Die Einzigartigkeit von StarCoder2-15B-Instruct liegt in seiner reinen Selbstausrichtungsstrategie. Der gesamte Trainingsprozess ist offen, transparent und völlig autonom und kontrollierbar. Das Modell generiert über StarCoder2-15B Tausende von Anweisungen als Reaktion auf die Feinabstimmung des StarCoder-15B-Basismodells, ohne auf teure manuelle Annotationen angewiesen zu sein.

Um ein neues wissenschaftliches und komplexes Frage-Antwort-Benchmark- und Bewertungssystem für große Modelle bereitzustellen, haben UNSW, Argonne, die University of Chicago und andere Institutionen gemeinsam das SciQAG-Framework eingeführt

Jul 25, 2024 am 06:42 AM

Um ein neues wissenschaftliches und komplexes Frage-Antwort-Benchmark- und Bewertungssystem für große Modelle bereitzustellen, haben UNSW, Argonne, die University of Chicago und andere Institutionen gemeinsam das SciQAG-Framework eingeführt

Jul 25, 2024 am 06:42 AM

Herausgeber | Der Frage-Antwort-Datensatz (QA) von ScienceAI spielt eine entscheidende Rolle bei der Förderung der Forschung zur Verarbeitung natürlicher Sprache (NLP). Hochwertige QS-Datensätze können nicht nur zur Feinabstimmung von Modellen verwendet werden, sondern auch effektiv die Fähigkeiten großer Sprachmodelle (LLMs) bewerten, insbesondere die Fähigkeit, wissenschaftliche Erkenntnisse zu verstehen und zu begründen. Obwohl es derzeit viele wissenschaftliche QS-Datensätze aus den Bereichen Medizin, Chemie, Biologie und anderen Bereichen gibt, weisen diese Datensätze immer noch einige Mängel auf. Erstens ist das Datenformular relativ einfach, die meisten davon sind Multiple-Choice-Fragen. Sie sind leicht auszuwerten, schränken jedoch den Antwortauswahlbereich des Modells ein und können die Fähigkeit des Modells zur Beantwortung wissenschaftlicher Fragen nicht vollständig testen. Im Gegensatz dazu offene Fragen und Antworten

Yolov10: Ausführliche Erklärung, Bereitstellung und Anwendung an einem Ort!

Jun 07, 2024 pm 12:05 PM

Yolov10: Ausführliche Erklärung, Bereitstellung und Anwendung an einem Ort!

Jun 07, 2024 pm 12:05 PM

1. Einleitung In den letzten Jahren haben sich YOLOs aufgrund ihres effektiven Gleichgewichts zwischen Rechenkosten und Erkennungsleistung zum vorherrschenden Paradigma im Bereich der Echtzeit-Objekterkennung entwickelt. Forscher haben das Architekturdesign, die Optimierungsziele, Datenerweiterungsstrategien usw. von YOLO untersucht und erhebliche Fortschritte erzielt. Gleichzeitig behindert die Verwendung von Non-Maximum Suppression (NMS) bei der Nachbearbeitung die End-to-End-Bereitstellung von YOLO und wirkt sich negativ auf die Inferenzlatenz aus. In YOLOs fehlt dem Design verschiedener Komponenten eine umfassende und gründliche Prüfung, was zu erheblicher Rechenredundanz führt und die Fähigkeiten des Modells einschränkt. Es bietet eine suboptimale Effizienz und ein relativ großes Potenzial zur Leistungsverbesserung. Ziel dieser Arbeit ist es, die Leistungseffizienzgrenze von YOLO sowohl in der Nachbearbeitung als auch in der Modellarchitektur weiter zu verbessern. zu diesem Zweck

SOTA Performance, eine multimodale KI-Methode zur Vorhersage der Protein-Ligand-Affinität in Xiamen, kombiniert erstmals molekulare Oberflächeninformationen

Jul 17, 2024 pm 06:37 PM

SOTA Performance, eine multimodale KI-Methode zur Vorhersage der Protein-Ligand-Affinität in Xiamen, kombiniert erstmals molekulare Oberflächeninformationen

Jul 17, 2024 pm 06:37 PM

Herausgeber |. KX Im Bereich der Arzneimittelforschung und -entwicklung ist die genaue und effektive Vorhersage der Bindungsaffinität von Proteinen und Liganden für das Arzneimittelscreening und die Arzneimitteloptimierung von entscheidender Bedeutung. Aktuelle Studien berücksichtigen jedoch nicht die wichtige Rolle molekularer Oberflächeninformationen bei Protein-Ligand-Wechselwirkungen. Auf dieser Grundlage schlugen Forscher der Universität Xiamen ein neuartiges Framework zur multimodalen Merkmalsextraktion (MFE) vor, das erstmals Informationen über Proteinoberfläche, 3D-Struktur und -Sequenz kombiniert und einen Kreuzaufmerksamkeitsmechanismus verwendet, um verschiedene Modalitäten zu vergleichen Ausrichtung. Experimentelle Ergebnisse zeigen, dass diese Methode bei der Vorhersage von Protein-Ligand-Bindungsaffinitäten Spitzenleistungen erbringt. Darüber hinaus belegen Ablationsstudien die Wirksamkeit und Notwendigkeit der Proteinoberflächeninformation und der multimodalen Merkmalsausrichtung innerhalb dieses Rahmens. Verwandte Forschungen beginnen mit „S

GlobalFoundries erschließt Märkte wie KI und erwirbt die Galliumnitrid-Technologie von Tagore Technology und zugehörige Teams

Jul 15, 2024 pm 12:21 PM

GlobalFoundries erschließt Märkte wie KI und erwirbt die Galliumnitrid-Technologie von Tagore Technology und zugehörige Teams

Jul 15, 2024 pm 12:21 PM

Laut Nachrichten dieser Website vom 5. Juli veröffentlichte GlobalFoundries am 1. Juli dieses Jahres eine Pressemitteilung, in der die Übernahme der Power-Galliumnitrid (GaN)-Technologie und des Portfolios an geistigem Eigentum von Tagore Technology angekündigt wurde, in der Hoffnung, seinen Marktanteil in den Bereichen Automobile und Internet auszubauen Anwendungsbereiche für Rechenzentren mit künstlicher Intelligenz, um höhere Effizienz und bessere Leistung zu erforschen. Da sich Technologien wie generative künstliche Intelligenz (GenerativeAI) in der digitalen Welt weiterentwickeln, ist Galliumnitrid (GaN) zu einer Schlüssellösung für nachhaltiges und effizientes Energiemanagement, insbesondere in Rechenzentren, geworden. Auf dieser Website wurde die offizielle Ankündigung zitiert, dass sich das Ingenieurteam von Tagore Technology im Rahmen dieser Übernahme mit GF zusammenschließen wird, um die Galliumnitrid-Technologie weiterzuentwickeln. G