Technologie-Peripheriegeräte

Technologie-Peripheriegeräte

KI

KI

Anwendung von Graph Machine Learning im Empfehlungsgeschäft der Ant Group

Anwendung von Graph Machine Learning im Empfehlungsgeschäft der Ant Group

Anwendung von Graph Machine Learning im Empfehlungsgeschäft der Ant Group

In diesem Artikel wird die Anwendung des maschinellen Graphenlernens im Ant-Empfehlungssystem vorgestellt. Im eigentlichen Geschäft von Ant gibt es eine große Menge zusätzlicher Informationen, wie z. B. Wissensdiagramme, Benutzerverhalten anderer Unternehmen usw. Diese Informationen sind normalerweise für das Empfehlungsgeschäft sehr hilfreich. Wir verwenden Diagrammalgorithmen, um diese Informationen und Empfehlungssysteme zu verbessern Benutzerinteressen zum Ausdruck bringen. Der Volltext konzentriert sich hauptsächlich auf die folgenden Aspekte:

- Hintergrund

- Grafikbasierte Empfehlungen

- Soziale und textbasierte Empfehlungen

- Domainübergreifende Empfehlungen

01 Hintergrund

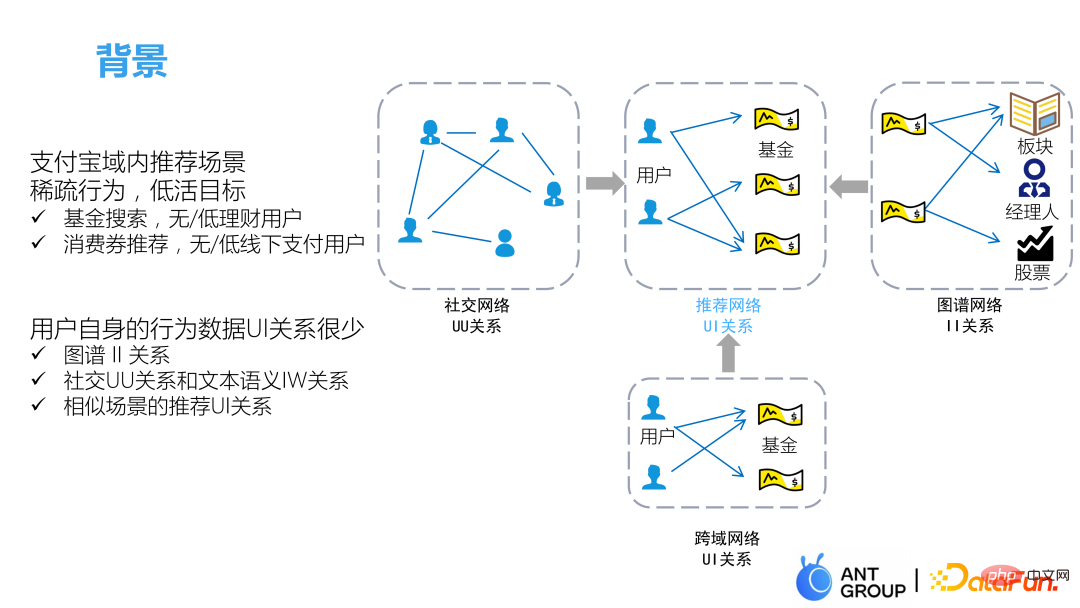

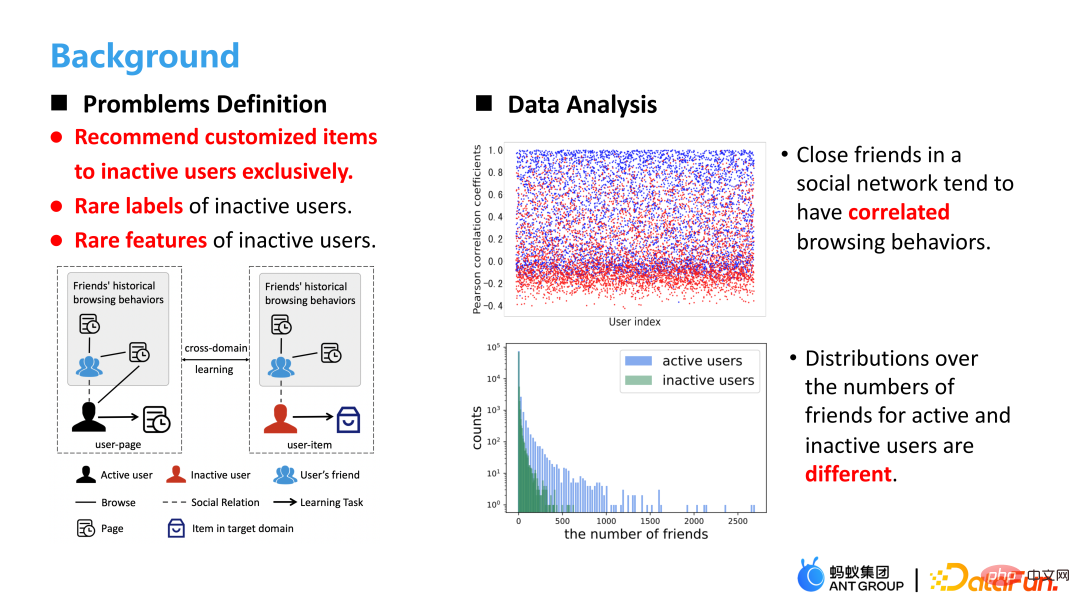

Neben der Hauptzahlungsfunktion verfügt Alipay auch über eine Vielzahl von Empfehlungsszenarien, darunter Bundempfehlungen, Fondsempfehlungen, Verbrauchergutscheinempfehlungen usw. Der größte Unterschied zwischen Empfehlungen innerhalb der Alipay-Domäne und anderen Empfehlungen besteht darin, dass das Benutzerverhalten spärlich und die Aktivität gering ist. Viele Benutzer öffnen Alipay nur zum Bezahlen und achten nicht auf andere Dinge. Daher gibt es im Empfehlungsnetzwerk nur sehr wenige Datensätze auf der UI-Seite, und unser Fokus liegt auch auf der Empfehlung von Zielen mit geringer Aktivität. Um beispielsweise die DAU zu erhöhen, dürfen Inhalte nur auf dem Hosenbund von Benutzern mit geringer Aktivität platziert werden, und normale Benutzer können sie nicht sehen; Sie verfügen nicht über ein Finanzmanagement oder haben eine niedrige Finanzmanagementposition. Die Empfehlung von Verbrauchergutscheinen soll auch den Offline-Konsum von Benutzern mit geringer Aktivität fördern.

Es gibt nur sehr wenige Informationen über die historische Verhaltenssequenz von Benutzern mit geringer Aktivität, und einige Empfehlungsmethoden, die direkt auf der historischen Verhaltenssequenz der Benutzeroberfläche basieren, sind möglicherweise nicht für unser Szenario geeignet . Deshalb haben wir die folgenden drei Szenarioinformationen eingeführt, um die UI-Beziehungsinformationen in der Alipay-Domäne zu verbessern:

- UU-Beziehung des sozialen Netzwerks

- II-Diagrammbeziehung.

- UI-Beziehungen in anderen Szenarien

Durch die UU-Beziehung von sozialen Netzwerken können die Klickpräferenzen von Freunden mit geringer Aktivität ermittelt werden Abgeleitet und zwischen Elementen kann die Diagrammbeziehung Benutzerpräferenzinformationen für ähnliche Elemente ermitteln und erweitern. Schließlich ist das Benutzerverhalten in domänenübergreifenden Szenarien auch für Empfehlungsaufgaben im aktuellen Szenario sehr hilfreich.

02Graphbasierte Empfehlung

Das Benutzerverhalten ist in vielen Empfehlungsszenarien spärlich, insbesondere bei der Charakterisierung neuer Benutzer sind nur sehr wenige Verhaltensinformationen verfügbar, sodass normalerweise viele eingeführt werden müssen Hilfsinformationen wie Attribute, Kontexte, Bilder usw. Was wir hier vorstellen, sind Wissensgraphen – Wissensgraphen. 1. Vorhandene Herausforderungen Das Diagramm selbst ist möglicherweise nicht für dieses Unternehmen konzipiert und enthält daher viele nutzlose Informationen. Außerdem ist der Trainingsprozess sehr zeitaufwändig. Eine gängige Lösung besteht darin, nur die Kanten im Diagramm beizubehalten, die unseren Produkten zugeordnet werden können, und alle anderen Kanten zu löschen. Dies kann jedoch zu Informationsverlusten führen, da auch andere Kanten nützlich sind.

Zweitens gibt es, wenn das Diagramm als Hilfsinformation verwendet wird, keine Möglichkeit, Benutzerpräferenzen an den Rändern innerhalb des Diagramms zu aggregieren. Wie in der Abbildung oben gezeigt, kann der Grund, warum Benutzer 1 Film 1 und Film 2 mag, darin liegen, dass sie dieselbe Hauptrolle spielen, während Benutzer 2 Film 2 und Film 3 mag, weil sie demselben Genre angehören. Wenn Sie zur Modellierung nur die UI- und II-Beziehungen gewöhnlicher Diagrammmodelle verwenden, können Sie nur die Korrelation zwischen Benutzern und Filmen ermitteln, es gibt jedoch keine Möglichkeit, diese potenziellen Absichten der Benutzer in der Grafik zusammenzufassen.

Daher werden wir später hauptsächlich die beiden Probleme der Kartendestillation und Kartenverfeinerung lösen. 2. Vorhandene Methoden Lernen der Graphendarstellung wird in eine Einbettung konvertiert und verbindet die Einbettung dann direkt mit dem UI-Modell. Diese Art von Methode lernt die Korrelation im Diagramm im Voraus und wandelt sie in eine Einbettung um. Daher ist es schwierig, die Ähnlichkeit zwischen dem Benutzer und dem Wissensvorsprung zu messen, und die Probleme der Diagrammdestillation und -verfeinerung werden nicht gelöst.

② Pfadbasiertes Modell Die pfadbasierte Methode zerlegt das Diagramm basierend auf den Wissenskanten im Diagramm in mehrere Metapfade, der Prozess der Erstellung von Metapfaden erfordert jedoch viel Expertenwissen und spiegelt auch nicht die Präferenz des Benutzers für Wissensvorsprünge wider.

③ GCN-basiertes Modell

Die GCN-basierte Methode modelliert die UI- und II-Beziehungen. Im Allgemeinen werden unterschiedliche Gewichte entsprechend verschiedenen Kantentypen durch die Aufmerksamkeitsmethode verwendet. Aber das Gewicht der Kante bezieht sich nur auf die Darstellung der Knoten an beiden Enden der Kante und hat nichts mit der Darstellung des Zielknotens zu tun.

3. Lösung

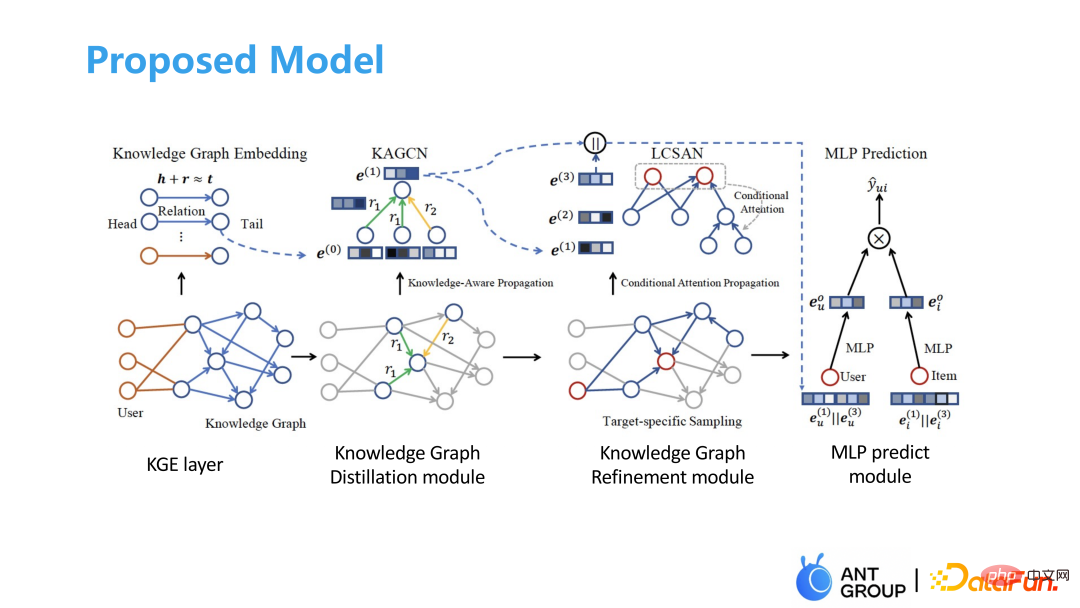

Zuerst erhalten wir die Diagrammdarstellung durch Lernen der Diagrammdarstellung und verwenden die Wissensabhängigkeitsweitergabe zum Lernen und Aggregieren Erhalten Sie die Diagrammdarstellung unterschiedlicher Kantenbedeutung und verwenden Sie dann ein Destillationsmodul, um die Kanten im Diagramm abzutasten und zu entrauschen. Fügen Sie dann bedingte Aufmerksamkeit hinzu, um das Diagramm zu verfeinern, und erstellen Sie schließlich ein Zwei-Turm-Modell, um das Ergebnis zu erhalten.

Die spezifischen Details jedes Teils werden unten vorgestellt:

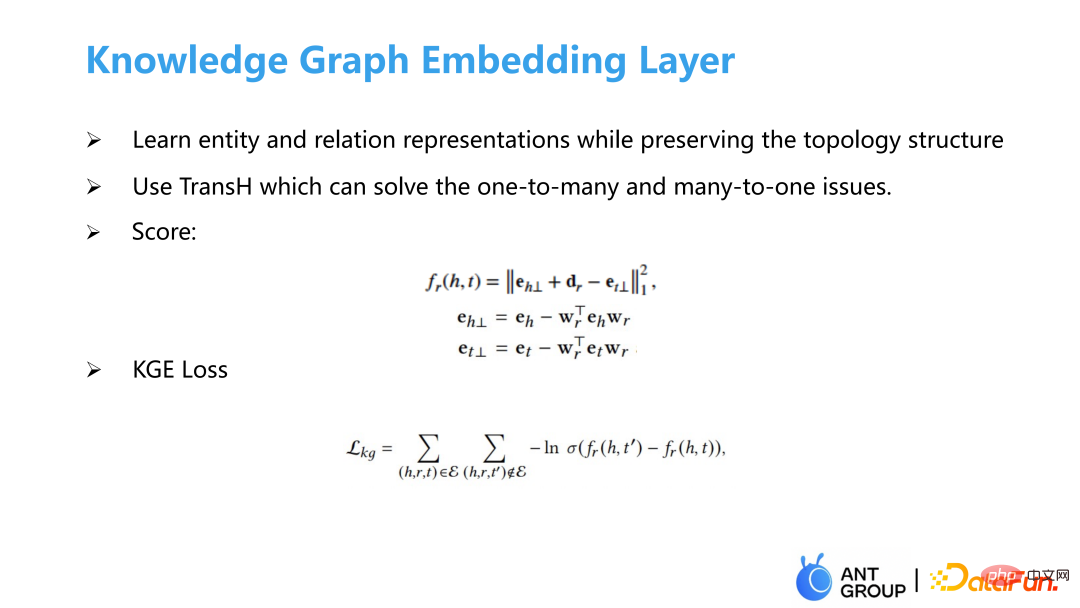

① Diagrammdarstellung lernen. Ebene

Wir verwenden hier die traditionelle Darstellung des TransH-Spektrums Modell, Weil es in unserem Diagramm viele Viele-zu-Eins- und Eins-zu-Viele-Kanten gibt. Jeder Knoten wird über TransH auf den Raum abgebildet, der der Kante entspricht, und die Ähnlichkeit der beiden Kanten wird in diesem Raum gemessen.

②

Lernebene für die Diagrammdarstellung

Nach dem Erlernen der Darstellung der Diagrammkante wird die Darstellung der Diagrammkante darin aggregiert der Nachbar, und dann Durch die Suche nach unterschiedlichen Der cos-Abstand des Kantenraums dient als Darstellung der gewichteten aggregierten Diagrammpunkte der Punkte. Da die Kanten im Diagramm sehr verrauscht sind, führen wir eine zusätzliche Stichprobe und Stichprobe für den Ziel-Untergraphen durch, basierend auf den Gewichten, die wir gelernt haben. Der Ziel-Untergraph ist der Teilgraph zweiter Ordnung. Die Stichprobenergebnisse werden in kleineren Teilgraphen zusammengefasst.

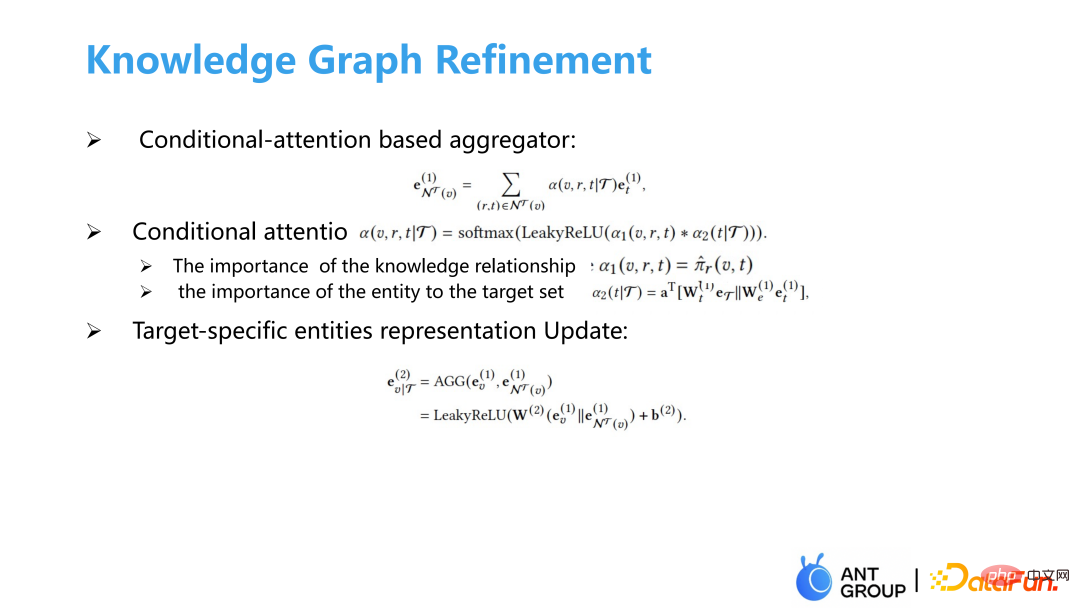

③ Lernebene für die grafische Darstellung

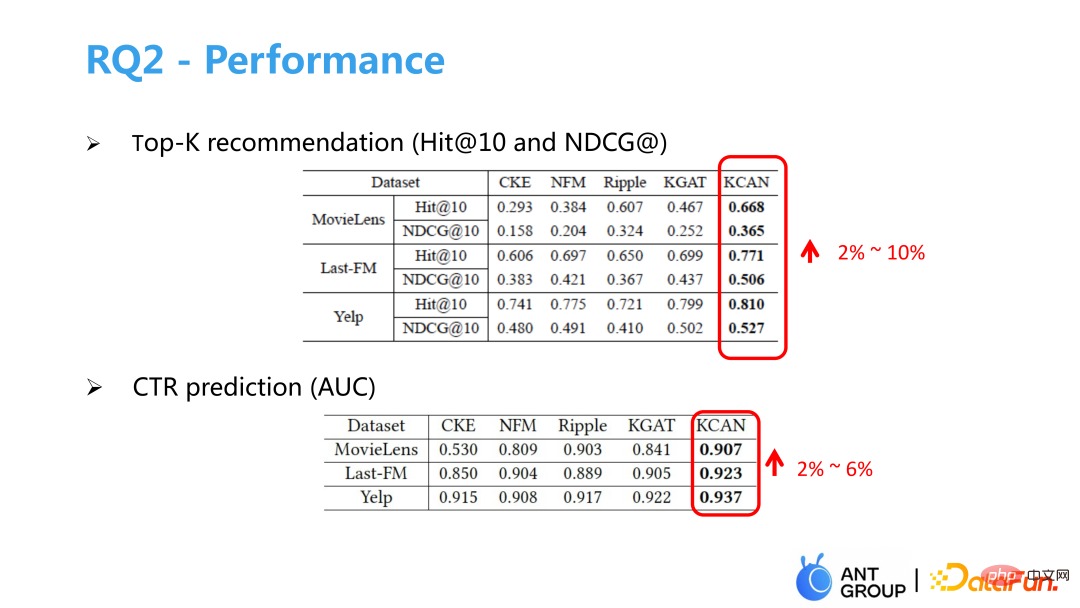

Nachdem wir den Untergraphen erhalten haben, führen wir eine bedingte Aufmerksamkeit durch, um die Bedeutung des Vorteils für den Benutzer und das Produkt zu messen. Die Bedeutung einer Kante lässt sich in zwei Teile unterteilen: Zum einen ist die Kante selbst sehr wichtig, zum anderen schenkt der Benutzer dieser Kante große Aufmerksamkeit. Die Bedeutung der Kante selbst wurde in der wissensabhängigen Aufmerksamkeit im vorherigen Schritt gelernt. Es ist keine zusätzliche Schulung erforderlich. Die Bedeutung der Kante wird durch das Zusammenfügen der Darstellungen aller Zielsätze und der Darstellungen beider Endpunkte ermittelt Rand in eine Aufmerksamkeit Holen Sie sich die bedingte Aufmerksamkeit und führen Sie dann eine Aggregation basierend auf der bedingten Aufmerksamkeit durch. Erstellen Sie zum Schluss ein Zwillingsturmmodell, um den paarweisen Verlust zu messen, und verwenden Sie es Methode zur Optimierung der Karte Gleichzeitig ist die Darstellung von Lernverlust und Empfehlung der Zielverlust des Systems. Die Komplexität unseres Algorithmus hängt linear von der Anzahl der Punkte und Kanten ab. 4. Experimentelle Ergebnisse Ausgewählt Entwickelte einige Datensätze für Empfehlungssysteme und Wissensgraphen Im Fondsempfehlungsdatensatz unseres Unternehmens umfasst die Basislinie hauptsächlich die auf Regelmäßigkeit basierende CKE-Methode, die auf Matrixzerlegung basierende NMF-Methode, die pfadbasierte heterogene Diagrammmethode RippleNet und die GCN-basierte KGAT.

②Aufmerksamkeitsvisualisierung

In der Wissensaufmerksamkeit auf der linken Seite bezieht sich der Wert an jeder Kante nur auf die beiden Endknoten in der oberen rechten Ecke von U532 i Der Wert auf 1678 ist sehr gering, daher wird es schwierig sein, diese Kante später zu testen. Die Benutzer der beiden Bilder rechts sind beide U0, aber die Produkte sind unterschiedlich, sodass das Gewicht des gesamten Bildes völlig unterschiedlich ist. In der Vorhersage U0-i2466 Und U0- Wenn die Korrelation von i780 völlig anders ist und U0- i Das. Gewicht des Pfades ganz rechts von 2466 Beim Sex ist der Weg ganz rechts wichtiger. ③ModellbewertungWir haben den Modelleffekt auf Top-K-Empfehlungs- und CTR-Klickaufgaben gemessen, die viel besser sind als die Verbesserung des Basismodells. A/B-Testexperimente mit Online-Fondsempfehlungen führen ebenfalls zu einer Verbesserung der Wirksamkeit. Schließlich führten wir ein Ablationsexperiment durch und die Ergebnisse zeigten, dass die Wirkung der Entfernung des bedingten Aufmerksamkeits- oder Wissensaufmerksamkeitsmodells abnehmen würde, was die Wirksamkeit der von uns vorgenommenen Verbesserungen bewies. 03Empfehlung basierend auf sozialen Netzwerken und Text

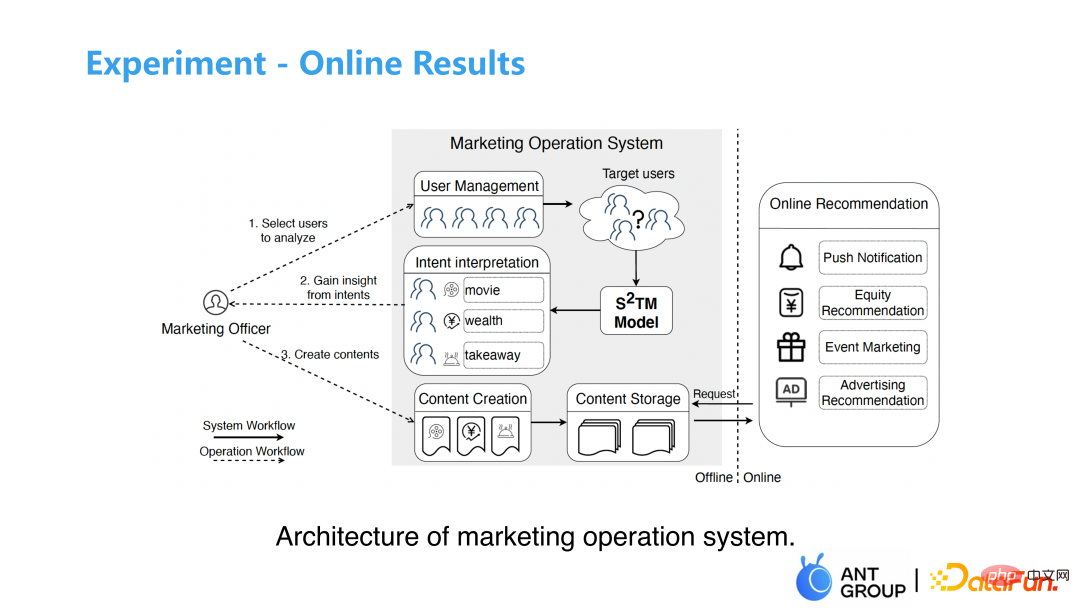

Die Empfehlung basierend auf sozialen Netzwerken und Texten ist hier kein Empfehlungsszenario im herkömmlichen Sinne, sondern dient hauptsächlich dazu, den Betrieb dabei zu unterstützen, Benutzerabsichten zu verstehen und Inhalte zu erstellen für Benutzer. Einige neue Inhalte und neue Anzeigen, um das Benutzerwachstum zu steuern. Wie gestaltet man beispielsweise das Cover einer Gürtelempfehlung? Erst nachdem der Betreiber die Absichten des Benutzers vollständig verstanden hat, kann er Inhalte entwerfen, die den psychologischen Erwartungen des Benutzers entsprechen.

1. Bestehende Herausforderungen

Eine natürliche Möglichkeit besteht darin, die Verteilung von Benutzern auf Absichten und Absichten auf Produkte zu messen. Behandeln Sie den Benutzer als Dokument und das Produkt als Wort die Absicht des Benutzers zu zerlegen. Tatsächlich sind die Klicks der Benutzer jedoch spärlich, insbesondere wenn unsere Zielkunden wenig aktive Benutzer sind, und Produktklicks folgen einer Long-Tail-Verteilung, was es schwierig macht, die Interessen und Absichten der Benutzer zu erfassen.

2. Lösung

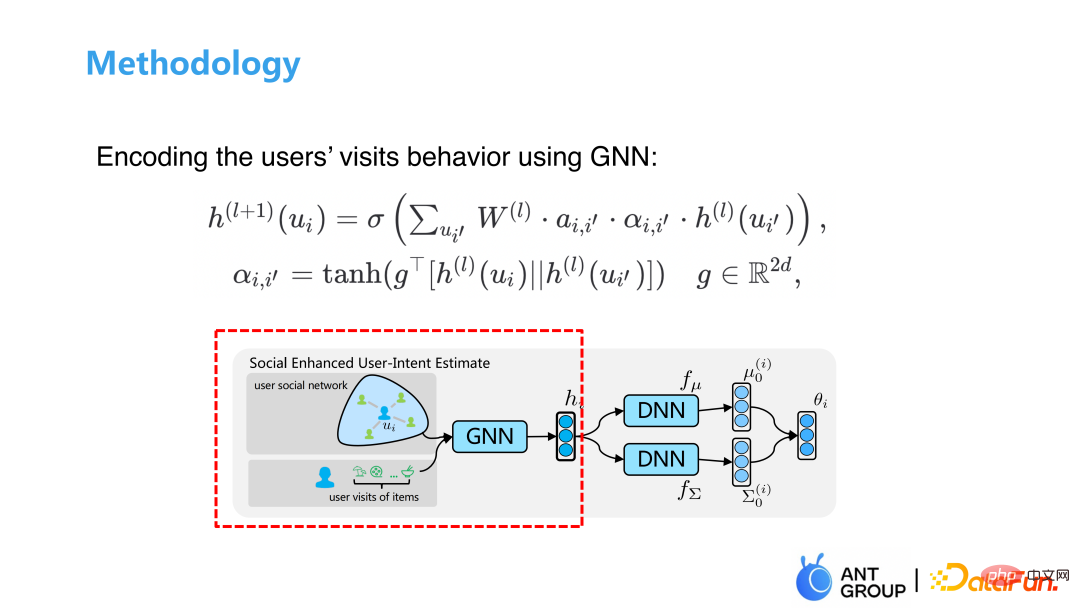

Zuerst fügen wir sowohl die UU-Beziehung als auch die UI-Beziehung zu GNN hinzu, um das Klickverhalten des Benutzers zu lernen und zu messen, bevor wir eine Annäherung vornehmen Die Verteilung, die vorherige Verteilung des traditionellen Topic-Modells, ist eine Dirichlet-Verteilung. Sie sieht der Dirichlet-Verteilung sehr ähnlich und kann durch einige umfangreiche Parametrisierungsarbeiten verwendet werden Verteilung differenzierbar.

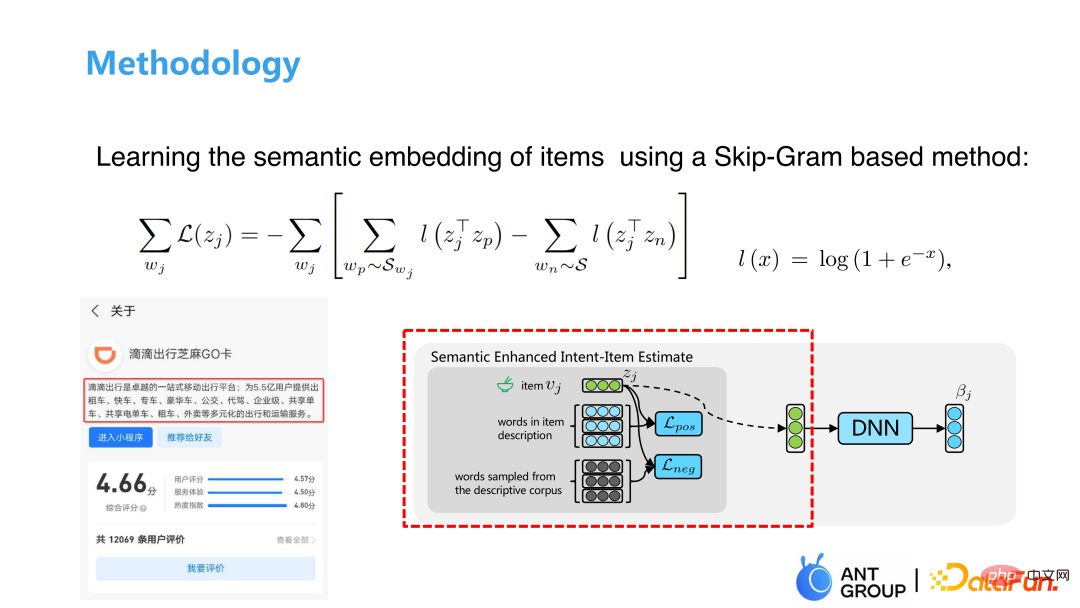

Nachdem Sie die Beziehung zwischen Benutzern gelernt haben, besteht der nächste Schritt darin, die Beziehung zwischen Korpus zu lernen. Im Bild oben befindet sich ein kleines Programm, das eine Textbeschreibung enthält. Es verwendet das Skip-Gram-Modell, um die Ähnlichkeit zwischen dem Element und den positiven und negativen Stichproben zu berechnen, die Ähnlichkeit des Wortes zu ermitteln und die Ähnlichkeit des Elements zu ermitteln Wort an die Benutzerabsichtsdarstellung durch ein DNN, und schließlich wird die KL-Divergenz-Beschränkungsverteilung an die von uns gewünschte Form angepasst. 3. Experimentelle Ergebnisse

Unser Datensatz sind die Klickdaten des Benutzers für 7 aufeinanderfolgende Tage, die etwa 500.000 Benutzer, 9206 Elemente und das historische Klickverhalten von 200 Millionen Benutzern umfassen, einschließlich sozialer Netzwerke Mit 7 Millionen Kanten hat jeder Benutzer durchschnittlich 14-15 Nachbarknoten.

Wir führten Offline- bzw. Online-Experimentaltests durch und maßen die Ähnlichkeit zwischen Benutzern und die Ähnlichkeit zwischen der Semantik unter verschiedenen Themen. Online-Experimente geben den von unserem Modell vorhergesagten Benutzerabsichten Rückmeldung an Operationen, und Operationen entwerfen Beschreibungstexte und Anzeigeseiten basierend auf Benutzerabsichten, um Online-Empfehlungen abzugeben. Die experimentelle Verbindung des Gesamtmodells kann relativ lang sein, da einige Materialien während des Vorgangs hergestellt werden. Das Ziel des Online-A/B-Experiments ist in zwei Teile unterteilt auf unserem Modell-Feedback, und der andere Teil besteht darin, die Erfahrung historischer Experten zu nutzen. Experimentelle Ergebnisse zeigen, dass unser Modell im Vergleich zu früher sowohl in Offline- als auch in Online-Experimenten erheblich verbessert wurde. 04

Empfehlung basierend auf domänenübergreifenden

Unser Empfehlungsziel sind gering aktive Benutzer, die möglicherweise keine Tags oder Merkmale haben und noch nie verwendet haben Alipay. In der obigen Abbildung haben wir zunächst die Ähnlichkeit zwischen Benutzern analysiert, wobei Blau die Verhaltensähnlichkeit mit Fremden und Rot die Verhaltensähnlichkeit mit Freunden darstellt. Die Ergebnisse zeigen, dass Freunde mit engeren Beziehungen einen höheren Grad an Verhaltensüberschneidungen aufweisen, sodass wir der Freund des Benutzers sind Verhaltensinformationen können als Ergänzung zu den Benutzerinformationen verwendet werden. Dann analysierten wir die Anzahl der Freunde aktiver und inaktiver Benutzer und stellten fest, dass die Anzahl der Freunde aktiver Benutzer viel höher war als die Anzahl inaktiver Benutzer. Daher fragten wir uns, ob wir die Klickinformationen aktiver Benutzer auf ihre inaktiven Benutzer migrieren könnten Informationen für Freunde. Zusätzliche Empfehlungen.

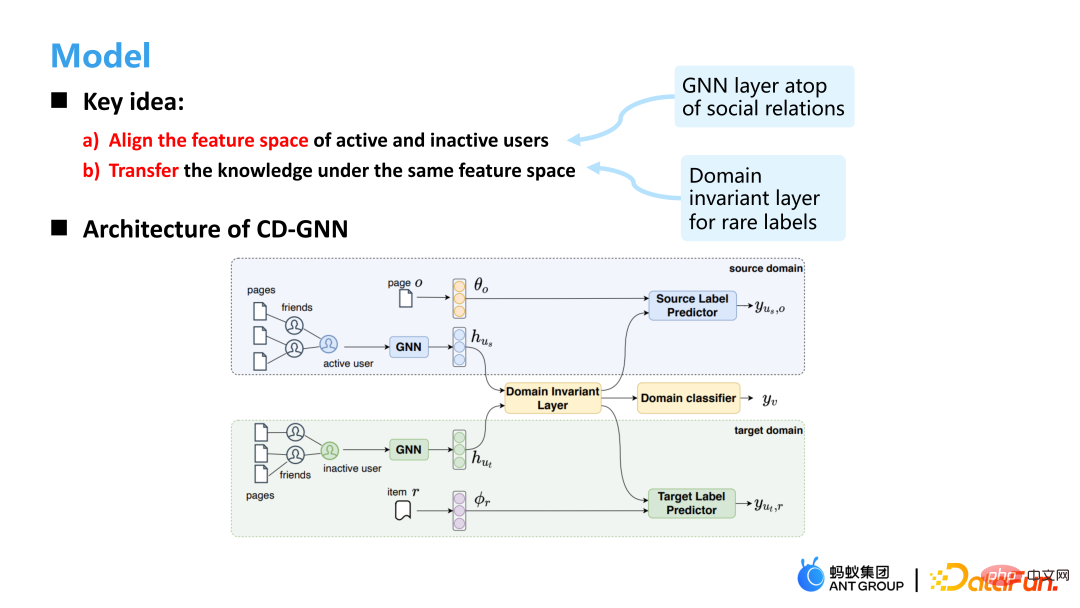

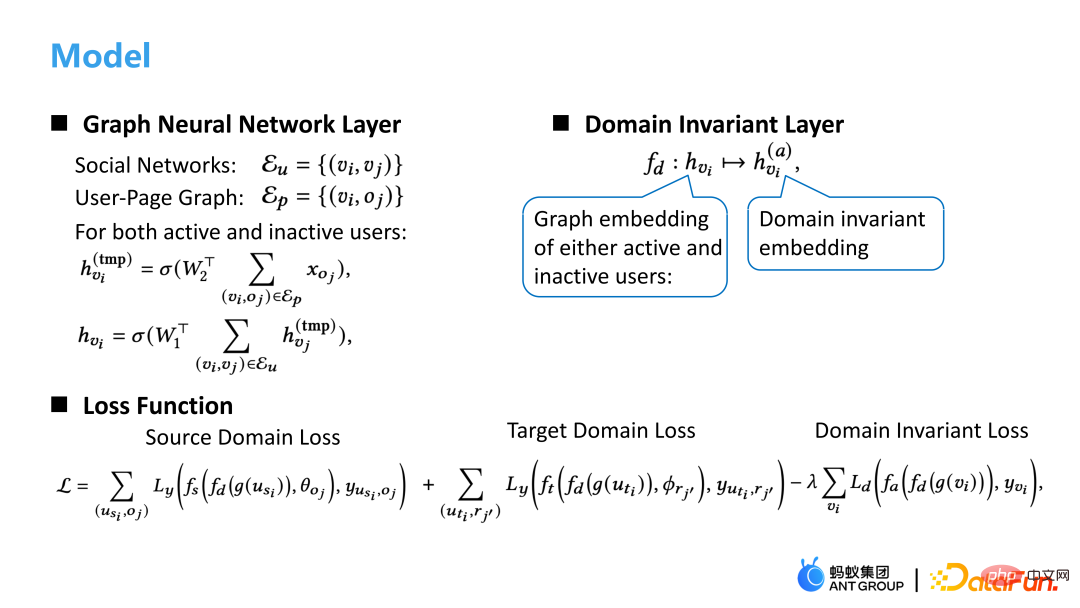

Eine Kernidee unseres Modells besteht also darin, die Funktionsbereiche aktiver Benutzer und inaktiver Benutzer aufeinander abzustimmen, weil inaktive Benutzer viele Funktionen nutzen fehlt und unterscheidet sich daher wesentlich vom Funktionsbereich aktiver Benutzer. Hier verwenden wir GNN, um die Darstellung des Benutzers zu lernen und die Darstellung des Benutzers in einem gemeinsamen Raum abzubilden. Wie in der obigen Abbildung gezeigt, ist die obere Schicht der CD-GNN-Struktur ein aktiver Benutzer, den wir vorhersagen möchten, und die untere Schicht ist ein inaktiver Benutzer, den wir vorhersagen möchten. Nachdem wir von zwei GNNs gelernt haben, werden sie einem zugeordnet Gemeinsamer Benutzer über eine domäneninvariante Ebene In Bezug auf die Darstellung wird schließlich eine Etikettenvorhersage sowohl für aktive als auch für inaktive Benutzer erstellt.

Insbesondere umfasst das Diagrammmodell das soziale Netzwerk und das Benutzerseitennetzwerk. Die beiden Netzwerke werden unterschiedlich aggregiert, und aktive Benutzer und inaktive Benutzer werden über die Domäneninvariantenschicht dem gleichen Bereich zugeordnet = Quellverlust + Zielverlust – Domäneninvarianter Verlust. Die Ergebnisse des Online-A/B-Versuchs zeigen, dass unser Modell die CTR im Vergleich zu GCN erheblich verbessert hat und unser Modell auch bei spärlichem Verhalten immer noch gute Ergebnisse erzielen kann.

Die oben genannten sind einige der kürzlich von unserem Team veröffentlichten Ergebnisse. Ich spreche hauptsächlich über die Arbeit der oben genannten drei Artikel.

05Interaktive Fragen und Antworten

F1: Werden die Parameter der CD-GNN-Schicht gemeinsam genutzt?

A1: Es wird nicht geteilt, da einige Merkmale aktiver Benutzer, wie z. B. ID-Merkmale, viel mehr sind als die Merkmale inaktiver Benutzer. Die Verteilung der Merkmale der beiden ist daher nicht konsistent Teilen Sie sie hier nicht.

F2: Beim Problem der domänenübergreifenden Empfehlung ist die Anzahl der Zielbezeichnungen für inaktive Benutzer sehr gering, was dazu führt, dass das Modell die Zieleinbettung inaktiver Benutzer schlecht lernt. Wie sollten solche Probleme berücksichtigt werden?

A2: Sie können einige vorab trainierte Methoden verwenden, um einige Darstellungsinformationen im Voraus hinzuzufügen, oder die fehlenden Funktionen durch einige Methoden ergänzen. Sie können die Features ergänzen, während Sie das Diagrammmodell erstellen, und die Features der Nachbarn ergänzen, anstatt einfach benachbarte Features zu aggregieren. Das Hinzufügen von Verlusten ähnlich der Feature-Rekonstruktion kann zur Lösung dieses Problems beitragen.

F3: Wurde die erste graphbasierte Methode in der Feinprobenszene implementiert? Wie viele Ebenen erreicht das darin enthaltene GNN im Allgemeinen?

A3: Im Gegensatz zu anderen Szenarien, in denen eine Liste empfohlen wird und sich darunter möglicherweise Hunderte von Informationen befinden, können Benutzer diese 5 Fonds auf einen Blick sehen. Die Auswirkungen der Neuordnung sind nicht sehr groß. Die Ergebnisse unseres Modells stehen in direktem Zusammenhang mit der Linie, bei der es sich um ein verfeinertes Modell handelt. Im Allgemeinen wird ein zweistufiges GNN verwendet. Das GNN der dritten Stufe verbessert bei einigen Aufgaben nicht viel und die Online-Verzögerung ist zu lang.

2. Lösung

Insbesondere umfasst das Diagrammmodell das soziale Netzwerk und das Benutzerseitennetzwerk. Die beiden Netzwerke werden unterschiedlich aggregiert, und aktive Benutzer und inaktive Benutzer werden über die Domäneninvariantenschicht dem gleichen Bereich zugeordnet = Quellverlust + Zielverlust – Domäneninvarianter Verlust. Die Ergebnisse des Online-A/B-Versuchs zeigen, dass unser Modell die CTR im Vergleich zu GCN erheblich verbessert hat und unser Modell auch bei spärlichem Verhalten immer noch gute Ergebnisse erzielen kann.

Die oben genannten sind einige der kürzlich von unserem Team veröffentlichten Ergebnisse. Ich spreche hauptsächlich über die Arbeit der oben genannten drei Artikel.

05Interaktive Fragen und Antworten

F1: Werden die Parameter der CD-GNN-Schicht gemeinsam genutzt?

A1: Es wird nicht geteilt, da einige Merkmale aktiver Benutzer, wie z. B. ID-Merkmale, viel mehr sind als die Merkmale inaktiver Benutzer. Die Verteilung der Merkmale der beiden ist daher nicht konsistent Teilen Sie sie hier nicht.

F2: Beim Problem der domänenübergreifenden Empfehlung ist die Anzahl der Zielbezeichnungen für inaktive Benutzer sehr gering, was dazu führt, dass das Modell die Zieleinbettung inaktiver Benutzer schlecht lernt. Wie sollten solche Probleme berücksichtigt werden?

A2: Sie können einige vorab trainierte Methoden verwenden, um einige Darstellungsinformationen im Voraus hinzuzufügen, oder die fehlenden Funktionen durch einige Methoden ergänzen. Sie können die Features ergänzen, während Sie das Diagrammmodell erstellen, und die Features der Nachbarn ergänzen, anstatt einfach benachbarte Features zu aggregieren. Das Hinzufügen von Verlusten ähnlich der Feature-Rekonstruktion kann zur Lösung dieses Problems beitragen.

F3: Wurde die erste graphbasierte Methode in der Feinprobenszene implementiert? Wie viele Ebenen erreicht das darin enthaltene GNN im Allgemeinen?

A3: Im Gegensatz zu anderen Szenarien, in denen eine Liste empfohlen wird und sich darunter möglicherweise Hunderte von Informationen befinden, können Benutzer diese 5 Fonds auf einen Blick sehen. Die Auswirkungen der Neuordnung sind nicht sehr groß. Die Ergebnisse unseres Modells stehen in direktem Zusammenhang mit der Linie, bei der es sich um ein verfeinertes Modell handelt. Im Allgemeinen wird ein zweistufiges GNN verwendet. Das GNN der dritten Stufe verbessert bei einigen Aufgaben nicht viel und die Online-Verzögerung ist zu lang.

Das obige ist der detaillierte Inhalt vonAnwendung von Graph Machine Learning im Empfehlungsgeschäft der Ant Group. Für weitere Informationen folgen Sie bitte anderen verwandten Artikeln auf der PHP chinesischen Website!

Heiße KI -Werkzeuge

Undresser.AI Undress

KI-gestützte App zum Erstellen realistischer Aktfotos

AI Clothes Remover

Online-KI-Tool zum Entfernen von Kleidung aus Fotos.

Undress AI Tool

Ausziehbilder kostenlos

Clothoff.io

KI-Kleiderentferner

AI Hentai Generator

Erstellen Sie kostenlos Ai Hentai.

Heißer Artikel

Heiße Werkzeuge

Notepad++7.3.1

Einfach zu bedienender und kostenloser Code-Editor

SublimeText3 chinesische Version

Chinesische Version, sehr einfach zu bedienen

Senden Sie Studio 13.0.1

Leistungsstarke integrierte PHP-Entwicklungsumgebung

Dreamweaver CS6

Visuelle Webentwicklungstools

SublimeText3 Mac-Version

Codebearbeitungssoftware auf Gottesniveau (SublimeText3)

Heiße Themen

1370

1370

52

52

In diesem Artikel erfahren Sie mehr über SHAP: Modellerklärung für maschinelles Lernen

Jun 01, 2024 am 10:58 AM

In diesem Artikel erfahren Sie mehr über SHAP: Modellerklärung für maschinelles Lernen

Jun 01, 2024 am 10:58 AM

In den Bereichen maschinelles Lernen und Datenwissenschaft stand die Interpretierbarkeit von Modellen schon immer im Fokus von Forschern und Praktikern. Mit der weit verbreiteten Anwendung komplexer Modelle wie Deep Learning und Ensemble-Methoden ist das Verständnis des Entscheidungsprozesses des Modells besonders wichtig geworden. Explainable AI|XAI trägt dazu bei, Vertrauen in maschinelle Lernmodelle aufzubauen, indem es die Transparenz des Modells erhöht. Eine Verbesserung der Modelltransparenz kann durch Methoden wie den weit verbreiteten Einsatz mehrerer komplexer Modelle sowie der Entscheidungsprozesse zur Erläuterung der Modelle erreicht werden. Zu diesen Methoden gehören die Analyse der Merkmalsbedeutung, die Schätzung des Modellvorhersageintervalls, lokale Interpretierbarkeitsalgorithmen usw. Die Merkmalswichtigkeitsanalyse kann den Entscheidungsprozess des Modells erklären, indem sie den Grad des Einflusses des Modells auf die Eingabemerkmale bewertet. Schätzung des Modellvorhersageintervalls

Transparent! Eine ausführliche Analyse der Prinzipien der wichtigsten Modelle des maschinellen Lernens!

Apr 12, 2024 pm 05:55 PM

Transparent! Eine ausführliche Analyse der Prinzipien der wichtigsten Modelle des maschinellen Lernens!

Apr 12, 2024 pm 05:55 PM

Laienhaft ausgedrückt ist ein Modell für maschinelles Lernen eine mathematische Funktion, die Eingabedaten einer vorhergesagten Ausgabe zuordnet. Genauer gesagt ist ein Modell für maschinelles Lernen eine mathematische Funktion, die Modellparameter anpasst, indem sie aus Trainingsdaten lernt, um den Fehler zwischen der vorhergesagten Ausgabe und der wahren Bezeichnung zu minimieren. Beim maschinellen Lernen gibt es viele Modelle, z. B. logistische Regressionsmodelle, Entscheidungsbaummodelle, Support-Vektor-Maschinenmodelle usw. Jedes Modell verfügt über seine anwendbaren Datentypen und Problemtypen. Gleichzeitig gibt es viele Gemeinsamkeiten zwischen verschiedenen Modellen oder es gibt einen verborgenen Weg für die Modellentwicklung. Am Beispiel des konnektionistischen Perzeptrons können wir es durch Erhöhen der Anzahl verborgener Schichten des Perzeptrons in ein tiefes neuronales Netzwerk umwandeln. Wenn dem Perzeptron eine Kernelfunktion hinzugefügt wird, kann es in eine SVM umgewandelt werden. Dieses hier

Die Entwicklung der künstlichen Intelligenz in der Weltraumforschung und der Siedlungstechnik

Apr 29, 2024 pm 03:25 PM

Die Entwicklung der künstlichen Intelligenz in der Weltraumforschung und der Siedlungstechnik

Apr 29, 2024 pm 03:25 PM

In den 1950er Jahren wurde die künstliche Intelligenz (KI) geboren. Damals entdeckten Forscher, dass Maschinen menschenähnliche Aufgaben wie das Denken ausführen können. Später, in den 1960er Jahren, finanzierte das US-Verteidigungsministerium künstliche Intelligenz und richtete Labore für die weitere Entwicklung ein. Forscher finden Anwendungen für künstliche Intelligenz in vielen Bereichen, etwa bei der Erforschung des Weltraums und beim Überleben in extremen Umgebungen. Unter Weltraumforschung versteht man die Erforschung des Universums, das das gesamte Universum außerhalb der Erde umfasst. Der Weltraum wird als extreme Umgebung eingestuft, da sich seine Bedingungen von denen auf der Erde unterscheiden. Um im Weltraum zu überleben, müssen viele Faktoren berücksichtigt und Vorkehrungen getroffen werden. Wissenschaftler und Forscher glauben, dass die Erforschung des Weltraums und das Verständnis des aktuellen Zustands aller Dinge dazu beitragen können, die Funktionsweise des Universums zu verstehen und sich auf mögliche Umweltkrisen vorzubereiten

Identifizieren Sie Über- und Unteranpassung anhand von Lernkurven

Apr 29, 2024 pm 06:50 PM

Identifizieren Sie Über- und Unteranpassung anhand von Lernkurven

Apr 29, 2024 pm 06:50 PM

In diesem Artikel wird vorgestellt, wie Überanpassung und Unteranpassung in Modellen für maschinelles Lernen mithilfe von Lernkurven effektiv identifiziert werden können. Unteranpassung und Überanpassung 1. Überanpassung Wenn ein Modell mit den Daten übertrainiert ist, sodass es daraus Rauschen lernt, spricht man von einer Überanpassung des Modells. Ein überangepasstes Modell lernt jedes Beispiel so perfekt, dass es ein unsichtbares/neues Beispiel falsch klassifiziert. Für ein überangepasstes Modell erhalten wir einen perfekten/nahezu perfekten Trainingssatzwert und einen schrecklichen Validierungssatz-/Testwert. Leicht geändert: „Ursache der Überanpassung: Verwenden Sie ein komplexes Modell, um ein einfaches Problem zu lösen und Rauschen aus den Daten zu extrahieren. Weil ein kleiner Datensatz als Trainingssatz möglicherweise nicht die korrekte Darstellung aller Daten darstellt. 2. Unteranpassung Heru.“

Implementierung von Algorithmen für maschinelles Lernen in C++: Häufige Herausforderungen und Lösungen

Jun 03, 2024 pm 01:25 PM

Implementierung von Algorithmen für maschinelles Lernen in C++: Häufige Herausforderungen und Lösungen

Jun 03, 2024 pm 01:25 PM

Zu den häufigsten Herausforderungen, mit denen Algorithmen für maschinelles Lernen in C++ konfrontiert sind, gehören Speicherverwaltung, Multithreading, Leistungsoptimierung und Wartbarkeit. Zu den Lösungen gehören die Verwendung intelligenter Zeiger, moderner Threading-Bibliotheken, SIMD-Anweisungen und Bibliotheken von Drittanbietern sowie die Einhaltung von Codierungsstilrichtlinien und die Verwendung von Automatisierungstools. Praktische Fälle zeigen, wie man die Eigen-Bibliothek nutzt, um lineare Regressionsalgorithmen zu implementieren, den Speicher effektiv zu verwalten und leistungsstarke Matrixoperationen zu nutzen.

Erklärbare KI: Erklären komplexer KI/ML-Modelle

Jun 03, 2024 pm 10:08 PM

Erklärbare KI: Erklären komplexer KI/ML-Modelle

Jun 03, 2024 pm 10:08 PM

Übersetzer |. Rezensiert von Li Rui |. Chonglou Modelle für künstliche Intelligenz (KI) und maschinelles Lernen (ML) werden heutzutage immer komplexer, und die von diesen Modellen erzeugten Ergebnisse sind eine Blackbox, die den Stakeholdern nicht erklärt werden kann. Explainable AI (XAI) zielt darauf ab, dieses Problem zu lösen, indem es Stakeholdern ermöglicht, die Funktionsweise dieser Modelle zu verstehen, sicherzustellen, dass sie verstehen, wie diese Modelle tatsächlich Entscheidungen treffen, und Transparenz in KI-Systemen, Vertrauen und Verantwortlichkeit zur Lösung dieses Problems gewährleistet. In diesem Artikel werden verschiedene Techniken der erklärbaren künstlichen Intelligenz (XAI) untersucht, um ihre zugrunde liegenden Prinzipien zu veranschaulichen. Mehrere Gründe, warum erklärbare KI von entscheidender Bedeutung ist. Vertrauen und Transparenz: Damit KI-Systeme allgemein akzeptiert und vertrauenswürdig sind, müssen Benutzer verstehen, wie Entscheidungen getroffen werden

Fünf Schulen des maschinellen Lernens, die Sie nicht kennen

Jun 05, 2024 pm 08:51 PM

Fünf Schulen des maschinellen Lernens, die Sie nicht kennen

Jun 05, 2024 pm 08:51 PM

Maschinelles Lernen ist ein wichtiger Zweig der künstlichen Intelligenz, der Computern die Möglichkeit gibt, aus Daten zu lernen und ihre Fähigkeiten zu verbessern, ohne explizit programmiert zu werden. Maschinelles Lernen hat ein breites Anwendungsspektrum in verschiedenen Bereichen, von der Bilderkennung und der Verarbeitung natürlicher Sprache bis hin zu Empfehlungssystemen und Betrugserkennung, und es verändert unsere Lebensweise. Im Bereich des maschinellen Lernens gibt es viele verschiedene Methoden und Theorien, von denen die fünf einflussreichsten Methoden als „Fünf Schulen des maschinellen Lernens“ bezeichnet werden. Die fünf Hauptschulen sind die symbolische Schule, die konnektionistische Schule, die evolutionäre Schule, die Bayes'sche Schule und die Analogieschule. 1. Der Symbolismus, auch Symbolismus genannt, betont die Verwendung von Symbolen zum logischen Denken und zum Ausdruck von Wissen. Diese Denkrichtung glaubt, dass Lernen ein Prozess der umgekehrten Schlussfolgerung durch das Vorhandene ist

Ist Flash Attention stabil? Meta und Harvard stellten fest, dass die Gewichtsabweichungen ihrer Modelle um Größenordnungen schwankten

May 30, 2024 pm 01:24 PM

Ist Flash Attention stabil? Meta und Harvard stellten fest, dass die Gewichtsabweichungen ihrer Modelle um Größenordnungen schwankten

May 30, 2024 pm 01:24 PM

MetaFAIR hat sich mit Harvard zusammengetan, um einen neuen Forschungsrahmen zur Optimierung der Datenverzerrung bereitzustellen, die bei der Durchführung groß angelegten maschinellen Lernens entsteht. Es ist bekannt, dass das Training großer Sprachmodelle oft Monate dauert und Hunderte oder sogar Tausende von GPUs verwendet. Am Beispiel des Modells LLaMA270B erfordert das Training insgesamt 1.720.320 GPU-Stunden. Das Training großer Modelle stellt aufgrund des Umfangs und der Komplexität dieser Arbeitsbelastungen einzigartige systemische Herausforderungen dar. In letzter Zeit haben viele Institutionen über Instabilität im Trainingsprozess beim Training generativer SOTA-KI-Modelle berichtet. Diese treten normalerweise in Form von Verlustspitzen auf. Beim PaLM-Modell von Google kam es beispielsweise während des Trainingsprozesses zu Instabilitäten. Numerische Voreingenommenheit ist die Hauptursache für diese Trainingsungenauigkeit.