Technologie-Peripheriegeräte

Technologie-Peripheriegeräte

KI

KI

So bauen Sie leistungsstarke Sprachsynthesesysteme mit kompakten Sprachdarstellungen

So bauen Sie leistungsstarke Sprachsynthesesysteme mit kompakten Sprachdarstellungen

So bauen Sie leistungsstarke Sprachsynthesesysteme mit kompakten Sprachdarstellungen

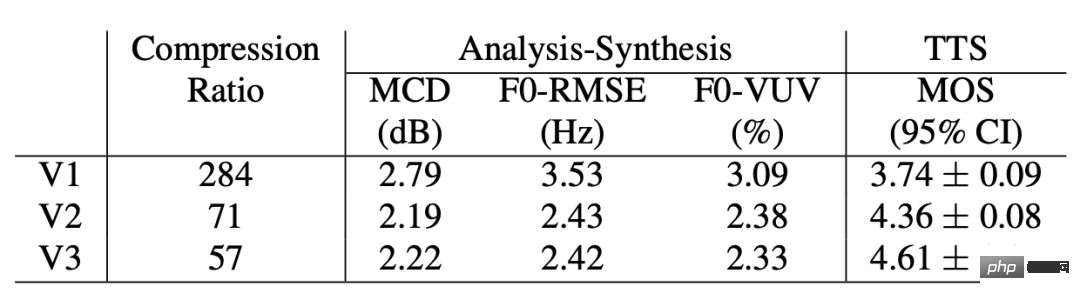

Das Xiaohongshu Multimedia Intelligent Algorithm Team und die Chinese University of Hong Kong haben erstmals gemeinsam das Hochleistungs-Sprachsyntheseschema MSMC-TTS vorgeschlagen, das auf einer mehrstufigen kompakten Sprachdarstellung mit mehreren Codebüchern basiert. Der auf dem vektorquantisierten Variations-Autoencoder (VQ-VAE) basierende Merkmalsanalysator verwendet mehrere Codebücher, um akustische Merkmale stufenweise zu kodieren, um einen Satz latenter Sequenzen mit unterschiedlichen zeitlichen Auflösungen zu bilden. Diese latenten Sequenzen können von einem mehrstufigen Prädiktor aus Text vorhergesagt und von einem neuronalen Vocoder in Zielaudio umgewandelt werden. Im Vergleich zum Mel-Spectrogram-basierten Fastspeech-Basissystem weist diese Lösung erhebliche Verbesserungen in der Klangqualität und Natürlichkeit auf. Diese Arbeit wurde nun in dem Papier „A Multi-Stage Multi-Codebook VQ-VAE Approach to High-Performance Neural TTS“ zusammengefasst und von der Sprachdomänenkonferenz INTERSPEECH 2022 angenommen.

1. Hintergrundeinführung

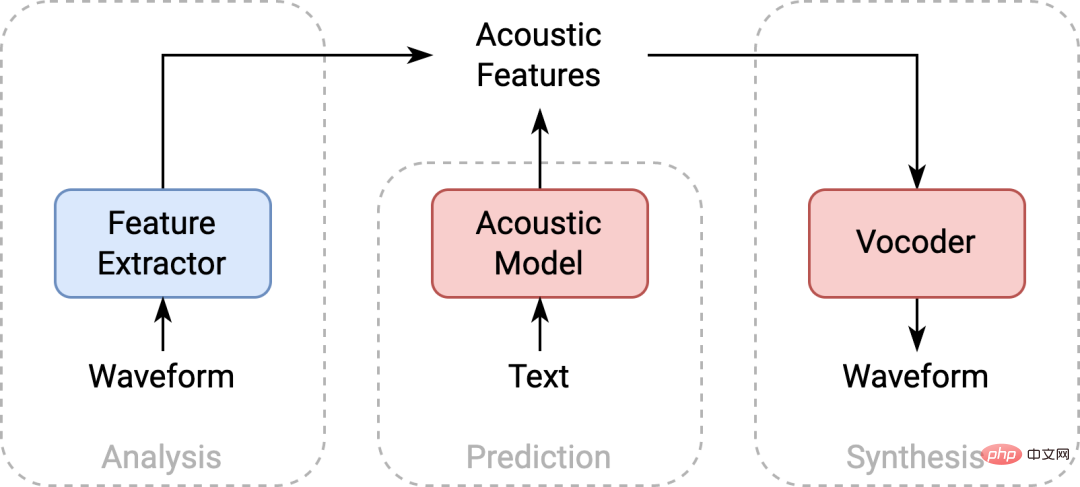

Text-to-Speech (TTS) ist eine Technologie, die Text in Sprache umwandelt. Sie wird häufig bei der Videosynchronisierung, der Erstellung von Audio- und Videoinhalten, der intelligenten Mensch-Computer-Interaktion und anderen Produkten eingesetzt. Die Back-End-Akustikmodellierungstechnologie gängiger Sprachsynthesesysteme umfasst normalerweise drei Teile: Merkmalsextraktor, Akustikmodell und Vocoder. TTS führt normalerweise eine akustische Modellierung anhand der Signalverarbeitung durch (z. B. Mel Spectrogram). Aufgrund der Anpassungsfähigkeit des Modells besteht jedoch ein gewisser Unterschied in der Verteilung zwischen den vorhergesagten akustischen Merkmalen und den tatsächlichen Daten macht es für Vocoder, die auf echten Daten trainiert wurden, schwierig, aus vorhergesagten Merkmalen hochwertiges Audio zu generieren.

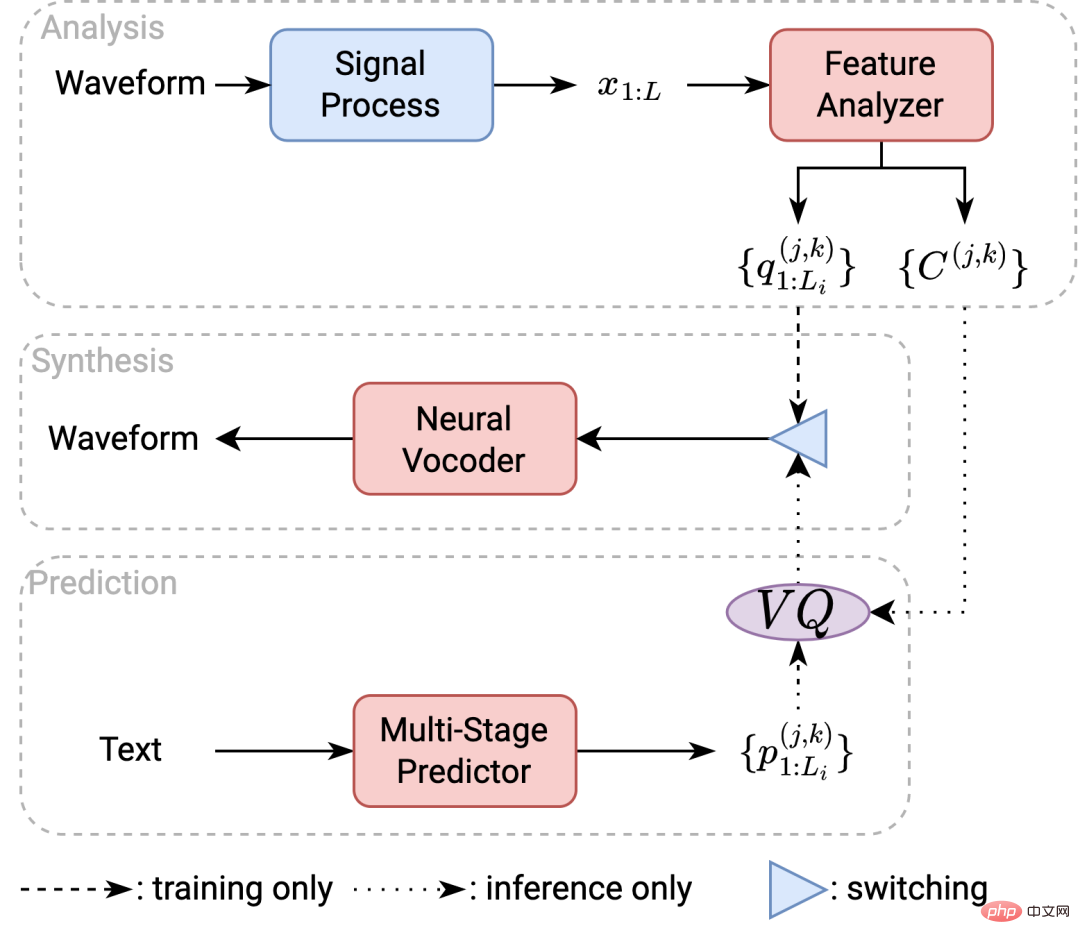

TTS-Systemrahmendiagramm

Als Reaktion auf dieses Problem hat die akademische Gemeinschaft komplexere Modellstrukturen und neuartigere generative Algorithmen verwendet, um Vorhersagefehler und Verteilungsunterschiede zu reduzieren. Diese Arbeit verfolgt einen anderen Ansatz und nimmt die kompakte Sprachdarstellung als Ausgangspunkt für die Betrachtung des Problems. Bei der Sprachsynthese kann 1) eine gute Kompaktheit der akustischen Merkmale genauere Modellvorhersageergebnisse und eine robustere Wellenformerzeugung gewährleisten; 2) eine gute Vollständigkeit der akustischen Merkmale kann eine bessere Rekonstruktion von Sprachsignalen gewährleisten. Basierend auf diesen beiden Überlegungen schlägt dieses Papier die Verwendung eines Vektorquantisierungs-Variations-Autoencoders (VQ-VAE) vor, um eine bessere kompakte Darstellung aus den Zieldaten zu gewinnen.

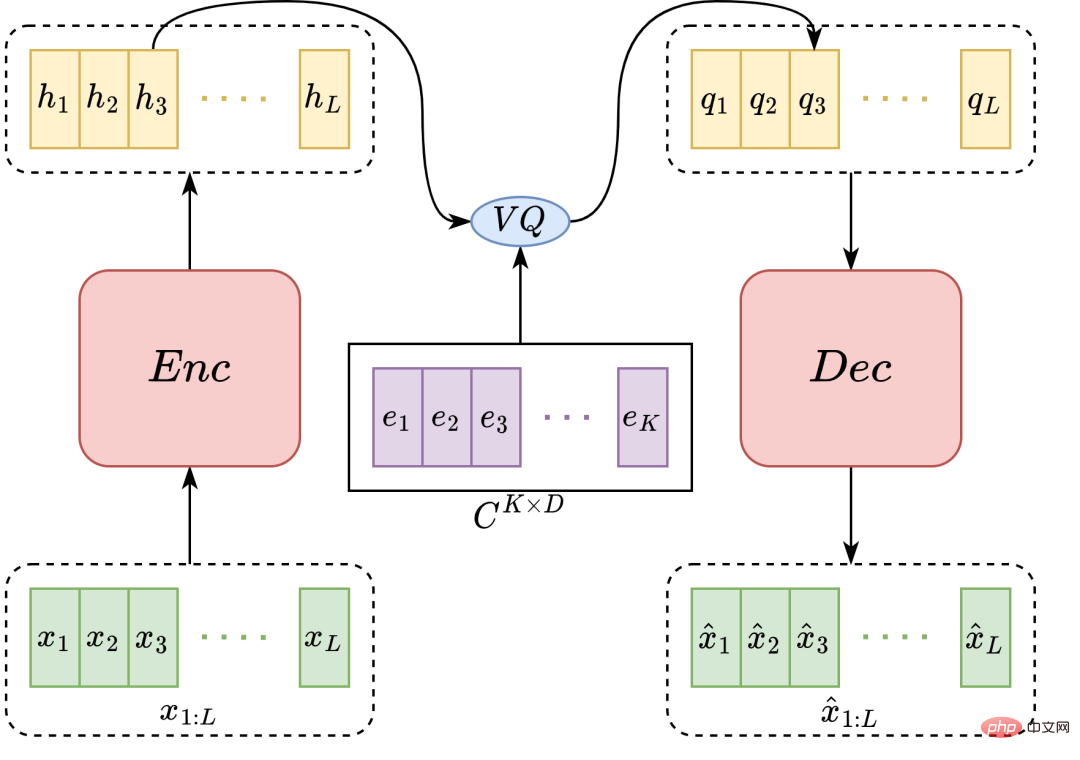

2. Darstellungslernen MSMC VQ-VAE

VQ-VAE enthält Encoder und Decoder. Der Encoder verarbeitet die eingegebene akustische Merkmalssequenz in eine latente Sequenz und quantisiert sie mithilfe des entsprechenden Codebuchs. Der Decoder stellt die quantisierte Sequenz auf die ursprüngliche akustische Merkmalssequenz wieder her. Diese quantisierte Folge weist eine bessere Kompaktheit (weniger Anzahl charakteristischer Parameter) als eine diskretisierte Darstellung auf. Je höher der Quantisierungsgrad, also je kleiner die Codebuchkapazität, desto höher ist die Kompaktheit der Merkmale. Dies führt aber auch zu einer Informationskomprimierung und verschlechtert die Funktionsvollständigkeit. Um eine ausreichende Vollständigkeit zu gewährleisten, werden in der Regel mehr Codewörter verwendet. Mit zunehmender Codebuchkapazität nehmen jedoch die für die Codebuchaktualisierung erforderliche Datenmenge und die Anzahl der Trainingszeiten exponentiell zu, was es für VQ-VAE schwierig macht, die Darstellungsvollständigkeit durch Vergrößerung des Codebuchs effektiv zu verbessern. Um dieses Problem anzugehen, wird in diesem Artikel die Methode der Mehrkopf-Vektorquantisierung (MHVQ) vorgeschlagen.

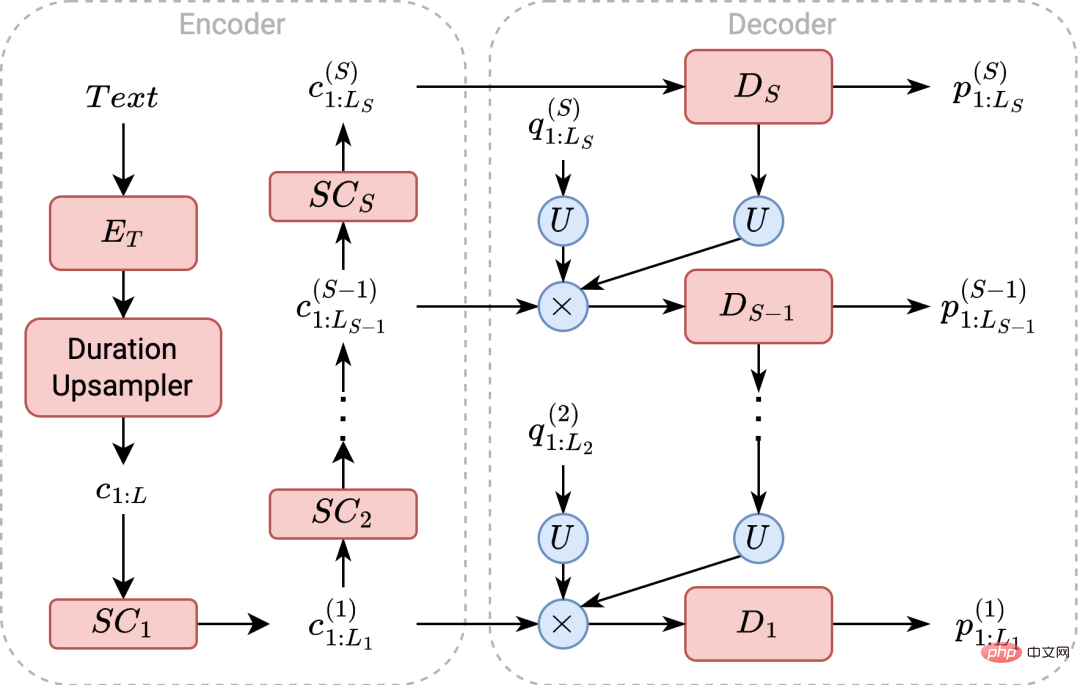

VQ-VAE-Modellstrukturdiagramm

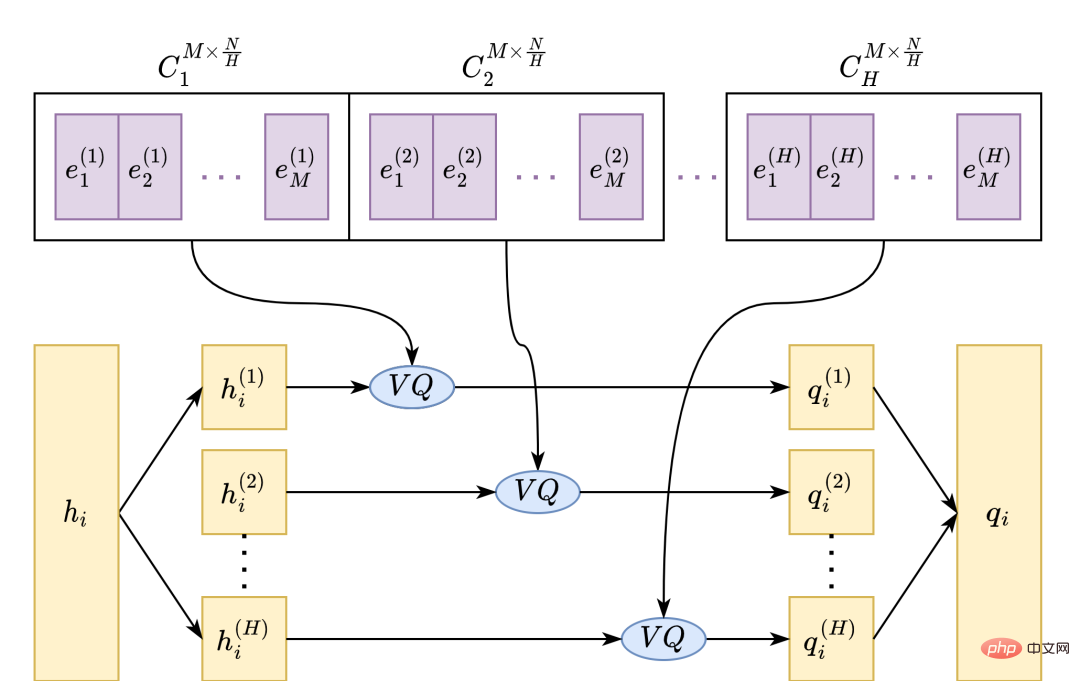

MHVQ unterteilt ein einzelnes Codebuch entsprechend der Merkmalsdimensionsrichtung in mehrere Untercodebücher. Während der Quantisierung wird jeder Eingabevektor gleichmäßig in mehrere Untervektoren zerlegt, mit entsprechenden Untercodebüchern quantisiert und schließlich in einen Ausgangsvektor gespleißt. Auf diese Weise können wir die Nutzung des Codebuchs und die Darstellungskapazität effektiver verbessern, ohne die Anzahl der Codebuchparameter zu erhöhen. Um beispielsweise die Komprimierungsrate um den Faktor 1 zu reduzieren, müssen die Codewörter auf das Quadrat der ursprünglichen Codebuchnummer erhöht werden. Nach der Verwendung von MHVQ kann die gleiche Komprimierungsrate erreicht werden, indem das Codebuch einfach in zwei Teile geteilt wird. Daher kann diese Methode die Vollständigkeit quantitativer Darstellungen effektiver regulieren.

MHVQ-Beispielbild

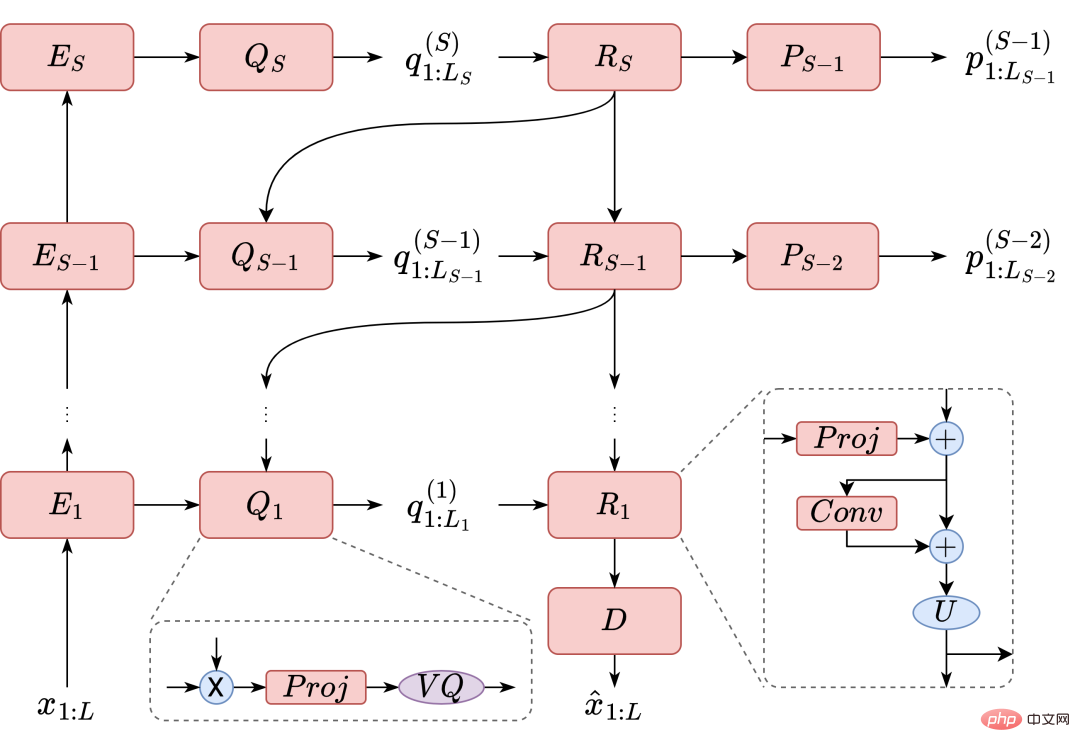

Außerdem gehen bei der Quantisierung der Sprachsequenz verschiedene Arten von Informationen, die in den Sprachmerkmalen enthalten sind, in unterschiedlichem Maße verloren. Diese Informationen unterscheiden sich in der zeitlichen Granularität, z. B. grobkörniges Timbre, Aussprachestil usw., und feinkörnige Tonhöhe, Aussprachedetails usw. Eine übermäßige Komprimierung von Informationen auf einer beliebigen Zeitskala kann zu einer gewissen Verschlechterung der Sprachqualität führen. Um dieses Problem zu lindern, schlägt diese Arbeit eine Sprachmodellierungsmethode mit mehreren Zeitskalen vor. Wie in der Abbildung gezeigt, wird die akustische Merkmalssequenz durch mehrere Encoder schrittweise auf unterschiedliche Zeitskalen codiert und dann Schicht für Schicht durch den Decoder quantisiert, wodurch mehrere quantisierte Sequenzen mit unterschiedlichen Zeitauflösungen decodiert werden. Die aus dieser Art von Sequenzsatz zusammengesetzte Darstellung ist die in dieser Arbeit vorgeschlagene mehrstufige Multi-Codebuch-Darstellung.

Beispieldiagramm für mehrstufige Modellierung

3. Akustische Modellierung MSMC-TTS # 🎜🎜#

Angesichts der mehrstufigen Multi-Codebuch-Charakterisierung MSMCR schlägt dieser Artikel das entsprechende TTS-System vor, nämlich das MSMC-TTS-System. Das System besteht aus drei Teilen: Analyse, Synthese und Vorhersage. Beim Systemtraining trainiert das System zunächst das Analysemodul. Das Audio im Trainingssatz wird nach der Signalverarbeitung in akustische Merkmale mit hoher Vollständigkeit (wie die in dieser Arbeit verwendeten Mel-Spektrogramm-Funktionen) umgewandelt. Diese akustischen Merkmale werden verwendet, um den Merkmalsanalysator basierend auf MSMC-VQ-VAE zu trainieren. Am Ende des Trainings werden sie in den entsprechenden MSMCR umgewandelt und anschließend werden das akustische Modell und der neuronale Vocoder trainiert. Während der Dekodierung verwendet das System ein akustisches Modell, um MSMCR aus Text vorherzusagen, und verwendet dann einen neuronalen Vocoder, um das Zielaudio zu erzeugen.

5. Zusammenfassung

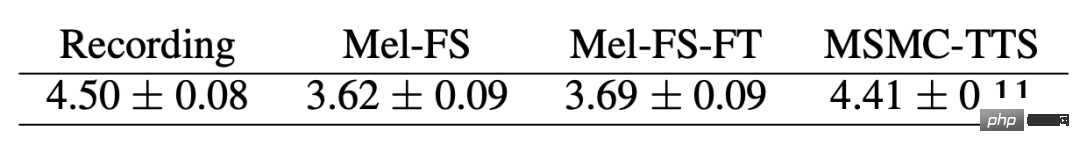

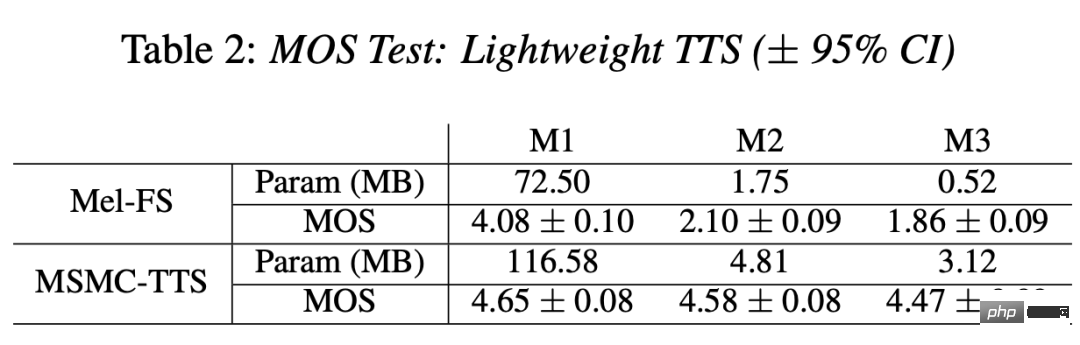

Diese Arbeit schlägt ein neues Hochleistungs-TTS (MSMC-TTS) aus der Perspektive des Studiums der kompakten Sprachdarstellung vor. Modellierungsmethode. Das System extrahiert mehrstufige Multi-Codebuch-Darstellungen aus Audio anstelle herkömmlicher akustischer Merkmale. Eingabetext kann von einem mehrstufigen Prädiktor in diese Sprachdarstellung umgewandelt werden, die aus mehreren Sequenzen mit unterschiedlichen zeitlichen Auflösungen besteht, und von einem neuronalen Vocoder in ein Zielsprachsignal umgewandelt werden. Experimentelle Ergebnisse zeigen, dass dieses System im Vergleich zum Mainstream-FastSpeech-System, das auf Mel-Spektrogramm basiert, eine bessere Synthesequalität und geringere Anforderungen an die Modellierungskomplexität aufweist.

6. Informationen zum Autor

Guo Haohan: Praktikant im Multimedia Intelligent Algorithm Team von Xiaohongshu. Er schloss sein Studium an der Northwestern Polytechnical University mit einem Bachelor ab und studierte im ASLP-Labor bei Professor Xie Lei. Derzeit promoviert er im HCCL-Labor der Chinesischen Universität Hongkong bei Professor Meng Meiling. Bisher wurden als Erstautor sechs Artikel auf den internationalen Redekonferenzen ICASSP, INTERSPEECH und SLT veröffentlicht.

Xie Fenglong: Leiter der Sprachtechnologie des Xiaohongshu Multimedia Intelligent Algorithm Team. Er hat mehr als zehn Artikel in Vortragskonferenzen und Fachzeitschriften wie ICASSP, INTERSPEECH und SPEECHCOM veröffentlicht. Er ist seit langem als Gutachter für große Vortragskonferenzen wie ICASSP und INTERSPEECH tätig.

Das obige ist der detaillierte Inhalt vonSo bauen Sie leistungsstarke Sprachsynthesesysteme mit kompakten Sprachdarstellungen. Für weitere Informationen folgen Sie bitte anderen verwandten Artikeln auf der PHP chinesischen Website!

Heiße KI -Werkzeuge

Undresser.AI Undress

KI-gestützte App zum Erstellen realistischer Aktfotos

AI Clothes Remover

Online-KI-Tool zum Entfernen von Kleidung aus Fotos.

Undress AI Tool

Ausziehbilder kostenlos

Clothoff.io

KI-Kleiderentferner

AI Hentai Generator

Erstellen Sie kostenlos Ai Hentai.

Heißer Artikel

Heiße Werkzeuge

Notepad++7.3.1

Einfach zu bedienender und kostenloser Code-Editor

SublimeText3 chinesische Version

Chinesische Version, sehr einfach zu bedienen

Senden Sie Studio 13.0.1

Leistungsstarke integrierte PHP-Entwicklungsumgebung

Dreamweaver CS6

Visuelle Webentwicklungstools

SublimeText3 Mac-Version

Codebearbeitungssoftware auf Gottesniveau (SublimeText3)

Heiße Themen

1376

1376

52

52

Methoden und Schritte zur Verwendung von BERT für die Stimmungsanalyse in Python

Jan 22, 2024 pm 04:24 PM

Methoden und Schritte zur Verwendung von BERT für die Stimmungsanalyse in Python

Jan 22, 2024 pm 04:24 PM

BERT ist ein vorab trainiertes Deep-Learning-Sprachmodell, das 2018 von Google vorgeschlagen wurde. Der vollständige Name lautet BidirektionalEncoderRepresentationsfromTransformers, der auf der Transformer-Architektur basiert und die Eigenschaften einer bidirektionalen Codierung aufweist. Im Vergleich zu herkömmlichen Einweg-Codierungsmodellen kann BERT bei der Textverarbeitung gleichzeitig Kontextinformationen berücksichtigen, sodass es bei Verarbeitungsaufgaben in natürlicher Sprache eine gute Leistung erbringt. Seine Bidirektionalität ermöglicht es BERT, die semantischen Beziehungen in Sätzen besser zu verstehen und dadurch die Ausdrucksfähigkeit des Modells zu verbessern. Durch Vorschulungs- und Feinabstimmungsmethoden kann BERT für verschiedene Aufgaben der Verarbeitung natürlicher Sprache verwendet werden, wie z. B. Stimmungsanalyse und Benennung

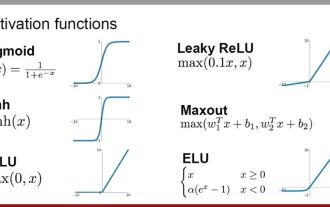

Analyse häufig verwendeter KI-Aktivierungsfunktionen: Deep-Learning-Praxis von Sigmoid, Tanh, ReLU und Softmax

Dec 28, 2023 pm 11:35 PM

Analyse häufig verwendeter KI-Aktivierungsfunktionen: Deep-Learning-Praxis von Sigmoid, Tanh, ReLU und Softmax

Dec 28, 2023 pm 11:35 PM

Aktivierungsfunktionen spielen beim Deep Learning eine entscheidende Rolle. Sie können nichtlineare Eigenschaften in neuronale Netze einführen und es dem Netz ermöglichen, komplexe Eingabe-Ausgabe-Beziehungen besser zu lernen und zu simulieren. Die richtige Auswahl und Verwendung von Aktivierungsfunktionen hat einen wichtigen Einfluss auf die Leistung und Trainingsergebnisse neuronaler Netze. In diesem Artikel werden vier häufig verwendete Aktivierungsfunktionen vorgestellt: Sigmoid, Tanh, ReLU und Softmax. Beginnend mit der Einführung, den Verwendungsszenarien und den Vorteilen. Nachteile und Optimierungslösungen werden besprochen, um Ihnen ein umfassendes Verständnis der Aktivierungsfunktionen zu vermitteln. 1. Sigmoid-Funktion Einführung in die Sigmoid-Funktionsformel: Die Sigmoid-Funktion ist eine häufig verwendete nichtlineare Funktion, die jede reelle Zahl auf Werte zwischen 0 und 1 abbilden kann. Es wird normalerweise verwendet, um das zu vereinheitlichen

Jenseits von ORB-SLAM3! SL-SLAM: Szenen mit wenig Licht, starkem Jitter und schwacher Textur werden verarbeitet

May 30, 2024 am 09:35 AM

Jenseits von ORB-SLAM3! SL-SLAM: Szenen mit wenig Licht, starkem Jitter und schwacher Textur werden verarbeitet

May 30, 2024 am 09:35 AM

Heute diskutieren wir darüber, wie Deep-Learning-Technologie die Leistung von visionbasiertem SLAM (Simultaneous Localization and Mapping) in komplexen Umgebungen verbessern kann. Durch die Kombination von Methoden zur Tiefenmerkmalsextraktion und Tiefenanpassung stellen wir hier ein vielseitiges hybrides visuelles SLAM-System vor, das die Anpassung in anspruchsvollen Szenarien wie schlechten Lichtverhältnissen, dynamischer Beleuchtung, schwach strukturierten Bereichen und starkem Jitter verbessern soll. Unser System unterstützt mehrere Modi, einschließlich erweiterter Monokular-, Stereo-, Monokular-Trägheits- und Stereo-Trägheitskonfigurationen. Darüber hinaus wird analysiert, wie visuelles SLAM mit Deep-Learning-Methoden kombiniert werden kann, um andere Forschungen zu inspirieren. Durch umfangreiche Experimente mit öffentlichen Datensätzen und selbst abgetasteten Daten demonstrieren wir die Überlegenheit von SL-SLAM in Bezug auf Positionierungsgenauigkeit und Tracking-Robustheit.

Latente Raumeinbettung: Erklärung und Demonstration

Jan 22, 2024 pm 05:30 PM

Latente Raumeinbettung: Erklärung und Demonstration

Jan 22, 2024 pm 05:30 PM

Latent Space Embedding (LatentSpaceEmbedding) ist der Prozess der Abbildung hochdimensionaler Daten auf niedrigdimensionalen Raum. Im Bereich des maschinellen Lernens und des tiefen Lernens handelt es sich bei der Einbettung latenter Räume normalerweise um ein neuronales Netzwerkmodell, das hochdimensionale Eingabedaten in einen Satz niedrigdimensionaler Vektordarstellungen abbildet. Dieser Satz von Vektoren wird oft als „latente Vektoren“ oder „latent“ bezeichnet Kodierungen". Der Zweck der Einbettung latenter Räume besteht darin, wichtige Merkmale in den Daten zu erfassen und sie in einer prägnanteren und verständlicheren Form darzustellen. Durch die Einbettung latenter Räume können wir Vorgänge wie das Visualisieren, Klassifizieren und Clustern von Daten im niedrigdimensionalen Raum durchführen, um die Daten besser zu verstehen und zu nutzen. Die Einbettung latenter Räume findet in vielen Bereichen breite Anwendung, z. B. bei der Bilderzeugung, der Merkmalsextraktion, der Dimensionsreduzierung usw. Die Einbettung des latenten Raums ist das Wichtigste

Verstehen Sie in einem Artikel: die Zusammenhänge und Unterschiede zwischen KI, maschinellem Lernen und Deep Learning

Mar 02, 2024 am 11:19 AM

Verstehen Sie in einem Artikel: die Zusammenhänge und Unterschiede zwischen KI, maschinellem Lernen und Deep Learning

Mar 02, 2024 am 11:19 AM

In der heutigen Welle rasanter technologischer Veränderungen sind künstliche Intelligenz (KI), maschinelles Lernen (ML) und Deep Learning (DL) wie helle Sterne und führen die neue Welle der Informationstechnologie an. Diese drei Wörter tauchen häufig in verschiedenen hochaktuellen Diskussionen und praktischen Anwendungen auf, aber für viele Entdecker, die neu auf diesem Gebiet sind, sind ihre spezifische Bedeutung und ihre internen Zusammenhänge möglicherweise noch immer rätselhaft. Schauen wir uns also zunächst dieses Bild an. Es ist ersichtlich, dass zwischen Deep Learning, maschinellem Lernen und künstlicher Intelligenz ein enger Zusammenhang und eine fortschreitende Beziehung besteht. Deep Learning ist ein spezifischer Bereich des maschinellen Lernens und des maschinellen Lernens

Super stark! Top 10 Deep-Learning-Algorithmen!

Mar 15, 2024 pm 03:46 PM

Super stark! Top 10 Deep-Learning-Algorithmen!

Mar 15, 2024 pm 03:46 PM

Fast 20 Jahre sind vergangen, seit das Konzept des Deep Learning im Jahr 2006 vorgeschlagen wurde. Deep Learning hat als Revolution auf dem Gebiet der künstlichen Intelligenz viele einflussreiche Algorithmen hervorgebracht. Was sind Ihrer Meinung nach die zehn besten Algorithmen für Deep Learning? Im Folgenden sind meiner Meinung nach die besten Algorithmen für Deep Learning aufgeführt. Sie alle nehmen hinsichtlich Innovation, Anwendungswert und Einfluss eine wichtige Position ein. 1. Hintergrund des Deep Neural Network (DNN): Deep Neural Network (DNN), auch Multi-Layer-Perceptron genannt, ist der am weitesten verbreitete Deep-Learning-Algorithmus. Als er erstmals erfunden wurde, wurde er aufgrund des Engpasses bei der Rechenleistung in Frage gestellt Jahre, Rechenleistung, Der Durchbruch kam mit der Datenexplosion. DNN ist ein neuronales Netzwerkmodell, das mehrere verborgene Schichten enthält. In diesem Modell übergibt jede Schicht Eingaben an die nächste Schicht und

So verwenden Sie CNN- und Transformer-Hybridmodelle, um die Leistung zu verbessern

Jan 24, 2024 am 10:33 AM

So verwenden Sie CNN- und Transformer-Hybridmodelle, um die Leistung zu verbessern

Jan 24, 2024 am 10:33 AM

Convolutional Neural Network (CNN) und Transformer sind zwei verschiedene Deep-Learning-Modelle, die bei verschiedenen Aufgaben eine hervorragende Leistung gezeigt haben. CNN wird hauptsächlich für Computer-Vision-Aufgaben wie Bildklassifizierung, Zielerkennung und Bildsegmentierung verwendet. Es extrahiert lokale Merkmale auf dem Bild durch Faltungsoperationen und führt eine Reduzierung der Merkmalsdimensionalität und räumliche Invarianz durch Pooling-Operationen durch. Im Gegensatz dazu wird Transformer hauptsächlich für Aufgaben der Verarbeitung natürlicher Sprache (NLP) wie maschinelle Übersetzung, Textklassifizierung und Spracherkennung verwendet. Es nutzt einen Selbstaufmerksamkeitsmechanismus, um Abhängigkeiten in Sequenzen zu modellieren und vermeidet so die sequentielle Berechnung in herkömmlichen rekurrenten neuronalen Netzen. Obwohl diese beiden Modelle für unterschiedliche Aufgaben verwendet werden, weisen sie Ähnlichkeiten in der Sequenzmodellierung auf

Verbesserter RMSprop-Algorithmus

Jan 22, 2024 pm 05:18 PM

Verbesserter RMSprop-Algorithmus

Jan 22, 2024 pm 05:18 PM

RMSprop ist ein weit verbreiteter Optimierer zum Aktualisieren der Gewichte neuronaler Netze. Es wurde 2012 von Geoffrey Hinton et al. vorgeschlagen und ist der Vorgänger des Adam-Optimierers. Das Aufkommen des RMSprop-Optimierers besteht hauptsächlich darin, einige Probleme zu lösen, die im SGD-Gradientenabstiegsalgorithmus auftreten, wie z. B. das Verschwinden des Gradienten und die Explosion des Gradienten. Durch den Einsatz des RMSprop-Optimierers kann die Lernrate effektiv angepasst und Gewichte adaptiv aktualisiert werden, wodurch der Trainingseffekt des Deep-Learning-Modells verbessert wird. Die Kernidee des RMSprop-Optimierers besteht darin, einen gewichteten Durchschnitt von Gradienten durchzuführen, sodass Gradienten in unterschiedlichen Zeitschritten unterschiedliche Auswirkungen auf Gewichtsaktualisierungen haben. Konkret berechnet RMSprop das Quadrat jedes Parameters