KI-Rauchverbot ist okay! Rauchererkennung + Gesichtserkennung

Hallo zusammen.

Heute werde ich ein Rauchererkennungs- und Gesichtserkennungsprojekt mit Ihnen teilen. An vielen öffentlichen Orten, in Produktionsstätten und in Schulen gibt es Rauchverbote. Es ist weiterhin notwendig, eine Rauchverbotsüberwachung durchzuführen und die KI das Rauchverhalten automatisch erkennen zu lassen und zu erkennen, wer raucht.

Verwenden Sie den Zielerkennungsalgorithmus, um das Rauchverhalten zu bestimmen, das Gesicht des Rauchers zu extrahieren und mithilfe des Gesichtserkennungsalgorithmus festzustellen, wer raucht. Die Idee ist relativ einfach, aber die Details sind immer noch etwas mühsam.

Die im Projekt verwendeten Trainingsdaten und Quellcode wurden gepackt. Es ist immer noch dasselbe wie zuvor, lesen Sie es im Kommentarbereich.

1. Um Zigaretten zu erkennen

Ich habe 5.000 markierte Rauchdaten als Trainingsdaten verwendet

und sie im Datensatzverzeichnis abgelegt.

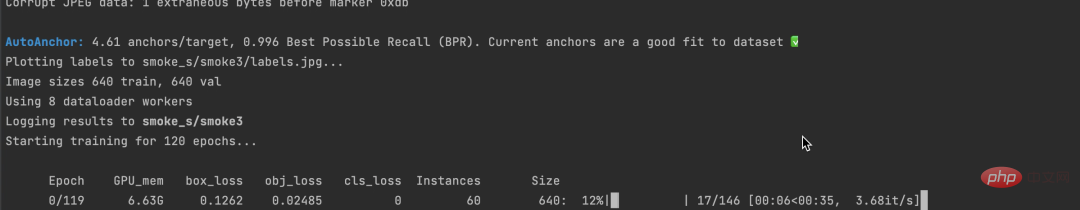

Trainieren Sie das YOLOv5-Zielerkennungsmodell.

Der erste Schritt besteht darin, data/coco128.yaml nach Smoke.yaml zu kopieren und das Datensatzverzeichnis und die Kategoriekonfigurationsinformationen zu ändern.

path: ../dataset/smoke # dataset root dir train: images/train# train images (relative to 'path') 128 images val: images/test# val images (relative to 'path') 128 images test:# test images (optional) # Classes names: 0: smoke

Der zweite Schritt besteht darin, ./models/yolov5s.yaml nach Smoke.yaml zu kopieren und nc zu ändern

nc: 1# number of classes

Der dritte Schritt besteht darin, das vorab trainierte Modell yolov5s.pt herunterzuladen und im Verzeichnis {yolov5-Verzeichnis}/weights abzulegen

Führen Sie den folgenden Befehl aus, um zu trainieren

python ./train.py --data ./data/smoke.yaml --cfg ./models/smoke.yaml --weights ./weights/yolov5s.pt --batch-size 30 --epochs 120 --workers 8 --name smoke --project smoke_s

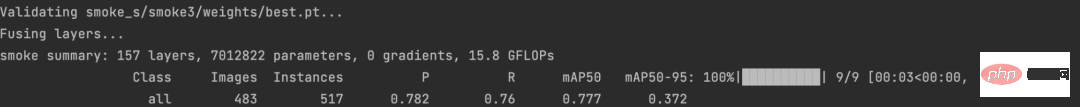

Nachdem das Training abgeschlossen ist, werden Sie kann die folgende Ausgabe sehen:

Es ist in Ordnung, es richtig zu nennen.

Nach Abschluss des Trainings kann die best.pt-Position gefunden und später zur Zigarettenerkennung verwendet werden.

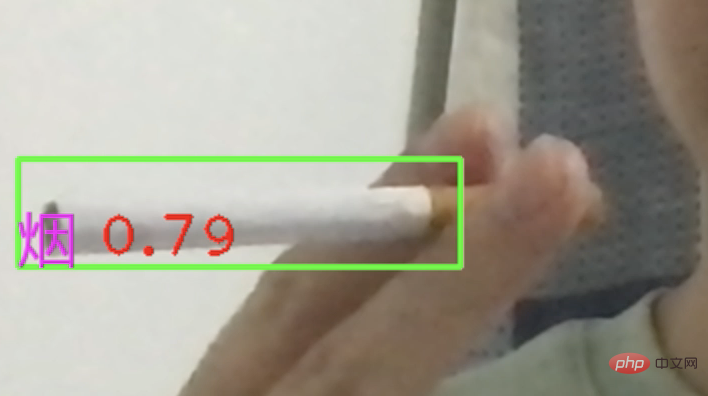

model = torch.hub.load('../28_people_counting/yolov5', 'custom', './weights/ciga.pt', source='local')

results = self.model(img[:, :, ::-1])

pd = results.pandas().xyxy[0]

ciga_pd = pd[pd['class'] == 0]

Nachdem wir Zigaretten identifizieren konnten, müssen wir noch feststellen, ob wir derzeit rauchen.

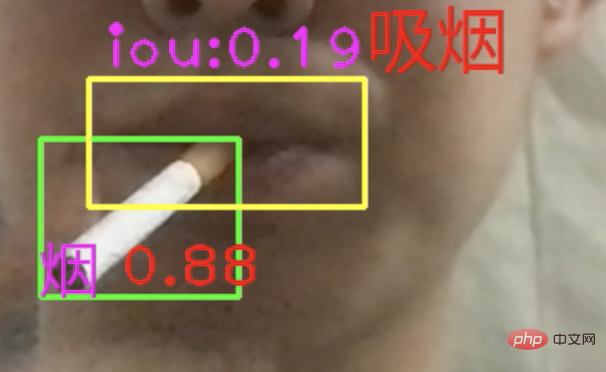

Sie können den IOU mithilfe des Zigarettenerkennungsrahmens und des Munderkennungsrahmens berechnen, um festzustellen, ob sich die beiden Rahmen überschneiden.

Munderkennungsrahmen, der Gesichtsschlüsselpunkte zur Identifizierung verwendet.

2. Gesichtserkennung

Es gibt viele ausgereifte Modelle für Gesichtserkennungsalgorithmen. Wir müssen sie nicht selbst trainieren, wir können die Datenbank einfach direkt anpassen.

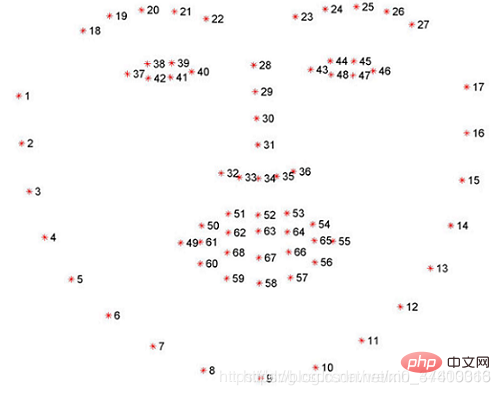

Ich verwende hier die dlib-Bibliothek, die 68 Schlüsselpunkte auf einem Gesicht identifizieren und Gesichtsmerkmale basierend auf diesen 68 Schlüsselpunkten extrahieren kann.

face_detector = dlib.get_frontal_face_detector()

face_sp = dlib.shape_predictor('./weights/shape_predictor_68_face_landmarks.dat')

dets = face_detector(img, 1)

face_list = []

for face in dets:

l, t, r, b = face.left(), face.top(), face.right(), face.bottom()

face_shape = face_sp(img, face)face_detector kann Gesichter erkennen und den Gesichtserkennungsrahmen zurückgeben. face_sp basiert auf dem Gesichtserkennungsrahmen und identifiziert 68 Schlüsselpunkte des Gesichts.

Anhand dieser 68 Schlüsselpunkte können wir den Munderkennungsrahmen erhalten, um festzustellen, ob Sie rauchen.

Abschließend hoffen wir immer noch, Gesichtserkennungsalgorithmen nutzen zu können, um zu erkennen, wer raucht.

Der erste Schritt besteht darin, Gesichtsmerkmale zu extrahieren

face_feature_model = dlib.face_recognition_model_v1('./weights/dlib_face_recognition_resnet_model_v1.dat')

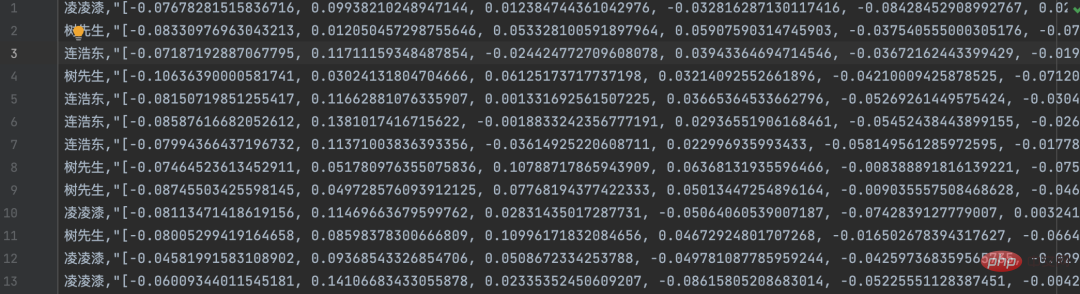

face_descriptor = face_feature_model.compute_face_descriptor(img, face_shape)face_descriptorBerechnen Sie einen Merkmalsvektor für jedes Gesicht basierend auf der Position und dem Abstand zwischen den 68 Schlüsselpunkten des Gesichts. Dieses Prinzip ähnelt dem zuvor geteilten word2vec oder dem Zuordnen von Videos zu N-dimensionalen Vektoren.

Der zweite Schritt besteht darin, die vorhandenen Gesichter in die Gesichtsdatenbank einzutragen. Ich habe 3 Rauchverhaltensweisen in Filmen und Fernsehserien vorbereitet

Schneiden Sie Gesichter aus den Videos aus, vektorisieren Sie sie und schreiben Sie sie in die Gesichtsdatenbank (ersetzt durch Dateien)

Der dritte Schritt, das Rauchverhalten, erfolgt schließlich. Wir können das Gesicht des Rauchers ausschneiden, den Gesichtsvektor berechnen, ihn mit den Merkmalen der Gesichtsdatenbank vergleichen, das ähnlichste Gesicht finden und den entsprechenden Namen zurückgeben erweitert werden, zum Beispiel: Das von mir bereitgestellte Video hat nur ein einziges Gesicht, aber in der tatsächlichen Überwachung müssen mehrere Gesichter vorhanden sein. Zu diesem Zeitpunkt können Sie den MOT-Algorithmus verwenden, um Fußgänger zu verfolgen und dann jede Person einzeln für das Rauchen zu identifizieren. Außerdem können Sie einen separaten Statistikbereich erstellen, um das identifizierte Rauchverhalten zu speichern und es als Beweis für Warnungen und Strafen zu verwenden.

Das obige ist der detaillierte Inhalt vonKI-Rauchverbot ist okay! Rauchererkennung + Gesichtserkennung. Für weitere Informationen folgen Sie bitte anderen verwandten Artikeln auf der PHP chinesischen Website!

Heiße KI -Werkzeuge

Undresser.AI Undress

KI-gestützte App zum Erstellen realistischer Aktfotos

AI Clothes Remover

Online-KI-Tool zum Entfernen von Kleidung aus Fotos.

Undress AI Tool

Ausziehbilder kostenlos

Clothoff.io

KI-Kleiderentferner

Video Face Swap

Tauschen Sie Gesichter in jedem Video mühelos mit unserem völlig kostenlosen KI-Gesichtstausch-Tool aus!

Heißer Artikel

Heiße Werkzeuge

Notepad++7.3.1

Einfach zu bedienender und kostenloser Code-Editor

SublimeText3 chinesische Version

Chinesische Version, sehr einfach zu bedienen

Senden Sie Studio 13.0.1

Leistungsstarke integrierte PHP-Entwicklungsumgebung

Dreamweaver CS6

Visuelle Webentwicklungstools

SublimeText3 Mac-Version

Codebearbeitungssoftware auf Gottesniveau (SublimeText3)

Heiße Themen

Web3 Trading Platform Ranking_Web3 Globale Top Ten Summary Top Ten Summary

Apr 21, 2025 am 10:45 AM

Web3 Trading Platform Ranking_Web3 Globale Top Ten Summary Top Ten Summary

Apr 21, 2025 am 10:45 AM

Binance ist der Overlord des Global Digital Asset Trading -Ökosystems, und seine Merkmale umfassen: 1. Das durchschnittliche tägliche Handelsvolumen übersteigt 150 Milliarden US -Dollar, unterstützt 500 Handelspaare, die 98% der Mainstream -Währungen abdecken. 2. Die Innovationsmatrix deckt den Markt für Derivate, das Web3 -Layout und den Bildungssystem ab; 3. Die technischen Vorteile sind Millisekunden -Matching -Engines mit Spitzenvolumina von 1,4 Millionen Transaktionen pro Sekunde. 4. Compliance Progress hält 15 Länderlizenzen und legt konforme Einheiten in Europa und den Vereinigten Staaten ein.

Worldcoin (WLD) Preisprognose 2025-2031: Wird WLD bis 2031 $ erreichen?

Apr 21, 2025 pm 02:42 PM

Worldcoin (WLD) Preisprognose 2025-2031: Wird WLD bis 2031 $ erreichen?

Apr 21, 2025 pm 02:42 PM

Worldcoin (WLD) fällt auf dem Kryptowährungsmarkt mit seinen einzigartigen biometrischen Überprüfungs- und Datenschutzschutzmechanismen auf, die die Aufmerksamkeit vieler Investoren auf sich ziehen. WLD hat mit seinen innovativen Technologien, insbesondere in Kombination mit OpenAI -Technologie für künstliche Intelligenz, außerdem unter Altcoins gespielt. Aber wie werden sich die digitalen Vermögenswerte in den nächsten Jahren verhalten? Lassen Sie uns den zukünftigen Preis von WLD zusammen vorhersagen. Die Preisprognose von 2025 WLD wird voraussichtlich im Jahr 2025 ein signifikantes Wachstum in WLD erzielen. Die Marktanalyse zeigt, dass der durchschnittliche WLD -Preis 1,31 USD mit maximal 1,36 USD erreichen kann. In einem Bärenmarkt kann der Preis jedoch auf rund 0,55 US -Dollar fallen. Diese Wachstumserwartung ist hauptsächlich auf Worldcoin2 zurückzuführen.

Was bedeutet Cross-Chain-Transaktion? Was sind die Cross-Chain-Transaktionen?

Apr 21, 2025 pm 11:39 PM

Was bedeutet Cross-Chain-Transaktion? Was sind die Cross-Chain-Transaktionen?

Apr 21, 2025 pm 11:39 PM

Börsen, die Cross-Chain-Transaktionen unterstützen: 1. Binance, 2. Uniswap, 3. Sushiswap, 4. Kurvenfinanzierung, 5. Thorchain, 6. 1inch Exchange, 7. DLN-Handel, diese Plattformen unterstützen Multi-Chain-Asset-Transaktionen durch verschiedene Technologien.

Rangliste der Hebelbörsen im Währungskreis Die neuesten Empfehlungen der zehn meistgezogenen Börsen im Währungskreis

Apr 21, 2025 pm 11:24 PM

Rangliste der Hebelbörsen im Währungskreis Die neuesten Empfehlungen der zehn meistgezogenen Börsen im Währungskreis

Apr 21, 2025 pm 11:24 PM

Die Plattformen, die im Jahr 2025 im Leveraged Trading, Security und Benutzererfahrung hervorragende Leistung haben, sind: 1. OKX, geeignet für Hochfrequenzhändler und bieten bis zu 100-fache Hebelwirkung; 2. Binance, geeignet für Mehrwährungshändler auf der ganzen Welt und bietet 125-mal hohe Hebelwirkung; 3. Gate.io, geeignet für professionelle Derivate Spieler, die 100 -fache Hebelwirkung bietet; 4. Bitget, geeignet für Anfänger und Sozialhändler, die bis zu 100 -fache Hebelwirkung bieten; 5. Kraken, geeignet für stetige Anleger, die fünfmal Hebelwirkung liefert; 6. Bybit, geeignet für Altcoin -Entdecker, die 20 -fache Hebelwirkung bietet; 7. Kucoin, geeignet für kostengünstige Händler, die 10-fache Hebelwirkung bietet; 8. Bitfinex, geeignet für das Seniorenspiel

Warum ist der Anstieg oder Abfall der virtuellen Währungspreise? Warum ist der Anstieg oder Abfall der virtuellen Währungspreise?

Apr 21, 2025 am 08:57 AM

Warum ist der Anstieg oder Abfall der virtuellen Währungspreise? Warum ist der Anstieg oder Abfall der virtuellen Währungspreise?

Apr 21, 2025 am 08:57 AM

Faktoren der steigenden Preise für virtuelle Währung sind: 1. Erhöhte Marktnachfrage, 2. Verringertes Angebot, 3.. Rückgangsfaktoren umfassen: 1. Verringerte Marktnachfrage, 2. Erhöhtes Angebot, 3. Streik der negativen Nachrichten, 4. Pessimistische Marktstimmung, 5. makroökonomisches Umfeld.

Top 10 Cryptocurrency Exchange -Plattformen Die weltweit größte Liste der digitalen Währung

Apr 21, 2025 pm 07:15 PM

Top 10 Cryptocurrency Exchange -Plattformen Die weltweit größte Liste der digitalen Währung

Apr 21, 2025 pm 07:15 PM

Börsen spielen eine wichtige Rolle auf dem heutigen Kryptowährungsmarkt. Sie sind nicht nur Plattformen, an denen Investoren handeln, sondern auch wichtige Quellen für Marktliquidität und Preisentdeckung. Der weltweit größte virtuelle Währungsbörsen gehören zu den Top Ten, und diese Börsen sind nicht nur im Handelsvolumen weit voraus, sondern haben auch ihre eigenen Vorteile in Bezug auf Benutzererfahrung, Sicherheit und innovative Dienste. Börsen, die über die Liste stehen, haben normalerweise eine große Benutzerbasis und einen umfangreichen Markteinfluss, und deren Handelsvolumen und Vermögenstypen sind häufig mit anderen Börsen schwer zu erreichen.

Aavenomics ist eine Empfehlung, das Aave -Protokoll -Token zu ändern und Token -Rückkauf einzuführen, die die Quorum -Anzahl von Personen erreicht hat.

Apr 21, 2025 pm 06:24 PM

Aavenomics ist eine Empfehlung, das Aave -Protokoll -Token zu ändern und Token -Rückkauf einzuführen, die die Quorum -Anzahl von Personen erreicht hat.

Apr 21, 2025 pm 06:24 PM

Aavenomics ist ein Vorschlag zur Änderung des Aave -Protokoll -Tokens und zur Einführung von Token -Repos, die ein Quorum für Aavedao implementiert hat. Marc Zeller, Gründer der AAVE -Projektkette (ACI), kündigte dies auf X an und stellte fest, dass sie eine neue Ära für die Vereinbarung markiert. Marc Zeller, Gründer der Aave Chain Initiative (ACI), kündigte auf X an, dass der Aavenomics -Vorschlag das Modifizieren des Aave -Protokoll -Tokens und die Einführung von Token -Repos umfasst, hat ein Quorum für Aavedao erreicht. Laut Zeller ist dies eine neue Ära für die Vereinbarung. AVEDAO -Mitglieder stimmten überwiegend für die Unterstützung des Vorschlags, der am Mittwoch 100 pro Woche betrug

Was sind die Hybrid -Blockchain -Handelsplattformen?

Apr 21, 2025 pm 11:36 PM

Was sind die Hybrid -Blockchain -Handelsplattformen?

Apr 21, 2025 pm 11:36 PM

Vorschläge für die Auswahl eines Kryptowährungsaustauschs: 1. Für die Liquiditätsanforderungen ist Priorität Binance, Gate.io oder OKX aufgrund seiner Bestelltiefe und der starken Volatilitätsbeständigkeit. 2. Compliance and Security, Coinbase, Kraken und Gemini haben strenge regulatorische Bestätigung. 3. Innovative Funktionen, Kucoins sanftes Stakel und Derivatdesign von Bitbit eignen sich für fortschrittliche Benutzer.