Technologie-Peripheriegeräte

Technologie-Peripheriegeräte

KI

KI

Das Erlernen eines Diffusionsmodells aus einem einzelnen natürlichen Bild ist besser als GAN. SinDiffusion erreicht neue SOTA

Das Erlernen eines Diffusionsmodells aus einem einzelnen natürlichen Bild ist besser als GAN. SinDiffusion erreicht neue SOTA

Das Erlernen eines Diffusionsmodells aus einem einzelnen natürlichen Bild ist besser als GAN. SinDiffusion erreicht neue SOTA

Die Technologie, Bilder aus einem einzelnen natürlichen Bild zu erzeugen, ist weit verbreitet und hat daher immer mehr Aufmerksamkeit erhalten. Diese Forschung zielt darauf ab, ein bedingungsloses generatives Modell aus einem einzelnen natürlichen Bild zu erlernen, um durch die Erfassung interner Patch-Statistiken verschiedene Proben mit ähnlichem visuellen Inhalt zu generieren. Sobald das Modell trainiert ist, kann es nicht nur qualitativ hochwertige, auflösungsunabhängige Bilder erzeugen, sondern kann auch problemlos an eine Vielzahl von Anwendungen angepasst werden, wie z. B. Bildbearbeitung, Bildharmonisierung und Konvertierung zwischen Bildern.

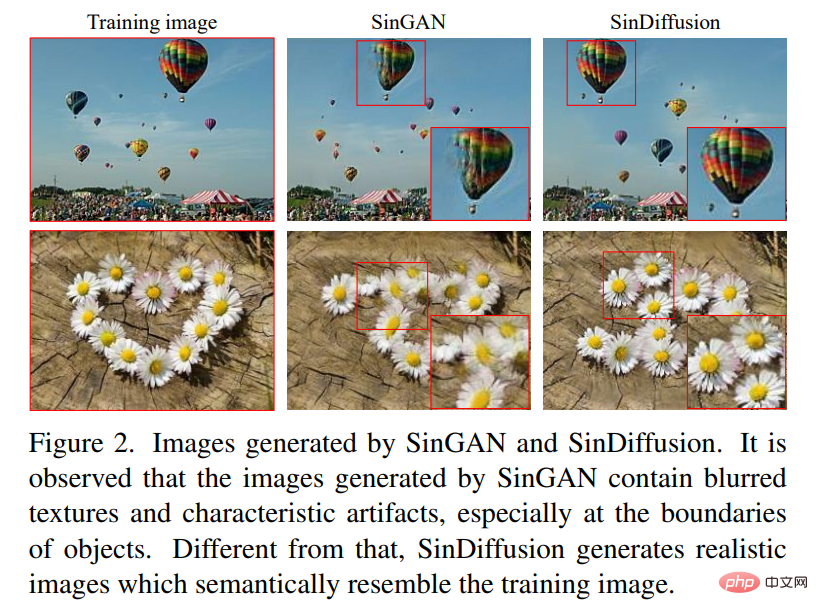

SinGAN kann die oben genannten Anforderungen erfüllen. Diese Methode kann mehrere Maßstäbe natürlicher Bilder erstellen und eine Reihe von GANs trainieren, um die internen statistischen Informationen von Patches in einem einzelnen Bild zu lernen. Die Kernidee von SinGAN besteht darin, mehrere Modelle in zunehmend größeren Maßstäben zu trainieren. Die mit diesen Methoden erzeugten Bilder können jedoch unbefriedigend sein, da sie unter kleinen Detailfehlern leiden, die zu offensichtlichen Artefakten in den erzeugten Bildern führen (siehe Abbildung 2).

In diesem Artikel schlugen Forscher der Universität für Wissenschaft und Technologie von China, Microsoft Research Asia und anderen Institutionen ein neues Framework vor – ein Einzelbilddiffusionsmodell (SinDiffusion, Single-Image Diffusion). wird verwendet, um aus einem einzelnen natürlichen Bild zu lernen, das auf dem Denoising Diffusion Probabilistic Model (DDPM) basiert. Obwohl das Diffusionsmodell ein mehrstufiger Generierungsprozess ist, weist es nicht das Problem kumulativer Fehler auf. Der Grund dafür ist, dass das Diffusionsmodell eine systematische mathematische Formel hat und Fehler in Zwischenschritten als Interferenz angesehen und während des Diffusionsprozesses verbessert werden können.

Ein weiteres Kerndesign von SinDiffusion besteht darin, das Empfangsfeld des Diffusionsmodells zu begrenzen. Diese Studie untersucht die Netzwerkstruktur, die häufig in früheren Diffusionsmodellen verwendet wurde [7] und stellt fest, dass sie eine stärkere Leistung und eine tiefere Struktur aufweist. Das Empfangsfeld dieser Netzwerkstruktur ist jedoch groß genug, um das gesamte Bild abzudecken, was dazu führt, dass das Modell dazu neigt, sich auf Gedächtnistrainingsbilder zu verlassen, um Bilder zu erzeugen, die genau den Trainingsbildern entsprechen. Um das Modell dazu zu ermutigen, Patch-Statistiken zu lernen, anstatt sich das gesamte Bild zu merken, hat die Forschung die Netzwerkstruktur sorgfältig entworfen und ein Patch-weises Rauschunterdrückungsnetzwerk eingeführt. Im Vergleich zur vorherigen Diffusionsstruktur reduziert SinDiffusion die Anzahl der Downsamplings und die Anzahl der ResBlocks in der ursprünglichen Netzwerkstruktur zur Rauschunterdrückung. Auf diese Weise kann SinDiffusion aus einem einzelnen natürlichen Bild lernen und qualitativ hochwertige und vielfältige Bilder erzeugen (siehe Abbildung 2).

- Papieradresse: https://arxiv.org/pdf/2211.12445.pdf

- Projektadresse: https://github.com/WeilunWang/SinDiffusion.

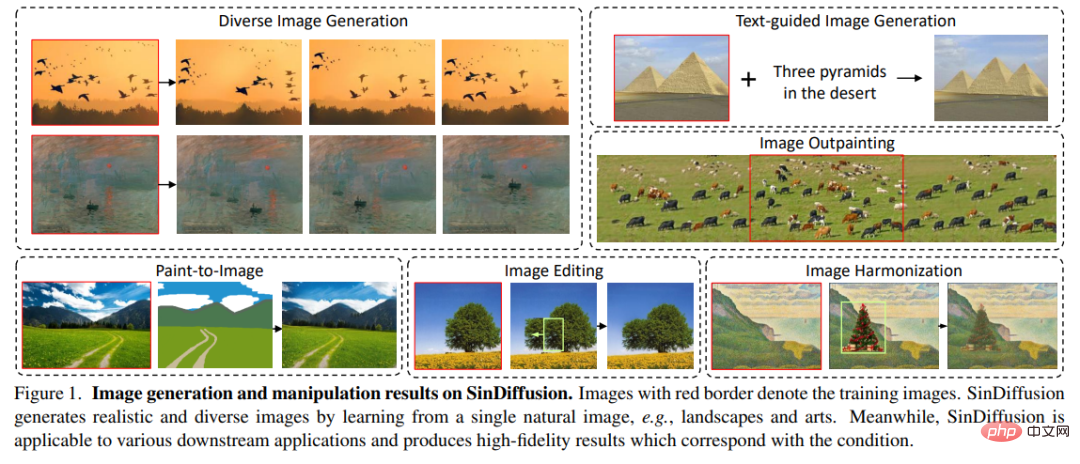

Der Vorteil von SinDiffusion besteht darin, dass es flexibel in verschiedenen Szenarien eingesetzt werden kann (siehe Abbildung 1). Es kann in verschiedenen Anwendungen eingesetzt werden, ohne dass das Modell neu trainiert werden muss. In SinGAN werden nachgelagerte Anwendungen hauptsächlich durch die Eingabe von Bedingungen in vorab trainierte GANs in verschiedenen Maßstäben implementiert. Daher ist die Anwendung von SinGAN auf räumlich ausgerichtete Bedingungen beschränkt. Im Gegensatz dazu ist SinDiffusion darauf ausgelegt, durch Probenahmeverfahren in einem breiteren Anwendungsspektrum eingesetzt zu werden. SinDiffusion lernt durch bedingungsloses Training, den Gradienten einer Datenverteilung vorherzusagen. Unter der Annahme, dass es eine Bewertungsfunktion gibt, die die Korrelation zwischen generierten Bildern und Bedingungen beschreibt (d. h. L-p-Abstand oder ein vortrainiertes Netzwerk wie CLIP), nutzt diese Studie den Gradienten der Korrelationsbewertung, um den Stichprobenprozess von SinDiffusion zu steuern. Auf diese Weise ist SinDiffusion in der Lage, Bilder zu generieren, die sowohl zur Datenverteilung als auch zu den gegebenen Bedingungen passen.

Die Studie demonstriert die Vorteile des vorgeschlagenen Rahmens, indem sie Experimente mit einer Vielzahl natürlicher Bilder durchführt, darunter Landschaften und berühmte Kunstwerke. Sowohl quantitative als auch qualitative Ergebnisse bestätigen, dass SinDiffusion hochpräzise und vielfältige Ergebnisse liefern kann, während nachgelagerte Anwendungen den Nutzen und die Flexibilität von SinDiffusion weiter unter Beweis stellen.

Methode

Im Gegensatz zum progressiven Wachstumsdesign in früheren Studien verwendet SinDiffusion für das Training ein einziges Entrauschungsmodell auf einer einzigen Skala, um die Anhäufung von Fehlern zu verhindern. Darüber hinaus stellte diese Studie fest, dass das Empfangsfeld auf Patch-Ebene des Diffusionsnetzwerks eine wichtige Rolle bei der Erfassung der internen Patch-Verteilung spielt, und entwarf eine neue Netzwerkstruktur zur Rauschunterdrückung. Basierend auf diesen beiden Kerndesigns generiert SinDiffusion hochwertige und vielfältige Bilder aus einem einzigen natürlichen Bild.

Der Rest dieses Abschnitts ist wie folgt aufgebaut: Zuerst überprüfen wir SinGAN und zeigen die Motivation von SinDiffusion und stellen dann das strukturelle Design von SinDiffusion vor.

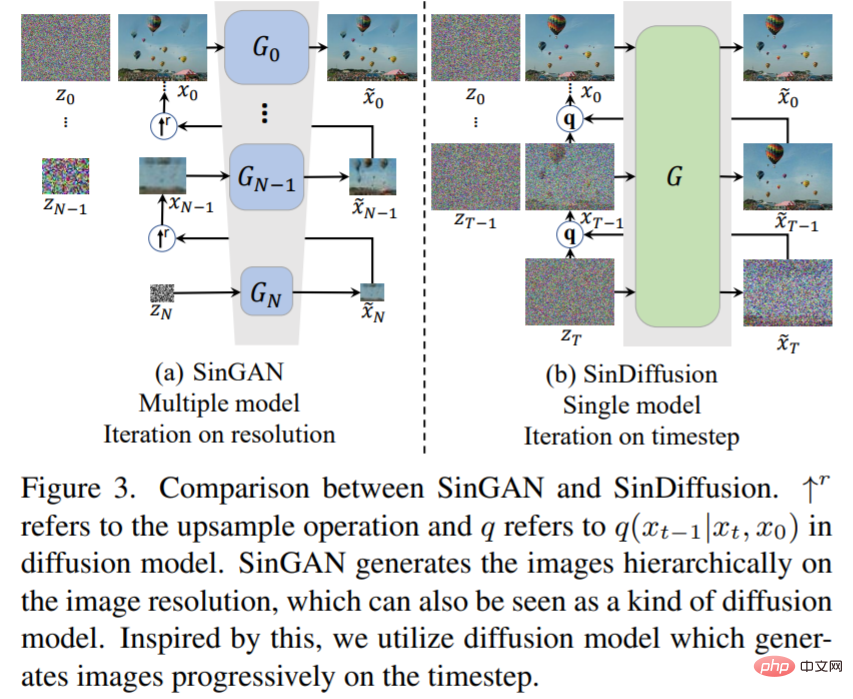

Lassen Sie uns zunächst einen kurzen Überblick über SinGAN geben. Abbildung 3(a) zeigt den Generierungsprozess von SinGAN. Um aus einem einzigen Bild unterschiedliche Bilder zu generieren, besteht ein Schlüsselentwurf von SinGAN darin, eine Bildpyramide aufzubauen und die Auflösung der erzeugten Bilder schrittweise zu erhöhen.

Abbildung 3(b) zeigt das neue Framework von SinDiffusion. Im Gegensatz zu SinGAN führt SinDiffusion einen mehrstufigen Generierungsprozess unter Verwendung eines einzelnen Entrauschungsnetzwerks in einem einzigen Maßstab durch. Obwohl SinDiffusion ebenfalls den gleichen mehrstufigen Generierungsprozess wie SinGAN verwendet, sind die generierten Ergebnisse von hoher Qualität. Dies liegt daran, dass das Diffusionsmodell auf der systematischen Ableitung mathematischer Gleichungen basiert und durch Zwischenschritte erzeugte Fehler während des Diffusionsprozesses immer wieder zu Rauschen verfeinert werden.

SinDiffusion

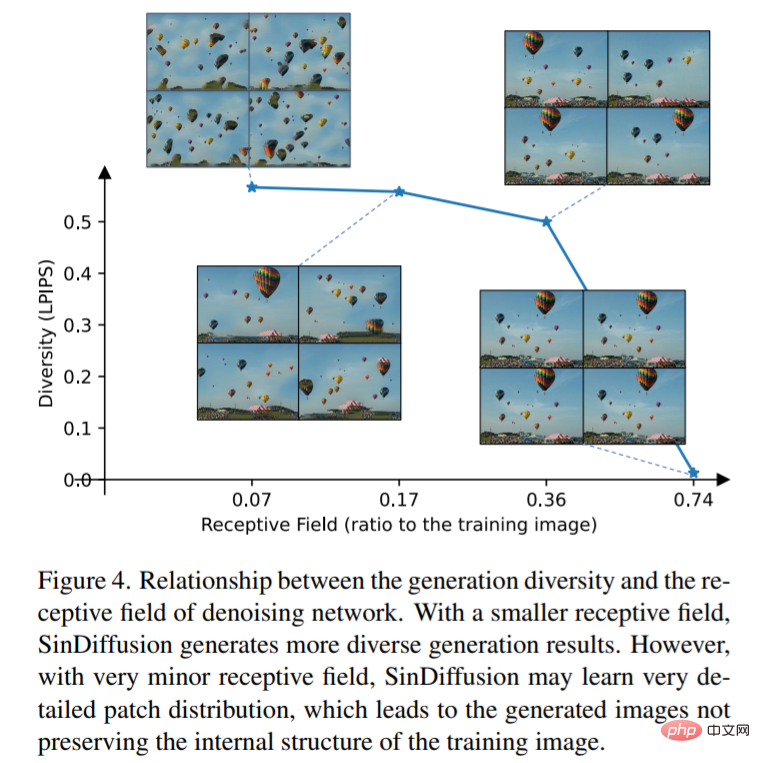

Dieser Artikel untersucht die Beziehung zwischen Generationenvielfalt und dem Empfangsfeld des Entrauschungsnetzwerks – eine Änderung der Netzwerkstruktur des Entrauschungsnetzwerks kann das Empfangsfeld verändern, und vier Arten von Diese Modelle werden auf einem einzelnen natürlichen Bild trainiert, wobei Netzwerkstrukturen mit unterschiedlichen Empfangsfeldern, aber vergleichbarer Leistung verwendet werden. Abbildung 4 zeigt die vom Modell unter verschiedenen Empfangsfeldern generierten Ergebnisse. Es ist zu beobachten, dass die durch SinDiffusion erzeugten Ergebnisse umso vielfältiger sind, je kleiner das Empfangsfeld ist und umgekehrt. Untersuchungen haben jedoch ergeben, dass extrem kleine Empfangsfeldmodelle die vernünftige Struktur des Bildes nicht aufrechterhalten können. Daher ist ein geeignetes Empfangsfeld wichtig und notwendig, um vernünftige Patch-Statistiken zu erhalten.

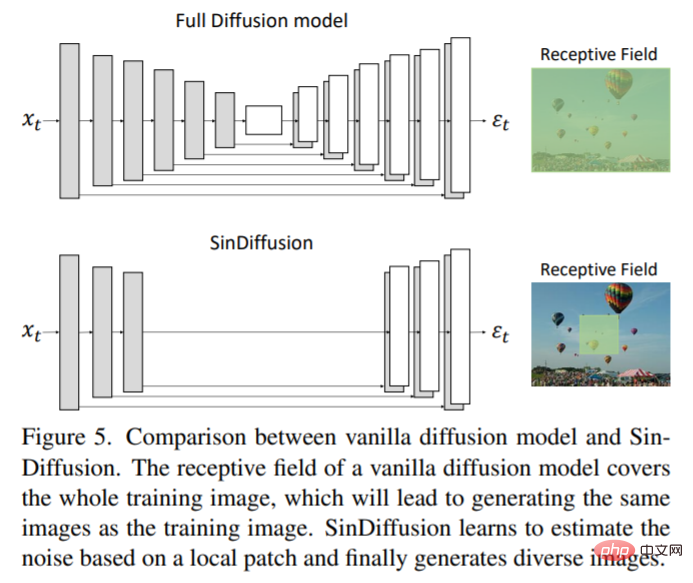

Diese Forschung gestaltet das häufig verwendete Diffusionsmodell neu und führt ein patchweises Entrauschungsnetzwerk für die Einzelbilderzeugung ein. Abbildung 5 ist eine Übersicht über das patchweise Entrauschungsnetzwerk in SinDiffusion und zeigt die Hauptunterschiede zu früheren Entrauschungsnetzwerken. Erstens wird die Tiefe des Entrauschungsnetzwerks durch die Reduzierung von Downsampling- und Upsampling-Vorgängen reduziert, wodurch das Empfangsfeld erheblich erweitert wird. Gleichzeitig werden die tiefen Aufmerksamkeitsschichten, die ursprünglich im Denoising-Netzwerk verwendet wurden, auf natürliche Weise entfernt, wodurch SinDiffusion zu einem vollständig Faltungsnetzwerk wird, das für die Generierung mit jeder Auflösung geeignet ist. Zweitens wird das Empfangsfeld von SinDiffusion weiter eingeschränkt, indem die Resblockierung der eingebetteten Zeit in jeder Auflösung reduziert wird. Diese Methode wird verwendet, um ein patchweises Rauschunterdrückungsnetzwerk mit geeigneten Empfangsfeldern zu erhalten und so realistische und vielfältige Ergebnisse zu erzielen.

Experiment

Die qualitativen Ergebnisse der zufällig generierten SinDiffusion-Bilder sind in Abbildung 6 dargestellt.

Es zeigt sich, dass SinDiffusion bei unterschiedlichen Auflösungen reale Bilder mit ähnlichen Mustern wie die Trainingsbilder erzeugen kann.

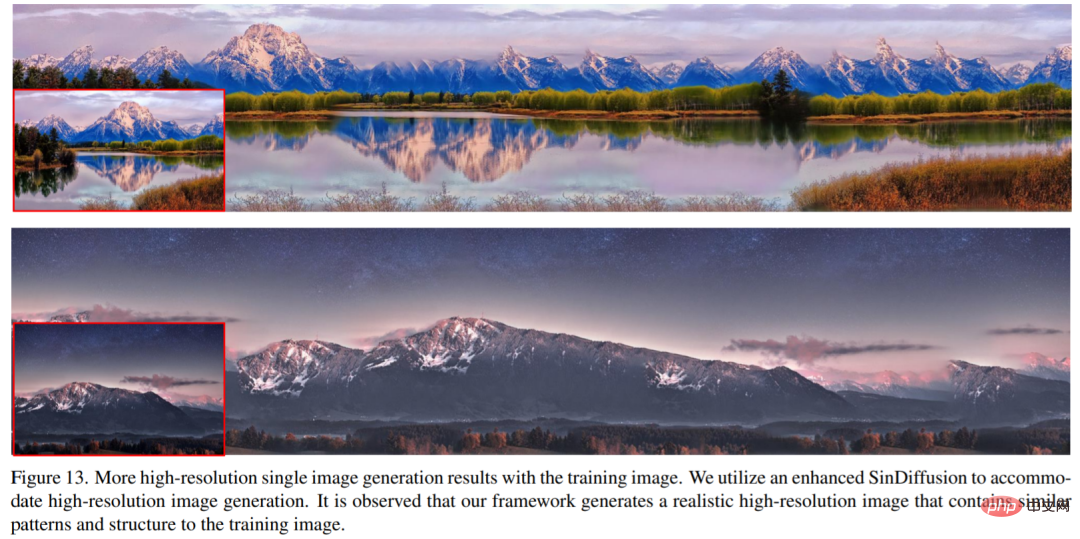

Darüber hinaus untersucht dieser Artikel auch SinDiffusion, wie man aus einem einzelnen Bild hochauflösende Bilder generiert. Abbildung 13 zeigt die Trainingsbilder und die generierten Ergebnisse. Das Trainingsbild ist ein Landschaftsbild mit einer Auflösung von 486 × 741, das reichhaltige Komponenten wie Wolken, Berge, Gras, Blumen und einen See enthält. Um die Erzeugung hochauflösender Bilder zu ermöglichen, wurde SinDiffusion auf eine erweiterte Version mit größeren Empfangsfeldern und Netzwerkfähigkeiten aktualisiert. Die erweiterte Version von SinDiffusion erzeugt ein hochauflösendes langes Bildlaufbild mit einer Auflösung von 486 x 2048. Der erzeugte Effekt behält das interne Layout des Trainingsbilds bei und fasst neue Inhalte zusammen, wie in Abbildung 13 dargestellt.

Vergleich mit früheren Methoden

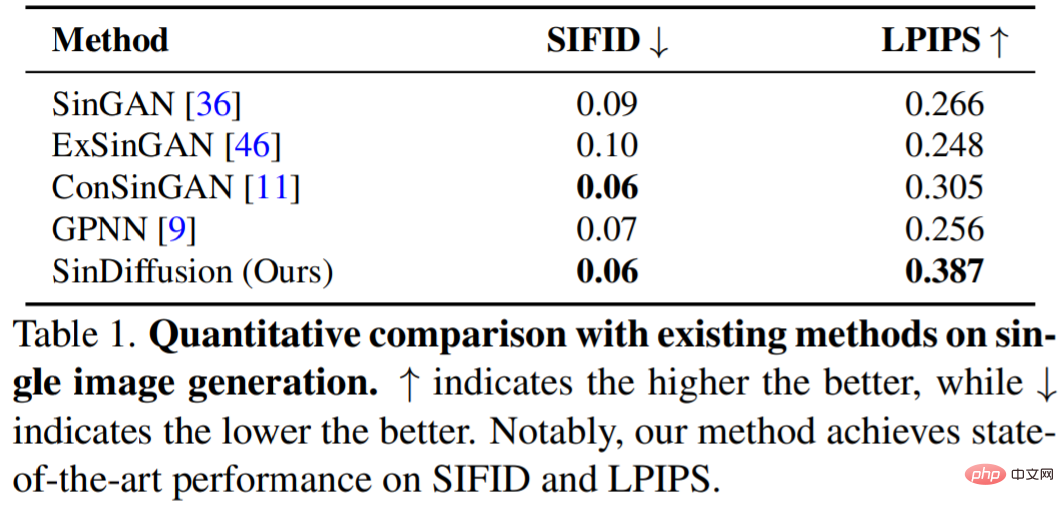

Tabelle 1 zeigt die quantitativen Ergebnisse von SinDiffusion im Vergleich zu mehreren anspruchsvollen Methoden, nämlich SinGAN, ExSinGAN, ConSinGAN und GPNN. Im Vergleich zu früheren GAN-basierten Methoden erreichte SinDiffusion nach schrittweisen Verbesserungen die SOTA-Leistung. Es ist erwähnenswert, dass die Forschungsmethode in diesem Artikel die Vielfalt der generierten Bilder erheblich verbessert. Im Durchschnitt von 50 Modellen, die mit dem Places50-Datensatz trainiert wurden, übertrifft diese Methode das derzeit anspruchsvollste Modell mit einem Wert von +0,082 LPIPS.

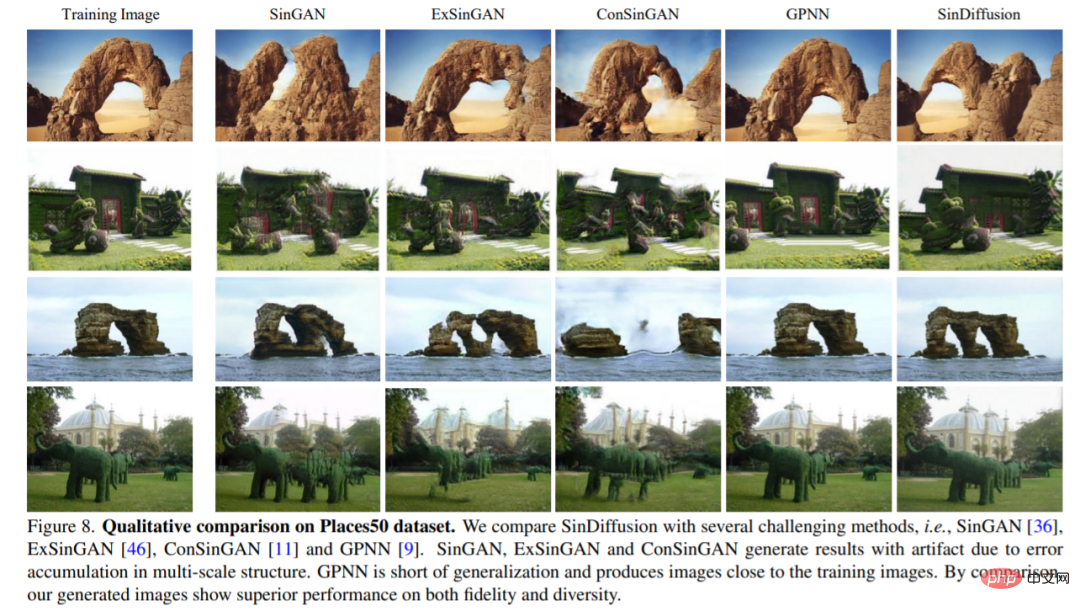

Zusätzlich zu den quantitativen Ergebnissen zeigt Abbildung 8 auch die qualitativen Ergebnisse des Places50-Datensatzes.

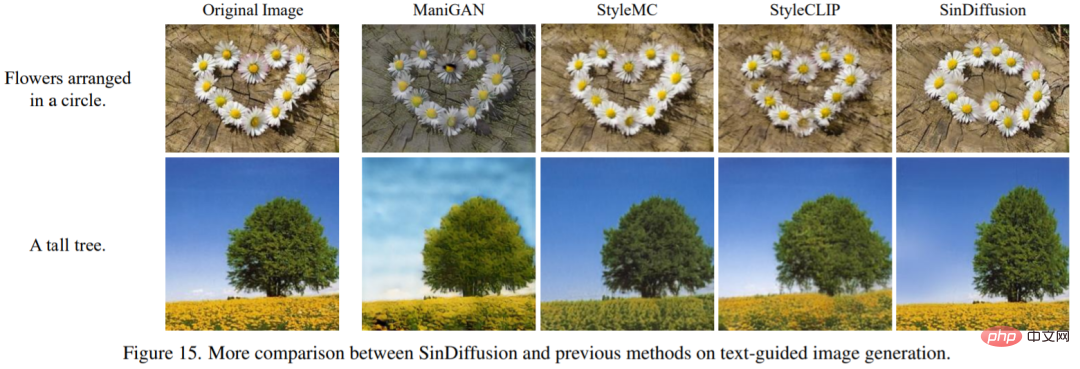

Abbildung 15 zeigt die Ergebnisse der textgesteuerten Bildgenerierung von SinDiffusion und früheren Methoden.

Weitere Informationen finden Sie im Originalpapier.

Das obige ist der detaillierte Inhalt vonDas Erlernen eines Diffusionsmodells aus einem einzelnen natürlichen Bild ist besser als GAN. SinDiffusion erreicht neue SOTA. Für weitere Informationen folgen Sie bitte anderen verwandten Artikeln auf der PHP chinesischen Website!

Heiße KI -Werkzeuge

Undresser.AI Undress

KI-gestützte App zum Erstellen realistischer Aktfotos

AI Clothes Remover

Online-KI-Tool zum Entfernen von Kleidung aus Fotos.

Undress AI Tool

Ausziehbilder kostenlos

Clothoff.io

KI-Kleiderentferner

AI Hentai Generator

Erstellen Sie kostenlos Ai Hentai.

Heißer Artikel

Heiße Werkzeuge

Notepad++7.3.1

Einfach zu bedienender und kostenloser Code-Editor

SublimeText3 chinesische Version

Chinesische Version, sehr einfach zu bedienen

Senden Sie Studio 13.0.1

Leistungsstarke integrierte PHP-Entwicklungsumgebung

Dreamweaver CS6

Visuelle Webentwicklungstools

SublimeText3 Mac-Version

Codebearbeitungssoftware auf Gottesniveau (SublimeText3)

Heiße Themen

1382

1382

52

52

Das weltweit leistungsstärkste Open-Source-MoE-Modell ist da, mit chinesischen Fähigkeiten, die mit GPT-4 vergleichbar sind, und der Preis beträgt nur fast ein Prozent von GPT-4-Turbo

May 07, 2024 pm 04:13 PM

Das weltweit leistungsstärkste Open-Source-MoE-Modell ist da, mit chinesischen Fähigkeiten, die mit GPT-4 vergleichbar sind, und der Preis beträgt nur fast ein Prozent von GPT-4-Turbo

May 07, 2024 pm 04:13 PM

Stellen Sie sich ein Modell der künstlichen Intelligenz vor, das nicht nur die Fähigkeit besitzt, die traditionelle Datenverarbeitung zu übertreffen, sondern auch eine effizientere Leistung zu geringeren Kosten erzielt. Dies ist keine Science-Fiction, DeepSeek-V2[1], das weltweit leistungsstärkste Open-Source-MoE-Modell, ist da. DeepSeek-V2 ist ein leistungsstarkes MoE-Sprachmodell (Mix of Experts) mit den Merkmalen eines wirtschaftlichen Trainings und einer effizienten Inferenz. Es besteht aus 236B Parametern, von denen 21B zur Aktivierung jedes Markers verwendet werden. Im Vergleich zu DeepSeek67B bietet DeepSeek-V2 eine stärkere Leistung, spart gleichzeitig 42,5 % der Trainingskosten, reduziert den KV-Cache um 93,3 % und erhöht den maximalen Generierungsdurchsatz auf das 5,76-fache. DeepSeek ist ein Unternehmen, das sich mit allgemeiner künstlicher Intelligenz beschäftigt

KI untergräbt die mathematische Forschung! Der Gewinner der Fields-Medaille und der chinesisch-amerikanische Mathematiker führten 11 hochrangige Arbeiten an | Gefällt mir bei Terence Tao

Apr 09, 2024 am 11:52 AM

KI untergräbt die mathematische Forschung! Der Gewinner der Fields-Medaille und der chinesisch-amerikanische Mathematiker führten 11 hochrangige Arbeiten an | Gefällt mir bei Terence Tao

Apr 09, 2024 am 11:52 AM

KI verändert tatsächlich die Mathematik. Vor kurzem hat Tao Zhexuan, der diesem Thema große Aufmerksamkeit gewidmet hat, die neueste Ausgabe des „Bulletin of the American Mathematical Society“ (Bulletin der American Mathematical Society) weitergeleitet. Zum Thema „Werden Maschinen die Mathematik verändern?“ äußerten viele Mathematiker ihre Meinung. Der gesamte Prozess war voller Funken, knallhart und aufregend. Der Autor verfügt über eine starke Besetzung, darunter der Fields-Medaillengewinner Akshay Venkatesh, der chinesische Mathematiker Zheng Lejun, der NYU-Informatiker Ernest Davis und viele andere bekannte Wissenschaftler der Branche. Die Welt der KI hat sich dramatisch verändert. Viele dieser Artikel wurden vor einem Jahr eingereicht.

Google ist begeistert: JAX-Leistung übertrifft Pytorch und TensorFlow! Es könnte die schnellste Wahl für das GPU-Inferenztraining werden

Apr 01, 2024 pm 07:46 PM

Google ist begeistert: JAX-Leistung übertrifft Pytorch und TensorFlow! Es könnte die schnellste Wahl für das GPU-Inferenztraining werden

Apr 01, 2024 pm 07:46 PM

Die von Google geförderte Leistung von JAX hat in jüngsten Benchmark-Tests die von Pytorch und TensorFlow übertroffen und belegt bei 7 Indikatoren den ersten Platz. Und der Test wurde nicht auf der TPU mit der besten JAX-Leistung durchgeführt. Obwohl unter Entwicklern Pytorch immer noch beliebter ist als Tensorflow. Aber in Zukunft werden möglicherweise mehr große Modelle auf Basis der JAX-Plattform trainiert und ausgeführt. Modelle Kürzlich hat das Keras-Team drei Backends (TensorFlow, JAX, PyTorch) mit der nativen PyTorch-Implementierung und Keras2 mit TensorFlow verglichen. Zunächst wählen sie eine Reihe von Mainstream-Inhalten aus

Hallo, elektrischer Atlas! Der Boston Dynamics-Roboter erwacht wieder zum Leben, seltsame 180-Grad-Bewegungen machen Musk Angst

Apr 18, 2024 pm 07:58 PM

Hallo, elektrischer Atlas! Der Boston Dynamics-Roboter erwacht wieder zum Leben, seltsame 180-Grad-Bewegungen machen Musk Angst

Apr 18, 2024 pm 07:58 PM

Boston Dynamics Atlas tritt offiziell in die Ära der Elektroroboter ein! Gestern hat sich der hydraulische Atlas einfach „unter Tränen“ von der Bühne der Geschichte zurückgezogen. Heute gab Boston Dynamics bekannt, dass der elektrische Atlas im Einsatz ist. Es scheint, dass Boston Dynamics im Bereich kommerzieller humanoider Roboter entschlossen ist, mit Tesla zu konkurrieren. Nach der Veröffentlichung des neuen Videos wurde es innerhalb von nur zehn Stunden bereits von mehr als einer Million Menschen angesehen. Die alten Leute gehen und neue Rollen entstehen. Das ist eine historische Notwendigkeit. Es besteht kein Zweifel, dass dieses Jahr das explosive Jahr der humanoiden Roboter ist. Netizens kommentierten: Die Weiterentwicklung der Roboter hat dazu geführt, dass die diesjährige Eröffnungsfeier wie Menschen aussieht, und der Freiheitsgrad ist weitaus größer als der von Menschen. Aber ist das wirklich kein Horrorfilm? Zu Beginn des Videos liegt Atlas ruhig auf dem Boden, scheinbar auf dem Rücken. Was folgt, ist atemberaubend

KAN, das MLP ersetzt, wurde durch Open-Source-Projekte auf Faltung erweitert

Jun 01, 2024 pm 10:03 PM

KAN, das MLP ersetzt, wurde durch Open-Source-Projekte auf Faltung erweitert

Jun 01, 2024 pm 10:03 PM

Anfang dieses Monats schlugen Forscher des MIT und anderer Institutionen eine vielversprechende Alternative zu MLP vor – KAN. KAN übertrifft MLP in Bezug auf Genauigkeit und Interpretierbarkeit. Und es kann MLP, das mit einer größeren Anzahl von Parametern ausgeführt wird, mit einer sehr kleinen Anzahl von Parametern übertreffen. Beispielsweise gaben die Autoren an, dass sie KAN nutzten, um die Ergebnisse von DeepMind mit einem kleineren Netzwerk und einem höheren Automatisierungsgrad zu reproduzieren. Konkret verfügt DeepMinds MLP über etwa 300.000 Parameter, während KAN nur etwa 200 Parameter hat. KAN hat eine starke mathematische Grundlage wie MLP und basiert auf dem universellen Approximationssatz, während KAN auf dem Kolmogorov-Arnold-Darstellungssatz basiert. Wie in der folgenden Abbildung gezeigt, hat KAN

Mar 18, 2024 am 09:20 AM

Mar 18, 2024 am 09:20 AM

Heute möchte ich eine aktuelle Forschungsarbeit der University of Connecticut vorstellen, die eine Methode zum Abgleichen von Zeitreihendaten mit großen NLP-Modellen (Natural Language Processing) im latenten Raum vorschlägt, um die Leistung von Zeitreihenprognosen zu verbessern. Der Schlüssel zu dieser Methode besteht darin, latente räumliche Hinweise (Eingabeaufforderungen) zu verwenden, um die Genauigkeit von Zeitreihenvorhersagen zu verbessern. Titel des Papiers: S2IP-LLM: SemanticSpaceInformedPromptLearningwithLLMforTimeSeriesForecasting Download-Adresse: https://arxiv.org/pdf/2403.05798v1.pdf 1. Hintergrundmodell für große Probleme

Tesla-Roboter arbeiten in Fabriken, Musk: Der Freiheitsgrad der Hände wird dieses Jahr 22 erreichen!

May 06, 2024 pm 04:13 PM

Tesla-Roboter arbeiten in Fabriken, Musk: Der Freiheitsgrad der Hände wird dieses Jahr 22 erreichen!

May 06, 2024 pm 04:13 PM

Das neueste Video von Teslas Roboter Optimus ist veröffentlicht und er kann bereits in der Fabrik arbeiten. Bei normaler Geschwindigkeit sortiert es Batterien (Teslas 4680-Batterien) so: Der Beamte hat auch veröffentlicht, wie es bei 20-facher Geschwindigkeit aussieht – auf einer kleinen „Workstation“, pflücken und pflücken und pflücken: Dieses Mal wird es freigegeben. Eines der Highlights Der Vorteil des Videos besteht darin, dass Optimus diese Arbeit in der Fabrik völlig autonom und ohne menschliches Eingreifen während des gesamten Prozesses erledigt. Und aus Sicht von Optimus kann es auch die krumme Batterie aufnehmen und platzieren, wobei der Schwerpunkt auf der automatischen Fehlerkorrektur liegt: In Bezug auf die Hand von Optimus gab der NVIDIA-Wissenschaftler Jim Fan eine hohe Bewertung ab: Die Hand von Optimus ist der fünffingrige Roboter der Welt am geschicktesten. Seine Hände sind nicht nur taktil

FisheyeDetNet: der erste Zielerkennungsalgorithmus basierend auf einer Fischaugenkamera

Apr 26, 2024 am 11:37 AM

FisheyeDetNet: der erste Zielerkennungsalgorithmus basierend auf einer Fischaugenkamera

Apr 26, 2024 am 11:37 AM

Die Zielerkennung ist ein relativ ausgereiftes Problem in autonomen Fahrsystemen, wobei die Fußgängererkennung einer der ersten Algorithmen ist, die eingesetzt werden. In den meisten Arbeiten wurde eine sehr umfassende Recherche durchgeführt. Die Entfernungswahrnehmung mithilfe von Fischaugenkameras für die Rundumsicht ist jedoch relativ wenig untersucht. Aufgrund der großen radialen Verzerrung ist es schwierig, die standardmäßige Bounding-Box-Darstellung in Fischaugenkameras zu implementieren. Um die obige Beschreibung zu vereinfachen, untersuchen wir erweiterte Begrenzungsrahmen-, Ellipsen- und allgemeine Polygondesigns in Polar-/Winkeldarstellungen und definieren eine mIOU-Metrik für die Instanzsegmentierung, um diese Darstellungen zu analysieren. Das vorgeschlagene Modell „fisheyeDetNet“ mit polygonaler Form übertrifft andere Modelle und erreicht gleichzeitig 49,5 % mAP auf dem Valeo-Fisheye-Kameradatensatz für autonomes Fahren