Technologie-Peripheriegeräte

Technologie-Peripheriegeräte

KI

KI

Implementierungspraxis der Spracherkennungstechnologie in Station B

Implementierungspraxis der Spracherkennungstechnologie in Station B

Implementierungspraxis der Spracherkennungstechnologie in Station B

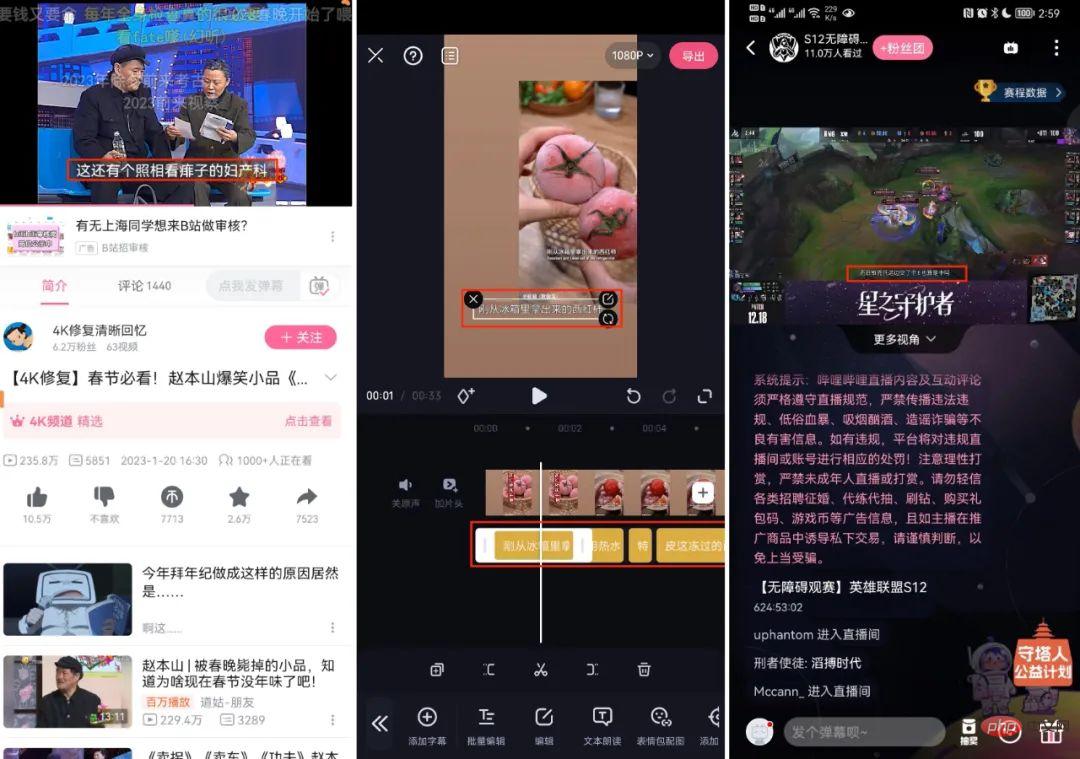

Automatische Spracherkennungstechnologie (ASR) wurde in großem Umfang in verwandten Geschäftsszenarien von Bilibili implementiert, wie z. B. Sicherheitsüberprüfung von Audio- und Videoinhalten, KI-Untertitel (C-Seite, Must-Cut, S12-Liveübertragung usw.), Videoverständnis (Volltextsuche) )warten.

Darüber hinaus gewann die ASR-Engine von Bilibili auch den ersten Platz in der neuesten umfassenden Bewertung des Industrie-Benchmarks SpeechIO (https://github.com/SpeechColab/Leaderboard) im November 2022 (https://github. com/ SpeechColab/Leaderboard#5-Ranking), und der Vorteil ist im privaten Testsatz deutlicher.

Rangliste aller Testsätze | ||

Rangliste |

Hersteller |

Wortfehlerrate |

1 |

B-Station | 2,82 % |

2 |

Alibaba Yitu |

3,16% |

4 | Microsoft |

3,28 % |

5 |

Tencent |

3,85 % |

6 |

iFlytek |

4. 05% |

7 |

GESCHWINDIGKEIT |

5,19 % |

8 |

Baidu |

8,14 % |

- AI-Untertitel (chinesische und englische C-Seite, Must-Cut, S12-Liveübertragung usw.)

- Volltextsuche

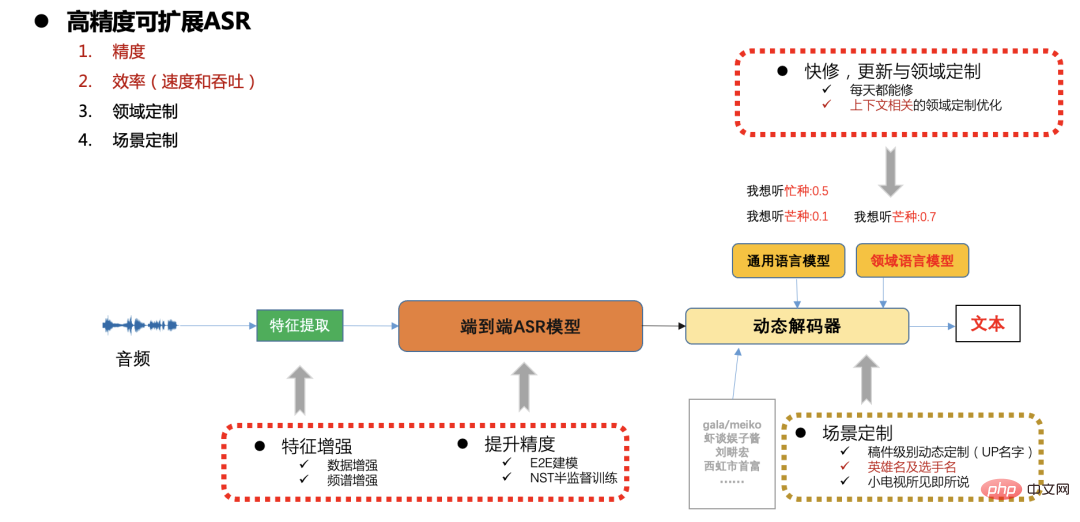

In diesem Artikel wird der Prozess vorgestellt. Wir haben Daten und Algorithmen gesammelt und untersucht. „Hochwertiger ASR-Motor“ 🔜 Die industrielle Bereitstellung zeichnet sich durch geringe Latenz, hohe Geschwindigkeit und Dauer aus weniger Rechenressourcen

Hohe Skalierbarkeit

Kann die Anpassung der Geschäftsiteration effizient unterstützen und die Anforderungen einer schnellen Geschäftsaktualisierung erfüllen

Hybrid-Framework (Hybrid) |

End-to-End-Framework Open-Source-Tools und Communities |

||||||||||||||||||||||||||||||||||||||||||||

Erweiterbarkeit |

|

TensorFlow /Pytorch |

|||||||||||||||||||||||||||||||||||||||||||

Die folgende Tabelle zeigt das optimale Ergebnis (CER) typischer Datensätze basierend auf repräsentativen Tools:

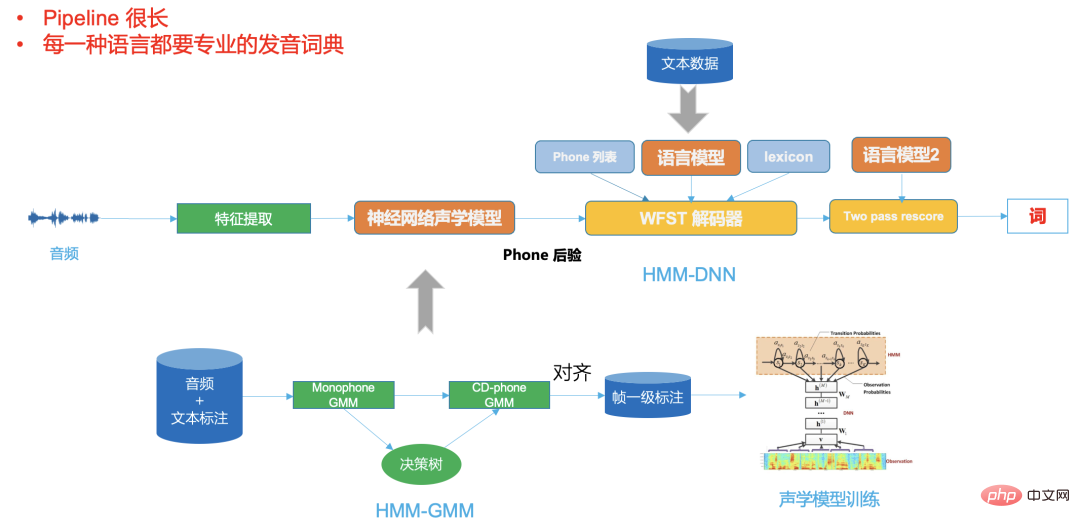

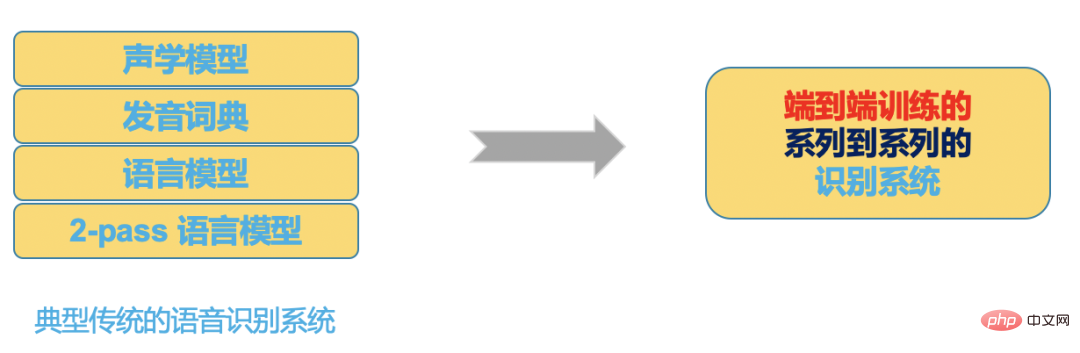

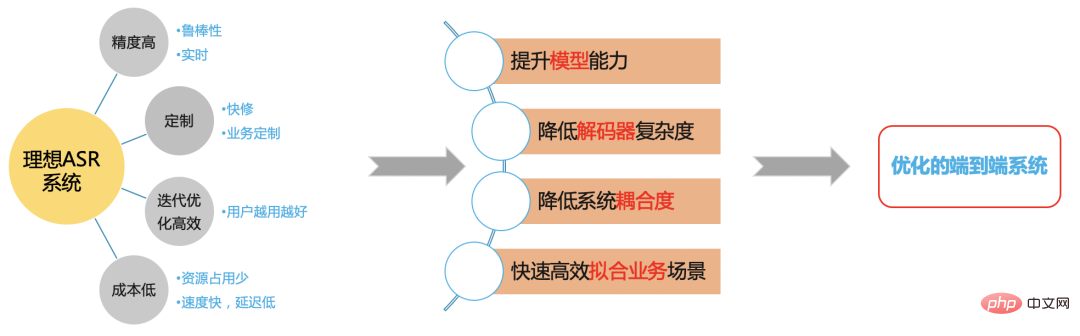

Kurz gesagt: Durch die Wahl eines End-to-End-Systems können wir im Vergleich zum herkömmlichen Hybrid-Framework mit bestimmten Ressourcen schneller und besser ein qualitativ hochwertiges ASR-System entwickeln. Natürlich können wir basierend auf dem Hybrid-Framework, wenn wir auch gleichermaßen fortschrittliche Modelle und hochoptimierte Decoder verwenden, Ergebnisse nahezu durchgängig erzielen, aber wir müssen möglicherweise ein Vielfaches investieren Manpower und Ressourcen, um dieses System zu entwickeln und zu optimieren. End-to-End-LösungsauswahlBilibili jeden Tag Es müssen Hunderttausende Stunden Audio transkribiert werden, was einen hohen Durchsatz und eine hohe Geschwindigkeit des ASR-Systems erfordert. Gleichzeitig ist auch die Szenenabdeckung von Station B sehr groß und effizientes ASR-System ist für uns von großer Bedeutung. Ideales ASR-System

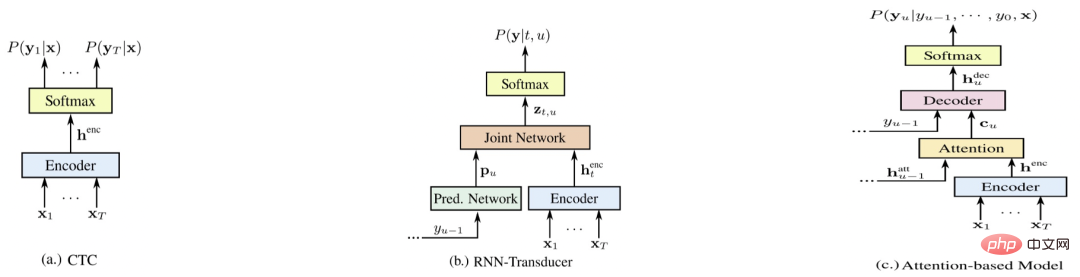

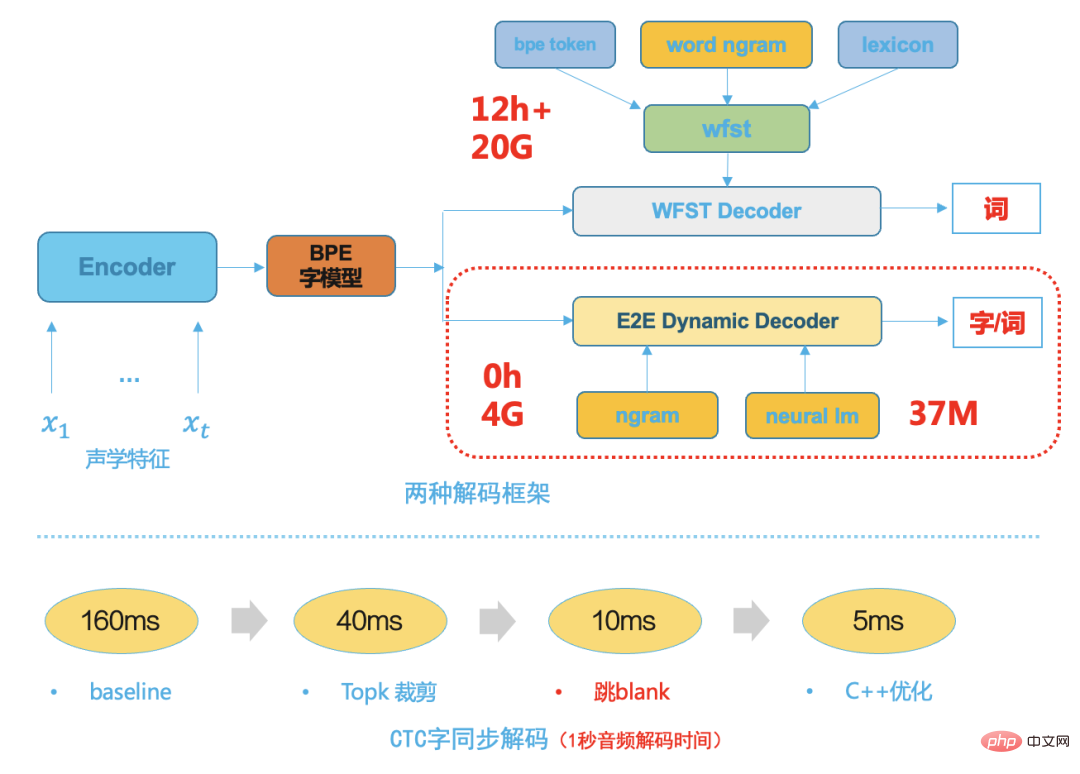

Abbildung 5 Wir hoffen, auf der Grundlage des End- End-Framework Ein effizientes ASR-System löst das Problem im B-Station-Szenario. End-to-End-Systemvergleich

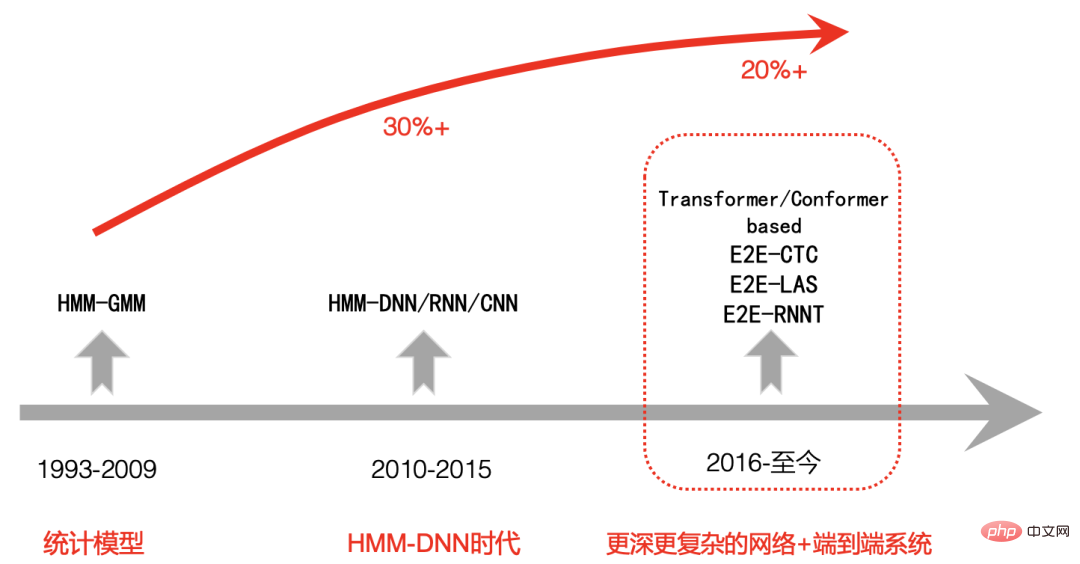

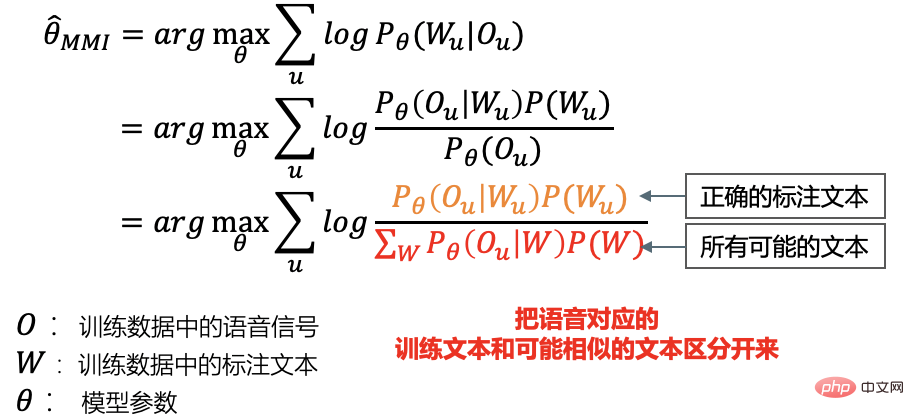

Abbildung 6 Abbildung 4 ist nun repräsentativ Drei End-to-End-Systeme [5], nämlich E2E-CTC, E2E-RNNT und E2E-AED. Im Folgenden werden die Vor- und Nachteile der einzelnen Systeme unter verschiedenen Aspekten verglichen (je höher die Punktzahl, desto besser)#🎜🎜 # # 🎜🎜#Systemvergleich

|

Das obige ist der detaillierte Inhalt vonImplementierungspraxis der Spracherkennungstechnologie in Station B. Für weitere Informationen folgen Sie bitte anderen verwandten Artikeln auf der PHP chinesischen Website!

Heiße KI -Werkzeuge

Undresser.AI Undress

KI-gestützte App zum Erstellen realistischer Aktfotos

AI Clothes Remover

Online-KI-Tool zum Entfernen von Kleidung aus Fotos.

Undress AI Tool

Ausziehbilder kostenlos

Clothoff.io

KI-Kleiderentferner

AI Hentai Generator

Erstellen Sie kostenlos Ai Hentai.

Heißer Artikel

Heiße Werkzeuge

Notepad++7.3.1

Einfach zu bedienender und kostenloser Code-Editor

SublimeText3 chinesische Version

Chinesische Version, sehr einfach zu bedienen

Senden Sie Studio 13.0.1

Leistungsstarke integrierte PHP-Entwicklungsumgebung

Dreamweaver CS6

Visuelle Webentwicklungstools

SublimeText3 Mac-Version

Codebearbeitungssoftware auf Gottesniveau (SublimeText3)

Heiße Themen

1374

1374

52

52

So erkennen Sie automatisch Sprache und generieren Untertitel in Filmausschnitten. Einführung in die Methode zur automatischen Generierung von Untertiteln

Mar 14, 2024 pm 08:10 PM

So erkennen Sie automatisch Sprache und generieren Untertitel in Filmausschnitten. Einführung in die Methode zur automatischen Generierung von Untertiteln

Mar 14, 2024 pm 08:10 PM

Wie implementieren wir die Funktion zur Generierung von Sprachuntertiteln auf dieser Plattform? Wenn wir einige Videos erstellen, müssen wir unsere Untertitel hinzufügen, um mehr Textur zu erhalten, oder wenn wir einige Geschichten erzählen, damit jeder die Informationen besser verstehen kann einige der Videos oben. Es spielt auch eine Rolle beim Ausdruck, aber viele Benutzer sind mit der automatischen Spracherkennung und der Untertitelgenerierung nicht sehr vertraut, wir können Sie in verschiedenen Aspekten problemlos dazu bringen, bessere Entscheidungen zu treffen Wir müssen einige funktionale Fähigkeiten langsam verstehen, also beeilen Sie sich und schauen Sie sich den Editor an, verpassen Sie es nicht.

So implementieren Sie ein Online-Spracherkennungssystem mit WebSocket und JavaScript

Dec 17, 2023 pm 02:54 PM

So implementieren Sie ein Online-Spracherkennungssystem mit WebSocket und JavaScript

Dec 17, 2023 pm 02:54 PM

So implementieren Sie mit WebSocket und JavaScript ein Online-Spracherkennungssystem. Einführung: Mit der kontinuierlichen Weiterentwicklung der Technologie ist die Spracherkennungstechnologie zu einem wichtigen Bestandteil des Bereichs der künstlichen Intelligenz geworden. Das auf WebSocket und JavaScript basierende Online-Spracherkennungssystem zeichnet sich durch geringe Latenz, Echtzeit und plattformübergreifende Eigenschaften aus und hat sich zu einer weit verbreiteten Lösung entwickelt. In diesem Artikel wird erläutert, wie Sie mit WebSocket und JavaScript ein Online-Spracherkennungssystem implementieren.

Das Stable Diffusion 3-Papier wird endlich veröffentlicht und die architektonischen Details werden enthüllt. Wird es helfen, Sora zu reproduzieren?

Mar 06, 2024 pm 05:34 PM

Das Stable Diffusion 3-Papier wird endlich veröffentlicht und die architektonischen Details werden enthüllt. Wird es helfen, Sora zu reproduzieren?

Mar 06, 2024 pm 05:34 PM

Der Artikel von StableDiffusion3 ist endlich da! Dieses Modell wurde vor zwei Wochen veröffentlicht und verwendet die gleiche DiT-Architektur (DiffusionTransformer) wie Sora. Nach seiner Veröffentlichung sorgte es für großes Aufsehen. Im Vergleich zur Vorgängerversion wurde die Qualität der von StableDiffusion3 generierten Bilder erheblich verbessert. Es unterstützt jetzt Eingabeaufforderungen mit mehreren Themen, und der Textschreibeffekt wurde ebenfalls verbessert, und es werden keine verstümmelten Zeichen mehr angezeigt. StabilityAI wies darauf hin, dass es sich bei StableDiffusion3 um eine Reihe von Modellen mit Parametergrößen von 800 M bis 8 B handelt. Durch diesen Parameterbereich kann das Modell direkt auf vielen tragbaren Geräten ausgeführt werden, wodurch der Einsatz von KI deutlich reduziert wird

Detaillierte Methode zum Deaktivieren der Spracherkennung im WIN10-System

Mar 27, 2024 pm 02:36 PM

Detaillierte Methode zum Deaktivieren der Spracherkennung im WIN10-System

Mar 27, 2024 pm 02:36 PM

1. Rufen Sie die Systemsteuerung auf, suchen Sie die Option [Spracherkennung] und schalten Sie sie ein. 2. Wenn die Spracherkennungsseite angezeigt wird, wählen Sie [Erweiterte Sprachoptionen]. 3. Deaktivieren Sie abschließend das Kontrollkästchen [Spracherkennung beim Start ausführen] in der Spalte „Benutzereinstellungen“ im Fenster „Spracheigenschaften“.

Beherrschen Sie die Koordinatensystemkonvertierung wirklich? Multisensorik-Themen, die für das autonome Fahren unverzichtbar sind

Oct 12, 2023 am 11:21 AM

Beherrschen Sie die Koordinatensystemkonvertierung wirklich? Multisensorik-Themen, die für das autonome Fahren unverzichtbar sind

Oct 12, 2023 am 11:21 AM

Der erste Pilot- und Schlüsselartikel stellt hauptsächlich mehrere häufig verwendete Koordinatensysteme in der autonomen Fahrtechnologie vor und erläutert, wie die Korrelation und Konvertierung zwischen ihnen abgeschlossen und schließlich ein einheitliches Umgebungsmodell erstellt werden kann. Der Schwerpunkt liegt hier auf dem Verständnis der Umrechnung vom Fahrzeug in den starren Kamerakörper (externe Parameter), der Kamera-in-Bild-Konvertierung (interne Parameter) und der Bild-in-Pixel-Einheitenkonvertierung. Die Konvertierung von 3D in 2D führt zu entsprechenden Verzerrungen, Verschiebungen usw. Wichtige Punkte: Das Fahrzeugkoordinatensystem und das Kamerakörperkoordinatensystem müssen neu geschrieben werden: Das Ebenenkoordinatensystem und das Pixelkoordinatensystem. Schwierigkeit: Sowohl die Entzerrung als auch die Verzerrungsaddition müssen auf der Bildebene kompensiert werden. 2. Einführung Insgesamt gibt es vier visuelle Systeme Koordinatensystem: Pixelebenenkoordinatensystem (u, v), Bildkoordinatensystem (x, y), Kamerakoordinatensystem () und Weltkoordinatensystem (). Es gibt eine Beziehung zwischen jedem Koordinatensystem,

Dieser Artikel reicht aus, um etwas über autonomes Fahren und Flugbahnvorhersage zu lesen!

Feb 28, 2024 pm 07:20 PM

Dieser Artikel reicht aus, um etwas über autonomes Fahren und Flugbahnvorhersage zu lesen!

Feb 28, 2024 pm 07:20 PM

Die Trajektorienvorhersage spielt eine wichtige Rolle beim autonomen Fahren. Unter autonomer Fahrtrajektorienvorhersage versteht man die Vorhersage der zukünftigen Fahrtrajektorie des Fahrzeugs durch die Analyse verschiedener Daten während des Fahrvorgangs. Als Kernmodul des autonomen Fahrens ist die Qualität der Trajektorienvorhersage von entscheidender Bedeutung für die nachgelagerte Planungssteuerung. Die Trajektorienvorhersageaufgabe verfügt über einen umfangreichen Technologie-Stack und erfordert Vertrautheit mit der dynamischen/statischen Wahrnehmung des autonomen Fahrens, hochpräzisen Karten, Fahrspurlinien, Fähigkeiten in der neuronalen Netzwerkarchitektur (CNN&GNN&Transformer) usw. Der Einstieg ist sehr schwierig! Viele Fans hoffen, so schnell wie möglich mit der Flugbahnvorhersage beginnen zu können und Fallstricke zu vermeiden. Heute werde ich eine Bestandsaufnahme einiger häufiger Probleme und einführender Lernmethoden für die Flugbahnvorhersage machen! Einführungsbezogenes Wissen 1. Sind die Vorschaupapiere in Ordnung? A: Schauen Sie sich zuerst die Umfrage an, S

DualBEV: BEVFormer und BEVDet4D deutlich übertreffen, öffnen Sie das Buch!

Mar 21, 2024 pm 05:21 PM

DualBEV: BEVFormer und BEVDet4D deutlich übertreffen, öffnen Sie das Buch!

Mar 21, 2024 pm 05:21 PM

In diesem Artikel wird das Problem der genauen Erkennung von Objekten aus verschiedenen Blickwinkeln (z. B. Perspektive und Vogelperspektive) beim autonomen Fahren untersucht, insbesondere wie die Transformation von Merkmalen aus der Perspektive (PV) in den Raum aus der Vogelperspektive (BEV) effektiv ist implementiert über das Modul Visual Transformation (VT). Bestehende Methoden lassen sich grob in zwei Strategien unterteilen: 2D-zu-3D- und 3D-zu-2D-Konvertierung. 2D-zu-3D-Methoden verbessern dichte 2D-Merkmale durch die Vorhersage von Tiefenwahrscheinlichkeiten, aber die inhärente Unsicherheit von Tiefenvorhersagen, insbesondere in entfernten Regionen, kann zu Ungenauigkeiten führen. Während 3D-zu-2D-Methoden normalerweise 3D-Abfragen verwenden, um 2D-Features abzutasten und die Aufmerksamkeitsgewichte der Korrespondenz zwischen 3D- und 2D-Features über einen Transformer zu lernen, erhöht sich die Rechen- und Bereitstellungszeit.

so schnell! Erkennen Sie Videosprache in nur wenigen Minuten mit weniger als 10 Codezeilen in Text

Feb 27, 2024 pm 01:55 PM

so schnell! Erkennen Sie Videosprache in nur wenigen Minuten mit weniger als 10 Codezeilen in Text

Feb 27, 2024 pm 01:55 PM

Hallo zusammen, ich bin Kite. Die Notwendigkeit, Audio- und Videodateien in Textinhalte umzuwandeln, war vor zwei Jahren schwierig, aber jetzt kann dies problemlos in nur wenigen Minuten gelöst werden. Es heißt, dass einige Unternehmen, um Trainingsdaten zu erhalten, Videos auf Kurzvideoplattformen wie Douyin und Kuaishou vollständig gecrawlt haben, dann den Ton aus den Videos extrahiert und sie in Textform umgewandelt haben, um sie als Trainingskorpus für Big-Data-Modelle zu verwenden . Wenn Sie eine Video- oder Audiodatei in Text konvertieren müssen, können Sie diese heute verfügbare Open-Source-Lösung ausprobieren. Sie können beispielsweise nach bestimmten Zeitpunkten suchen, zu denen Dialoge in Film- und Fernsehsendungen erscheinen. Kommen wir ohne weitere Umschweife zum Punkt. Whisper ist OpenAIs Open-Source-Whisper. Es ist natürlich in Python geschrieben und erfordert nur ein paar einfache Installationspakete.

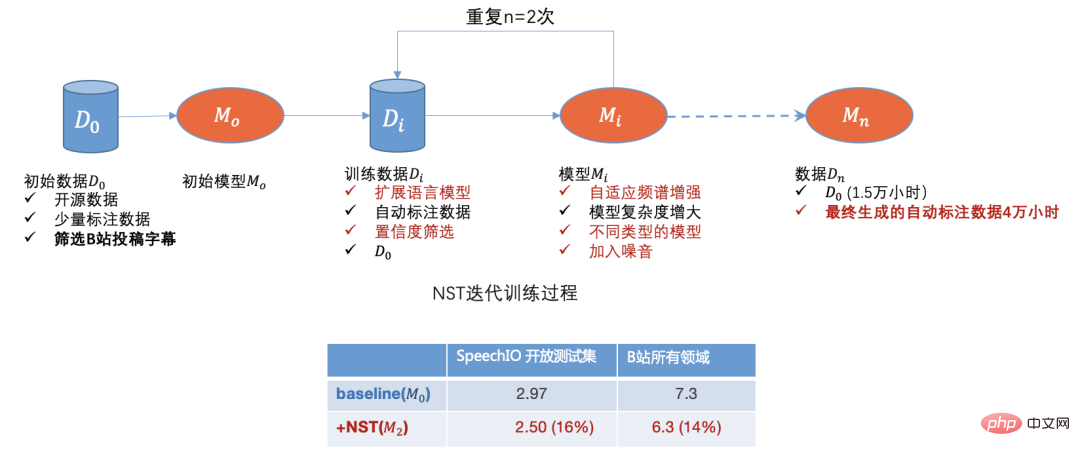

Mithilfe von Open-Source-Daten, Übermittlungsdaten von Standort B, manuellen Annotationsdaten und automatischen Annotationsdaten haben wir zunächst das Datenkaltstartproblem gelöst. Mit der Iteration des Modells können wir die Daten weiter herausfiltern Domänendaten mit schlechter Erkennung,

Mithilfe von Open-Source-Daten, Übermittlungsdaten von Standort B, manuellen Annotationsdaten und automatischen Annotationsdaten haben wir zunächst das Datenkaltstartproblem gelöst. Mit der Iteration des Modells können wir die Daten weiter herausfiltern Domänendaten mit schlechter Erkennung,

Auf einer einzelnen GPU T4 wird die Download-Geschwindigkeit um 30 % erhöht, der Durchsatz wird um das Zweifache erhöht und 3.000 Stunden langes Audio können in einer Stunde transkribiert werden

Auf einer einzelnen GPU T4 wird die Download-Geschwindigkeit um 30 % erhöht, der Durchsatz wird um das Zweifache erhöht und 3.000 Stunden langes Audio können in einer Stunde transkribiert werden