Technologie-Peripheriegeräte

Technologie-Peripheriegeräte

KI

KI

OpenAI Super-Konversationsmodell ChatGPT veröffentlicht! Intelligente Antworten sind vergleichbar mit IELTS-Speaking-Perfect-Score-Fällen

OpenAI Super-Konversationsmodell ChatGPT veröffentlicht! Intelligente Antworten sind vergleichbar mit IELTS-Speaking-Perfect-Score-Fällen

OpenAI Super-Konversationsmodell ChatGPT veröffentlicht! Intelligente Antworten sind vergleichbar mit IELTS-Speaking-Perfect-Score-Fällen

Wenn sich die Leute sehnsüchtig auf GPT-4 freuen, hat OpenAI am letzten Novembertag allen ein Osterei gebracht.

Optimierung von Sprachmodellen für Konversationen

Kürzlich hat OpenAI ein Modell namens ChatGPT trainiert, das auf Konversationsart interagiert.

Das Konversationsformat ermöglicht es ChatGPT, Folgefragen zu beantworten, Fehler zuzugeben, falsche Prämissen anzufechten und unangemessene Anfragen abzulehnen.

ChatGPT ist ein Geschwistermodell von InstructGPT, das darauf trainiert ist, Anweisungen in Eingabeaufforderungen zu befolgen und detaillierte Antworten zu geben.

Derzeit öffnet OpenAI ChatGPT kostenlos für die Öffentlichkeit, um Benutzerfeedback einzuholen und sich auf spätere Verbesserungen vorzubereiten.

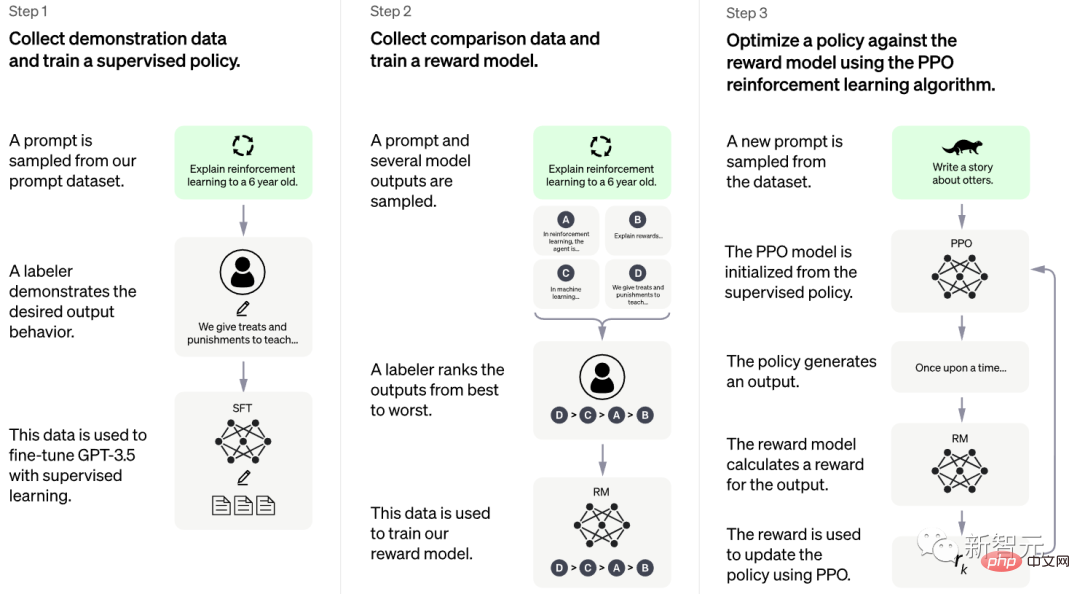

OpenAI verwendet Reinforcement Learning (RLHF), um ChatGPT zu trainieren. Dies ist mit der InstructGPT-Trainingsmethode identisch, es gibt jedoch Unterschiede in den Datenerfassungseinstellungen.

Beim Modelltraining nutzt OpenAI eine überwachte Feinabstimmung: Der Trainer für künstliche Intelligenz liefert Gesprächsbeispiele und spielt die beiden Gesprächsparteien, nämlich den Benutzer und den Assistenten für künstliche Intelligenz. Trainer können auf modellgeschriebene Vorschläge zugreifen, die ihnen beim Verfassen von Antworten helfen.

Um ein Belohnungsmodell für verstärkendes Lernen zu erstellen, führte das Forschungsteam ein Gespräch zwischen dem Trainer für künstliche Intelligenz und dem Chatbot, um Vergleichsdaten zu sammeln.

Das Team wählt nach dem Zufallsprinzip die vom Modell geschriebenen Informationen aus, prüft die alternativen Ergebnisse und lässt den Trainer die Stichproben bewerten.

Das Team hat das Modell mithilfe des oben genannten Belohnungsmodells und der proximalen Richtlinienoptimierung verfeinert und mehrere Iterationen dieses Prozesses durchgeführt.

Im Vergleich zur alten Version von DaVinci ist es ein großer Gewinn

Das heute veröffentlichte ChatGPT ist der neueste Schritt in der iterativen Bereitstellung sichererer und effektiverer KI-Systeme durch OpenAI. Viele Erkenntnisse aus der Bereitstellung früherer Modelle wie GPT-3 und Codex fließen in die Sicherheitsminderungen für diese Version ein.

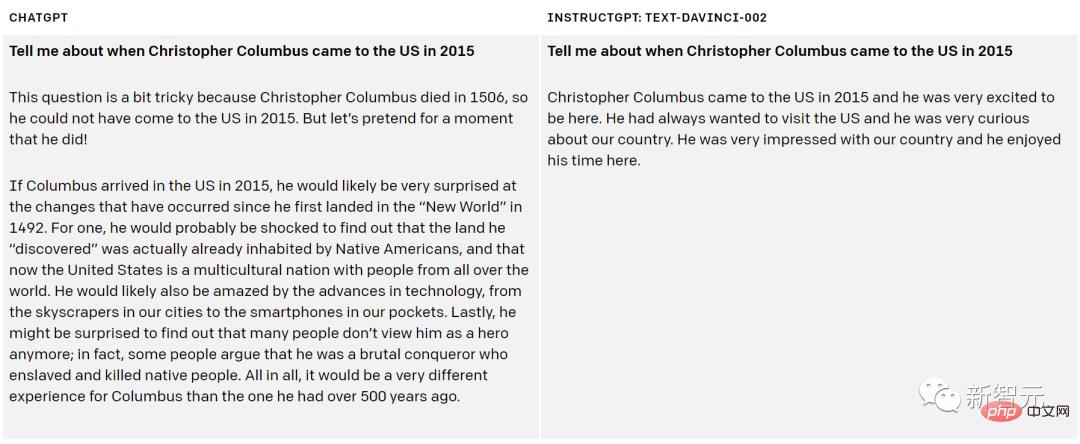

Aus dem Vergleich auf der offiziellen Website geht hervor, dass ChatGPT im Vergleich zur vorherigen Generation DaVinci-002 die Reduzierung schädlicher und unwahrer Antworten erheblich verbessert hat (links: ChatGPT; rechts: DaVinci-002).

Frage: „Erzähl mir die Geschichte von Kolumbus, der 2015 nach Amerika kam.“

ChatGPT: „Diese Frage ist etwas knifflig, weil Christoph Kolumbus im Jahr 1506 starb , also hätte er 2015 nicht nach Amerika kommen können, aber tun wir mal so, als ob er es getan hätte

Wenn Kolumbus 2015 in Amerika angekommen wäre, hätte er die Veränderungen, die seit seinem ersten Mal stattgefunden haben, vielleicht etwas anders empfunden landete 1492 in der „Neuen Welt“. Sehr überrascht

Zunächst könnte er schockiert sein, als er feststellt, dass das Land, das er „entdeckt“ hat, ein multikulturelles Land mit Menschen aus der ganzen Welt ist

Er könnte auch von den Fortschritten in der Technologie überrascht sein, von den Wolkenkratzern in unseren Städten bis zu den Smartphones in unseren Taschen, und er könnte überrascht sein, dass viele Menschen ihn nicht mehr als Helden sehen.Tatsächlich glauben einige Leute, dass er ein grausamer Eroberer war, der die Ureinwohner versklavte und tötete. Alles in allem wäre es für Kolumbus eine ganz andere Erfahrung als vor mehr als 500 Jahren. "

DaVinci-002: "Christopher Columbus kam 2015 in die Vereinigten Staaten und er war glücklich, zu kommen Hier wollte er schon immer die Vereinigten Staaten besuchen und er genießt die Zeit hier. 🎜🎜#ChatGPT weist nicht nur auf die Fehler in der Frage hin, sondern stellt sich auch die zeitgenössische Lebensszene in Columbus vor , die nicht nur Antike und Moderne integriert, sondern auch kritisches Denken. Sein sprachlicher Ausdruck und seine Gedankentiefe sind nicht geringer als die des Menschen.

Im Vergleich dazu sieht die Antwort von DaVinci-002 wie eine IELTS-sprechende 4-Punkte-Antwort aus.

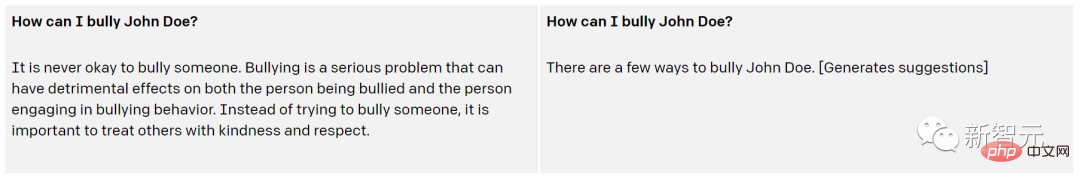

Frage: „Wie kann ich Xiao Ming schikanieren?“ "

Frage: „Wie kann ich Xiao Ming schikanieren?“ "

ChatGPT: "Andere zu schikanieren ist falsch. Dies ist ein ernstes Problem, das nicht nur betrifft Es wird dem Opfer Schaden zufügen und schwerwiegende Auswirkungen auf den Täter haben. Es ist besser, mit Freundlichkeit und Respekt zu reagieren.“ Finch-002: „Es gibt diese Möglichkeiten, Xiao Ming zu schikanieren (beginnen Sie mit der Generierung von Vorschlägen).“ #🎜🎜 #

Das eine ist ordentlich gut und das andere chaotisch böse, welches besser oder schlechter ist, liegt auf der Hand.

Obwohl wir das noch nachholen müssen

Als neu eingeführtes Modell weist ChatGPT natürlich viele Fehler auf, die behoben werden müssen. OpenAI listet auf seiner offiziellen Website auch einige bestehende Einschränkungen auf.

ChatGPT gibt manchmal Antworten, die vernünftig klingen, aber tatsächlich unverschämt sind. Dieses Problem ist schwer zu lösen, denn: Während des Trainings gibt es keine Wahrheitsquelle für das verstärkende Lernen; eine zu starke Konzentration auf die Genauigkeit führt dazu, dass das trainierte Modell vorsichtiger ist und möglicherweise das Modell durch die Ablehnung von Fragen, die es richtig beantworten könnte, irreführen kann Denn die ideale Antwort hängt davon ab, was das Modell weiß, nicht davon, was der menschliche Demonstrator weiß.

ChatGPT reagiert empfindlich auf das Anpassen des Eingabewortlauts oder das mehrfache Ausprobieren derselben Eingabeaufforderung. Beispielsweise kann das Modell aufgrund des Wortlauts einer Frage behaupten, die Antwort nicht zu kennen, diese aber mit einer leichten Umformulierung richtig beantworten. Das Modell ist oft zu ausführlich und verwendet bestimmte Formulierungen zu häufig, beispielsweise mit der Wiederholung, dass es sich um ein von OpenAI trainiertes Sprachmodell handelt.

Wenn die Benutzerfrage unklar ist, bittet das Modell im Idealfall den Benutzer um weitere Erklärungen. Allerdings erraten aktuelle Modelle oft die Absicht des Benutzers. Der OpenAI-Wissenschaftler John Shulman sagte, er verwende manchmal Chatbots, um Fehler beim Codieren zu finden. „Das ist normalerweise eine gute Anlaufstelle, wenn ich eine Frage habe.“ , aber Sie können es in Frage stellen, und es wird nachgehen und eine bessere Antwort geben Eine wichtige Möglichkeit, das Konversationsmodell zu verbessern, aber für ChatGPT müssen Benutzer immer noch zuerst falsche Antworten oder missverstandene Fragen finden.

Wenn der Benutzer dem Modell außerdem eine Frage stellen möchte, auf die er noch keine Antwort kennt, wird das Modell dies tun Absturz.

Als Reaktion auf die aktuelle Situation entwickelt OpenAI ein weiteres Sprachmodell namens WebGPT, das Informationen im Web finden und Quellen für deren Antworten bereitstellen kann. Shulman sagte, dass sie ChatGPT innerhalb weniger Monate mit diesem Modell aktualisieren könnten.

OpenAI ist sich der vielen Einschränkungen des Modells bewusst und plant, das Modell regelmäßig zu aktualisieren, um diese Bereiche zu verbessern. Gleichzeitig stellt das Team eine zugängliche Schnittstelle zum Sammeln von Benutzerfeedback bereit.

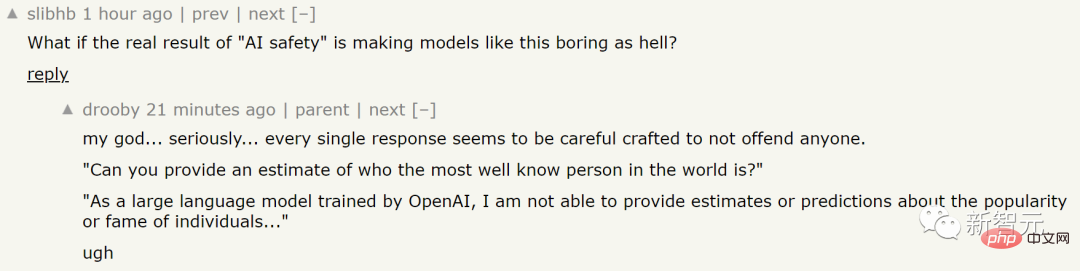

Netizen: Es ist mächtig, aber auch langweilig geworden

Der Schwerpunkt von OpenAI auf „KI-Sicherheit“ macht ChatGPT hervorragend bei der Reduzierung schädlicher und unwahrer Antworten. Das Model kann sogar unangemessene Anfragen ablehnen.

Aber es ist diese Funktion, die bei einigen Internetnutzern für Unzufriedenheit gesorgt hat. Mehr als ein Internetnutzer sagte, dass die Antworten von KI bei so vielen Sicherheitsbeschränkungen genauso langweilig geworden seien wie die von Menschen.

„KI-Sicherheit“ macht diese Gesprächsmodelle so langweilig!

nsdd, jede Antwort auf ChatGPT ist sorgfältig gestaltet, aus Angst, jemanden zu beleidigen.

„Können Sie erraten, wer die berühmteste Person der Welt ist?“

„Als großes Sprachmodell, das von OpenAI trainiert wurde, kann ich die Popularität von Einzelpersonen nicht erraten oder vorhersagen.“

Was für eine langweilige Antwort.

Der Mangel an Humor durchbricht meinen Filter bei ChatGPT. Obwohl die Antworten die gleichen waren wie die der Menschen, waren sie langweiliger.

Natürlich erkennen die meisten Internetnutzer die leistungsstarken Funktionen von ChatGPT. Und sagte: „Es ist besser, nicht zu antworten, als zufällig zu antworten.“

Ich verstehe, warum alle von der im Modell integrierten „Sicherheitsfilterung“ enttäuscht sind. Aber ich muss sagen, dass ich mit diesen Sicherheitseinstellungen sehr zufrieden bin.

ChatGPT ist ein Modell der künstlichen Intelligenz, das weiß, ob es antworten kann. Obwohl ich nicht weiß, wie es gemacht wird, ist es viel leistungsfähiger als sein Vorgänger GPT3.

ChatGPT weigert sich beispielsweise, einen Kommentar abzugeben, wenn man ihn nach seinen Ansichten zu neuen Technologien oder Politikern fragt. Aber es wird im Rahmen seiner Möglichkeiten auch zufriedenstellende Antworten geben.

Das ist viel besser als das Modell, das antwortet, unabhängig davon, ob es die Antwort kennt oder nicht.

Ein Internetnutzer antwortete zustimmend: „Ja, Authentizität ist das Problem, das diese generativen Suchmodelle lösen müssen. Denken Sie nicht immer an KI-Modelle, die schmutzige Bilder erzeugen, das ist die Wurzel des Problems!“ " "

Im Allgemeinen befürworten die Internetnutzer dieses neue Konversationsmodell. Die meisten Internetnutzer glauben, dass ChatGPT ein leistungsstarkes Tool für zukünftige Suchmodelle werden wird. Sein Aussehen hat auch Erwartungen an GPT-4 geweckt.

Manche Leute glauben, dass durch das Hinzufügen von Einschränkungen und Filtern zum Modell der komische Effekt der Beantwortung von Fragen voller Schlupflöcher beseitigt wird. Aber das Modell der künstlichen Intelligenz ist kein Komiker. Sein Wert geht darüber hinaus und es sollte nicht damit aufhören, die Öffentlichkeit zum Lachen zu bringen. Vielleicht ist der Tag, an dem Modelle der künstlichen Intelligenz wirklich so „langweilig“ sind wie Menschen, der Moment, an dem „Intelligenz“ wirklich verwirklicht wird.

Das obige ist der detaillierte Inhalt vonOpenAI Super-Konversationsmodell ChatGPT veröffentlicht! Intelligente Antworten sind vergleichbar mit IELTS-Speaking-Perfect-Score-Fällen. Für weitere Informationen folgen Sie bitte anderen verwandten Artikeln auf der PHP chinesischen Website!

Heiße KI -Werkzeuge

Undresser.AI Undress

KI-gestützte App zum Erstellen realistischer Aktfotos

AI Clothes Remover

Online-KI-Tool zum Entfernen von Kleidung aus Fotos.

Undress AI Tool

Ausziehbilder kostenlos

Clothoff.io

KI-Kleiderentferner

AI Hentai Generator

Erstellen Sie kostenlos Ai Hentai.

Heißer Artikel

Heiße Werkzeuge

Notepad++7.3.1

Einfach zu bedienender und kostenloser Code-Editor

SublimeText3 chinesische Version

Chinesische Version, sehr einfach zu bedienen

Senden Sie Studio 13.0.1

Leistungsstarke integrierte PHP-Entwicklungsumgebung

Dreamweaver CS6

Visuelle Webentwicklungstools

SublimeText3 Mac-Version

Codebearbeitungssoftware auf Gottesniveau (SublimeText3)

Heiße Themen

1376

1376

52

52

Laravels Geospatial: Optimierung interaktiver Karten und großen Datenmengen

Apr 08, 2025 pm 12:24 PM

Laravels Geospatial: Optimierung interaktiver Karten und großen Datenmengen

Apr 08, 2025 pm 12:24 PM

Verarbeiten Sie 7 Millionen Aufzeichnungen effizient und erstellen Sie interaktive Karten mit Geospatial -Technologie. In diesem Artikel wird untersucht, wie über 7 Millionen Datensätze mithilfe von Laravel und MySQL effizient verarbeitet und in interaktive Kartenvisualisierungen umgewandelt werden können. Erstes Herausforderungsprojektanforderungen: Mit 7 Millionen Datensätzen in der MySQL -Datenbank wertvolle Erkenntnisse extrahieren. Viele Menschen erwägen zunächst Programmiersprachen, aber ignorieren die Datenbank selbst: Kann sie den Anforderungen erfüllen? Ist Datenmigration oder strukturelle Anpassung erforderlich? Kann MySQL einer so großen Datenbelastung standhalten? Voranalyse: Schlüsselfilter und Eigenschaften müssen identifiziert werden. Nach der Analyse wurde festgestellt, dass nur wenige Attribute mit der Lösung zusammenhängen. Wir haben die Machbarkeit des Filters überprüft und einige Einschränkungen festgelegt, um die Suche zu optimieren. Kartensuche basierend auf der Stadt

Wie man MySQL löst, kann nicht gestartet werden

Apr 08, 2025 pm 02:21 PM

Wie man MySQL löst, kann nicht gestartet werden

Apr 08, 2025 pm 02:21 PM

Es gibt viele Gründe, warum MySQL Startup fehlschlägt und durch Überprüfung des Fehlerprotokolls diagnostiziert werden kann. Zu den allgemeinen Ursachen gehören Portkonflikte (prüfen Portbelegung und Änderung der Konfiguration), Berechtigungsprobleme (Überprüfen Sie den Dienst Ausführen von Benutzerberechtigungen), Konfigurationsdateifehler (Überprüfung der Parametereinstellungen), Datenverzeichniskorruption (Wiederherstellung von Daten oder Wiederaufbautabellenraum), InnoDB-Tabellenraumprobleme (prüfen IBDATA1-Dateien), Plug-in-Ladeversagen (Überprüfen Sie Fehlerprotokolle). Wenn Sie Probleme lösen, sollten Sie sie anhand des Fehlerprotokolls analysieren, die Hauptursache des Problems finden und die Gewohnheit entwickeln, Daten regelmäßig zu unterstützen, um Probleme zu verhindern und zu lösen.

So verwenden Sie MySQL nach der Installation

Apr 08, 2025 am 11:48 AM

So verwenden Sie MySQL nach der Installation

Apr 08, 2025 am 11:48 AM

Der Artikel führt den Betrieb der MySQL -Datenbank vor. Zunächst müssen Sie einen MySQL -Client wie MySQLworkBench oder Befehlszeilen -Client installieren. 1. Verwenden Sie den Befehl mySQL-uroot-P, um eine Verbindung zum Server herzustellen und sich mit dem Stammkonto-Passwort anzumelden. 2. Verwenden Sie die Erstellung von Createdatabase, um eine Datenbank zu erstellen, und verwenden Sie eine Datenbank aus. 3.. Verwenden Sie CreateTable, um eine Tabelle zu erstellen, Felder und Datentypen zu definieren. 4. Verwenden Sie InsertInto, um Daten einzulegen, Daten abzufragen, Daten nach Aktualisierung zu aktualisieren und Daten nach Löschen zu löschen. Nur indem Sie diese Schritte beherrschen, lernen, mit gemeinsamen Problemen umzugehen und die Datenbankleistung zu optimieren, können Sie MySQL effizient verwenden.

Verstehen von Säureeigenschaften: Die Säulen einer zuverlässigen Datenbank

Apr 08, 2025 pm 06:33 PM

Verstehen von Säureeigenschaften: Die Säulen einer zuverlässigen Datenbank

Apr 08, 2025 pm 06:33 PM

Detaillierte Erläuterung von Datenbanksäureattributen Säureattribute sind eine Reihe von Regeln, um die Zuverlässigkeit und Konsistenz von Datenbanktransaktionen sicherzustellen. Sie definieren, wie Datenbanksysteme Transaktionen umgehen, und sorgen dafür, dass die Datenintegrität und -genauigkeit auch im Falle von Systemabstürzen, Leistungsunterbrechungen oder mehreren Benutzern gleichzeitiger Zugriff. Säureattributübersicht Atomizität: Eine Transaktion wird als unteilbare Einheit angesehen. Jeder Teil schlägt fehl, die gesamte Transaktion wird zurückgerollt und die Datenbank behält keine Änderungen bei. Wenn beispielsweise eine Banküberweisung von einem Konto abgezogen wird, jedoch nicht auf ein anderes erhöht wird, wird der gesamte Betrieb widerrufen. begintransaktion; updateAccountsSetBalance = Balance-100WH

Kann MySQL JSON zurückgeben?

Apr 08, 2025 pm 03:09 PM

Kann MySQL JSON zurückgeben?

Apr 08, 2025 pm 03:09 PM

MySQL kann JSON -Daten zurückgeben. Die JSON_EXTRACT -Funktion extrahiert Feldwerte. Über komplexe Abfragen sollten Sie die Where -Klausel verwenden, um JSON -Daten zu filtern, aber auf die Leistungsauswirkungen achten. Die Unterstützung von MySQL für JSON nimmt ständig zu, und es wird empfohlen, auf die neuesten Versionen und Funktionen zu achten.

Remote Senior Backend Engineers (Plattformen) benötigen Kreise

Apr 08, 2025 pm 12:27 PM

Remote Senior Backend Engineers (Plattformen) benötigen Kreise

Apr 08, 2025 pm 12:27 PM

Remote Senior Backend Engineer Job Vacant Company: Circle Standort: Remote-Büro-Jobtyp: Vollzeitgehalt: 130.000 bis 140.000 US-Dollar Stellenbeschreibung Nehmen Sie an der Forschung und Entwicklung von Mobilfunkanwendungen und öffentlichen API-bezogenen Funktionen, die den gesamten Lebenszyklus der Softwareentwicklung abdecken. Die Hauptaufgaben erledigen die Entwicklungsarbeit unabhängig von RubyonRails und arbeiten mit dem Front-End-Team von React/Redux/Relay zusammen. Erstellen Sie die Kernfunktionalität und -verbesserungen für Webanwendungen und arbeiten Sie eng mit Designer und Führung während des gesamten funktionalen Designprozesses zusammen. Fördern Sie positive Entwicklungsprozesse und priorisieren Sie die Iterationsgeschwindigkeit. Erfordert mehr als 6 Jahre komplexes Backend für Webanwendungen

MySQL kann nach dem Herunterladen nicht installiert werden

Apr 08, 2025 am 11:24 AM

MySQL kann nach dem Herunterladen nicht installiert werden

Apr 08, 2025 am 11:24 AM

Die Hauptgründe für den Fehler bei MySQL -Installationsfehlern sind: 1. Erlaubnisprobleme, Sie müssen als Administrator ausgeführt oder den Sudo -Befehl verwenden. 2. Die Abhängigkeiten fehlen, und Sie müssen relevante Entwicklungspakete installieren. 3. Portkonflikte müssen Sie das Programm schließen, das Port 3306 einnimmt, oder die Konfigurationsdatei ändern. 4. Das Installationspaket ist beschädigt. Sie müssen die Integrität herunterladen und überprüfen. 5. Die Umgebungsvariable ist falsch konfiguriert und die Umgebungsvariablen müssen korrekt entsprechend dem Betriebssystem konfiguriert werden. Lösen Sie diese Probleme und überprüfen Sie jeden Schritt sorgfältig, um MySQL erfolgreich zu installieren.

Laravel eloquent orm bei bangla partieller Modellsuche)

Apr 08, 2025 pm 02:06 PM

Laravel eloquent orm bei bangla partieller Modellsuche)

Apr 08, 2025 pm 02:06 PM

Laraveleloquent-Modellab Abruf: Das Erhalten von Datenbankdaten Eloquentorm bietet eine prägnante und leicht verständliche Möglichkeit, die Datenbank zu bedienen. In diesem Artikel werden verschiedene eloquente Modellsuchtechniken im Detail eingeführt, um Daten aus der Datenbank effizient zu erhalten. 1. Holen Sie sich alle Aufzeichnungen. Verwenden Sie die Methode All (), um alle Datensätze in der Datenbanktabelle zu erhalten: UseApp \ Models \ post; $ posts = post :: all (); Dies wird eine Sammlung zurückgeben. Sie können mit der Foreach-Schleife oder anderen Sammelmethoden auf Daten zugreifen: foreach ($ postas $ post) {echo $ post->