Technologie-Peripheriegeräte

Technologie-Peripheriegeräte

KI

KI

Ausländische Medienkommentare zu GPT-4: Ein großer Sprung auf dem Gebiet der künstlichen Intelligenz und eine weitere große Veränderung in der technischen Ethik

Ausländische Medienkommentare zu GPT-4: Ein großer Sprung auf dem Gebiet der künstlichen Intelligenz und eine weitere große Veränderung in der technischen Ethik

Ausländische Medienkommentare zu GPT-4: Ein großer Sprung auf dem Gebiet der künstlichen Intelligenz und eine weitere große Veränderung in der technischen Ethik

Nachrichten vom 15. März, Ortszeit am Dienstag, Künstliche IntelligenzForschungslaborOpenAIveröffentlichte die neueste Version des großen Sprachmodells GPT-4. Dieses lang erwartete fortschrittliche Tool kann nicht nur automatisch Texte generieren, sondern auch Bildinhalte beschreiben und analysieren. Es treibt nicht nur das technische Niveau der Welle der künstlichen Intelligenz voran, sondern macht es auch immer schwieriger, die ethischen Grenzen der Technologieentwicklung zu ignorieren.

OpenAIs früher Online-Chat-RoboterChatGPT erregte mit seinem automatisch generierten glatten Text große Aufmerksamkeit und löste bei der Öffentlichkeit auch Bedenken hinsichtlich seiner Fähigkeit aus, Aufsätze und fiktive Skripte zu verfassen. Wissen Sie, ChatGPT verwendet immer noch GPT-3, eine Technologie der älteren Generation, die vor mehr als einem Jahr veraltet war.

Im Gegensatz dazu ist das hochmoderne GPT-4-Modell nicht nur in der Lage, automatisch Texte zu generieren, sondern auch Bilder basierend auf einfachen Benutzeranforderungen zu beschreiben. Als GPT-4 beispielsweise ein Foto eines Boxhandschuhs gezeigt wurde, der an einer hölzernen Wippe mit einer Kugel an einem Ende hing, und der Benutzer fragte, was passieren würde, wenn der Handschuh herunterfallen würde, antwortete GPT-4, dass er auf die Wippe stoßen würde Wippe, die den Ball fliegen lässt.

Frühe Tester haben behauptet, dass GPT-4 in seiner Fähigkeit, vernünftig zu denken und neue Dinge zu lernen, sehr weit fortgeschritten sei. Microsoft gab am Dienstag außerdem bekannt, dass der im letzten Monat veröffentlichte Bing-Chatbot für künstliche Intelligenz GPT-4 verwendet.

Entwickler sagten am Dienstag, dass diese Technologie die Arbeit und das Leben der Menschen weiter revolutionieren wird. Aber es weckt in der Öffentlichkeit auch Bedenken darüber, wie Menschen mit solch schrecklich hochentwickelten Maschinen konkurrieren können und wie Menschen dem vertrauen können, was sie online sehen.

OpenAI-Führungskräfte sagten, dass die „Multimodalität“ von GPT-4 über Text und Bilder hinweg ChatGPT bei „erweiterten Argumentationsfähigkeiten“ weit überlegen sei. Das Unternehmen verzögerte die Veröffentlichung der Bildbeschreibungsfunktion von GPT-4 aufgrund von Bedenken hinsichtlich eines Missbrauchs der Funktion, und Abonnenten des von GPT-4 unterstützten ChatGPT Plus-Dienstes können nur die Textfunktion verwenden.

Sandhini Agarwal, ein Politikforscher bei OpenAI, sagte, dass der Grund, warum das Unternehmen diese Funktion nicht veröffentlicht hat, darin besteht, die potenziellen Risiken besser zu verstehen. OpenAI-Sprecher Niko Felix sagte, das Unternehmen plane, „Schutzmaßnahmen zu implementieren, um zu verhindern, dass persönliche Informationen in Bildern identifiziert werden“.

OpenAI gab auch zu, dass GPT-4 immer noch häufige Fehler wie „Halluzinationen erzeugen“, Unsinn machen, soziale Vorurteile aufrechterhalten und schlechte Ratschläge geben wird.

Microsoft hat Milliarden von Dollar in OpenAI investiert und hofft, dass die Technologie der künstlichen Intelligenz zum Killerfeature seiner Bürosoftware, Suchmaschinen und anderen Online-Produkte werden kann. Das Unternehmen bewirbt die Technologie als äußerst effizienten Partner, der sich wiederholende Aufgaben bewältigen kann und es den Menschen ermöglicht, sich auf kreative Arbeit zu konzentrieren, beispielsweise indem sie Softwareentwicklern hilft, die Arbeit ganzer Teams abzuschließen.

Aber einige Leute, die sich Sorgen über künstliche Intelligenz machen, sagen, dass dies möglicherweise nur Symptome sind und künstliche Intelligenz zu Geschäftsmodellen und Risiken führen kann, die niemand vorhersagen kann.

Die rasante Entwicklung der künstlichen Intelligenz, gepaart mit der Popularität von ChatGPT, hat zu einem harten Wettbewerb zwischen Unternehmen der Branche um die Vorherrschaft im Bereich der künstlichen Intelligenz und die Veröffentlichung neuer Software geführt.

Dieser Trend hat auch viel Kritik hervorgerufen. Viele glauben, dass die Eile dieser Unternehmen, ungetestete, unregulierte und unvorhersehbare Technologien einzuführen, Benutzer täuschen, die Arbeit von Künstlern untergraben und in der realen Welt Schaden anrichten könnte.

Weil sie darauf ausgelegt sind, überzeugende Formulierungen zu generieren, liefern KI-Sprachmodelle oft falsche Antworten. Darüber hinaus werden diese Modelle anhand von Informationen und Bildern aus dem Internet trainiert und lernen, menschliche Vorurteile nachzuahmen.

OpenAI-Forscher schrieben in einem technischen Bericht, dass „da GPT-4 und ähnliche Systeme der künstlichen Intelligenz weit verbreitet sind“, sie „die inhärenten Erkenntnisse stärken werden“.

Irene Solaiman, eine ehemalige Forscherin bei OpenAI und politische Direktorin von Hugging Face, einem Open-Source-Unternehmen für künstliche Intelligenz, ist davon überzeugt, dass die Geschwindigkeit dieses technologischen Fortschritts eine rechtzeitige Reaktion der gesamten Gesellschaft auf potenzielle Probleme erfordert.

Sie sagte weiter: „Als Gesellschaft können wir bereits einen breiten Konsens über einige Schäden erzielen, die nicht durch Models verursacht werden sollten“, aber „viele der Schäden sind subtil und betreffen hauptsächlich Minderheitengruppen.“ „Kann bei der KI-Leistung keine zweitrangige Rolle spielen.“

Auch das neueste GPT-4 ist nicht ganz stabil. Als ein Benutzer dem KI-Tool zum Upgrade auf GPT-4 gratulierte, antwortete er: „Ich bin immer noch ein GPT-3-Modell.“ Dann entschuldigte es sich nach der Korrektur dafür und sagte: „Als GPT-4 danke ich Ihnen für Ihre Glückwünsche!“ Der Benutzer scherzte dann, dass es sich tatsächlich immer noch um ein GPT-3-Modell handelte, und die KI entschuldigte sich erneut und sagte das es „Es handelt sich tatsächlich um ein GPT-3-Modell, nicht um GPT-4“.

OpenAI-Sprecher Felix sagte, das Forschungsteam des Unternehmens untersuche, wo das Problem liege.

Am Dienstag kritisierten Forscher der künstlichen Intelligenz OpenAI dafür, dass es nicht genügend Informationen offenlegte. Das Unternehmen hat keine Daten zu seiner Bewertung der Verzerrungen in GPT-4 veröffentlicht. Eifrige Ingenieure waren auch enttäuscht, als sie nur wenige Details zum GPT-4-Modell, zum Datensatz oder zu den Trainingsmethoden fanden. OpenAI sagte im technischen Bericht, dass es diese Details aufgrund der „Wettbewerbslandschaft und Auswirkungen auf die Sicherheit“ nicht offenlegen werde.

Der Bereich der multisensorischen künstlichen Intelligenz, in dem GPT-4 tätig ist, ist hart umkämpft. DeepMind, das Unternehmen für künstliche Intelligenz im Besitz der Google-Muttergesellschaft Alphabet, veröffentlichte letztes Jahr ein Allround-Modell namens Gato, das Bilder beschreiben und Videospiele spielen kann. Google hat diesen Monat PaLM-E veröffentlicht, ein multimodales System, das künstliche Intelligenz und Sprachanalyse in einarmige Roboter integriert. Wenn ihn beispielsweise jemand bittet, ein paar Chips aufzuheben, kann es die Aufforderung verstehen, sich zur Schublade wenden und den entsprechenden Gegenstand auswählen.

Ähnliche Systeme haben grenzenlosen Optimismus hinsichtlich des Potenzials der Technologie hervorgerufen, wobei einige sogar ein Intelligenzniveau sehen, das dem des Menschen fast ebenbürtig ist. Kritiker und KI-Forscher argumentieren jedoch, dass diese Systeme lediglich etablierte Muster und inhärente Korrelationen in wiederholten Trainingsdaten finden, ohne deren Bedeutung klar zu verstehen.

GPT-4 ist der vierte „generative vorab trainierte Transformator“ seit der ersten Veröffentlichung von OpenAI im Jahr 2018 und basiert auf dem 2017 entwickelten bahnbrechenden „Transformator“ mit neuronaler Netzwerktechnologie. Solche Systeme, die durch Online-Analyse von Texten und Bildern „vortrainiert“ wurden, haben zu raschen Fortschritten bei der Analyse menschlicher Sprache und Bilder durch künstliche Intelligenzsysteme geführt. Im Laufe der Jahre hat OpenAI auch die potenziellen sozialen Risiken der Massenfreigabe von Werkzeugen der künstlichen Intelligenz grundlegend verändert. Im Jahr 2019 weigerte sich das Unternehmen, GPT-2 öffentlich zu veröffentlichen, mit der Begründung, dass die KI zwar sehr gut leistungsfähig sei, man sich jedoch Sorgen über „bösartige Anwendungen“ mache, die es nutzen könnten.

Aber im November letzten Jahres hat OpenAI ChatGPT öffentlich eingeführt, das auf einer fein abgestimmten Version von GPT-3 basiert. Innerhalb weniger Tage nach der Einführung wurde die Marke von 1 Million Nutzern überschritten.

Öffentliche Experimente mit ChatGPT- und Bing-Chatbots zeigen, dass die Technologie ohne menschliches Eingreifen alles andere als eine perfekte Leistung erbringt. Nach einer Reihe seltsamer Gespräche und falscher Antworten gaben Microsoft-Führungskräfte zu, dass KI-Chatbots immer noch nicht vertrauenswürdig sind, wenn es darum geht, korrekte Antworten zu geben, sagten jedoch, dass sie „Konfidenzmetriken“ entwickeln, um das Problem anzugehen.

GPT-4 verspricht, einige Mängel zu beheben, wobei KI-Befürworter wie der Tech-Blogger Robert Scoble argumentieren, dass „GPT-4 besser ist als alle erwartet.“

OpenAI-CEO Sam Sam Altman hat versucht, die Erwartungen an GPT-4 zu dämpfen . Er sagte im Januar, dass die Spekulationen über die Fähigkeiten von GPT-4 unmögliche Höhen erreicht hätten, dass „Gerüchte über GPT-4 lächerlich seien“ und „sie enttäuscht sein werden“

Aber Altman fördert auch die Vision von OpenAI. In einem Blogbeitrag letzten Monat sagte er, das Unternehmen plane, wie sichergestellt werden könne, dass „die gesamte Menschheit“ von „künstlicher universeller Energie“ (AGI) profitiert. Dieser Branchenbegriff bezieht sich auf die immer noch unrealistische Vorstellung einer superkünstlichen Intelligenz, die genauso intelligent oder sogar intelligenter ist als der Mensch.

Das obige ist der detaillierte Inhalt vonAusländische Medienkommentare zu GPT-4: Ein großer Sprung auf dem Gebiet der künstlichen Intelligenz und eine weitere große Veränderung in der technischen Ethik. Für weitere Informationen folgen Sie bitte anderen verwandten Artikeln auf der PHP chinesischen Website!

Heiße KI -Werkzeuge

Undresser.AI Undress

KI-gestützte App zum Erstellen realistischer Aktfotos

AI Clothes Remover

Online-KI-Tool zum Entfernen von Kleidung aus Fotos.

Undress AI Tool

Ausziehbilder kostenlos

Clothoff.io

KI-Kleiderentferner

AI Hentai Generator

Erstellen Sie kostenlos Ai Hentai.

Heißer Artikel

Heiße Werkzeuge

Notepad++7.3.1

Einfach zu bedienender und kostenloser Code-Editor

SublimeText3 chinesische Version

Chinesische Version, sehr einfach zu bedienen

Senden Sie Studio 13.0.1

Leistungsstarke integrierte PHP-Entwicklungsumgebung

Dreamweaver CS6

Visuelle Webentwicklungstools

SublimeText3 Mac-Version

Codebearbeitungssoftware auf Gottesniveau (SublimeText3)

Heiße Themen

1378

1378

52

52

Mit ChatGPT können kostenlose Benutzer jetzt Bilder mithilfe von DALL-E 3 mit einem Tageslimit generieren

Aug 09, 2024 pm 09:37 PM

Mit ChatGPT können kostenlose Benutzer jetzt Bilder mithilfe von DALL-E 3 mit einem Tageslimit generieren

Aug 09, 2024 pm 09:37 PM

DALL-E 3 wurde im September 2023 offiziell als deutlich verbessertes Modell gegenüber seinem Vorgänger eingeführt. Er gilt als einer der bisher besten KI-Bildgeneratoren und ist in der Lage, Bilder mit komplexen Details zu erstellen. Zum Start war es jedoch exklusiv

Ein neues Programmierparadigma, wenn Spring Boot auf OpenAI trifft

Feb 01, 2024 pm 09:18 PM

Ein neues Programmierparadigma, wenn Spring Boot auf OpenAI trifft

Feb 01, 2024 pm 09:18 PM

Im Jahr 2023 ist die KI-Technologie zu einem heißen Thema geworden und hat enorme Auswirkungen auf verschiedene Branchen, insbesondere im Programmierbereich. Die Bedeutung der KI-Technologie wird den Menschen zunehmend bewusst, und die Spring-Community bildet da keine Ausnahme. Mit der kontinuierlichen Weiterentwicklung der GenAI-Technologie (General Artificial Intelligence) ist es entscheidend und dringend geworden, die Erstellung von Anwendungen mit KI-Funktionen zu vereinfachen. Vor diesem Hintergrund entstand „SpringAI“ mit dem Ziel, den Prozess der Entwicklung von KI-Funktionsanwendungen zu vereinfachen, ihn einfach und intuitiv zu gestalten und unnötige Komplexität zu vermeiden. Durch „SpringAI“ können Entwickler einfacher Anwendungen mit KI-Funktionen erstellen, wodurch diese einfacher zu verwenden und zu bedienen sind.

Wählen Sie das Einbettungsmodell, das am besten zu Ihren Daten passt: Ein Vergleichstest von OpenAI und mehrsprachigen Open-Source-Einbettungen

Feb 26, 2024 pm 06:10 PM

Wählen Sie das Einbettungsmodell, das am besten zu Ihren Daten passt: Ein Vergleichstest von OpenAI und mehrsprachigen Open-Source-Einbettungen

Feb 26, 2024 pm 06:10 PM

OpenAI kündigte kürzlich die Einführung seines Einbettungsmodells embeddingv3 der neuesten Generation an, das seiner Meinung nach das leistungsstärkste Einbettungsmodell mit höherer Mehrsprachenleistung ist. Diese Reihe von Modellen ist in zwei Typen unterteilt: das kleinere Text-Embeddings-3-Small und das leistungsfähigere und größere Text-Embeddings-3-Large. Es werden nur wenige Informationen darüber offengelegt, wie diese Modelle entworfen und trainiert werden, und auf die Modelle kann nur über kostenpflichtige APIs zugegriffen werden. Es gab also viele Open-Source-Einbettungsmodelle. Aber wie schneiden diese Open-Source-Modelle im Vergleich zum Closed-Source-Modell von OpenAI ab? In diesem Artikel wird die Leistung dieser neuen Modelle empirisch mit Open-Source-Modellen verglichen. Wir planen, Daten zu erstellen

So installieren Sie ChatGPT auf einem Mobiltelefon

Mar 05, 2024 pm 02:31 PM

So installieren Sie ChatGPT auf einem Mobiltelefon

Mar 05, 2024 pm 02:31 PM

Installationsschritte: 1. Laden Sie die ChatGTP-Software von der offiziellen ChatGTP-Website oder dem mobilen Store herunter. 2. Wählen Sie nach dem Öffnen in der Einstellungsoberfläche die Sprache aus. 3. Wählen Sie in der Spieloberfläche das Mensch-Maschine-Spiel aus 4. Geben Sie nach dem Start Befehle in das Chatfenster ein, um mit der Software zu interagieren.

Posthume Arbeit des OpenAI Super Alignment Teams: Zwei große Modelle spielen ein Spiel und die Ausgabe wird verständlicher

Jul 19, 2024 am 01:29 AM

Posthume Arbeit des OpenAI Super Alignment Teams: Zwei große Modelle spielen ein Spiel und die Ausgabe wird verständlicher

Jul 19, 2024 am 01:29 AM

Wenn die Antwort des KI-Modells überhaupt unverständlich ist, würden Sie es wagen, sie zu verwenden? Da maschinelle Lernsysteme in immer wichtigeren Bereichen eingesetzt werden, wird es immer wichtiger zu zeigen, warum wir ihren Ergebnissen vertrauen können und wann wir ihnen nicht vertrauen sollten. Eine Möglichkeit, Vertrauen in die Ausgabe eines komplexen Systems zu gewinnen, besteht darin, vom System zu verlangen, dass es eine Interpretation seiner Ausgabe erstellt, die für einen Menschen oder ein anderes vertrauenswürdiges System lesbar ist, d. h. so vollständig verständlich, dass mögliche Fehler erkannt werden können gefunden. Um beispielsweise Vertrauen in das Justizsystem aufzubauen, verlangen wir von den Gerichten, dass sie klare und lesbare schriftliche Stellungnahmen abgeben, die ihre Entscheidungen erläutern und stützen. Für große Sprachmodelle können wir auch einen ähnlichen Ansatz verfolgen. Stellen Sie bei diesem Ansatz jedoch sicher, dass das Sprachmodell generiert wird

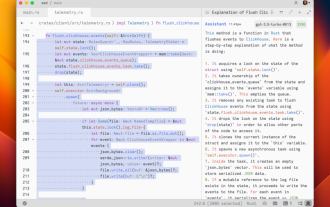

Der Rust-basierte Zed-Editor ist Open Source und bietet integrierte Unterstützung für OpenAI und GitHub Copilot

Feb 01, 2024 pm 02:51 PM

Der Rust-basierte Zed-Editor ist Open Source und bietet integrierte Unterstützung für OpenAI und GitHub Copilot

Feb 01, 2024 pm 02:51 PM

Autor丨Zusammengestellt von TimAnderson丨Produziert von Noah|51CTO Technology Stack (WeChat-ID: blog51cto) Das Zed-Editor-Projekt befindet sich noch in der Vorabversionsphase und wurde unter AGPL-, GPL- und Apache-Lizenzen als Open Source bereitgestellt. Der Editor zeichnet sich durch hohe Leistung und mehrere KI-gestützte Optionen aus, ist jedoch derzeit nur auf der Mac-Plattform verfügbar. Nathan Sobo erklärte in einem Beitrag, dass in der Codebasis des Zed-Projekts auf GitHub der Editor-Teil unter der GPL lizenziert ist, die serverseitigen Komponenten unter der AGPL lizenziert sind und der GPUI-Teil (GPU Accelerated User) die Schnittstelle übernimmt Apache2.0-Lizenz. GPUI ist ein vom Zed-Team entwickeltes Produkt

Warten Sie nicht auf OpenAI, sondern darauf, dass Open-Sora vollständig Open Source ist

Mar 18, 2024 pm 08:40 PM

Warten Sie nicht auf OpenAI, sondern darauf, dass Open-Sora vollständig Open Source ist

Mar 18, 2024 pm 08:40 PM

Vor nicht allzu langer Zeit wurde OpenAISora mit seinen erstaunlichen Videogenerierungseffekten schnell populär und stach aus der Masse der literarischen Videomodelle hervor und rückte in den Mittelpunkt der weltweiten Aufmerksamkeit. Nach der Einführung des Sora-Trainings-Inferenzreproduktionsprozesses mit einer Kostenreduzierung von 46 % vor zwei Wochen hat das Colossal-AI-Team das weltweit erste Sora-ähnliche Architektur-Videogenerierungsmodell „Open-Sora1.0“ vollständig als Open-Source-Lösung bereitgestellt, das das gesamte Spektrum abdeckt Lernen Sie den Trainingsprozess, einschließlich der Datenverarbeitung, aller Trainingsdetails und Modellgewichte, kennen und schließen Sie sich mit globalen KI-Enthusiasten zusammen, um eine neue Ära der Videoerstellung voranzutreiben. Schauen wir uns für einen kleinen Vorgeschmack ein Video einer geschäftigen Stadt an, das mit dem vom Colossal-AI-Team veröffentlichten Modell „Open-Sora1.0“ erstellt wurde. Open-Sora1.0

Microsoft und OpenAI planen, 100 Millionen US-Dollar in humanoide Roboter zu investieren! Internetnutzer rufen Musk an

Feb 01, 2024 am 11:18 AM

Microsoft und OpenAI planen, 100 Millionen US-Dollar in humanoide Roboter zu investieren! Internetnutzer rufen Musk an

Feb 01, 2024 am 11:18 AM

Anfang des Jahres wurde bekannt, dass Microsoft und OpenAI große Geldsummen in ein Startup für humanoide Roboter investieren. Unter anderem plant Microsoft, 95 Millionen US-Dollar zu investieren, und OpenAI wird 5 Millionen US-Dollar investieren. Laut Bloomberg wird das Unternehmen in dieser Runde voraussichtlich insgesamt 500 Millionen US-Dollar einsammeln, und seine Pre-Money-Bewertung könnte 1,9 Milliarden US-Dollar erreichen. Was zieht sie an? Werfen wir zunächst einen Blick auf die Robotik-Erfolge dieses Unternehmens. Dieser Roboter ist ganz in Silber und Schwarz gehalten und ähnelt in seinem Aussehen dem Abbild eines Roboters in einem Hollywood-Science-Fiction-Blockbuster: Jetzt steckt er eine Kaffeekapsel in die Kaffeemaschine: Wenn sie nicht richtig platziert ist, passt sie sich von selbst an menschliche Fernbedienung: Nach einer Weile kann jedoch eine Tasse Kaffee mitgenommen und genossen werden: Haben Sie Familienmitglieder, die es erkannt haben? Ja, dieser Roboter wurde vor einiger Zeit erstellt.