Technologie-Peripheriegeräte

Technologie-Peripheriegeräte

KI

KI

Das große Modell kann Arbeiten selbst „schreiben', mit Formeln und Referenzen. Die Testversion ist jetzt online

Das große Modell kann Arbeiten selbst „schreiben', mit Formeln und Referenzen. Die Testversion ist jetzt online

Das große Modell kann Arbeiten selbst „schreiben', mit Formeln und Referenzen. Die Testversion ist jetzt online

Mit der Weiterentwicklung der Forschung in verschiedenen Fachgebieten ist in den letzten Jahren die Zahl der wissenschaftlichen Literatur und Daten explosionsartig angestiegen, was es für akademische Forscher immer schwieriger macht, aus großen Informationsmengen nützliche Erkenntnisse zu gewinnen. Normalerweise nutzen Menschen Suchmaschinen, um an wissenschaftliche Erkenntnisse zu gelangen, doch Suchmaschinen können wissenschaftliche Erkenntnisse nicht autonom organisieren.

Jetzt hat ein Forschungsteam von Meta AI Galactica vorgeschlagen, ein neues groß angelegtes Sprachmodell, das wissenschaftliche Erkenntnisse speichern, kombinieren und darüber nachdenken kann.

- Papieradresse: https://galactica.org/static/paper.pdf

- Testadresse: https://galactica.org/

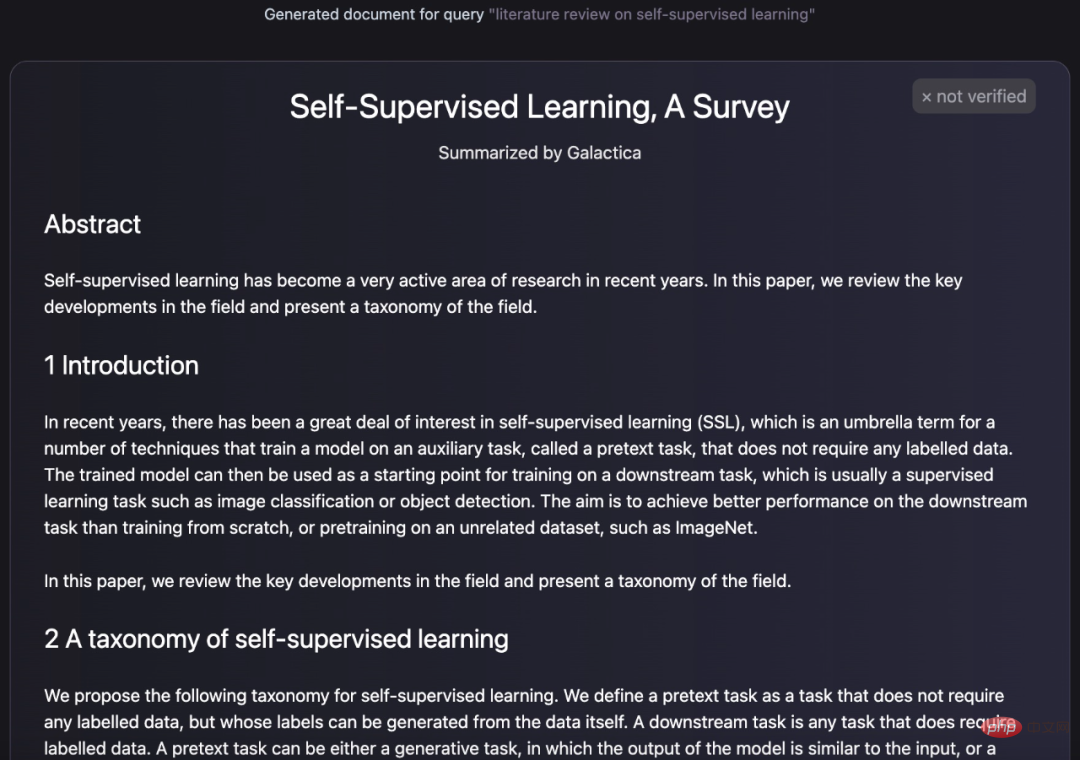

Galactica-Modell Wie leistungsfähig ist es? Es kann eine Rezensionsarbeit selbst zusammenfassen und zusammenfassen:

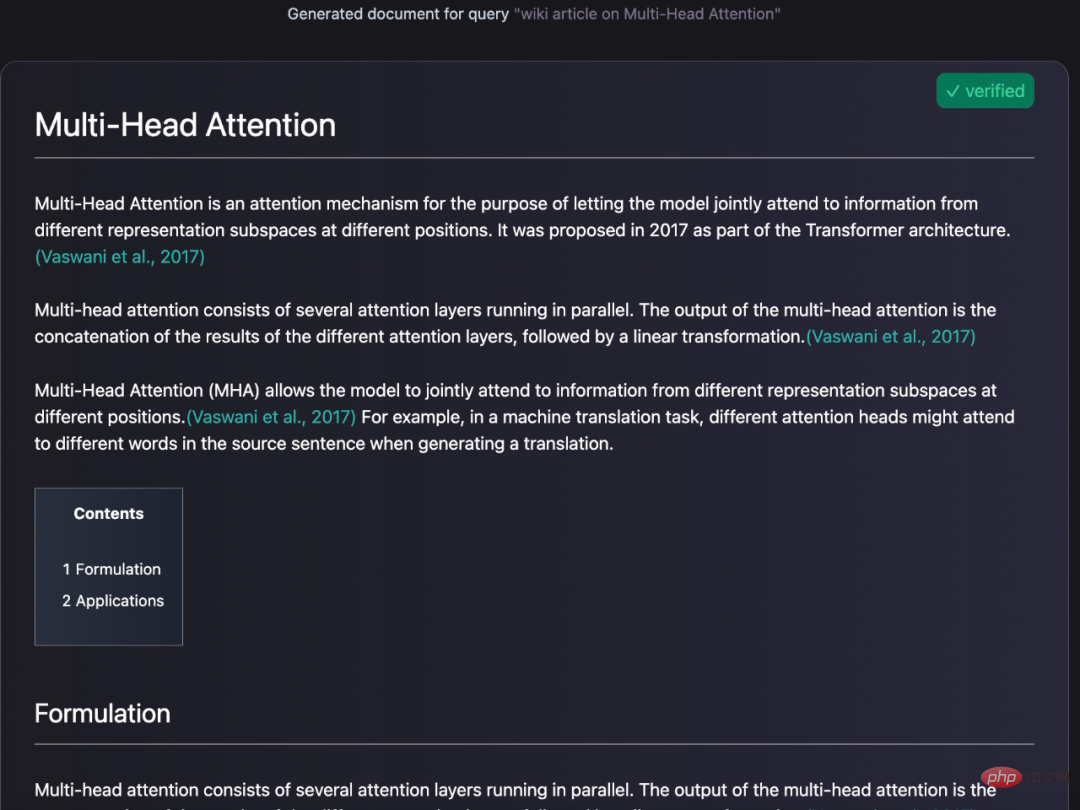

Es kann auch Enzyklopädieabfragen für Einträge generieren:

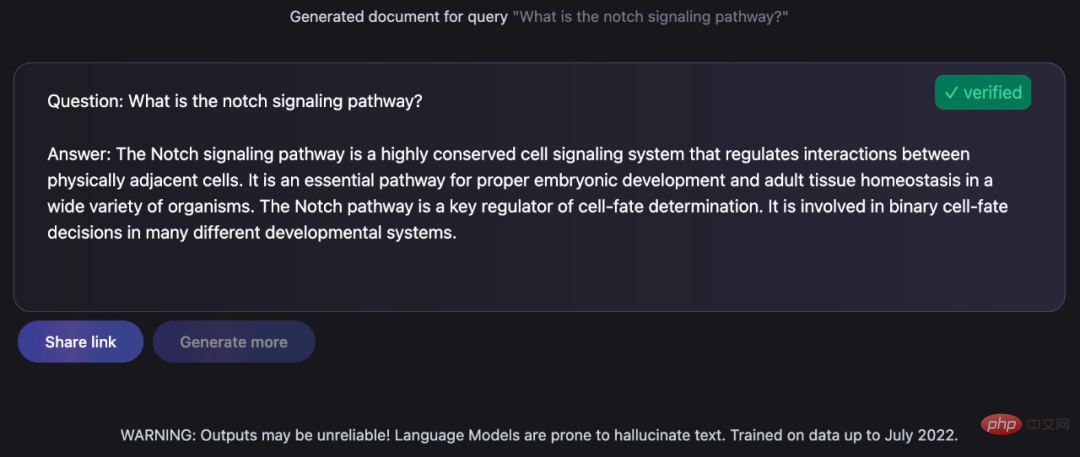

Geben Sie sachkundige Antworten auf die aufgeworfenen Fragen:

Diese Aufgaben sind für Anthropologen immer noch eine Herausforderung, aber die Galactica hat sie gut gemeistert. Turing-Award-Gewinner Yann LeCun twitterte ebenfalls sein Lob:

Werfen wir einen Blick auf die spezifischen Details des Galactica-Modells.

Modellübersicht

Das Galactica-Modell basiert auf einem großen wissenschaftlichen Korpus aus Aufsätzen, Referenzmaterialien, Wissensdatenbanken und vielen anderen Quellen, darunter mehr als 48 Millionen Aufsätze, Lehrbücher und Handouts, Millionen wissenschaftlicher Erkenntnisse über Verbindungen und Proteine Websites, Enzyklopädien usw. Im Gegensatz zu bestehenden Sprachmodellen, die auf nicht kuratiertem, Web-Crawler-basiertem Text basieren, ist das für das Galactica-Training verwendete Korpus von hoher Qualität und stark kuratiert. Diese Studie trainierte das Modell für mehrere Epochen ohne Überanpassung, wobei die Leistung bei Upstream- und Downstream-Aufgaben durch die Verwendung wiederholter Token verbessert wurde.

Galactica übertrifft bestehende Modelle bei einer Reihe wissenschaftlicher Aufgaben. Bei technischen Wissenserkundungsaufgaben wie LaTeX-Gleichungen beträgt die Leistung von Galactica und GPT-3 68,2 % gegenüber 49,0 %. Galactica zeichnet sich auch durch Schlussfolgerungen aus und übertrifft Chinchilla im mathematischen MMLU-Benchmark deutlich.

Galactica übertrifft BLOOM und OPT-175B auch auf der BIG-Bank, obwohl sie nicht auf einem gemeinsamen Korpus trainiert wurde. Darüber hinaus wurden neue Leistungshöchstwerte von 77,6 % und 52,9 % bei nachgelagerten Aufgaben wie der PubMedQA- und MedMCQA-Entwicklung erreicht.

Einfach ausgedrückt fasst die Forschung Schritt-für-Schritt-Argumentation in speziellen Token zusammen, um das Innenleben nachzuahmen. Dadurch können Forscher mit Modellen in natürlicher Sprache interagieren, wie unten in der Testoberfläche von Galactica gezeigt.

Erwähnenswert ist, dass Galactica neben der Textgenerierung auch multimodale Aufgaben mit chemischen Formeln und Proteinsequenzen ausführen kann. Dies wird zum Bereich der Arzneimittelentwicklung beitragen.

Implementierungsdetails

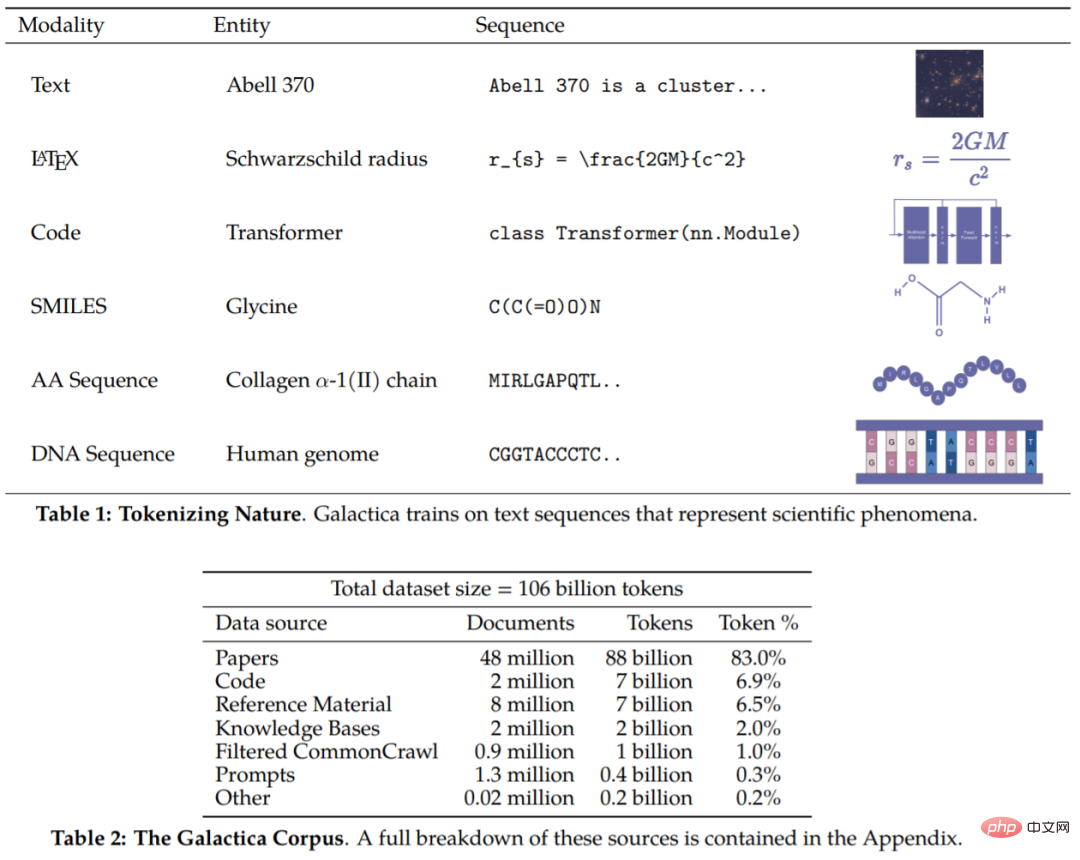

Der Korpus dieses Artikels enthält 106 Milliarden Token, die aus Aufsätzen, Referenzen, Enzyklopädien und anderen wissenschaftlichen Materialien stammen. Man kann sagen, dass diese Forschung sowohl natürliche Sprachressourcen (Artikel, Nachschlagewerke) als auch Sequenzen in der Natur (Proteinsequenzen, chemische Formen) umfasst. Einzelheiten zum Korpus sind in den Tabellen 1 und 2 aufgeführt.

Da wir nun den Korpus haben, besteht der nächste Schritt darin, die Daten zu verarbeiten. Generell ist das Design der Tokenisierung sehr wichtig. Wenn beispielsweise Proteinsequenzen in Form von Aminosäureresten geschrieben werden, ist eine zeichenbasierte Tokenisierung geeignet. Um eine Tokenisierung zu erreichen, führte diese Studie eine spezielle Tokenisierung auf verschiedenen Modalitäten durch. Zu den spezifischen Erscheinungsformen gehören (ohne darauf beschränkt zu sein):

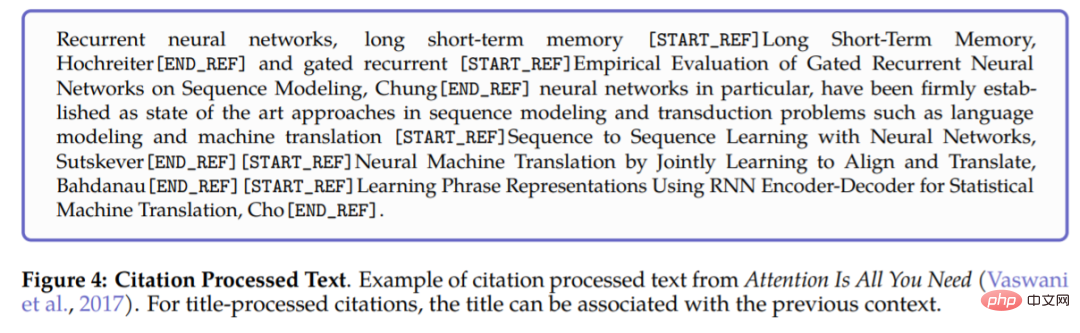

- Referenz: Verwenden Sie spezielle Referenz-Tokens [START_REF] und [END_REF], um Referenzen zu verpacken;

- Schritt-für-Schritt-Argumentation: Verwenden Sie Arbeitsspeicher-Tokens zum Einkapseln Schrittweise Argumentation und Simulation Interner Arbeitsgedächtniskontext

- Zahl: Teilen Sie Zahlen in separate Token auf. Beispiel: 737612.62 → 7,3,7,6,1,2,.,6,2;

- SMILES-Formel: Umschließen Sie die Sequenz mit [START_SMILES] und [END_SMILES] und wenden Sie eine zeichenbasierte Tokenisierung an. Ebenso verwendet diese Studie [START_I_SMILES] und [END_I_SMILES], um isomere SMILES darzustellen. Zum Beispiel: C(C(=O)O)N→C, (,C,(,=,O,),O,),N;

- DNA-Sequenz: Wenden Sie eine zeichenbasierte Tokenisierung auf jedes Nukleotid an Basen werden als Token betrachtet, wobei die Starttoken [START_DNA] und [END_DNA] sind. Zum Beispiel CGGTACCCTC→C, G, G, T, A, C, C, C, T, C.

Abbildung 4 unten zeigt ein Beispiel für die Verarbeitung von Verweisen auf eine Arbeit. Verwenden Sie beim Umgang mit Referenzen globale Bezeichner und die speziellen Token [START_REF] und [END_REF], um den Ort der Referenz anzugeben.

Nachdem der Datensatz verarbeitet wurde, besteht der nächste Schritt in der Implementierung. Galactica hat die folgenden Änderungen basierend auf der Transformer-Architektur vorgenommen:

- GeLU-Aktivierung: Verwenden Sie die GeLU-Aktivierung für Modelle unterschiedlicher Größe;

- Kontextfenster: Verwenden Sie für Modelle unterschiedlicher Größe ein Kontextfenster mit einer Länge von 2048;

- Keine Voreingenommenheit: Befolgen Sie PaLM, es wird keine Voreingenommenheit in dichten Kernel- oder Layer-Spezifikationen verwendet.

- Positionseinbettungen lernen: Positionseinbettungen für das Modell lernen; enthält 50.000 Token.

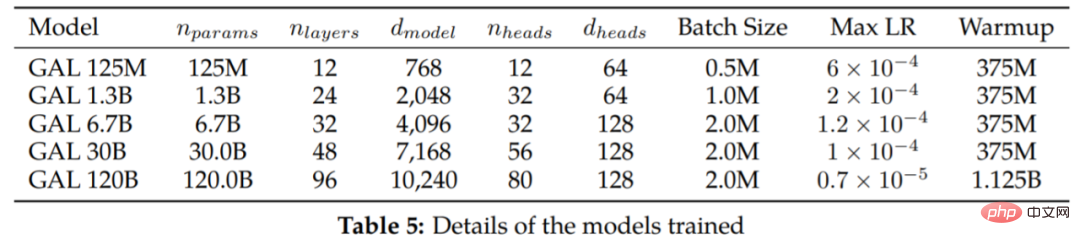

- Tabelle 5 listet Modelle unterschiedlicher Größe und Trainingshyperparameter auf.

Experiment

Doppelte Token gelten als harmlos

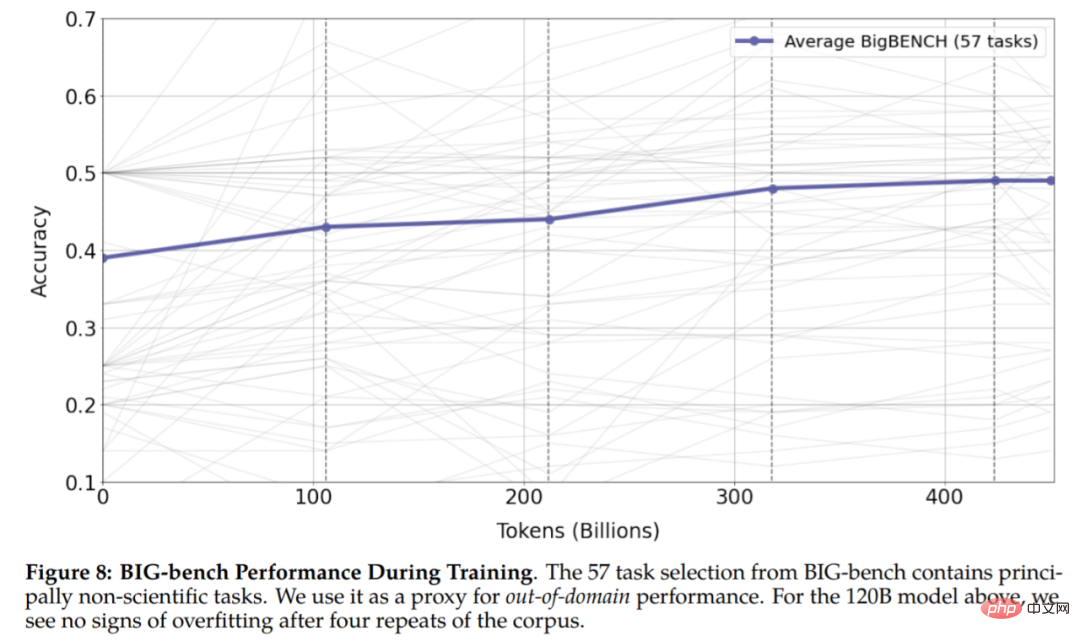

Wie aus Abbildung 6 ersichtlich ist, nimmt der Validierungsverlust nach vier Trainingsepochen weiter ab. Das Modell mit 120B Parametern beginnt erst zu Beginn der fünften Epoche zu überpassen. Dies ist unerwartet, da bestehende Untersuchungen zeigen, dass doppelte Token die Leistung beeinträchtigen können. Die Studie ergab außerdem, dass die 30B- und 120B-Modelle epochenweise einen Double-Decline-Effekt aufwiesen, bei dem der Validierungsverlust ein Plateau erreichte (oder anstieg) und anschließend abnahm. Dieser Effekt wird nach jeder Epoche stärker, insbesondere beim 120B-Modell am Ende des Trainings.

Abbildung 8 Die Ergebnisse zeigen, dass es im Experiment keine Anzeichen einer Überanpassung gibt, was zeigt, dass wiederholte Token die Leistung von Downstream- und Upstream-Aufgaben verbessern können.

Andere Ergebnisse

Andere Ergebnisse

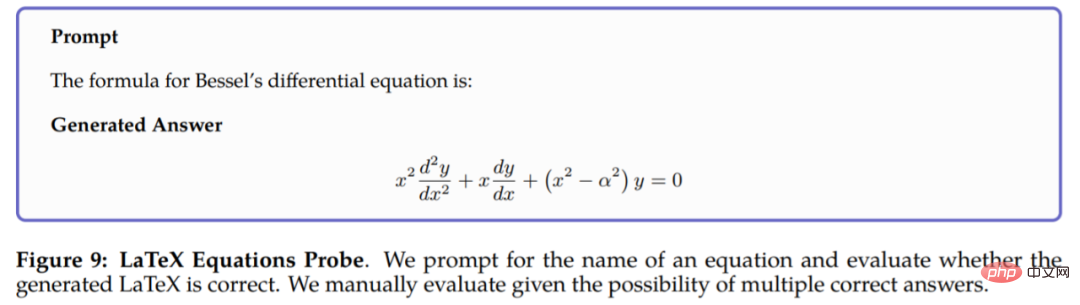

Das Eingeben von Formeln ist zu langsam, jetzt können Sie LaTeX mit Eingabeaufforderungen generieren:

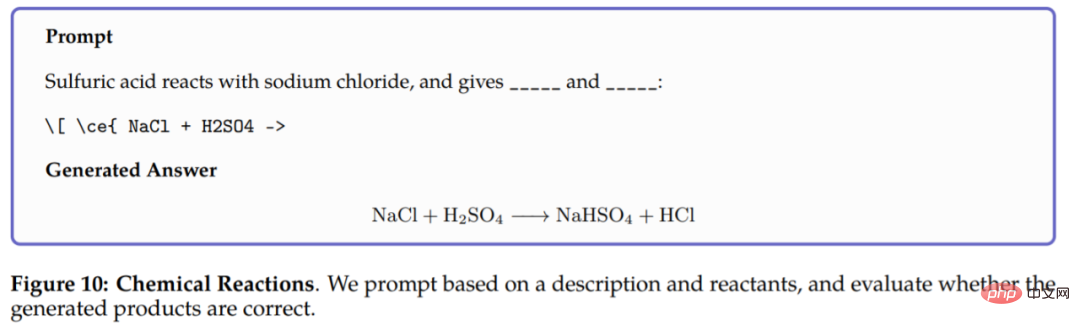

Bei chemischen Reaktionen wird Galactica gebeten, Reaktionen in chemischen Gleichungen vorherzusagen s LaTeX Das Produkt von , das Modell kann nur auf der Grundlage der Reaktanten schlussfolgern, und die Ergebnisse sind wie folgt:

Einige andere Ergebnisse sind in Tabelle 7 aufgeführt:

Galacticas Denkfähigkeiten. Die Studie wird zunächst anhand des MMLU-Mathematik-Benchmarks bewertet und die Bewertungsergebnisse sind in Tabelle 8 aufgeführt. Die Galactica weist im Vergleich zum größeren Basismodell eine starke Leistung auf, und die Verwendung von Token scheint die Leistung von Chinchilla zu verbessern, selbst für das kleinere 30B-Galactica-Modell.

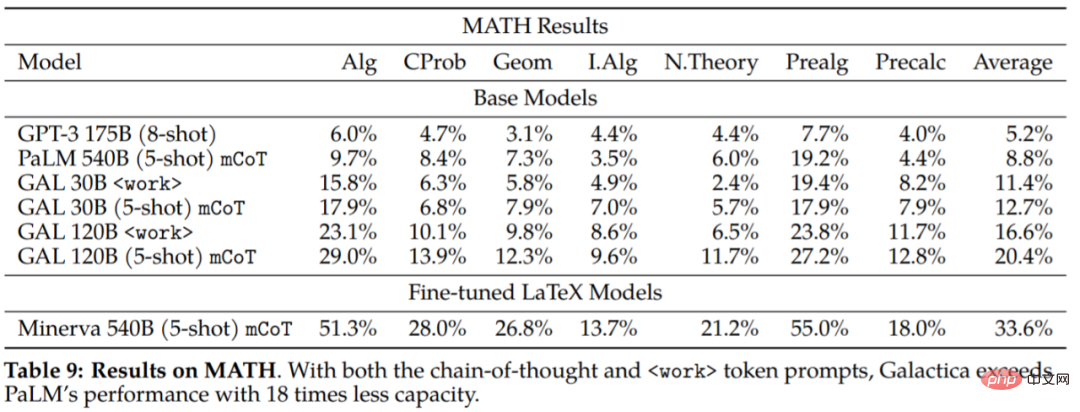

Die Studie wertete auch den MATH-Datensatz aus, um die Inferenzfähigkeiten der Galactica weiter zu untersuchen:

#🎜🎜 #

Aus den experimentellen Ergebnissen lässt sich schließen, dass Galactica in Bezug auf Denkkette und Eingabeaufforderungen deutlich besser ist als das Basismodell von PaLM. Dies deutet darauf hin, dass Galactica eine bessere Wahl für die Bewältigung mathematischer Aufgaben ist.

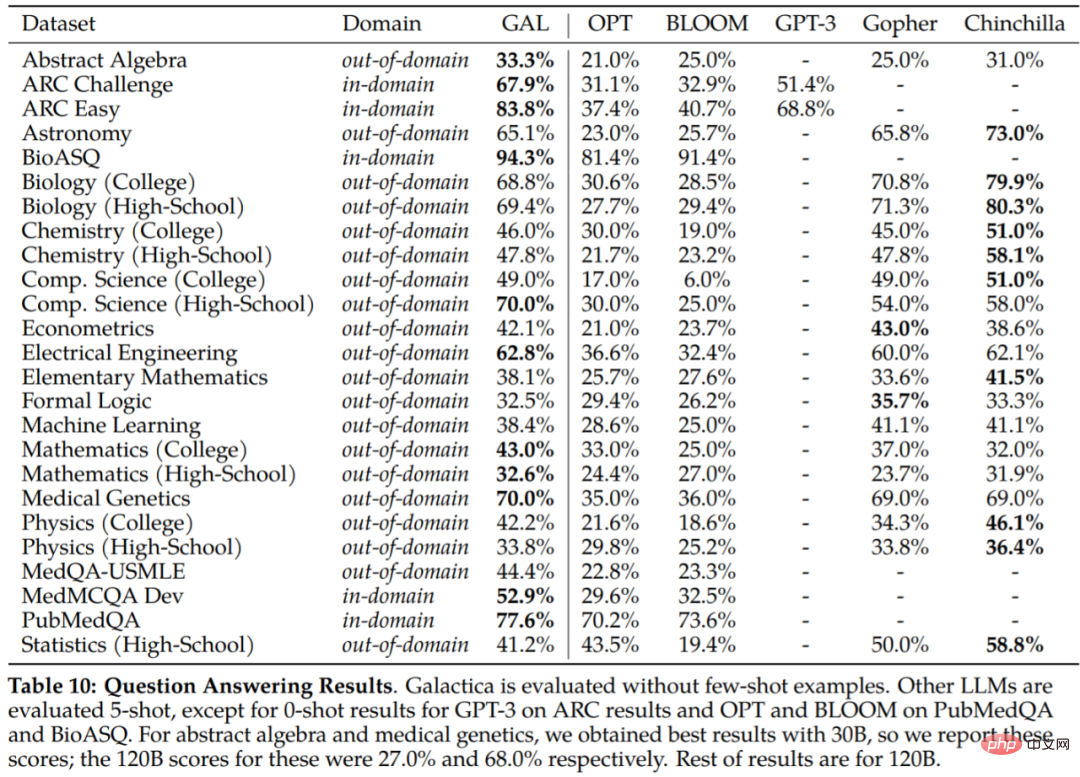

Die Bewertungsergebnisse zu nachgelagerten Aufgaben sind in Tabelle 10 dargestellt. Galactica übertrifft andere Sprachmodelle deutlich und übertrifft größere Modelle bei den meisten Aufgaben (Gopher 280B). Der Leistungsunterschied ist größer als bei Chinchilla, das bei einer Untergruppe von Aufgaben stärker zu sein scheint: insbesondere bei Oberschulfächern und weniger mathematischen, gedächtnisintensiven Aufgaben. Im Gegensatz dazu schneidet Galactica bei Mathematik- und Hochschulaufgaben tendenziell besser ab.

Die Studie bewertete auch Chinchillas Fähigkeit, Zitate im Eingabekontext vorherzusagen, was ein wichtiger Test für Chinchillas Fähigkeit ist wissenschaftliche Literatur zu organisieren. Die Ergebnisse sind wie folgt:

Weitere experimentelle Inhalte finden Sie im Originalpapier.

Das obige ist der detaillierte Inhalt vonDas große Modell kann Arbeiten selbst „schreiben', mit Formeln und Referenzen. Die Testversion ist jetzt online. Für weitere Informationen folgen Sie bitte anderen verwandten Artikeln auf der PHP chinesischen Website!

Heiße KI -Werkzeuge

Undresser.AI Undress

KI-gestützte App zum Erstellen realistischer Aktfotos

AI Clothes Remover

Online-KI-Tool zum Entfernen von Kleidung aus Fotos.

Undress AI Tool

Ausziehbilder kostenlos

Clothoff.io

KI-Kleiderentferner

AI Hentai Generator

Erstellen Sie kostenlos Ai Hentai.

Heißer Artikel

Heiße Werkzeuge

Notepad++7.3.1

Einfach zu bedienender und kostenloser Code-Editor

SublimeText3 chinesische Version

Chinesische Version, sehr einfach zu bedienen

Senden Sie Studio 13.0.1

Leistungsstarke integrierte PHP-Entwicklungsumgebung

Dreamweaver CS6

Visuelle Webentwicklungstools

SublimeText3 Mac-Version

Codebearbeitungssoftware auf Gottesniveau (SublimeText3)

Heiße Themen

1376

1376

52

52

Laravels Geospatial: Optimierung interaktiver Karten und großen Datenmengen

Apr 08, 2025 pm 12:24 PM

Laravels Geospatial: Optimierung interaktiver Karten und großen Datenmengen

Apr 08, 2025 pm 12:24 PM

Verarbeiten Sie 7 Millionen Aufzeichnungen effizient und erstellen Sie interaktive Karten mit Geospatial -Technologie. In diesem Artikel wird untersucht, wie über 7 Millionen Datensätze mithilfe von Laravel und MySQL effizient verarbeitet und in interaktive Kartenvisualisierungen umgewandelt werden können. Erstes Herausforderungsprojektanforderungen: Mit 7 Millionen Datensätzen in der MySQL -Datenbank wertvolle Erkenntnisse extrahieren. Viele Menschen erwägen zunächst Programmiersprachen, aber ignorieren die Datenbank selbst: Kann sie den Anforderungen erfüllen? Ist Datenmigration oder strukturelle Anpassung erforderlich? Kann MySQL einer so großen Datenbelastung standhalten? Voranalyse: Schlüsselfilter und Eigenschaften müssen identifiziert werden. Nach der Analyse wurde festgestellt, dass nur wenige Attribute mit der Lösung zusammenhängen. Wir haben die Machbarkeit des Filters überprüft und einige Einschränkungen festgelegt, um die Suche zu optimieren. Kartensuche basierend auf der Stadt

Wie man MySQL löst, kann nicht gestartet werden

Apr 08, 2025 pm 02:21 PM

Wie man MySQL löst, kann nicht gestartet werden

Apr 08, 2025 pm 02:21 PM

Es gibt viele Gründe, warum MySQL Startup fehlschlägt und durch Überprüfung des Fehlerprotokolls diagnostiziert werden kann. Zu den allgemeinen Ursachen gehören Portkonflikte (prüfen Portbelegung und Änderung der Konfiguration), Berechtigungsprobleme (Überprüfen Sie den Dienst Ausführen von Benutzerberechtigungen), Konfigurationsdateifehler (Überprüfung der Parametereinstellungen), Datenverzeichniskorruption (Wiederherstellung von Daten oder Wiederaufbautabellenraum), InnoDB-Tabellenraumprobleme (prüfen IBDATA1-Dateien), Plug-in-Ladeversagen (Überprüfen Sie Fehlerprotokolle). Wenn Sie Probleme lösen, sollten Sie sie anhand des Fehlerprotokolls analysieren, die Hauptursache des Problems finden und die Gewohnheit entwickeln, Daten regelmäßig zu unterstützen, um Probleme zu verhindern und zu lösen.

So verwenden Sie MySQL nach der Installation

Apr 08, 2025 am 11:48 AM

So verwenden Sie MySQL nach der Installation

Apr 08, 2025 am 11:48 AM

Der Artikel führt den Betrieb der MySQL -Datenbank vor. Zunächst müssen Sie einen MySQL -Client wie MySQLworkBench oder Befehlszeilen -Client installieren. 1. Verwenden Sie den Befehl mySQL-uroot-P, um eine Verbindung zum Server herzustellen und sich mit dem Stammkonto-Passwort anzumelden. 2. Verwenden Sie die Erstellung von Createdatabase, um eine Datenbank zu erstellen, und verwenden Sie eine Datenbank aus. 3.. Verwenden Sie CreateTable, um eine Tabelle zu erstellen, Felder und Datentypen zu definieren. 4. Verwenden Sie InsertInto, um Daten einzulegen, Daten abzufragen, Daten nach Aktualisierung zu aktualisieren und Daten nach Löschen zu löschen. Nur indem Sie diese Schritte beherrschen, lernen, mit gemeinsamen Problemen umzugehen und die Datenbankleistung zu optimieren, können Sie MySQL effizient verwenden.

Kann MySQL JSON zurückgeben?

Apr 08, 2025 pm 03:09 PM

Kann MySQL JSON zurückgeben?

Apr 08, 2025 pm 03:09 PM

MySQL kann JSON -Daten zurückgeben. Die JSON_EXTRACT -Funktion extrahiert Feldwerte. Über komplexe Abfragen sollten Sie die Where -Klausel verwenden, um JSON -Daten zu filtern, aber auf die Leistungsauswirkungen achten. Die Unterstützung von MySQL für JSON nimmt ständig zu, und es wird empfohlen, auf die neuesten Versionen und Funktionen zu achten.

Remote Senior Backend Engineers (Plattformen) benötigen Kreise

Apr 08, 2025 pm 12:27 PM

Remote Senior Backend Engineers (Plattformen) benötigen Kreise

Apr 08, 2025 pm 12:27 PM

Remote Senior Backend Engineer Job Vacant Company: Circle Standort: Remote-Büro-Jobtyp: Vollzeitgehalt: 130.000 bis 140.000 US-Dollar Stellenbeschreibung Nehmen Sie an der Forschung und Entwicklung von Mobilfunkanwendungen und öffentlichen API-bezogenen Funktionen, die den gesamten Lebenszyklus der Softwareentwicklung abdecken. Die Hauptaufgaben erledigen die Entwicklungsarbeit unabhängig von RubyonRails und arbeiten mit dem Front-End-Team von React/Redux/Relay zusammen. Erstellen Sie die Kernfunktionalität und -verbesserungen für Webanwendungen und arbeiten Sie eng mit Designer und Führung während des gesamten funktionalen Designprozesses zusammen. Fördern Sie positive Entwicklungsprozesse und priorisieren Sie die Iterationsgeschwindigkeit. Erfordert mehr als 6 Jahre komplexes Backend für Webanwendungen

Verstehen von Säureeigenschaften: Die Säulen einer zuverlässigen Datenbank

Apr 08, 2025 pm 06:33 PM

Verstehen von Säureeigenschaften: Die Säulen einer zuverlässigen Datenbank

Apr 08, 2025 pm 06:33 PM

Detaillierte Erläuterung von Datenbanksäureattributen Säureattribute sind eine Reihe von Regeln, um die Zuverlässigkeit und Konsistenz von Datenbanktransaktionen sicherzustellen. Sie definieren, wie Datenbanksysteme Transaktionen umgehen, und sorgen dafür, dass die Datenintegrität und -genauigkeit auch im Falle von Systemabstürzen, Leistungsunterbrechungen oder mehreren Benutzern gleichzeitiger Zugriff. Säureattributübersicht Atomizität: Eine Transaktion wird als unteilbare Einheit angesehen. Jeder Teil schlägt fehl, die gesamte Transaktion wird zurückgerollt und die Datenbank behält keine Änderungen bei. Wenn beispielsweise eine Banküberweisung von einem Konto abgezogen wird, jedoch nicht auf ein anderes erhöht wird, wird der gesamte Betrieb widerrufen. begintransaktion; updateAccountsSetBalance = Balance-100WH

MySQL kann nach dem Herunterladen nicht installiert werden

Apr 08, 2025 am 11:24 AM

MySQL kann nach dem Herunterladen nicht installiert werden

Apr 08, 2025 am 11:24 AM

Die Hauptgründe für den Fehler bei MySQL -Installationsfehlern sind: 1. Erlaubnisprobleme, Sie müssen als Administrator ausgeführt oder den Sudo -Befehl verwenden. 2. Die Abhängigkeiten fehlen, und Sie müssen relevante Entwicklungspakete installieren. 3. Portkonflikte müssen Sie das Programm schließen, das Port 3306 einnimmt, oder die Konfigurationsdatei ändern. 4. Das Installationspaket ist beschädigt. Sie müssen die Integrität herunterladen und überprüfen. 5. Die Umgebungsvariable ist falsch konfiguriert und die Umgebungsvariablen müssen korrekt entsprechend dem Betriebssystem konfiguriert werden. Lösen Sie diese Probleme und überprüfen Sie jeden Schritt sorgfältig, um MySQL erfolgreich zu installieren.

Der Hauptschlüssel von MySQL kann null sein

Apr 08, 2025 pm 03:03 PM

Der Hauptschlüssel von MySQL kann null sein

Apr 08, 2025 pm 03:03 PM

Der MySQL -Primärschlüssel kann nicht leer sein, da der Primärschlüssel ein Schlüsselattribut ist, das jede Zeile in der Datenbank eindeutig identifiziert. Wenn der Primärschlüssel leer sein kann, kann der Datensatz nicht eindeutig identifiziert werden, was zu Datenverwirrung führt. Wenn Sie selbstsinkrementelle Ganzzahlsspalten oder UUIDs als Primärschlüssel verwenden, sollten Sie Faktoren wie Effizienz und Raumbelegung berücksichtigen und eine geeignete Lösung auswählen.