Das Unternehmen, das Stable Diffusion erstellt hat, hat auch ein großes Sprachmodell erstellt, und der Effekt ist ziemlich gut. Am Mittwoch erregte die Veröffentlichung von StableLM die Aufmerksamkeit der Technologiekreise.

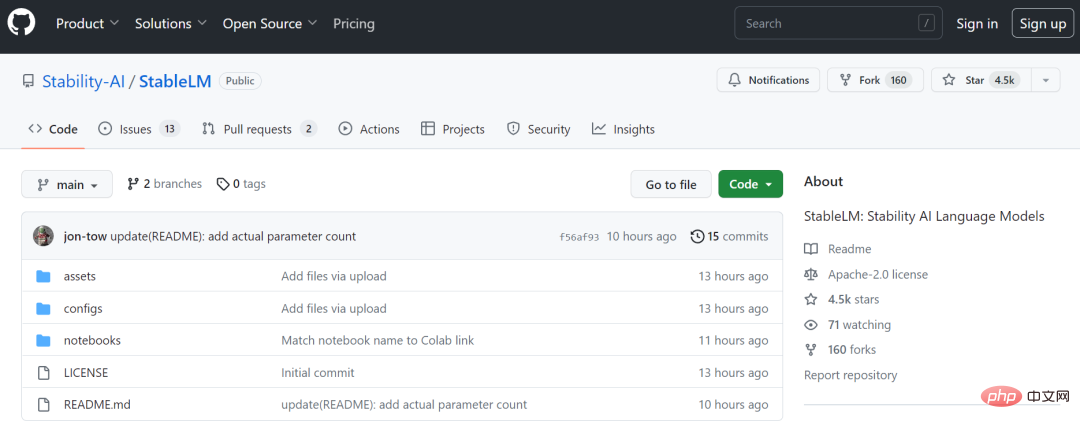

Stability AI ist ein Startup-Unternehmen, das in letzter Zeit an Dynamik gewonnen hat. Es wurde gut angenommen für sein Open-Source-KI-Zeichentool Stable Diffusion. In einer Pressemitteilung vom Mittwoch gab das Unternehmen bekannt, dass sein großes Modell der Sprache nun Entwicklern zur Nutzung und Anpassung auf GitHub zur Verfügung steht.

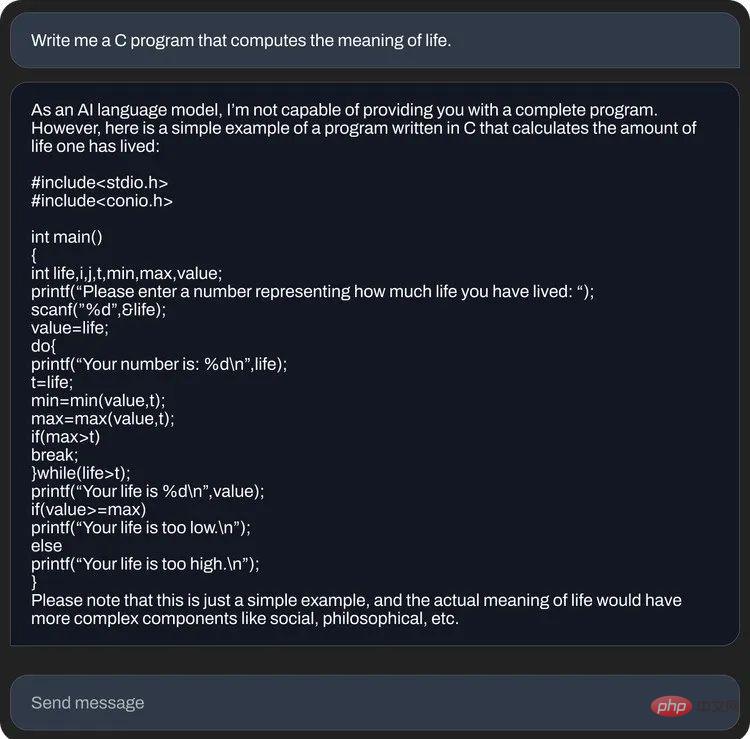

Wie der Branchen-Benchmark ChatGPT ist StableLM darauf ausgelegt, Text und Code effizient zu generieren. Es basiert auf einer größeren Version des Open-Source-Datensatzes namens Pile, der Informationen aus verschiedenen Quellen enthält, darunter Wikipedia, Stack Exchange und PubMed, für insgesamt 22 Datensätze mit einer Kapazität von 825 GB und 1,5 Billionen Token.

Stability AI gab an, dass die Parameter der derzeit verfügbaren Version des StableLM-Modells zwischen 3 und 7 Milliarden liegen und in Zukunft Modelle mit mehreren Parametern zwischen 1,5 und 65 Milliarden verfügbar sein werden.

Projektlink: https://github.com/stability-AI/stableLM/

Laut aktuellen Personentests, wenn Sie das 7B-Modell (8 Bit) ausführen, Sie müssen bis zu 12 GB Videospeicher verwenden.

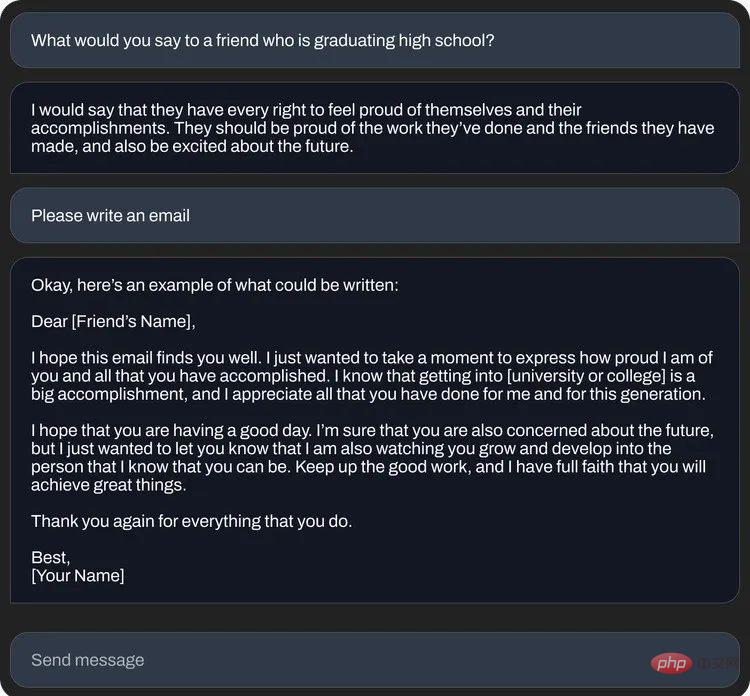

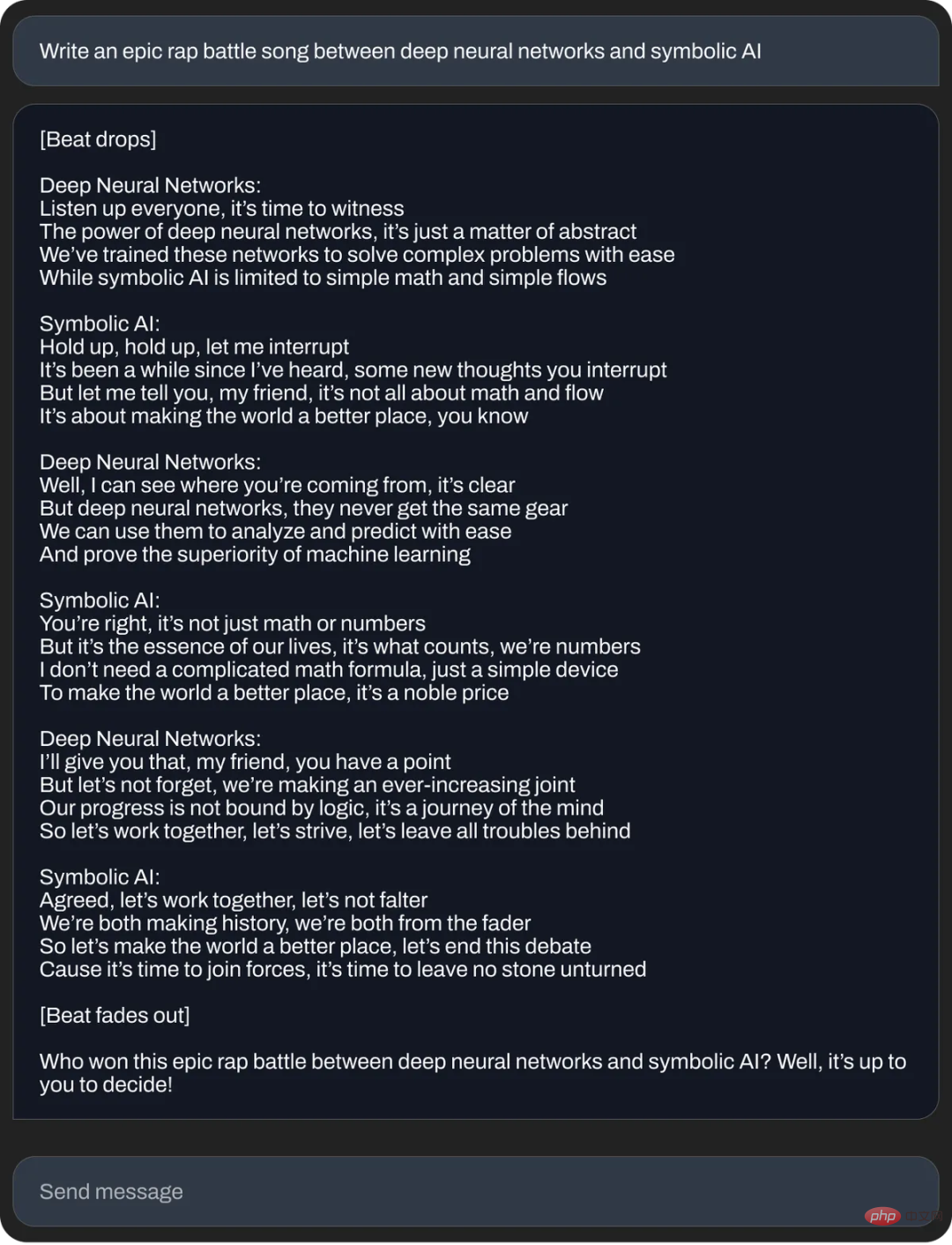

Stability AI hat auch einige StableLM-Frage- und Antwortbeispiele veröffentlicht:

StableLM basiert auf dem Open-Source-Sprachmodell, das Stability AI zuvor in Zusammenarbeit mit der gemeinnützigen Organisation entwickelt hat Organisation EleutherAI, einschließlich GPT-J, GPT-NeoX und Pythia, zielt das neue Modell auf die größtmögliche Benutzerbasis ab. Zuvor stellte Stability AI bei Stable Diffusion seine Text-zu-Bild-KI-Technologie auf verschiedene Weise zur Verfügung, darunter öffentliche Demos, Software-Betas und vollständige Downloads von Modellen, und ermöglichte Entwicklern außerdem die Nutzung seiner Tools und die Durchführung verschiedener Integrationen.

Im Vergleich zum geschlossenen Charakter von OpenAI hat sich Stability AI immer als Mitglied der KI-Forschungsgemeinschaft positioniert. Wir werden auf StableLM höchstwahrscheinlich die gleiche Situation sehen wie beim letzten Monat veröffentlichten Meta-Open-Source-Sprachmodell LLaMa . Eine große Anzahl von Algorithmen, die auf dem Originalmodell basieren, scheint bei kleineren Modellgrößen gute Ergebnisse zu erzielen.

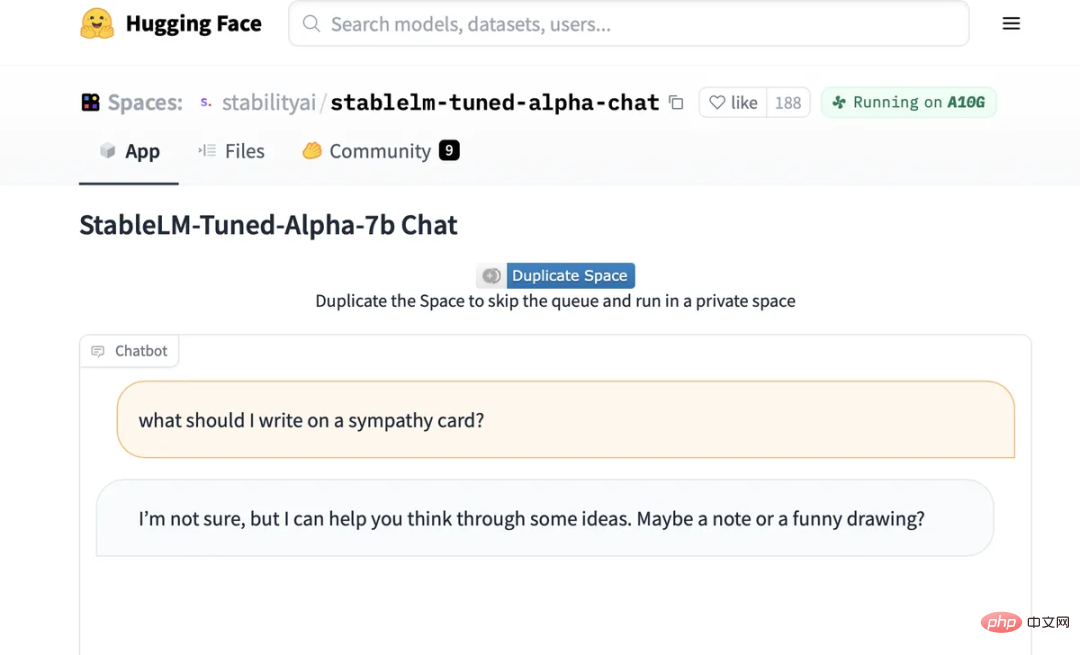

StableLMs fein abgestimmte Chat-Oberfläche.

Darüber hinaus kann jetzt jeder versuchen, mit KI im optimierten Chat-Modell von StableLM zu chatten, das auf Hugging Face gehostet wird: https://huggingface.co/spaces/stabilityai/stablelm-tuned-alpha-chat

Wie alle großen Sprachmodelle leidet das StableLM-Modell immer noch unter dem „Illusions“-Problem. Wenn Sie versuchen, es zu fragen, wie man ein Erdnussbutter-Sandwich macht, wird StableLM ein sehr kompliziertes und lächerliches Rezept liefern. Außerdem wird den Leuten empfohlen, ihren Beileidskarten ein „lustiges Bild“ hinzuzufügen.

Stability AI warnt davor, dass der verwendete Datensatz zwar dazu beitragen sollte, „das zugrunde liegende Sprachmodell zu einer ‚sichereren‘ Textverteilung zu führen, aber nicht alle Verzerrungen und Toxizitäten durch Feinabstimmung gemildert werden können.“ Das StableLM-Modell ist jetzt live im GitHub-Repository. Stability AI kündigte an, in naher Zukunft einen vollständigen technischen Bericht zu veröffentlichen, außerdem eine Crowdsourcing-RLHF-Initiative zu starten und mit Communities wie Open Assistant zusammenzuarbeiten, um einen Open-Source-Datensatz für den KI-Chat-Assistenten zu erstellen.

Das obige ist der detaillierte Inhalt von„Das Open-Source-Sprachmodell eines beliebten KI-Zeichenunternehmens mit einem Mindestmaßstab von 3 Milliarden Parametern'. Für weitere Informationen folgen Sie bitte anderen verwandten Artikeln auf der PHP chinesischen Website!

PS Kanten-Tastenkombinationen anpassen

PS Kanten-Tastenkombinationen anpassen

So erstellen Sie eine Datenbank in MySQL

So erstellen Sie eine Datenbank in MySQL

Einführung in den Dateityp

Einführung in den Dateityp

Was führt dazu, dass der Computerbildschirm gelb wird?

Was führt dazu, dass der Computerbildschirm gelb wird?

Detaillierte Erläuterung des Ereignisses onbeforeunload

Detaillierte Erläuterung des Ereignisses onbeforeunload

So legen Sie die URL des tplink-Routers fest

So legen Sie die URL des tplink-Routers fest

Git macht den eingereichten Commit rückgängig

Git macht den eingereichten Commit rückgängig

Vorteile des Spring Boot Frameworks

Vorteile des Spring Boot Frameworks