Technologie-Peripheriegeräte

Technologie-Peripheriegeräte

KI

KI

ChatGPT Vergangenheit und Zukunft: Die Entwicklung von künstlicher Intelligenz und Datenschutz in der digitalen Kommunikation

ChatGPT Vergangenheit und Zukunft: Die Entwicklung von künstlicher Intelligenz und Datenschutz in der digitalen Kommunikation

ChatGPT Vergangenheit und Zukunft: Die Entwicklung von künstlicher Intelligenz und Datenschutz in der digitalen Kommunikation

Übersetzer |. Liu Tao

Rezensent |. Chonglou

Die Entwicklung der künstlichen Intelligenz hat uns in den letzten Jahren nicht gebracht Es gibt nur Chancen, aber auch Rückschläge. Einige große Durchbrüche haben das Internet revolutioniert, und viele davon sind zum Besseren.

Doch bevor die Leute Zeit hatten, sich auf die Veröffentlichung von OpenAIs ChatGPT vorzubereiten, hatte es bereits die ganze Welt im Sturm erobert. Es schafft die Fähigkeit, auf natürliche Weise mit Menschen zu sprechen und in sehr kurzer Zeit aufschlussreiche Antworten zu geben, was beispiellos ist.

Als immer mehr Menschen auf die Möglichkeiten von ChatGPT aufmerksam wurden, wurde allen visionären Führungskräften auf der ganzen Welt klar, dass von diesem Zeitpunkt an die digitale Kommunikationstechnologie Einzug halten wird revolutionäre Veränderungen. Aber Innovationen gehen oft mit Kontroversen einher, und in diesem Fall musste sich der Supernova-Chatbot mit Datenschutzproblemen für legitime Daten auseinandersetzen.

Die Entwicklung von ChatGPT erforderte eine umfangreiche Datenerfassung und aufgrund der Unfähigkeit von OpenAI, genau zu beschreiben, wie der Chatbot funktioniert, wie er Daten verarbeitet und speichert, Vordenker und die Privatsphäre der Regierung Aufsichtsbehörden haben Bedenken hinsichtlich der Daten geäußert. Es gibt auch wachsende Bedenken und Fragen zu Datenschutzpraktiken.

Das Problem ist von der Öffentlichkeit nicht unbemerkt geblieben: Laut einer Umfrage aus dem Jahr 2023 glauben 67 % der weltweiten Verbraucher, dass sie die Kontrolle über ihre Daten von Technologieunternehmen verlieren .

Die gleiche Umfrage ergab auch, dass 72,6 % der iOS-Apps private Benutzerdaten verfolgen, und bei kostenlosen Apps ist die Wahrscheinlichkeit, dass sie Benutzerdaten verfolgen, viermal höher als bei kostenpflichtigen Apps.

Wenn Sie darüber besorgt sind, denken Sie daran, dass die meisten Benutzer von ChatGPT immer noch die kostenlose Version verwenden.

Vor diesem Hintergrund müssen Datenschutzunternehmen die von ChatGPT generierten Ergebnisse voll ausnutzen, Produkte bereitstellen, die den Datenschutz verbessern, und eine Welt mit stärkeren Daten schaffen Transparenz und mehr Verantwortung, damit sich die Menschen ihrer Datenrechte und deren Nutzung bewusst sind, aber auch, damit diese bahnbrechenden KI-Technologien nicht auf unethische Taktiken angewiesen sind, um zu profitieren, wie es viele große Technologieunternehmen tun.

1. ChatGPT kennt Sie vielleicht schon

ChatGPT ist ein Large Language Model (LLM), was bedeutet, dass es viele Daten benötigt ordnungsgemäß funktioniert, kann es Informationen kohärent vorhersagen und verarbeiten.

Das heißt, wenn Sie jemals Artikel im Internet geschrieben haben, ist es sehr wahrscheinlich, dass ChatGPT diese Informationen gescannt und verarbeitet hat.

Darüber hinaus sind große Sprachmodelle (LLMs) wie ChatGPT stark auf große Datenmengen aus Online-Quellen wie E-Books, Artikeln und Social-Media-Beiträgen usw. angewiesen . um seinen Algorithmus zu trainieren. Dadurch können Benutzer damit authentische Antworten generieren, die scheinbar mit von Menschen geschriebenen Textnachrichten identisch sind.

Kurz gesagt, jeder Artikel, der im Internet veröffentlicht wurde, kann zum Trainieren von ChatGPT oder den Large Language Models (LLMs) seiner Konkurrenten verwendet werden. Diese LLMs werden definitiv folgen sobald ChatGPT erfolgreich ist.

Da OpenAI kürzlich zugab, dass Datenlecks durch Schwachstellen in Open-Source-Bibliotheken verursacht wurden, ist es nicht verwunderlich, dass Bedenken hinsichtlich Datenschutzproblemen bestehen. Darüber hinaus stellte ein Cybersicherheitsunternehmen fest, dass eine kürzlich hinzugefügte Komponente anfällig für eine aktiv ausgenutzte Sicherheitslücke war.

OpenAI führte eine Untersuchung durch und stellte fest, dass die durchgesickerten Daten die Titel des Chatverlaufs aktiver Benutzer und die erste Nachricht neu erstellter Konversationen enthielten.

Durch die Sicherheitslücke wurden auch die Zahlungsinformationen von 1,2 % der ChatGPT Plus-Benutzer offengelegt, darunter Vor- und Nachname, E-Mail-Adresse, Zahlungsadresse, Ablaufdatum der Zahlungskarte usw letzten vier Ziffern der Zahlungskartennummer.

Zu sagen, dass dies eine Datenschutzkatastrophe ist, ist eine Untertreibung. In ChatGPT stecken wahrscheinlich mehr Informationen als in jedem anderen Produkt auf der Welt, und nur wenige Monate nach der Veröffentlichung gelangen vertrauliche Informationen bereits an die Öffentlichkeit.

2. Was müssen ChatGPT-Benutzer tun?

Der Silberstreif am Horizont ist dieser: Die öffentliche Aufmerksamkeit auf die tatsächlichen Risiken zu lenken, die ChatGPT für die Privatsphäre mit sich bringt, könnte eine hervorragende Gelegenheit für Einzelpersonen sein, die Bedeutung des Datenschutzes zu verstehen. und tauchen Sie in weitere Details ein. Dies ist besonders wichtig angesichts der schnellen Erweiterung der ChatGPT-Benutzerbasis.

Neben der Umsetzung von Vorsichtsmaßnahmen und der Einhaltung von Wachsamkeit müssen Benutzer auch ihre Rechte als betroffene Person (Data Subject Rights, DSR) wahrnehmen, zu denen auch die Wahrung ihres Rechts auf Zugriff, Bearbeitung und Zugriff gehört Persönliche Daten löschen.

Im digitalen Zeitalter muss sich jeder Benutzer für eine Verschärfung der Datenschutzbestimmungen einsetzen, damit er eine bessere Kontrolle über seine persönlichen Daten hat und größtmögliche Verantwortung gewährleisten kann. Nutzen Sie dies Information.

ChatGPT scheint darauf reagiert zu haben, da neue Sitzungen nun dazu auffordern, sensible Daten oder Firmengeheimnisse nicht einzugeben, da diese im System nicht sicher sind.

Samsung hat festgestellt, dass dies immer noch schwierig ist und mehr Menschen bei der Verwendung von ChatGPT-Eingabeaufforderungen aufmerksam und vorsichtig sein müssen.

Dinge wie die Verwendung eines neuen ChatGPT-Plugins zum Einkaufen mögen harmlos erscheinen, aber möchten Sie wirklich eine unsichere digitale Aufzeichnung darüber, wer Sie jemals gegessen haben? das Internet?

Bis diese Datenschutzbedenken ausgeräumt sind, müssen wir als Öffentlichkeit langsamer werden und dürfen uns nicht zu sehr auf die Hektik neuer KI-Technologien einlassen.

3. Was muss das Unternehmen tun?

Es versteht sich von selbst: Wenn sich Nutzer dazu verpflichten, Transaktionen abzubrechen, müssen Unternehmen die Verantwortung für unangemessene Datennutzung und Datenschutzpraktiken übernehmen.

Daher sollten große und kleine Unternehmen transparente und leicht verständliche Protokolle fördern, damit Einzelpersonen klar verstehen, wie ihre Daten verwendet werden und wohin sie gehen, sowie alle Drittunternehmen, die möglicherweise Zugriff auf diese Daten haben .

Darüber hinaus sollten Unternehmensleiter den Benutzern klare Möglichkeiten zur Ausübung ihrer Rechte als betroffene Person (Data Subjektrechte, DSR) bieten und die Mitarbeiter dazu erziehen, ethische Richtlinien für die Datenverarbeitung und -speicherung einzuhalten.

Von diesem Ziel sind wir noch weit entfernt, da sich die meisten Standardberechtigungen immer noch in einer regulatorischen Grauzone befinden, da sie nicht eindeutig auf die Notwendigkeit hinweisen, sich abzumelden oder anzumelden, je nachdem, wo sich der Benutzer und das Unternehmen befinden.

Transparenz, Klarheit und Verantwortlichkeit sollten im Vordergrund der Überlegungen jedes Unternehmens stehen, wenn es um den Datenschutz geht.

Der Aufstieg von ChatGPT hat eine neue Ära der Datenschutzüberwachung eingeläutet, in der Organisationen und Einzelpersonen gleichermaßen proaktiv sein müssen, um sicherzustellen, dass Daten angemessen gehandhabt werden, um Verstöße und Missbrauch zu vermeiden.

ChatGPT sammelt mehr Daten schneller als jedes andere Unternehmen in der Geschichte, und wenn die Sicherheit schief geht, werden die Auswirkungen auf den Datenschutz beispiellos sein.

Wenn Unternehmen sicherstellen wollen, dass sie sich potenzieller Probleme wirklich bewusst sind, müssen sie damit beginnen, Daten strategischer zu schützen und das Vertrauen der Verbraucher in das Internet aufzubauen. Andernfalls ist eine bessere gemeinsame digitale Zukunft in großer Gefahr.

Originallink: https://hackernoon.com/the-evolution-of-ai-and-data-privacy-how-chatgpt-is-shaping-the-future-of-digital-communication

Einführung des Übersetzers:

Liu Tao, 51CTO-Community-Redakteur, verantwortlich für die Erkennung und Kontrolle von Systemstarts bei einem großen Zentralunternehmen.

Das obige ist der detaillierte Inhalt vonChatGPT Vergangenheit und Zukunft: Die Entwicklung von künstlicher Intelligenz und Datenschutz in der digitalen Kommunikation. Für weitere Informationen folgen Sie bitte anderen verwandten Artikeln auf der PHP chinesischen Website!

Heiße KI -Werkzeuge

Undresser.AI Undress

KI-gestützte App zum Erstellen realistischer Aktfotos

AI Clothes Remover

Online-KI-Tool zum Entfernen von Kleidung aus Fotos.

Undress AI Tool

Ausziehbilder kostenlos

Clothoff.io

KI-Kleiderentferner

AI Hentai Generator

Erstellen Sie kostenlos Ai Hentai.

Heißer Artikel

Heiße Werkzeuge

Notepad++7.3.1

Einfach zu bedienender und kostenloser Code-Editor

SublimeText3 chinesische Version

Chinesische Version, sehr einfach zu bedienen

Senden Sie Studio 13.0.1

Leistungsstarke integrierte PHP-Entwicklungsumgebung

Dreamweaver CS6

Visuelle Webentwicklungstools

SublimeText3 Mac-Version

Codebearbeitungssoftware auf Gottesniveau (SublimeText3)

Heiße Themen

1376

1376

52

52

Mit ChatGPT können kostenlose Benutzer jetzt Bilder mithilfe von DALL-E 3 mit einem Tageslimit generieren

Aug 09, 2024 pm 09:37 PM

Mit ChatGPT können kostenlose Benutzer jetzt Bilder mithilfe von DALL-E 3 mit einem Tageslimit generieren

Aug 09, 2024 pm 09:37 PM

DALL-E 3 wurde im September 2023 offiziell als deutlich verbessertes Modell gegenüber seinem Vorgänger eingeführt. Er gilt als einer der bisher besten KI-Bildgeneratoren und ist in der Lage, Bilder mit komplexen Details zu erstellen. Zum Start war es jedoch exklusiv

Wählen Sie das Einbettungsmodell, das am besten zu Ihren Daten passt: Ein Vergleichstest von OpenAI und mehrsprachigen Open-Source-Einbettungen

Feb 26, 2024 pm 06:10 PM

Wählen Sie das Einbettungsmodell, das am besten zu Ihren Daten passt: Ein Vergleichstest von OpenAI und mehrsprachigen Open-Source-Einbettungen

Feb 26, 2024 pm 06:10 PM

OpenAI kündigte kürzlich die Einführung seines Einbettungsmodells embeddingv3 der neuesten Generation an, das seiner Meinung nach das leistungsstärkste Einbettungsmodell mit höherer Mehrsprachenleistung ist. Diese Reihe von Modellen ist in zwei Typen unterteilt: das kleinere Text-Embeddings-3-Small und das leistungsfähigere und größere Text-Embeddings-3-Large. Es werden nur wenige Informationen darüber offengelegt, wie diese Modelle entworfen und trainiert werden, und auf die Modelle kann nur über kostenpflichtige APIs zugegriffen werden. Es gab also viele Open-Source-Einbettungsmodelle. Aber wie schneiden diese Open-Source-Modelle im Vergleich zum Closed-Source-Modell von OpenAI ab? In diesem Artikel wird die Leistung dieser neuen Modelle empirisch mit Open-Source-Modellen verglichen. Wir planen, Daten zu erstellen

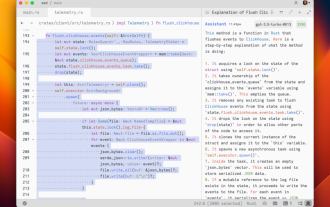

Ein neues Programmierparadigma, wenn Spring Boot auf OpenAI trifft

Feb 01, 2024 pm 09:18 PM

Ein neues Programmierparadigma, wenn Spring Boot auf OpenAI trifft

Feb 01, 2024 pm 09:18 PM

Im Jahr 2023 ist die KI-Technologie zu einem heißen Thema geworden und hat enorme Auswirkungen auf verschiedene Branchen, insbesondere im Programmierbereich. Die Bedeutung der KI-Technologie wird den Menschen zunehmend bewusst, und die Spring-Community bildet da keine Ausnahme. Mit der kontinuierlichen Weiterentwicklung der GenAI-Technologie (General Artificial Intelligence) ist es entscheidend und dringend geworden, die Erstellung von Anwendungen mit KI-Funktionen zu vereinfachen. Vor diesem Hintergrund entstand „SpringAI“ mit dem Ziel, den Prozess der Entwicklung von KI-Funktionsanwendungen zu vereinfachen, ihn einfach und intuitiv zu gestalten und unnötige Komplexität zu vermeiden. Durch „SpringAI“ können Entwickler einfacher Anwendungen mit KI-Funktionen erstellen, wodurch diese einfacher zu verwenden und zu bedienen sind.

So installieren Sie ChatGPT auf einem Mobiltelefon

Mar 05, 2024 pm 02:31 PM

So installieren Sie ChatGPT auf einem Mobiltelefon

Mar 05, 2024 pm 02:31 PM

Installationsschritte: 1. Laden Sie die ChatGTP-Software von der offiziellen ChatGTP-Website oder dem mobilen Store herunter. 2. Wählen Sie nach dem Öffnen in der Einstellungsoberfläche die Sprache aus. 3. Wählen Sie in der Spieloberfläche das Mensch-Maschine-Spiel aus 4. Geben Sie nach dem Start Befehle in das Chatfenster ein, um mit der Software zu interagieren.

Posthume Arbeit des OpenAI Super Alignment Teams: Zwei große Modelle spielen ein Spiel und die Ausgabe wird verständlicher

Jul 19, 2024 am 01:29 AM

Posthume Arbeit des OpenAI Super Alignment Teams: Zwei große Modelle spielen ein Spiel und die Ausgabe wird verständlicher

Jul 19, 2024 am 01:29 AM

Wenn die Antwort des KI-Modells überhaupt unverständlich ist, würden Sie es wagen, sie zu verwenden? Da maschinelle Lernsysteme in immer wichtigeren Bereichen eingesetzt werden, wird es immer wichtiger zu zeigen, warum wir ihren Ergebnissen vertrauen können und wann wir ihnen nicht vertrauen sollten. Eine Möglichkeit, Vertrauen in die Ausgabe eines komplexen Systems zu gewinnen, besteht darin, vom System zu verlangen, dass es eine Interpretation seiner Ausgabe erstellt, die für einen Menschen oder ein anderes vertrauenswürdiges System lesbar ist, d. h. so vollständig verständlich, dass mögliche Fehler erkannt werden können gefunden. Um beispielsweise Vertrauen in das Justizsystem aufzubauen, verlangen wir von den Gerichten, dass sie klare und lesbare schriftliche Stellungnahmen abgeben, die ihre Entscheidungen erläutern und stützen. Für große Sprachmodelle können wir auch einen ähnlichen Ansatz verfolgen. Stellen Sie bei diesem Ansatz jedoch sicher, dass das Sprachmodell generiert wird

Der Rust-basierte Zed-Editor ist Open Source und bietet integrierte Unterstützung für OpenAI und GitHub Copilot

Feb 01, 2024 pm 02:51 PM

Der Rust-basierte Zed-Editor ist Open Source und bietet integrierte Unterstützung für OpenAI und GitHub Copilot

Feb 01, 2024 pm 02:51 PM

Autor丨Zusammengestellt von TimAnderson丨Produziert von Noah|51CTO Technology Stack (WeChat-ID: blog51cto) Das Zed-Editor-Projekt befindet sich noch in der Vorabversionsphase und wurde unter AGPL-, GPL- und Apache-Lizenzen als Open Source bereitgestellt. Der Editor zeichnet sich durch hohe Leistung und mehrere KI-gestützte Optionen aus, ist jedoch derzeit nur auf der Mac-Plattform verfügbar. Nathan Sobo erklärte in einem Beitrag, dass in der Codebasis des Zed-Projekts auf GitHub der Editor-Teil unter der GPL lizenziert ist, die serverseitigen Komponenten unter der AGPL lizenziert sind und der GPUI-Teil (GPU Accelerated User) die Schnittstelle übernimmt Apache2.0-Lizenz. GPUI ist ein vom Zed-Team entwickeltes Produkt

Warten Sie nicht auf OpenAI, sondern darauf, dass Open-Sora vollständig Open Source ist

Mar 18, 2024 pm 08:40 PM

Warten Sie nicht auf OpenAI, sondern darauf, dass Open-Sora vollständig Open Source ist

Mar 18, 2024 pm 08:40 PM

Vor nicht allzu langer Zeit wurde OpenAISora mit seinen erstaunlichen Videogenerierungseffekten schnell populär und stach aus der Masse der literarischen Videomodelle hervor und rückte in den Mittelpunkt der weltweiten Aufmerksamkeit. Nach der Einführung des Sora-Trainings-Inferenzreproduktionsprozesses mit einer Kostenreduzierung von 46 % vor zwei Wochen hat das Colossal-AI-Team das weltweit erste Sora-ähnliche Architektur-Videogenerierungsmodell „Open-Sora1.0“ vollständig als Open-Source-Lösung bereitgestellt, das das gesamte Spektrum abdeckt Lernen Sie den Trainingsprozess, einschließlich der Datenverarbeitung, aller Trainingsdetails und Modellgewichte, kennen und schließen Sie sich mit globalen KI-Enthusiasten zusammen, um eine neue Ära der Videoerstellung voranzutreiben. Schauen wir uns für einen kleinen Vorgeschmack ein Video einer geschäftigen Stadt an, das mit dem vom Colossal-AI-Team veröffentlichten Modell „Open-Sora1.0“ erstellt wurde. Open-Sora1.0

Die lokale Ausführungsleistung des Embedding-Dienstes übertrifft die von OpenAI Text-Embedding-Ada-002, was sehr praktisch ist!

Apr 15, 2024 am 09:01 AM

Die lokale Ausführungsleistung des Embedding-Dienstes übertrifft die von OpenAI Text-Embedding-Ada-002, was sehr praktisch ist!

Apr 15, 2024 am 09:01 AM

Ollama ist ein superpraktisches Tool, mit dem Sie Open-Source-Modelle wie Llama2, Mistral und Gemma problemlos lokal ausführen können. In diesem Artikel werde ich vorstellen, wie man Ollama zum Vektorisieren von Text verwendet. Wenn Sie Ollama nicht lokal installiert haben, können Sie diesen Artikel lesen. In diesem Artikel verwenden wir das Modell nomic-embed-text[2]. Es handelt sich um einen Text-Encoder, der OpenAI text-embedding-ada-002 und text-embedding-3-small bei kurzen und langen Kontextaufgaben übertrifft. Starten Sie den nomic-embed-text-Dienst, wenn Sie o erfolgreich installiert haben