Technologie-Peripheriegeräte

Technologie-Peripheriegeräte

KI

KI

Italien ist das erste Land, das ChatGPT verbietet! CEO von OpenAI: Ich glaube nicht, dass es einen Verstoß gibt

Italien ist das erste Land, das ChatGPT verbietet! CEO von OpenAI: Ich glaube nicht, dass es einen Verstoß gibt

Italien ist das erste Land, das ChatGPT verbietet! CEO von OpenAI: Ich glaube nicht, dass es einen Verstoß gibt

Erst gestern hat die italienische Regierung plötzlich ein Verbot von ChatGPT angeordnet!

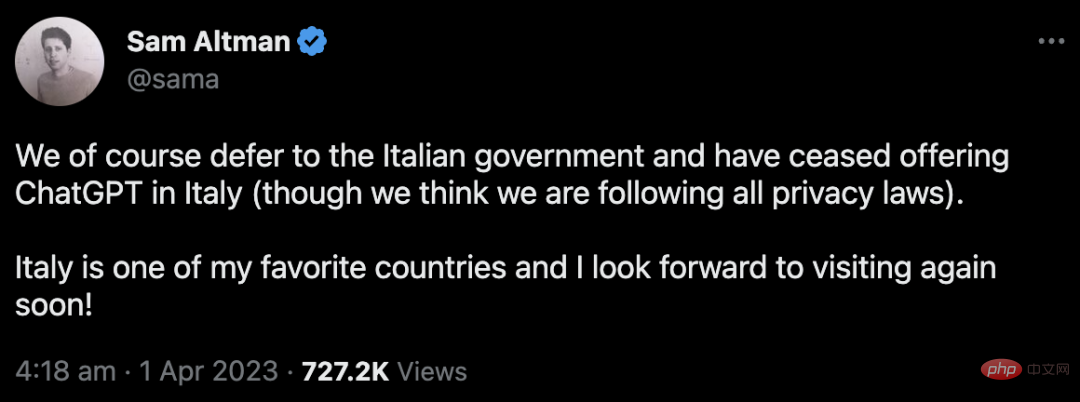

Bald antwortete Sam Altman, CEO von OpenAI, dass das Unternehmen den lokalen ChatGPT-Dienst geschlossen habe (aber davon ausgegangen sei, dass er gegen keine Vorschriften verstoßen habe).

Seitdem hat Italien als erstes Land der Welt das Verbot von ChatGPT bekannt gegeben.

(ChatGPT kann in anderen Ländern und Regionen nicht verwendet werden, da OpenAI es nicht von Anfang an geöffnet hat.)

Italien hat ChatGPT verboten und Datenschutzprobleme umfassend untersucht

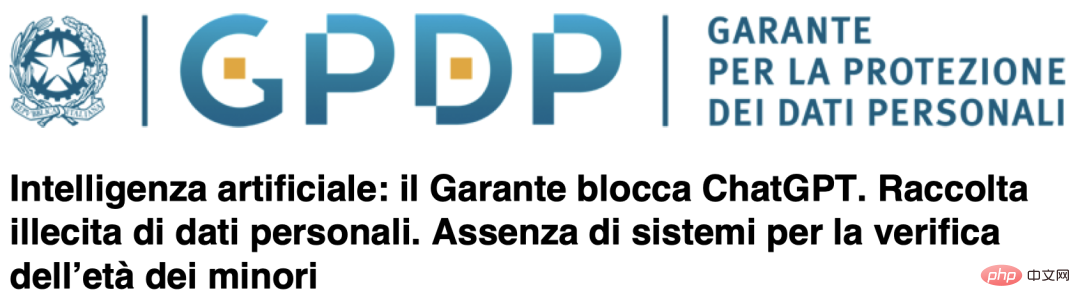

Am 31. März ordnete die nationale Datenschutzbehörde Italiens offiziell an ChatGPT verboten und OpenAI der „illegalen Erhebung personenbezogener Daten“ beschuldigt.

Es ist erwähnenswert, dass dieses „vorübergehende Verbot“ in Kraft bleibt, bis OpenAI das wegweisende Datenschutzgesetz der Europäischen Union, die Datenschutz-Grundverordnung (DSGVO), einhalten kann.

Dateiadresse: https://www.garanteprivacy.it/home/docweb/-/docweb-display/docweb/9870847#english

Nachrichten veröffentlicht gemäß den italienischen Nationaldaten Schutzbehörde GPDP Dem Entwurf zufolge entbehrt das Verhalten von OpenAI, Nutzerdaten zu sammeln und diese für das „Training“ von Algorithmen zu nutzen, einer rechtlichen Grundlage.

Gleichzeitig hat die Weitergabe von Benutzerkonversationen und Zahlungsinformationen am 20. März auch die Probleme von OpenAI beim Umgang mit personenbezogenen Daten deutlich gemacht.

Obwohl OpenAI behauptet, dass ChatGPT sich an Benutzer über 13 Jahre richtet, ist es aufgrund des Fehlens eines entsprechenden Mechanismus zur Altersüberprüfung wahrscheinlich, dass Minderjährige Inhalte sehen, die über ihren eigenen Entwicklungs- und Selbstbewusstseinsstand hinausgehen .

Die Regulierungsbehörde gab an, dass OpenAI 20 Tage Zeit hat, um praktikable Abhilfemaßnahmen zu ergreifen, und mit einer Geldstrafe von bis zu 20 Millionen Euro oder 4 % des gesamten weltweiten Jahresumsatzes rechnen muss.

Als Antwort erklärte OpenAI, dass es den Dienst nun für italienische Benutzer geschlossen habe und versprach, die Privatsphäre der Benutzer zu schützen:

„Wir haben hart daran gearbeitet, personenbezogene Daten beim Training von Systemen wie ChatGPT zu reduzieren, weil wir Wir wollen, dass diese KI die Welt versteht, nicht Einzelpersonen. Natürlich glauben wir auch, dass die KI-Überwachung notwendig ist. „

Es scheint, dass das zukünftige Schicksal von ChatGPT in Italien von diesen 20 Tagen abhängen könnte.

Es ist jedoch nicht das erste Mal, dass Italien solche Maßnahmen gegen KI-Chatbots ergreift.

Im Februar haben die Aufsichtsbehörden die Chatbot-App Replika.ai verboten. Replika war „berüchtigt“ für die intimen Beziehungen einiger Benutzer zu Robotern. Später entfernte Replika die Option für pornografisches Rollenspiel und einige Benutzer benötigten sogar Hilfe von einer Selbstmord-Hotline.

Sollten KI-Tools eingeschränkt werden?

Nach der Veröffentlichung von ChatGPT ist die Fähigkeit, Papiere und Code zu schreiben, zwar umwerfend, aber die Verbreitung von Fehlinformationen, die Auswirkungen auf die Beschäftigung und allgemeinere Risiken für die gesamte menschliche Gesellschaft haben viele Menschen beunruhigt und frühzeitig gewarnt.

In letzter Zeit kam es zu Wellen von Verboten der GPT-Technologie.

Nicht nur der Turing-Award-Gewinner Yoshua Bengio, Musk, Marcus und andere tausende große Namen haben einen offenen Brief unterzeichnet, in dem sie alle KI-Labore auf der ganzen Welt auffordern, das Training von KI-Modellen einzustellen, die leistungsfähiger als GPT-4 sind.

Darüber hinaus hat auch die Verbraucherschutzorganisation BEUC kürzlich die EU und die nationalen Behörden aufgefordert, ChatGPT zu untersuchen.

Darüber hinaus haben viele Experten auch erklärt, dass aufgrund ihrer möglichen Auswirkungen auf die nationale Sicherheit, Beschäftigung und Bildung neue Vorschriften für den Umgang mit KI erforderlich sind.

Ein Sprecher der Europäischen Kommission sagte: „Wir hoffen, dass alle in der EU tätigen Unternehmen die Datenschutzbestimmungen der EU respektieren. Die Durchsetzung der Datenschutz-Grundverordnung liegt in der Verantwortung der EU-Datenschutzbehörden.“ " #🎜 🎜#

Exekutivvizepräsidentin der Europäischen Kommission, Margrethe Vestager, sagte auf Twitter, dass die Kommission, die über das EU-Gesetz über künstliche Intelligenz diskutiert, möglicherweise nicht geneigt ist, künstliche Intelligenz zu verbieten.

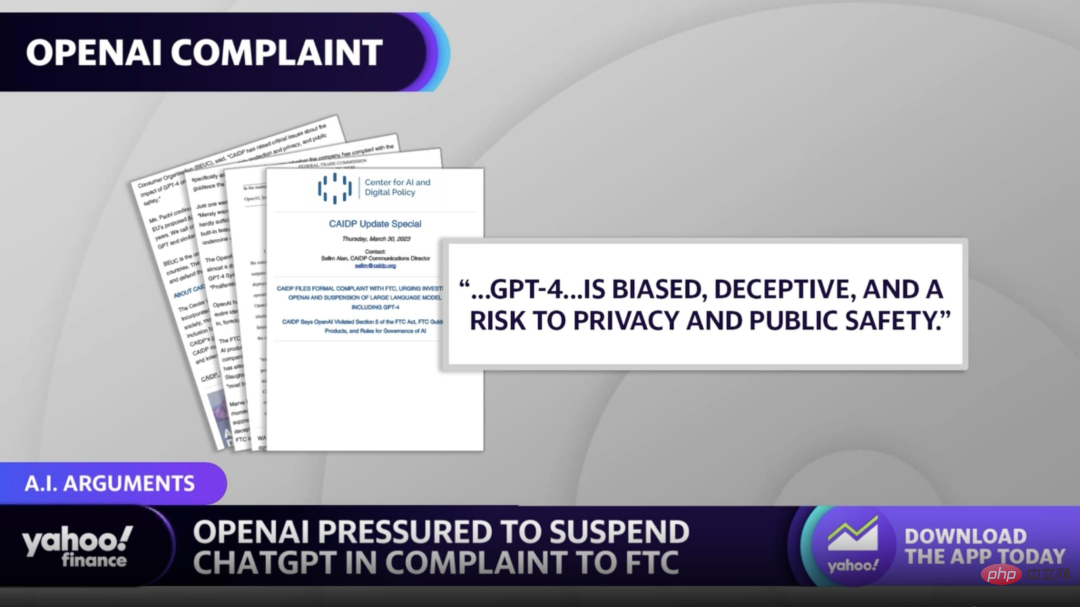

„Egal welche Technologie wir nutzen, wir müssen unsere eigenen Rechte schützen. Deshalb regulieren wir nicht die KI-Technologie, sondern den Einsatz von KI.“ 🎜 In den Vereinigten Staaten hat die gemeinnützige Organisation Center for Artificial Intelligence and Digital Policy (CAIDP) außerdem die Federal Trade Commission (FTC) gebeten, zu untersuchen, ob OpenAI gegen Verbraucherschutzbestimmungen verstößt und ihr die weitere Veröffentlichung von GPT-4 untersagt.

Letztendlich erscheint die Berufung von CAIDP angesichts des Präzedenzfalls eines gemeinsamen Briefs von Tausenden von großen Leuten logischer. Darüber hinaus unterzeichnete CAIDP-Vorsitzender Marc Rotenberg den Brief überraschend.

Dateiadresse: https://cdn.arstechnica.net/wp-content/uploads /2023/03/CAIDP-FTC-Complaint-OpenAI-GPT-033023.pdf

CAIDP ist jedoch weiterhin davon überzeugt, dass ChatGPT „voreingenommen und irreführend ist und ein Risiko für die öffentliche Sicherheit darstellt“.

Obwohl OpenAI öffentlich auf die potenziellen Bedrohungen durch KI-generierten Text hingewiesen hat, ist CAIDP der Ansicht, dass GPT-4 weit über die Grenze hinausgegangen ist und daher reguliert werden sollte Maßnahmen zum Schutz der Verbraucher.

CAIDP gab an, dass das GPT-4-Modell viele erhebliche potenzielle Bedrohungen birgt, beispielsweise die Art und Weise, wie GPT-4 bösartigen Code generieren kann und die Art und Weise, wie es Propaganda stark anpasst, und Es ist voreingenommen. Schulungsdaten können zu Stereotypen oder unfairen Rassen- und Geschlechtspräferenzen in Bereichen wie der Einstellung führen.

CAIDP ist der Ansicht, dass die Handlungen von OpenAI gegen Abschnitt 5 des FTC-Gesetzes verstoßen, der unfaire und irreführende Handelspraktiken verbietet.

Darunter sind die Illusion des KI-Modells und der Unsinn aus Sicht von CAIDP allesamt Täuschung. Es warnte ChatGPT vor der „Förderung irreführender Geschäftsaussagen und Werbung“, die in den Zuständigkeitsbereich der FTC fallen könnten. In der Beschwerde forderte CAIDP die FTC auf, alle weiteren kommerziellen Einsätze des GPT-Modells zu stoppen und jede künftige Einführung zu verlangen. Vor der Modellierung muss das Modell unabhängig evaluiert werden. Außerdem wird ein öffentlich zugängliches Meldetool gefordert, ähnlich dem, mit dem Verbraucher Betrugsbeschwerden einreichen können.

CAIDP sucht nach Anzeichen dafür, dass große Technologieunternehmen versuchen, den Wettbewerb zu monopolisieren, und eine Untersuchung von OpenAI, einem der Hauptakteure im KI-Wettrüsten, gerät ins Stocken stellt eine wesentliche Verbesserung der Untersuchung dar.

Einige Analysten glauben, dass die Beschwerde der CAIDP die FTC zwar nicht dazu veranlassen wird, kurzfristig Maßnahmen zu ergreifen, eine entsprechende Aufsicht jedoch wahrscheinlich in der Zukunft erfolgen wird und dazu führen kann Die Veröffentlichung von GPT-5 verzögert sich.

Abschließend lässt sich nur sagen, dass das „Reputationsrisiko“, über das sich Google Sorgen gemacht hat, endlich angekommen ist.

Abschließend lässt sich nur sagen, dass das „Reputationsrisiko“, über das sich Google Sorgen gemacht hat, endlich angekommen ist.

Referenz:

# 🎜 🎜#

https://www.php.cn/link/d35a29602005cb55aa57a5f683c8e0c2

#🎜 🎜# #🎜🎜 #Das obige ist der detaillierte Inhalt vonItalien ist das erste Land, das ChatGPT verbietet! CEO von OpenAI: Ich glaube nicht, dass es einen Verstoß gibt. Für weitere Informationen folgen Sie bitte anderen verwandten Artikeln auf der PHP chinesischen Website!

Heiße KI -Werkzeuge

Undresser.AI Undress

KI-gestützte App zum Erstellen realistischer Aktfotos

AI Clothes Remover

Online-KI-Tool zum Entfernen von Kleidung aus Fotos.

Undress AI Tool

Ausziehbilder kostenlos

Clothoff.io

KI-Kleiderentferner

AI Hentai Generator

Erstellen Sie kostenlos Ai Hentai.

Heißer Artikel

Heiße Werkzeuge

Notepad++7.3.1

Einfach zu bedienender und kostenloser Code-Editor

SublimeText3 chinesische Version

Chinesische Version, sehr einfach zu bedienen

Senden Sie Studio 13.0.1

Leistungsstarke integrierte PHP-Entwicklungsumgebung

Dreamweaver CS6

Visuelle Webentwicklungstools

SublimeText3 Mac-Version

Codebearbeitungssoftware auf Gottesniveau (SublimeText3)

Heiße Themen

1377

1377

52

52

Mit ChatGPT können kostenlose Benutzer jetzt Bilder mithilfe von DALL-E 3 mit einem Tageslimit generieren

Aug 09, 2024 pm 09:37 PM

Mit ChatGPT können kostenlose Benutzer jetzt Bilder mithilfe von DALL-E 3 mit einem Tageslimit generieren

Aug 09, 2024 pm 09:37 PM

DALL-E 3 wurde im September 2023 offiziell als deutlich verbessertes Modell gegenüber seinem Vorgänger eingeführt. Er gilt als einer der bisher besten KI-Bildgeneratoren und ist in der Lage, Bilder mit komplexen Details zu erstellen. Zum Start war es jedoch exklusiv

Wählen Sie das Einbettungsmodell, das am besten zu Ihren Daten passt: Ein Vergleichstest von OpenAI und mehrsprachigen Open-Source-Einbettungen

Feb 26, 2024 pm 06:10 PM

Wählen Sie das Einbettungsmodell, das am besten zu Ihren Daten passt: Ein Vergleichstest von OpenAI und mehrsprachigen Open-Source-Einbettungen

Feb 26, 2024 pm 06:10 PM

OpenAI kündigte kürzlich die Einführung seines Einbettungsmodells embeddingv3 der neuesten Generation an, das seiner Meinung nach das leistungsstärkste Einbettungsmodell mit höherer Mehrsprachenleistung ist. Diese Reihe von Modellen ist in zwei Typen unterteilt: das kleinere Text-Embeddings-3-Small und das leistungsfähigere und größere Text-Embeddings-3-Large. Es werden nur wenige Informationen darüber offengelegt, wie diese Modelle entworfen und trainiert werden, und auf die Modelle kann nur über kostenpflichtige APIs zugegriffen werden. Es gab also viele Open-Source-Einbettungsmodelle. Aber wie schneiden diese Open-Source-Modelle im Vergleich zum Closed-Source-Modell von OpenAI ab? In diesem Artikel wird die Leistung dieser neuen Modelle empirisch mit Open-Source-Modellen verglichen. Wir planen, Daten zu erstellen

Ein neues Programmierparadigma, wenn Spring Boot auf OpenAI trifft

Feb 01, 2024 pm 09:18 PM

Ein neues Programmierparadigma, wenn Spring Boot auf OpenAI trifft

Feb 01, 2024 pm 09:18 PM

Im Jahr 2023 ist die KI-Technologie zu einem heißen Thema geworden und hat enorme Auswirkungen auf verschiedene Branchen, insbesondere im Programmierbereich. Die Bedeutung der KI-Technologie wird den Menschen zunehmend bewusst, und die Spring-Community bildet da keine Ausnahme. Mit der kontinuierlichen Weiterentwicklung der GenAI-Technologie (General Artificial Intelligence) ist es entscheidend und dringend geworden, die Erstellung von Anwendungen mit KI-Funktionen zu vereinfachen. Vor diesem Hintergrund entstand „SpringAI“ mit dem Ziel, den Prozess der Entwicklung von KI-Funktionsanwendungen zu vereinfachen, ihn einfach und intuitiv zu gestalten und unnötige Komplexität zu vermeiden. Durch „SpringAI“ können Entwickler einfacher Anwendungen mit KI-Funktionen erstellen, wodurch diese einfacher zu verwenden und zu bedienen sind.

So installieren Sie ChatGPT auf einem Mobiltelefon

Mar 05, 2024 pm 02:31 PM

So installieren Sie ChatGPT auf einem Mobiltelefon

Mar 05, 2024 pm 02:31 PM

Installationsschritte: 1. Laden Sie die ChatGTP-Software von der offiziellen ChatGTP-Website oder dem mobilen Store herunter. 2. Wählen Sie nach dem Öffnen in der Einstellungsoberfläche die Sprache aus. 3. Wählen Sie in der Spieloberfläche das Mensch-Maschine-Spiel aus 4. Geben Sie nach dem Start Befehle in das Chatfenster ein, um mit der Software zu interagieren.

Posthume Arbeit des OpenAI Super Alignment Teams: Zwei große Modelle spielen ein Spiel und die Ausgabe wird verständlicher

Jul 19, 2024 am 01:29 AM

Posthume Arbeit des OpenAI Super Alignment Teams: Zwei große Modelle spielen ein Spiel und die Ausgabe wird verständlicher

Jul 19, 2024 am 01:29 AM

Wenn die Antwort des KI-Modells überhaupt unverständlich ist, würden Sie es wagen, sie zu verwenden? Da maschinelle Lernsysteme in immer wichtigeren Bereichen eingesetzt werden, wird es immer wichtiger zu zeigen, warum wir ihren Ergebnissen vertrauen können und wann wir ihnen nicht vertrauen sollten. Eine Möglichkeit, Vertrauen in die Ausgabe eines komplexen Systems zu gewinnen, besteht darin, vom System zu verlangen, dass es eine Interpretation seiner Ausgabe erstellt, die für einen Menschen oder ein anderes vertrauenswürdiges System lesbar ist, d. h. so vollständig verständlich, dass mögliche Fehler erkannt werden können gefunden. Um beispielsweise Vertrauen in das Justizsystem aufzubauen, verlangen wir von den Gerichten, dass sie klare und lesbare schriftliche Stellungnahmen abgeben, die ihre Entscheidungen erläutern und stützen. Für große Sprachmodelle können wir auch einen ähnlichen Ansatz verfolgen. Stellen Sie bei diesem Ansatz jedoch sicher, dass das Sprachmodell generiert wird

Der Rust-basierte Zed-Editor ist Open Source und bietet integrierte Unterstützung für OpenAI und GitHub Copilot

Feb 01, 2024 pm 02:51 PM

Der Rust-basierte Zed-Editor ist Open Source und bietet integrierte Unterstützung für OpenAI und GitHub Copilot

Feb 01, 2024 pm 02:51 PM

Autor丨Zusammengestellt von TimAnderson丨Produziert von Noah|51CTO Technology Stack (WeChat-ID: blog51cto) Das Zed-Editor-Projekt befindet sich noch in der Vorabversionsphase und wurde unter AGPL-, GPL- und Apache-Lizenzen als Open Source bereitgestellt. Der Editor zeichnet sich durch hohe Leistung und mehrere KI-gestützte Optionen aus, ist jedoch derzeit nur auf der Mac-Plattform verfügbar. Nathan Sobo erklärte in einem Beitrag, dass in der Codebasis des Zed-Projekts auf GitHub der Editor-Teil unter der GPL lizenziert ist, die serverseitigen Komponenten unter der AGPL lizenziert sind und der GPUI-Teil (GPU Accelerated User) die Schnittstelle übernimmt Apache2.0-Lizenz. GPUI ist ein vom Zed-Team entwickeltes Produkt

Warten Sie nicht auf OpenAI, sondern darauf, dass Open-Sora vollständig Open Source ist

Mar 18, 2024 pm 08:40 PM

Warten Sie nicht auf OpenAI, sondern darauf, dass Open-Sora vollständig Open Source ist

Mar 18, 2024 pm 08:40 PM

Vor nicht allzu langer Zeit wurde OpenAISora mit seinen erstaunlichen Videogenerierungseffekten schnell populär und stach aus der Masse der literarischen Videomodelle hervor und rückte in den Mittelpunkt der weltweiten Aufmerksamkeit. Nach der Einführung des Sora-Trainings-Inferenzreproduktionsprozesses mit einer Kostenreduzierung von 46 % vor zwei Wochen hat das Colossal-AI-Team das weltweit erste Sora-ähnliche Architektur-Videogenerierungsmodell „Open-Sora1.0“ vollständig als Open-Source-Lösung bereitgestellt, das das gesamte Spektrum abdeckt Lernen Sie den Trainingsprozess, einschließlich der Datenverarbeitung, aller Trainingsdetails und Modellgewichte, kennen und schließen Sie sich mit globalen KI-Enthusiasten zusammen, um eine neue Ära der Videoerstellung voranzutreiben. Schauen wir uns für einen kleinen Vorgeschmack ein Video einer geschäftigen Stadt an, das mit dem vom Colossal-AI-Team veröffentlichten Modell „Open-Sora1.0“ erstellt wurde. Open-Sora1.0

Microsoft und OpenAI planen, 100 Millionen US-Dollar in humanoide Roboter zu investieren! Internetnutzer rufen Musk an

Feb 01, 2024 am 11:18 AM

Microsoft und OpenAI planen, 100 Millionen US-Dollar in humanoide Roboter zu investieren! Internetnutzer rufen Musk an

Feb 01, 2024 am 11:18 AM

Anfang des Jahres wurde bekannt, dass Microsoft und OpenAI große Geldsummen in ein Startup für humanoide Roboter investieren. Unter anderem plant Microsoft, 95 Millionen US-Dollar zu investieren, und OpenAI wird 5 Millionen US-Dollar investieren. Laut Bloomberg wird das Unternehmen in dieser Runde voraussichtlich insgesamt 500 Millionen US-Dollar einsammeln, und seine Pre-Money-Bewertung könnte 1,9 Milliarden US-Dollar erreichen. Was zieht sie an? Werfen wir zunächst einen Blick auf die Robotik-Erfolge dieses Unternehmens. Dieser Roboter ist ganz in Silber und Schwarz gehalten und ähnelt in seinem Aussehen dem Abbild eines Roboters in einem Hollywood-Science-Fiction-Blockbuster: Jetzt steckt er eine Kaffeekapsel in die Kaffeemaschine: Wenn sie nicht richtig platziert ist, passt sie sich von selbst an menschliche Fernbedienung: Nach einer Weile kann jedoch eine Tasse Kaffee mitgenommen und genossen werden: Haben Sie Familienmitglieder, die es erkannt haben? Ja, dieser Roboter wurde vor einiger Zeit erstellt.