Technologie-Peripheriegeräte

Technologie-Peripheriegeräte

KI

KI

Mithilfe der Quantenverschränkung als GPS kann eine präzise Positionierung auch in Bereichen ohne Signal erreicht werden

Mithilfe der Quantenverschränkung als GPS kann eine präzise Positionierung auch in Bereichen ohne Signal erreicht werden

Mithilfe der Quantenverschränkung als GPS kann eine präzise Positionierung auch in Bereichen ohne Signal erreicht werden

Quantenverschränkung bezieht sich auf ein spezielles Kopplungsphänomen, das zwischen Teilchen auftritt. Im verschränkten Zustand können wir nicht die Eigenschaften jedes einzelnen Teilchens beschreiben, sondern nur das Phänomen der Eigenschaften des Gesamtsystems. Dieser Einfluss verschwindet nicht mit der Änderung des Abstands, selbst wenn die Teilchen durch das gesamte Universum getrennt sind .

Eine neue Studie zeigt, dass Sensoren mithilfe von Quantenverschränkungsmechanismen Bewegungen genauer und schneller erkennen können. Wissenschaftler glauben, dass die Erkenntnisse dazu beitragen könnten, Navigationssysteme zu entwickeln, die nicht auf GPS basieren.

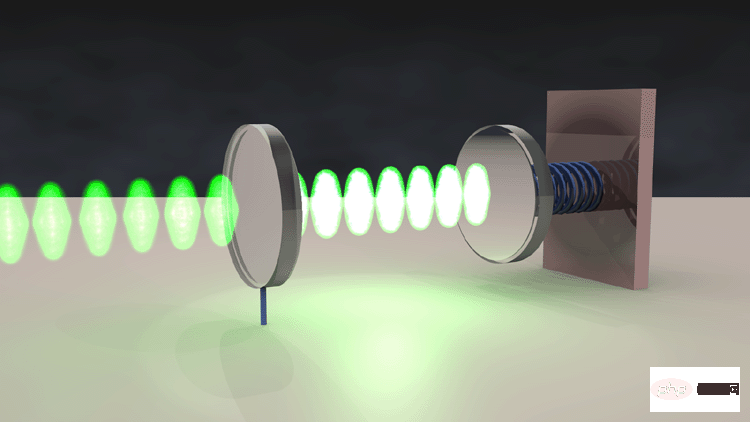

In einer neuen Studie, die in „Nature Photonics“ von der University of Arizona und anderen Institutionen eingereicht wurde, führten Forscher Experimente mit optomechanischen Sensoren durch, die Lichtstrahlen nutzen, um auf Interferenzen zu reagieren. Diese Sensoren fungieren als Beschleunigungsmesser, mit denen Smartphones Bewegungen erkennen können. Andererseits können Beschleunigungsmesser auch in Trägheitsnavigationssystemen in Bereichen mit schlechten GPS-Signalen eingesetzt werden, beispielsweise im Untergrund, unter Wasser, in Gebäuden, abgelegenen Gebieten und an Orten, an denen Funksignale gestört werden. ?

Um die Leistung der optomechanischen Sensorik zu verbessern, versuchen Forscher, die Verschränkung zu nutzen, die Einstein als „spukhafte Fernwirkung“ bezeichnete. Verschränkte Teilchen sind im Wesentlichen synchron, egal wie weit sie voneinander entfernt sind.

Forscher hoffen, innerhalb der nächsten zwei Jahre einen Prototyp eines verschränkten Beschleunigungsmesser-Chips zu haben.

„Bisher konzentrierten sich unsere Forschungen zur quantenverstärkten optomechanischen Sensorik hauptsächlich auf die Verbesserung der Empfindlichkeit eines einzelnen Sensors“, sagte der Hauptautor der Studie, Yi Xia, ein Quantenphysiker an der University of Arizona, Tucson. „Jüngste theoretische und experimentelle Studien haben jedoch gezeigt, dass die Verschränkung die Empfindlichkeit zwischen mehreren Sensoren erheblich verbessern kann, ein Ansatz, der als verteilte Quantenerkennung bekannt ist.“

Der Mechanismus optomechanischer Sensoren beruht auf der Synchronisation zweier Laserstrahlen. Ein Lichtstrahl wird von einer Komponente namens Oszillator reflektiert, und jede Bewegung des Oszillators verändert die Distanz, die das Licht auf seinem Weg zum Detektor zurücklegt. Ein solcher Unterschied in der zurückgelegten Strecke wird deutlich, wenn der zweite Strahl den ersten überlappt. Wenn der Sensor stationär ist, sind die beiden Strahlen perfekt ausgerichtet. Wenn sich der Sensor bewegt, erzeugen die überlappenden Lichtwellen ein Interferenzmuster, das die Größe und Geschwindigkeit der Bewegung des Sensors verrät.

In der neuen Studie verwendet der Sensor von Dal Wilsons Gruppe an der University of Arizona eine Membran als Oszillator, die ähnlich wie ein Trommelfell funktioniert, das nach dem Anschlag vibriert.

Anstatt einen Strahl auf einen Oszillator strahlen zu lassen, teilten die Forscher einen Infrarot-Laserstrahl in zwei verschränkte Strahlen auf, die von den beiden Oszillatoren auf zwei Detektoren reflektiert wurden. Diese verschränkte Natur des Lichts ermöglicht es im Wesentlichen zwei Sensoren, einen einzelnen Lichtstrahl zu analysieren und zusammenzuarbeiten, um Geschwindigkeit und Genauigkeit zu erhöhen.

„Wir können die Verschränkung nutzen, um die Krafterfassungsleistung mehrerer optomechanischer Sensoren zu verbessern“, sagte der Hauptautor der Studie, Zheshen Zhang, ein Quantenphysiker an der University of Michigan in Ann Arbor.

Um die Genauigkeit des Geräts zu verbessern, verwendeten die Forscher außerdem sogenanntes „komprimiertes Licht“. Das Quetschen von Licht macht sich ein Schlüsselprinzip der Quantenphysik zunutze: das Heisenbergsche Unsicherheitsprinzip, das besagt, dass bei der Bestimmung der Position eines Teilchens sein Impuls völlig ungewiss ist; wenn sein Impuls bestimmt ist, ist seine Position überhaupt nicht sicher. Gequetschtes Licht nutzt diesen Kompromiss aus, um die Unsicherheit bei der Messung einer bestimmten Variablen – in diesem Fall der Phase der Wellen, aus denen der Laserstrahl besteht – zu „quetschen“ oder zu verringern und gleichzeitig die Unsicherheit bei der Messung einer anderen Variablen zu erhöhen. Aber das Studienpersonal kann ignoriert werden.

„Wir sind eines der wenigen Teams, das eine komprimierte Lichtquelle erzeugen kann und erforschen sie derzeit als Grundlage für die nächste Generation der Präzisionsmesstechnik“, sagte Zheshen Zhang. Insgesamt konnten die Wissenschaftler 40 Prozent genauere und 60 Prozent schnellere Messungen durchführen als mit zwei unverflochtenen Strahlen. Darüber hinaus wird erwartet, dass die Genauigkeit und Geschwindigkeit dieses Ansatzes mit zunehmender Anzahl von Sensoren zunimmt. „Diese Erkenntnisse bedeuten, dass wir die Leistung der ultrapräzisen Kraftmessung weiter auf ein beispielloses Niveau verbessern können“, sagte Zheshen Zhang. Forscher sagen, dass die Verbesserung optomechanischer Sensoren nicht nur zu besseren Trägheitsnavigationssystemen führen könnte, sondern auch dazu beitragen könnte, mysteriöse Phänomene wie dunkle Materie und Gravitationswellen zu erkennen. Dunkle Materie ist eine unsichtbare Substanz, von der angenommen wird, dass sie fünf Sechstel der gesamten Materie im Universum ausmacht, und die Entdeckung ihrer möglichen Gravitationseffekte kann Wissenschaftlern dabei helfen, ihre Eigenschaften herauszufinden. Gravitationswellen sind Wellen im Gefüge der Raumzeit, die dazu beitragen können, Geheimnisse von Schwarzen Löchern bis zum Urknall aufzudecken.

Als nächstes planen die Wissenschaftler, ihr System zu miniaturisieren. Es ist bereits möglich, komprimierte Lichtquellen auf Chips zu platzieren, die nur einen halben Zentimeter breit sind. Innerhalb der nächsten ein oder zwei Jahre können wir mit Prototyp-Chips rechnen, die gequetschte Lichtquellen, Strahlteiler, Wellenleiter und Trägheitssensoren umfassen. „Dadurch wird diese Technologie praktischer, erschwinglicher und zugänglicher“, sagte Zheshen Zhang.

Darüber hinaus arbeitet das Forschungsteam derzeit mit Honeywell, dem Jet Propulsion Laboratory, NIST und mehreren anderen Universitäten an der Entwicklung einer quantenverstärkten Trägheitsmesseinheit im Chip-Maßstab. Zheshen Zhang sagte: „Unsere Vision ist es, solche integrierten Sensoren in autonomen Fahrzeugen und Raumfahrzeugen einzusetzen, um eine präzise Navigation ohne GPS-Signale zu erreichen.“

Das obige ist der detaillierte Inhalt vonMithilfe der Quantenverschränkung als GPS kann eine präzise Positionierung auch in Bereichen ohne Signal erreicht werden. Für weitere Informationen folgen Sie bitte anderen verwandten Artikeln auf der PHP chinesischen Website!

Heiße KI -Werkzeuge

Undresser.AI Undress

KI-gestützte App zum Erstellen realistischer Aktfotos

AI Clothes Remover

Online-KI-Tool zum Entfernen von Kleidung aus Fotos.

Undress AI Tool

Ausziehbilder kostenlos

Clothoff.io

KI-Kleiderentferner

AI Hentai Generator

Erstellen Sie kostenlos Ai Hentai.

Heißer Artikel

Heiße Werkzeuge

Notepad++7.3.1

Einfach zu bedienender und kostenloser Code-Editor

SublimeText3 chinesische Version

Chinesische Version, sehr einfach zu bedienen

Senden Sie Studio 13.0.1

Leistungsstarke integrierte PHP-Entwicklungsumgebung

Dreamweaver CS6

Visuelle Webentwicklungstools

SublimeText3 Mac-Version

Codebearbeitungssoftware auf Gottesniveau (SublimeText3)

Heiße Themen

1376

1376

52

52

Ein tiefer Einblick in Modelle, Daten und Frameworks: eine ausführliche 54-seitige Übersicht über effiziente große Sprachmodelle

Jan 14, 2024 pm 07:48 PM

Ein tiefer Einblick in Modelle, Daten und Frameworks: eine ausführliche 54-seitige Übersicht über effiziente große Sprachmodelle

Jan 14, 2024 pm 07:48 PM

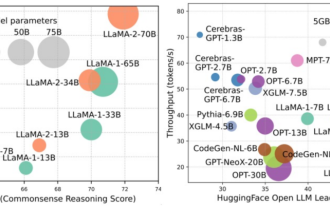

Large-Scale Language Models (LLMs) haben überzeugende Fähigkeiten bei vielen wichtigen Aufgaben bewiesen, darunter das Verständnis natürlicher Sprache, die Sprachgenerierung und das komplexe Denken, und hatten tiefgreifende Auswirkungen auf die Gesellschaft. Diese herausragenden Fähigkeiten erfordern jedoch erhebliche Schulungsressourcen (im linken Bild dargestellt) und lange Inferenzzeiten (im rechten Bild dargestellt). Daher müssen Forscher wirksame technische Mittel entwickeln, um ihre Effizienzprobleme zu lösen. Darüber hinaus wurden, wie auf der rechten Seite der Abbildung zu sehen ist, einige effiziente LLMs (LanguageModels) wie Mistral-7B erfolgreich beim Entwurf und Einsatz von LLMs eingesetzt. Diese effizienten LLMs können den Inferenzspeicher erheblich reduzieren und gleichzeitig eine ähnliche Genauigkeit wie LLaMA1-33B beibehalten

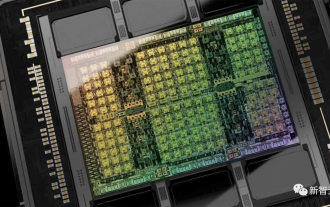

Nvidias GPU der nächsten Generation zerschmettert H100 und wird enthüllt! Das erste 3-nm-Multichip-Moduldesign, vorgestellt im Jahr 2024

Sep 30, 2023 pm 12:49 PM

Nvidias GPU der nächsten Generation zerschmettert H100 und wird enthüllt! Das erste 3-nm-Multichip-Moduldesign, vorgestellt im Jahr 2024

Sep 30, 2023 pm 12:49 PM

3-nm-Prozess, Leistung übertrifft H100! Kürzlich brachten die ausländischen Medien DigiTimes die Nachricht, dass Nvidia die GPU der nächsten Generation, die B100, mit dem Codenamen „Blackwell“ entwickelt, angeblich als Produkt für Anwendungen im Bereich der künstlichen Intelligenz (KI) und des Hochleistungsrechnens (HPC). Der B100 wird den 3-nm-Prozess von TSMC sowie ein komplexeres Multi-Chip-Modul (MCM)-Design nutzen und im vierten Quartal 2024 erscheinen. Nvidia, das mehr als 80 % des GPU-Marktes für künstliche Intelligenz monopolisiert, kann mit dem B100 zuschlagen, solange das Eisen heiß ist, und in dieser Welle des KI-Einsatzes weitere Herausforderer wie AMD und Intel angreifen. Nach Schätzungen von NVIDIA wird erwartet, dass der Produktionswert dieses Bereichs bis 2027 ungefähr erreicht

Die leistungsstarke Kombination aus Diffusions- und Superauflösungsmodellen, der Technologie hinter Googles Bildgenerator Imagen

Apr 10, 2023 am 10:21 AM

Die leistungsstarke Kombination aus Diffusions- und Superauflösungsmodellen, der Technologie hinter Googles Bildgenerator Imagen

Apr 10, 2023 am 10:21 AM

In den letzten Jahren hat multimodales Lernen große Aufmerksamkeit erhalten, insbesondere in den beiden Richtungen der Text-Bild-Synthese und des kontrastiven Bild-Text-Lernens. Einige KI-Modelle haben aufgrund ihrer Anwendung bei der kreativen Bilderzeugung und -bearbeitung große öffentliche Aufmerksamkeit erregt, wie beispielsweise die von OpenAI eingeführten Textbildmodelle DALL・E und DALL-E 2 sowie GauGAN und GauGAN2 von NVIDIA. Um nicht zu übertreffen, hat Google Ende Mai sein eigenes Text-zu-Bild-Modell Imagen veröffentlicht, das die Grenzen der untertitelbedingten Bildgenerierung offenbar noch weiter erweitert. Mit nur einer Beschreibung einer Szene kann Imagen eine hohe Qualität und Auflösung erzeugen

Die umfassendste Übersicht über multimodale Großmodelle finden Sie hier! 7 Microsoft-Forscher arbeiteten intensiv zusammen, 5 Hauptthemen, 119 Seiten Dokument

Sep 25, 2023 pm 04:49 PM

Die umfassendste Übersicht über multimodale Großmodelle finden Sie hier! 7 Microsoft-Forscher arbeiteten intensiv zusammen, 5 Hauptthemen, 119 Seiten Dokument

Sep 25, 2023 pm 04:49 PM

Die umfassendste Übersicht über multimodale Großmodelle finden Sie hier! Es wurde von sieben chinesischen Forschern bei Microsoft verfasst und umfasst 119 Seiten. Es geht von zwei Arten multimodaler Forschungsrichtungen für große Modelle aus, die abgeschlossen wurden und immer noch an der Spitze stehen, und fasst fünf spezifische Forschungsthemen umfassend zusammen: visuelles Verständnis und visuelle Generierung Der vom einheitlichen visuellen Modell LLM unterstützte multimodale Großmodell-Multimodalagent konzentriert sich auf ein Phänomen: Das multimodale Grundmodell hat sich von spezialisiert zu universell entwickelt. Ps. Aus diesem Grund hat der Autor am Anfang des Artikels direkt ein Bild von Doraemon gezeichnet. Wer sollte diese Rezension (Bericht) lesen? Mit den ursprünglichen Worten von Microsoft: Solange Sie daran interessiert sind, das Grundwissen und die neuesten Fortschritte multimodaler Grundmodelle zu erlernen, egal ob Sie ein professioneller Forscher oder ein Student sind, ist dieser Inhalt sehr gut für Sie geeignet.

Neue Forschungsergebnisse zeigen das Potenzial von Quanten-Monte-Carlo, neuronale Netze bei der Überwindung von Beschränkungen zu übertreffen, und eine Unterausgabe von Nature beschreibt die neuesten Fortschritte

Apr 24, 2023 pm 09:16 PM

Neue Forschungsergebnisse zeigen das Potenzial von Quanten-Monte-Carlo, neuronale Netze bei der Überwindung von Beschränkungen zu übertreffen, und eine Unterausgabe von Nature beschreibt die neuesten Fortschritte

Apr 24, 2023 pm 09:16 PM

Nach vier Monaten wurde im internationalen Top-Journal Nature Communications eine weitere Gemeinschaftsarbeit zwischen ByteDance Research und Chen Jis Forschungsgruppe an der School of Physics der Peking-Universität veröffentlicht: der Artikel „Towards the Ground State of Moleculars Via Diffusion Monte Carlo Neural Networks“. Kombiniert neuronale Netze mit Diffusions-Monte-Carlo-Methoden und verbessert so die Anwendung neuronaler Netzmethoden in der Quantenchemie erheblich. Die Berechnungsgenauigkeit, Effizienz und Systemskala für verwandte Aufgaben sind zum neuesten SOTA geworden. Papierlink: https://www.nature.com

I2V-Adapter aus der SD-Community: keine Konfiguration erforderlich, Plug-and-Play, perfekt kompatibel mit dem Tusheng-Video-Plug-in

Jan 15, 2024 pm 07:48 PM

I2V-Adapter aus der SD-Community: keine Konfiguration erforderlich, Plug-and-Play, perfekt kompatibel mit dem Tusheng-Video-Plug-in

Jan 15, 2024 pm 07:48 PM

Die Aufgabe der Bild-zu-Video-Generierung (I2V) ist eine Herausforderung im Bereich Computer Vision, die darauf abzielt, statische Bilder in dynamische Videos umzuwandeln. Die Schwierigkeit dieser Aufgabe besteht darin, dynamische Informationen in der zeitlichen Dimension aus einem einzelnen Bild zu extrahieren und zu generieren und dabei die Authentizität und visuelle Kohärenz des Bildinhalts zu wahren. Bestehende I2V-Methoden erfordern häufig komplexe Modellarchitekturen und große Mengen an Trainingsdaten, um dieses Ziel zu erreichen. Kürzlich wurde ein neues Forschungsergebnis „I2V-Adapter: AGeneralImage-to-VideoAdapter for VideoDiffusionModels“ unter der Leitung von Kuaishou veröffentlicht. Diese Forschung stellt eine innovative Bild-zu-Video-Konvertierungsmethode vor und schlägt ein leichtes Adaptermodul vor, d. h.

Bekanntgabe des Boltzmann-Preises 2022: Gründer von Hopfield Network gewinnt Auszeichnung

Aug 13, 2023 pm 08:49 PM

Bekanntgabe des Boltzmann-Preises 2022: Gründer von Hopfield Network gewinnt Auszeichnung

Aug 13, 2023 pm 08:49 PM

Die beiden Wissenschaftler, die den Boltzmann-Preis 2022 gewonnen haben, wurden bekannt gegeben. Diese Auszeichnung wurde vom IUPAP-Komitee für statistische Physik (C3) ins Leben gerufen, um Forscher zu würdigen, die herausragende Leistungen auf dem Gebiet der statistischen Physik erbracht haben. Der Gewinner muss ein Wissenschaftler sein, der zuvor weder einen Boltzmann-Preis noch einen Nobelpreis gewonnen hat. Dieser Preis wurde 1975 ins Leben gerufen und wird alle drei Jahre zum Gedenken an Ludwig Boltzmann, den Begründer der statistischen Physik, verliehen. Grund für die Auszeichnung: In Anerkennung der bahnbrechenden Beiträge von Deepak Dharistheoriginalstatement auf dem Gebiet der statistischen Physik, einschließlich der exakten Lösung selbstorganisierter Systeme kritisches Modell, Schnittstellenwachstum, Störung

VPR 2024 perfektes Ergebnispapier! Meta schlägt EfficientSAM vor: schnell alles aufteilen!

Mar 02, 2024 am 10:10 AM

VPR 2024 perfektes Ergebnispapier! Meta schlägt EfficientSAM vor: schnell alles aufteilen!

Mar 02, 2024 am 10:10 AM

Diese Arbeit von EfficientSAM wurde mit einer perfekten Bewertung von 5/5/5 in CVPR2024 aufgenommen! Der Autor teilte das Ergebnis in den sozialen Medien mit, wie im Bild unten gezeigt: Der Gewinner des LeCun Turing Award hat dieses Werk ebenfalls wärmstens empfohlen! In einer aktuellen Forschung haben Meta-Forscher eine neue, verbesserte Methode vorgeschlagen, nämlich das Mask Image Pre-Training (SAMI) unter Verwendung von SAM. Diese Methode kombiniert MAE-Vortrainingstechnologie und SAM-Modelle, um hochwertige vorab trainierte ViT-Encoder zu erhalten. Durch SAMI versuchen Forscher, die Leistung und Effizienz des Modells zu verbessern und bessere Lösungen für Sehaufgaben bereitzustellen. Der Vorschlag dieser Methode bringt neue Ideen und Möglichkeiten zur weiteren Erforschung und Entwicklung der Bereiche Computer Vision und Deep Learning. durch die Kombination verschiedener