Die Computer-Vision-Technologie steht vor einem großen Wandel

Wird sich Computer Vision wieder neu erfinden?

Ryad Benosman, Professor für Augenheilkunde an der University of Pittsburgh und außerordentlicher Professor am CMU Robotics Institute, glaubt, dass dies tatsächlich der Fall ist. Als einer der Begründer der ereignisbasierten Vision-Technologie erwartet Benosman, dass neuromorphes Sehen – Computer Vision basierend auf ereignisbasierten Kameras – die nächste Richtung in der Computer Vision sein wird.

„Computer Vision wurde viele Male neu erfunden“, sagte Benosman. „Ich habe gesehen, wie es mindestens zweimal neu erfunden wurde.“

Benosman verwies auf den Wandel von der Bildverarbeitung mit ein wenig Photogrammetrie zu geometriebasierten Methoden in den 1990er Jahren und dann auf die heutigen rasanten Fortschritte beim maschinellen Lernen. Trotz dieser Veränderungen basiert die moderne Computer-Vision-Technologie immer noch hauptsächlich auf Bildsensoren – Kameras, die Bilder erzeugen, die denen des menschlichen Auges ähneln.

Laut Benosman wird das Bilderfassungsparadigma die Innovation alternativer Technologien behindern, bis sie nicht mehr nützlich sind. Die Entwicklung von Hochleistungsprozessoren (z. B. GPUs) verzögert die Notwendigkeit, alternative Lösungen zu finden, und verlängert so diese Auswirkungen.

„Warum verwenden wir Bilder für Computer Vision? Das ist die Millionen-Dollar-Frage“, sagte er. „Wir haben keinen Grund, Bilder zu verwenden – es liegt einfach an der historischen Dynamik. Schon bevor es Kameras gab, hatten Bilder eine Dynamik.“ Im 15. Jahrhundert verwendeten Künstler raumgroße Geräte, um Bilder von Menschen oder Landschaften außerhalb eines Raums auf Leinwand zu zeichnen. Im Laufe der Jahre wurden die Gemälde durch Filme ersetzt, um die Bilder aufzuzeichnen. Innovationen wie die digitale Fotografie machten es schließlich einfach, dass Bildkameras zur Grundlage moderner Computer-Vision-Technologie wurden.

Allerdings glaubt Benosman, dass die auf Bildkameras basierende Computer-Vision-Technologie äußerst ineffizient ist. Sein Vergleich war das Verteidigungssystem einer mittelalterlichen Burg: Wächter, die um die Mauern herum postiert waren, hielten Ausschau nach herannahenden Feinden. Der Trommler schlug gleichmäßig, und bei jedem Schlag schrie jeder Wachmann laut heraus, was er sah. Wie leicht ist es, zu belauschen, wie ein Wachmann in all dem Trubel einen Feind am Rande eines fernen Waldes entdeckt?

Das Hardware-Äquivalent zu Trommelschlägen des 21. Jahrhunderts ist das elektronische Taktsignal, und die Wächter sind die Pixel. Es entstehen große Datenmengen, die in jedem Taktzyklus überprüft werden müssen, was zu einer großen Menge redundanter Informationen führt und somit viele unnötige Berechnungen erfordert.

„Die Menschen verbrauchen so viel Energie, dass sie die gesamte Rechenleistung des Schlosses in Anspruch nehmen, um sich selbst zu schützen“, sagte Benosman. Wenn ein interessantes Ereignis entdeckt wird – in dieser Analogie durch den Feind dargestellt – „muss man herumlaufen und nutzlose Informationen sammeln, überall schreien die Leute, also gibt es viel Bandbreite … Stellen Sie sich nun vor, Sie haben ein komplexes Schloss. All diese Leute.“ Alle müssen gehört werden.“

Betreten Sie Neuromorphic Vision. Die Grundidee ist von der Funktionsweise biologischer Systeme inspiriert, die darin besteht, Veränderungen in der Szenendynamik zu erkennen, anstatt kontinuierlich die gesamte Szene zu analysieren. In unserer Burg-Analogie bedeutet das, die Wachen ruhig zu halten, bis sie etwas Interessantes sehen, und dann ihren Standort anzurufen, um Alarm zu schlagen. In elektronischer Form bedeutet das, einzelne Pixel bestimmen zu lassen, ob sie etwas Relevantes sehen.

„Pixel können selbst entscheiden, welche Nachricht sie senden sollen“, sagte Benosman.

„Anstatt Systeminformationen abzurufen, können sie nach aussagekräftigen Informationen suchen – Funktionen. Das macht den Unterschied.“

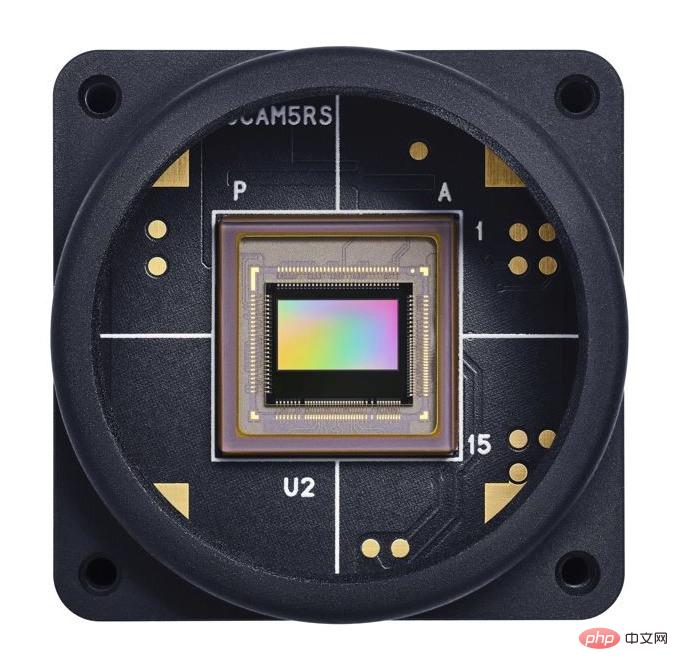

Das in Zusammenarbeit mit Sony entwickelte Prophesee DVS Sensor Evaluation Kit. Benosman ist Mitbegründer von Prophesee. Dieser ereignisbasierte Ansatz kann im Vergleich zur Systemerfassung mit fester Frequenz viel Strom sparen und die Latenz reduzieren.

Dieser ereignisbasierte Ansatz kann im Vergleich zur Systemerfassung mit fester Frequenz viel Strom sparen und die Latenz reduzieren.

„Sie wollen etwas adaptiveres, und das ist es, was Ihnen die relativen Veränderungen [ereignisbasiertes Sehen] bieten – die adaptive Erfassungshäufigkeit“, sagte er. „Wenn man sich Amplitudenänderungen ansieht, erhalten wir viele Proben, wenn sich etwas sehr schnell bewegt. Wenn sich etwas nicht ändert, erhalten wir fast Null, also passen Sie Ihre Erfassungsfrequenz basierend darauf an.“ Die Dynamik der Szene. Das ist es, was es mit sich bringt. Deshalb ist es ein gutes Design.“

Benosman betrat das Gebiet des neuromorphen Sehens im Jahr 2000 mit der Überzeugung, dass fortschrittliches Computersehen niemals funktionieren würde, weil Bilder nicht der richtige Ansatz seien.

„Die größte Veränderung besteht darin, zu sagen, dass wir ohne Graustufen und ohne Bilder sehen können, was in den späten 2000er Jahren ketzerisch war – völlig ketzerisch“, sagte er.

Die von Benosman vorgeschlagene Technologie – die Grundlage der heutigen ereignisbasierten Sensorik – war so anders, dass Beiträge, die beim damals wichtigsten IEEE-Journal für Computer Vision eingereicht wurden, ohne Begutachtung abgelehnt wurden. Tatsächlich begann die Technologie erst mit der Entwicklung des Dynamic Vision Sensor (DVS) im Jahr 2008 an Dynamik zu gewinnen.

Neurowissenschaften inspiriert

Neuromorphe Technologie ist eine Technologie, die von biologischen Systemen inspiriert ist, einschließlich des ultimativen Computers: dem Gehirn und seinen Neuronen oder Rechenelementen. Das Problem ist, dass niemand vollständig versteht, wie Neuronen funktionieren. Obwohl wir wissen, dass Neuronen auf eingehende elektrische Signale, sogenannte Spikes, reagieren, haben Forscher Neuronen bis vor Kurzem als eher hastig beschrieben und angenommen, dass nur die Anzahl der Spikes von Bedeutung sei. Diese Hypothese hielt sich jahrzehntelang hartnäckig, aber neuere Arbeiten haben gezeigt, dass der Zeitpunkt dieser Spitzen absolut entscheidend ist und dass das Gehirn so strukturiert ist, dass es Verzögerungen bei diesen Spitzen erzeugt, um Informationen zu verschlüsseln.

Heutige Spike-Neuronale Netze simulieren die im Gehirn sichtbaren Spikes und sind vereinfachte Versionen der Realität – oft binäre Darstellungen von Spikes. „Ich bekomme eine 1, ich wache auf, ich rechne, ich schlafe“, erklärte Benosman. Die Realität ist viel komplexer. Wenn eine Spitze eintrifft, beginnt das Neuron, den Wert der Spitze im Laufe der Zeit zu integrieren; die Neuronen verlieren ebenfalls, was bedeutet, dass die Ergebnisse dynamisch sind. Darüber hinaus gibt es etwa 50 verschiedene Arten von Neuronen mit 50 verschiedenen Integrationsprofilen.

Aktuellen elektronischen Versionen fehlen integrierte dynamische Pfade, Konnektivität zwischen Neuronen sowie unterschiedliche Gewichtungen und Verzögerungen. „Das Problem ist, dass man nicht die ganze Komplexität nachahmen kann, um ein funktionierendes Produkt herzustellen, weil wir es nicht verstehen“, sagte er. „Wenn wir eine gute Theorie des Gehirns hätten, würden wir sie lösen. Das Problem ist, dass wir es einfach nicht wissen.“

Bensoman betreibt ein einzigartiges Labor, das sich dem Verständnis der Mathematik hinter kortikalen Berechnungen widmet, mit dem Ziel, neue zu schaffen Mathematische Modelle und deren Replikation in Siliziumgeräte. Dies beinhaltet die direkte Überwachung von Spitzen aus echten Netzhäuten.

Derzeit lehnt Bensoman die originalgetreue Replikation biologischer Neuronen ab und bezeichnet diesen Ansatz als veraltet.

„Die Idee, Neuronen in Silizium zu replizieren, entstand, weil die Leute sich Transistoren ansahen und einen Mechanismus sahen, der wie ein echtes Neuron aussah, also gab es am Anfang einige Überlegungen dahinter“, sagte er. „Wir haben keine Zellen; wir haben Silizium. Sie müssen Ihr Computersubstrat anpassen, nicht umgekehrt … Wenn ich weiß, was ich rechne, und den Chip habe, kann ich diese Gleichung optimieren und es umsetzen.“ zu den niedrigsten Kosten, dem geringsten Stromverbrauch und der geringsten Latenz für den Betrieb.“ Obwohl Systeme bereits kommerziell verfügbar sind, sind Fortschritte erforderlich, bevor vollständig menschenähnliches Sehen kommerziell genutzt werden kann.

Benosman sagt, dass die ursprünglichen DVS-Kameras „große, dicke Pixel“ hatten, weil die Komponenten rund um die Fotodiode selbst den Füllfaktor stark reduzierten. Während Investitionen in die Entwicklung dieser Kameras die Technologie beschleunigt haben, machte Benosman deutlich, dass die heutigen Vorfallkameras lediglich Verbesserungen der ursprünglichen Forschungsausrüstung aus dem Jahr 2000 darstellen. Die fortschrittlichsten DVS-Kameras von Sony, Samsung und Omnivision verfügen über winzige Pixel, die fortschrittliche Technologien wie 3D-Stacking integrieren und Rauschen reduzieren. Benosmans Sorge ist, ob die heute verwendeten Sensortypen erfolgreich skaliert werden können.

„Das Problem ist, dass man, sobald man die Pixelanzahl erhöht, viele Daten erhält, weil man immer noch sehr schnell ist“, sagte er. „Man könnte es wahrscheinlich immer noch in Echtzeit verarbeiten, aber man würde zu viele relative Änderungen durch zu viele Pixel erhalten. Das bringt im Moment alle um, weil sie das Potenzial sehen, aber sie haben nicht die richtigen Prozessoren, um es zu unterstützen.“

Dieses Prophesee-Kundenanwendungsbeispiel zeigt den Unterschied zwischen der Bildkamera (obere linke Ecke jedes Felds) und der DVS-Sensorausgabe. Neuromorphe Allzweckprozessoren hinken ihren DVS-Kamera-Gegenstücken hinterher. Die Bemühungen einiger der größten Player der Branche (IBM Truenorth, Intel Loihi) dauern noch an. Der richtige Prozessor und der richtige Sensor seien eine unschlagbare Kombination, sagte Benosman.

Neuromorphe Allzweckprozessoren hinken ihren DVS-Kamera-Gegenstücken hinterher. Die Bemühungen einiger der größten Player der Branche (IBM Truenorth, Intel Loihi) dauern noch an. Der richtige Prozessor und der richtige Sensor seien eine unschlagbare Kombination, sagte Benosman.

„[Die heutigen DVS-]Sensoren sind extrem schnell, haben eine extrem niedrige Bandbreite und einen hohen Dynamikbereich, sodass Sie drinnen und draußen sehen können“, sagte Benosman. „Das ist die Zukunft. Wird es durchstarten? Auf jeden Fall.“

„Wer den Prozessor einbauen und den vollen Stack liefern kann, wird gewinnen, weil er unschlagbar sein wird“, fügte er hinzu.

Das obige ist der detaillierte Inhalt vonDie Computer-Vision-Technologie steht vor einem großen Wandel. Für weitere Informationen folgen Sie bitte anderen verwandten Artikeln auf der PHP chinesischen Website!

Heiße KI -Werkzeuge

Undresser.AI Undress

KI-gestützte App zum Erstellen realistischer Aktfotos

AI Clothes Remover

Online-KI-Tool zum Entfernen von Kleidung aus Fotos.

Undress AI Tool

Ausziehbilder kostenlos

Clothoff.io

KI-Kleiderentferner

AI Hentai Generator

Erstellen Sie kostenlos Ai Hentai.

Heißer Artikel

Heiße Werkzeuge

Notepad++7.3.1

Einfach zu bedienender und kostenloser Code-Editor

SublimeText3 chinesische Version

Chinesische Version, sehr einfach zu bedienen

Senden Sie Studio 13.0.1

Leistungsstarke integrierte PHP-Entwicklungsumgebung

Dreamweaver CS6

Visuelle Webentwicklungstools

SublimeText3 Mac-Version

Codebearbeitungssoftware auf Gottesniveau (SublimeText3)

Heiße Themen

1378

1378

52

52

Bytedance Cutting führt SVIP-Supermitgliedschaft ein: 499 Yuan für ein fortlaufendes Jahresabonnement, das eine Vielzahl von KI-Funktionen bietet

Jun 28, 2024 am 03:51 AM

Bytedance Cutting führt SVIP-Supermitgliedschaft ein: 499 Yuan für ein fortlaufendes Jahresabonnement, das eine Vielzahl von KI-Funktionen bietet

Jun 28, 2024 am 03:51 AM

Diese Seite berichtete am 27. Juni, dass Jianying eine von FaceMeng Technology, einer Tochtergesellschaft von ByteDance, entwickelte Videobearbeitungssoftware ist, die auf der Douyin-Plattform basiert und grundsätzlich kurze Videoinhalte für Benutzer der Plattform produziert Windows, MacOS und andere Betriebssysteme. Jianying kündigte offiziell die Aktualisierung seines Mitgliedschaftssystems an und führte ein neues SVIP ein, das eine Vielzahl von KI-Schwarztechnologien umfasst, wie z. B. intelligente Übersetzung, intelligente Hervorhebung, intelligente Verpackung, digitale menschliche Synthese usw. Preislich beträgt die monatliche Gebühr für das Clipping von SVIP 79 Yuan, die Jahresgebühr 599 Yuan (Hinweis auf dieser Website: entspricht 49,9 Yuan pro Monat), das fortlaufende Monatsabonnement beträgt 59 Yuan pro Monat und das fortlaufende Jahresabonnement beträgt 499 Yuan pro Jahr (entspricht 41,6 Yuan pro Monat). Darüber hinaus erklärte der Cut-Beamte auch, dass diejenigen, die den ursprünglichen VIP abonniert haben, das Benutzererlebnis verbessern sollen

Kontexterweiterter KI-Codierungsassistent mit Rag und Sem-Rag

Jun 10, 2024 am 11:08 AM

Kontexterweiterter KI-Codierungsassistent mit Rag und Sem-Rag

Jun 10, 2024 am 11:08 AM

Verbessern Sie die Produktivität, Effizienz und Genauigkeit der Entwickler, indem Sie eine abrufgestützte Generierung und ein semantisches Gedächtnis in KI-Codierungsassistenten integrieren. Übersetzt aus EnhancingAICodingAssistantswithContextUsingRAGandSEM-RAG, Autor JanakiramMSV. Obwohl grundlegende KI-Programmierassistenten natürlich hilfreich sind, können sie oft nicht die relevantesten und korrektesten Codevorschläge liefern, da sie auf einem allgemeinen Verständnis der Softwaresprache und den gängigsten Mustern beim Schreiben von Software basieren. Der von diesen Coding-Assistenten generierte Code eignet sich zur Lösung der von ihnen zu lösenden Probleme, entspricht jedoch häufig nicht den Coding-Standards, -Konventionen und -Stilen der einzelnen Teams. Dabei entstehen häufig Vorschläge, die geändert oder verfeinert werden müssen, damit der Code in die Anwendung übernommen wird

Kann LLM durch Feinabstimmung wirklich neue Dinge lernen: Die Einführung neuen Wissens kann dazu führen, dass das Modell mehr Halluzinationen hervorruft

Jun 11, 2024 pm 03:57 PM

Kann LLM durch Feinabstimmung wirklich neue Dinge lernen: Die Einführung neuen Wissens kann dazu führen, dass das Modell mehr Halluzinationen hervorruft

Jun 11, 2024 pm 03:57 PM

Large Language Models (LLMs) werden auf riesigen Textdatenbanken trainiert und erwerben dort große Mengen an realem Wissen. Dieses Wissen wird in ihre Parameter eingebettet und kann dann bei Bedarf genutzt werden. Das Wissen über diese Modelle wird am Ende der Ausbildung „verdinglicht“. Am Ende des Vortrainings hört das Modell tatsächlich auf zu lernen. Richten Sie das Modell aus oder verfeinern Sie es, um zu erfahren, wie Sie dieses Wissen nutzen und natürlicher auf Benutzerfragen reagieren können. Aber manchmal reicht Modellwissen nicht aus, und obwohl das Modell über RAG auf externe Inhalte zugreifen kann, wird es als vorteilhaft angesehen, das Modell durch Feinabstimmung an neue Domänen anzupassen. Diese Feinabstimmung erfolgt mithilfe von Eingaben menschlicher Annotatoren oder anderer LLM-Kreationen, wobei das Modell auf zusätzliches Wissen aus der realen Welt trifft und dieses integriert

Sieben coole technische Interviewfragen für GenAI und LLM

Jun 07, 2024 am 10:06 AM

Sieben coole technische Interviewfragen für GenAI und LLM

Jun 07, 2024 am 10:06 AM

Um mehr über AIGC zu erfahren, besuchen Sie bitte: 51CTOAI.x Community https://www.51cto.com/aigc/Translator|Jingyan Reviewer|Chonglou unterscheidet sich von der traditionellen Fragendatenbank, die überall im Internet zu sehen ist erfordert einen Blick über den Tellerrand hinaus. Large Language Models (LLMs) gewinnen in den Bereichen Datenwissenschaft, generative künstliche Intelligenz (GenAI) und künstliche Intelligenz zunehmend an Bedeutung. Diese komplexen Algorithmen verbessern die menschlichen Fähigkeiten, treiben Effizienz und Innovation in vielen Branchen voran und werden zum Schlüssel für Unternehmen, um wettbewerbsfähig zu bleiben. LLM hat ein breites Anwendungsspektrum und kann in Bereichen wie der Verarbeitung natürlicher Sprache, der Textgenerierung, der Spracherkennung und Empfehlungssystemen eingesetzt werden. Durch das Lernen aus großen Datenmengen ist LLM in der Lage, Text zu generieren

Um ein neues wissenschaftliches und komplexes Frage-Antwort-Benchmark- und Bewertungssystem für große Modelle bereitzustellen, haben UNSW, Argonne, die University of Chicago und andere Institutionen gemeinsam das SciQAG-Framework eingeführt

Jul 25, 2024 am 06:42 AM

Um ein neues wissenschaftliches und komplexes Frage-Antwort-Benchmark- und Bewertungssystem für große Modelle bereitzustellen, haben UNSW, Argonne, die University of Chicago und andere Institutionen gemeinsam das SciQAG-Framework eingeführt

Jul 25, 2024 am 06:42 AM

Herausgeber | Der Frage-Antwort-Datensatz (QA) von ScienceAI spielt eine entscheidende Rolle bei der Förderung der Forschung zur Verarbeitung natürlicher Sprache (NLP). Hochwertige QS-Datensätze können nicht nur zur Feinabstimmung von Modellen verwendet werden, sondern auch effektiv die Fähigkeiten großer Sprachmodelle (LLMs) bewerten, insbesondere die Fähigkeit, wissenschaftliche Erkenntnisse zu verstehen und zu begründen. Obwohl es derzeit viele wissenschaftliche QS-Datensätze aus den Bereichen Medizin, Chemie, Biologie und anderen Bereichen gibt, weisen diese Datensätze immer noch einige Mängel auf. Erstens ist das Datenformular relativ einfach, die meisten davon sind Multiple-Choice-Fragen. Sie sind leicht auszuwerten, schränken jedoch den Antwortauswahlbereich des Modells ein und können die Fähigkeit des Modells zur Beantwortung wissenschaftlicher Fragen nicht vollständig testen. Im Gegensatz dazu offene Fragen und Antworten

Fünf Schulen des maschinellen Lernens, die Sie nicht kennen

Jun 05, 2024 pm 08:51 PM

Fünf Schulen des maschinellen Lernens, die Sie nicht kennen

Jun 05, 2024 pm 08:51 PM

Maschinelles Lernen ist ein wichtiger Zweig der künstlichen Intelligenz, der Computern die Möglichkeit gibt, aus Daten zu lernen und ihre Fähigkeiten zu verbessern, ohne explizit programmiert zu werden. Maschinelles Lernen hat ein breites Anwendungsspektrum in verschiedenen Bereichen, von der Bilderkennung und der Verarbeitung natürlicher Sprache bis hin zu Empfehlungssystemen und Betrugserkennung, und es verändert unsere Lebensweise. Im Bereich des maschinellen Lernens gibt es viele verschiedene Methoden und Theorien, von denen die fünf einflussreichsten Methoden als „Fünf Schulen des maschinellen Lernens“ bezeichnet werden. Die fünf Hauptschulen sind die symbolische Schule, die konnektionistische Schule, die evolutionäre Schule, die Bayes'sche Schule und die Analogieschule. 1. Der Symbolismus, auch Symbolismus genannt, betont die Verwendung von Symbolen zum logischen Denken und zum Ausdruck von Wissen. Diese Denkrichtung glaubt, dass Lernen ein Prozess der umgekehrten Schlussfolgerung durch das Vorhandene ist

SOTA Performance, eine multimodale KI-Methode zur Vorhersage der Protein-Ligand-Affinität in Xiamen, kombiniert erstmals molekulare Oberflächeninformationen

Jul 17, 2024 pm 06:37 PM

SOTA Performance, eine multimodale KI-Methode zur Vorhersage der Protein-Ligand-Affinität in Xiamen, kombiniert erstmals molekulare Oberflächeninformationen

Jul 17, 2024 pm 06:37 PM

Herausgeber |. KX Im Bereich der Arzneimittelforschung und -entwicklung ist die genaue und effektive Vorhersage der Bindungsaffinität von Proteinen und Liganden für das Arzneimittelscreening und die Arzneimitteloptimierung von entscheidender Bedeutung. Aktuelle Studien berücksichtigen jedoch nicht die wichtige Rolle molekularer Oberflächeninformationen bei Protein-Ligand-Wechselwirkungen. Auf dieser Grundlage schlugen Forscher der Universität Xiamen ein neuartiges Framework zur multimodalen Merkmalsextraktion (MFE) vor, das erstmals Informationen über Proteinoberfläche, 3D-Struktur und -Sequenz kombiniert und einen Kreuzaufmerksamkeitsmechanismus verwendet, um verschiedene Modalitäten zu vergleichen Ausrichtung. Experimentelle Ergebnisse zeigen, dass diese Methode bei der Vorhersage von Protein-Ligand-Bindungsaffinitäten Spitzenleistungen erbringt. Darüber hinaus belegen Ablationsstudien die Wirksamkeit und Notwendigkeit der Proteinoberflächeninformation und der multimodalen Merkmalsausrichtung innerhalb dieses Rahmens. Verwandte Forschungen beginnen mit „S

GlobalFoundries erschließt Märkte wie KI und erwirbt die Galliumnitrid-Technologie von Tagore Technology und zugehörige Teams

Jul 15, 2024 pm 12:21 PM

GlobalFoundries erschließt Märkte wie KI und erwirbt die Galliumnitrid-Technologie von Tagore Technology und zugehörige Teams

Jul 15, 2024 pm 12:21 PM

Laut Nachrichten dieser Website vom 5. Juli veröffentlichte GlobalFoundries am 1. Juli dieses Jahres eine Pressemitteilung, in der die Übernahme der Power-Galliumnitrid (GaN)-Technologie und des Portfolios an geistigem Eigentum von Tagore Technology angekündigt wurde, in der Hoffnung, seinen Marktanteil in den Bereichen Automobile und Internet auszubauen Anwendungsbereiche für Rechenzentren mit künstlicher Intelligenz, um höhere Effizienz und bessere Leistung zu erforschen. Da sich Technologien wie generative künstliche Intelligenz (GenerativeAI) in der digitalen Welt weiterentwickeln, ist Galliumnitrid (GaN) zu einer Schlüssellösung für nachhaltiges und effizientes Energiemanagement, insbesondere in Rechenzentren, geworden. Auf dieser Website wurde die offizielle Ankündigung zitiert, dass sich das Ingenieurteam von Tagore Technology im Rahmen dieser Übernahme mit GF zusammenschließen wird, um die Galliumnitrid-Technologie weiterzuentwickeln. G