Technologie-Peripheriegeräte

Technologie-Peripheriegeräte

KI

KI

NTU hat ein neues RAM-Modell vorgeschlagen, bei dem Meta verwendet wird, um alles aufzuteilen und eine Beziehung herzustellen. Der Sneak-Attack-Effekt mit Gesang und Tanz ist hervorragend!

NTU hat ein neues RAM-Modell vorgeschlagen, bei dem Meta verwendet wird, um alles aufzuteilen und eine Beziehung herzustellen. Der Sneak-Attack-Effekt mit Gesang und Tanz ist hervorragend!

NTU hat ein neues RAM-Modell vorgeschlagen, bei dem Meta verwendet wird, um alles aufzuteilen und eine Beziehung herzustellen. Der Sneak-Attack-Effekt mit Gesang und Tanz ist hervorragend!

Anfang dieses Monats schockierte das von Meta eingeführte „Split Everything“-Modell den gesamten CV-Kreis.

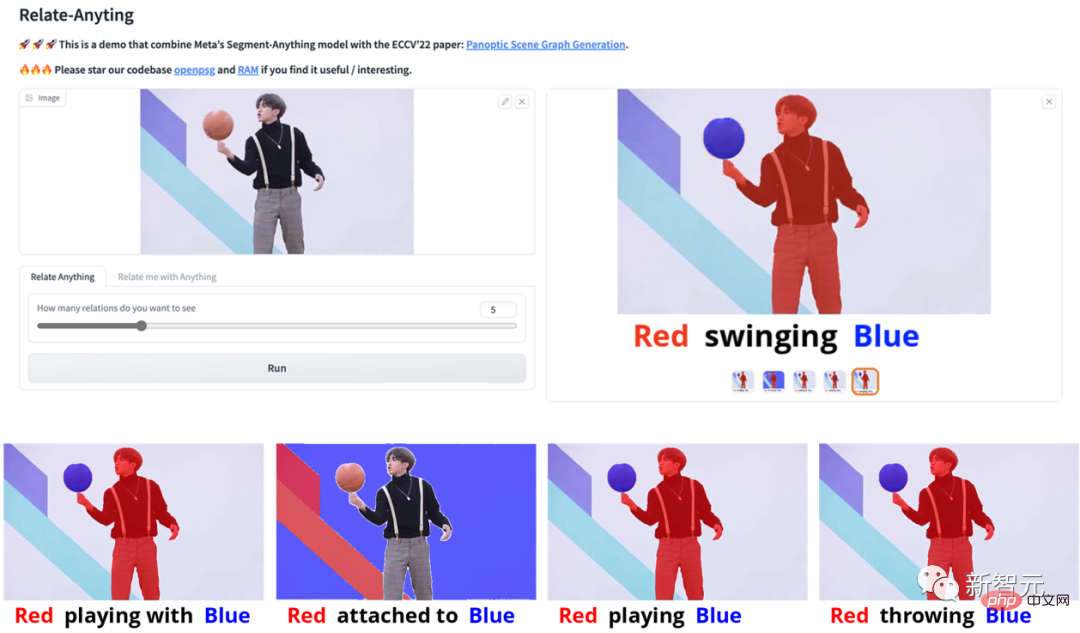

In den letzten Tagen ist ein maschinelles Lernmodell namens „Relate-Anything-Model (RAM)“ aufgetaucht. Es gibt dem Segment Anything Model (SAM) die Möglichkeit, verschiedene visuelle Beziehungen zwischen verschiedenen visuellen Konzepten zu identifizieren.

Es versteht sich, dass das Modell vom MMLab-Team der Nanyang Technological University und Studenten des VisCom Laboratory des King's College London und der Tongji University in ihrer Freizeit entwickelt wurde.

Demo-Adresse: https://huggingface.co/spaces/mmlab-ntu/relate-anything-model

Code-Adresse: https://github.com/ Luodian/RelateAnything

Datensatzadresse: https://github.com/Jingkang50/OpenPSG

Effektdemonstration

Werfen wir zunächst einen Blick auf „Relate-Anything-Model (RAM)“ „Anwendungsbeispiele!

Zum Beispiel sind die folgenden Bildanalyseergebnisse der RAM-Modellimplementierung von Fußballspielen, Tanzen und Freundschaften schließen sehr beeindruckend und zeigen deutlich die hervorragende Leistung und das Potenzial des Modells für vielfältige Anwendungen.

Vorkenntnisse: Vollständige Szenendiagramm-Generierung PSG-Aufgabe

RAM-Modell basierend auf ECCV'22 SenseHuman Workshop & International Algorithmus-Beispielwettbewerb „Panoptic Scene Graph“. Generation“-Streckenmeisterschaftsprogramm.

Papieradresse: https://arxiv.org/abs/2302.02651

Die PSG Challenge hat ein Preisgeld von einer Million und hat verschiedene Lösungen von 100 Teams aus der ganzen Welt erhalten Zu den Lösungen gehören die Verwendung fortschrittlicher Bildsegmentierungsmethoden und die Lösung von Long-Tail-Problemen. Darüber hinaus erhielt der Wettbewerb auch einige innovative Ansätze, wie beispielsweise szenengraphenspezifische Datenanreicherungstechniken.

Nach der Bewertung stach das GRNet des Xiaohongshu-Teams aufgrund von Überlegungen wie Leistungsindikatoren, Neuheit und Bedeutung der Lösung als Gewinnermethode hervor.

Wettbewerbsdetails: https://github.com/Jingkang50/OpenPSG

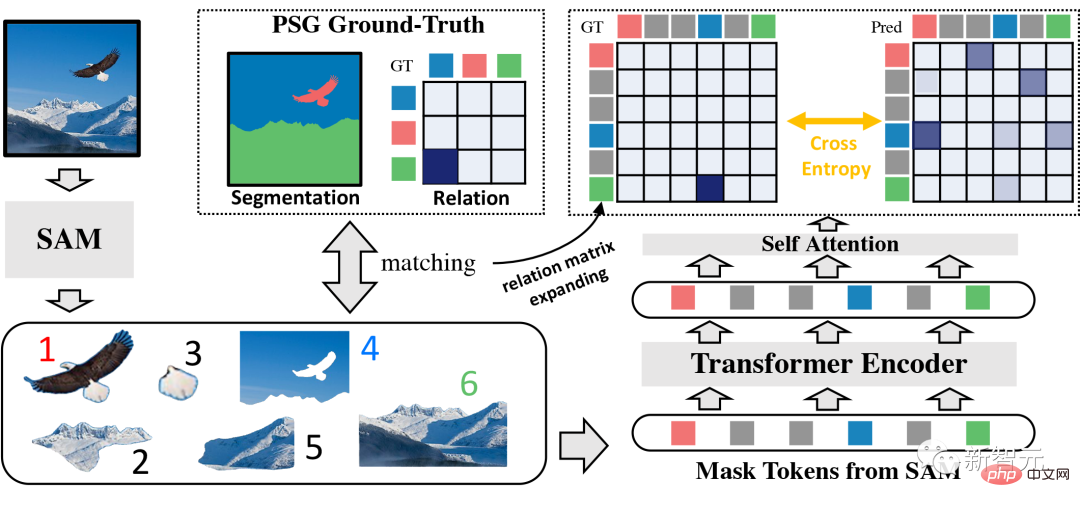

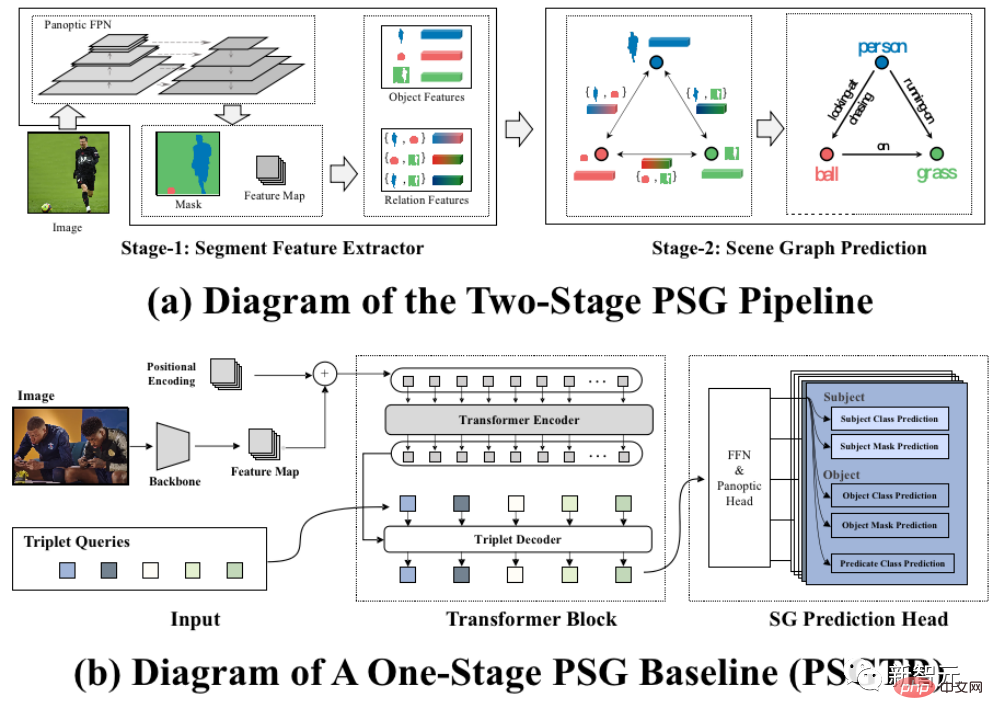

Bevor wir die Lösung vorstellen, stellen wir zunächst zwei klassische PSG-Grundlinienmethoden vor, darunter eine zweistufige Methode und die andere ist eine einstufige Methode.

Für die zweistufige Basislinienmethode, wie in Abbildung a dargestellt, wird in der ersten Stufe das vorab trainierte Panorama-Segmentierungsmodell Panoptic FPN verwendet, um Merkmale, Segmentierung und Klassifizierungsvorhersagen zu extrahieren aus dem Bild. Die Merkmale jedes einzelnen Objekts werden dann in der zweiten Stufe einem klassischen Szenengraphgenerator wie IMP zur Generierung von Szenengraphen zugeführt, die an die PSG-Aufgabe angepasst sind. Durch diesen zweistufigen Ansatz kann die klassische SGG-Methode mit minimalen Modifikationen an die PSG-Aufgabe angepasst werden.

Wie in Abbildung b gezeigt, verwendet die einstufige Basismethode PSGTR zunächst CNN, um Bildmerkmale zu extrahieren, und verwendet dann einen Transformator Encoder ähnlich dem DETR-Decoder zum direkten Lernen von Triplettdarstellungen. Der ungarische Matcher wird verwendet, um vorhergesagte Triples mit Ground-Truth-Triples zu vergleichen. Das Optimierungsziel besteht dann darin, die Kosten der Matcher-Berechnung zu maximieren, und der Gesamtverlust wird unter Verwendung des Kreuzentropie-DICE/F-1-Verlusts für die Kennzeichnung und Segmentierung berechnet. #🎜🎜 ## 🎜🎜 ## 🎜🎜 ## 🎜🎜 ## 🎜🎜 ## 🎜🎜 ## 🎜🎜 ## 🎜🎜 ## 🎜🎜#RAM Model Architecture#🎜🎜 ## 🎜🎜 ## 🎜🎜 #Im Entwurfsprozess des RAM-Modells verwies der Autor auf das zweistufige Strukturparadigma der Meisterschaftslösung GRNet von PSG. Obwohl die Forschung im ursprünglichen PSG-Artikel zeigt, dass einstufige Modelle derzeit eine bessere Leistung erbringen als zweistufige Modelle, können einstufige Modelle häufig nicht die gleiche gute Segmentierungsleistung wie zweistufige Modelle erzielen.

Basierend auf dieser Beobachtung zielt das Design von RAM wie GRNet darauf ab, durch Fokussierung einen Kompromiss zwischen den beiden Modi zu finden auf dem zweistufigen Paradigma und gibt ihm die Möglichkeit, einen globalen Kontext zu erhalten, der dem einstufigen Paradigma ähnelt.

Insbesondere wird Segment Anything Model (SAM) zunächst als Merkmalsextraktor verwendet, um Objekte im Bild zu identifizieren und zu segmentieren -spezifische Zwischenmerkmalskarten vom SAM-Segmentierer werden mit ihren entsprechenden Segmentierungen zusammengeführt, um Merkmale auf Objektebene zu erhalten.

Anschließend wird der Transformer als globales Kontextmodul verwendet und die erhaltenen Funktionen auf Objektebene werden nach linearer Zuordnung darin eingegeben . Durch den Cross-Attention-Mechanismus im Transformer-Encoder sammeln die Ausgabeobjektfunktionen mehr globale Informationen von anderen Objekten.

Abschließend wird für jede vom Transformer ausgegebene Funktion auf Objektebene der Selbstaufmerksamkeitsmechanismus verwendet, um die Kontextinformationen weiter anzureichern und sorgen Sie dafür, dass jedes Objekt die Interaktion vervollständigt.

Bitte beachten Sie, dass hier auch eine Kategorieeinbettung hinzugefügt wird, um die Kategorie des Objekts anzugeben, und daraus erhalten wir Objektpaare und Vorhersage der Beziehung zwischen ihnen.

RAM-Beziehungsklassifizierung Während des Trainingsprozesses muss für jede Beziehungskategorie eine Beziehung zwei sein führte eine Metaklassifizierungsaufgabe durch, um festzustellen, ob eine Beziehung zwischen Objektpaaren besteht.

Ähnlich wie bei GRNet gibt es einige besondere Überlegungen für relationale binäre Klassifizierungsaufgaben. PSG-Datensätze enthalten beispielsweise normalerweise zwei Objekte mit mehreren Beziehungen, z. B. „Menschen schauen sich Elefanten an“ und „Menschen füttern Elefanten“ existieren gleichzeitig. Um das Multi-Label-Problem zu lösen, konvertieren die Autoren die Beziehungsvorhersage von einem Single-Label-Klassifizierungsproblem in ein Multi-Label-Klassifizierungsproblem.

Darüber hinaus verbessert der PSG-Datensatz die Leistung, indem er vom Annotator verlangt, ein spezifisches und präzises Prädikat auszuwählen (z. B. „Stopp bei“. „anstelle eines allgemeineren „在“), um Genauigkeit und Korrelation zu verfolgen, ist es möglicherweise nicht zum Erlernen von Grenzbeziehungen geeignet (z. B. „在“ existiert tatsächlich gleichzeitig mit „stop“). Um dieses Problem zu lösen, wendet RAM eine Selbsttrainingsstrategie an, die selbstdestillierte Etiketten für die Beziehungsklassifizierung verwendet und einen exponentiellen gleitenden Durchschnitt verwendet, um Etiketten dynamisch zu aktualisieren.

Andere RAM-Designs

Bei der Berechnung des relationalen binären Klassifizierungsverlusts muss jedes vorhergesagte Objekt mit seinem entsprechenden Grundwahrheitsobjekt gepaart werden. Hierzu wird der ungarische Matching-Algorithmus verwendet.

Dieser Algorithmus ist jedoch anfällig für Instabilität, insbesondere in den frühen Trainingsphasen, wenn die Netzwerkgenauigkeit gering ist. Dies kann zu unterschiedlichen Matching-Ergebnissen für dieselbe Eingabe führen, was zu inkonsistenten Netzwerkoptimierungsrichtungen führt und das Training schwieriger macht.

Im RAM kann der Autor im Gegensatz zur vorherigen Lösung mithilfe des leistungsstarken SAM-Modells eine vollständige und detaillierte Segmentierung nahezu jedes Bildes durchführen. Daher wird RAM beim Matching von Vorhersage und GT auf natürliche Weise entworfen Neue GT-Matching-Methode: Verwenden Sie den PSG-Datensatz, um das Modell zu trainieren.

Für jedes Trainingsbild segmentiert SAM mehrere Objekte, aber nur wenige stimmen mit der Ground Truth (GT)-Maske von PSG überein. Die Autoren führen ein einfaches Matching basierend auf ihren Intersektions-Union-Scores (IOU) durch, sodass (fast) jede GT-Maske einer SAM-Maske zugeordnet wird. Anschließend generierte der Autor das Beziehungsdiagramm basierend auf der SAM-Maske neu, was natürlich mit den Vorhersagen des Modells übereinstimmte.

Zusammenfassung des RAM-Modells

Im RAM-Modell verwendet der Autor das Segment Anything Model (SAM), um Objekte im Bild zu identifizieren und zu segmentieren und die Merkmale jedes segmentierten Objekts zu extrahieren. Das Transformer-Modul wird dann verwendet, um zwischen segmentierten Objekten zu interagieren und neue Funktionen zu erhalten. Nachdem diese Merkmale schließlich in Kategorien eingebettet wurden, werden die Vorhersageergebnisse über den Selbstaufmerksamkeitsmechanismus ausgegeben.

Insbesondere während des Trainingsprozesses schlägt der Autor eine neue GT-Matching-Methode vor und berechnet basierend auf dieser Methode die Paarungsbeziehung zwischen Vorhersagen und GT und klassifiziert ihre gegenseitigen Beziehungen. Der Autor betrachtet den überwachten Lernprozess der Beziehungsklassifizierung als ein Klassifizierungsproblem mit mehreren Etiketten und wendet eine Selbsttrainingsstrategie an, um die Grenzbeziehungen von Etiketten zu lernen.

Abschließend hoffe ich, dass das RAM-Modell Ihnen mehr Inspiration und Innovation bringen kann. Wenn Sie auch ein maschinelles Lernmodell trainieren möchten, das Zusammenhänge finden kann, können Sie die Arbeit dieses Teams verfolgen und jederzeit Feedback und Vorschläge geben.

Projektadresse: https://github.com/Jingkang50/OpenPSG

Das obige ist der detaillierte Inhalt vonNTU hat ein neues RAM-Modell vorgeschlagen, bei dem Meta verwendet wird, um alles aufzuteilen und eine Beziehung herzustellen. Der Sneak-Attack-Effekt mit Gesang und Tanz ist hervorragend!. Für weitere Informationen folgen Sie bitte anderen verwandten Artikeln auf der PHP chinesischen Website!

Heiße KI -Werkzeuge

Undresser.AI Undress

KI-gestützte App zum Erstellen realistischer Aktfotos

AI Clothes Remover

Online-KI-Tool zum Entfernen von Kleidung aus Fotos.

Undress AI Tool

Ausziehbilder kostenlos

Clothoff.io

KI-Kleiderentferner

AI Hentai Generator

Erstellen Sie kostenlos Ai Hentai.

Heißer Artikel

Heiße Werkzeuge

Notepad++7.3.1

Einfach zu bedienender und kostenloser Code-Editor

SublimeText3 chinesische Version

Chinesische Version, sehr einfach zu bedienen

Senden Sie Studio 13.0.1

Leistungsstarke integrierte PHP-Entwicklungsumgebung

Dreamweaver CS6

Visuelle Webentwicklungstools

SublimeText3 Mac-Version

Codebearbeitungssoftware auf Gottesniveau (SublimeText3)

Heiße Themen

1376

1376

52

52

Laravels Geospatial: Optimierung interaktiver Karten und großen Datenmengen

Apr 08, 2025 pm 12:24 PM

Laravels Geospatial: Optimierung interaktiver Karten und großen Datenmengen

Apr 08, 2025 pm 12:24 PM

Verarbeiten Sie 7 Millionen Aufzeichnungen effizient und erstellen Sie interaktive Karten mit Geospatial -Technologie. In diesem Artikel wird untersucht, wie über 7 Millionen Datensätze mithilfe von Laravel und MySQL effizient verarbeitet und in interaktive Kartenvisualisierungen umgewandelt werden können. Erstes Herausforderungsprojektanforderungen: Mit 7 Millionen Datensätzen in der MySQL -Datenbank wertvolle Erkenntnisse extrahieren. Viele Menschen erwägen zunächst Programmiersprachen, aber ignorieren die Datenbank selbst: Kann sie den Anforderungen erfüllen? Ist Datenmigration oder strukturelle Anpassung erforderlich? Kann MySQL einer so großen Datenbelastung standhalten? Voranalyse: Schlüsselfilter und Eigenschaften müssen identifiziert werden. Nach der Analyse wurde festgestellt, dass nur wenige Attribute mit der Lösung zusammenhängen. Wir haben die Machbarkeit des Filters überprüft und einige Einschränkungen festgelegt, um die Suche zu optimieren. Kartensuche basierend auf der Stadt

Wie man MySQL löst, kann nicht gestartet werden

Apr 08, 2025 pm 02:21 PM

Wie man MySQL löst, kann nicht gestartet werden

Apr 08, 2025 pm 02:21 PM

Es gibt viele Gründe, warum MySQL Startup fehlschlägt und durch Überprüfung des Fehlerprotokolls diagnostiziert werden kann. Zu den allgemeinen Ursachen gehören Portkonflikte (prüfen Portbelegung und Änderung der Konfiguration), Berechtigungsprobleme (Überprüfen Sie den Dienst Ausführen von Benutzerberechtigungen), Konfigurationsdateifehler (Überprüfung der Parametereinstellungen), Datenverzeichniskorruption (Wiederherstellung von Daten oder Wiederaufbautabellenraum), InnoDB-Tabellenraumprobleme (prüfen IBDATA1-Dateien), Plug-in-Ladeversagen (Überprüfen Sie Fehlerprotokolle). Wenn Sie Probleme lösen, sollten Sie sie anhand des Fehlerprotokolls analysieren, die Hauptursache des Problems finden und die Gewohnheit entwickeln, Daten regelmäßig zu unterstützen, um Probleme zu verhindern und zu lösen.

So verwenden Sie MySQL nach der Installation

Apr 08, 2025 am 11:48 AM

So verwenden Sie MySQL nach der Installation

Apr 08, 2025 am 11:48 AM

Der Artikel führt den Betrieb der MySQL -Datenbank vor. Zunächst müssen Sie einen MySQL -Client wie MySQLworkBench oder Befehlszeilen -Client installieren. 1. Verwenden Sie den Befehl mySQL-uroot-P, um eine Verbindung zum Server herzustellen und sich mit dem Stammkonto-Passwort anzumelden. 2. Verwenden Sie die Erstellung von Createdatabase, um eine Datenbank zu erstellen, und verwenden Sie eine Datenbank aus. 3.. Verwenden Sie CreateTable, um eine Tabelle zu erstellen, Felder und Datentypen zu definieren. 4. Verwenden Sie InsertInto, um Daten einzulegen, Daten abzufragen, Daten nach Aktualisierung zu aktualisieren und Daten nach Löschen zu löschen. Nur indem Sie diese Schritte beherrschen, lernen, mit gemeinsamen Problemen umzugehen und die Datenbankleistung zu optimieren, können Sie MySQL effizient verwenden.

Verstehen von Säureeigenschaften: Die Säulen einer zuverlässigen Datenbank

Apr 08, 2025 pm 06:33 PM

Verstehen von Säureeigenschaften: Die Säulen einer zuverlässigen Datenbank

Apr 08, 2025 pm 06:33 PM

Detaillierte Erläuterung von Datenbanksäureattributen Säureattribute sind eine Reihe von Regeln, um die Zuverlässigkeit und Konsistenz von Datenbanktransaktionen sicherzustellen. Sie definieren, wie Datenbanksysteme Transaktionen umgehen, und sorgen dafür, dass die Datenintegrität und -genauigkeit auch im Falle von Systemabstürzen, Leistungsunterbrechungen oder mehreren Benutzern gleichzeitiger Zugriff. Säureattributübersicht Atomizität: Eine Transaktion wird als unteilbare Einheit angesehen. Jeder Teil schlägt fehl, die gesamte Transaktion wird zurückgerollt und die Datenbank behält keine Änderungen bei. Wenn beispielsweise eine Banküberweisung von einem Konto abgezogen wird, jedoch nicht auf ein anderes erhöht wird, wird der gesamte Betrieb widerrufen. begintransaktion; updateAccountsSetBalance = Balance-100WH

Kann MySQL JSON zurückgeben?

Apr 08, 2025 pm 03:09 PM

Kann MySQL JSON zurückgeben?

Apr 08, 2025 pm 03:09 PM

MySQL kann JSON -Daten zurückgeben. Die JSON_EXTRACT -Funktion extrahiert Feldwerte. Über komplexe Abfragen sollten Sie die Where -Klausel verwenden, um JSON -Daten zu filtern, aber auf die Leistungsauswirkungen achten. Die Unterstützung von MySQL für JSON nimmt ständig zu, und es wird empfohlen, auf die neuesten Versionen und Funktionen zu achten.

Remote Senior Backend Engineers (Plattformen) benötigen Kreise

Apr 08, 2025 pm 12:27 PM

Remote Senior Backend Engineers (Plattformen) benötigen Kreise

Apr 08, 2025 pm 12:27 PM

Remote Senior Backend Engineer Job Vacant Company: Circle Standort: Remote-Büro-Jobtyp: Vollzeitgehalt: 130.000 bis 140.000 US-Dollar Stellenbeschreibung Nehmen Sie an der Forschung und Entwicklung von Mobilfunkanwendungen und öffentlichen API-bezogenen Funktionen, die den gesamten Lebenszyklus der Softwareentwicklung abdecken. Die Hauptaufgaben erledigen die Entwicklungsarbeit unabhängig von RubyonRails und arbeiten mit dem Front-End-Team von React/Redux/Relay zusammen. Erstellen Sie die Kernfunktionalität und -verbesserungen für Webanwendungen und arbeiten Sie eng mit Designer und Führung während des gesamten funktionalen Designprozesses zusammen. Fördern Sie positive Entwicklungsprozesse und priorisieren Sie die Iterationsgeschwindigkeit. Erfordert mehr als 6 Jahre komplexes Backend für Webanwendungen

MySQL kann nach dem Herunterladen nicht installiert werden

Apr 08, 2025 am 11:24 AM

MySQL kann nach dem Herunterladen nicht installiert werden

Apr 08, 2025 am 11:24 AM

Die Hauptgründe für den Fehler bei MySQL -Installationsfehlern sind: 1. Erlaubnisprobleme, Sie müssen als Administrator ausgeführt oder den Sudo -Befehl verwenden. 2. Die Abhängigkeiten fehlen, und Sie müssen relevante Entwicklungspakete installieren. 3. Portkonflikte müssen Sie das Programm schließen, das Port 3306 einnimmt, oder die Konfigurationsdatei ändern. 4. Das Installationspaket ist beschädigt. Sie müssen die Integrität herunterladen und überprüfen. 5. Die Umgebungsvariable ist falsch konfiguriert und die Umgebungsvariablen müssen korrekt entsprechend dem Betriebssystem konfiguriert werden. Lösen Sie diese Probleme und überprüfen Sie jeden Schritt sorgfältig, um MySQL erfolgreich zu installieren.

Laravel eloquent orm bei bangla partieller Modellsuche)

Apr 08, 2025 pm 02:06 PM

Laravel eloquent orm bei bangla partieller Modellsuche)

Apr 08, 2025 pm 02:06 PM

Laraveleloquent-Modellab Abruf: Das Erhalten von Datenbankdaten Eloquentorm bietet eine prägnante und leicht verständliche Möglichkeit, die Datenbank zu bedienen. In diesem Artikel werden verschiedene eloquente Modellsuchtechniken im Detail eingeführt, um Daten aus der Datenbank effizient zu erhalten. 1. Holen Sie sich alle Aufzeichnungen. Verwenden Sie die Methode All (), um alle Datensätze in der Datenbanktabelle zu erhalten: UseApp \ Models \ post; $ posts = post :: all (); Dies wird eine Sammlung zurückgeben. Sie können mit der Foreach-Schleife oder anderen Sammelmethoden auf Daten zugreifen: foreach ($ postas $ post) {echo $ post->