Technologie-Peripheriegeräte

Technologie-Peripheriegeräte

KI

KI

PandaLM, ein Open-Source-„Schiedsrichter-Großmodell' der Peking-Universität, der West Lake University und anderen: drei Codezeilen zur vollautomatischen Bewertung von LLM mit einer Genauigkeit von 94 % von ChatGPT

PandaLM, ein Open-Source-„Schiedsrichter-Großmodell' der Peking-Universität, der West Lake University und anderen: drei Codezeilen zur vollautomatischen Bewertung von LLM mit einer Genauigkeit von 94 % von ChatGPT

PandaLM, ein Open-Source-„Schiedsrichter-Großmodell' der Peking-Universität, der West Lake University und anderen: drei Codezeilen zur vollautomatischen Bewertung von LLM mit einer Genauigkeit von 94 % von ChatGPT

Nach der Veröffentlichung von ChatGPT hat sich das Ökosystem im Bereich der Verarbeitung natürlicher Sprache völlig verändert. Viele Probleme, die zuvor nicht gelöst werden konnten, können mit ChatGPT gelöst werden.

Aber es bringt auch ein Problem mit sich: Die Leistung großer Modelle ist zu stark und es ist schwierig, die Unterschiede der einzelnen Modelle mit bloßem Auge zu beurteilen#🎜🎜 ##🎜🎜 #.

Wenn beispielsweise mehrere Versionen des Modells mit unterschiedlichen Basismodellen und Hyperparametern trainiert werden, kann die Leistung in den Beispielen ähnlich sein und es ist unmöglich, sie vollständig zu quantifizieren Der Unterschied zwischen den beiden Modellen.Derzeit

Bewertung großer SprachmodelleEs gibt zwei Hauptoptionen: #🎜🎜 #1. Rufen Sie die API-Schnittstellenbewertung von OpenAI auf.

ChatGPT kann verwendet werden, um die Qualität der Ausgabe zweier Modelle zu bewerten. ChatGPT wurde jedoch iterativ aktualisiert, und die Antworten auf dieselbe Frage können zu unterschiedlichen Zeiten erfolgen anders sein. Auswertung Dadurch entsteht ein Problem, das

nicht reproduziert werden kann. 2. Manuelle Anmerkung

Wenn Sie auf der Crowdsourcing-Plattform nach manueller Anmerkung fragen, #🎜🎜 Teams mit unzureichenden Mitteln

können es sich möglicherweise nicht leisten, und es gibt auch Fälle, in denen DrittunternehmenDaten preisgeben. Um solche „großen Modellbewertungsprobleme“ zu lösen, haben Forscher der Peking University, der West Lake University, der North Carolina State University, der Carnegie Mellon University und MSRA gemeinsam gearbeitet hat mit PandaLM ein neues Framework zur Bewertung von Sprachmodellen entwickelt, das sich der Realisierung datenschutzschonender, zuverlässiger, reproduzierbarer und kostengünstiger Lösungen zur Bewertung großer Modelle widmet.

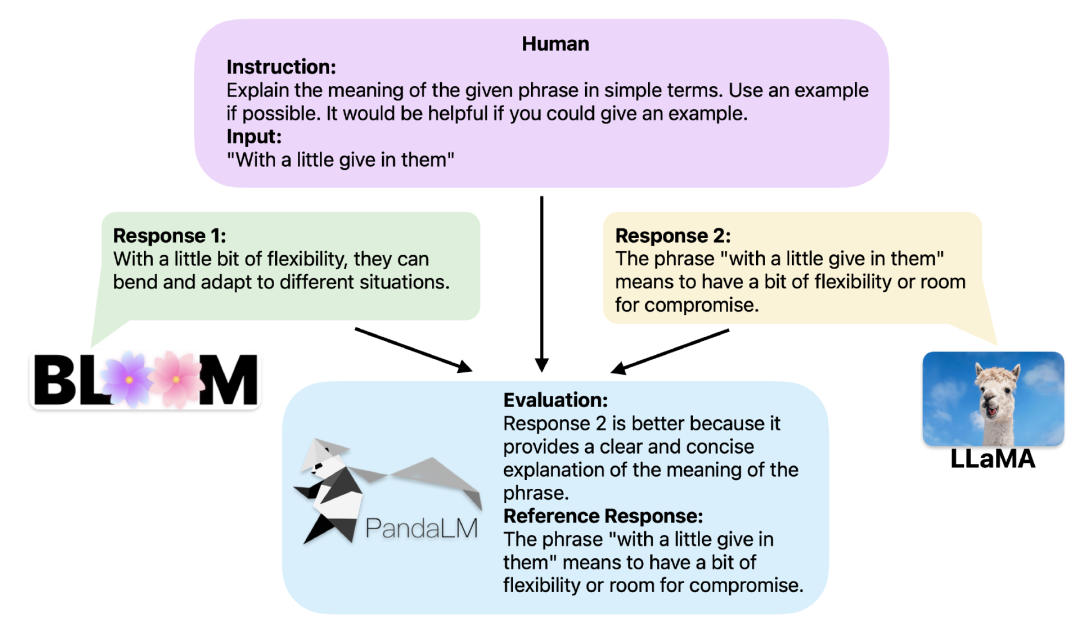

Bei gleichem Kontext kann PandaLM die Antwortausgabe verschiedener LLMs vergleichen und spezifische Gründe angeben.

Um die Zuverlässigkeit und Konsistenz des Tools zu demonstrieren, erstellten die Forscher einen vielfältigen, von Menschen kommentierten Testdatensatz, der aus etwa 1.000 Proben besteht, wobei PandaLM eine Genauigkeit von -7B von 94 % erreicht der Bewertungsfähigkeit von ChatGPT

.Drei Codezeilen verwenden PandaLM

Wenn zwei verschiedene große Modelle unterschiedliche Antworten auf dieselbe Anweisung und denselben Kontext erzeugen, zielt PandaLM darauf ab, die zu vergleichen Antwortqualität dieser beiden großen Modelle und Ausgabe der Vergleichsergebnisse, Vergleichsgründe und Antworten als Referenz.Es gibt drei Vergleichsergebnisse: Antwort 1 ist besser, Antwort 2 ist besser, Antwort 1 und Antwort 2 sind von ähnlicher Qualität.

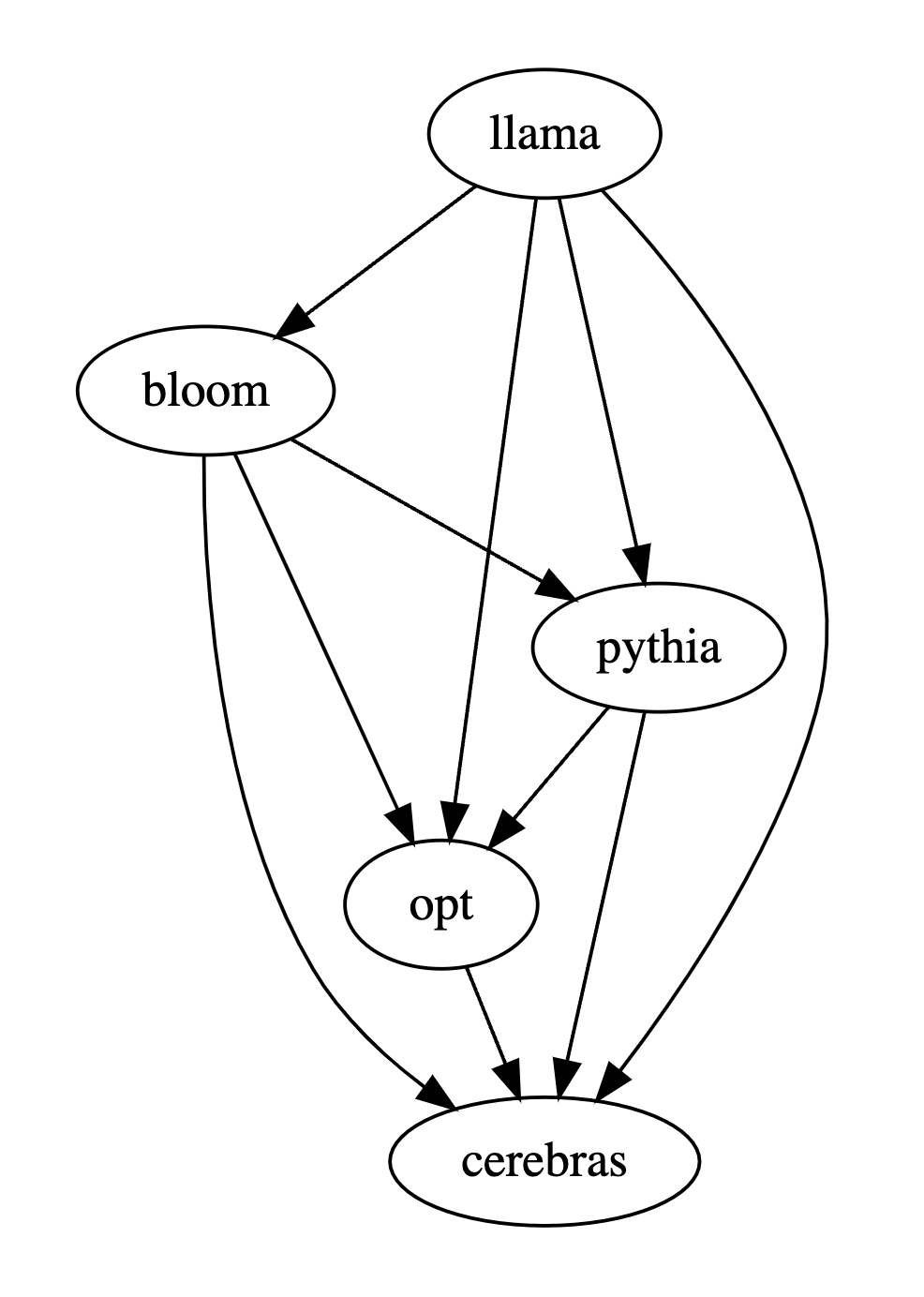

Wenn Sie die Leistung mehrerer großer Modelle vergleichen, verwenden Sie einfach PandaLM, um sie paarweise zu vergleichen, und fassen Sie dann die Ergebnisse der paarweisen Vergleiche zusammen, um die Leistung mehrerer großer Modelle zu vergleichen Durch Rangfolge oder Zeichnen eines Beziehungsdiagramms der Teilordnung eines Modells können Sie die Leistungsunterschiede zwischen verschiedenen Modellen klar und intuitiv analysieren.

PandaLM muss nur „lokal bereitgestellt“ werden und „erfordert keine menschliche Beteiligung“, sodass die Bewertung von PandaLM die Privatsphäre schützen kann und recht kostengünstig ist.

Um eine bessere Interpretierbarkeit zu gewährleisten, kann PandaLM seine Auswahl auch in natürlicher Sprache erklären und einen zusätzlichen Satz von Referenzantworten generieren.

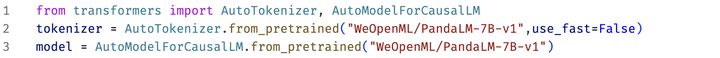

Im Projekt unterstützen die Forscher nicht nur die Nutzung von PandaLM über das Web Die Benutzeroberfläche unterstützt zur Fallanalyse und zur Vereinfachung der Verwendung auch drei Codezeilen zum Aufrufen von PandaLM zur Textauswertung, die von beliebigen Modellen und Daten generiert wird.

Im Projekt unterstützen die Forscher nicht nur die Nutzung von PandaLM über das Web Die Benutzeroberfläche unterstützt zur Fallanalyse und zur Vereinfachung der Verwendung auch drei Codezeilen zum Aufrufen von PandaLM zur Textauswertung, die von beliebigen Modellen und Daten generiert wird.

Angesichts der Tatsache, dass viele bestehende Modelle und Frameworks nicht Open Source sind oder es schwierig ist, die Inferenz lokal durchzuführen, unterstützt PandaLM die Verwendung bestimmter Modellgewichte zum Generieren von auszuwertendem Text oder die direkte Übergabe einer .json-Datei, die den auszuwertenden Text enthält.

Benutzer können PandaLM nutzen, um benutzerdefinierte Modelle und Eingabedaten auszuwerten, indem sie einfach eine Liste mit dem Modellnamen/HuggingFace-Modell-ID oder dem .json-Dateipfad übergeben. Das Folgende ist ein minimalistisches Anwendungsbeispiel:

Um jedem die flexible Nutzung von PandaLM zur kostenlosen Evaluierung zu ermöglichen, haben die Forscher auch die Modellgewichte von PandaLM auf der Huggingface-Website veröffentlicht, die über geladen werden kann Folgender Befehl PandaLM-7B-Modell:

Funktionen von PandaLM

Reproduzierbarkeit

Da die Gewichte von PandaLM öffentlich sind, auch wenn die Ausgabe des Sprachmodells Zufälligkeit aufweist, wenn behoben Nach dem zufälligen Seeding können die Bewertungsergebnisse von PandaLM immer noch konsistent bleiben.

Die Aktualisierung des Modells basierend auf der Online-API ist undurchsichtig, seine Ausgabe kann zu verschiedenen Zeiten sehr inkonsistent sein und die alte Version des Modells ist nicht mehr zugänglich, sodass die Bewertung basierend auf der Online-API häufig nicht möglich ist reproduzierbar.

Automatisierung, Datenschutz und geringer Overhead

Stellen Sie das PandaLM-Modell einfach lokal bereit und rufen Sie vorgefertigte Befehle auf, um mit der Evaluierung verschiedener großer Modelle zu beginnen. Es ist nicht erforderlich, mit Experten in Kontakt zu bleiben, wie dies bei der Einstellung von Experten der Fall ist Annotation Es gibt kein Problem von Datenlecks während der Kommunikation und es fallen keine API-Gebühren oder Arbeitskosten an, was es sehr kostengünstig macht.

Bewertungsebene

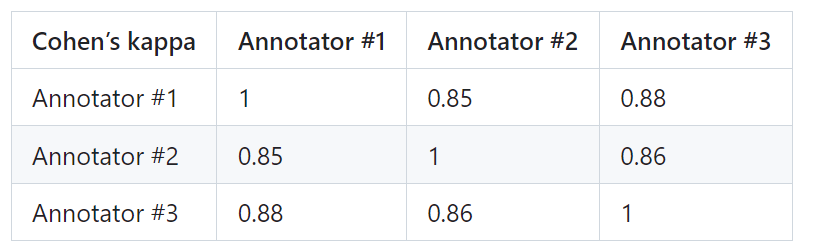

Um die Zuverlässigkeit von PandaLM zu beweisen, beauftragten die Forscher drei Experten mit der Durchführung unabhängiger wiederholter Annotationen und erstellten einen manuell annotierten Testsatz.

Das Testset enthält 50 verschiedene Szenen und jede Szene enthält mehrere Aufgaben. Dieser Testsatz ist vielfältig, zuverlässig und entspricht den menschlichen Vorlieben für Text. Jede Stichprobe des Testsatzes besteht aus einer Anweisung und einem Kontext sowie zwei Antworten, die von verschiedenen großen Modellen generiert werden, und die Qualität der beiden Antworten wird von Menschen verglichen.

Screenen Sie Proben mit großen Unterschieden zwischen Annotatoren aus, um sicherzustellen, dass die IAA (Inter Annotator Agreement) jedes Annotators im endgültigen Testsatz nahe bei 0,85 liegt. Es ist erwähnenswert, dass der Trainingssatz von PandaLM keine Überschneidungen mit dem manuell annotierten Testsatz aufweist, der erstellt wurde.

Diese gefilterten Proben erfordern zusätzliches Wissen oder schwer zu beschaffende Informationen zur Beurteilung, was es für Menschen schwierig macht, sie genau zu kennzeichnen.

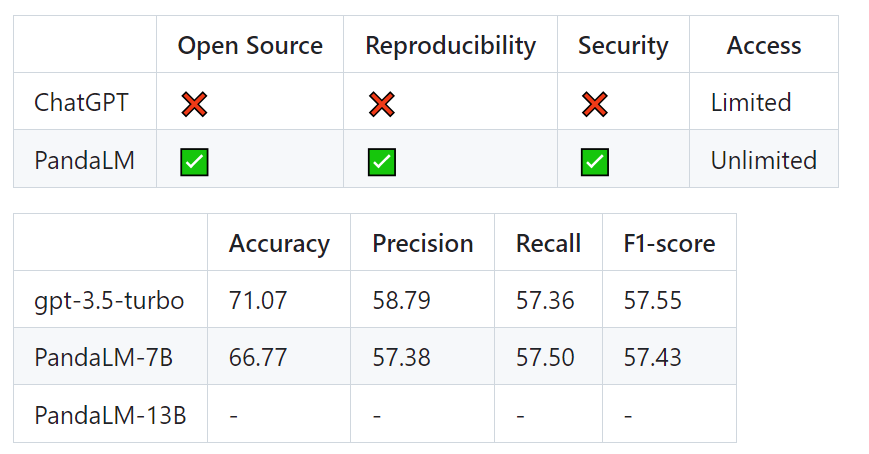

Der gefilterte Testsatz enthält 1000 Proben, während der ursprüngliche ungefilterte Testsatz 2500 Proben enthält. Die Verteilung des Testsatzes beträgt {0:105, 1:422, 2:472}, wobei 0 angibt, dass die beiden Antworten von ähnlicher Qualität sind, 1 angibt, dass Antwort 1 besser ist, und 2 angibt, dass Antwort 2 besser ist. Unter Berücksichtigung des menschlichen Testsatzes als Benchmark sieht der Leistungsvergleich zwischen PandaLM und gpt-3.5-turbo wie folgt aus:

Es ist ersichtlich, dass PandaLM-7B das Niveau von gpt-3.5-turbo 94 erreicht hat % in Bezug auf Präzision, Rückruf und F1-Score ist PandaLM-7B fast das gleiche wie gpt-3.5-turbo.

Daher kann man im Vergleich zu gpt-3.5-turbo davon ausgehen, dass PandaLM-7B bereits über beträchtliche Fähigkeiten zur Evaluierung großer Modelle verfügt.

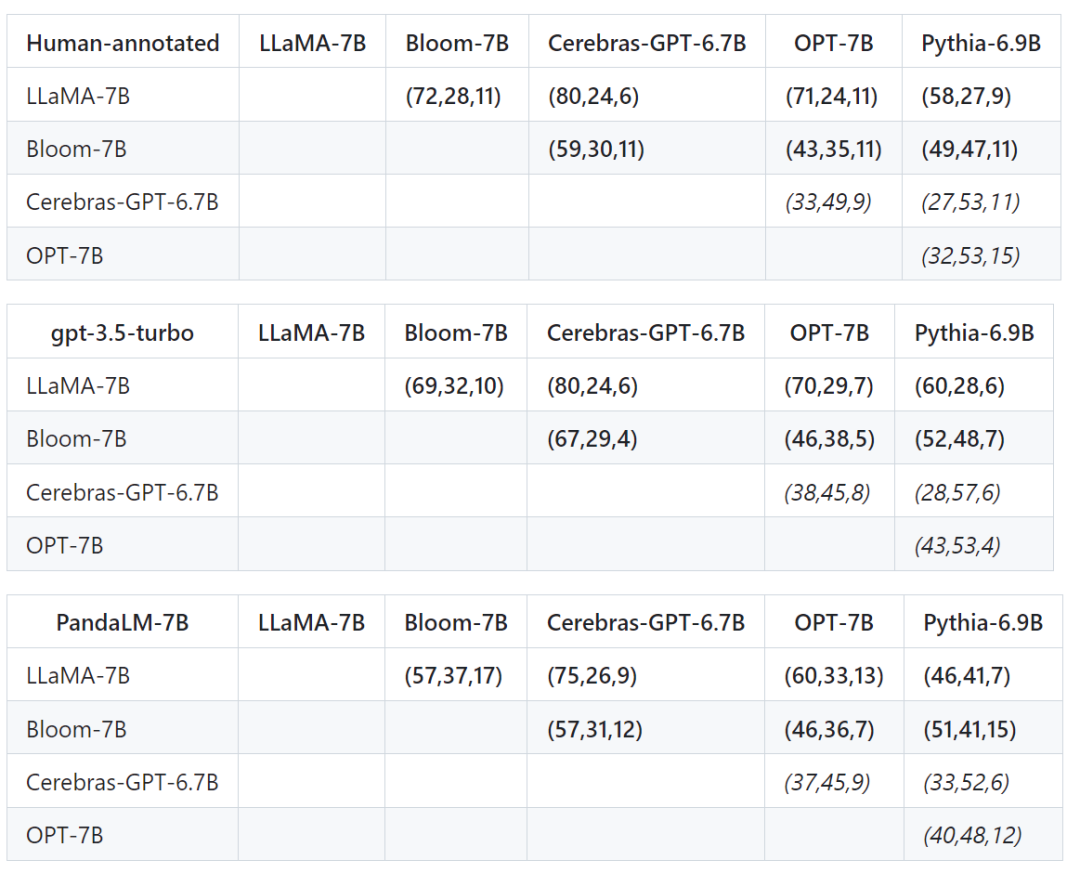

Zusätzlich zu Genauigkeit, Präzision, Rückruf und F1-Score des Testsatzes liefert es auch Vergleichsergebnisse zwischen 5 großen Open-Source-Modellen ähnlicher Größe.

Zuerst verwendeten wir dieselben Trainingsdaten zur Feinabstimmung der fünf Modelle und verwendeten dann Menschen, gpt-3.5-turbo und PandaLM, um die fünf Modelle jeweils zu vergleichen.

Das erste Tupel (72, 28, 11) in der ersten Zeile der Tabelle unten zeigt an, dass es 72 LLaMA-7B-Antworten gibt, die besser sind als Bloom-7B, und 28 LLaMA-7B-Antworten sind besser als Bloom- 7B Der Unterschied besteht darin, dass die beiden Modelle 11 ähnliche Antwortqualitäten haben.

In diesem Beispiel denken Menschen also, dass LLaMA-7B besser ist als Bloom-7B. Die Ergebnisse in den folgenden drei Tabellen zeigen, dass Menschen, gpt-3.5-turbo und PandaLM-7B völlig übereinstimmende Urteile über die Beziehung zwischen den Vor- und Nachteilen der einzelnen Modelle haben.

Zusammenfassung

PandaLM bietet neben der menschlichen Bewertung und der OpenAI-API-Bewertung eine dritte Lösung zur Bewertung großer Modelle. PandaLM verfügt nicht nur über ein hohes Bewertungsniveau, sondern auch die Bewertungsergebnisse sind reproduzierbar und die Bewertung Der Prozess ist automatisiert, datenschutzschonend und mit geringem Aufwand verbunden.

In Zukunft wird PandaLM die Forschung an großen Modellen in Wissenschaft und Industrie fördern, damit mehr Menschen von der Entwicklung großer Modelle profitieren können.

Das obige ist der detaillierte Inhalt vonPandaLM, ein Open-Source-„Schiedsrichter-Großmodell' der Peking-Universität, der West Lake University und anderen: drei Codezeilen zur vollautomatischen Bewertung von LLM mit einer Genauigkeit von 94 % von ChatGPT. Für weitere Informationen folgen Sie bitte anderen verwandten Artikeln auf der PHP chinesischen Website!

Heiße KI -Werkzeuge

Undresser.AI Undress

KI-gestützte App zum Erstellen realistischer Aktfotos

AI Clothes Remover

Online-KI-Tool zum Entfernen von Kleidung aus Fotos.

Undress AI Tool

Ausziehbilder kostenlos

Clothoff.io

KI-Kleiderentferner

AI Hentai Generator

Erstellen Sie kostenlos Ai Hentai.

Heißer Artikel

Heiße Werkzeuge

Notepad++7.3.1

Einfach zu bedienender und kostenloser Code-Editor

SublimeText3 chinesische Version

Chinesische Version, sehr einfach zu bedienen

Senden Sie Studio 13.0.1

Leistungsstarke integrierte PHP-Entwicklungsumgebung

Dreamweaver CS6

Visuelle Webentwicklungstools

SublimeText3 Mac-Version

Codebearbeitungssoftware auf Gottesniveau (SublimeText3)

Heiße Themen

1382

1382

52

52

Das weltweit leistungsstärkste Open-Source-MoE-Modell ist da, mit chinesischen Fähigkeiten, die mit GPT-4 vergleichbar sind, und der Preis beträgt nur fast ein Prozent von GPT-4-Turbo

May 07, 2024 pm 04:13 PM

Das weltweit leistungsstärkste Open-Source-MoE-Modell ist da, mit chinesischen Fähigkeiten, die mit GPT-4 vergleichbar sind, und der Preis beträgt nur fast ein Prozent von GPT-4-Turbo

May 07, 2024 pm 04:13 PM

Stellen Sie sich ein Modell der künstlichen Intelligenz vor, das nicht nur die Fähigkeit besitzt, die traditionelle Datenverarbeitung zu übertreffen, sondern auch eine effizientere Leistung zu geringeren Kosten erzielt. Dies ist keine Science-Fiction, DeepSeek-V2[1], das weltweit leistungsstärkste Open-Source-MoE-Modell, ist da. DeepSeek-V2 ist ein leistungsstarkes MoE-Sprachmodell (Mix of Experts) mit den Merkmalen eines wirtschaftlichen Trainings und einer effizienten Inferenz. Es besteht aus 236B Parametern, von denen 21B zur Aktivierung jedes Markers verwendet werden. Im Vergleich zu DeepSeek67B bietet DeepSeek-V2 eine stärkere Leistung, spart gleichzeitig 42,5 % der Trainingskosten, reduziert den KV-Cache um 93,3 % und erhöht den maximalen Generierungsdurchsatz auf das 5,76-fache. DeepSeek ist ein Unternehmen, das sich mit allgemeiner künstlicher Intelligenz beschäftigt

KI untergräbt die mathematische Forschung! Der Gewinner der Fields-Medaille und der chinesisch-amerikanische Mathematiker führten 11 hochrangige Arbeiten an | Gefällt mir bei Terence Tao

Apr 09, 2024 am 11:52 AM

KI untergräbt die mathematische Forschung! Der Gewinner der Fields-Medaille und der chinesisch-amerikanische Mathematiker führten 11 hochrangige Arbeiten an | Gefällt mir bei Terence Tao

Apr 09, 2024 am 11:52 AM

KI verändert tatsächlich die Mathematik. Vor kurzem hat Tao Zhexuan, der diesem Thema große Aufmerksamkeit gewidmet hat, die neueste Ausgabe des „Bulletin of the American Mathematical Society“ (Bulletin der American Mathematical Society) weitergeleitet. Zum Thema „Werden Maschinen die Mathematik verändern?“ äußerten viele Mathematiker ihre Meinung. Der gesamte Prozess war voller Funken, knallhart und aufregend. Der Autor verfügt über eine starke Besetzung, darunter der Fields-Medaillengewinner Akshay Venkatesh, der chinesische Mathematiker Zheng Lejun, der NYU-Informatiker Ernest Davis und viele andere bekannte Wissenschaftler der Branche. Die Welt der KI hat sich dramatisch verändert. Viele dieser Artikel wurden vor einem Jahr eingereicht.

Google ist begeistert: JAX-Leistung übertrifft Pytorch und TensorFlow! Es könnte die schnellste Wahl für das GPU-Inferenztraining werden

Apr 01, 2024 pm 07:46 PM

Google ist begeistert: JAX-Leistung übertrifft Pytorch und TensorFlow! Es könnte die schnellste Wahl für das GPU-Inferenztraining werden

Apr 01, 2024 pm 07:46 PM

Die von Google geförderte Leistung von JAX hat in jüngsten Benchmark-Tests die von Pytorch und TensorFlow übertroffen und belegt bei 7 Indikatoren den ersten Platz. Und der Test wurde nicht auf der TPU mit der besten JAX-Leistung durchgeführt. Obwohl unter Entwicklern Pytorch immer noch beliebter ist als Tensorflow. Aber in Zukunft werden möglicherweise mehr große Modelle auf Basis der JAX-Plattform trainiert und ausgeführt. Modelle Kürzlich hat das Keras-Team drei Backends (TensorFlow, JAX, PyTorch) mit der nativen PyTorch-Implementierung und Keras2 mit TensorFlow verglichen. Zunächst wählen sie eine Reihe von Mainstream-Inhalten aus

Hallo, elektrischer Atlas! Der Boston Dynamics-Roboter erwacht wieder zum Leben, seltsame 180-Grad-Bewegungen machen Musk Angst

Apr 18, 2024 pm 07:58 PM

Hallo, elektrischer Atlas! Der Boston Dynamics-Roboter erwacht wieder zum Leben, seltsame 180-Grad-Bewegungen machen Musk Angst

Apr 18, 2024 pm 07:58 PM

Boston Dynamics Atlas tritt offiziell in die Ära der Elektroroboter ein! Gestern hat sich der hydraulische Atlas einfach „unter Tränen“ von der Bühne der Geschichte zurückgezogen. Heute gab Boston Dynamics bekannt, dass der elektrische Atlas im Einsatz ist. Es scheint, dass Boston Dynamics im Bereich kommerzieller humanoider Roboter entschlossen ist, mit Tesla zu konkurrieren. Nach der Veröffentlichung des neuen Videos wurde es innerhalb von nur zehn Stunden bereits von mehr als einer Million Menschen angesehen. Die alten Leute gehen und neue Rollen entstehen. Das ist eine historische Notwendigkeit. Es besteht kein Zweifel, dass dieses Jahr das explosive Jahr der humanoiden Roboter ist. Netizens kommentierten: Die Weiterentwicklung der Roboter hat dazu geführt, dass die diesjährige Eröffnungsfeier wie Menschen aussieht, und der Freiheitsgrad ist weitaus größer als der von Menschen. Aber ist das wirklich kein Horrorfilm? Zu Beginn des Videos liegt Atlas ruhig auf dem Boden, scheinbar auf dem Rücken. Was folgt, ist atemberaubend

KAN, das MLP ersetzt, wurde durch Open-Source-Projekte auf Faltung erweitert

Jun 01, 2024 pm 10:03 PM

KAN, das MLP ersetzt, wurde durch Open-Source-Projekte auf Faltung erweitert

Jun 01, 2024 pm 10:03 PM

Anfang dieses Monats schlugen Forscher des MIT und anderer Institutionen eine vielversprechende Alternative zu MLP vor – KAN. KAN übertrifft MLP in Bezug auf Genauigkeit und Interpretierbarkeit. Und es kann MLP, das mit einer größeren Anzahl von Parametern ausgeführt wird, mit einer sehr kleinen Anzahl von Parametern übertreffen. Beispielsweise gaben die Autoren an, dass sie KAN nutzten, um die Ergebnisse von DeepMind mit einem kleineren Netzwerk und einem höheren Automatisierungsgrad zu reproduzieren. Konkret verfügt DeepMinds MLP über etwa 300.000 Parameter, während KAN nur etwa 200 Parameter hat. KAN hat eine starke mathematische Grundlage wie MLP und basiert auf dem universellen Approximationssatz, während KAN auf dem Kolmogorov-Arnold-Darstellungssatz basiert. Wie in der folgenden Abbildung gezeigt, hat KAN

Empfohlen: Ausgezeichnetes JS-Open-Source-Projekt zur Gesichtserkennung und -erkennung

Apr 03, 2024 am 11:55 AM

Empfohlen: Ausgezeichnetes JS-Open-Source-Projekt zur Gesichtserkennung und -erkennung

Apr 03, 2024 am 11:55 AM

Die Technologie zur Gesichtserkennung und -erkennung ist bereits eine relativ ausgereifte und weit verbreitete Technologie. Derzeit ist JS die am weitesten verbreitete Internetanwendungssprache. Die Implementierung der Gesichtserkennung und -erkennung im Web-Frontend hat im Vergleich zur Back-End-Gesichtserkennung Vor- und Nachteile. Zu den Vorteilen gehören die Reduzierung der Netzwerkinteraktion und die Echtzeiterkennung, was die Wartezeit des Benutzers erheblich verkürzt und das Benutzererlebnis verbessert. Die Nachteile sind: Es ist durch die Größe des Modells begrenzt und auch die Genauigkeit ist begrenzt. Wie implementiert man mit js die Gesichtserkennung im Web? Um die Gesichtserkennung im Web zu implementieren, müssen Sie mit verwandten Programmiersprachen und -technologien wie JavaScript, HTML, CSS, WebRTC usw. vertraut sein. Gleichzeitig müssen Sie auch relevante Technologien für Computer Vision und künstliche Intelligenz beherrschen. Dies ist aufgrund des Designs der Webseite erwähnenswert

Tesla-Roboter arbeiten in Fabriken, Musk: Der Freiheitsgrad der Hände wird dieses Jahr 22 erreichen!

May 06, 2024 pm 04:13 PM

Tesla-Roboter arbeiten in Fabriken, Musk: Der Freiheitsgrad der Hände wird dieses Jahr 22 erreichen!

May 06, 2024 pm 04:13 PM

Das neueste Video von Teslas Roboter Optimus ist veröffentlicht und er kann bereits in der Fabrik arbeiten. Bei normaler Geschwindigkeit sortiert es Batterien (Teslas 4680-Batterien) so: Der Beamte hat auch veröffentlicht, wie es bei 20-facher Geschwindigkeit aussieht – auf einer kleinen „Workstation“, pflücken und pflücken und pflücken: Dieses Mal wird es freigegeben. Eines der Highlights Der Vorteil des Videos besteht darin, dass Optimus diese Arbeit in der Fabrik völlig autonom und ohne menschliches Eingreifen während des gesamten Prozesses erledigt. Und aus Sicht von Optimus kann es auch die krumme Batterie aufnehmen und platzieren, wobei der Schwerpunkt auf der automatischen Fehlerkorrektur liegt: In Bezug auf die Hand von Optimus gab der NVIDIA-Wissenschaftler Jim Fan eine hohe Bewertung ab: Die Hand von Optimus ist der fünffingrige Roboter der Welt am geschicktesten. Seine Hände sind nicht nur taktil

FisheyeDetNet: der erste Zielerkennungsalgorithmus basierend auf einer Fischaugenkamera

Apr 26, 2024 am 11:37 AM

FisheyeDetNet: der erste Zielerkennungsalgorithmus basierend auf einer Fischaugenkamera

Apr 26, 2024 am 11:37 AM

Die Zielerkennung ist ein relativ ausgereiftes Problem in autonomen Fahrsystemen, wobei die Fußgängererkennung einer der ersten Algorithmen ist, die eingesetzt werden. In den meisten Arbeiten wurde eine sehr umfassende Recherche durchgeführt. Die Entfernungswahrnehmung mithilfe von Fischaugenkameras für die Rundumsicht ist jedoch relativ wenig untersucht. Aufgrund der großen radialen Verzerrung ist es schwierig, die standardmäßige Bounding-Box-Darstellung in Fischaugenkameras zu implementieren. Um die obige Beschreibung zu vereinfachen, untersuchen wir erweiterte Begrenzungsrahmen-, Ellipsen- und allgemeine Polygondesigns in Polar-/Winkeldarstellungen und definieren eine mIOU-Metrik für die Instanzsegmentierung, um diese Darstellungen zu analysieren. Das vorgeschlagene Modell „fisheyeDetNet“ mit polygonaler Form übertrifft andere Modelle und erreicht gleichzeitig 49,5 % mAP auf dem Valeo-Fisheye-Kameradatensatz für autonomes Fahren