Technologie-Peripheriegeräte

Technologie-Peripheriegeräte

KI

KI

Selbstregulierung ist heute der Kontrollstandard für künstliche Intelligenz

Selbstregulierung ist heute der Kontrollstandard für künstliche Intelligenz

Selbstregulierung ist heute der Kontrollstandard für künstliche Intelligenz

Befürchten Sie, dass sich künstliche Intelligenz zu schnell entwickelt und negative Folgen haben könnte? Wünschen Sie sich, dass es ein nationales Gesetz gäbe, das dies regelt? Heutzutage gibt es keine neuen Gesetze, die den Einsatz von KI einschränken, und oft ist Selbstregulierung die beste Option für Unternehmen, die KI einführen – zumindest vorerst. Obwohl „künstliche Intelligenz“ seit vielen Jahren „Big Data“ als heißestes Schlagwort in der Technologiewelt abgelöst hat, löste der Start von ChatGPT Ende November 2022 einen KI-Goldrausch aus, der viele KI-Beobachter, darunter auch uns, überraschte. In nur wenigen Monaten haben eine Vielzahl leistungsstarker generativer KI-Modelle dank ihrer bemerkenswerten Fähigkeit, menschliche Sprache und menschliches Verständnis nachzuahmen, die Aufmerksamkeit der Welt auf sich gezogen. Der außergewöhnliche Aufstieg generativer Modelle in der Mainstream-Kultur, der durch das Aufkommen von ChatGPT vorangetrieben wird, wirft viele Fragen darüber auf, wohin das alles führt. Das erstaunliche Phänomen der künstlichen Intelligenz, die fesselnde Poesie und skurrile Kunst hervorbringen kann, weicht der Besorgnis über die negativen Folgen der künstlichen Intelligenz, die von Verbraucherschäden und Arbeitsplatzverlusten bis hin zu Freiheitsstrafen und sogar der Zerstörung der Menschheit reichen.

Das macht einigen Menschen große Sorgen. Letzten Monat beantragte eine Koalition von KI-Forschern ein sechsmonatiges Moratorium für die Entwicklung neuer generativer Modelle, die größer als GPT-4 sind (Weiterführende Literatur: Offener Brief fordert Moratorium für KI-Forschung), GPT-4, das massive Modell, das OpenAI letzten Monat eingeführt hat Sprachmodell (LLM).

Das macht einigen Menschen große Sorgen. Letzten Monat beantragte eine Koalition von KI-Forschern ein sechsmonatiges Moratorium für die Entwicklung neuer generativer Modelle, die größer als GPT-4 sind (Weiterführende Literatur: Offener Brief fordert Moratorium für KI-Forschung), GPT-4, das massive Modell, das OpenAI letzten Monat eingeführt hat Sprachmodell (LLM).

In einem offenen Brief, der vom Turing-Preisträger Yoshua Bengio und OpenAI-Mitbegründer Elon Musk und anderen unterzeichnet wurde, heißt es: „Fortgeschrittene künstliche Intelligenz könnte eine bedeutende Veränderung in der Geschichte von darstellen.“ Tiefgreifende Veränderungen sollten mit angemessener Sorgfalt und Ressourcen geplant und bewältigt werden. „Leider wurde dieses Maß an Planung und Management nicht erreicht.“ Umfragen zeigen, dass die Amerikaner der Meinung sind, dass künstliche Intelligenz nicht vertrauenswürdig ist, und dass sie eine Regulierung wünschen, insbesondere in Bezug auf wirkungsvolle Dinge wie selbstfahrende Autos und den Zugang zu staatlichen Leistungen.

Doch trotz mehrerer neuer lokaler Gesetze, die auf KI abzielen – beispielsweise eines in New York City, das sich auf den Einsatz von KI bei der Einstellung konzentriert, wurden die Durchsetzungsbemühungen bis jetzt verzögert Monat – Der Kongress hat keine neuen Bundesvorschriften, die speziell auf künstliche Intelligenz abzielen, da diese sich der Ziellinie nähert (obwohl KI in stark regulierten Branchen wie Finanzdienstleistungen und Gesundheitswesen Eingang in die Gesetzgebung gefunden hat).

Was sollte ein Unternehmen unter der Stimulation künstlicher Intelligenz tun? Es ist keine Überraschung, dass Unternehmen die Vorteile der künstlichen Intelligenz teilen möchten. Schließlich gilt der Drang, „datengesteuert“ zu werden, als Überlebensnotwendigkeit im digitalen Zeitalter. Allerdings möchten Unternehmen auch die realen oder vermeintlichen negativen Folgen vermeiden, die sich aus einem unsachgemäßen Einsatz von KI ergeben können.

Künstliche Intelligenz ist wild „

西世界“. Andrew Burt, Gründer der Anwaltskanzlei für künstliche Intelligenz BNH.AI, sagte einmal: „Niemand weiß, wie man mit Risiken umgeht Frameworks, die Unternehmen zur Bewältigung von KI-Risiken nutzen können. Burt empfiehlt die Verwendung des Artificial Intelligence Risk Management Framework (

RMF: Risk Management Framework), das vom National Institute of Standards and Technology (NIST) stammt und Anfang dieses Jahres fertiggestellt wurde.

RMF hilft Unternehmen, darüber nachzudenken, wie ihre KI funktioniert und welche möglichen negativen Folgen sie haben kann. Es nutzt den Ansatz „Abbildung, Messung, Verwaltung und Steuerung“, um die Risiken des Einsatzes künstlicher Intelligenz in einer Vielzahl von Serviceangeboten zu verstehen und letztendlich zu mindern.Ein weiteres KI-Risikomanagement-Framework stammt von Cathy O'Neil, CEO von O'Neil Risk Advisory & Algorithmic Audit (ORCAA). ORCAA schlug ein Rahmenwerk namens „

Explainable Fairness“ vor.

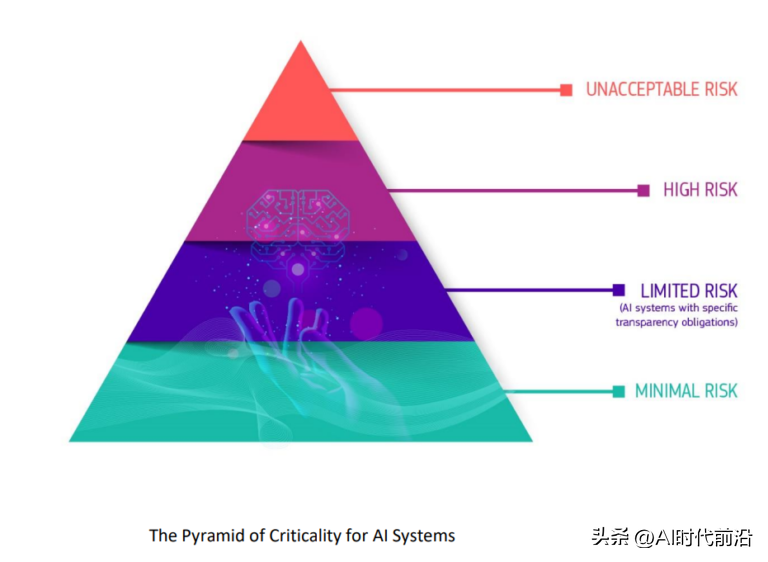

Erklärbare Fairness gibt Unternehmen die Möglichkeit, nicht nur ihre Algorithmen auf Verzerrungen zu testen, sondern auch zu untersuchen, was passiert, wenn Unterschiede in den Ergebnissen festgestellt werden. Wenn eine Bank beispielsweise über die Berechtigung für ein Studiendarlehen entscheidet, welche Faktoren können dann rechtlich herangezogen werden, um das Darlehen zu genehmigen oder abzulehnen oder höhere oder niedrigere Zinsen zu verlangen?Natürlich müssen Banken Daten nutzen, um diese Fragen zu beantworten. Aber welche Daten können sie nutzen – also welche Faktoren spiegeln einen Kreditantragsteller wider? Welche Faktoren sollten gesetzlich zulässig sein und welche nicht? Die Beantwortung dieser Fragen sei weder einfach noch einfach, sagte O'Neil. O'Neil sagte während einer Diskussion auf der Nvidia GPU Technology Conference (GTC) letzten Monat: „Darum geht es bei diesem Rahmenwerk, dass diese rechtlichen Faktoren legalisiert werden müssen.“ Daten Auch ohne Angesichts der neuen KI-Gesetze sollten sich Unternehmen fragen, wie sie KI fair und ethisch implementieren können, um bestehende Gesetze einzuhalten, sagte Triveni Gandhi, Leiterin des Analyse- und KI-Softwareanbieters Dataiku AI. „Die Leute müssen anfangen, darüber nachzudenken, okay, wie können wir die bestehenden Gesetze betrachten und sie auf die derzeit existierenden KI-Anwendungsfälle anwenden?“ „Es gibt einige Vorschriften, aber es wird auch viel darüber nachgedacht.“ was wir künstliche Intelligenz aufbauen wollen Ein ethischer und werteorientierter Ansatz für Intelligenz Das sind tatsächlich die Fragen, die sich Unternehmen stellen, auch ohne übergreifende Vorschriften Die EU stuft die potenziellen Schäden von KI ein eine „Kritikalitätspyramide“ Die EU treibt bereits eine eigene Verordnung voran, das Gesetz über künstliche Intelligenz, das noch in diesem Jahr in Kraft treten könnte. Mit dem Gesetz über künstliche Intelligenz wird ein gemeinsamer regulatorischer und rechtlicher Rahmen für den Einsatz künstlicher Intelligenz geschaffen, der sich auf EU-Bürger auswirkt, einschließlich der Art und Weise, wie KI entwickelt wird, zu welchen Zwecken Unternehmen sie verwenden können und welche Gesetze bei Nichteinhaltung von Anforderungen gelten als Ergebnis. Das Gesetz könnte von Unternehmen verlangen, dass sie in bestimmten Anwendungsfällen eine Genehmigung einholen, bevor sie KI einführen, und bestimmte andere als zu riskant erachtete KI-Anwendungen verbieten.

Das obige ist der detaillierte Inhalt vonSelbstregulierung ist heute der Kontrollstandard für künstliche Intelligenz. Für weitere Informationen folgen Sie bitte anderen verwandten Artikeln auf der PHP chinesischen Website!

Heiße KI -Werkzeuge

Undresser.AI Undress

KI-gestützte App zum Erstellen realistischer Aktfotos

AI Clothes Remover

Online-KI-Tool zum Entfernen von Kleidung aus Fotos.

Undress AI Tool

Ausziehbilder kostenlos

Clothoff.io

KI-Kleiderentferner

AI Hentai Generator

Erstellen Sie kostenlos Ai Hentai.

Heißer Artikel

Heiße Werkzeuge

Notepad++7.3.1

Einfach zu bedienender und kostenloser Code-Editor

SublimeText3 chinesische Version

Chinesische Version, sehr einfach zu bedienen

Senden Sie Studio 13.0.1

Leistungsstarke integrierte PHP-Entwicklungsumgebung

Dreamweaver CS6

Visuelle Webentwicklungstools

SublimeText3 Mac-Version

Codebearbeitungssoftware auf Gottesniveau (SublimeText3)

Heiße Themen

1376

1376

52

52

Bytedance Cutting führt SVIP-Supermitgliedschaft ein: 499 Yuan für ein fortlaufendes Jahresabonnement, das eine Vielzahl von KI-Funktionen bietet

Jun 28, 2024 am 03:51 AM

Bytedance Cutting führt SVIP-Supermitgliedschaft ein: 499 Yuan für ein fortlaufendes Jahresabonnement, das eine Vielzahl von KI-Funktionen bietet

Jun 28, 2024 am 03:51 AM

Diese Seite berichtete am 27. Juni, dass Jianying eine von FaceMeng Technology, einer Tochtergesellschaft von ByteDance, entwickelte Videobearbeitungssoftware ist, die auf der Douyin-Plattform basiert und grundsätzlich kurze Videoinhalte für Benutzer der Plattform produziert Windows, MacOS und andere Betriebssysteme. Jianying kündigte offiziell die Aktualisierung seines Mitgliedschaftssystems an und führte ein neues SVIP ein, das eine Vielzahl von KI-Schwarztechnologien umfasst, wie z. B. intelligente Übersetzung, intelligente Hervorhebung, intelligente Verpackung, digitale menschliche Synthese usw. Preislich beträgt die monatliche Gebühr für das Clipping von SVIP 79 Yuan, die Jahresgebühr 599 Yuan (Hinweis auf dieser Website: entspricht 49,9 Yuan pro Monat), das fortlaufende Monatsabonnement beträgt 59 Yuan pro Monat und das fortlaufende Jahresabonnement beträgt 499 Yuan pro Jahr (entspricht 41,6 Yuan pro Monat). Darüber hinaus erklärte der Cut-Beamte auch, dass diejenigen, die den ursprünglichen VIP abonniert haben, das Benutzererlebnis verbessern sollen

Kontexterweiterter KI-Codierungsassistent mit Rag und Sem-Rag

Jun 10, 2024 am 11:08 AM

Kontexterweiterter KI-Codierungsassistent mit Rag und Sem-Rag

Jun 10, 2024 am 11:08 AM

Verbessern Sie die Produktivität, Effizienz und Genauigkeit der Entwickler, indem Sie eine abrufgestützte Generierung und ein semantisches Gedächtnis in KI-Codierungsassistenten integrieren. Übersetzt aus EnhancingAICodingAssistantswithContextUsingRAGandSEM-RAG, Autor JanakiramMSV. Obwohl grundlegende KI-Programmierassistenten natürlich hilfreich sind, können sie oft nicht die relevantesten und korrektesten Codevorschläge liefern, da sie auf einem allgemeinen Verständnis der Softwaresprache und den gängigsten Mustern beim Schreiben von Software basieren. Der von diesen Coding-Assistenten generierte Code eignet sich zur Lösung der von ihnen zu lösenden Probleme, entspricht jedoch häufig nicht den Coding-Standards, -Konventionen und -Stilen der einzelnen Teams. Dabei entstehen häufig Vorschläge, die geändert oder verfeinert werden müssen, damit der Code in die Anwendung übernommen wird

Sieben coole technische Interviewfragen für GenAI und LLM

Jun 07, 2024 am 10:06 AM

Sieben coole technische Interviewfragen für GenAI und LLM

Jun 07, 2024 am 10:06 AM

Um mehr über AIGC zu erfahren, besuchen Sie bitte: 51CTOAI.x Community https://www.51cto.com/aigc/Translator|Jingyan Reviewer|Chonglou unterscheidet sich von der traditionellen Fragendatenbank, die überall im Internet zu sehen ist erfordert einen Blick über den Tellerrand hinaus. Large Language Models (LLMs) gewinnen in den Bereichen Datenwissenschaft, generative künstliche Intelligenz (GenAI) und künstliche Intelligenz zunehmend an Bedeutung. Diese komplexen Algorithmen verbessern die menschlichen Fähigkeiten, treiben Effizienz und Innovation in vielen Branchen voran und werden zum Schlüssel für Unternehmen, um wettbewerbsfähig zu bleiben. LLM hat ein breites Anwendungsspektrum und kann in Bereichen wie der Verarbeitung natürlicher Sprache, der Textgenerierung, der Spracherkennung und Empfehlungssystemen eingesetzt werden. Durch das Lernen aus großen Datenmengen ist LLM in der Lage, Text zu generieren

Kann LLM durch Feinabstimmung wirklich neue Dinge lernen: Die Einführung neuen Wissens kann dazu führen, dass das Modell mehr Halluzinationen hervorruft

Jun 11, 2024 pm 03:57 PM

Kann LLM durch Feinabstimmung wirklich neue Dinge lernen: Die Einführung neuen Wissens kann dazu führen, dass das Modell mehr Halluzinationen hervorruft

Jun 11, 2024 pm 03:57 PM

Large Language Models (LLMs) werden auf riesigen Textdatenbanken trainiert und erwerben dort große Mengen an realem Wissen. Dieses Wissen wird in ihre Parameter eingebettet und kann dann bei Bedarf genutzt werden. Das Wissen über diese Modelle wird am Ende der Ausbildung „verdinglicht“. Am Ende des Vortrainings hört das Modell tatsächlich auf zu lernen. Richten Sie das Modell aus oder verfeinern Sie es, um zu erfahren, wie Sie dieses Wissen nutzen und natürlicher auf Benutzerfragen reagieren können. Aber manchmal reicht Modellwissen nicht aus, und obwohl das Modell über RAG auf externe Inhalte zugreifen kann, wird es als vorteilhaft angesehen, das Modell durch Feinabstimmung an neue Domänen anzupassen. Diese Feinabstimmung erfolgt mithilfe von Eingaben menschlicher Annotatoren oder anderer LLM-Kreationen, wobei das Modell auf zusätzliches Wissen aus der realen Welt trifft und dieses integriert

Um ein neues wissenschaftliches und komplexes Frage-Antwort-Benchmark- und Bewertungssystem für große Modelle bereitzustellen, haben UNSW, Argonne, die University of Chicago und andere Institutionen gemeinsam das SciQAG-Framework eingeführt

Jul 25, 2024 am 06:42 AM

Um ein neues wissenschaftliches und komplexes Frage-Antwort-Benchmark- und Bewertungssystem für große Modelle bereitzustellen, haben UNSW, Argonne, die University of Chicago und andere Institutionen gemeinsam das SciQAG-Framework eingeführt

Jul 25, 2024 am 06:42 AM

Herausgeber | Der Frage-Antwort-Datensatz (QA) von ScienceAI spielt eine entscheidende Rolle bei der Förderung der Forschung zur Verarbeitung natürlicher Sprache (NLP). Hochwertige QS-Datensätze können nicht nur zur Feinabstimmung von Modellen verwendet werden, sondern auch effektiv die Fähigkeiten großer Sprachmodelle (LLMs) bewerten, insbesondere die Fähigkeit, wissenschaftliche Erkenntnisse zu verstehen und zu begründen. Obwohl es derzeit viele wissenschaftliche QS-Datensätze aus den Bereichen Medizin, Chemie, Biologie und anderen Bereichen gibt, weisen diese Datensätze immer noch einige Mängel auf. Erstens ist das Datenformular relativ einfach, die meisten davon sind Multiple-Choice-Fragen. Sie sind leicht auszuwerten, schränken jedoch den Antwortauswahlbereich des Modells ein und können die Fähigkeit des Modells zur Beantwortung wissenschaftlicher Fragen nicht vollständig testen. Im Gegensatz dazu offene Fragen und Antworten

Fünf Schulen des maschinellen Lernens, die Sie nicht kennen

Jun 05, 2024 pm 08:51 PM

Fünf Schulen des maschinellen Lernens, die Sie nicht kennen

Jun 05, 2024 pm 08:51 PM

Maschinelles Lernen ist ein wichtiger Zweig der künstlichen Intelligenz, der Computern die Möglichkeit gibt, aus Daten zu lernen und ihre Fähigkeiten zu verbessern, ohne explizit programmiert zu werden. Maschinelles Lernen hat ein breites Anwendungsspektrum in verschiedenen Bereichen, von der Bilderkennung und der Verarbeitung natürlicher Sprache bis hin zu Empfehlungssystemen und Betrugserkennung, und es verändert unsere Lebensweise. Im Bereich des maschinellen Lernens gibt es viele verschiedene Methoden und Theorien, von denen die fünf einflussreichsten Methoden als „Fünf Schulen des maschinellen Lernens“ bezeichnet werden. Die fünf Hauptschulen sind die symbolische Schule, die konnektionistische Schule, die evolutionäre Schule, die Bayes'sche Schule und die Analogieschule. 1. Der Symbolismus, auch Symbolismus genannt, betont die Verwendung von Symbolen zum logischen Denken und zum Ausdruck von Wissen. Diese Denkrichtung glaubt, dass Lernen ein Prozess der umgekehrten Schlussfolgerung durch das Vorhandene ist

SOTA Performance, eine multimodale KI-Methode zur Vorhersage der Protein-Ligand-Affinität in Xiamen, kombiniert erstmals molekulare Oberflächeninformationen

Jul 17, 2024 pm 06:37 PM

SOTA Performance, eine multimodale KI-Methode zur Vorhersage der Protein-Ligand-Affinität in Xiamen, kombiniert erstmals molekulare Oberflächeninformationen

Jul 17, 2024 pm 06:37 PM

Herausgeber |. KX Im Bereich der Arzneimittelforschung und -entwicklung ist die genaue und effektive Vorhersage der Bindungsaffinität von Proteinen und Liganden für das Arzneimittelscreening und die Arzneimitteloptimierung von entscheidender Bedeutung. Aktuelle Studien berücksichtigen jedoch nicht die wichtige Rolle molekularer Oberflächeninformationen bei Protein-Ligand-Wechselwirkungen. Auf dieser Grundlage schlugen Forscher der Universität Xiamen ein neuartiges Framework zur multimodalen Merkmalsextraktion (MFE) vor, das erstmals Informationen über Proteinoberfläche, 3D-Struktur und -Sequenz kombiniert und einen Kreuzaufmerksamkeitsmechanismus verwendet, um verschiedene Modalitäten zu vergleichen Ausrichtung. Experimentelle Ergebnisse zeigen, dass diese Methode bei der Vorhersage von Protein-Ligand-Bindungsaffinitäten Spitzenleistungen erbringt. Darüber hinaus belegen Ablationsstudien die Wirksamkeit und Notwendigkeit der Proteinoberflächeninformation und der multimodalen Merkmalsausrichtung innerhalb dieses Rahmens. Verwandte Forschungen beginnen mit „S

GlobalFoundries erschließt Märkte wie KI und erwirbt die Galliumnitrid-Technologie von Tagore Technology und zugehörige Teams

Jul 15, 2024 pm 12:21 PM

GlobalFoundries erschließt Märkte wie KI und erwirbt die Galliumnitrid-Technologie von Tagore Technology und zugehörige Teams

Jul 15, 2024 pm 12:21 PM

Laut Nachrichten dieser Website vom 5. Juli veröffentlichte GlobalFoundries am 1. Juli dieses Jahres eine Pressemitteilung, in der die Übernahme der Power-Galliumnitrid (GaN)-Technologie und des Portfolios an geistigem Eigentum von Tagore Technology angekündigt wurde, in der Hoffnung, seinen Marktanteil in den Bereichen Automobile und Internet auszubauen Anwendungsbereiche für Rechenzentren mit künstlicher Intelligenz, um höhere Effizienz und bessere Leistung zu erforschen. Da sich Technologien wie generative künstliche Intelligenz (GenerativeAI) in der digitalen Welt weiterentwickeln, ist Galliumnitrid (GaN) zu einer Schlüssellösung für nachhaltiges und effizientes Energiemanagement, insbesondere in Rechenzentren, geworden. Auf dieser Website wurde die offizielle Ankündigung zitiert, dass sich das Ingenieurteam von Tagore Technology im Rahmen dieser Übernahme mit GF zusammenschließen wird, um die Galliumnitrid-Technologie weiterzuentwickeln. G