Technologie-Peripheriegeräte

Technologie-Peripheriegeräte

KI

KI

Erforschung der Möglichkeit, aus einer Reihe von Wörtern ein visuelles Sprachmodell zu erstellen

Erforschung der Möglichkeit, aus einer Reihe von Wörtern ein visuelles Sprachmodell zu erstellen

Erforschung der Möglichkeit, aus einer Reihe von Wörtern ein visuelles Sprachmodell zu erstellen

Übersetzer |. Zhu Xianzhong

Rezensent |. Chonglou

Aktuell Multimodale künstliche Intelligenz Werden Sie zum Streettalk und heißen Diskussionsthemen. Mit der jüngsten Veröffentlichung von GPT-4 sehen wir unzählige mögliche neue Anwendungen und zukünftige Technologien, die noch vor sechs Monaten undenkbar waren. Tatsächlich sind visuelle Sprachmodelle im Allgemeinen für viele verschiedene Aufgaben nützlich. Sie können beispielsweise CLIP (Contrastive Language-Image Pre-training, , also „Contrastive Language-Image Pre-training“, Link: https://www.php.cn/link verwenden /b02d46e8a3d8d9fd6028f3f2c2495864 Zero-Shot-Bildklassifizierung für unsichtbare Datensätze; Typischerweise kann eine hervorragende Leistung ohne jegliche Schulung erzielt werden

Mittlerweile visuelle Sprachmodelle nicht. Perfekt In diesem Artikel werden wir die Einschränkungen dieser Modelle untersuchen und hervorheben, wo und warum sie versagen können. Tatsächlich dieser Artikel wird eine kurze/hochrangige Beschreibung veröffentlichen des Artikels , der als ICLR 2023 veröffentlicht werden soll. Klicken Sie einfach auf den -Link https://www.php.cn/link/afb992000fcf79ef7a53fffde9c8e044. EinführungWas ist ein visuelles Sprachmodell? Synergie zwischen visuellen und sprachlichen Daten zur Ausführung verschiedener Aufgaben. Während in der vorhandenen -Literatur viele visuelle Sprachmodelle eingeführt wurden, bleibt CLIP ( Contrast Language-Image Pre-training) das bekannteste und Das am weitesten verbreitete Modell.

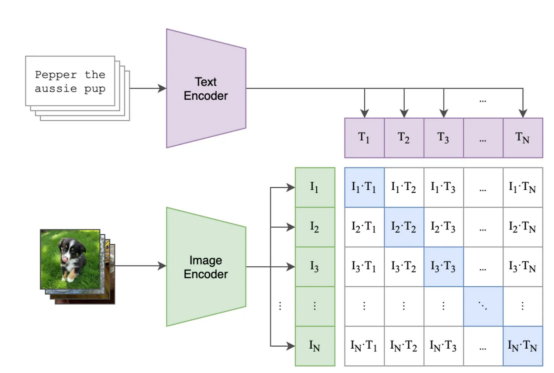

Durch die Einbettung von Bildern und Bildunterschriften in denselben Vektorraum ermöglicht das CLIP-Modell

Musterschlussfolgerungen und ermöglicht es Benutzern, Aufgaben wie die Zero-Shot-Bildklassifizierung und Text- Das CLIP-Modell verwendet kontrastive Lernmethoden, um das Einbetten von Bildern und Bildunterschriften zu erlernen Bildunterschriften durch Minimierung des Abstands zwischen Bildern in einem gemeinsamen Vektorraum. Die durch das CLIP-Modell und andere kontrastbasierte Modelle erzielten Ergebnisse zeigen, dass dieser Ansatz sehr effektiv ist um Bild- und Titelpaare stapelweise zu vergleichen, und das Modell ist optimiert, um die Bild-Text-Ähnlichkeit zwischen Einbettungspaaren zu maximieren und die Ähnlichkeit zwischen anderen Bild-Text-Paaren im Stapel zu verringern Die folgende Abbildung zeigt ein Beispiel für mögliche Batch- und Trainingsschritte

- Das violette Quadrat enthält die Einbettungen für alle Titel und das grüne Quadrat enthält die Einbettungen für alle Bilder.

- Das Quadrat der Matrix enthält das Skalarprodukt aller Bildeinbettungen und aller Texteinbettungen im Stapel (lesen Sie „Cosinus-Ähnlichkeit“, da die Einbettungen normalisiert sind).

- Das blaue Quadrat enthält das Skalarprodukt zwischen den Bild-Text-Paaren, für die das Modell die Ähnlichkeit maximieren muss, die anderen weißen Quadrate sind die Ähnlichkeiten, die wir minimieren möchten (da jedes dieser Quadrate die Ähnlichkeit der Übereinstimmungen enthält). Bild-Text-Paare, wie zum Beispiel ein Bild einer Katze und eine Beschreibung von „meinem Vintage-Stuhl“

( wo sich die blauen Quadrate befinden die Bild-Text-Paare, für die wir die Ähnlichkeit optimieren möchten )

Nach dem Training sollten Sie in der Lage sein, einen Code zu generieren, in dem Sie das Bild und denTitel eines aussagekräftigen Vektorraums kodieren können, sobald Sie dies haben Wenn Sie Inhalte für jedes Bild und jeden Text einbetten, können Sie beispielsweise herausfinden, welche Bilder besser zum Titel passen (z. B. „Hunde im Sommerferien-Fotoalbum 2017“ am Strand finden) (Hund am Strand). ). Sprachmodelle wie CLIP sind zu leistungsstarken Werkzeugen zur Lösung komplexer Aufgaben der künstlichen Intelligenz geworden, indem sie visuelle und sprachliche Informationen integrieren. Ihre Fähigkeit, diese beiden Arten von Daten in einen gemeinsamen Vektorraum einzubetten, hat zu einer breiten Palette von Anwendungen geführt überlegene Leistung. Können visuelle Sprachmodelle Sprache verstehen? Inwieweit können tiefe Modelle Sprache verstehen? Unser Ziel ist es, visuelle Sprachmodelle und ihre Synthesefähigkeiten zu untersuchen. Wir schlagen zunächst einen neuen Datensatz vor, um das Inhaltsstoffverständnis zu testen.

Beziehungen, und Ordnung

:

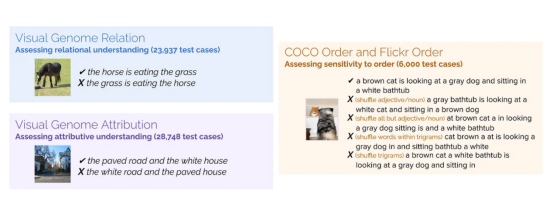

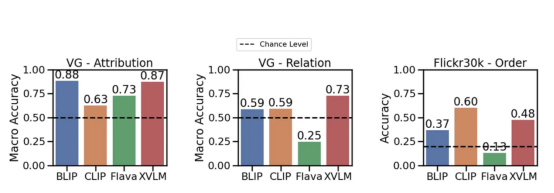

Attribute, Beziehungen und Ordnung). : ARO. (Attribute, Beziehungen und Bestellungen)Wie gut schneiden Modelle wie CLIP (und das aktuelle BLIP von Salesforce) beim Verstehen von Sprache ab Wir haben einen Satz attributbasierter zusammengesetzter Titel (z. B. „die rote Tür und der stehende Mann“(rote Tür und der stehende Mann)) und einen Satz zusammengestellt Beziehungsbasierte Synthese von Titeln (z. B. „Das Pferd frisst das Gras“Pferd frisst Gras)) und passenden Bildern. Dann generieren wir gefälschte Titel , die nach ersetzen, wie zum Beispiel „das Gras frisst das Pferd“ (Gras frisst das Pferd ) . Können die Models den richtigen Titel finden? Wir haben auch den Effekt des Mischens von Wörtern untersucht: Bevorzugt das Modell nicht gemischte Titel gegenüber gemischten Titeln? Die vier Datensätze, die wir für die Attribute ) Benchmark erstellt haben, werden unten angezeigt (beachten Sie, dass der Reihenfolge Teil zwei Datensätze enthält): Die verschiedenen Datensätze, die wir erstellt haben umfassen Beziehung, Attribution und Reihenfolge. Für jeden Datensatz zeigen wir ein Bildbeispiel und einen anderen Titel. Davon ist nur ein Titel korrekt, und das Modell muss diesen richtigen Titel identifizieren. 🏜 „Die weiße Straße und das gepflasterte Haus“ ( Das BLIP-Modell versteht den Unterschied zwischen „Gras frisst Gras“ und „Pferd frisst Gras“ nicht Vorausgesetzt ) Jetzt , sehen wir uns die experimentellen an: Wenige Modelle können die übertreffen Möglichkeit, Zusammenhänge weitgehend zu verstehen (z Beispiel: Essen—— Essen). Allerdings ist das CLIP-Modell etwas höher als diese Möglichkeit in Bezug auf die Kanten von Eigenschaften und Beziehungen . Dies zeigt tatsächlich, dass es immer noch ein Problem mit dem visuellen Sprachmodell gibt. Leistung verschiedener Modelle in Bezug auf Attribute, Beziehungen und Reihenfolge (Flick30k) Benchmark. Wobei CLIP, BLIP andere SoTA-Modelle-Modelle verwendet wurden Nicht nur der übliche Kontrastverlust . Warum ist das so? Fangen wir von vorne an: Visuelle Sprachmodelle werden oft in Retrieval-Aufgaben evaluiert: Nehmen Sie einen Titel und finden Sie das Bild, dem er zugeordnet ist. Wenn Sie sich die Datensätze ansehen, die zur Bewertung dieser Modelle verwendet werden (z. B. MSCOCO, Flickr30K), werden Sie feststellen, dass sie häufig Bilder enthalten, die mit Titeln Die orange Katze ist auf dem roten Tisch). Wenn also der Titel komplex ist, warum kann das Modell dann nicht das Kompositionsverständnis erlernen? ]Die Suche in diesen Datensätzen erfordert nicht unbedingt ein Verständnis der Zusammensetzung. Wir haben versucht, das Problem besser zu verstehen, und haben die Leistung des Modells beim Abrufen beim Neuordnen der Wortreihenfolge in Titeln getestet. Können wir das richtige Bild für den Titel „books the looking at people are“ finden? Wenn die Antwort „Ja “ lautet, bedeutet dies, dass , keine Anleitungsinformationen erforderlich sind, um das richtige Bild zu finden.

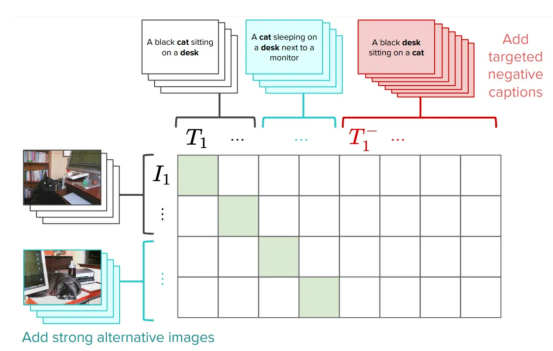

Die Aufgabe unseres Testmodells besteht darin, verschlüsselte Titel abzurufen. Selbst wenn wir die Bildunterschriften verschlüsseln, kann das Modell das entsprechende Bild korrekt finden (und umgekehrt). Dies deutet darauf hin, dass die Abrufaufgabe möglicherweise zu einfach ist , Bild vom Autor bereitgestellt. Wir haben verschiedene Shuffle-Verfahren getestet und die Ergebnisse sind positiv: Auch wenn unterschiedliche Shuffle-Techniken zum Einsatz kommen, wird die Abrufleistung grundsätzlich nicht beeinträchtigt. Sagen wir es noch einmal: Visuelle Sprachmodelle erzielen bei diesen Datensätzen einen leistungsstarken Abruf, selbst wenn auf die Anweisungsinformationen nicht zugegriffen werden kann. Diese Modelle verhalten sich möglicherweise wie ein Stapel von Wörtern , wobei die Reihenfolge keine Rolle spielt: Wenn das Modell die Wortreihenfolge nicht verstehen muss, um beim Abrufen gute Ergebnisse zu erzielen, was messen wir dann tatsächlich beim Abrufen? ? Da wir nun wissen, dass es ein Problem gibt, möchten wir vielleicht nach einer Lösung suchen. Der einfachste Weg ist: Lassen Sie das CLIP-Modell verstehen, dass „die Katze auf dem Tisch“ und „der Tisch liegt auf der Katze“ unterschiedlich sind. Tatsächlich ist eine der Möglichkeiten vorgeschlagen haben, die Verbesserung des CLIP-Trainings durch das Hinzufügen eines harten Negativs, das speziell zur Lösung dieses Problems erstellt wurde. Dies ist eine sehr einfache und effiziente Lösung: Sie erfordert sehr kleine Änderungen am ursprünglichen CLIP-Verlust, ohne die Gesamtleistung zu beeinträchtigen (einige Vorbehalte können Sie im Artikel nachlesen). Wir nennen diese Version von CLIP NegCLIP. Einführung von Hartnegativen im CLIP-Modell (Wir haben Bild- und Text-Hartnegative hinzugefügt , ) Grundsätzlich bitten wir das NegCLIP -Modell , ein Bild einer schwarzen Katze über dem Satz „Eine schwarze Katze sitzt auf einem Schreibtisch“ zu platzieren. Nah, aber weit wegSatz „Ein schwarzer Schreibtisch“. Sitting on a Cat“ ( ). Hinweis: Letzteres wird automatisch durch die Verwendung von POS-Tags generiert. Der Effekt dieses Fixes besteht darin, dass er tatsächlich die Leistung des ARO-Benchmarks verbessert, ohne die Abrufleistung oder die Leistung nachgelagerter Aufgaben wie Abruf und Klassifizierung zu beeinträchtigen. In der folgenden Abbildung finden Sie Ergebnisse zu verschiedenen Benchmarks (Einzelheiten finden Sie in diesem entsprechenden Papier ). NegCLIPModell im Vergleich zu CLIPModell bei verschiedenen Benchmarks. Unter diesen ist der blaue Benchmark der von uns eingeführte Benchmark, und der grüne Benchmark stammt aus dem NetzwerkDokumentation(Bild vom Autor bereitgestellt) Sie Das kann man hier sehen und das ist eine enorme Verbesserung gegenüber dem ARO-Benchmark, und es gibt auch Edge-Verbesserungenoder ähnliche Leistungen bei anderen nachgelagerten Aufgaben. Mert (Hauptautor des Artikels) bei der Erstellung einer kleinen Bibliothek zum Testen visueller Sprachmodelle. Nun Erledigt. Sie können seinen Code verwenden, um unsere Ergebnisse zu reproduzieren oder mit neuen Modellen zu experimentieren. Es dauert nur ein paar Zeilen P: Zusätzlich haben wir NegCLIP implementiert. Modell (Es handelt sich tatsächlich um eine aktualisierte Kopie von OpenCLIP), seine vollständige Code-Download-Adresse lautet https://github.com/vinid/neg_clip. Kurz gesagt, das visuelle Sprachmodellkann derzeit viele Dinge tun. Als nächstes Wir können es kaum erwarten zu sehen, was zukünftige Modelle wie GPT4 leisten können! Zhu Xianzhong, 51CTO-Community-Redakteur, 51CTO-Expertenblogger, Dozent, Computerlehrer an einer Universität in Weifang und ein Veteran in der freiberuflichen Programmierbranche. Originaltitel: Your Vision-Language Model Might Be a Bag of Words, Autor: Federico Bianchi

白路和狠的屋

Was tun?

Programmierimplementierung

import clip

from dataset_zoo import VG_Relation, VG_Attribution

model, image_preprocess = clip.load("ViT-B/32", device="cuda")

root_dir="/path/to/aro/datasets"

#把 download设置为True将把数据集下载到路径`root_dir`——如果不存在的话

#对于VG-R和VG-A,这将是1GB大小的压缩zip文件——它是GQA的一个子集

vgr_dataset = VG_Relation(image_preprocess=preprocess,

download=True, root_dir=root_dir)

vga_dataset = VG_Attribution(image_preprocess=preprocess,

download=True, root_dir=root_dir)

#可以对数据集作任何处理。数据集中的每一项具有类似如下的形式:

# item = {"image_options": [image], "caption_options": [false_caption, true_caption]}Fazit

Übersetzer-Einführung

Das obige ist der detaillierte Inhalt vonErforschung der Möglichkeit, aus einer Reihe von Wörtern ein visuelles Sprachmodell zu erstellen. Für weitere Informationen folgen Sie bitte anderen verwandten Artikeln auf der PHP chinesischen Website!

Heiße KI -Werkzeuge

Undresser.AI Undress

KI-gestützte App zum Erstellen realistischer Aktfotos

AI Clothes Remover

Online-KI-Tool zum Entfernen von Kleidung aus Fotos.

Undress AI Tool

Ausziehbilder kostenlos

Clothoff.io

KI-Kleiderentferner

Video Face Swap

Tauschen Sie Gesichter in jedem Video mühelos mit unserem völlig kostenlosen KI-Gesichtstausch-Tool aus!

Heißer Artikel

Heiße Werkzeuge

Notepad++7.3.1

Einfach zu bedienender und kostenloser Code-Editor

SublimeText3 chinesische Version

Chinesische Version, sehr einfach zu bedienen

Senden Sie Studio 13.0.1

Leistungsstarke integrierte PHP-Entwicklungsumgebung

Dreamweaver CS6

Visuelle Webentwicklungstools

SublimeText3 Mac-Version

Codebearbeitungssoftware auf Gottesniveau (SublimeText3)

Heiße Themen

1393

1393

52

52

1207

1207

24

24

Bytedance Cutting führt SVIP-Supermitgliedschaft ein: 499 Yuan für ein fortlaufendes Jahresabonnement, das eine Vielzahl von KI-Funktionen bietet

Jun 28, 2024 am 03:51 AM

Bytedance Cutting führt SVIP-Supermitgliedschaft ein: 499 Yuan für ein fortlaufendes Jahresabonnement, das eine Vielzahl von KI-Funktionen bietet

Jun 28, 2024 am 03:51 AM

Diese Seite berichtete am 27. Juni, dass Jianying eine von FaceMeng Technology, einer Tochtergesellschaft von ByteDance, entwickelte Videobearbeitungssoftware ist, die auf der Douyin-Plattform basiert und grundsätzlich kurze Videoinhalte für Benutzer der Plattform produziert Windows, MacOS und andere Betriebssysteme. Jianying kündigte offiziell die Aktualisierung seines Mitgliedschaftssystems an und führte ein neues SVIP ein, das eine Vielzahl von KI-Schwarztechnologien umfasst, wie z. B. intelligente Übersetzung, intelligente Hervorhebung, intelligente Verpackung, digitale menschliche Synthese usw. Preislich beträgt die monatliche Gebühr für das Clipping von SVIP 79 Yuan, die Jahresgebühr 599 Yuan (Hinweis auf dieser Website: entspricht 49,9 Yuan pro Monat), das fortlaufende Monatsabonnement beträgt 59 Yuan pro Monat und das fortlaufende Jahresabonnement beträgt 499 Yuan pro Jahr (entspricht 41,6 Yuan pro Monat). Darüber hinaus erklärte der Cut-Beamte auch, dass diejenigen, die den ursprünglichen VIP abonniert haben, das Benutzererlebnis verbessern sollen

Kontexterweiterter KI-Codierungsassistent mit Rag und Sem-Rag

Jun 10, 2024 am 11:08 AM

Kontexterweiterter KI-Codierungsassistent mit Rag und Sem-Rag

Jun 10, 2024 am 11:08 AM

Verbessern Sie die Produktivität, Effizienz und Genauigkeit der Entwickler, indem Sie eine abrufgestützte Generierung und ein semantisches Gedächtnis in KI-Codierungsassistenten integrieren. Übersetzt aus EnhancingAICodingAssistantswithContextUsingRAGandSEM-RAG, Autor JanakiramMSV. Obwohl grundlegende KI-Programmierassistenten natürlich hilfreich sind, können sie oft nicht die relevantesten und korrektesten Codevorschläge liefern, da sie auf einem allgemeinen Verständnis der Softwaresprache und den gängigsten Mustern beim Schreiben von Software basieren. Der von diesen Coding-Assistenten generierte Code eignet sich zur Lösung der von ihnen zu lösenden Probleme, entspricht jedoch häufig nicht den Coding-Standards, -Konventionen und -Stilen der einzelnen Teams. Dabei entstehen häufig Vorschläge, die geändert oder verfeinert werden müssen, damit der Code in die Anwendung übernommen wird

Kann LLM durch Feinabstimmung wirklich neue Dinge lernen: Die Einführung neuen Wissens kann dazu führen, dass das Modell mehr Halluzinationen hervorruft

Jun 11, 2024 pm 03:57 PM

Kann LLM durch Feinabstimmung wirklich neue Dinge lernen: Die Einführung neuen Wissens kann dazu führen, dass das Modell mehr Halluzinationen hervorruft

Jun 11, 2024 pm 03:57 PM

Large Language Models (LLMs) werden auf riesigen Textdatenbanken trainiert und erwerben dort große Mengen an realem Wissen. Dieses Wissen wird in ihre Parameter eingebettet und kann dann bei Bedarf genutzt werden. Das Wissen über diese Modelle wird am Ende der Ausbildung „verdinglicht“. Am Ende des Vortrainings hört das Modell tatsächlich auf zu lernen. Richten Sie das Modell aus oder verfeinern Sie es, um zu erfahren, wie Sie dieses Wissen nutzen und natürlicher auf Benutzerfragen reagieren können. Aber manchmal reicht Modellwissen nicht aus, und obwohl das Modell über RAG auf externe Inhalte zugreifen kann, wird es als vorteilhaft angesehen, das Modell durch Feinabstimmung an neue Domänen anzupassen. Diese Feinabstimmung erfolgt mithilfe von Eingaben menschlicher Annotatoren oder anderer LLM-Kreationen, wobei das Modell auf zusätzliches Wissen aus der realen Welt trifft und dieses integriert

Sieben coole technische Interviewfragen für GenAI und LLM

Jun 07, 2024 am 10:06 AM

Sieben coole technische Interviewfragen für GenAI und LLM

Jun 07, 2024 am 10:06 AM

Um mehr über AIGC zu erfahren, besuchen Sie bitte: 51CTOAI.x Community https://www.51cto.com/aigc/Translator|Jingyan Reviewer|Chonglou unterscheidet sich von der traditionellen Fragendatenbank, die überall im Internet zu sehen ist erfordert einen Blick über den Tellerrand hinaus. Large Language Models (LLMs) gewinnen in den Bereichen Datenwissenschaft, generative künstliche Intelligenz (GenAI) und künstliche Intelligenz zunehmend an Bedeutung. Diese komplexen Algorithmen verbessern die menschlichen Fähigkeiten, treiben Effizienz und Innovation in vielen Branchen voran und werden zum Schlüssel für Unternehmen, um wettbewerbsfähig zu bleiben. LLM hat ein breites Anwendungsspektrum und kann in Bereichen wie der Verarbeitung natürlicher Sprache, der Textgenerierung, der Spracherkennung und Empfehlungssystemen eingesetzt werden. Durch das Lernen aus großen Datenmengen ist LLM in der Lage, Text zu generieren

Fünf Schulen des maschinellen Lernens, die Sie nicht kennen

Jun 05, 2024 pm 08:51 PM

Fünf Schulen des maschinellen Lernens, die Sie nicht kennen

Jun 05, 2024 pm 08:51 PM

Maschinelles Lernen ist ein wichtiger Zweig der künstlichen Intelligenz, der Computern die Möglichkeit gibt, aus Daten zu lernen und ihre Fähigkeiten zu verbessern, ohne explizit programmiert zu werden. Maschinelles Lernen hat ein breites Anwendungsspektrum in verschiedenen Bereichen, von der Bilderkennung und der Verarbeitung natürlicher Sprache bis hin zu Empfehlungssystemen und Betrugserkennung, und es verändert unsere Lebensweise. Im Bereich des maschinellen Lernens gibt es viele verschiedene Methoden und Theorien, von denen die fünf einflussreichsten Methoden als „Fünf Schulen des maschinellen Lernens“ bezeichnet werden. Die fünf Hauptschulen sind die symbolische Schule, die konnektionistische Schule, die evolutionäre Schule, die Bayes'sche Schule und die Analogieschule. 1. Der Symbolismus, auch Symbolismus genannt, betont die Verwendung von Symbolen zum logischen Denken und zum Ausdruck von Wissen. Diese Denkrichtung glaubt, dass Lernen ein Prozess der umgekehrten Schlussfolgerung durch das Vorhandene ist

Um ein neues wissenschaftliches und komplexes Frage-Antwort-Benchmark- und Bewertungssystem für große Modelle bereitzustellen, haben UNSW, Argonne, die University of Chicago und andere Institutionen gemeinsam das SciQAG-Framework eingeführt

Jul 25, 2024 am 06:42 AM

Um ein neues wissenschaftliches und komplexes Frage-Antwort-Benchmark- und Bewertungssystem für große Modelle bereitzustellen, haben UNSW, Argonne, die University of Chicago und andere Institutionen gemeinsam das SciQAG-Framework eingeführt

Jul 25, 2024 am 06:42 AM

Herausgeber | Der Frage-Antwort-Datensatz (QA) von ScienceAI spielt eine entscheidende Rolle bei der Förderung der Forschung zur Verarbeitung natürlicher Sprache (NLP). Hochwertige QS-Datensätze können nicht nur zur Feinabstimmung von Modellen verwendet werden, sondern auch effektiv die Fähigkeiten großer Sprachmodelle (LLMs) bewerten, insbesondere die Fähigkeit, wissenschaftliche Erkenntnisse zu verstehen und zu begründen. Obwohl es derzeit viele wissenschaftliche QS-Datensätze aus den Bereichen Medizin, Chemie, Biologie und anderen Bereichen gibt, weisen diese Datensätze immer noch einige Mängel auf. Erstens ist das Datenformular relativ einfach, die meisten davon sind Multiple-Choice-Fragen. Sie sind leicht auszuwerten, schränken jedoch den Antwortauswahlbereich des Modells ein und können die Fähigkeit des Modells zur Beantwortung wissenschaftlicher Fragen nicht vollständig testen. Im Gegensatz dazu offene Fragen und Antworten

SK Hynix wird am 6. August neue KI-bezogene Produkte vorstellen: 12-Layer-HBM3E, 321-High-NAND usw.

Aug 01, 2024 pm 09:40 PM

SK Hynix wird am 6. August neue KI-bezogene Produkte vorstellen: 12-Layer-HBM3E, 321-High-NAND usw.

Aug 01, 2024 pm 09:40 PM

Laut Nachrichten dieser Website vom 1. August hat SK Hynix heute (1. August) einen Blogbeitrag veröffentlicht, in dem es ankündigt, dass es am Global Semiconductor Memory Summit FMS2024 teilnehmen wird, der vom 6. bis 8. August in Santa Clara, Kalifornien, USA, stattfindet viele neue Technologien Generation Produkt. Einführung des Future Memory and Storage Summit (FutureMemoryandStorage), früher Flash Memory Summit (FlashMemorySummit), hauptsächlich für NAND-Anbieter, im Zusammenhang mit der zunehmenden Aufmerksamkeit für die Technologie der künstlichen Intelligenz wurde dieses Jahr in Future Memory and Storage Summit (FutureMemoryandStorage) umbenannt Laden Sie DRAM- und Speicheranbieter und viele weitere Akteure ein. Neues Produkt SK Hynix wurde letztes Jahr auf den Markt gebracht

SOTA Performance, eine multimodale KI-Methode zur Vorhersage der Protein-Ligand-Affinität in Xiamen, kombiniert erstmals molekulare Oberflächeninformationen

Jul 17, 2024 pm 06:37 PM

SOTA Performance, eine multimodale KI-Methode zur Vorhersage der Protein-Ligand-Affinität in Xiamen, kombiniert erstmals molekulare Oberflächeninformationen

Jul 17, 2024 pm 06:37 PM

Herausgeber |. KX Im Bereich der Arzneimittelforschung und -entwicklung ist die genaue und effektive Vorhersage der Bindungsaffinität von Proteinen und Liganden für das Arzneimittelscreening und die Arzneimitteloptimierung von entscheidender Bedeutung. Aktuelle Studien berücksichtigen jedoch nicht die wichtige Rolle molekularer Oberflächeninformationen bei Protein-Ligand-Wechselwirkungen. Auf dieser Grundlage schlugen Forscher der Universität Xiamen ein neuartiges Framework zur multimodalen Merkmalsextraktion (MFE) vor, das erstmals Informationen über Proteinoberfläche, 3D-Struktur und -Sequenz kombiniert und einen Kreuzaufmerksamkeitsmechanismus verwendet, um verschiedene Modalitäten zu vergleichen Ausrichtung. Experimentelle Ergebnisse zeigen, dass diese Methode bei der Vorhersage von Protein-Ligand-Bindungsaffinitäten Spitzenleistungen erbringt. Darüber hinaus belegen Ablationsstudien die Wirksamkeit und Notwendigkeit der Proteinoberflächeninformation und der multimodalen Merkmalsausrichtung innerhalb dieses Rahmens. Verwandte Forschungen beginnen mit „S