Technologie-Peripheriegeräte

Technologie-Peripheriegeräte

KI

KI

Beschreiben Sie kurz die fünf Arten von Beschleunigern für maschinelles Lernen

Beschreiben Sie kurz die fünf Arten von Beschleunigern für maschinelles Lernen

Beschreiben Sie kurz die fünf Arten von Beschleunigern für maschinelles Lernen

Übersetzer |. Bugatti

Rezensent |. Die letzten zehn Jahre waren die Ära des tiefen Lernens. Wir freuen uns auf eine Reihe großer Ereignisse, von AlphaGo bis zum DELL-E 2. Unzählige Produkte oder Dienstleistungen, die auf künstlicher Intelligenz (KI) basieren, sind im täglichen Leben aufgetaucht, darunter Alexa-Geräte, Werbeempfehlungen, Lagerroboter und selbstfahrende Autos.

In den letzten Jahren ist die Größe von Deep-Learning-Modellen exponentiell gewachsen. Das ist keine Neuigkeit: Das Wu Dao 2.0-Modell enthält 1,75 Billionen Parameter und das Training von GPT-3 auf 240 ml.p4d.24xlarge-Instanzen in der SageMaker-Trainingsplattform dauert nur etwa 25 Tage.

In den letzten Jahren ist die Größe von Deep-Learning-Modellen exponentiell gewachsen. Das ist keine Neuigkeit: Das Wu Dao 2.0-Modell enthält 1,75 Billionen Parameter und das Training von GPT-3 auf 240 ml.p4d.24xlarge-Instanzen in der SageMaker-Trainingsplattform dauert nur etwa 25 Tage.

Aber mit der Weiterentwicklung der Deep-Learning-Schulung und -Einführung wird es immer anspruchsvoller. Da sich Deep-Learning-Modelle weiterentwickeln, sind Skalierbarkeit und Effizienz zwei große Herausforderungen bei Schulung und Bereitstellung.

In diesem Artikel werden die fünf wichtigsten Arten von Beschleunigern für maschinelles Lernen (ML) zusammengefasst.

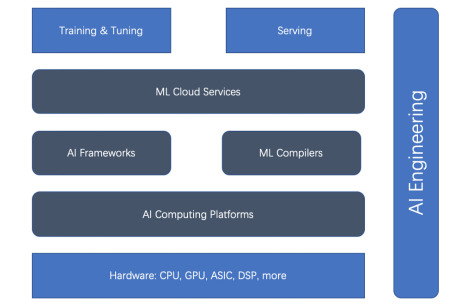

Verstehen Sie den ML-Lebenszyklus in der KI-Technik.

Bevor Sie ML-Beschleuniger umfassend einführen, sollten Sie sich auch den ML-Lebenszyklus ansehen.

ML-Lebenszyklus ist der Lebenszyklus von Daten und Modellen. Man kann sagen, dass Daten die Wurzel von ML sind und die Qualität des Modells bestimmen. Jeder Aspekt des Lebenszyklus bietet Möglichkeiten zur Beschleunigung.

MLOps kann den Prozess der ML-Modellbereitstellung automatisieren. Aufgrund seines operativen Charakters ist es jedoch auf den horizontalen Prozess des KI-Workflows beschränkt und kann Schulung und Einsatz nicht grundlegend verbessern.

KI-Engineering geht weit über den Rahmen von MLOps hinaus. Es kann den Workflow-Prozess für maschinelles Lernen sowie die Trainings- und Bereitstellungsarchitektur als Ganzes (horizontal und vertikal) entwerfen. Darüber hinaus beschleunigt es die Bereitstellung und Schulung durch effiziente Orchestrierung des gesamten ML-Lebenszyklus.

Basierend auf dem ganzheitlichen ML-Lebenszyklus und der KI-Technik gibt es fünf Haupttypen von ML-Beschleunigern (oder Beschleunigungsaspekten): Hardwarebeschleuniger, KI-Computing-Plattformen, KI-Frameworks, ML-Compiler und Cloud-Dienste. Schauen Sie sich zunächst das Beziehungsdiagramm unten an.

Abbildung 1. Die Beziehung zwischen Training und Bereitstellungsbeschleuniger

Abbildung 1. Die Beziehung zwischen Training und Bereitstellungsbeschleuniger

Wir können sehen, dass Hardwarebeschleuniger und KI-Frameworks der Hauptstrom der Beschleunigung sind. Doch in letzter Zeit haben ML-Compiler, KI-Computing-Plattformen und ML-Cloud-Dienste immer mehr an Bedeutung gewonnen.

Nachfolgend einzeln vorgestellt.

1. KI-Framework

Wenn es um die Beschleunigung des ML-Trainings und -Einsatzes geht, kommt die Wahl des richtigen KI-Frameworks nicht umhin. Leider gibt es kein einheitliches, perfektes oder optimales KI-Framework. Drei in Forschung und Produktion weit verbreitete KI-Frameworks sind TensorFlow, PyTorch und JAX. Sie zeichnen sich jeweils durch unterschiedliche Aspekte aus, beispielsweise Benutzerfreundlichkeit, Produktreife und Skalierbarkeit.

TensorFlow:TensorFlow ist das Flaggschiff-KI-Framework. TensorFlow hat die Deep-Learning-Open-Source-Community von Anfang an dominiert. TensorFlow Serving ist eine klar definierte und ausgereifte Plattform. Für das Internet und IoT sind auch TensorFlow.js und TensorFlow Lite ausgereift.

Aber aufgrund der Einschränkungen bei der frühen Erforschung von Deep Learning wurde TensorFlow 1.x so konzipiert, dass statische Diagramme auf nicht-pythonische Weise erstellt werden. Dies stellt ein Hindernis für eine sofortige Evaluierung im „Eager“-Modus dar, der es PyTorch ermöglicht, sich im Forschungsbereich schnell zu verbessern. TensorFlow 2.x versucht aufzuholen, aber leider ist das Upgrade von TensorFlow 1.x auf 2.x umständlich. TensorFlow führt außerdem Keras ein, um die Verwendung insgesamt zu vereinfachen, und XLA (Accelerated Linear Algebra), einen optimierenden Compiler, um die unterste Ebene zu beschleunigen.

PyTorch:Mit seinem Eager-Modus und dem Python-ähnlichen Ansatz ist PyTorch heute ein Arbeitstier in der Deep-Learning-Community und wird in allen Bereichen von der Forschung bis zur Produktion eingesetzt. Neben TorchServe lässt sich PyTorch auch in Framework-unabhängige Plattformen wie Kubeflow integrieren. Darüber hinaus ist die Popularität von PyTorch untrennbar mit dem Erfolg der Transformers-Bibliothek von Hugging Face verbunden.

JAX: Google hat JAX eingeführt, basierend auf gerätebeschleunigtem NumPy und JIT. Genau wie PyTorch vor einigen Jahren handelt es sich um ein eher natives Deep-Learning-Framework, das in der Forschungsgemeinschaft schnell an Popularität gewinnt. Es handelt sich aber noch nicht um ein „offizielles“ Google-Produkt, wie Google behauptet.

2. HardwarebeschleunigerEs besteht kein Zweifel, dass die GPU von NVIDIA das Deep-Learning-Training beschleunigen kann, aber sie wurde ursprünglich für Grafikkarten entwickelt.

Nach dem Aufkommen von Allzweck-GPUs erfreuen sich Grafikkarten, die für das Training neuronaler Netze verwendet werden, großer Beliebtheit. Diese Allzweck-GPUs können beliebigen Code ausführen und nicht nur Unterroutinen rendern. Die Programmiersprache CUDA von NVIDIA bietet eine Möglichkeit, beliebigen Code in einer C-ähnlichen Sprache zu schreiben. Die Allzweck-GPU verfügt über ein relativ praktisches Programmiermodell, einen umfassenden Parallelitätsmechanismus und eine hohe Speicherbandbreite und bietet jetzt eine ideale Plattform für die Programmierung neuronaler Netzwerke.

Heute unterstützt NVIDIA eine Reihe von GPUs, von Desktops bis hin zu Mobilgeräten, Workstations, mobilen Workstations, Spielekonsolen und Rechenzentren.

Angesichts des großen Erfolgs der NVIDIA-GPU gab es im Laufe der Zeit keinen Mangel an Nachfolgern, wie etwa der GPU von AMD und dem TPU-ASIC von Google.

3. AI Computing Platform

Wie bereits erwähnt, hängt die Geschwindigkeit des ML-Trainings und der Bereitstellung stark von der Hardware (wie GPU und TPU) ab. Diese Treiberplattformen (d. h. KI-Computing-Plattformen) sind entscheidend für die Leistung. Es gibt zwei bekannte KI-Computing-Plattformen: CUDA und OpenCL.

CUDA: CUDA (Compute Unified Device Architecture) ist ein paralleles Programmierparadigma, das 2007 von NVIDIA veröffentlicht wurde. Es ist für zahlreiche allgemeine Anwendungen auf Grafikprozessoren und GPUs konzipiert. CUDA ist eine proprietäre API, die nur NVIDIAs GPUs mit Tesla-Architektur unterstützt. Zu den von CUDA unterstützten Grafikkarten gehören die GeForce 8-Serie, Tesla und Quadro.

OpenCL: OpenCL (Open Computing Language) wurde ursprünglich von Apple entwickelt und wird jetzt vom Khronos-Team für heterogenes Computing, einschließlich CPUs, GPUs, DSPs und andere Arten von Prozessoren, gepflegt. Diese portable Sprache ist anpassungsfähig genug, um eine hohe Leistung auf jeder Hardwareplattform, einschließlich Nvidias GPUs, zu ermöglichen.

NVIDIA ist jetzt OpenCL 3.0-kompatibel für die Verwendung mit R465- und höheren Treibern. Mit der OpenCL-API kann man Rechenkerne starten, die in einer begrenzten Teilmenge der Programmiersprache C geschrieben sind, auf der GPU.

4. ML-Compiler

Der ML-Compiler spielt eine wichtige Rolle bei der Beschleunigung von Training und Bereitstellung. ML-Compiler können die Effizienz der groß angelegten Modellbereitstellung erheblich verbessern. Es gibt viele beliebte Compiler wie Apache TVM, LLVM, Google MLIR, TensorFlow XLA, Meta Glow, PyTorch nvFuser und Intel PlaidML.

5. ML Cloud Services

ML-Cloud-Plattform und -Dienste verwalten die ML-Plattform in der Cloud. Sie können auf verschiedene Arten optimiert werden, um die Effizienz zu steigern.

Nehmen Sie Amazon SageMaker als Beispiel. Dies ist ein führender ML-Cloud-Plattformdienst. SageMaker bietet eine breite Palette von Funktionen für den ML-Lebenszyklus: von der Vorbereitung, Erstellung, Schulung/Optimierung bis hin zur Bereitstellung/Verwaltung.

Es optimiert viele Aspekte, um die Trainings- und Bereitstellungseffizienz zu verbessern, wie z. B. Endpunkte mit mehreren Modellen auf der GPU, kostengünstiges Training mit heterogenen Clustern und einen proprietären Graviton-Prozessor, der für CPU-basierte ML-Inferenz geeignet ist.

Fazit

Da der Umfang der Deep-Learning-Schulung und -Bereitstellung immer weiter zunimmt, werden die Herausforderungen immer größer. Die Verbesserung der Effizienz von Deep-Learning-Training und -Einsatz ist komplex. Basierend auf dem ML-Lebenszyklus gibt es fünf Aspekte, die das ML-Training und die Bereitstellung beschleunigen können: KI-Framework, Hardwarebeschleuniger, Computerplattform, ML-Compiler und Cloud-Service. KI-Engineering kann all dies koordinieren und technische Prinzipien nutzen, um die Effizienz auf breiter Front zu verbessern.

Originaltitel: 5 Arten von ML-Beschleunigern, Autor: Luhui Hu

Das obige ist der detaillierte Inhalt vonBeschreiben Sie kurz die fünf Arten von Beschleunigern für maschinelles Lernen. Für weitere Informationen folgen Sie bitte anderen verwandten Artikeln auf der PHP chinesischen Website!

Heiße KI -Werkzeuge

Undresser.AI Undress

KI-gestützte App zum Erstellen realistischer Aktfotos

AI Clothes Remover

Online-KI-Tool zum Entfernen von Kleidung aus Fotos.

Undress AI Tool

Ausziehbilder kostenlos

Clothoff.io

KI-Kleiderentferner

AI Hentai Generator

Erstellen Sie kostenlos Ai Hentai.

Heißer Artikel

Heiße Werkzeuge

Notepad++7.3.1

Einfach zu bedienender und kostenloser Code-Editor

SublimeText3 chinesische Version

Chinesische Version, sehr einfach zu bedienen

Senden Sie Studio 13.0.1

Leistungsstarke integrierte PHP-Entwicklungsumgebung

Dreamweaver CS6

Visuelle Webentwicklungstools

SublimeText3 Mac-Version

Codebearbeitungssoftware auf Gottesniveau (SublimeText3)

Heiße Themen

1377

1377

52

52

Bytedance Cutting führt SVIP-Supermitgliedschaft ein: 499 Yuan für ein fortlaufendes Jahresabonnement, das eine Vielzahl von KI-Funktionen bietet

Jun 28, 2024 am 03:51 AM

Bytedance Cutting führt SVIP-Supermitgliedschaft ein: 499 Yuan für ein fortlaufendes Jahresabonnement, das eine Vielzahl von KI-Funktionen bietet

Jun 28, 2024 am 03:51 AM

Diese Seite berichtete am 27. Juni, dass Jianying eine von FaceMeng Technology, einer Tochtergesellschaft von ByteDance, entwickelte Videobearbeitungssoftware ist, die auf der Douyin-Plattform basiert und grundsätzlich kurze Videoinhalte für Benutzer der Plattform produziert Windows, MacOS und andere Betriebssysteme. Jianying kündigte offiziell die Aktualisierung seines Mitgliedschaftssystems an und führte ein neues SVIP ein, das eine Vielzahl von KI-Schwarztechnologien umfasst, wie z. B. intelligente Übersetzung, intelligente Hervorhebung, intelligente Verpackung, digitale menschliche Synthese usw. Preislich beträgt die monatliche Gebühr für das Clipping von SVIP 79 Yuan, die Jahresgebühr 599 Yuan (Hinweis auf dieser Website: entspricht 49,9 Yuan pro Monat), das fortlaufende Monatsabonnement beträgt 59 Yuan pro Monat und das fortlaufende Jahresabonnement beträgt 499 Yuan pro Jahr (entspricht 41,6 Yuan pro Monat). Darüber hinaus erklärte der Cut-Beamte auch, dass diejenigen, die den ursprünglichen VIP abonniert haben, das Benutzererlebnis verbessern sollen

Kontexterweiterter KI-Codierungsassistent mit Rag und Sem-Rag

Jun 10, 2024 am 11:08 AM

Kontexterweiterter KI-Codierungsassistent mit Rag und Sem-Rag

Jun 10, 2024 am 11:08 AM

Verbessern Sie die Produktivität, Effizienz und Genauigkeit der Entwickler, indem Sie eine abrufgestützte Generierung und ein semantisches Gedächtnis in KI-Codierungsassistenten integrieren. Übersetzt aus EnhancingAICodingAssistantswithContextUsingRAGandSEM-RAG, Autor JanakiramMSV. Obwohl grundlegende KI-Programmierassistenten natürlich hilfreich sind, können sie oft nicht die relevantesten und korrektesten Codevorschläge liefern, da sie auf einem allgemeinen Verständnis der Softwaresprache und den gängigsten Mustern beim Schreiben von Software basieren. Der von diesen Coding-Assistenten generierte Code eignet sich zur Lösung der von ihnen zu lösenden Probleme, entspricht jedoch häufig nicht den Coding-Standards, -Konventionen und -Stilen der einzelnen Teams. Dabei entstehen häufig Vorschläge, die geändert oder verfeinert werden müssen, damit der Code in die Anwendung übernommen wird

Sieben coole technische Interviewfragen für GenAI und LLM

Jun 07, 2024 am 10:06 AM

Sieben coole technische Interviewfragen für GenAI und LLM

Jun 07, 2024 am 10:06 AM

Um mehr über AIGC zu erfahren, besuchen Sie bitte: 51CTOAI.x Community https://www.51cto.com/aigc/Translator|Jingyan Reviewer|Chonglou unterscheidet sich von der traditionellen Fragendatenbank, die überall im Internet zu sehen ist erfordert einen Blick über den Tellerrand hinaus. Large Language Models (LLMs) gewinnen in den Bereichen Datenwissenschaft, generative künstliche Intelligenz (GenAI) und künstliche Intelligenz zunehmend an Bedeutung. Diese komplexen Algorithmen verbessern die menschlichen Fähigkeiten, treiben Effizienz und Innovation in vielen Branchen voran und werden zum Schlüssel für Unternehmen, um wettbewerbsfähig zu bleiben. LLM hat ein breites Anwendungsspektrum und kann in Bereichen wie der Verarbeitung natürlicher Sprache, der Textgenerierung, der Spracherkennung und Empfehlungssystemen eingesetzt werden. Durch das Lernen aus großen Datenmengen ist LLM in der Lage, Text zu generieren

Kann LLM durch Feinabstimmung wirklich neue Dinge lernen: Die Einführung neuen Wissens kann dazu führen, dass das Modell mehr Halluzinationen hervorruft

Jun 11, 2024 pm 03:57 PM

Kann LLM durch Feinabstimmung wirklich neue Dinge lernen: Die Einführung neuen Wissens kann dazu führen, dass das Modell mehr Halluzinationen hervorruft

Jun 11, 2024 pm 03:57 PM

Large Language Models (LLMs) werden auf riesigen Textdatenbanken trainiert und erwerben dort große Mengen an realem Wissen. Dieses Wissen wird in ihre Parameter eingebettet und kann dann bei Bedarf genutzt werden. Das Wissen über diese Modelle wird am Ende der Ausbildung „verdinglicht“. Am Ende des Vortrainings hört das Modell tatsächlich auf zu lernen. Richten Sie das Modell aus oder verfeinern Sie es, um zu erfahren, wie Sie dieses Wissen nutzen und natürlicher auf Benutzerfragen reagieren können. Aber manchmal reicht Modellwissen nicht aus, und obwohl das Modell über RAG auf externe Inhalte zugreifen kann, wird es als vorteilhaft angesehen, das Modell durch Feinabstimmung an neue Domänen anzupassen. Diese Feinabstimmung erfolgt mithilfe von Eingaben menschlicher Annotatoren oder anderer LLM-Kreationen, wobei das Modell auf zusätzliches Wissen aus der realen Welt trifft und dieses integriert

Um ein neues wissenschaftliches und komplexes Frage-Antwort-Benchmark- und Bewertungssystem für große Modelle bereitzustellen, haben UNSW, Argonne, die University of Chicago und andere Institutionen gemeinsam das SciQAG-Framework eingeführt

Jul 25, 2024 am 06:42 AM

Um ein neues wissenschaftliches und komplexes Frage-Antwort-Benchmark- und Bewertungssystem für große Modelle bereitzustellen, haben UNSW, Argonne, die University of Chicago und andere Institutionen gemeinsam das SciQAG-Framework eingeführt

Jul 25, 2024 am 06:42 AM

Herausgeber | Der Frage-Antwort-Datensatz (QA) von ScienceAI spielt eine entscheidende Rolle bei der Förderung der Forschung zur Verarbeitung natürlicher Sprache (NLP). Hochwertige QS-Datensätze können nicht nur zur Feinabstimmung von Modellen verwendet werden, sondern auch effektiv die Fähigkeiten großer Sprachmodelle (LLMs) bewerten, insbesondere die Fähigkeit, wissenschaftliche Erkenntnisse zu verstehen und zu begründen. Obwohl es derzeit viele wissenschaftliche QS-Datensätze aus den Bereichen Medizin, Chemie, Biologie und anderen Bereichen gibt, weisen diese Datensätze immer noch einige Mängel auf. Erstens ist das Datenformular relativ einfach, die meisten davon sind Multiple-Choice-Fragen. Sie sind leicht auszuwerten, schränken jedoch den Antwortauswahlbereich des Modells ein und können die Fähigkeit des Modells zur Beantwortung wissenschaftlicher Fragen nicht vollständig testen. Im Gegensatz dazu offene Fragen und Antworten

Fünf Schulen des maschinellen Lernens, die Sie nicht kennen

Jun 05, 2024 pm 08:51 PM

Fünf Schulen des maschinellen Lernens, die Sie nicht kennen

Jun 05, 2024 pm 08:51 PM

Maschinelles Lernen ist ein wichtiger Zweig der künstlichen Intelligenz, der Computern die Möglichkeit gibt, aus Daten zu lernen und ihre Fähigkeiten zu verbessern, ohne explizit programmiert zu werden. Maschinelles Lernen hat ein breites Anwendungsspektrum in verschiedenen Bereichen, von der Bilderkennung und der Verarbeitung natürlicher Sprache bis hin zu Empfehlungssystemen und Betrugserkennung, und es verändert unsere Lebensweise. Im Bereich des maschinellen Lernens gibt es viele verschiedene Methoden und Theorien, von denen die fünf einflussreichsten Methoden als „Fünf Schulen des maschinellen Lernens“ bezeichnet werden. Die fünf Hauptschulen sind die symbolische Schule, die konnektionistische Schule, die evolutionäre Schule, die Bayes'sche Schule und die Analogieschule. 1. Der Symbolismus, auch Symbolismus genannt, betont die Verwendung von Symbolen zum logischen Denken und zum Ausdruck von Wissen. Diese Denkrichtung glaubt, dass Lernen ein Prozess der umgekehrten Schlussfolgerung durch das Vorhandene ist

SOTA Performance, eine multimodale KI-Methode zur Vorhersage der Protein-Ligand-Affinität in Xiamen, kombiniert erstmals molekulare Oberflächeninformationen

Jul 17, 2024 pm 06:37 PM

SOTA Performance, eine multimodale KI-Methode zur Vorhersage der Protein-Ligand-Affinität in Xiamen, kombiniert erstmals molekulare Oberflächeninformationen

Jul 17, 2024 pm 06:37 PM

Herausgeber |. KX Im Bereich der Arzneimittelforschung und -entwicklung ist die genaue und effektive Vorhersage der Bindungsaffinität von Proteinen und Liganden für das Arzneimittelscreening und die Arzneimitteloptimierung von entscheidender Bedeutung. Aktuelle Studien berücksichtigen jedoch nicht die wichtige Rolle molekularer Oberflächeninformationen bei Protein-Ligand-Wechselwirkungen. Auf dieser Grundlage schlugen Forscher der Universität Xiamen ein neuartiges Framework zur multimodalen Merkmalsextraktion (MFE) vor, das erstmals Informationen über Proteinoberfläche, 3D-Struktur und -Sequenz kombiniert und einen Kreuzaufmerksamkeitsmechanismus verwendet, um verschiedene Modalitäten zu vergleichen Ausrichtung. Experimentelle Ergebnisse zeigen, dass diese Methode bei der Vorhersage von Protein-Ligand-Bindungsaffinitäten Spitzenleistungen erbringt. Darüber hinaus belegen Ablationsstudien die Wirksamkeit und Notwendigkeit der Proteinoberflächeninformation und der multimodalen Merkmalsausrichtung innerhalb dieses Rahmens. Verwandte Forschungen beginnen mit „S

AlphaFold 3 wird auf den Markt gebracht und sagt die Wechselwirkungen und Strukturen von Proteinen und allen Lebensmolekülen umfassend und mit weitaus größerer Genauigkeit als je zuvor voraus

Jul 16, 2024 am 12:08 AM

AlphaFold 3 wird auf den Markt gebracht und sagt die Wechselwirkungen und Strukturen von Proteinen und allen Lebensmolekülen umfassend und mit weitaus größerer Genauigkeit als je zuvor voraus

Jul 16, 2024 am 12:08 AM

Herausgeber | Rettichhaut Seit der Veröffentlichung des leistungsstarken AlphaFold2 im Jahr 2021 verwenden Wissenschaftler Modelle zur Proteinstrukturvorhersage, um verschiedene Proteinstrukturen innerhalb von Zellen zu kartieren, Medikamente zu entdecken und eine „kosmische Karte“ jeder bekannten Proteininteraktion zu zeichnen. Gerade hat Google DeepMind das AlphaFold3-Modell veröffentlicht, das gemeinsame Strukturvorhersagen für Komplexe wie Proteine, Nukleinsäuren, kleine Moleküle, Ionen und modifizierte Reste durchführen kann. Die Genauigkeit von AlphaFold3 wurde im Vergleich zu vielen dedizierten Tools in der Vergangenheit (Protein-Ligand-Interaktion, Protein-Nukleinsäure-Interaktion, Antikörper-Antigen-Vorhersage) deutlich verbessert. Dies zeigt, dass dies innerhalb eines einzigen einheitlichen Deep-Learning-Frameworks möglich ist