Technologie-Peripheriegeräte

Technologie-Peripheriegeräte

KI

KI

Durch KI-Face-Swapping-Betrug wurden 4,3 Millionen Yuan betrogen. Verbraucherexperten empfehlen sofort drei Abwehrmaßnahmen

Durch KI-Face-Swapping-Betrug wurden 4,3 Millionen Yuan betrogen. Verbraucherexperten empfehlen sofort drei Abwehrmaßnahmen

Durch KI-Face-Swapping-Betrug wurden 4,3 Millionen Yuan betrogen. Verbraucherexperten empfehlen sofort drei Abwehrmaßnahmen

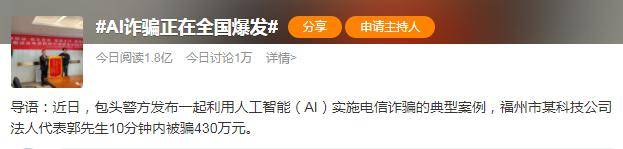

Kürzlich gab das Büro für öffentliche Sicherheit der Stadt Baotou bekannt, dass Herr Guo, der gesetzliche Vertreter eines Technologieunternehmens in Fuzhou, innerhalb von 10 Minuten um 4,3 Millionen Yuan betrogen wurde, weil die KI sein Gesicht veränderte #🎜🎜 #, was weit verbreitete Bedenken hinsichtlich der Sicherheit künstlicher Intelligenz auslöst. Heiße Diskussion.

darin, das Inhärente zu vermeiden.“ Mängel bei der Gesichtserkennung , Fotos, Videos, Masken, Simulationsmodelle usw. effektiv identifizieren, insbesondere der Betrug mit Gesichts- und Stimmveränderung, der bei diesem Vorfall aufgetreten ist.“

Zu den potenziellen Risiken, die KI mit sich bringt, sagte „AI-Godfather“ Hinton einmal in einem Interview mit der New York Times: „Im Vergleich zum Klimawandel könnteKI eine dringendere Bedrohung für die Menschheit darstellen.“ 🎜🎜#" Der Realität nach ist diese Aussage nicht „alarmistisch“. Das „Böse“ in der Büchse der Pandora kommt allmählich zum Vorschein. Gleichzeitig treibt AIGC die Entwicklung der KI rasch auf eine neue Stufe.

Das „Böse“ der Technologie verhindern: Sehen heißt nicht unbedingt glaubenLaut dem öffentlichen WeChat-Konto „Peace Baotou“ meldete das Untersuchungsbüro für Cyberkriminalität im Bereich Telekommunikation des Büros für öffentliche Sicherheit der Stadt Baotou einen Fall von Telekommunikationsbetrug. Herr Guo, der gesetzliche Vertreter eines Technologieunternehmens in der Stadt Fuzhou #🎜🎜 # wurde innerhalb von 10 Minuten betrogen

Glücklicherweise wurden 3,3684 Millionen Yuan an betrogenen Geldern abgefangen und „intelligente KI-Technologie zur Gesichtsveränderung und Lautmalerei“ eingesetzt.Wie haben sie das gemacht? Dies ist ein komplizierter Prozess, aus der Sicht des Opfers wurde Herr Guo hauptsächlich durch Gesichtsveränderungstechnologie und Onomatopoeia-Technologie

getäuscht Versteckte Bedeutungen hinter dem Vorfall sind erforderlich, z. B. über den Kanal, über den der Kriminelle Kontakt mit dem Opfer aufgenommen hat, wie er an das Konto der entsprechenden sozialen Software gelangt, wie er weiß, als wen er sich ausgeben muss, und wie er ihn erhält entsprechendes Bild- und Tonmaterial sowie die Auswahl des Opfers.Wenn wir uns auf die beiden Schlüsselthemen Gesichtsveränderungstechnologie und Onomatopoeia-Technologie

konzentrieren, sind die Hauptproblemedie Erfassung grundlegender Daten, das Trainingsgerüst und das Echtzeit-Rendering . Auf Datenebene können die Audio- und Videoinformationen des Imitators aus Social-Engineering-Bibliotheken wie sozialen Medien abgerufen oder aus dem Fotoalbum und dem Chatverlauf eines verlorenen schwarzen Telefons extrahiert werden. In Bezug auf das Trainings-Framework unterstützt die Bearbeitungssoftware mehrerer inländischer Mainstream-Kurzvideoplattformen derzeit gesichtsverändernde Spezialeffekte ohne Warnmeldungen. In ausländischen Open-Source-Frameworks gibt es mehr als 30 Synthesemethoden. Im Hinblick auf das Echtzeit-Rendering kann ein gekapertes Rendering auch durch Angriffsvorgänge wie das Flashen des Telefons und die Installation aufdringlicher Software erreicht werden. Deshalb „Sehen heißt nicht unbedingt glauben“

Hinter der Technik steckt immer bewusst „Böses“, vor dem man sich hüten muss.Ersticken Sie es im Keim, nutzen Sie die „

魔 Methode“, um die „Magie“ zu besiegen Risiken sind unvermeidlich. Wie können wir also „Magie“ nutzen, um „Magie“ zu besiegen?

Derzeit verfügen viele Finanzinstitute über entsprechende Umsetzungsmaßnahmen und damit verbundene Technologieanwendungen. Beispielsweise wurden Technologien wieIn-vivo-Fälschungsbekämpfung und Vermittleridentifizierung auch in Finanzgeschäftsszenarien eingesetzt.

„Die Kernfunktion von Live-Fälschungsbekämpfung, Zwischenidentifizierung und anderen Technologien besteht darin, die Mängel der Gesichtserkennung zu vermeiden

und Fotos, Videos, Masken, Simulationsmodelle usw. effektiv zu identifizieren. Insbesondere in diesem Vorfall sagte Feng Yue, ein intelligenter Kernexperte am MaMaConsumer Artificial Intelligence Research Institute: „Basierend auf solchen technologischen Innovationen ist MaMaConsumer Finance derzeit in der Lage, 99 % der Batch-Angriffe zu blockieren, was Risiken wie z.“ gefälschte Informationen, Vermittlungsagentur, gefälschte Anträge, langfristige Kreditvergabe, Telekommunikationsbetrug usw. „Im Vergleich zu Finanzinstituten ist soziale Software am Ende des gesamten Prozesses verpflichtet, Fälschungsmechanismen einzuführen und den Benutzern Anrufauthentifizierungserinnerungen in Echtzeit bereitzustellen, um zu markieren, ob der Peer-Benutzer ungewöhnliches Verhalten oder gefälschte Bilder aufweist Fälschungsanomalien. Durch frühere Risikowarninformationen kann das Auftreten von Risikofolgen wirksamer verhindert werden.

Zusätzlich zur plattformbezogenen Umsetzung kann die Öffentlichkeit auch einige Selbsthilfemaßnahmen ergreifen. Derzeit gibt es eine Art Technologie, die die Verwendung von Benutzerdaten für Gesichts- oder Stimmänderungen verhindern kann Art der Technologie heißtAdversarial Sample Technology#🎜 🎜#. Am Beispiel menschlicher Gesichtsbilder kann die Technologie zur Gesichtsveränderung unwirksam gemacht werden, indem man dem Bild eine gegnerische Störungsmaske beifügt, die für das bloße Auge unsichtbar ist. Benutzer können diese Art von Technologie nutzen, um ihre Medieninformationen wie Bilder und Stimmen in sozialen Medien zu schützen, bevor sie sie veröffentlichen.

Schließlich ist „Vorsorgebewusstsein“ der Grundstein aller „Magie“ , und die Öffentlichkeit muss auch den Sicherheitsschutz von persönlichen Gegenständen und Informationen stärken.

„Klicken Sie nicht auf unbekannte SMS-Links, E-Mail-Links usw., scannen Sie keine QR-Codes aus unbekannten Quellen, laden Sie keine APPs herunter, geben Sie Ihr Gesicht und andere persönliche biometrische Informationen nicht einfach an andere weiter, tun Sie es nicht einfach.“ Geben Sie Ihren Personalausweis, Ihre Bankkarte, Ihren Verifizierungscode und andere Informationen preis, geben Sie animierte Bilder, Videos usw. nicht übermäßig preis und teilen Sie sie nicht“, schlug Feng Yue vor. „Es gibt keine Garantie dafür, dass Mobiltelefone und andere mobile Geräte nicht verloren gehen. Sie können regelmäßig WeChat-Chat-Aufzeichnungen löschen, relevante Spuren von Personen verbergen, mit denen Sie eine enge Beziehung haben, Fotoalben von Mobiltelefonen verschlüsseln oder die Datenschutzfunktion Ihres Geräts aktivieren.“ Mobiltelefon. Diese alltäglichen Verhaltensweisen können zu Betrug führen.

Es dauert lange, bis man Schritt für Schritt zum Erfolg kommt. Die Verhinderung des „Missbrauchs“ der Technologie der künstlichen Intelligenz wird auch im digitalen Zeitalter ein zentrales Thema bleiben.Quelle: Informationen zur Finanzbranche

Das obige ist der detaillierte Inhalt vonDurch KI-Face-Swapping-Betrug wurden 4,3 Millionen Yuan betrogen. Verbraucherexperten empfehlen sofort drei Abwehrmaßnahmen. Für weitere Informationen folgen Sie bitte anderen verwandten Artikeln auf der PHP chinesischen Website!

Heiße KI -Werkzeuge

Undresser.AI Undress

KI-gestützte App zum Erstellen realistischer Aktfotos

AI Clothes Remover

Online-KI-Tool zum Entfernen von Kleidung aus Fotos.

Undress AI Tool

Ausziehbilder kostenlos

Clothoff.io

KI-Kleiderentferner

AI Hentai Generator

Erstellen Sie kostenlos Ai Hentai.

Heißer Artikel

Heiße Werkzeuge

Notepad++7.3.1

Einfach zu bedienender und kostenloser Code-Editor

SublimeText3 chinesische Version

Chinesische Version, sehr einfach zu bedienen

Senden Sie Studio 13.0.1

Leistungsstarke integrierte PHP-Entwicklungsumgebung

Dreamweaver CS6

Visuelle Webentwicklungstools

SublimeText3 Mac-Version

Codebearbeitungssoftware auf Gottesniveau (SublimeText3)

Heiße Themen

1377

1377

52

52

Ich habe versucht, die Vibe -Codierung mit Cursor AI und es ist erstaunlich!

Mar 20, 2025 pm 03:34 PM

Ich habe versucht, die Vibe -Codierung mit Cursor AI und es ist erstaunlich!

Mar 20, 2025 pm 03:34 PM

Die Vibe -Codierung verändert die Welt der Softwareentwicklung, indem wir Anwendungen mit natürlicher Sprache anstelle von endlosen Codezeilen erstellen können. Inspiriert von Visionären wie Andrej Karpathy, lässt dieser innovative Ansatz Dev

Top 5 Genai Starts vom Februar 2025: GPT-4,5, GROK-3 & MEHR!

Mar 22, 2025 am 10:58 AM

Top 5 Genai Starts vom Februar 2025: GPT-4,5, GROK-3 & MEHR!

Mar 22, 2025 am 10:58 AM

Februar 2025 war ein weiterer bahnbrechender Monat für die Generative KI, die uns einige der am meisten erwarteten Modell-Upgrades und bahnbrechenden neuen Funktionen gebracht hat. Von Xais Grok 3 und Anthropics Claude 3.7 -Sonett, um g zu eröffnen

Wie benutze ich Yolo V12 zur Objekterkennung?

Mar 22, 2025 am 11:07 AM

Wie benutze ich Yolo V12 zur Objekterkennung?

Mar 22, 2025 am 11:07 AM

Yolo (Sie schauen nur einmal) war ein führender Echtzeit-Objekterkennungsrahmen, wobei jede Iteration die vorherigen Versionen verbessert. Die neueste Version Yolo V12 führt Fortschritte vor, die die Genauigkeit erheblich verbessern

Ist Chatgpt 4 o verfügbar?

Mar 28, 2025 pm 05:29 PM

Ist Chatgpt 4 o verfügbar?

Mar 28, 2025 pm 05:29 PM

Chatgpt 4 ist derzeit verfügbar und weit verbreitet, wodurch im Vergleich zu seinen Vorgängern wie ChatGPT 3.5 signifikante Verbesserungen beim Verständnis des Kontextes und des Generierens kohärenter Antworten zeigt. Zukünftige Entwicklungen können mehr personalisierte Inters umfassen

Gencast von Google: Wettervorhersage mit Gencast Mini Demo

Mar 16, 2025 pm 01:46 PM

Gencast von Google: Wettervorhersage mit Gencast Mini Demo

Mar 16, 2025 pm 01:46 PM

Gencast von Google Deepmind: Eine revolutionäre KI für die Wettervorhersage Die Wettervorhersage wurde einer dramatischen Transformation unterzogen, die sich von rudimentären Beobachtungen zu ausgefeilten AI-angetriebenen Vorhersagen überschreitet. Google DeepMinds Gencast, ein Bodenbrei

Welche KI ist besser als Chatgpt?

Mar 18, 2025 pm 06:05 PM

Welche KI ist besser als Chatgpt?

Mar 18, 2025 pm 06:05 PM

Der Artikel erörtert KI -Modelle, die Chatgpt wie Lamda, Lama und Grok übertreffen und ihre Vorteile in Bezug auf Genauigkeit, Verständnis und Branchenauswirkungen hervorheben. (159 Charaktere)

Beste KI -Kunstgeneratoren (kostenlos & amp; bezahlt) für kreative Projekte

Apr 02, 2025 pm 06:10 PM

Beste KI -Kunstgeneratoren (kostenlos & amp; bezahlt) für kreative Projekte

Apr 02, 2025 pm 06:10 PM

Der Artikel überprüft Top -KI -Kunstgeneratoren, diskutiert ihre Funktionen, Eignung für kreative Projekte und Wert. Es zeigt MidJourney als den besten Wert für Fachkräfte und empfiehlt Dall-E 2 für hochwertige, anpassbare Kunst.

O1 gegen GPT-4O: Ist OpenAIs neues Modell besser als GPT-4O?

Mar 16, 2025 am 11:47 AM

O1 gegen GPT-4O: Ist OpenAIs neues Modell besser als GPT-4O?

Mar 16, 2025 am 11:47 AM

Openais O1: Ein 12-tägiger Geschenkbummel beginnt mit ihrem bisher mächtigsten Modell Die Ankunft im Dezember bringt eine globale Verlangsamung, Schneeflocken in einigen Teilen der Welt, aber Openai fängt gerade erst an. Sam Altman und sein Team starten ein 12-tägiges Geschenk Ex