Technologie-Peripheriegeräte

Technologie-Peripheriegeräte

KI

KI

Generalistische KI-Agenten von SenseTime und der Tsinghua-Universität schalten Minecraft zu 100 % frei! 2 Tage Training auf einer einzelnen CPU, um eine Redstone-Schaltung von Grund auf zu erstellen

Generalistische KI-Agenten von SenseTime und der Tsinghua-Universität schalten Minecraft zu 100 % frei! 2 Tage Training auf einer einzelnen CPU, um eine Redstone-Schaltung von Grund auf zu erstellen

Generalistische KI-Agenten von SenseTime und der Tsinghua-Universität schalten Minecraft zu 100 % frei! 2 Tage Training auf einer einzelnen CPU, um eine Redstone-Schaltung von Grund auf zu erstellen

Es gibt ein sehr interessantes, aber dem gesunden Menschenverstand widersprechendes Phänomen im Entwicklungsprozess der KI –

„Einige Aufgaben, die für Menschen relativ schwierig sind, wie zum Beispiel Schach spielen, sind für KI relativ einfach zu bewältigen. Und im Offene Dinge auf der Welt, die für den Menschen relativ einfach sind, wie etwa die Interaktion mit der Umwelt, Planung und Entscheidungsfindung, steht der KI vor großen Herausforderungen.“

Und das ist Moravecs Paradoxon.

Jetzt hat GITM diese paradoxe Einschränkung jedoch erfolgreich durchbrochen, Durchbrüche in komplexen und realweltähnlichen Umgebungen erzielt und ist in der Lage, wie Menschen zu überleben, zu erforschen und zu erschaffen!

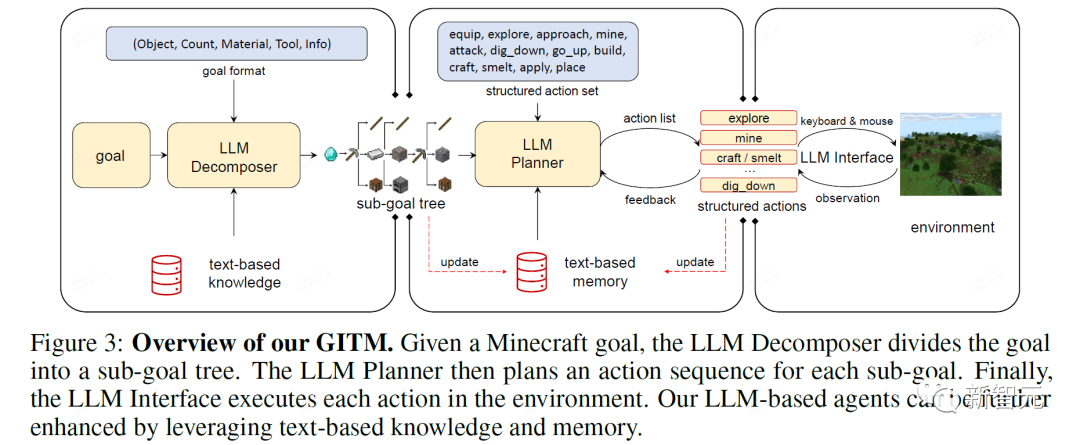

Im Bestseller-Spiel „Minecraft“, das die reale Welt genau simuliert, ist die von SenseTime und Forschern der Tsinghua-Universität, dem Shanghai Artificial Intelligence Laboratory und anderen Institutionen gemeinsam vorgeschlagene generalistische KI der Agent Ghost in der Minecraft (GITM) kann nicht nur Minecraft spielen, sondern schneidet auch besser ab als alle bisherigen Agenten.

Projekthomepage: https://github.com/OpenGVLab/GITM

Überleben, erforschen und erschaffen wie Menschen

Diese Forschung geht in die Richtung der Künstlichen Allgemeinen Intelligenz (AGI). ) Ein wichtiger Schritt ist getan.

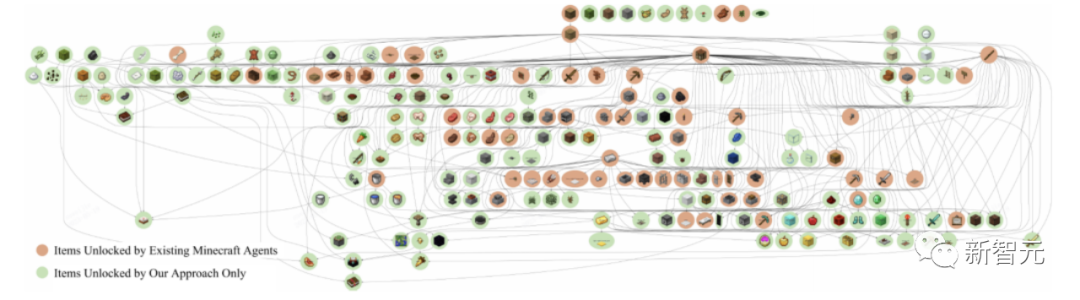

Umfangreiche Missionsabdeckung

GITM erreichte 100 % Missionsabdeckung für alle technischen Herausforderungen in der Hauptwelt von Minecraft (die kompletten 262 Gegenstände im Technologiebaum wurden erfolgreich freigeschaltet), während die Summe aller bisherigen Agenten konnte nur 30 % abdecken. (In der Vergangenheit haben alle Agentenmethoden, einschließlich OpenAI und DeepMind, insgesamt nur 78 freigeschaltet)

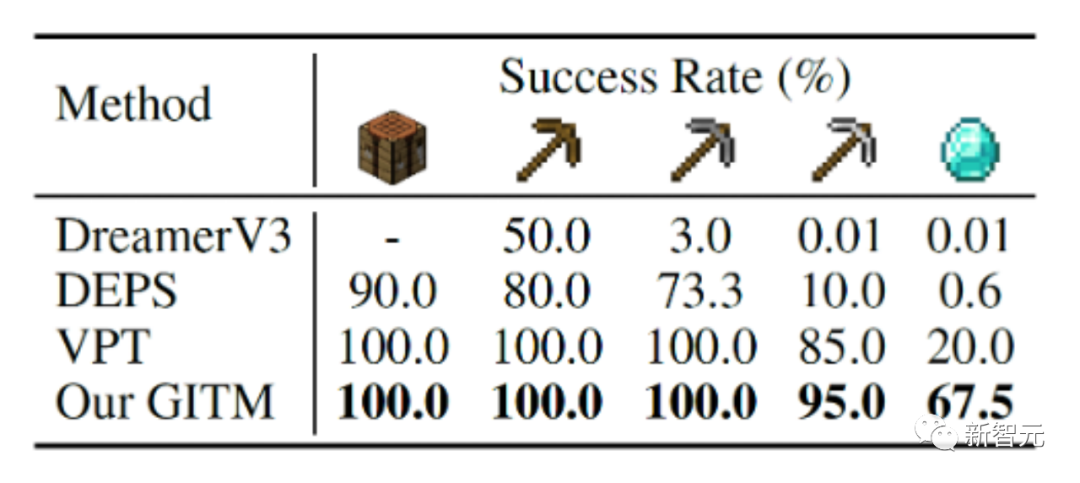

Hohe Erfolgsquote bei Aufgaben

Bei der meistgesehenen Aufgabe „Get Diamonds“ hat GITM erreicht eine Erfolgsquote von 67,5 %, was 47,5 % höher ist als das aktuell beste Ergebnis (OpenAI VPT).

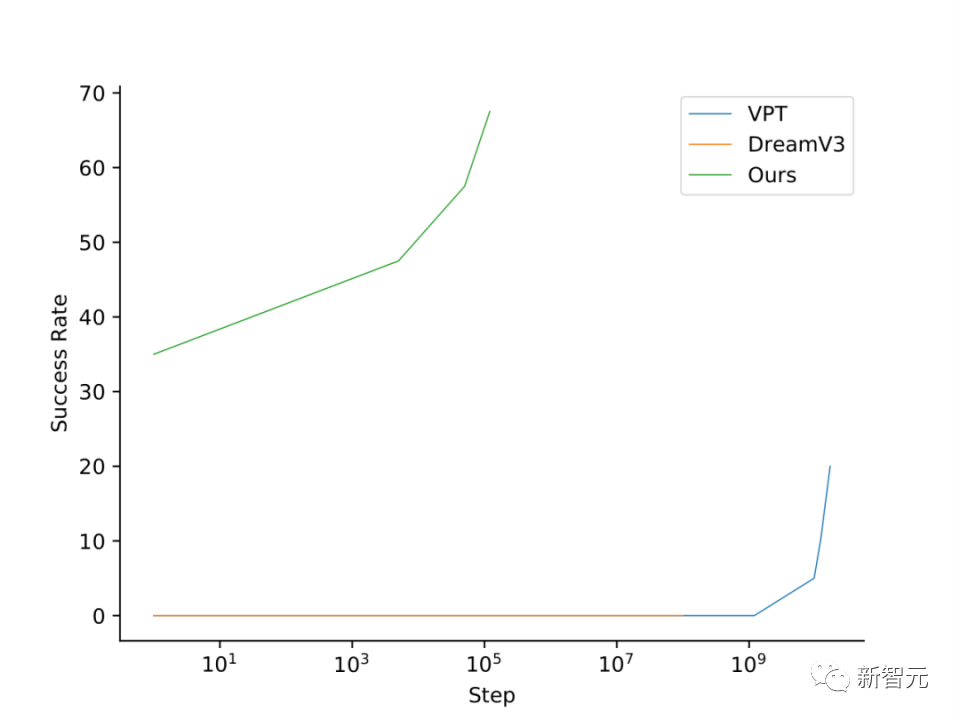

Extrem hohe Trainingseffizienz

Auch die Trainingseffizienz von GITM hat einen neuen Höhepunkt erreicht. Die Anzahl der Umgebungsinteraktionsschritte beträgt nur ein Zehntausendstel der vorhandenen Methoden, und das Training auf einem einzelnen CPU-Knoten kann in zwei Tagen abgeschlossen werden, was weit weniger ist als die 6480 GPU-Tage, die beim vorherigen OpenAI VPT oder der 17-GPU erforderlich waren Tage, die DeepMind DreamerV3 benötigt.

Der generalistische KI-Agent „Ghost in the Minecraft“ (GITM) spielt das Spiel „Minecraft“, indem er im Überlebensmodus bei Null anfängt, alle Gegenstände in der Hauptwelt beschafft und nach Diamanten gräbt Kein Problem. Kann verzauberte Bücher erstellen!

GITM kann mit verschiedenen Terrains, Umgebungen, Tag- und Nachtszenen umgehen und sogar Monstern problemlos begegnen.

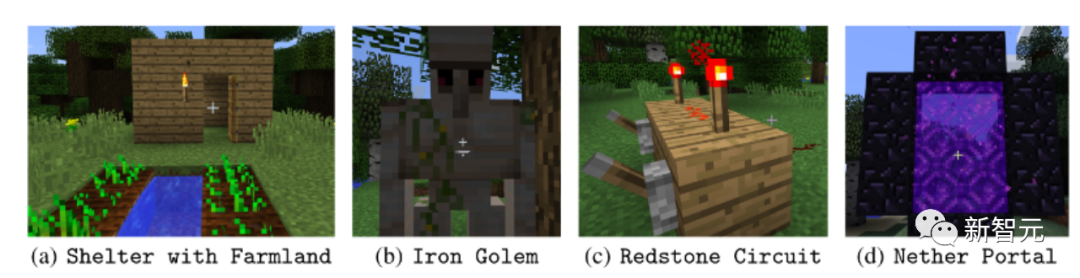

GITM kann auch bei komplexeren Aufgaben in „Minecraft“ eingesetzt werden, z. B. bei Überlebensbedürfnissen wie Unterkünften, Ackerland, Eisengolems, Redstone-Schaltkreise, die zur Herstellung automatisierter Geräte benötigt werden, Netherportale, die zum Betreten der Unterwelt benötigt werden usw.

Diese Aufgaben demonstrieren die leistungsstarken Fähigkeiten und Skalierbarkeit von GITM, die es Agenten ermöglichen, in „Minecraft“ lange zu überleben und sich weiterzuentwickeln und fortgeschrittenere Welten zu erkunden.

Allgemeine Durchbrüche bei der künstlichen Intelligenz beschleunigen die KI-Industrialisierungsrevolution

Entwickeln Sie einen KI-Agenten GITM, der alle technischen Herausforderungen in „Minecraft“ meistert, mit dem Ziel, eine allgemeine Richtung der künstlichen Intelligenz aufzubauen, die das Ganze autonom lernen und meistern kann Fähigkeiten aus der Praxis.

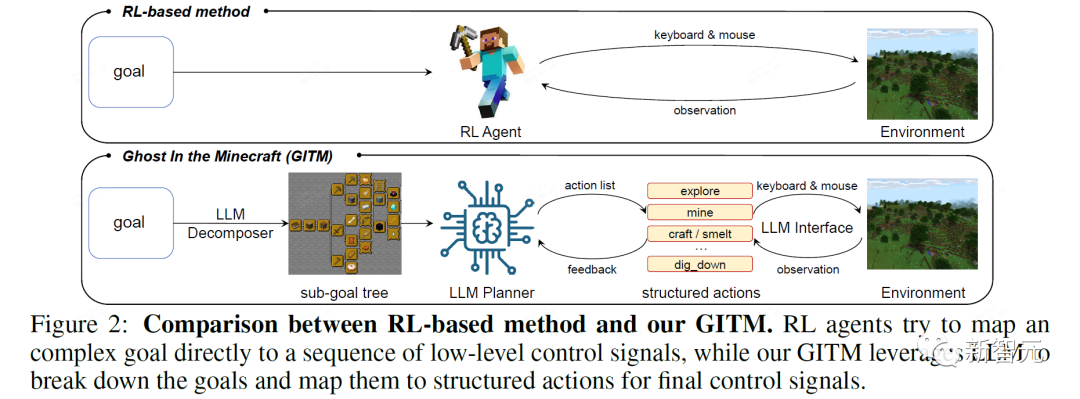

GITM durchbricht die traditionelle RL-basierte Architektur und übernimmt ein neues Paradigma des Large Language Model (LLM) als Kern des Agenten.

Diese Innovation trägt auch dazu bei, das Forschungsziel der künstlichen allgemeinen Intelligenz (AGI) zu beschleunigen und intelligente Agenten zu entwickeln, die wie Menschen in einer offenen Weltumgebung wahrnehmen, verstehen und interagieren können, und große Durchbrüche bringen und Fortschritte in Branchen wie Robotik und autonomem Fahren, lösen komplexe Umgebungen und verschiedene Long-Tail-Probleme in der realen Welt effektiv und fördern die Implementierung von KI-Technologie in größeren Branchen.

„Ghost in the Minecraft“ (GITM)

Profitieren Sie von der strategischen Ausrichtung „großes Modell + große Rechenleistung“, um auch die Entwicklung von AGI (allgemeine künstliche Intelligenz) voranzutreiben Als Full-Stack-Großmodell-F&E-System konnte sich SenseTime im Bereich der multimodalen und vielseitig einsetzbaren Großmodelle mit dem „Ririxin SenseNova“-Großmodellsystem als Kern schnell weiterentwickeln Helfen Sie dabei, innovative Technologien schnell auf Smart Cars, Smart Life, Smart Business und Smart Cities anzuwenden. In Bereichen wie Smart Cities werden wir die industrielle Intelligenz weiter verbessern.

Heute wird der Erfolg von GITM die Fähigkeit von Anwendungen wie dem autonomen Fahren, komplexe Aufgaben zu bewältigen, auf ein höheres Niveau heben und höhere technische Grenzen durchbrechen.

Das obige ist der detaillierte Inhalt vonGeneralistische KI-Agenten von SenseTime und der Tsinghua-Universität schalten Minecraft zu 100 % frei! 2 Tage Training auf einer einzelnen CPU, um eine Redstone-Schaltung von Grund auf zu erstellen. Für weitere Informationen folgen Sie bitte anderen verwandten Artikeln auf der PHP chinesischen Website!

Heiße KI -Werkzeuge

Undresser.AI Undress

KI-gestützte App zum Erstellen realistischer Aktfotos

AI Clothes Remover

Online-KI-Tool zum Entfernen von Kleidung aus Fotos.

Undress AI Tool

Ausziehbilder kostenlos

Clothoff.io

KI-Kleiderentferner

AI Hentai Generator

Erstellen Sie kostenlos Ai Hentai.

Heißer Artikel

Heiße Werkzeuge

Notepad++7.3.1

Einfach zu bedienender und kostenloser Code-Editor

SublimeText3 chinesische Version

Chinesische Version, sehr einfach zu bedienen

Senden Sie Studio 13.0.1

Leistungsstarke integrierte PHP-Entwicklungsumgebung

Dreamweaver CS6

Visuelle Webentwicklungstools

SublimeText3 Mac-Version

Codebearbeitungssoftware auf Gottesniveau (SublimeText3)

Heiße Themen

1374

1374

52

52

Bytedance Cutting führt SVIP-Supermitgliedschaft ein: 499 Yuan für ein fortlaufendes Jahresabonnement, das eine Vielzahl von KI-Funktionen bietet

Jun 28, 2024 am 03:51 AM

Bytedance Cutting führt SVIP-Supermitgliedschaft ein: 499 Yuan für ein fortlaufendes Jahresabonnement, das eine Vielzahl von KI-Funktionen bietet

Jun 28, 2024 am 03:51 AM

Diese Seite berichtete am 27. Juni, dass Jianying eine von FaceMeng Technology, einer Tochtergesellschaft von ByteDance, entwickelte Videobearbeitungssoftware ist, die auf der Douyin-Plattform basiert und grundsätzlich kurze Videoinhalte für Benutzer der Plattform produziert Windows, MacOS und andere Betriebssysteme. Jianying kündigte offiziell die Aktualisierung seines Mitgliedschaftssystems an und führte ein neues SVIP ein, das eine Vielzahl von KI-Schwarztechnologien umfasst, wie z. B. intelligente Übersetzung, intelligente Hervorhebung, intelligente Verpackung, digitale menschliche Synthese usw. Preislich beträgt die monatliche Gebühr für das Clipping von SVIP 79 Yuan, die Jahresgebühr 599 Yuan (Hinweis auf dieser Website: entspricht 49,9 Yuan pro Monat), das fortlaufende Monatsabonnement beträgt 59 Yuan pro Monat und das fortlaufende Jahresabonnement beträgt 499 Yuan pro Jahr (entspricht 41,6 Yuan pro Monat). Darüber hinaus erklärte der Cut-Beamte auch, dass diejenigen, die den ursprünglichen VIP abonniert haben, das Benutzererlebnis verbessern sollen

Kontexterweiterter KI-Codierungsassistent mit Rag und Sem-Rag

Jun 10, 2024 am 11:08 AM

Kontexterweiterter KI-Codierungsassistent mit Rag und Sem-Rag

Jun 10, 2024 am 11:08 AM

Verbessern Sie die Produktivität, Effizienz und Genauigkeit der Entwickler, indem Sie eine abrufgestützte Generierung und ein semantisches Gedächtnis in KI-Codierungsassistenten integrieren. Übersetzt aus EnhancingAICodingAssistantswithContextUsingRAGandSEM-RAG, Autor JanakiramMSV. Obwohl grundlegende KI-Programmierassistenten natürlich hilfreich sind, können sie oft nicht die relevantesten und korrektesten Codevorschläge liefern, da sie auf einem allgemeinen Verständnis der Softwaresprache und den gängigsten Mustern beim Schreiben von Software basieren. Der von diesen Coding-Assistenten generierte Code eignet sich zur Lösung der von ihnen zu lösenden Probleme, entspricht jedoch häufig nicht den Coding-Standards, -Konventionen und -Stilen der einzelnen Teams. Dabei entstehen häufig Vorschläge, die geändert oder verfeinert werden müssen, damit der Code in die Anwendung übernommen wird

Kann LLM durch Feinabstimmung wirklich neue Dinge lernen: Die Einführung neuen Wissens kann dazu führen, dass das Modell mehr Halluzinationen hervorruft

Jun 11, 2024 pm 03:57 PM

Kann LLM durch Feinabstimmung wirklich neue Dinge lernen: Die Einführung neuen Wissens kann dazu führen, dass das Modell mehr Halluzinationen hervorruft

Jun 11, 2024 pm 03:57 PM

Large Language Models (LLMs) werden auf riesigen Textdatenbanken trainiert und erwerben dort große Mengen an realem Wissen. Dieses Wissen wird in ihre Parameter eingebettet und kann dann bei Bedarf genutzt werden. Das Wissen über diese Modelle wird am Ende der Ausbildung „verdinglicht“. Am Ende des Vortrainings hört das Modell tatsächlich auf zu lernen. Richten Sie das Modell aus oder verfeinern Sie es, um zu erfahren, wie Sie dieses Wissen nutzen und natürlicher auf Benutzerfragen reagieren können. Aber manchmal reicht Modellwissen nicht aus, und obwohl das Modell über RAG auf externe Inhalte zugreifen kann, wird es als vorteilhaft angesehen, das Modell durch Feinabstimmung an neue Domänen anzupassen. Diese Feinabstimmung erfolgt mithilfe von Eingaben menschlicher Annotatoren oder anderer LLM-Kreationen, wobei das Modell auf zusätzliches Wissen aus der realen Welt trifft und dieses integriert

Keine OpenAI-Daten erforderlich, schließen Sie sich der Liste der großen Codemodelle an! UIUC veröffentlicht StarCoder-15B-Instruct

Jun 13, 2024 pm 01:59 PM

Keine OpenAI-Daten erforderlich, schließen Sie sich der Liste der großen Codemodelle an! UIUC veröffentlicht StarCoder-15B-Instruct

Jun 13, 2024 pm 01:59 PM

An der Spitze der Softwaretechnologie kündigte die Gruppe von UIUC Zhang Lingming zusammen mit Forschern der BigCode-Organisation kürzlich das StarCoder2-15B-Instruct-Großcodemodell an. Diese innovative Errungenschaft erzielte einen bedeutenden Durchbruch bei Codegenerierungsaufgaben, übertraf erfolgreich CodeLlama-70B-Instruct und erreichte die Spitze der Codegenerierungsleistungsliste. Die Einzigartigkeit von StarCoder2-15B-Instruct liegt in seiner reinen Selbstausrichtungsstrategie. Der gesamte Trainingsprozess ist offen, transparent und völlig autonom und kontrollierbar. Das Modell generiert über StarCoder2-15B Tausende von Anweisungen als Reaktion auf die Feinabstimmung des StarCoder-15B-Basismodells, ohne auf teure manuelle Annotationen angewiesen zu sein.

Um ein neues wissenschaftliches und komplexes Frage-Antwort-Benchmark- und Bewertungssystem für große Modelle bereitzustellen, haben UNSW, Argonne, die University of Chicago und andere Institutionen gemeinsam das SciQAG-Framework eingeführt

Jul 25, 2024 am 06:42 AM

Um ein neues wissenschaftliches und komplexes Frage-Antwort-Benchmark- und Bewertungssystem für große Modelle bereitzustellen, haben UNSW, Argonne, die University of Chicago und andere Institutionen gemeinsam das SciQAG-Framework eingeführt

Jul 25, 2024 am 06:42 AM

Herausgeber | Der Frage-Antwort-Datensatz (QA) von ScienceAI spielt eine entscheidende Rolle bei der Förderung der Forschung zur Verarbeitung natürlicher Sprache (NLP). Hochwertige QS-Datensätze können nicht nur zur Feinabstimmung von Modellen verwendet werden, sondern auch effektiv die Fähigkeiten großer Sprachmodelle (LLMs) bewerten, insbesondere die Fähigkeit, wissenschaftliche Erkenntnisse zu verstehen und zu begründen. Obwohl es derzeit viele wissenschaftliche QS-Datensätze aus den Bereichen Medizin, Chemie, Biologie und anderen Bereichen gibt, weisen diese Datensätze immer noch einige Mängel auf. Erstens ist das Datenformular relativ einfach, die meisten davon sind Multiple-Choice-Fragen. Sie sind leicht auszuwerten, schränken jedoch den Antwortauswahlbereich des Modells ein und können die Fähigkeit des Modells zur Beantwortung wissenschaftlicher Fragen nicht vollständig testen. Im Gegensatz dazu offene Fragen und Antworten

Yolov10: Ausführliche Erklärung, Bereitstellung und Anwendung an einem Ort!

Jun 07, 2024 pm 12:05 PM

Yolov10: Ausführliche Erklärung, Bereitstellung und Anwendung an einem Ort!

Jun 07, 2024 pm 12:05 PM

1. Einleitung In den letzten Jahren haben sich YOLOs aufgrund ihres effektiven Gleichgewichts zwischen Rechenkosten und Erkennungsleistung zum vorherrschenden Paradigma im Bereich der Echtzeit-Objekterkennung entwickelt. Forscher haben das Architekturdesign, die Optimierungsziele, Datenerweiterungsstrategien usw. von YOLO untersucht und erhebliche Fortschritte erzielt. Gleichzeitig behindert die Verwendung von Non-Maximum Suppression (NMS) bei der Nachbearbeitung die End-to-End-Bereitstellung von YOLO und wirkt sich negativ auf die Inferenzlatenz aus. In YOLOs fehlt dem Design verschiedener Komponenten eine umfassende und gründliche Prüfung, was zu erheblicher Rechenredundanz führt und die Fähigkeiten des Modells einschränkt. Es bietet eine suboptimale Effizienz und ein relativ großes Potenzial zur Leistungsverbesserung. Ziel dieser Arbeit ist es, die Leistungseffizienzgrenze von YOLO sowohl in der Nachbearbeitung als auch in der Modellarchitektur weiter zu verbessern. zu diesem Zweck

SOTA Performance, eine multimodale KI-Methode zur Vorhersage der Protein-Ligand-Affinität in Xiamen, kombiniert erstmals molekulare Oberflächeninformationen

Jul 17, 2024 pm 06:37 PM

SOTA Performance, eine multimodale KI-Methode zur Vorhersage der Protein-Ligand-Affinität in Xiamen, kombiniert erstmals molekulare Oberflächeninformationen

Jul 17, 2024 pm 06:37 PM

Herausgeber |. KX Im Bereich der Arzneimittelforschung und -entwicklung ist die genaue und effektive Vorhersage der Bindungsaffinität von Proteinen und Liganden für das Arzneimittelscreening und die Arzneimitteloptimierung von entscheidender Bedeutung. Aktuelle Studien berücksichtigen jedoch nicht die wichtige Rolle molekularer Oberflächeninformationen bei Protein-Ligand-Wechselwirkungen. Auf dieser Grundlage schlugen Forscher der Universität Xiamen ein neuartiges Framework zur multimodalen Merkmalsextraktion (MFE) vor, das erstmals Informationen über Proteinoberfläche, 3D-Struktur und -Sequenz kombiniert und einen Kreuzaufmerksamkeitsmechanismus verwendet, um verschiedene Modalitäten zu vergleichen Ausrichtung. Experimentelle Ergebnisse zeigen, dass diese Methode bei der Vorhersage von Protein-Ligand-Bindungsaffinitäten Spitzenleistungen erbringt. Darüber hinaus belegen Ablationsstudien die Wirksamkeit und Notwendigkeit der Proteinoberflächeninformation und der multimodalen Merkmalsausrichtung innerhalb dieses Rahmens. Verwandte Forschungen beginnen mit „S

GlobalFoundries erschließt Märkte wie KI und erwirbt die Galliumnitrid-Technologie von Tagore Technology und zugehörige Teams

Jul 15, 2024 pm 12:21 PM

GlobalFoundries erschließt Märkte wie KI und erwirbt die Galliumnitrid-Technologie von Tagore Technology und zugehörige Teams

Jul 15, 2024 pm 12:21 PM

Laut Nachrichten dieser Website vom 5. Juli veröffentlichte GlobalFoundries am 1. Juli dieses Jahres eine Pressemitteilung, in der die Übernahme der Power-Galliumnitrid (GaN)-Technologie und des Portfolios an geistigem Eigentum von Tagore Technology angekündigt wurde, in der Hoffnung, seinen Marktanteil in den Bereichen Automobile und Internet auszubauen Anwendungsbereiche für Rechenzentren mit künstlicher Intelligenz, um höhere Effizienz und bessere Leistung zu erforschen. Da sich Technologien wie generative künstliche Intelligenz (GenerativeAI) in der digitalen Welt weiterentwickeln, ist Galliumnitrid (GaN) zu einer Schlüssellösung für nachhaltiges und effizientes Energiemanagement, insbesondere in Rechenzentren, geworden. Auf dieser Website wurde die offizielle Ankündigung zitiert, dass sich das Ingenieurteam von Tagore Technology im Rahmen dieser Übernahme mit GF zusammenschließen wird, um die Galliumnitrid-Technologie weiterzuentwickeln. G