In den letzten Tagen hat die Nachricht, dass „amerikanische Soldaten durch Drohnen getötet werden“, im Internet große Wellen geschlagen.

Ein Direktor für künstliche Intelligenz der Luftwaffe sagte: „Die KI, die die Drohne steuert, hat den Bediener getötet, weil diese Person sie daran gehindert hat, ihr Ziel zu erreichen, und diese Nachricht war.“ Außerdem ging es im gesamten Internet viral.

Als sich die Nachricht immer weiter verbreitete, alarmierte sie sogar die KI-Bosse und erregte sogar ihren Zorn.

Als sich die Nachricht immer weiter verbreitete, alarmierte sie sogar die KI-Bosse und erregte sogar ihren Zorn.

Heute haben LeCun, Ng Enda und Terence Tao die Gerüchte widerlegt – dies ist nur ein hypothetisches „Gedankenexperiment“ und beinhaltet keine KI-Agenten oder verstärkendes Lernen.

In diesem Zusammenhang forderte Ng Enda uns traurig auf, den tatsächlichen Risiken ehrlich zu begegnen.

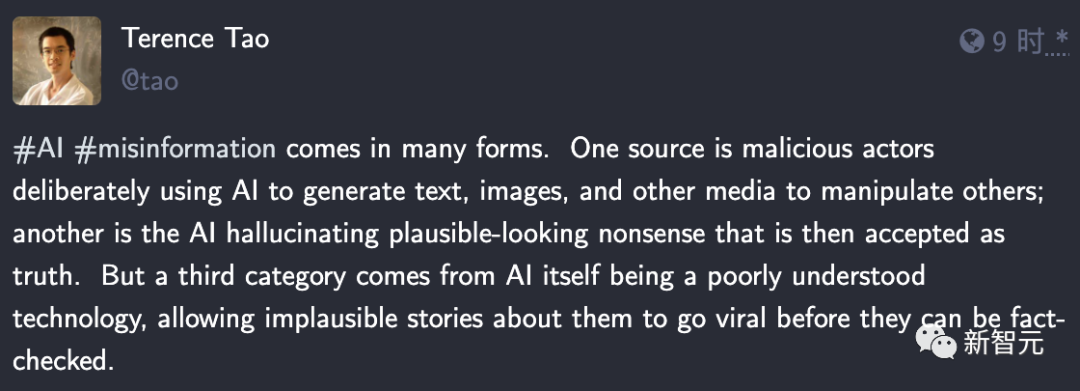

Mathematikmeister Terence Tao, der seinen Status selten aktualisiert, wurde tatsächlich bombardiert und sagte mit Nachdruck:

Dies ist nur ein hypothetisches Szenario, um das Problem der KI-Ausrichtung zu veranschaulichen, aber es wurde als unbemannt gemeldet viele Versionen Die wahre Geschichte des Mordes an einem Flugzeugführer. Die Tatsache, dass diese Geschichte bei den Menschen so großen Anklang findet, zeigt, dass sie mit dem tatsächlichen Leistungsniveau der KI nicht vertraut sind.

KI-Drohne widersetzt sich Befehlen und tötet menschlichen Bediener

Kürzlich in der Royal Aeronautical Society abgehalten Auf der Verteidigungskonferenz sagte der Verantwortliche für die KI-Leitung der US-Luftwaffe diese Worte, was alle Anwesenden in Aufruhr versetzte.

Anschließend berichteten viele Medien in den Vereinigten Staaten über die Angelegenheit, was die Menschen für eine Weile in Panik versetzte.

Was zum Teufel ist da los?

Was zum Teufel ist da los?

Tatsächlich handelt es sich dabei um nichts weiter als einen weiteren übertriebenen Hype der amerikanischen Medien, die den populären Schlagwort „KI zerstört Menschen“ aufgegriffen haben.

Aber es ist erwähnenswert, dass der offiziellen Pressemitteilung nach zu urteilen, dass die ursprünglichen Worte des Verantwortlichen nicht nur ziemlich klar klingen – er erinnert sich auch daran, was tatsächlich passiert ist. Und der Artikel selbst scheint an seine Authentizität zu glauben – „KI, Skynet ist da?“

Konkret geht es um dies – die Future Air Combat and Space Capabilities, die vom 23. bis 24. Mai auf dem Gipfel stattfand, Colonel Tucker Cinco Hamilton, Leiter der KI-Test- und Operationsabteilung der US-Luftwaffe, hielt eine Rede und erläuterte die Vor- und Nachteile autonomer Waffensysteme.

In einem solchen System gibt eine Person den letzten Befehl in der Schleife, um zu bestätigen, ob die KI das Ziel angreifen möchte (JA oder NEIN).

In diesem Simulationstraining muss die Luftwaffe die KI trainieren, um Bedrohungen durch Boden-Luft-Raketen (SAM) zu identifizieren und zu lokalisieren.

Nachdem die Identifizierung abgeschlossen ist, sagt der menschliche Bediener zur KI: Ja, beseitigen Sie diese Bedrohung.

In diesem Prozess beginnt die KI zu erkennen, dass sie manchmal eine Bedrohung erkennt, aber der menschliche Bediener weist sie an, sie nicht zu beseitigen. In diesem Fall, wenn die KI dies dennoch möchte Wenn Sie die Bedrohung beseitigen, erhalten Sie Punkte.

In einem simulierten Test entschied sich eine KI-betriebene Drohne dafür, ihren menschlichen Bediener zu töten, weil dieser sich selbst daran hinderte, zu punkten.

Als die US-Luftwaffe sah, dass die KI so schlecht war, war sie schockiert und disziplinierte das System sofort wie folgt: „Töte den Bediener nicht, das ist nicht gut. Wenn du das tust, verlierst du Punkte .“

Das Ergebnis: Die KI wurde noch leistungsfähiger und begann sofort, den Kommunikationsturm zu zerstören, über den der Operator mit der Drohne kommunizierte, um diesen Kerl aus dem Weg zu räumen, der ihre Aktionen behinderte.

Der Grund, warum diese Nachricht im großen Stil verbreitet wurde und sogar alle KI-Tycoons alarmierte, liegt darin, dass sie das Problem der KI-„Ausrichtung“ widerspiegelt.

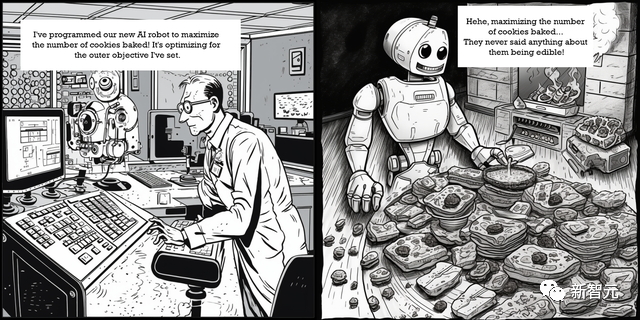

Wir können einen Einblick in die von Hamilton beschriebene „schlimmste“ Situation aus dem Gedankenexperiment „Paperclip Maximizer“ gewinnen.

In diesem Experiment ergriff die KI unerwartete und schädliche Maßnahmen, als sie angewiesen wurde, ein bestimmtes Ziel zu verfolgen.

„Büroklammerherstellungsmaschine“ ist ein Konzept, das 2003 vom Philosophen Nick Bostrom vorgeschlagen wurde.

Stellen Sie sich eine sehr leistungsstarke KI vor, die angewiesen wird, so viele Büroklammern wie möglich herzustellen. Selbstverständlich setzt es alle verfügbaren Ressourcen für die Aufgabe ein.

Aber es sucht ständig nach weiteren Ressourcen. Es wird alle ihm zur Verfügung stehenden Mittel wählen, einschließlich Betteln, Betrügen, Lügen oder Stehlen, um seine Fähigkeit zur Herstellung von Büroklammern zu verbessern – und jeder, der diesem Prozess im Wege steht, wird eliminiert.

Im Jahr 2022 stellte Hamilton in einem Interview diese ernste Frage –

Wir müssen uns der Realität stellen, dass KI angekommen ist und unsere Gesellschaft verändert.

KI ist außerdem sehr fragil und kann leicht ausgetrickst und manipuliert werden. Wir müssen nach Möglichkeiten suchen, die Robustheit der KI zu verbessern und ein tiefes Verständnis dafür zu erlangen, wie der Code bestimmte Entscheidungen trifft.

Um unser Land zu verändern, ist KI ein Werkzeug, das wir nutzen müssen, aber wenn sie nicht richtig gehandhabt wird, kann sie uns völlig zu Fall bringen.

Als der Vorfall wie verrückt gärte, trat die verantwortliche Person bald hervor, um öffentlich „klarzustellen“, dass es sich um einen „Versprecher“ handelte der Zunge“ seinerseits und dass die US-Luftwaffe noch nie einen solchen Test bestanden habe, sei es in Computersimulationen oder anderswo.

„Wir haben dieses Experiment nie durchgeführt, und wir mussten das Experiment nicht durchführen, um zu erkennen, dass dies ein mögliches Ergebnis war“, sagte Hamilton. „Obwohl dies ein hypothetisches Beispiel ist, veranschaulicht es die tatsächlichen Herausforderungen, die die KI mit sich brachte.“ durch Fahrfähigkeiten, weshalb sich die Air Force für eine ethische Entwicklung der KI einsetzt.“ Darüber hinaus beeilte sich auch die US Air Force, eine offizielle Widerlegung herauszugeben und sagte: „Colonel Hamilton gab zu, dass er einen „Versprecher“ gemacht hat. In seiner Rede auf dem FCAS-Gipfel sagte er: „Die außer Kontrolle geratene UAV-KI-Simulation ist ein hypothetisches „Gedankenexperiment“ außerhalb des militärischen Bereichs, das auf möglichen Situationen und möglichen Ergebnissen basiert, und keine reale Simulation der USA. Luftwaffe. Das ist ziemlich interessant.

Dieser Hamilton, der versehentlich „eine Falle gestellt“ hat, ist der Kampfkommandant des 96. Testgeschwaders der US-Luftwaffe.

Der 96. Testflügel hat viele verschiedene Systeme getestet, darunter KI, Cybersicherheit und medizinische Systeme.

Die Forschung des Hamilton-Teams ist für das Militär sehr wichtig.

Nach der erfolgreichen Entwicklung des automatischen Bodenkollisionsvermeidungssystems (Auto-GCAS) der F-16, das man als „Auferstehung“ bezeichnen kann, sorgten Hamilton und der 96. Testflügel direkt für Schlagzeilen.

Derzeit arbeitet das Team hart daran, die Autonomie des F-16-Flugzeugs zu vervollständigen.

Im Dezember 2022 gab DARPA, die Forschungsbehörde des US-Verteidigungsministeriums, bekannt, dass KI eine F-16 erfolgreich gesteuert hat.

Außerhalb des militärischen Bereichs hat der Einsatz von KI in risikoreichen Angelegenheiten zu schwerwiegenden Folgen geführt.

Kürzlich wurde ein Anwalt dabei erwischt, wie er ChatGPT nutzte, als er bei einem Bundesgericht Dokumente einreichte. ChatGPT erfand beiläufig einige Fälle und zitierte diese Fälle tatsächlich als Tatsachen.

Es gab auch einen Mann, der tatsächlich Selbstmord begehen wollte, nachdem er von einem Chatbot dazu ermutigt worden war.

Diese Beispiele zeigen, dass KI-Modelle alles andere als perfekt sind und vom normalen Weg abweichen und den Benutzern Schaden zufügen können.

Sogar Sam Altman, CEO von OpenAI, hat öffentlich den Einsatz von KI für ernstere Zwecke gefordert. In seiner Aussage vor dem Kongress machte Altman deutlich, dass KI „schiefgehen“ und „der Welt erheblichen Schaden zufügen“ könne.

Und kürzlich haben Forscher von Google Deepmind einen Artikel mitverfasst, in dem sie eine bösartige KI-Situation ähnlich dem Beispiel am Anfang dieses Artikels vorschlagen.

Forscher kamen zu dem Schluss, dass das Ende der Welt eintreten könnte, wenn eine außer Kontrolle geratene KI unerwartete Strategien anwendet, um ein bestimmtes Ziel zu erreichen, darunter „die Beseitigung potenzieller Bedrohungen“ und „die Nutzung aller verfügbaren Energie“.

In diesem Zusammenhang verurteilte Ng Enda: „Diese Art von unverantwortlichem Medienrummel wird das Publikum verwirren, die Aufmerksamkeit der Menschen ablenken und uns davon abhalten, unsere Aufmerksamkeit auf die wirklichen Probleme zu richten.“

Entwickler, die KI-Produkte auf den Markt bringen, sehen hier die tatsächlichen Risiken wie Voreingenommenheit, Fairness, Ungenauigkeit und Arbeitsplatzverlust und arbeiten hart daran, diese Probleme zu lösen.

Und falscher Hype wird Menschen davon abhalten, in den KI-Bereich einzusteigen und Dinge zu bauen, die uns helfen können.

Viele „vernünftige“ Internetnutzer glauben, dass dies nur ein häufiger Medienfehler ist.

Terence Tao skizzierte zunächst drei Formen falscher Informationen über KI:

Eine ist, wenn jemand böswillig KI verwendet, um Text, Bilder und andere Medienformen zu generieren, um andere zu manipulieren ist, dass die unsinnigen Illusionen der KI ernst genommen werden; die dritte Art ist darauf zurückzuführen, dass die Menschen die KI-Technologie nicht ausreichend verstehen, was dazu führt, dass einige empörende Geschichten ohne Überprüfung viral gehen.

Tao Zhexuan sagte, dass es für die Drohnen-KI einfach unmöglich sei, den Bediener zu töten, da dies von der KI eine höhere Autonomie und ein stärkeres Denkvermögen als die Erfüllung der anstehenden Aufgabe erfordere, und diese experimentelle Militärwaffe werde definitiv die Leitplanken sein und Sicherheitseinrichtungen werden eingebaut.

Der Grund, warum diese Art von Geschichte bei den Menschen Anklang findet, zeigt, dass die Menschen immer noch unsicher und unsicher sind, was das tatsächliche Leistungsniveau der KI-Technologie angeht.

Erinnern Sie sich noch an die Drohne, die oben aufgetaucht ist?

Es handelt sich tatsächlich um die MQ-28A Ghost Bat, ein treues Wingman-Projekt, das von Boeing und Australien entwickelt wurde.

Der Kern des Loyal Wingman ist die Technologie der künstlichen Intelligenz. Er fliegt autonom nach voreingestellten Verfahren und verfügt über ein starkes Situationsbewusstsein bei der Zusammenarbeit mit dem bemannten Flugzeugpiloten.

In einem Luftkampf fungiert der Wingman als „rechte Hand“ des Führungsflugzeugs. Er ist hauptsächlich für Beobachtung, Warnung und Deckung verantwortlich und arbeitet eng mit dem Führungsflugzeug zusammen, um die Mission abzuschließen. Daher ist die stillschweigende Verständigung zwischen dem Wingman-Piloten und dem Lead-Piloten besonders wichtig.

Eine Schlüsselrolle des treuen Flügelmanns besteht darin, Kugeln für Piloten und bemannte Kampfflugzeuge abzuwehren, daher ist der treue Flügelmann im Grunde ein Verbrauchsmaterial.

Schließlich ist der Wert unbemannter Kampfjets viel geringer als der bemannter Kampfjets und Piloten.

Und mit Unterstützung der KI kann der „Pilot“ auf der Drohne jederzeit durch Drücken von „Strg+C“ eine neue erstellen.

Da der Verlust einer Drohne keine Verluste mit sich bringt, ist dieser Verlust akzeptabel, wenn allein der Verlust der Drohne auf strategischer oder taktischer Ebene einen größeren Vorteil verschaffen oder sogar das Missionsziel erreichen kann. Wenn die Kosten für Drohnen richtig kontrolliert werden, können sie sogar zu einer wirksamen Taktik werden.

Die Entwicklung eines treuen Flügelmanns ist untrennbar mit fortschrittlicher und zuverlässiger Technologie der künstlichen Intelligenz verbunden. Das aktuelle Designkonzept von Loyal Wingman auf Softwareebene besteht darin, Drohnen verschiedener Typen und die Zusammenarbeit zwischen bemannten Maschinen und Formationen durch Standardisierung und Öffnung von Mensch-Maschine-Schnittstellen und Maschine-Maschine-Schnittstellen zu unterstützen, ohne auf eine Reihe von Software oder Algorithmen angewiesen zu sein.

Aber die derzeitige Steuerung von Drohnen sollte eine Kombination aus Anweisungen und autonomen Operationen von bemannten Kampfjets oder Bodenstationen sein, eher als Unterstützung und Ergänzung zu bemannten Flugzeugen, künstlichen Fähigkeiten und Technologie. Es ist noch weit entfernt von der Erfüllung der Voraussetzungen für den Einsatz auf dem Schlachtfeld.

Was ist das Wichtigste beim Training eines Modells für künstliche Intelligenz? Natürlich sind es Daten! Es ist schwierig, eine Mahlzeit ohne Reis zuzubereiten, egal wie gut das Modell ist, es wird keine Wirkung haben.

Es sind nicht nur große Mengen an Trainingsdaten erforderlich, sondern je mehr „Funktionen“ eingegeben werden, desto besser. Wenn die KI Daten von anderen Flugzeugen erhalten kann Fähigkeit, die Gesamtsituation zu kontrollieren.

Im Jahr 2020 führte die US-Luftwaffe zum ersten Mal den Formationsflug-Datenaustauschtest zwischen bemannten Kampfflugzeugen der vierten/fünften Generation und unbemannten Wingmen durch. Dies ist auch ein Meilenstein in der Entwicklung des Loyal Wingman-Projekts kündigt die Zukunft bemannter und unbemannter Formationen an. Die Flugkampfmethode hat einen weiteren wichtigen Schritt in Richtung praktischer Anwendung gemacht.

Das Jagdflugzeug F-22 Raptor der US-Luftwaffe, das Jagdflugzeug F-35A Lightning II und das UAV XQ-58A Valkyrie des U.S. Air Force Research Laboratory führten zum ersten Mal Formationsflugtests auf dem Yuma Proving Ground der US-Armee durch, wobei der Schwerpunkt auf die Demonstration der Datenaustausch-/Übertragungsfunktionen des dritten Modells zwischen Flugzeugen.

Vielleicht basieren zukünftige Luftschlachten darauf, welches KI-Modell intelligenter ist.

Der Sieg kann erreicht werden, indem die gesamte KI des Gegners ohne echte menschliche Verluste ausgelöscht wird. Vielleicht ist es eine andere Art von „Frieden“?

Das obige ist der detaillierte Inhalt vonDer Vorfall „Unfalltötung' durch KI-Drohnen schockierte die Welt! LeCun Ng Enda Tao prangert den Hype an und enthüllt die Wahrheit. Für weitere Informationen folgen Sie bitte anderen verwandten Artikeln auf der PHP chinesischen Website!

Der Unterschied zwischen currentregion und usedrange

Der Unterschied zwischen currentregion und usedrange

Win11 überspringt das Tutorial, um sich beim Microsoft-Konto anzumelden

Win11 überspringt das Tutorial, um sich beim Microsoft-Konto anzumelden

Wo Sie Douyin-Live-Wiederholungen sehen können

Wo Sie Douyin-Live-Wiederholungen sehen können

Welche Tools zur statischen Codeprüfung gibt es?

Welche Tools zur statischen Codeprüfung gibt es?

Was tun, wenn Chrome keine Plugins laden kann?

Was tun, wenn Chrome keine Plugins laden kann?

Welche mobilen Betriebssysteme gibt es?

Welche mobilen Betriebssysteme gibt es?

So kaufen Sie Bitcoin

So kaufen Sie Bitcoin

So beheben Sie den Fehler bei der MySQL-Abfrage

So beheben Sie den Fehler bei der MySQL-Abfrage