Technologie-Peripheriegeräte

Technologie-Peripheriegeräte

KI

KI

OpenAI und Google haben eine Doppelmoral: Sie nutzen die Daten anderer Leute, um große Modelle zu trainieren, lassen aber niemals zu, dass ihre eigenen Daten nach außen dringen

OpenAI und Google haben eine Doppelmoral: Sie nutzen die Daten anderer Leute, um große Modelle zu trainieren, lassen aber niemals zu, dass ihre eigenen Daten nach außen dringen

OpenAI und Google haben eine Doppelmoral: Sie nutzen die Daten anderer Leute, um große Modelle zu trainieren, lassen aber niemals zu, dass ihre eigenen Daten nach außen dringen

Im neuen Zeitalter der generativen KI verfolgen große Technologieunternehmen bei der Nutzung von Online-Inhalten die Strategie „Tu, was ich sage, nicht tu, was ich tue“. In gewisser Weise kann man von dieser Strategie eine Doppelmoral und einen Missbrauch des Rederechts sprechen.

Da sich gleichzeitig große Sprachmodelle (LLM) zum Mainstream-Trend in der KI-Entwicklung entwickeln, scheuen sowohl große als auch Start-up-Unternehmen keine Mühen, um ihre Modelle zu entwickeln eigene große Modelle. Unter ihnen sind Trainingsdaten eine wichtige Voraussetzung für die Leistungsfähigkeit großer Modelle.

In letzter Zeit haben das von Microsoft unterstützte OpenAI, Google und das von Microsoft unterstützte Unternehmen Anthropic laut Insider-Berichten andere Websites oder das Internet des Unternehmens genutzt Inhalte, um ihre generativen KI-Modelle zu trainieren . Dies geschah alles ohne Einholung einer besonderen Genehmigung und wird Teil eines sich anbahnenden Rechtsstreits sein, bei dem es um die Zukunft des Webs und die Anwendung des Urheberrechts in dieser neuen Ära geht.

Diese großen Technologieunternehmen können argumentieren, dass sie fair genutzt werden oder nicht Ob das wirklich so ist, darüber lässt sich streiten. Sie lassen jedoch nicht zu, dass ihre Inhalte zum Trainieren anderer KI-Modelle verwendet werden. Wir kommen also nicht umhin zu fragen: Warum können diese großen Technologieunternehmen beim Training großer Modelle die Online-Inhalte anderer Unternehmen nutzen?

Diese Unternehmen sind schlau, aber auch sehr heuchlerisch. Ob es eindeutige Beweise für die Behauptungen gibt, lässt sich aus den Nutzungsbedingungen einiger ihrer Produkte ersehen.

Schauen wir uns zunächst Claude an, einen von Anthropic eingeführten KI-Assistenten ähnlich wie ChatGPT. Das System kann Aufgaben wie Zusammenfassung, Suche, Unterstützung bei der Erstellung, Fragen und Antworten sowie Codierung erledigen. Vor einiger Zeit wurde erneut ein Upgrade durchgeführt und der Kontext-Token auf 100.000 erweitert, was die Verarbeitungsgeschwindigkeit erheblich beschleunigte.

Claudes Nutzungsbedingungen lauten wie folgt. Sie dürfen auf die folgenden Arten nicht auf den Dienst zugreifen oder ihn nutzen (von denen einige hier aufgeführt sind) Wenn eine dieser Einschränkungen mit der Richtlinie zur akzeptablen Nutzung unvereinbar ist oder unklar ist, hat letztere Vorrang:

Claudes Nutzungsbedingungen lauten wie folgt. Sie dürfen auf die folgenden Arten nicht auf den Dienst zugreifen oder ihn nutzen (von denen einige hier aufgeführt sind) Wenn eine dieser Einschränkungen mit der Richtlinie zur akzeptablen Nutzung unvereinbar ist oder unklar ist, hat letztere Vorrang:

# 🎜🎜#Entwickeln Sie alle Produkte oder Dienstleistungen, die mit unseren Dienstleistungen konkurrieren, einschließlich der Entwicklung oder Schulung von KI- oder maschinellen Lernalgorithmen oder -modellen

- #🎜🎜 # Scrapen, Scrapen oder anderweitige Beschaffung von Daten oder Informationen aus unseren Diensten auf andere Weise ohne Genehmigung gemäß den Bedingungen

- Claude-Adresse der Nutzungsbedingungen : https://vault.pactsafe.io/s/9f502c93-cb5c-4571-b205-1e479da61794/legal.html#terms

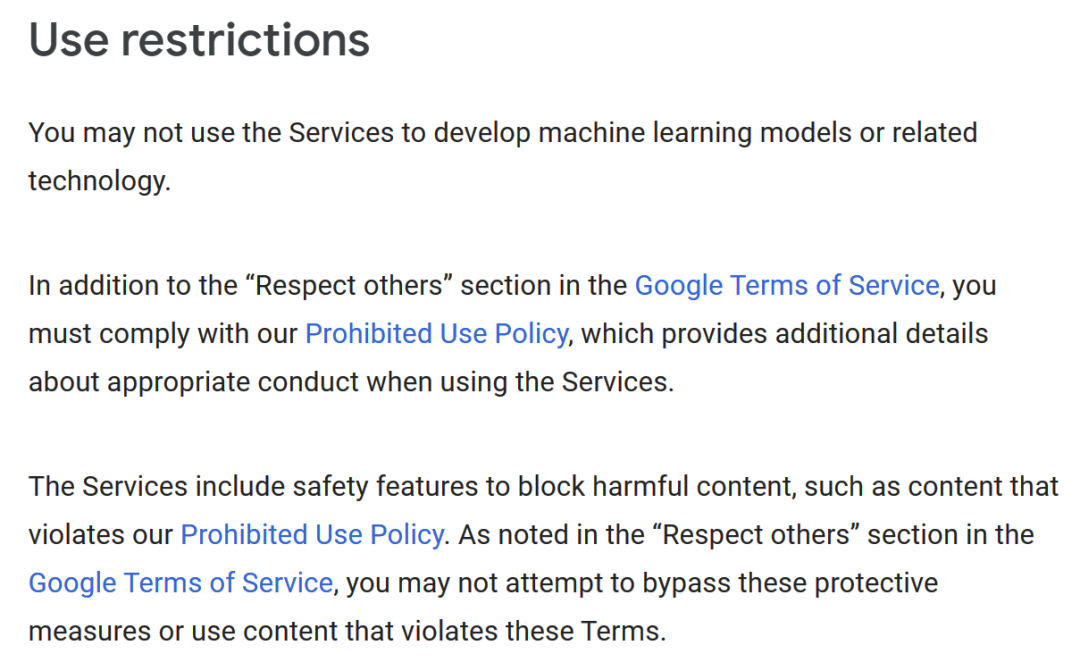

#🎜🎜 #Ähnlich, In den Nutzungsbedingungen für generative KI von Google heißt es: „Sie dürfen den Dienst nicht zur Entwicklung von Modellen für maschinelles Lernen oder verwandten Technologien nutzen.“ 🎜🎜#Nutzungsbedingungen von Google Generative AI Adresse: https://policies.google.com/terms/generative-ai

#🎜🎜 #Was ist mit den Nutzungsbedingungen von OpenAI? Ähnlich wie bei Google: „Sie dürfen die Ausgabe des Dienstes nicht verwenden, um Modelle zu entwickeln, die mit OpenAI konkurrieren.“ 🎜🎜#

Adresse der Nutzungsbedingungen von OpenAI: https://openai.com/policies/ Nutzungsbedingungen

Diese Unternehmen sind klug, sie wissen, dass qualitativ hochwertige Inhalte für das Training neuer KI-Modelle von entscheidender Bedeutung sind. Daher ist es sinnvoll, anderen nicht zu erlauben, ihre Ergebnisse auf diese Weise zu nutzen. Aber sie haben keine Skrupel, die Daten anderer Leute zu nutzen, um ihre eigenen Modelle zu trainieren.

OpenAI, Google und Anthropic lehnten Insider-Anfragen nach Kommentaren ab und antworteten nicht.

Reddit, Twitter und andere: Genug ist genug

Tatsächlich waren andere Unternehmen nicht glücklich, als ihnen klar wurde, was passierte. Im April will Reddit, das seit Jahren zum Trainieren von KI-Modellen genutzt wird, damit beginnen, Gebühren für den Zugriff auf seine Daten zu erheben.

Steve Huffman, CEO von Reddit, sagte: „Der Datenbestand von Reddit ist sehr wertvoll, daher können wir diesen Wert den größten Unternehmen der Welt nicht kostenlos zur Verfügung stellen.“

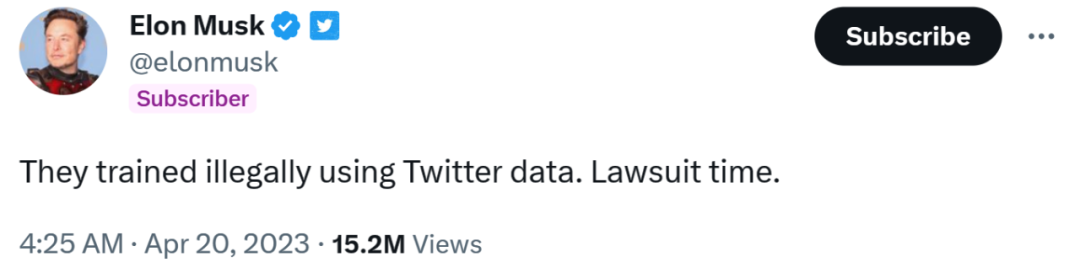

Ebenfalls im April dieses Jahres beschuldigte Musk OpenAI Microsoft, Einer der Hauptbefürworter der Klage nutzte Twitter-Daten illegal zum Trainieren von KI-Modellen. „Zeit für einen Rechtsstreit“, twitterte er.

Als Antwort auf den Kommentar von Insider erklärte Microsoft jedoch, dass „diese Prämisse so viele Fehler enthält, dass ich nicht einmal weiß, wo ich anfangen soll.“

OpenAI-CEO Sam Altman hat versucht, dies zu untersuchen Ein neues KI-Modell, das das Urheberrecht respektiert, um dieses Problem zu verschärfen. Laut Axios sagte er kürzlich: „Wir versuchen, ein neues Modell zu entwickeln. Wenn das KI-System Ihre Inhalte verwendet oder Ihren Stil verwendet, werden Sie dafür bezahlt.“

Die aktuelle Trainingsmethode von KI-Modellen hat das Netzwerk „zerbrochen“

Ein ehemaliger Microsoft-Manager sagte, dass es dabei ein Problem geben muss. Der Microsoft-Veteran und berühmte Softwareentwickler Steven Sinofsky glaubt, dass die aktuelle Trainingsmethode von KI-Modellen das Netzwerk „zerstört“.

Steven Sinofsky

Das obige ist der detaillierte Inhalt vonOpenAI und Google haben eine Doppelmoral: Sie nutzen die Daten anderer Leute, um große Modelle zu trainieren, lassen aber niemals zu, dass ihre eigenen Daten nach außen dringen. Für weitere Informationen folgen Sie bitte anderen verwandten Artikeln auf der PHP chinesischen Website!

Heiße KI -Werkzeuge

Undresser.AI Undress

KI-gestützte App zum Erstellen realistischer Aktfotos

AI Clothes Remover

Online-KI-Tool zum Entfernen von Kleidung aus Fotos.

Undress AI Tool

Ausziehbilder kostenlos

Clothoff.io

KI-Kleiderentferner

AI Hentai Generator

Erstellen Sie kostenlos Ai Hentai.

Heißer Artikel

Heiße Werkzeuge

Notepad++7.3.1

Einfach zu bedienender und kostenloser Code-Editor

SublimeText3 chinesische Version

Chinesische Version, sehr einfach zu bedienen

Senden Sie Studio 13.0.1

Leistungsstarke integrierte PHP-Entwicklungsumgebung

Dreamweaver CS6

Visuelle Webentwicklungstools

SublimeText3 Mac-Version

Codebearbeitungssoftware auf Gottesniveau (SublimeText3)

Heiße Themen

1376

1376

52

52

Welche Methode wird verwendet, um Strings in Objekte in Vue.js umzuwandeln?

Apr 07, 2025 pm 09:39 PM

Welche Methode wird verwendet, um Strings in Objekte in Vue.js umzuwandeln?

Apr 07, 2025 pm 09:39 PM

Bei der Konvertierung von Zeichenfolgen in Objekte in Vue.js wird JSON.Parse () für Standard -JSON -Zeichenfolgen bevorzugt. Bei nicht standardmäßigen JSON-Zeichenfolgen kann die Zeichenfolge durch Verwendung regelmäßiger Ausdrücke verarbeitet und Methoden gemäß dem Format oder dekodierten URL-kodiert reduziert werden. Wählen Sie die entsprechende Methode gemäß dem String -Format aus und achten Sie auf Sicherheits- und Codierungsprobleme, um Fehler zu vermeiden.

So verwenden Sie MySQL nach der Installation

Apr 08, 2025 am 11:48 AM

So verwenden Sie MySQL nach der Installation

Apr 08, 2025 am 11:48 AM

Der Artikel führt den Betrieb der MySQL -Datenbank vor. Zunächst müssen Sie einen MySQL -Client wie MySQLworkBench oder Befehlszeilen -Client installieren. 1. Verwenden Sie den Befehl mySQL-uroot-P, um eine Verbindung zum Server herzustellen und sich mit dem Stammkonto-Passwort anzumelden. 2. Verwenden Sie die Erstellung von Createdatabase, um eine Datenbank zu erstellen, und verwenden Sie eine Datenbank aus. 3.. Verwenden Sie CreateTable, um eine Tabelle zu erstellen, Felder und Datentypen zu definieren. 4. Verwenden Sie InsertInto, um Daten einzulegen, Daten abzufragen, Daten nach Aktualisierung zu aktualisieren und Daten nach Löschen zu löschen. Nur indem Sie diese Schritte beherrschen, lernen, mit gemeinsamen Problemen umzugehen und die Datenbankleistung zu optimieren, können Sie MySQL effizient verwenden.

Wie man MySQL löst, kann nicht gestartet werden

Apr 08, 2025 pm 02:21 PM

Wie man MySQL löst, kann nicht gestartet werden

Apr 08, 2025 pm 02:21 PM

Es gibt viele Gründe, warum MySQL Startup fehlschlägt und durch Überprüfung des Fehlerprotokolls diagnostiziert werden kann. Zu den allgemeinen Ursachen gehören Portkonflikte (prüfen Portbelegung und Änderung der Konfiguration), Berechtigungsprobleme (Überprüfen Sie den Dienst Ausführen von Benutzerberechtigungen), Konfigurationsdateifehler (Überprüfung der Parametereinstellungen), Datenverzeichniskorruption (Wiederherstellung von Daten oder Wiederaufbautabellenraum), InnoDB-Tabellenraumprobleme (prüfen IBDATA1-Dateien), Plug-in-Ladeversagen (Überprüfen Sie Fehlerprotokolle). Wenn Sie Probleme lösen, sollten Sie sie anhand des Fehlerprotokolls analysieren, die Hauptursache des Problems finden und die Gewohnheit entwickeln, Daten regelmäßig zu unterstützen, um Probleme zu verhindern und zu lösen.

Laravels Geospatial: Optimierung interaktiver Karten und großen Datenmengen

Apr 08, 2025 pm 12:24 PM

Laravels Geospatial: Optimierung interaktiver Karten und großen Datenmengen

Apr 08, 2025 pm 12:24 PM

Verarbeiten Sie 7 Millionen Aufzeichnungen effizient und erstellen Sie interaktive Karten mit Geospatial -Technologie. In diesem Artikel wird untersucht, wie über 7 Millionen Datensätze mithilfe von Laravel und MySQL effizient verarbeitet und in interaktive Kartenvisualisierungen umgewandelt werden können. Erstes Herausforderungsprojektanforderungen: Mit 7 Millionen Datensätzen in der MySQL -Datenbank wertvolle Erkenntnisse extrahieren. Viele Menschen erwägen zunächst Programmiersprachen, aber ignorieren die Datenbank selbst: Kann sie den Anforderungen erfüllen? Ist Datenmigration oder strukturelle Anpassung erforderlich? Kann MySQL einer so großen Datenbelastung standhalten? Voranalyse: Schlüsselfilter und Eigenschaften müssen identifiziert werden. Nach der Analyse wurde festgestellt, dass nur wenige Attribute mit der Lösung zusammenhängen. Wir haben die Machbarkeit des Filters überprüft und einige Einschränkungen festgelegt, um die Suche zu optimieren. Kartensuche basierend auf der Stadt

VUE.JS Wie kann man ein Array von String -Typ in ein Array von Objekten umwandeln?

Apr 07, 2025 pm 09:36 PM

VUE.JS Wie kann man ein Array von String -Typ in ein Array von Objekten umwandeln?

Apr 07, 2025 pm 09:36 PM

Zusammenfassung: Es gibt die folgenden Methoden zum Umwandeln von VUE.JS -String -Arrays in Objektarrays: Grundlegende Methode: Verwenden Sie die Kartenfunktion, um regelmäßige formatierte Daten zu entsprechen. Erweitertes Gameplay: Die Verwendung regulärer Ausdrücke kann komplexe Formate ausführen, müssen jedoch sorgfältig geschrieben und berücksichtigt werden. Leistungsoptimierung: In Betracht ziehen die große Datenmenge, asynchrone Operationen oder effiziente Datenverarbeitungsbibliotheken können verwendet werden. Best Practice: Clear Code -Stil, verwenden Sie sinnvolle variable Namen und Kommentare, um den Code präzise zu halten.

So stellen Sie die Zeitüberschreitung von Vue Axios fest

Apr 07, 2025 pm 10:03 PM

So stellen Sie die Zeitüberschreitung von Vue Axios fest

Apr 07, 2025 pm 10:03 PM

Um die Zeitüberschreitung für Vue Axios festzulegen, können wir eine Axios -Instanz erstellen und die Zeitleitungsoption angeben: in globalen Einstellungen: vue.Prototyp. $ Axios = axios.create ({Timeout: 5000}); In einer einzigen Anfrage: this. $ axios.get ('/api/user', {timeout: 10000}).

So optimieren Sie die Datenbankleistung nach der MySQL -Installation

Apr 08, 2025 am 11:36 AM

So optimieren Sie die Datenbankleistung nach der MySQL -Installation

Apr 08, 2025 am 11:36 AM

Die MySQL -Leistungsoptimierung muss von drei Aspekten beginnen: Installationskonfiguration, Indexierung und Abfrageoptimierung, Überwachung und Abstimmung. 1. Nach der Installation müssen Sie die my.cnf -Datei entsprechend der Serverkonfiguration anpassen, z. 2. Erstellen Sie einen geeigneten Index, um übermäßige Indizes zu vermeiden und Abfrageanweisungen zu optimieren, z. B. den Befehl Erklärung zur Analyse des Ausführungsplans; 3. Verwenden Sie das eigene Überwachungstool von MySQL (ShowProcessList, Showstatus), um die Datenbankgesundheit zu überwachen und die Datenbank regelmäßig zu sichern und zu organisieren. Nur durch kontinuierliche Optimierung dieser Schritte kann die Leistung der MySQL -Datenbank verbessert werden.

Remote Senior Backend Engineers (Plattformen) benötigen Kreise

Apr 08, 2025 pm 12:27 PM

Remote Senior Backend Engineers (Plattformen) benötigen Kreise

Apr 08, 2025 pm 12:27 PM

Remote Senior Backend Engineer Job Vacant Company: Circle Standort: Remote-Büro-Jobtyp: Vollzeitgehalt: 130.000 bis 140.000 US-Dollar Stellenbeschreibung Nehmen Sie an der Forschung und Entwicklung von Mobilfunkanwendungen und öffentlichen API-bezogenen Funktionen, die den gesamten Lebenszyklus der Softwareentwicklung abdecken. Die Hauptaufgaben erledigen die Entwicklungsarbeit unabhängig von RubyonRails und arbeiten mit dem Front-End-Team von React/Redux/Relay zusammen. Erstellen Sie die Kernfunktionalität und -verbesserungen für Webanwendungen und arbeiten Sie eng mit Designer und Führung während des gesamten funktionalen Designprozesses zusammen. Fördern Sie positive Entwicklungsprozesse und priorisieren Sie die Iterationsgeschwindigkeit. Erfordert mehr als 6 Jahre komplexes Backend für Webanwendungen