Technologie-Peripheriegeräte

Technologie-Peripheriegeräte

KI

KI

OlaGPT, das erste Denkframework, das die menschliche Kognition simuliert: Sechs Module verbessern das Sprachmodell und steigern die Denkfähigkeit um bis zu 85 %

OlaGPT, das erste Denkframework, das die menschliche Kognition simuliert: Sechs Module verbessern das Sprachmodell und steigern die Denkfähigkeit um bis zu 85 %

OlaGPT, das erste Denkframework, das die menschliche Kognition simuliert: Sechs Module verbessern das Sprachmodell und steigern die Denkfähigkeit um bis zu 85 %

Als ChatGPT zum ersten Mal veröffentlicht wurde, war die Leistung des Modells im Dialog so menschlich, dass die Illusion entstand, dass das Sprachmodell „Denkfähigkeit“ habe.

Nachdem Forscher jedoch ein tiefgreifendes Verständnis von Sprachmodellen erlangt hatten, stellten sie nach und nach fest, dass die Reproduktion auf der Grundlage von Sprachmustern mit hoher Wahrscheinlichkeit immer noch weit von der erwarteten „allgemeinen künstlichen Intelligenz“ entfernt ist.

In den meisten aktuellen Forschungen generieren groß angelegte Sprachmodelle hauptsächlich Denkketten unter der Leitung spezifischer Aufforderungen zur Ausführung von Denkaufgaben, ohne Berücksichtigung menschlicher kognitiver Rahmenbedingungen, wodurch sich die Fähigkeit von Sprachmodellen, komplexe Denkprobleme zu lösen, von denen von Menschen unterscheidet bleiben.

Wenn Menschen mit komplexen Denkproblemen konfrontiert sind, nutzen sie normalerweise verschiedene kognitive Fähigkeiten und müssen mit allen Aspekten von Werkzeugen, Wissen und externen Umgebungsinformationen interagieren. Können Sprachmodelle menschliche Denkprozesse simulieren, um komplexe Probleme zu lösen?

Die Antwort ist natürlich ja! Das erste OlaGPT-Modell, das den menschlichen kognitiven Verarbeitungsrahmen simuliert, ist da!

Papier-Link: https://arxiv.org/abs/2305.16334

Code-Link: https://www.php.cn/link/73a1c863a54653d5e184b790fee14754

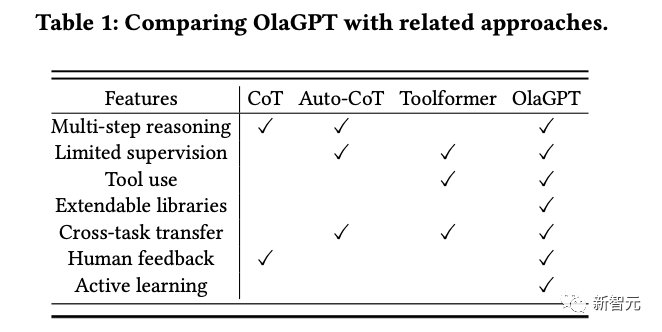

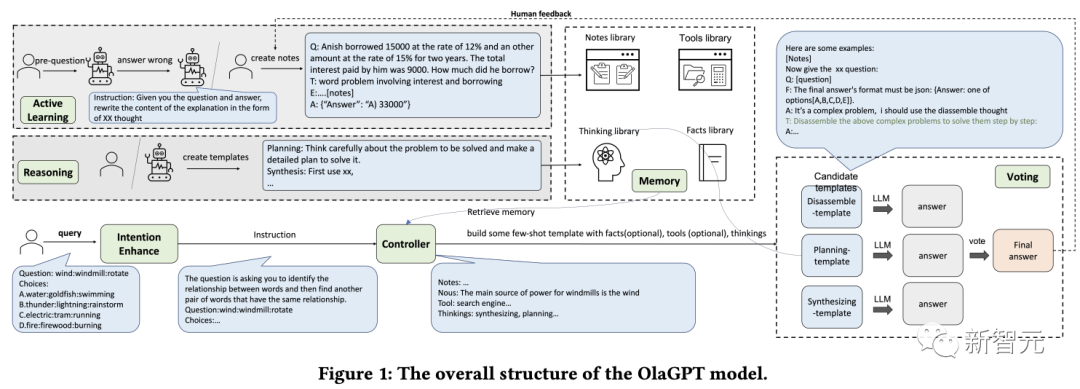

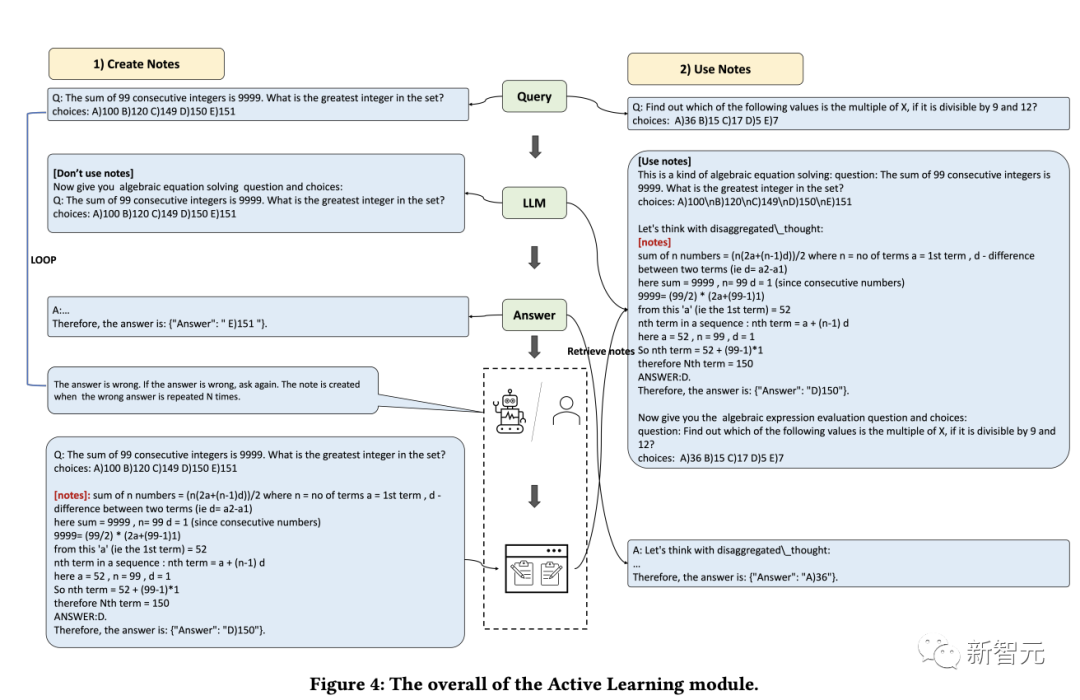

OlaGPT umfasst mehrere kognitive Module, einschließlich Aufmerksamkeit, Gedächtnis, Argumentation, Lernen und entsprechende Planungs- und Entscheidungsmechanismen; inspiriert durch menschliches aktives Lernen, enthält das Framework auch eine Lerneinheit, um frühere Fehler und Expertenmeinungen aufzuzeichnen und dynamisch darauf zu verweisen, um die Fähigkeit zur Lösung ähnlicher Probleme zu verbessern.

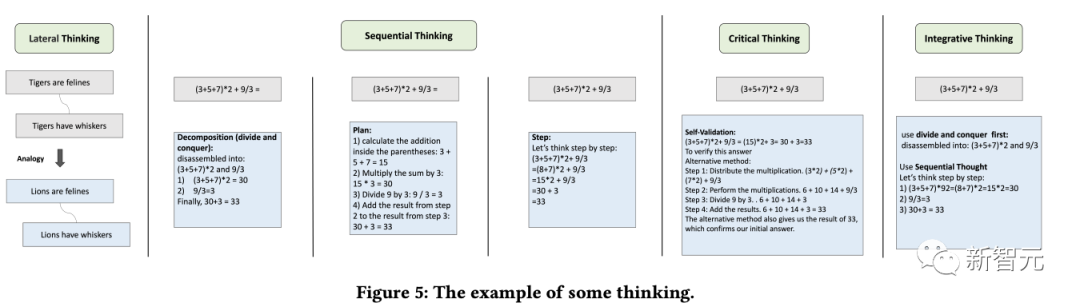

Der Artikel beschreibt außerdem gängige effektive Denkrahmen für Menschen zur Lösung von Problemen und entwirft die Chain of Thought (CoT)-Vorlage entsprechend. Außerdem wird ein umfassender Entscheidungsmechanismus vorgeschlagen, der die Genauigkeit des Modells maximieren kann.

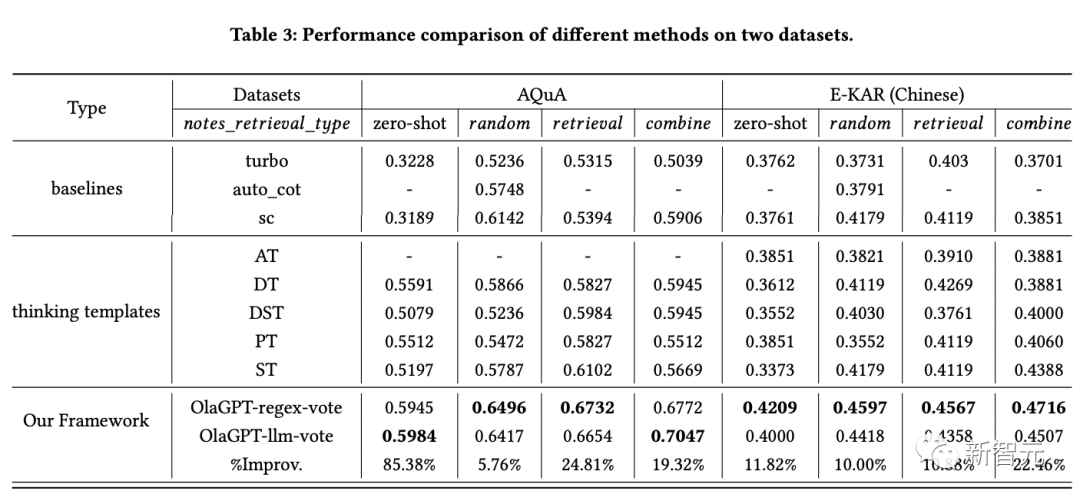

Experimentelle Ergebnisse, die nach einer strengen Auswertung mehrerer Inferenzdatensätze erzielt wurden, zeigen, dass OlaGPT frühere Benchmarks auf dem neuesten Stand der Technik übertrifft und seine Wirksamkeit unter Beweis stellt.

Simulation menschlicher Kognition

Es besteht immer noch eine große Lücke zwischen dem aktuellen Sprachmodell und der erwarteten allgemeinen künstlichen Intelligenz. Die wichtigsten Erscheinungsformen sind:

1. In einigen Fällen ist der generierte Inhalt bedeutungslos oder weicht vom menschlichen Wert ab kann sogar einige sehr gefährliche Vorschläge liefern. Die aktuelle Lösung besteht darin, Verstärkungslernen mit menschlichem Feedback (RLHF) einzuführen, um die Modellausgabe zu bewerten.

2. Das Wissen des Sprachmodells beschränkt sich auf Konzepte und Fakten, die explizit in den Trainingsdaten erwähnt werden.

Wenn Sprachmodelle mit komplexen Problemen konfrontiert werden, können sie sich nicht an veränderte Umgebungen anpassen, vorhandenes Wissen oder Werkzeuge nutzen, über historische Lehren nachdenken, Probleme zerlegen und von Menschen in der langfristigen Entwicklung zusammengefasste Denkmuster (wie Analogie, induktives Denken, deduktives Denken usw.), um Probleme zu lösen.

Allerdings gibt es immer noch viele Systemprobleme, die es Sprachmodellen ermöglichen, den Prozess menschlicher Gehirnverarbeitungsprobleme zu simulieren:

1. Wie man die Hauptmodule im menschlichen kognitiven Rahmen systematisch nachahmt und kodiert und gleichzeitig darauf aufbaut menschliches allgemeines Denken in einem erreichbaren Modus für die Terminplanung?

2. Wie kann man Sprachmodelle dazu anleiten, aktiv wie Menschen zu lernen, das heißt, aus historischen Fehlern oder Expertenlösungen für schwierige Probleme zu lernen und sich weiterzuentwickeln?

Obwohl es möglich ist, das Modell neu zu trainieren, um korrigierte Antworten zu kodieren, ist dies offensichtlich sehr kostspielig und unflexibel.

3. Wie können Sprachmodelle flexibel verschiedene vom Menschen entwickelte Denkweisen nutzen, um ihre Denkleistung zu verbessern?

Ein festes und universelles Denkmodell lässt sich nur schwer an unterschiedliche Probleme anpassen. Genauso wie Menschen, die mit unterschiedlichen Arten von Problemen konfrontiert sind, normalerweise flexibel unterschiedliche Denkweisen wählen, wie zum Beispiel analoges Denken, deduktives Denken usw.

OlaGPT

OlaGPT ist ein Problemlösungs-Framework, das menschliches Denken simuliert und die Fähigkeiten großer Sprachmodelle verbessern kann.

OlaGPT stützt sich auf die Theorie der kognitiven Architektur und modelliert die Kernfähigkeiten des kognitiven Rahmens wie Aufmerksamkeit, Gedächtnis, Lernen, Argumentation und Handlungsauswahl.

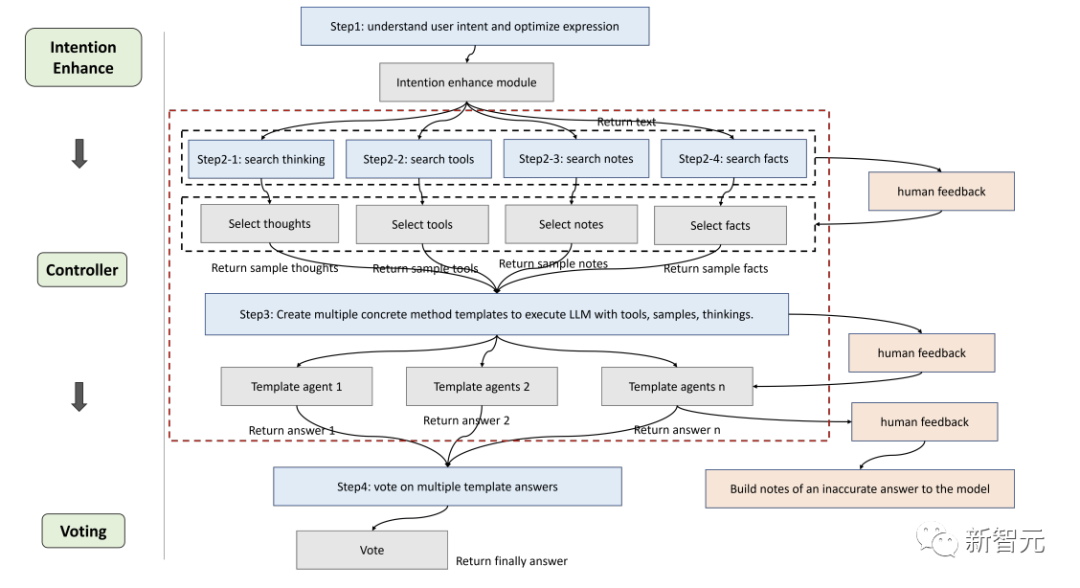

Die Forscher haben das Framework auf der Grundlage spezifischer Implementierungsanforderungen verfeinert und einen für Sprachmodelle geeigneten Prozess zur Lösung komplexer Probleme vorgeschlagen, der insbesondere sechs Module umfasst: Absichtsverbesserungsmodul (Aufmerksamkeit), Gedächtnismodul (Speicher), aktives Lernmodul ( Lernen), Argumentationsmodul (Argumentation), Controller-Modul (Aktionsauswahl) und Abstimmungsmodul.

Intention Enhance

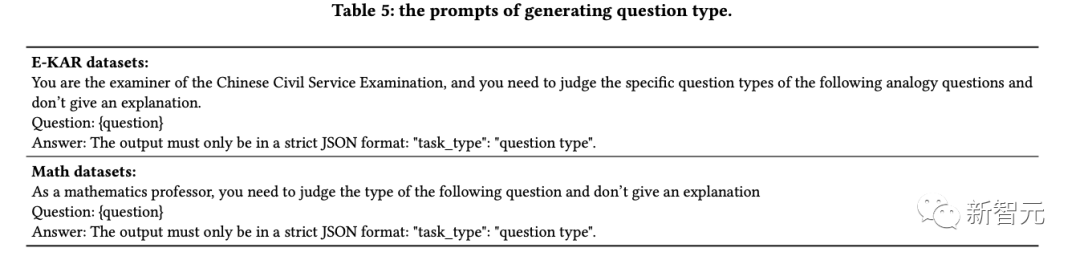

Aufmerksamkeit ist ein wichtiger Teil der menschlichen Wahrnehmung, da sie relevante Informationen identifiziert und irrelevante Daten herausfiltert.

In ähnlicher Weise haben die Forscher ein entsprechendes Aufmerksamkeitsmodul für das Sprachmodell entworfen, nämlich die Absichtsverbesserung, das darauf abzielt, die relevantesten Informationen zu extrahieren und eine stärkere Korrelation zwischen der Benutzereingabe und dem Sprachmuster des Modells herzustellen, das betrachtet werden kann als optimierter Konverter von Benutzerausdrucksgewohnheiten zu Modellausdrucksgewohnheiten.

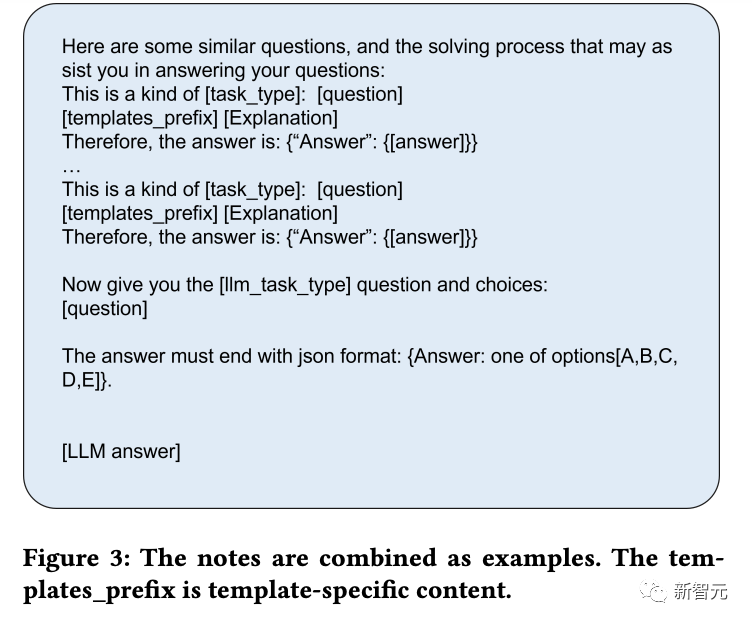

Ermitteln Sie zunächst die Fragetypen von LLMs im Voraus durch spezifische Aufforderungswörter und rekonstruieren Sie dann die Art und Weise, Fragen zu stellen.

Fügen Sie beispielsweise am Anfang der Frage einen Satz hinzu: „Geben Sie nun XX (Fragetyp), Frage und Auswahlmöglichkeiten:“ an Um die Analyse zu erleichtern, müssen Sie außerdem Folgendes hinzufügen: „Die Antwort muss im JSON-Format enden: Antwort: eine der Optionen[A,B,C,D,E].“

Aus den Ergebnissen geht hervor:

1. SC (Selbstkonsistenz) schneidet besser ab als GPT-3.5-Turbo, was darauf hinweist Die Anwendung eines Ensemble-Ansatzes trägt in gewissem Maße dazu bei, die Wirksamkeit großmaßstäblicher Modelle zu verbessern.

2. Die Leistung der im Artikel vorgeschlagenen Methode übertrifft die von SC, was in gewissem Maße die Wirksamkeit der Denkvorlagenstrategie beweist.

Die Antworten auf unterschiedliche Denkmuster weisen erhebliche Unterschiede auf, und eine Abstimmung nach unterschiedlichen Denkmustern führt letztendlich zu besseren Ergebnissen, als einfach mehrere Abstimmungsrunden durchzuführen.

3. Unterschiedliche Denkvorlagen haben unterschiedliche Auswirkungen und Schritt-für-Schritt-Lösungen sind möglicherweise besser für Argumentationsprobleme geeignet.

4. Die Leistung des aktiven Lernmoduls ist deutlich besser als die Nullstichprobenmethode.

Das Einbeziehen anspruchsvoller Fälle in die Notizenbibliothek sowie die Verwendung von Zufalls-, Abruf- und Kombinationslisten zur Verbesserung der Leistung ist eine praktikable Strategie.

5. Unterschiedliche Abrufschemata haben unterschiedliche Auswirkungen auf unterschiedliche Datensätze. Im Allgemeinen führt die Kombinationsstrategie zu besseren Ergebnissen.

6. Die Methode in diesem Artikel ist offensichtlich besser als andere Lösungen. Dies liegt an der angemessenen Gestaltung des Gesamtrahmens, einschließlich der effektiven Gestaltung des aktiven Lernmoduls Unter verschiedenen Denkvorlagen sind die Ergebnisse unterschiedlich. Das Controller-Modul spielt eine sehr gute Kontrollrolle und wählt Inhalte aus, die mit den vom Abstimmungsmodul entworfenen Integrationsmethoden übereinstimmen.

Referenz:

https://www.php.cn/link/73a1c863a54653d5e184b790fee14754

Das obige ist der detaillierte Inhalt vonOlaGPT, das erste Denkframework, das die menschliche Kognition simuliert: Sechs Module verbessern das Sprachmodell und steigern die Denkfähigkeit um bis zu 85 %. Für weitere Informationen folgen Sie bitte anderen verwandten Artikeln auf der PHP chinesischen Website!

Heiße KI -Werkzeuge

Undresser.AI Undress

KI-gestützte App zum Erstellen realistischer Aktfotos

AI Clothes Remover

Online-KI-Tool zum Entfernen von Kleidung aus Fotos.

Undress AI Tool

Ausziehbilder kostenlos

Clothoff.io

KI-Kleiderentferner

AI Hentai Generator

Erstellen Sie kostenlos Ai Hentai.

Heißer Artikel

Heiße Werkzeuge

Notepad++7.3.1

Einfach zu bedienender und kostenloser Code-Editor

SublimeText3 chinesische Version

Chinesische Version, sehr einfach zu bedienen

Senden Sie Studio 13.0.1

Leistungsstarke integrierte PHP-Entwicklungsumgebung

Dreamweaver CS6

Visuelle Webentwicklungstools

SublimeText3 Mac-Version

Codebearbeitungssoftware auf Gottesniveau (SublimeText3)

Heiße Themen

1377

1377

52

52

Das weltweit leistungsstärkste Open-Source-MoE-Modell ist da, mit chinesischen Fähigkeiten, die mit GPT-4 vergleichbar sind, und der Preis beträgt nur fast ein Prozent von GPT-4-Turbo

May 07, 2024 pm 04:13 PM

Das weltweit leistungsstärkste Open-Source-MoE-Modell ist da, mit chinesischen Fähigkeiten, die mit GPT-4 vergleichbar sind, und der Preis beträgt nur fast ein Prozent von GPT-4-Turbo

May 07, 2024 pm 04:13 PM

Stellen Sie sich ein Modell der künstlichen Intelligenz vor, das nicht nur die Fähigkeit besitzt, die traditionelle Datenverarbeitung zu übertreffen, sondern auch eine effizientere Leistung zu geringeren Kosten erzielt. Dies ist keine Science-Fiction, DeepSeek-V2[1], das weltweit leistungsstärkste Open-Source-MoE-Modell, ist da. DeepSeek-V2 ist ein leistungsstarkes MoE-Sprachmodell (Mix of Experts) mit den Merkmalen eines wirtschaftlichen Trainings und einer effizienten Inferenz. Es besteht aus 236B Parametern, von denen 21B zur Aktivierung jedes Markers verwendet werden. Im Vergleich zu DeepSeek67B bietet DeepSeek-V2 eine stärkere Leistung, spart gleichzeitig 42,5 % der Trainingskosten, reduziert den KV-Cache um 93,3 % und erhöht den maximalen Generierungsdurchsatz auf das 5,76-fache. DeepSeek ist ein Unternehmen, das sich mit allgemeiner künstlicher Intelligenz beschäftigt

KI untergräbt die mathematische Forschung! Der Gewinner der Fields-Medaille und der chinesisch-amerikanische Mathematiker führten 11 hochrangige Arbeiten an | Gefällt mir bei Terence Tao

Apr 09, 2024 am 11:52 AM

KI untergräbt die mathematische Forschung! Der Gewinner der Fields-Medaille und der chinesisch-amerikanische Mathematiker führten 11 hochrangige Arbeiten an | Gefällt mir bei Terence Tao

Apr 09, 2024 am 11:52 AM

KI verändert tatsächlich die Mathematik. Vor kurzem hat Tao Zhexuan, der diesem Thema große Aufmerksamkeit gewidmet hat, die neueste Ausgabe des „Bulletin of the American Mathematical Society“ (Bulletin der American Mathematical Society) weitergeleitet. Zum Thema „Werden Maschinen die Mathematik verändern?“ äußerten viele Mathematiker ihre Meinung. Der gesamte Prozess war voller Funken, knallhart und aufregend. Der Autor verfügt über eine starke Besetzung, darunter der Fields-Medaillengewinner Akshay Venkatesh, der chinesische Mathematiker Zheng Lejun, der NYU-Informatiker Ernest Davis und viele andere bekannte Wissenschaftler der Branche. Die Welt der KI hat sich dramatisch verändert. Viele dieser Artikel wurden vor einem Jahr eingereicht.

Hallo, elektrischer Atlas! Der Boston Dynamics-Roboter erwacht wieder zum Leben, seltsame 180-Grad-Bewegungen machen Musk Angst

Apr 18, 2024 pm 07:58 PM

Hallo, elektrischer Atlas! Der Boston Dynamics-Roboter erwacht wieder zum Leben, seltsame 180-Grad-Bewegungen machen Musk Angst

Apr 18, 2024 pm 07:58 PM

Boston Dynamics Atlas tritt offiziell in die Ära der Elektroroboter ein! Gestern hat sich der hydraulische Atlas einfach „unter Tränen“ von der Bühne der Geschichte zurückgezogen. Heute gab Boston Dynamics bekannt, dass der elektrische Atlas im Einsatz ist. Es scheint, dass Boston Dynamics im Bereich kommerzieller humanoider Roboter entschlossen ist, mit Tesla zu konkurrieren. Nach der Veröffentlichung des neuen Videos wurde es innerhalb von nur zehn Stunden bereits von mehr als einer Million Menschen angesehen. Die alten Leute gehen und neue Rollen entstehen. Das ist eine historische Notwendigkeit. Es besteht kein Zweifel, dass dieses Jahr das explosive Jahr der humanoiden Roboter ist. Netizens kommentierten: Die Weiterentwicklung der Roboter hat dazu geführt, dass die diesjährige Eröffnungsfeier wie Menschen aussieht, und der Freiheitsgrad ist weitaus größer als der von Menschen. Aber ist das wirklich kein Horrorfilm? Zu Beginn des Videos liegt Atlas ruhig auf dem Boden, scheinbar auf dem Rücken. Was folgt, ist atemberaubend

KAN, das MLP ersetzt, wurde durch Open-Source-Projekte auf Faltung erweitert

Jun 01, 2024 pm 10:03 PM

KAN, das MLP ersetzt, wurde durch Open-Source-Projekte auf Faltung erweitert

Jun 01, 2024 pm 10:03 PM

Anfang dieses Monats schlugen Forscher des MIT und anderer Institutionen eine vielversprechende Alternative zu MLP vor – KAN. KAN übertrifft MLP in Bezug auf Genauigkeit und Interpretierbarkeit. Und es kann MLP, das mit einer größeren Anzahl von Parametern ausgeführt wird, mit einer sehr kleinen Anzahl von Parametern übertreffen. Beispielsweise gaben die Autoren an, dass sie KAN nutzten, um die Ergebnisse von DeepMind mit einem kleineren Netzwerk und einem höheren Automatisierungsgrad zu reproduzieren. Konkret verfügt DeepMinds MLP über etwa 300.000 Parameter, während KAN nur etwa 200 Parameter hat. KAN hat eine starke mathematische Grundlage wie MLP und basiert auf dem universellen Approximationssatz, während KAN auf dem Kolmogorov-Arnold-Darstellungssatz basiert. Wie in der folgenden Abbildung gezeigt, hat KAN

Google ist begeistert: JAX-Leistung übertrifft Pytorch und TensorFlow! Es könnte die schnellste Wahl für das GPU-Inferenztraining werden

Apr 01, 2024 pm 07:46 PM

Google ist begeistert: JAX-Leistung übertrifft Pytorch und TensorFlow! Es könnte die schnellste Wahl für das GPU-Inferenztraining werden

Apr 01, 2024 pm 07:46 PM

Die von Google geförderte Leistung von JAX hat in jüngsten Benchmark-Tests die von Pytorch und TensorFlow übertroffen und belegt bei 7 Indikatoren den ersten Platz. Und der Test wurde nicht auf der TPU mit der besten JAX-Leistung durchgeführt. Obwohl unter Entwicklern Pytorch immer noch beliebter ist als Tensorflow. Aber in Zukunft werden möglicherweise mehr große Modelle auf Basis der JAX-Plattform trainiert und ausgeführt. Modelle Kürzlich hat das Keras-Team drei Backends (TensorFlow, JAX, PyTorch) mit der nativen PyTorch-Implementierung und Keras2 mit TensorFlow verglichen. Zunächst wählen sie eine Reihe von Mainstream-Inhalten aus

FisheyeDetNet: der erste Zielerkennungsalgorithmus basierend auf einer Fischaugenkamera

Apr 26, 2024 am 11:37 AM

FisheyeDetNet: der erste Zielerkennungsalgorithmus basierend auf einer Fischaugenkamera

Apr 26, 2024 am 11:37 AM

Die Zielerkennung ist ein relativ ausgereiftes Problem in autonomen Fahrsystemen, wobei die Fußgängererkennung einer der ersten Algorithmen ist, die eingesetzt werden. In den meisten Arbeiten wurde eine sehr umfassende Recherche durchgeführt. Die Entfernungswahrnehmung mithilfe von Fischaugenkameras für die Rundumsicht ist jedoch relativ wenig untersucht. Aufgrund der großen radialen Verzerrung ist es schwierig, die standardmäßige Bounding-Box-Darstellung in Fischaugenkameras zu implementieren. Um die obige Beschreibung zu vereinfachen, untersuchen wir erweiterte Begrenzungsrahmen-, Ellipsen- und allgemeine Polygondesigns in Polar-/Winkeldarstellungen und definieren eine mIOU-Metrik für die Instanzsegmentierung, um diese Darstellungen zu analysieren. Das vorgeschlagene Modell „fisheyeDetNet“ mit polygonaler Form übertrifft andere Modelle und erreicht gleichzeitig 49,5 % mAP auf dem Valeo-Fisheye-Kameradatensatz für autonomes Fahren

Tesla-Roboter arbeiten in Fabriken, Musk: Der Freiheitsgrad der Hände wird dieses Jahr 22 erreichen!

May 06, 2024 pm 04:13 PM

Tesla-Roboter arbeiten in Fabriken, Musk: Der Freiheitsgrad der Hände wird dieses Jahr 22 erreichen!

May 06, 2024 pm 04:13 PM

Das neueste Video von Teslas Roboter Optimus ist veröffentlicht und er kann bereits in der Fabrik arbeiten. Bei normaler Geschwindigkeit sortiert es Batterien (Teslas 4680-Batterien) so: Der Beamte hat auch veröffentlicht, wie es bei 20-facher Geschwindigkeit aussieht – auf einer kleinen „Workstation“, pflücken und pflücken und pflücken: Dieses Mal wird es freigegeben. Eines der Highlights Der Vorteil des Videos besteht darin, dass Optimus diese Arbeit in der Fabrik völlig autonom und ohne menschliches Eingreifen während des gesamten Prozesses erledigt. Und aus Sicht von Optimus kann es auch die krumme Batterie aufnehmen und platzieren, wobei der Schwerpunkt auf der automatischen Fehlerkorrektur liegt: In Bezug auf die Hand von Optimus gab der NVIDIA-Wissenschaftler Jim Fan eine hohe Bewertung ab: Die Hand von Optimus ist der fünffingrige Roboter der Welt am geschicktesten. Seine Hände sind nicht nur taktil

Mit einer einzelnen Karte läuft Llama 70B schneller als mit zwei Karten, Microsoft hat gerade FP6 in A100 integriert |

Apr 29, 2024 pm 04:55 PM

Mit einer einzelnen Karte läuft Llama 70B schneller als mit zwei Karten, Microsoft hat gerade FP6 in A100 integriert |

Apr 29, 2024 pm 04:55 PM

FP8 und die geringere Gleitkomma-Quantifizierungsgenauigkeit sind nicht länger das „Patent“ von H100! Lao Huang wollte, dass jeder INT8/INT4 nutzt, und das Microsoft DeepSpeed-Team begann, FP6 auf A100 ohne offizielle Unterstützung von NVIDIA auszuführen. Testergebnisse zeigen, dass die FP6-Quantisierung der neuen Methode TC-FPx auf A100 nahe an INT4 liegt oder gelegentlich schneller als diese ist und eine höhere Genauigkeit aufweist als letztere. Darüber hinaus gibt es eine durchgängige Unterstützung großer Modelle, die als Open-Source-Lösung bereitgestellt und in Deep-Learning-Inferenz-Frameworks wie DeepSpeed integriert wurde. Dieses Ergebnis wirkt sich auch unmittelbar auf die Beschleunigung großer Modelle aus – in diesem Rahmen ist der Durchsatz bei Verwendung einer einzelnen Karte zum Ausführen von Llama 2,65-mal höher als der von Doppelkarten. eins