Technologie-Peripheriegeräte

Technologie-Peripheriegeräte

KI

KI

KI imitiert das Gedächtnismodell des menschlichen Gehirns und die Spielergebnisse stiegen um 29,9 %

KI imitiert das Gedächtnismodell des menschlichen Gehirns und die Spielergebnisse stiegen um 29,9 %

KI imitiert das Gedächtnismodell des menschlichen Gehirns und die Spielergebnisse stiegen um 29,9 %

Uns wird oft beigebracht, „zweimal nachzudenken, bevor man handelt“ und die gesammelten Erfahrungen voll auszunutzen. Nun hat dieser Satz auch die KI inspiriert.

Herkömmliche Entscheidungsfindungs-KI-Modelle können aufgrund des Vergessenseffekts keine Erfahrungen effektiv sammeln, aber eine von China geleitete Forschung hat die Art und Weise, wie KI sich erinnert, verändert.

Die neue Gedächtnismethode imitiert das menschliche Gehirn und verbessert effektiv die Effizienz der KI beim Sammeln von Erfahrungen, wodurch die Spielleistung der KI um 29,9 % gesteigert wird.

Das Forschungsteam besteht aus jeweils sechs Personen vom Mira-Québec AI Research Institute und dem Microsoft Montreal Research Institute, von denen vier Chinesen sind.

Sie nannten das Ergebnis Decision Transformer with Memory (DT-Mem).

Im Vergleich zu herkömmlichen Entscheidungsmodellen ist DT-Mem breiter anwendbar und die Effizienz des Modellbetriebs ist ebenfalls höher.

Neben dem Anwendungseffekt wurde auch die Einarbeitungszeit von DT-Mem von mindestens 200 Stunden auf 50 Stunden verkürzt.

Gleichzeitig schlug das Team auch eine Feinabstimmungsmethode vor, damit sich DT-Mem an neue Szenarien anpassen kann, die noch nicht trainiert wurden.

Das fein abgestimmte Modell kann auch in Spielen gut funktionieren, die es zuvor noch nicht gelernt hat.

Der Arbeitsmechanismus ist vom Menschen inspiriert

Das traditionelle Entscheidungsmodell basiert auf LLM und nutzt implizites Gedächtnis und seine Leistung verlässt sich auf Daten und Berechnungen.

Implizite Erinnerungen werden unbewusst erzeugt und nicht bewusst erinnert und können daher nicht bewusst abgerufen werden.

Einfacher ausgedrückt ist der relevante Inhalt offensichtlich dort gespeichert, aber das Modell weiß nicht, dass er existiert.

Dieses Merkmal des impliziten Gedächtnisses führt dazu, dass das traditionelle Modell ein Vergessensphänomen aufweist, was zu einer geringen Arbeitseffizienz führt.

Das Vergessensphänomen zeigt, dass das Modell nach dem Erlernen einer neuen Lösungsmethode für ein Problem möglicherweise den alten Inhalt vergisst, selbst wenn das alte und das neue Problem vom gleichen Typ sind.

Das menschliche Gehirn verwendet eine verteilte Gedächtnisspeicherung Methode, bei der der Gedächtnisinhalt verteilt in mehreren verschiedenen Bereichen des Gehirns gespeichert wird.

Dieser Ansatz hilft dabei, mehrere Fähigkeiten effektiv zu verwalten und zu organisieren und so das Phänomen des Vergessens zu mildern.

Inspiriert davon schlug das Forschungsteam ein internes Arbeitsspeichermodul vor, um Informationen für verschiedene nachgelagerte Aufgaben zu speichern, zu mischen und abzurufen.

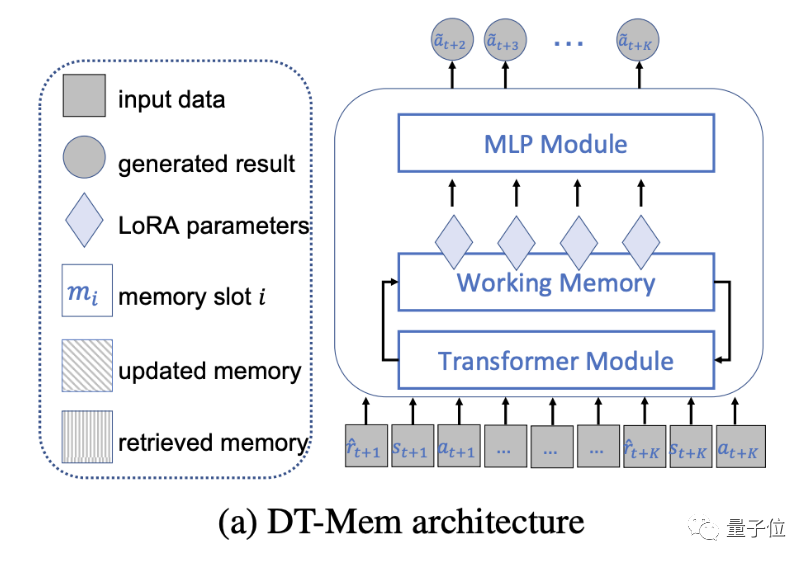

Konkret besteht DT-Mem aus drei Teilen: Transformer, Speichermodul und Multi-Layer-Perception (MLP)-Modul.

Der Transformer von DT-Mem imitiert die Architektur von GPT-2, löscht jedoch den Aufmerksamkeitsmechanismus.

Gleichzeitig wird das MLP-Modul in GPT-2 im Rahmen von DT-Mem in unabhängige Komponenten aufgeteilt.

Dazwischen führte das Forschungsteam ein Arbeitsgedächtnismodul ein, um Zwischeninformationen zu speichern und zu verarbeiten.

Diese Struktur ist von der neuronalen Turing-Maschine inspiriert, bei der der Speicher zum Ableiten verschiedener Algorithmen verwendet wird.

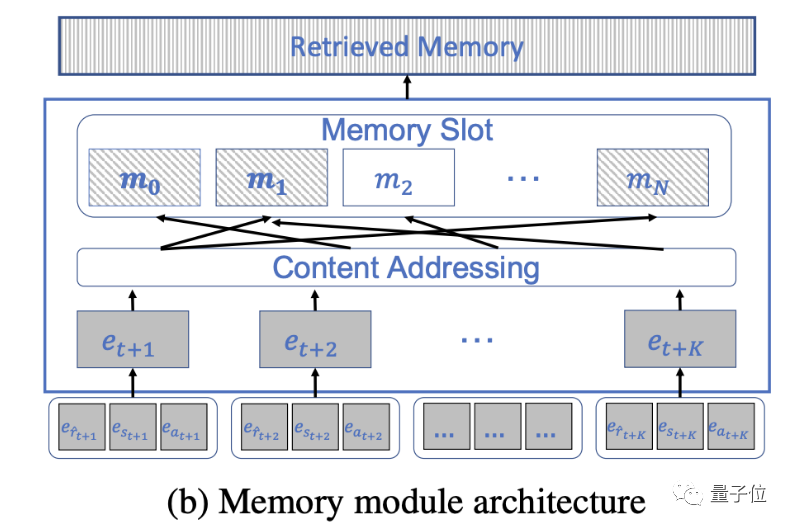

Das Speichermodul analysiert die vom Transformer ausgegebenen Informationen und bestimmt seinen Speicherort und wie es mit vorhandenen Informationen integriert werden kann.

Darüber hinaus wird in diesem Modul auch darüber nachgedacht, wie diese Informationen in zukünftigen Entscheidungsprozessen genutzt werden.

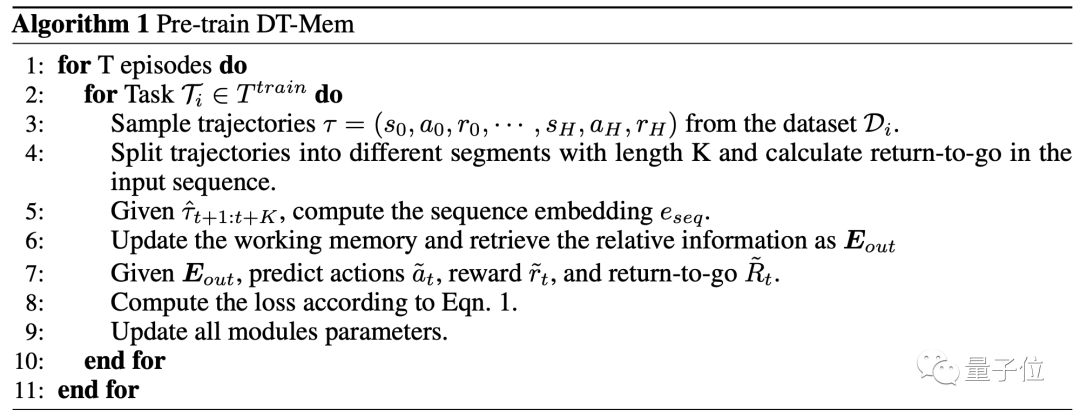

Diese Aufgaben werden zunächst in fünf Schritten initialisiert.

Dann folgt das Sortieren der Eingabeinformationen. In diesem Schritt werden die Informationen nicht an den Transformer übergeben, sondern in Form von Tupeln im selben Raum gespeichert.

Danach müssen Sie den Speicherort bestimmen. Menschen speichern verwandte Informationen normalerweise am selben Ort, und auch DT-Mem basiert auf diesem Prinzip.

Die letzten beiden Schritte – Speicheraktualisierung und -abruf – sind der Kern des Speichermoduls und das wichtigste Glied im gesamten DT-Mem.

Speicheraktualisierung bedeutet das Bearbeiten und Ersetzen vorhandener Informationen, um sicherzustellen, dass die Informationen rechtzeitig entsprechend den Anforderungen der Aufgabe aktualisiert werden können.

In diesem Schritt berechnet DT-Mem die Lösch- und Schreibvektoren, um zu bestimmen, wie sie mit vorhandenen Daten gemischt werden.

Speicherabruf ist der Zugriff auf und die Wiederherstellung vorhandener Informationen sowie der rechtzeitige Abruf relevanter und nützlicher Informationen, wenn Entscheidungen getroffen werden müssen.

Bevor DT-Mem tatsächlich eingesetzt werden kann, muss es noch einen Vorschulungsprozess durchlaufen.

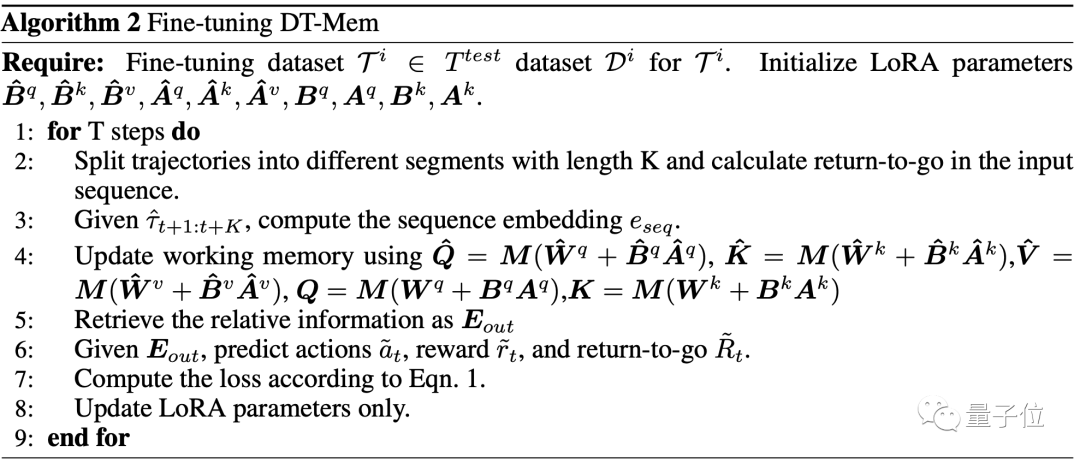

Für die Feinabstimmung von DT-Mem schlug das Team auch einen neuen Weg vor.

Da es Daten verwendet, die auf der Grundlage von Aufgaben gekennzeichnet sind, kann diese Art der Feinabstimmung DT-Mem dabei helfen, sich an neue Aufgaben anzupassen.

Dieser Prozess basiert auf der Low-Rank-Adaption (LoRA), bei der Low-Rank-Elemente zur bestehenden Matrix hinzugefügt werden.

Die Trainingszeit kann bis zu 32-fach verkürzt werden

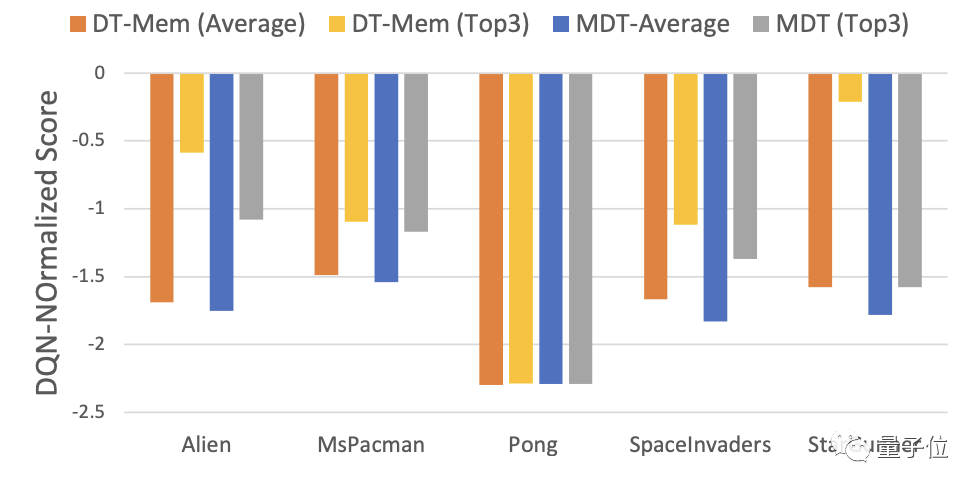

Zum Testen Aufgrund der Entscheidungsfähigkeit von DT-Mem ließ das Forschungsteam mehrere Spiele spielen.

Es gibt insgesamt 5 Spiele, alle von Atari.

Gleichzeitig testete das Team auch die Leistung des traditionellen Modells M[ulti-game]DT als Referenz.

Daher waren die besten Ergebnisse von DT-Mem in vier Spielen besser als die von MDT.

Konkret verbessert DT-Mem den normalisierten DQN-Score um 29,9 % im Vergleich zu MDT.

Allerdings beträgt die Parametermenge von DT-Mem nur 20 Mio., was nur 10 % von MDT (200 Mio. Parameter) entspricht.

Eine solche Leistung ist keineswegs übertrieben.

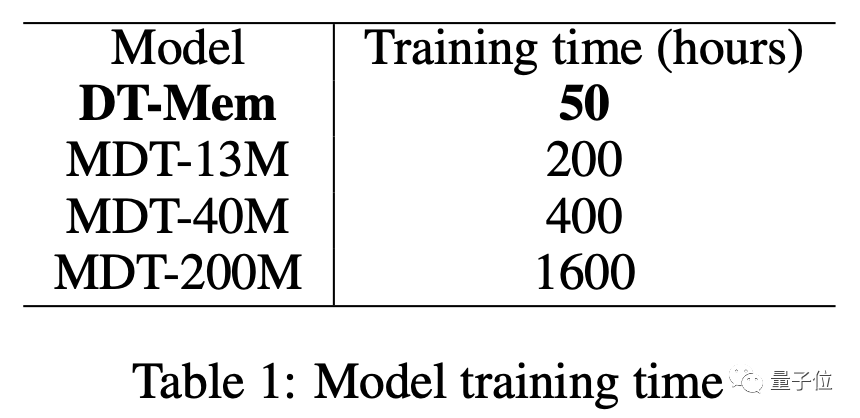

Zusätzlich zu seiner hervorragenden Leistung übertrifft DT-Mem auch die Trainingseffizienz von MDT.

Die 13M-Parameterversion von MDT benötigt 200 Stunden zum Trainieren, während die 20M-DT-Mem-Version nur 50 Stunden benötigt.

Im Vergleich zur 200M-Version verkürzt sich die Trainingszeit um das 32-fache, die Leistung ist aber noch besser.

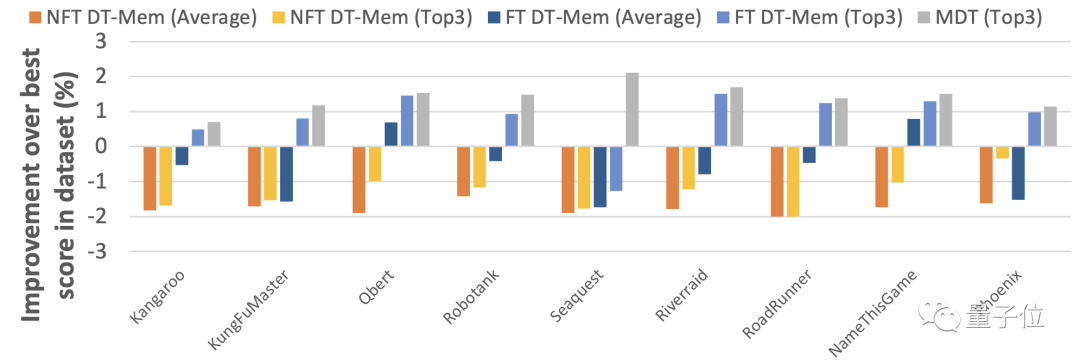

Die Testergebnisse der vom Team vorgeschlagenen Feinabstimmungsmethode zeigen auch, dass diese Feinabstimmung die Fähigkeit von DT-Mem verbessert, sich an unbekannte Szenarien anzupassen.

Es ist zu beachten, dass die in der folgenden Tabelle zum Testen verwendeten Spiele MDT bekannt sind, sodass die Leistung von MDT in dieser Runde nicht als Grundlage für die Messung verwendet wird.

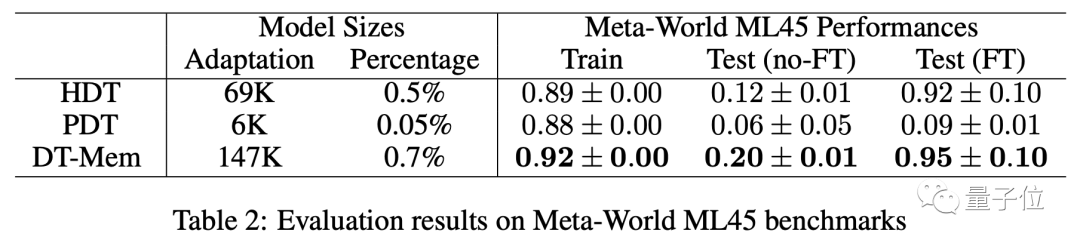

Neben Spielen testete das Team DT-Mem auch mit dem Meta-World ML45-Benchmark.

Die diesmal als Referenz verwendeten sind H[yper]DT und P[romot]DT.

Die Ergebnisse zeigen, dass bei den Modellen ohne Feinabstimmung die Leistung von DT-Mem 8 Prozentpunkte höher ist als die von HDT.

Es ist zu beachten, dass der hier getestete HDT zwar nur 69.000 Parameter hat, aber auf einem vorab trainierten Modell mit 2,3 Millionen Parametern basiert, sodass die tatsächliche Parameteranzahl mehr als das Zehnfache der von DT-Mem (147.000) beträgt.

Papieradresse: https://arxiv.org/abs/2305.16338

Das obige ist der detaillierte Inhalt vonKI imitiert das Gedächtnismodell des menschlichen Gehirns und die Spielergebnisse stiegen um 29,9 %. Für weitere Informationen folgen Sie bitte anderen verwandten Artikeln auf der PHP chinesischen Website!

Heiße KI -Werkzeuge

Undresser.AI Undress

KI-gestützte App zum Erstellen realistischer Aktfotos

AI Clothes Remover

Online-KI-Tool zum Entfernen von Kleidung aus Fotos.

Undress AI Tool

Ausziehbilder kostenlos

Clothoff.io

KI-Kleiderentferner

AI Hentai Generator

Erstellen Sie kostenlos Ai Hentai.

Heißer Artikel

Heiße Werkzeuge

Notepad++7.3.1

Einfach zu bedienender und kostenloser Code-Editor

SublimeText3 chinesische Version

Chinesische Version, sehr einfach zu bedienen

Senden Sie Studio 13.0.1

Leistungsstarke integrierte PHP-Entwicklungsumgebung

Dreamweaver CS6

Visuelle Webentwicklungstools

SublimeText3 Mac-Version

Codebearbeitungssoftware auf Gottesniveau (SublimeText3)

Heiße Themen

1376

1376

52

52

Das weltweit leistungsstärkste Open-Source-MoE-Modell ist da, mit chinesischen Fähigkeiten, die mit GPT-4 vergleichbar sind, und der Preis beträgt nur fast ein Prozent von GPT-4-Turbo

May 07, 2024 pm 04:13 PM

Das weltweit leistungsstärkste Open-Source-MoE-Modell ist da, mit chinesischen Fähigkeiten, die mit GPT-4 vergleichbar sind, und der Preis beträgt nur fast ein Prozent von GPT-4-Turbo

May 07, 2024 pm 04:13 PM

Stellen Sie sich ein Modell der künstlichen Intelligenz vor, das nicht nur die Fähigkeit besitzt, die traditionelle Datenverarbeitung zu übertreffen, sondern auch eine effizientere Leistung zu geringeren Kosten erzielt. Dies ist keine Science-Fiction, DeepSeek-V2[1], das weltweit leistungsstärkste Open-Source-MoE-Modell, ist da. DeepSeek-V2 ist ein leistungsstarkes MoE-Sprachmodell (Mix of Experts) mit den Merkmalen eines wirtschaftlichen Trainings und einer effizienten Inferenz. Es besteht aus 236B Parametern, von denen 21B zur Aktivierung jedes Markers verwendet werden. Im Vergleich zu DeepSeek67B bietet DeepSeek-V2 eine stärkere Leistung, spart gleichzeitig 42,5 % der Trainingskosten, reduziert den KV-Cache um 93,3 % und erhöht den maximalen Generierungsdurchsatz auf das 5,76-fache. DeepSeek ist ein Unternehmen, das sich mit allgemeiner künstlicher Intelligenz beschäftigt

KAN, das MLP ersetzt, wurde durch Open-Source-Projekte auf Faltung erweitert

Jun 01, 2024 pm 10:03 PM

KAN, das MLP ersetzt, wurde durch Open-Source-Projekte auf Faltung erweitert

Jun 01, 2024 pm 10:03 PM

Anfang dieses Monats schlugen Forscher des MIT und anderer Institutionen eine vielversprechende Alternative zu MLP vor – KAN. KAN übertrifft MLP in Bezug auf Genauigkeit und Interpretierbarkeit. Und es kann MLP, das mit einer größeren Anzahl von Parametern ausgeführt wird, mit einer sehr kleinen Anzahl von Parametern übertreffen. Beispielsweise gaben die Autoren an, dass sie KAN nutzten, um die Ergebnisse von DeepMind mit einem kleineren Netzwerk und einem höheren Automatisierungsgrad zu reproduzieren. Konkret verfügt DeepMinds MLP über etwa 300.000 Parameter, während KAN nur etwa 200 Parameter hat. KAN hat eine starke mathematische Grundlage wie MLP und basiert auf dem universellen Approximationssatz, während KAN auf dem Kolmogorov-Arnold-Darstellungssatz basiert. Wie in der folgenden Abbildung gezeigt, hat KAN

Hallo, elektrischer Atlas! Der Boston Dynamics-Roboter erwacht wieder zum Leben, seltsame 180-Grad-Bewegungen machen Musk Angst

Apr 18, 2024 pm 07:58 PM

Hallo, elektrischer Atlas! Der Boston Dynamics-Roboter erwacht wieder zum Leben, seltsame 180-Grad-Bewegungen machen Musk Angst

Apr 18, 2024 pm 07:58 PM

Boston Dynamics Atlas tritt offiziell in die Ära der Elektroroboter ein! Gestern hat sich der hydraulische Atlas einfach „unter Tränen“ von der Bühne der Geschichte zurückgezogen. Heute gab Boston Dynamics bekannt, dass der elektrische Atlas im Einsatz ist. Es scheint, dass Boston Dynamics im Bereich kommerzieller humanoider Roboter entschlossen ist, mit Tesla zu konkurrieren. Nach der Veröffentlichung des neuen Videos wurde es innerhalb von nur zehn Stunden bereits von mehr als einer Million Menschen angesehen. Die alten Leute gehen und neue Rollen entstehen. Das ist eine historische Notwendigkeit. Es besteht kein Zweifel, dass dieses Jahr das explosive Jahr der humanoiden Roboter ist. Netizens kommentierten: Die Weiterentwicklung der Roboter hat dazu geführt, dass die diesjährige Eröffnungsfeier wie Menschen aussieht, und der Freiheitsgrad ist weitaus größer als der von Menschen. Aber ist das wirklich kein Horrorfilm? Zu Beginn des Videos liegt Atlas ruhig auf dem Boden, scheinbar auf dem Rücken. Was folgt, ist atemberaubend

KI untergräbt die mathematische Forschung! Der Gewinner der Fields-Medaille und der chinesisch-amerikanische Mathematiker führten 11 hochrangige Arbeiten an | Gefällt mir bei Terence Tao

Apr 09, 2024 am 11:52 AM

KI untergräbt die mathematische Forschung! Der Gewinner der Fields-Medaille und der chinesisch-amerikanische Mathematiker führten 11 hochrangige Arbeiten an | Gefällt mir bei Terence Tao

Apr 09, 2024 am 11:52 AM

KI verändert tatsächlich die Mathematik. Vor kurzem hat Tao Zhexuan, der diesem Thema große Aufmerksamkeit gewidmet hat, die neueste Ausgabe des „Bulletin of the American Mathematical Society“ (Bulletin der American Mathematical Society) weitergeleitet. Zum Thema „Werden Maschinen die Mathematik verändern?“ äußerten viele Mathematiker ihre Meinung. Der gesamte Prozess war voller Funken, knallhart und aufregend. Der Autor verfügt über eine starke Besetzung, darunter der Fields-Medaillengewinner Akshay Venkatesh, der chinesische Mathematiker Zheng Lejun, der NYU-Informatiker Ernest Davis und viele andere bekannte Wissenschaftler der Branche. Die Welt der KI hat sich dramatisch verändert. Viele dieser Artikel wurden vor einem Jahr eingereicht.

Google ist begeistert: JAX-Leistung übertrifft Pytorch und TensorFlow! Es könnte die schnellste Wahl für das GPU-Inferenztraining werden

Apr 01, 2024 pm 07:46 PM

Google ist begeistert: JAX-Leistung übertrifft Pytorch und TensorFlow! Es könnte die schnellste Wahl für das GPU-Inferenztraining werden

Apr 01, 2024 pm 07:46 PM

Die von Google geförderte Leistung von JAX hat in jüngsten Benchmark-Tests die von Pytorch und TensorFlow übertroffen und belegt bei 7 Indikatoren den ersten Platz. Und der Test wurde nicht auf der TPU mit der besten JAX-Leistung durchgeführt. Obwohl unter Entwicklern Pytorch immer noch beliebter ist als Tensorflow. Aber in Zukunft werden möglicherweise mehr große Modelle auf Basis der JAX-Plattform trainiert und ausgeführt. Modelle Kürzlich hat das Keras-Team drei Backends (TensorFlow, JAX, PyTorch) mit der nativen PyTorch-Implementierung und Keras2 mit TensorFlow verglichen. Zunächst wählen sie eine Reihe von Mainstream-Inhalten aus

Tesla-Roboter arbeiten in Fabriken, Musk: Der Freiheitsgrad der Hände wird dieses Jahr 22 erreichen!

May 06, 2024 pm 04:13 PM

Tesla-Roboter arbeiten in Fabriken, Musk: Der Freiheitsgrad der Hände wird dieses Jahr 22 erreichen!

May 06, 2024 pm 04:13 PM

Das neueste Video von Teslas Roboter Optimus ist veröffentlicht und er kann bereits in der Fabrik arbeiten. Bei normaler Geschwindigkeit sortiert es Batterien (Teslas 4680-Batterien) so: Der Beamte hat auch veröffentlicht, wie es bei 20-facher Geschwindigkeit aussieht – auf einer kleinen „Workstation“, pflücken und pflücken und pflücken: Dieses Mal wird es freigegeben. Eines der Highlights Der Vorteil des Videos besteht darin, dass Optimus diese Arbeit in der Fabrik völlig autonom und ohne menschliches Eingreifen während des gesamten Prozesses erledigt. Und aus Sicht von Optimus kann es auch die krumme Batterie aufnehmen und platzieren, wobei der Schwerpunkt auf der automatischen Fehlerkorrektur liegt: In Bezug auf die Hand von Optimus gab der NVIDIA-Wissenschaftler Jim Fan eine hohe Bewertung ab: Die Hand von Optimus ist der fünffingrige Roboter der Welt am geschicktesten. Seine Hände sind nicht nur taktil

FisheyeDetNet: der erste Zielerkennungsalgorithmus basierend auf einer Fischaugenkamera

Apr 26, 2024 am 11:37 AM

FisheyeDetNet: der erste Zielerkennungsalgorithmus basierend auf einer Fischaugenkamera

Apr 26, 2024 am 11:37 AM

Die Zielerkennung ist ein relativ ausgereiftes Problem in autonomen Fahrsystemen, wobei die Fußgängererkennung einer der ersten Algorithmen ist, die eingesetzt werden. In den meisten Arbeiten wurde eine sehr umfassende Recherche durchgeführt. Die Entfernungswahrnehmung mithilfe von Fischaugenkameras für die Rundumsicht ist jedoch relativ wenig untersucht. Aufgrund der großen radialen Verzerrung ist es schwierig, die standardmäßige Bounding-Box-Darstellung in Fischaugenkameras zu implementieren. Um die obige Beschreibung zu vereinfachen, untersuchen wir erweiterte Begrenzungsrahmen-, Ellipsen- und allgemeine Polygondesigns in Polar-/Winkeldarstellungen und definieren eine mIOU-Metrik für die Instanzsegmentierung, um diese Darstellungen zu analysieren. Das vorgeschlagene Modell „fisheyeDetNet“ mit polygonaler Form übertrifft andere Modelle und erreicht gleichzeitig 49,5 % mAP auf dem Valeo-Fisheye-Kameradatensatz für autonomes Fahren

Mit einer einzelnen Karte läuft Llama 70B schneller als mit zwei Karten, Microsoft hat gerade FP6 in A100 integriert |

Apr 29, 2024 pm 04:55 PM

Mit einer einzelnen Karte läuft Llama 70B schneller als mit zwei Karten, Microsoft hat gerade FP6 in A100 integriert |

Apr 29, 2024 pm 04:55 PM

FP8 und die geringere Gleitkomma-Quantifizierungsgenauigkeit sind nicht länger das „Patent“ von H100! Lao Huang wollte, dass jeder INT8/INT4 nutzt, und das Microsoft DeepSpeed-Team begann, FP6 auf A100 ohne offizielle Unterstützung von NVIDIA auszuführen. Testergebnisse zeigen, dass die FP6-Quantisierung der neuen Methode TC-FPx auf A100 nahe an INT4 liegt oder gelegentlich schneller als diese ist und eine höhere Genauigkeit aufweist als letztere. Darüber hinaus gibt es eine durchgängige Unterstützung großer Modelle, die als Open-Source-Lösung bereitgestellt und in Deep-Learning-Inferenz-Frameworks wie DeepSpeed integriert wurde. Dieses Ergebnis wirkt sich auch unmittelbar auf die Beschleunigung großer Modelle aus – in diesem Rahmen ist der Durchsatz bei Verwendung einer einzelnen Karte zum Ausführen von Llama 2,65-mal höher als der von Doppelkarten. eins