Technologie-Peripheriegeräte

Technologie-Peripheriegeräte

KI

KI

Es gibt ein einheitliches Modell für die multimodale, steuerbare Bilderzeugung, und alle Modellparameter und Inferenzcodes sind Open Source

Es gibt ein einheitliches Modell für die multimodale, steuerbare Bilderzeugung, und alle Modellparameter und Inferenzcodes sind Open Source

Es gibt ein einheitliches Modell für die multimodale, steuerbare Bilderzeugung, und alle Modellparameter und Inferenzcodes sind Open Source

- Papieradresse: https://arxiv.org /abs/2305.11147

- Code-Adresse: https://github.com/salesforce/UniControl

- Projekthomepage: https://shorturl.at/lmMX6

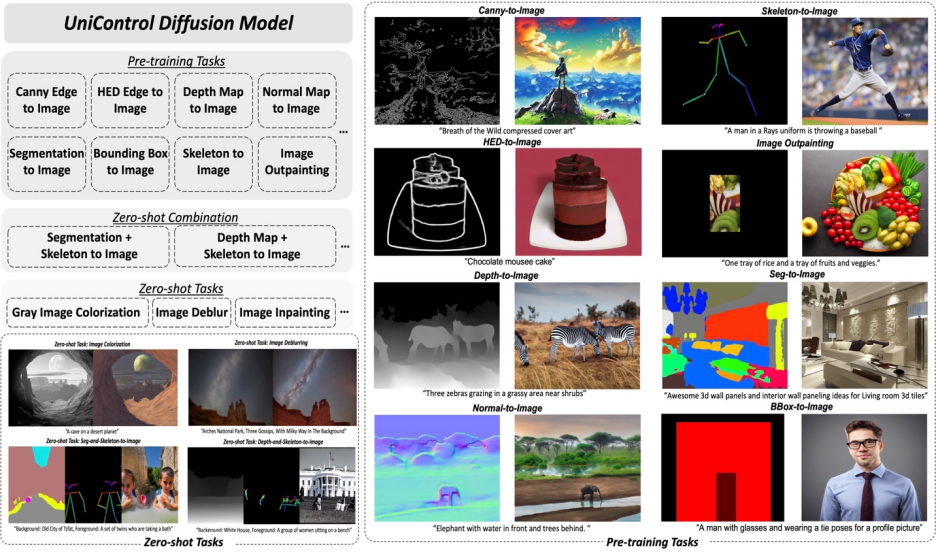

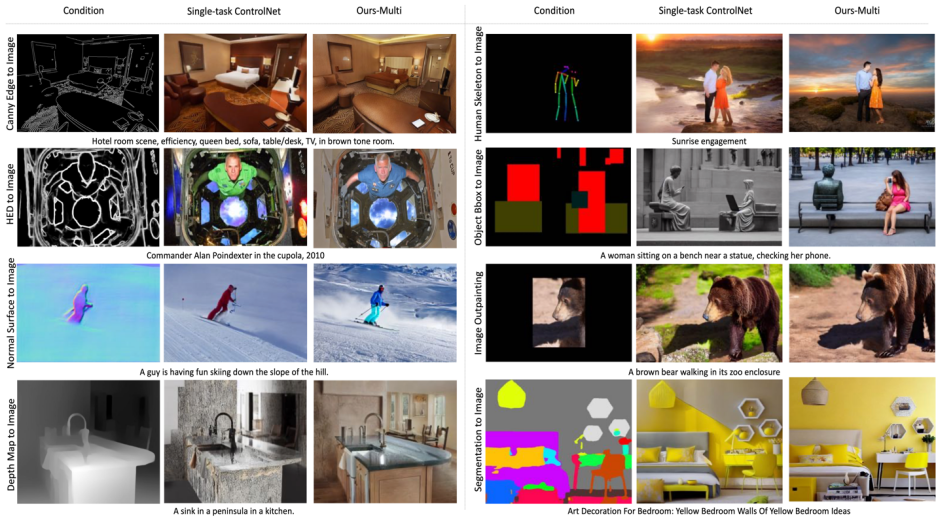

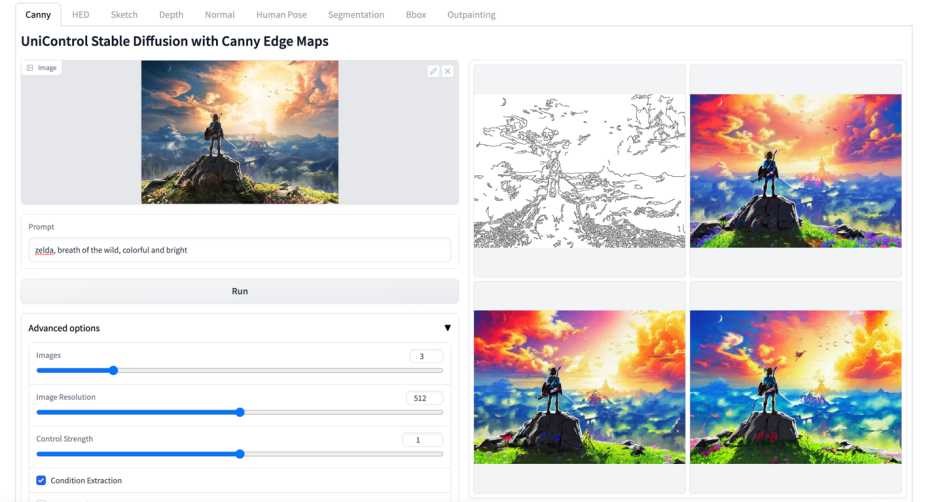

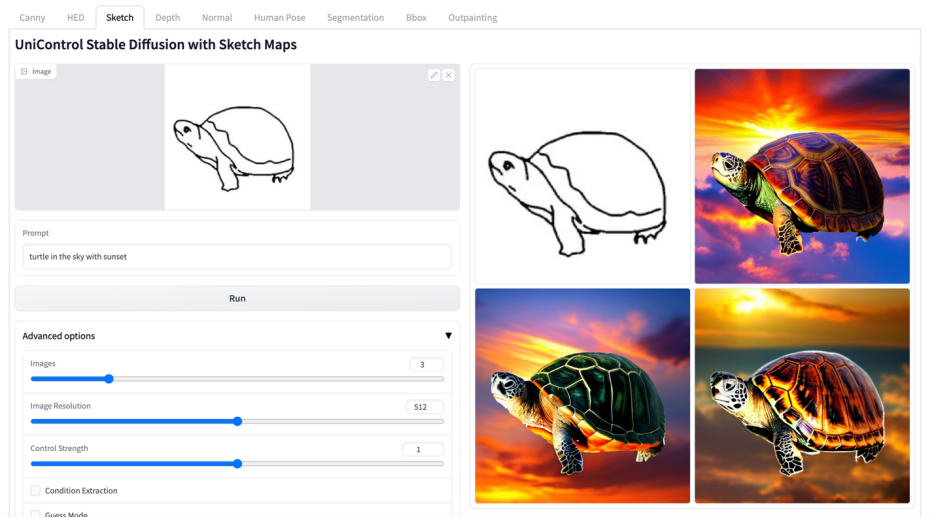

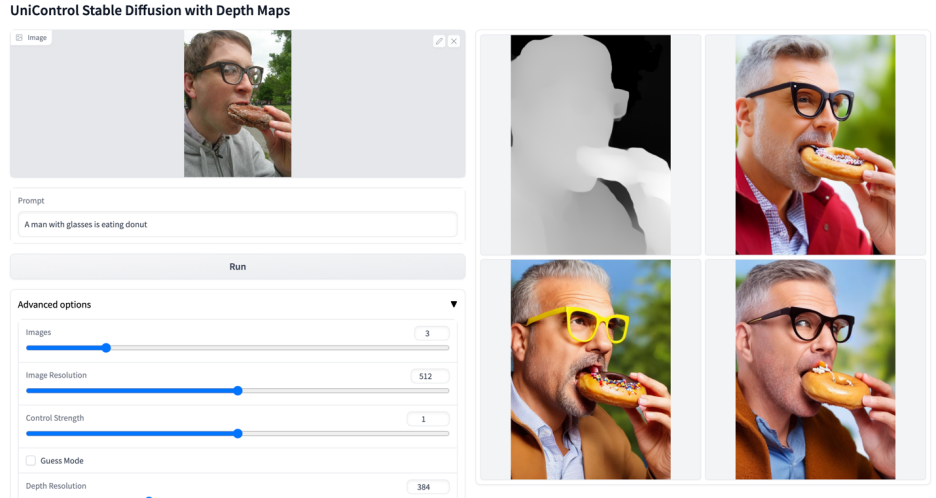

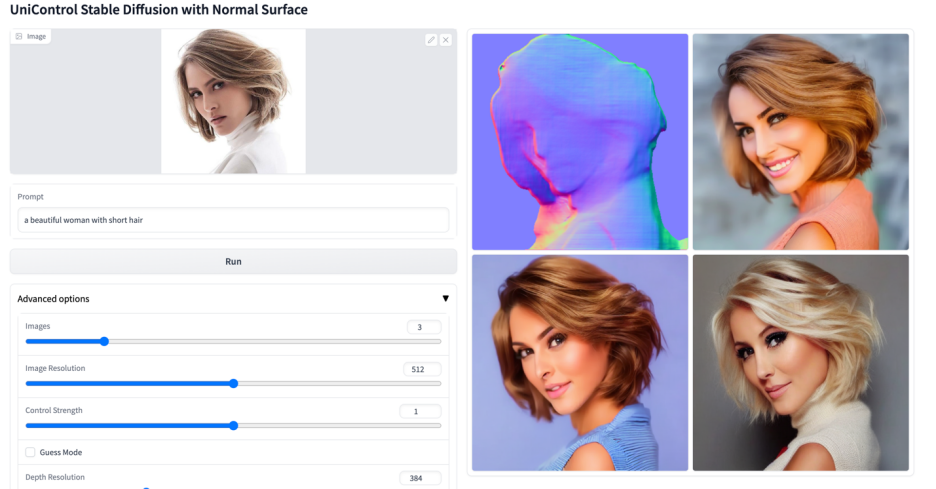

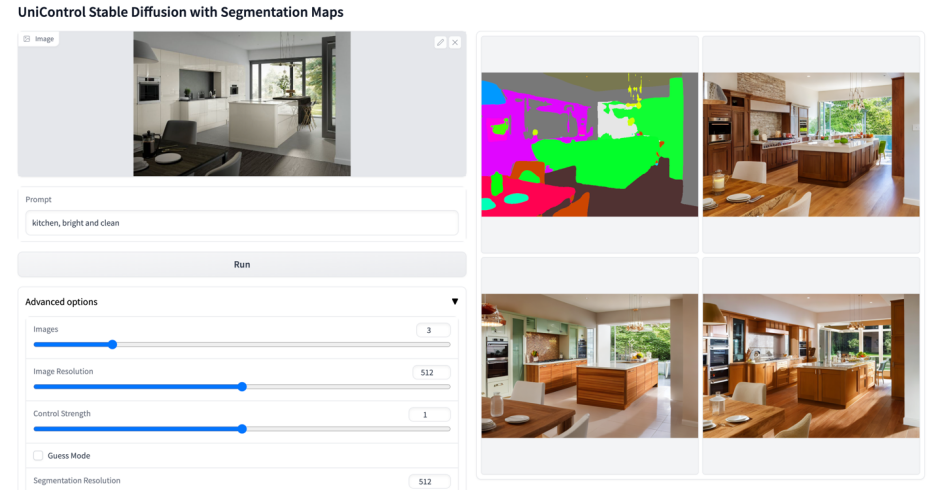

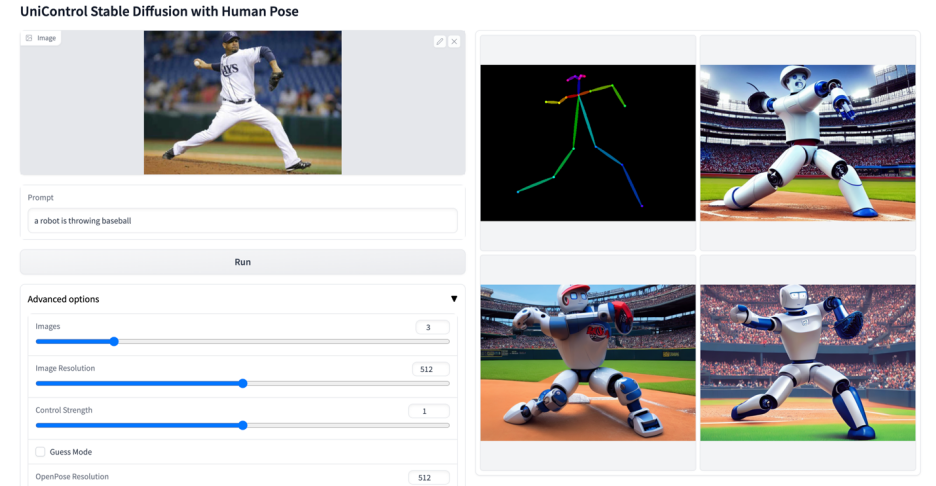

#🎜 🎜#Einführung: Stable Diffusion zeigt leistungsstarke visuelle Generierungsfähigkeiten. Es gelingt ihnen jedoch oft nicht, Bilder mit räumlicher, struktureller oder geometrischer Kontrolle zu erzeugen. Arbeiten wie ControlNet [1] und T2I-Adpater [2] ermöglichen eine kontrollierbare Bilderzeugung für verschiedene Modalitäten, aber die Anpassung an verschiedene visuelle Bedingungen in einem einzigen einheitlichen Modell bleibt eine ungelöste Herausforderung. UniControl umfasst eine Vielzahl steuerbarer Condition-to-Image-Aufgaben (C2I) in einem einzigen Framework. Um UniControl in die Lage zu versetzen, verschiedene visuelle Bedingungen zu bewältigen, führten die Autoren ein aufgabenbewusstes HyperNet ein, um das nachgeschaltete bedingte Diffusionsmodell so anzupassen, dass es sich gleichzeitig an verschiedene C2I-Aufgaben anpassen kann. UniControl ist für neun verschiedene C2I-Aufgaben geschult und demonstriert starke visuelle Generierungsfähigkeiten und Zero-Shot-Generalisierungsfähigkeiten. Der Autor hat die Modellparameter und den Inferenzcode als Open Source bereitgestellt. Der Datensatz und der Trainingscode werden ebenfalls so schnell wie möglich als Open Source bereitgestellt. Abbildung 1: UniControl-Modell von Bestehend aus mehreren Pre-Training-Aufgaben und Zero-Shot-Aufgaben Alle Modelle sind für eine einzige Modalität konzipiert. Arbeiten wie Taskonomy [3] beweisen jedoch, dass verschiedene visuelle Modalitäten gemeinsame Merkmale und Informationen haben. Daher geht dieser Artikel davon aus, dass ein einheitliches multimodales Modell großes Potenzial hat.

Lösung:  In diesem Artikel werden MOE-ähnliche Adapter und aufgabenorientiertes HyperNet vorgeschlagen, um Funktionen zur multimodalen Bedingungsgenerierung in UniControl zu implementieren. Und der Autor hat einen neuen Datensatz MultiGen-20M erstellt, der 9 Hauptaufgaben, mehr als 20 Millionen Bildbedingungs-Prompt-Tripel und eine Bildgröße ≥512 enthält.

In diesem Artikel werden MOE-ähnliche Adapter und aufgabenorientiertes HyperNet vorgeschlagen, um Funktionen zur multimodalen Bedingungsgenerierung in UniControl zu implementieren. Und der Autor hat einen neuen Datensatz MultiGen-20M erstellt, der 9 Hauptaufgaben, mehr als 20 Millionen Bildbedingungs-Prompt-Tripel und eine Bildgröße ≥512 enthält.

Vorteile: 1) Kompakteres Modell (1,4B #params, 5,78GB Prüfpunkt), Implementieren Sie mehrere Aufgaben mit weniger Parametern. 2) Leistungsstärkere visuelle Generierungsfunktionen und Steuerungsgenauigkeit. 3) Zero-Shot-Generalisierungsfähigkeit auf noch nie gesehene Modalitäten.

1. Einführung Generative Basismodelle verändern die Bereiche der künstlichen Intelligenz in der Verarbeitung natürlicher Sprache, Computer Vision, Audioverarbeitung und Robotersteuerung . Art der Interaktion. Bei der Verarbeitung natürlicher Sprache leisten generative Basismodelle wie InstructGPT oder GPT-4 bei einer Vielzahl von Aufgaben gute Dienste, und diese Multitasking-Fähigkeit ist eine der attraktivsten Funktionen. Darüber hinaus können sie Zero-Shot- oder Fence-Shot-Lernen durchführen, um unbekannte Aufgaben zu bewältigen.

Allerdings ist diese Multitasking-Fähigkeit in generativen Modellen im visuellen Bereich nicht ausgeprägt. Während Textbeschreibungen eine flexible Möglichkeit bieten, den Inhalt generierter Bilder zu steuern, mangelt es ihnen oft an räumlicher, struktureller oder geometrischer Kontrolle auf Pixelebene. Aktuelle populäre Forschungsergebnisse wie ControlNet und der T2I-Adapter können das Stable Diffusion Model (SDM) verbessern, um eine präzise Steuerung zu erreichen. Im Gegensatz zu Sprachhinweisen, die von einem einheitlichen Modul wie CLIP verarbeitet werden können, kann jedes ControlNet-Modell jedoch nur die spezifische Modalität verarbeiten, auf die es trainiert wurde.

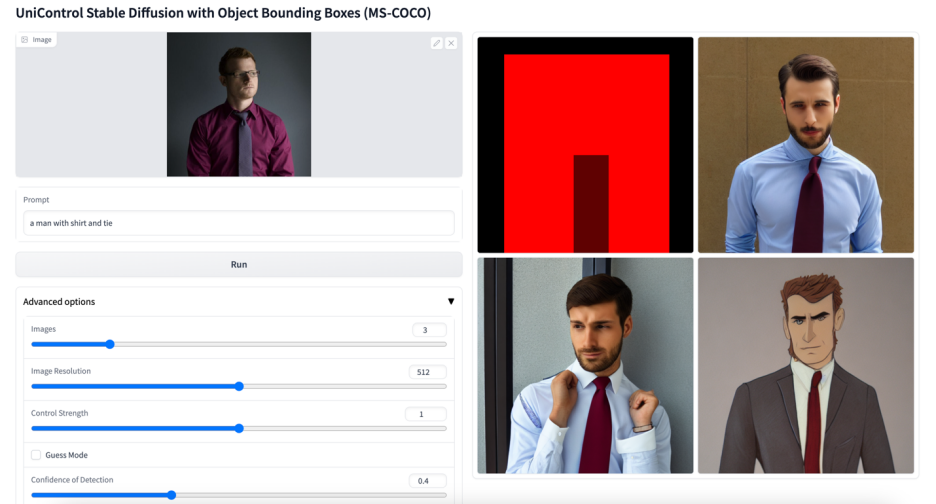

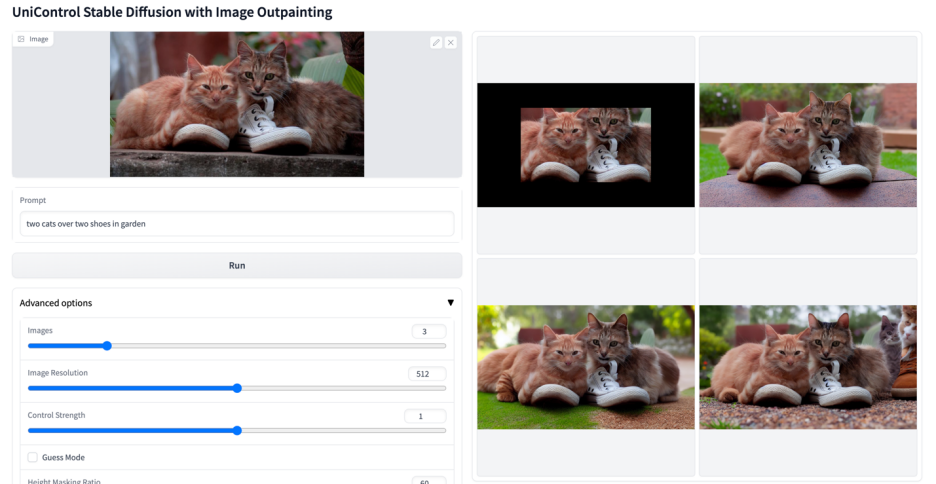

Um die Einschränkungen früherer Arbeiten zu überwinden, schlägt dieses Papier UniControl vor, ein einheitliches Diffusionsmodell, das sowohl Sprache als auch verschiedene visuelle Bedingungen verarbeiten kann. Das einheitliche Design von UniControl ermöglicht eine verbesserte Trainings- und Inferenzeffizienz sowie eine verbesserte steuerbare Erzeugung. UniControl hingegen profitiert von den inhärenten Verbindungen zwischen verschiedenen Sehbedingungen, um die generativen Effekte jeder Bedingung zu verstärken.Die einheitliche steuerbare Generierungsfunktion von UniControl basiert auf zwei Teilen: dem „MOE-Style-Adapter“ und dem „Task-aware HyperNet“. Der MOE-Adapter verfügt über etwa 70.000 Parameter und kann Low-Level-Feature-Maps aus verschiedenen Modalitäten erlernen. Das aufgabenbewusste HyperNet kann Aufgabenanweisungen als Eingabeaufforderungen in natürlicher Sprache eingeben und Aufgabeneinbettungen ausgeben, die in das Downstream-Netzwerk eingebettet werden, um die Downstream-Parameter zu modulieren zur Anpassung an verschiedene modale Eingaben. In dieser Studie wurde UniControl vorab trainiert, um die Fähigkeit zum Multitasking- und Zero-Shot-Lernen zu erlangen, einschließlich neun verschiedener Aufgaben in fünf Kategorien: Edge (Canny, HED, Skizze), Flächenkartierung (Segmentierung, Object Bound Box), Skelett (Menschliches Skelett), Geometrie (Tiefe, normale Oberfläche) und Bildbearbeitung (Image Outpainting). Anschließend trainierte die Studie UniControl über 5.000 GPU-Stunden lang auf NVIDIA A100-Hardware (neue Modelle werden auch heute noch trainiert). Und UniControl demonstriert die sofortige Anpassungsfähigkeit an neue Aufgaben. Der Beitrag dieser Studie lässt sich wie folgt zusammenfassen:

2. Modelldesign

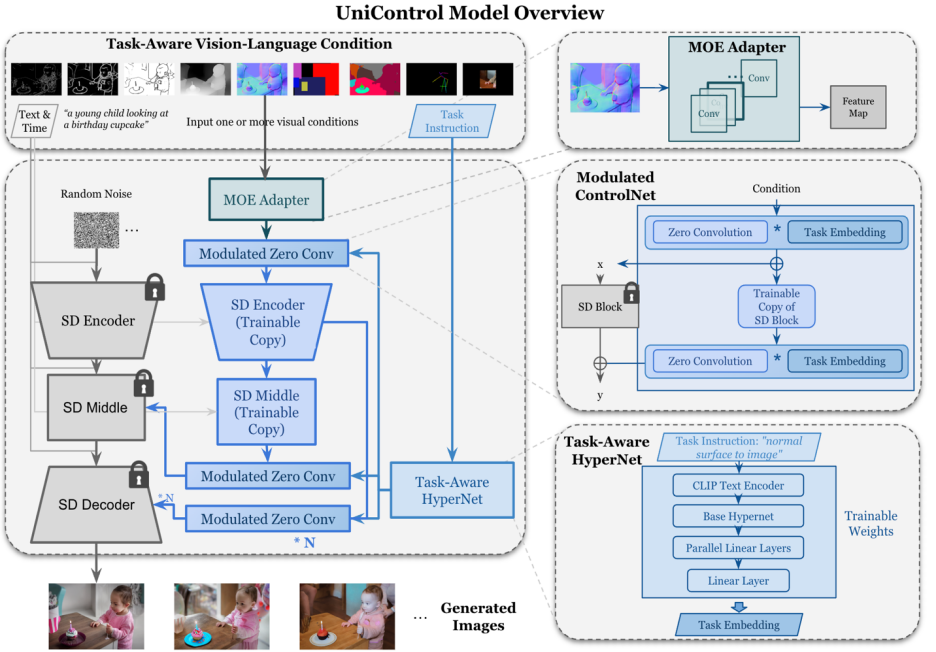

#🎜 🎜#Abbildung 2: Modellstruktur. Um mehrere Aufgaben zu bewältigen, wurde in der Studie ein MOE-Adapter mit etwa 70.000 Parametern pro Aufgabe und einem aufgabenbewussten HyperNet (~12 Millionen Parameter) zur Modulation von 7 Schichten ohne Faltung entwickelt. Diese Struktur ermöglicht die Implementierung von Multitask-Funktionen in einem einzigen Modell, wodurch nicht nur die Vielfalt von Multitasks sichergestellt wird, sondern auch die zugrunde liegende Parameterfreigabe erhalten bleibt. Erhebliche Reduzierung der Modellgröße im Vergleich zu äquivalenten gestapelten Einzelaufgabenmodellen (ca. 1,4 Milliarden Parameter pro Modell).

UniControl-Modelldesign gewährleistet zwei Eigenschaften:

1 ) zu Überwinden Sie die Fehlausrichtung zwischen Low-Level-Features verschiedener Modalitäten. Dies hilft UniControl, notwendige und einzigartige Informationen aus allen Aufgaben zu lernen. Wenn ein Modell beispielsweise auf Segmentierungskarten als visuelle Bedingung basiert, werden 3D-Informationen möglicherweise ignoriert.

2) Kann Metawissen aufgabenübergreifend erlernen. Dadurch kann das Modell das gemeinsame Wissen zwischen Aufgaben und die Unterschiede zwischen ihnen verstehen.

Um diese Eigenschaften bereitzustellen, führt das Modell zwei neuartige Module ein: MOE-Style-Adapter und Task-aware HyperNet.

Der Adapter im MOE-Stil besteht aus einer Reihe von Faltungsmodulen. Jeder Adapter entspricht einer separaten Modalität, inspiriert vom Mischungsmodell der Experten (MOE), das als UniControl-Erfassung verwendet wird Charakterisierung verschiedener Sehstörungen auf niedriger Ebene. Dieses Adaptermodul verfügt über ca. 70.000 Parameter und ist äußerst recheneffizient. Die visuellen Merkmale werden dann zur Verarbeitung in ein einheitliches Netzwerk eingespeist.

Aufgabenbewusstes HyperNet passt das Nullfaltungsmodul von ControlNet durch Aufgabenanweisungsbedingungen an. HyperNet projiziert zunächst die Aufgabenanweisungen in die Aufgabeneinbettung, und dann injizieren die Forscher die Aufgabeneinbettung in die Null-Faltungsschicht von ControlNet. Hier entspricht die Aufgabeneinbettung der Faltungskernmatrixgröße der Null-Faltungsschicht. Ähnlich wie bei StyleGAN [4] multipliziert diese Studie die beiden direkt, um die Faltungsparameter zu modulieren, und die modulierten Faltungsparameter werden als endgültige Faltungsparameter verwendet. Daher sind die modulierten Nullfaltungsparameter jeder Aufgabe unterschiedlich. Dies stellt die Anpassungsfähigkeit des Modells an jede Modalität sicher. Darüber hinaus werden alle Gewichte geteilt.

3. Modelltraining

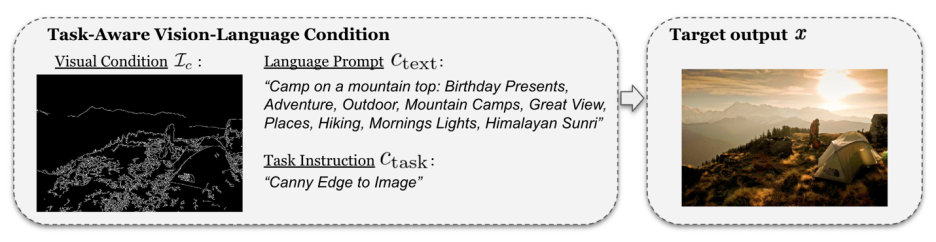

Anders als bei SDM oder ControlNet ist die Bilderzeugungsbedingung dieser Modelle ein einzelner Sprachhinweis oder eine einzelne Art von visueller Bedingung wie „canny“. UniControl muss eine Vielzahl visueller Bedingungen aus verschiedenen Aufgaben sowie verbale Hinweise bewältigen. Daher besteht die Eingabe von UniControl aus vier Teilen: Geräusch, Textaufforderung, visueller Zustand und Aufgabenanweisung. Unter anderem können Aufgabenanweisungen auf natürliche Weise entsprechend der Modalität des Sehzustands erhalten werden.

Mit solchen generierten Trainingspaaren wurde in dieser Studie DDPM [5] zum Trainieren des Modells übernommen.

4. Experimentelle Ergebnisse

#🎜 🎜#Abbildung 6: Visuelle Vergleichsergebnisse des Testsatzes. Die Testdaten stammen von MSCOCO [6] und Laion [7]

Die hier wiedergegebenen Vergleichsergebnisse mit dem offiziellen oder ControlNet Die Ergebnisse der Studie sind in Abbildung 6 dargestellt. Weitere Ergebnisse finden Sie im Dokument.

5.Zero-Shot-Aufgaben-VerallgemeinerungDas Modell testet die Zero-Shot-Fähigkeit in den folgenden zwei Szenarien: # 🎜🎜#

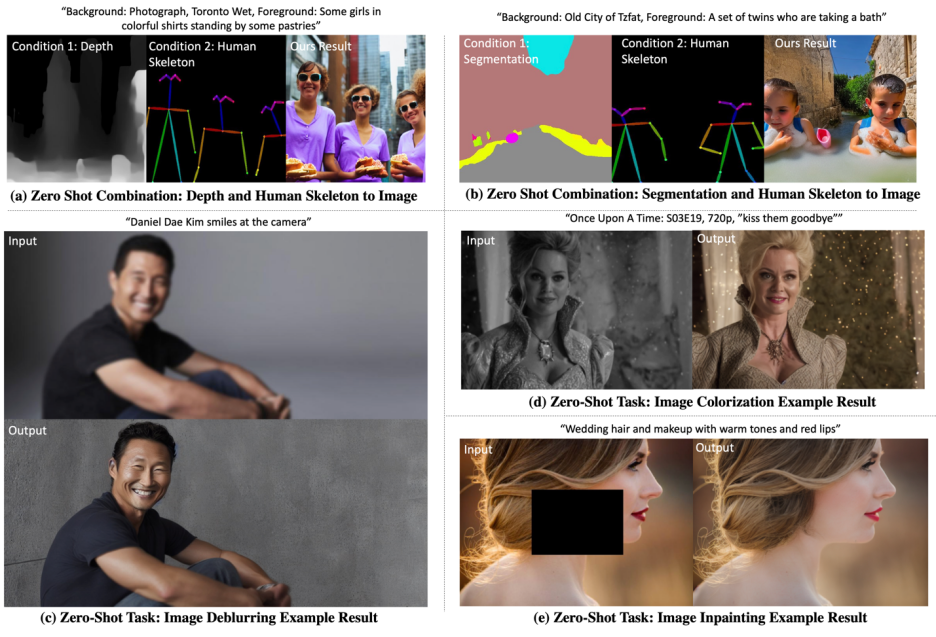

Verallgemeinerung gemischter Aufgaben: Diese Studie berücksichtigt zwei verschiedene visuelle Bedingungen als Eingabe für UniControl, eine davon ist eine Mischung aus Segmentierungskarten und menschlichen Skeletten, und fügt spezifische Schlüsselwörter in den Textaufforderungen hinzu. „Hintergrund“ und „Vordergrund“. Darüber hinaus schreibt die Studie die Hybridaufgabenanweisungen als Hybridanweisungen zur Kombination zweier Aufgaben um, beispielsweise „Segmentierungskarte und menschliches Skelett zum Bild“.Neue Aufgabenverallgemeinerung: UniControl muss kontrollierbare Bilder unter neuen, noch nie dagewesenen visuellen Bedingungen generieren. Um dies zu erreichen, ist es wichtig, die Aufgabengewichte auf der Grundlage der Beziehung zwischen unsichtbaren und sichtbaren vorab trainierten Aufgaben abzuschätzen. Aufgabengewichte können durch manuelles Zuweisen oder Berechnen von Ähnlichkeitswerten von Aufgabenanweisungen im Einbettungsraum geschätzt werden. Adapter im MOE-Stil können linear mit geschätzten Aufgabengewichten zusammengesetzt werden, um flache Merkmale aus neuen, unsichtbaren visuellen Bedingungen zu extrahieren.

Die visualisierten Ergebnisse sind in Abbildung 7 dargestellt. Weitere Ergebnisse finden Sie im Dokument.

Abbildung 7: UniControl im Nullpunkt Visuelle Ergebnisse bei -Shot-Aufgaben6. Zusammenfassung

Im Allgemeinen hat das UniControl-Modell seine Kontrolle bestanden Diversität bietet ein neues Grundmodell für die kontrollierbare visuelle Generierung. Ein solches Modell könnte die Möglichkeit bieten, ein höheres Maß an Autonomie und menschlicher Kontrolle bei Bilderzeugungsaufgaben zu erreichen. Diese Studie freut sich auf die Diskussion und Zusammenarbeit mit weiteren Forschern, um die Entwicklung dieses Fachgebiets weiter voranzutreiben. Weitere Bilder 🎜#

# 🎜 🎜#

Das obige ist der detaillierte Inhalt vonEs gibt ein einheitliches Modell für die multimodale, steuerbare Bilderzeugung, und alle Modellparameter und Inferenzcodes sind Open Source. Für weitere Informationen folgen Sie bitte anderen verwandten Artikeln auf der PHP chinesischen Website!

Heiße KI -Werkzeuge

Undresser.AI Undress

KI-gestützte App zum Erstellen realistischer Aktfotos

AI Clothes Remover

Online-KI-Tool zum Entfernen von Kleidung aus Fotos.

Undress AI Tool

Ausziehbilder kostenlos

Clothoff.io

KI-Kleiderentferner

AI Hentai Generator

Erstellen Sie kostenlos Ai Hentai.

Heißer Artikel

Heiße Werkzeuge

Notepad++7.3.1

Einfach zu bedienender und kostenloser Code-Editor

SublimeText3 chinesische Version

Chinesische Version, sehr einfach zu bedienen

Senden Sie Studio 13.0.1

Leistungsstarke integrierte PHP-Entwicklungsumgebung

Dreamweaver CS6

Visuelle Webentwicklungstools

SublimeText3 Mac-Version

Codebearbeitungssoftware auf Gottesniveau (SublimeText3)

Heiße Themen

1377

1377

52

52

Das weltweit leistungsstärkste Open-Source-MoE-Modell ist da, mit chinesischen Fähigkeiten, die mit GPT-4 vergleichbar sind, und der Preis beträgt nur fast ein Prozent von GPT-4-Turbo

May 07, 2024 pm 04:13 PM

Das weltweit leistungsstärkste Open-Source-MoE-Modell ist da, mit chinesischen Fähigkeiten, die mit GPT-4 vergleichbar sind, und der Preis beträgt nur fast ein Prozent von GPT-4-Turbo

May 07, 2024 pm 04:13 PM

Stellen Sie sich ein Modell der künstlichen Intelligenz vor, das nicht nur die Fähigkeit besitzt, die traditionelle Datenverarbeitung zu übertreffen, sondern auch eine effizientere Leistung zu geringeren Kosten erzielt. Dies ist keine Science-Fiction, DeepSeek-V2[1], das weltweit leistungsstärkste Open-Source-MoE-Modell, ist da. DeepSeek-V2 ist ein leistungsstarkes MoE-Sprachmodell (Mix of Experts) mit den Merkmalen eines wirtschaftlichen Trainings und einer effizienten Inferenz. Es besteht aus 236B Parametern, von denen 21B zur Aktivierung jedes Markers verwendet werden. Im Vergleich zu DeepSeek67B bietet DeepSeek-V2 eine stärkere Leistung, spart gleichzeitig 42,5 % der Trainingskosten, reduziert den KV-Cache um 93,3 % und erhöht den maximalen Generierungsdurchsatz auf das 5,76-fache. DeepSeek ist ein Unternehmen, das sich mit allgemeiner künstlicher Intelligenz beschäftigt

KI untergräbt die mathematische Forschung! Der Gewinner der Fields-Medaille und der chinesisch-amerikanische Mathematiker führten 11 hochrangige Arbeiten an | Gefällt mir bei Terence Tao

Apr 09, 2024 am 11:52 AM

KI untergräbt die mathematische Forschung! Der Gewinner der Fields-Medaille und der chinesisch-amerikanische Mathematiker führten 11 hochrangige Arbeiten an | Gefällt mir bei Terence Tao

Apr 09, 2024 am 11:52 AM

KI verändert tatsächlich die Mathematik. Vor kurzem hat Tao Zhexuan, der diesem Thema große Aufmerksamkeit gewidmet hat, die neueste Ausgabe des „Bulletin of the American Mathematical Society“ (Bulletin der American Mathematical Society) weitergeleitet. Zum Thema „Werden Maschinen die Mathematik verändern?“ äußerten viele Mathematiker ihre Meinung. Der gesamte Prozess war voller Funken, knallhart und aufregend. Der Autor verfügt über eine starke Besetzung, darunter der Fields-Medaillengewinner Akshay Venkatesh, der chinesische Mathematiker Zheng Lejun, der NYU-Informatiker Ernest Davis und viele andere bekannte Wissenschaftler der Branche. Die Welt der KI hat sich dramatisch verändert. Viele dieser Artikel wurden vor einem Jahr eingereicht.

KAN, das MLP ersetzt, wurde durch Open-Source-Projekte auf Faltung erweitert

Jun 01, 2024 pm 10:03 PM

KAN, das MLP ersetzt, wurde durch Open-Source-Projekte auf Faltung erweitert

Jun 01, 2024 pm 10:03 PM

Anfang dieses Monats schlugen Forscher des MIT und anderer Institutionen eine vielversprechende Alternative zu MLP vor – KAN. KAN übertrifft MLP in Bezug auf Genauigkeit und Interpretierbarkeit. Und es kann MLP, das mit einer größeren Anzahl von Parametern ausgeführt wird, mit einer sehr kleinen Anzahl von Parametern übertreffen. Beispielsweise gaben die Autoren an, dass sie KAN nutzten, um die Ergebnisse von DeepMind mit einem kleineren Netzwerk und einem höheren Automatisierungsgrad zu reproduzieren. Konkret verfügt DeepMinds MLP über etwa 300.000 Parameter, während KAN nur etwa 200 Parameter hat. KAN hat eine starke mathematische Grundlage wie MLP und basiert auf dem universellen Approximationssatz, während KAN auf dem Kolmogorov-Arnold-Darstellungssatz basiert. Wie in der folgenden Abbildung gezeigt, hat KAN

Hallo, elektrischer Atlas! Der Boston Dynamics-Roboter erwacht wieder zum Leben, seltsame 180-Grad-Bewegungen machen Musk Angst

Apr 18, 2024 pm 07:58 PM

Hallo, elektrischer Atlas! Der Boston Dynamics-Roboter erwacht wieder zum Leben, seltsame 180-Grad-Bewegungen machen Musk Angst

Apr 18, 2024 pm 07:58 PM

Boston Dynamics Atlas tritt offiziell in die Ära der Elektroroboter ein! Gestern hat sich der hydraulische Atlas einfach „unter Tränen“ von der Bühne der Geschichte zurückgezogen. Heute gab Boston Dynamics bekannt, dass der elektrische Atlas im Einsatz ist. Es scheint, dass Boston Dynamics im Bereich kommerzieller humanoider Roboter entschlossen ist, mit Tesla zu konkurrieren. Nach der Veröffentlichung des neuen Videos wurde es innerhalb von nur zehn Stunden bereits von mehr als einer Million Menschen angesehen. Die alten Leute gehen und neue Rollen entstehen. Das ist eine historische Notwendigkeit. Es besteht kein Zweifel, dass dieses Jahr das explosive Jahr der humanoiden Roboter ist. Netizens kommentierten: Die Weiterentwicklung der Roboter hat dazu geführt, dass die diesjährige Eröffnungsfeier wie Menschen aussieht, und der Freiheitsgrad ist weitaus größer als der von Menschen. Aber ist das wirklich kein Horrorfilm? Zu Beginn des Videos liegt Atlas ruhig auf dem Boden, scheinbar auf dem Rücken. Was folgt, ist atemberaubend

Google ist begeistert: JAX-Leistung übertrifft Pytorch und TensorFlow! Es könnte die schnellste Wahl für das GPU-Inferenztraining werden

Apr 01, 2024 pm 07:46 PM

Google ist begeistert: JAX-Leistung übertrifft Pytorch und TensorFlow! Es könnte die schnellste Wahl für das GPU-Inferenztraining werden

Apr 01, 2024 pm 07:46 PM

Die von Google geförderte Leistung von JAX hat in jüngsten Benchmark-Tests die von Pytorch und TensorFlow übertroffen und belegt bei 7 Indikatoren den ersten Platz. Und der Test wurde nicht auf der TPU mit der besten JAX-Leistung durchgeführt. Obwohl unter Entwicklern Pytorch immer noch beliebter ist als Tensorflow. Aber in Zukunft werden möglicherweise mehr große Modelle auf Basis der JAX-Plattform trainiert und ausgeführt. Modelle Kürzlich hat das Keras-Team drei Backends (TensorFlow, JAX, PyTorch) mit der nativen PyTorch-Implementierung und Keras2 mit TensorFlow verglichen. Zunächst wählen sie eine Reihe von Mainstream-Inhalten aus

Empfohlen: Ausgezeichnetes JS-Open-Source-Projekt zur Gesichtserkennung und -erkennung

Apr 03, 2024 am 11:55 AM

Empfohlen: Ausgezeichnetes JS-Open-Source-Projekt zur Gesichtserkennung und -erkennung

Apr 03, 2024 am 11:55 AM

Die Technologie zur Gesichtserkennung und -erkennung ist bereits eine relativ ausgereifte und weit verbreitete Technologie. Derzeit ist JS die am weitesten verbreitete Internetanwendungssprache. Die Implementierung der Gesichtserkennung und -erkennung im Web-Frontend hat im Vergleich zur Back-End-Gesichtserkennung Vor- und Nachteile. Zu den Vorteilen gehören die Reduzierung der Netzwerkinteraktion und die Echtzeiterkennung, was die Wartezeit des Benutzers erheblich verkürzt und das Benutzererlebnis verbessert. Die Nachteile sind: Es ist durch die Größe des Modells begrenzt und auch die Genauigkeit ist begrenzt. Wie implementiert man mit js die Gesichtserkennung im Web? Um die Gesichtserkennung im Web zu implementieren, müssen Sie mit verwandten Programmiersprachen und -technologien wie JavaScript, HTML, CSS, WebRTC usw. vertraut sein. Gleichzeitig müssen Sie auch relevante Technologien für Computer Vision und künstliche Intelligenz beherrschen. Dies ist aufgrund des Designs der Webseite erwähnenswert

Das multimodale Dokumentenverständnis-Großmodell Alibaba 7B gewinnt neue SOTA

Apr 02, 2024 am 11:31 AM

Das multimodale Dokumentenverständnis-Großmodell Alibaba 7B gewinnt neue SOTA

Apr 02, 2024 am 11:31 AM

Neues SOTA für multimodale Dokumentverständnisfunktionen! Das Alibaba mPLUG-Team hat die neueste Open-Source-Arbeit mPLUG-DocOwl1.5 veröffentlicht, die eine Reihe von Lösungen zur Bewältigung der vier großen Herausforderungen der hochauflösenden Bildtexterkennung, des allgemeinen Verständnisses der Dokumentstruktur, der Befolgung von Anweisungen und der Einführung externen Wissens vorschlägt. Schauen wir uns ohne weitere Umschweife zunächst die Auswirkungen an. Ein-Klick-Erkennung und Konvertierung von Diagrammen mit komplexen Strukturen in das Markdown-Format: Es stehen Diagramme verschiedener Stile zur Verfügung: Auch eine detailliertere Texterkennung und -positionierung ist einfach zu handhaben: Auch ausführliche Erläuterungen zum Dokumentverständnis können gegeben werden: Sie wissen schon, „Document Understanding“. " ist derzeit ein wichtiges Szenario für die Implementierung großer Sprachmodelle. Es gibt viele Produkte auf dem Markt, die das Lesen von Dokumenten unterstützen. Einige von ihnen verwenden hauptsächlich OCR-Systeme zur Texterkennung und arbeiten mit LLM zur Textverarbeitung zusammen.

Tesla-Roboter arbeiten in Fabriken, Musk: Der Freiheitsgrad der Hände wird dieses Jahr 22 erreichen!

May 06, 2024 pm 04:13 PM

Tesla-Roboter arbeiten in Fabriken, Musk: Der Freiheitsgrad der Hände wird dieses Jahr 22 erreichen!

May 06, 2024 pm 04:13 PM

Das neueste Video von Teslas Roboter Optimus ist veröffentlicht und er kann bereits in der Fabrik arbeiten. Bei normaler Geschwindigkeit sortiert es Batterien (Teslas 4680-Batterien) so: Der Beamte hat auch veröffentlicht, wie es bei 20-facher Geschwindigkeit aussieht – auf einer kleinen „Workstation“, pflücken und pflücken und pflücken: Dieses Mal wird es freigegeben. Eines der Highlights Der Vorteil des Videos besteht darin, dass Optimus diese Arbeit in der Fabrik völlig autonom und ohne menschliches Eingreifen während des gesamten Prozesses erledigt. Und aus Sicht von Optimus kann es auch die krumme Batterie aufnehmen und platzieren, wobei der Schwerpunkt auf der automatischen Fehlerkorrektur liegt: In Bezug auf die Hand von Optimus gab der NVIDIA-Wissenschaftler Jim Fan eine hohe Bewertung ab: Die Hand von Optimus ist der fünffingrige Roboter der Welt am geschicktesten. Seine Hände sind nicht nur taktil