Vielfältige und hochwertige Ergebnisse der 3D-Szenengenerierung

Mithilfe der künstlichen Intelligenz-unterstützten Inhaltsgenerierung (AIGC) ist im Bereich der Bildgenerierung eine Menge Arbeit entstanden, von frühen Variations-Autoencodern (VAE) bis hin zu generativen kontradiktorischen Netzwerken (GAN) ) und dann zum kürzlich beliebten Diffusionsmodell (Diffusionsmodell) haben sich die Fähigkeiten zur Modellgenerierung schnell verbessert. Modelle, die durch Stable Diffusion, Midjourney usw. dargestellt werden, haben beispiellose Ergebnisse bei der Erzeugung äußerst realistischer Bilder erzielt. Gleichzeitig sind im Bereich der Videogenerierung in letzter Zeit viele hervorragende Arbeiten entstanden. Beispielsweise kann das generative Modell von Runway fantasievolle Videoclips generieren. Diese Anwendungen haben die Hemmschwelle für die Erstellung von Inhalten erheblich gesenkt und machen es für jeden einfacher, seine wilden Ideen in die Realität umzusetzen.

Da jedoch die inhaltstragenden Medien immer umfangreicher werden, geben sich die Menschen nach und nach nicht mehr mit zweidimensionalen grafischen Inhalten wie Bildern, Texten und Videos zufrieden. Mit der kontinuierlichen Weiterentwicklung der interaktiven Videospieltechnologie, insbesondere der allmählichen Reife von Anwendungen wie virtueller und erweiterter Realität, hoffen die Menschen zunehmend, mit Szenen und Objekten aus einer dreidimensionalen Perspektive zu interagieren, was den Bedarf an dreidimensionalen Inhalten mit sich bringt. Höhere Anforderungen generieren.

Wie man schnell hochwertige dreidimensionale Inhalte mit feiner geometrischer Struktur und äußerst realistischem Erscheinungsbild generiert, war schon immer ein zentrales Thema, das von Forschern in der Computergrafik-Community untersucht wurde. Die intelligente Generierung dreidimensionaler Inhalte durch Computer kann bei der Produktion wichtiger digitaler Assets in der Spiele-, Film- und Fernsehproduktion in tatsächlichen Produktionsanwendungen helfen, wodurch die Entwicklungszeit des Kunstproduktionspersonals erheblich verkürzt, die Kosten für den Erwerb von Assets erheblich gesenkt und die Zeit verkürzt werden Gesamtproduktion Der Zyklus bietet Benutzern auch technische Möglichkeiten, Tausende personalisierter visueller Erlebnisse zu bieten. Für normale Benutzer wird das Aufkommen schneller und praktischer Tools zur Erstellung von 3D-Inhalten in Kombination mit Anwendungen wie Desktop-3D-Druckern in Zukunft mehr unbegrenzte Fantasie in das Unterhaltungsleben normaler Verbraucher bringen.

Obwohl normale Benutzer derzeit problemlos 2D-Inhalte wie Bilder und Videos über Geräte wie tragbare Kameras erstellen und sogar 3D-Szenen modellieren und scannen können, erfordert die Erstellung hochwertiger 3D-Inhalte im Allgemeinen häufig erfahrene Fachleute Verwenden Sie zum manuellen Modellieren und Rendern Software wie 3ds Max, Maya, Blender usw., diese sind jedoch mit hohen Lernkosten und steilen Wachstumskurven verbunden.

Einer der Hauptgründe ist, dass der Ausdruck dreidimensionaler Inhalte sehr komplex ist, wie etwa geometrische Modelle, Texturkarten oder Charakterskelettanimationen. Selbst in Bezug auf den geometrischen Ausdruck kann es in verschiedenen Formen vorliegen, z. B. in Punktwolken, Voxeln und Netzen. Die Komplexität des dreidimensionalen Ausdrucks schränkt die nachfolgende Datenerfassung und das Algorithmusdesign erheblich ein.

Andererseits sind 3D-Daten naturgemäß rar und die Kosten für die Datenerfassung sind oft hoch. Sie erfordern oft teure Ausrüstung und komplexe Erfassungsprozesse und es ist schwierig, große Mengen an 3D-Daten in einem einheitlichen Format zu erfassen . Dies macht die Verwendung der meisten datengesteuerten tiefen generativen Modelle schwierig.

Auf Algorithmusebene ist es ebenfalls ein schwer zu lösendes Problem, wie die gesammelten dreidimensionalen Daten in das Berechnungsmodell eingespeist werden. Der Rechenleistungsaufwand der dreidimensionalen Datenverarbeitung ist exponentiell höher als der von zweidimensionalen Daten. Die gewaltsame Erweiterung des zweidimensionalen Generierungsalgorithmus auf drei Dimensionen ist selbst für die fortschrittlichsten parallelen Rechenprozessoren schwierig, sie innerhalb einer akzeptablen Zeit zu verarbeiten.

Aus den oben genannten Gründen sind die meisten aktuellen Arbeiten zur Generierung von 3D-Inhalten auf eine bestimmte Kategorie beschränkt oder können nur Inhalte mit niedrigerer Auflösung generieren, was es schwierig macht, sie auf reale Produktionsprozesse anzuwenden.

Um die oben genannten Probleme zu lösen, Chen Baoquans Team von der Universität Peking hat sich mit Forschern der Shandong-Universität und des Tencent AI Lab zusammengetan, um die erste Methode zur Generierung verschiedener hochwertiger 3D-Szenen auf der Grundlage einer einzigen Beispielszene vorzuschlagen ohne Training. Dieser Algorithmus hat die folgenden Vorteile:

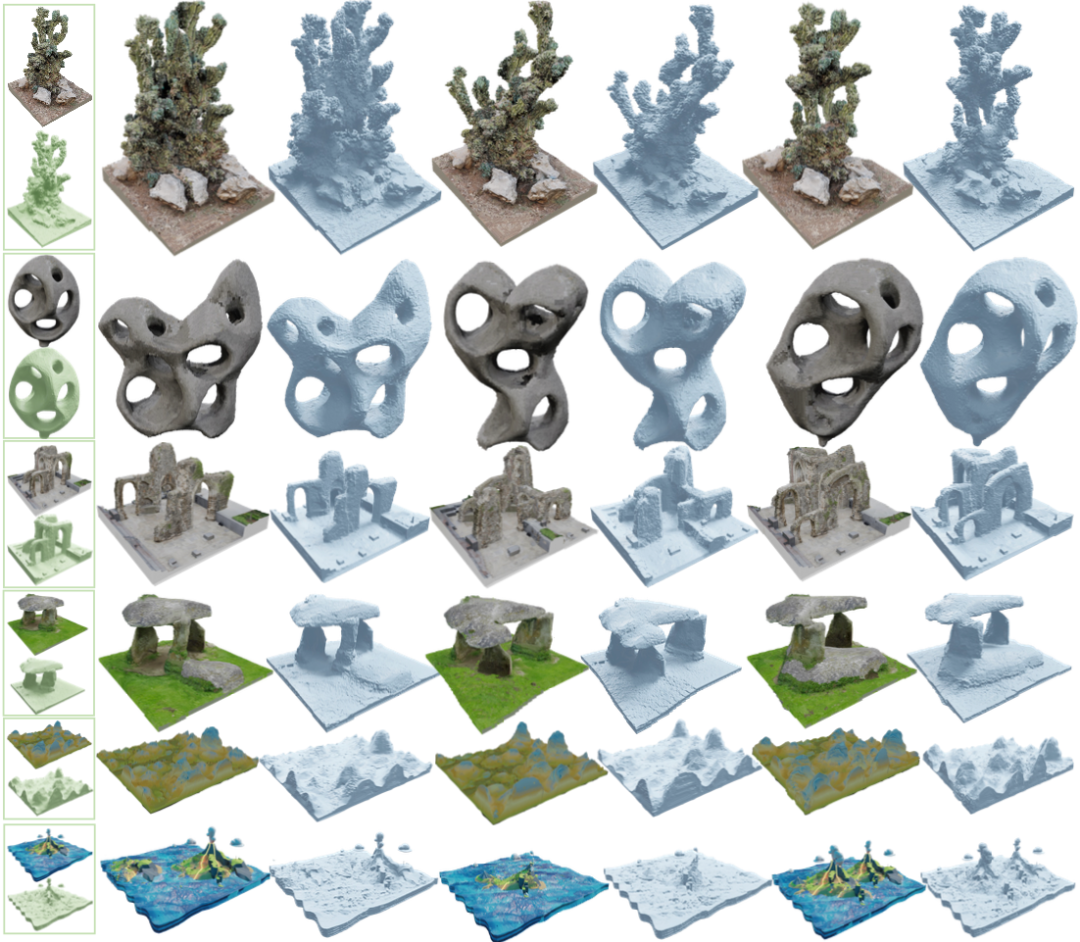

1 Er erfordert keine umfangreichen ähnlichen Trainingsdaten und kann mit nur einem einzigen Beispiel schnell hochwertige dreidimensionale Szenen erzeugen 2. Plenoxels basierend auf neuronalen Strahlungsfeldern werden als dreidimensionaler Ausdruck verwendet. Die Szene hat ein sehr realistisches Erscheinungsbild und kann fotorealistische Multi-View-Bilder wiedergeben. Die generierte Szene behält außerdem alle Eigenschaften der Probe perfekt bei, z. B. den Effekt der Reflexion auf der Wasseroberfläche, der sich mit dem Betrachtungswinkel ändert 3, und unterstützt eine Vielzahl von Anwendungsproduktionsszenarien, z. B. die Bearbeitung von 3D-Szenen. Größenumleitung, Szenenstruktur-Analogie und sich änderndes Szenenerscheinungsbild usw. Die Forscher schlugen ein mehrskaliges progressives Generationsframework vor, wie in der folgenden Abbildung dargestellt. Die Kernidee des Algorithmus besteht darin, die Beispielszene in mehrere Blöcke zu zerlegen, Gaußsches Rauschen einzuführen und sie dann auf ähnliche Weise wie Bausteine wieder zu ähnlichen neuen Szenen zusammenzusetzen. Der Autor verwendet ein Koordinaten-Mapping-Feld, einen Ausdruck, der mit Samples heterogen ist, um die generierte Szene darzustellen, wodurch eine qualitativ hochwertige Generierung möglich wird. Um den Optimierungsprozess des Algorithmus robuster zu machen, schlägt diese Studie auch eine Optimierungsmethode vor, die auf einer Mischung aus Werten und Koordinaten basiert. Um gleichzeitig das Problem des massiven Ressourcenverbrauchs bei dreidimensionalen Berechnungen zu lösen, verwendet diese Forschung eine genaue, annähernde Optimierungsstrategie, die die Generierung hochwertiger neuer Szenen in wenigen Minuten ohne jegliche Schulung ermöglicht. Weitere technische Details finden Sie im Originalpapier. Zufällige Szenengenerierung . Mit dieser Methode können Objekte mit komplexer Topologie wie Kakteen, Bögen und Steinbänken verarbeitet werden, und die generierten Szenen bewahren perfekt die feine Geometrie und das hochwertige Erscheinungsbild der Beispielszenen. Kein aktuelles generatives Modell auf Basis neuronaler Netze erreicht eine vergleichbare Qualität und Vielfalt. Hochauflösende große Szenengenerierung Diese Methode kann effizient extrem hochauflösende dreidimensionale Inhalte generieren. Wie oben gezeigt, können wir einen Teil „Tausend Meilen von Flüssen und Bergen“ mit einer Auflösung von 1328 x 512 x 200 erzeugen, indem wir einen einzelnen Teil des dreidimensionalen Teils „Tausende Meilen von Flüssen und Bergen“ mit einer Auflösung von 512 x 512 x eingeben 200 in der oberen linken Ecke und rendern Sie 4096 x 1024 2D-Mehrfachansichtsbilder mit hoher Auflösung. Einführung in die Methode

Reale grenzenlose Szenengenerierung

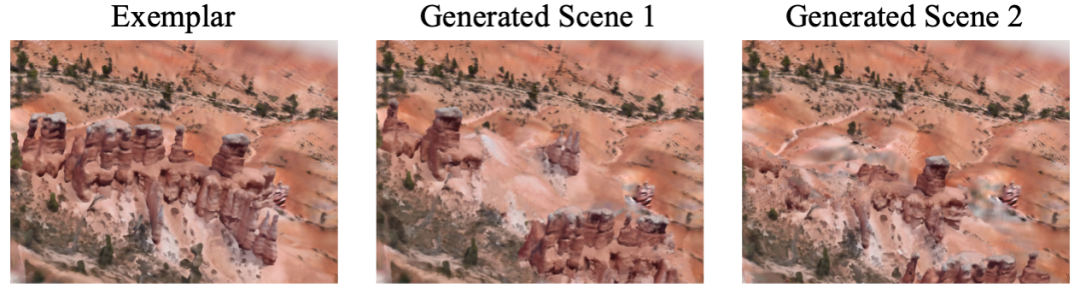

Der Autor hat die vorgeschlagene Generierungsmethode auch an realen natürlichen Szenen überprüft. Durch die Verwendung einer NeRF++-ähnlichen Verarbeitungsmethode können nach expliziter Trennung von Vordergrund und Hintergrund wie dem Himmel und separater Generierung des Vordergrundinhalts neue Szenen in randlosen Szenen in der realen Welt generiert werden.

andere Anwendungsszenarien

Scene bearbeiten

Verwendung des gleichen Algorithmus-Frameworks derselben Generation, indem künstlich angegebene Beschränkungen hinzugefügt werden, können Objekte in der dreidimensionalen Szene gelöscht und gelöscht und gelöscht werden und gelöscht werden. kopiert und Änderungen und andere Bearbeitungsvorgänge. Wie im Bild gezeigt, können Sie den Berg aus der Szene entfernen und die Löcher automatisch füllen, ihn duplizieren, um drei Gipfel zu erstellen, oder den Berg vergrößern.

Größenumleitung

Mit dieser Methode können auch dreidimensionale Objekte gedehnt oder gestaucht werden, während ihre lokale Form erhalten bleibt. Der grüne Rahmen im Bild zeigt die ursprüngliche Beispielszene, die einen dreidimensionalen Zug verlängert und dabei die lokale Größe des Fensters beibehält.

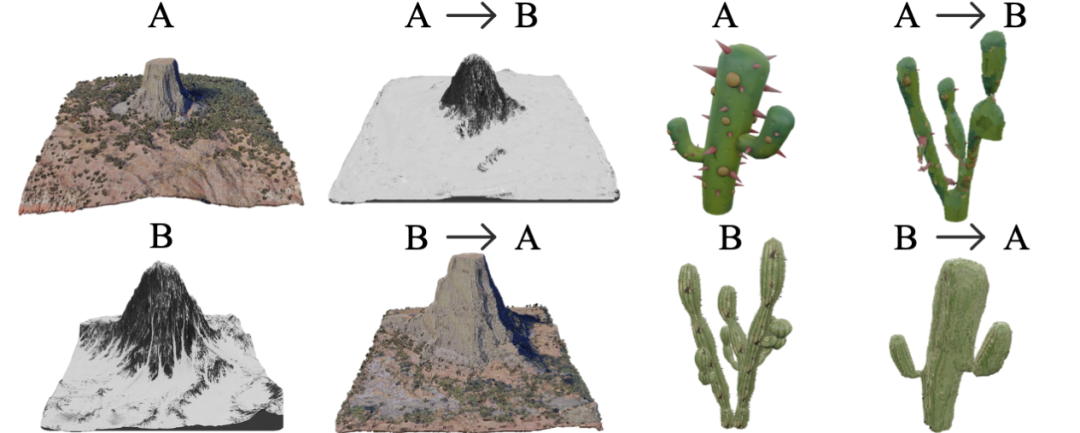

Die Generierung von Strukturanalogien

ähnelt der Bildstilübertragung. Bei zwei Szenen A und B können wir eine Szene erstellen, die das Aussehen und die geometrischen Eigenschaften von A aufweist. aber die Struktur Ein neues Szenario ähnlich wie B. Beispielsweise können wir uns auf einen Schneeberg beziehen, um einen anderen Berg in einen dreidimensionalen Schneeberg zu verwandeln.

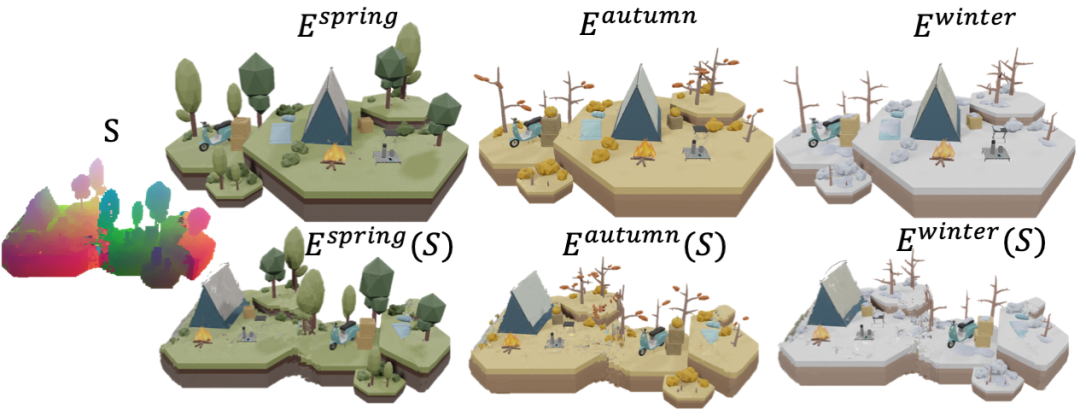

Beispielszenen ersetzen

Da diese Methode einen heterogenen Ausdruck für generierte Szenen verwendet, können durch einfaches Ändern der zugeordneten Beispielszenen vielfältigere neue Szenen generiert werden. Durch die Verwendung desselben generierten Szenenkartierungsfelds S zum Kartieren von Szenen zu unterschiedlichen Zeiten oder Jahreszeiten können beispielsweise umfassendere Generierungsergebnisse erzielt werden.

Diese Arbeit ist auf den Bereich der 3D-Inhaltsgenerierung ausgerichtet. Sie schlägt erstmals ein 3D-Modell zur Generierung natürlicher Szenen vor, das auf einer einzelnen Stichprobe basiert und versucht, die großen Datenanforderungen der aktuellen 3D-Generierungsmethode zu lösen Rechenleistungsaufwand, schlechte Erzeugungsqualität usw. Diese Arbeit konzentriert sich auf allgemeinere Naturszenen mit schwachen semantischen Informationen und legt mehr Wert auf die Vielfalt und Qualität der generierten Inhalte. Der Algorithmus ist hauptsächlich von Technologien im Zusammenhang mit der Texturbilderzeugung in der herkömmlichen Computergrafik inspiriert und kann in Kombination mit dem aktuellen neuronalen Strahlungsfeld schnell hochwertige dreidimensionale Szenen erzeugen und hat eine Vielzahl praktischer Anwendungen demonstriert.

Diese Arbeit ist äußerst vielseitig und kann nicht nur mit aktuellen neuronalen Ausdrücken kombiniert werden, sondern ist auch auf traditionelle geometrische Ausdrücke der Rendering-Pipeline anwendbar, wie z. B. polygonale Netze (Mesh). Während wir uns auf große Datenmengen und Modelle konzentrieren, sollten wir von Zeit zu Zeit auch traditionelle Grafiktools überprüfen. Forscher glauben, dass im Bereich der 3D-AIGC in naher Zukunft traditionelle Grafiktools in Kombination mit hochwertigen neuronalen Ausdrücken und leistungsstarken Generierungsmodellen weitere brillante Funken erzeugen werden, was die Qualität und Geschwindigkeit der 3D-Inhaltsgenerierung weiter fördert und die Kreativität der Menschen freisetzt .

Diese Forschung wurde von der Mehrheit der Internetnutzer diskutiert:

Einige Internetnutzer sagten: (Diese Forschung) eignet sich hervorragend für die Spieleentwicklung, da durch die einfache Modellierung eines einzelnen Modells viele neue Versionen generiert werden können.

Einige Leute stimmen dem oben genannten Standpunkt voll und ganz zu, Spieleentwickler, Einzelpersonen und kleine Unternehmen können von dieser Art von Modell Hilfe erhalten.

Das obige ist der detaillierte Inhalt von3D-Szenengenerierung: Generieren Sie vielfältige Ergebnisse aus einer einzigen Probe, ohne dass ein neuronales Netzwerktraining erforderlich ist. Für weitere Informationen folgen Sie bitte anderen verwandten Artikeln auf der PHP chinesischen Website!

So kaufen Sie echte Ripple-Münzen

So kaufen Sie echte Ripple-Münzen

Spleißverwendung

Spleißverwendung

So handeln Sie auf Binance

So handeln Sie auf Binance

Empfohlene Datenanalyse-Websites

Empfohlene Datenanalyse-Websites

Kopfzeile entfernen

Kopfzeile entfernen

Daten von der mobilen Festplatte wiederherstellen

Daten von der mobilen Festplatte wiederherstellen

Methode zur Stornierung der Benutzerkontensteuerung

Methode zur Stornierung der Benutzerkontensteuerung

So entsperren Sie die Passwortsperre auf Ihrem Apple-Telefon, wenn Sie sie vergessen

So entsperren Sie die Passwortsperre auf Ihrem Apple-Telefon, wenn Sie sie vergessen

vue v-wenn

vue v-wenn