Technologie-Peripheriegeräte

Technologie-Peripheriegeräte

KI

KI

LLaMA schlagen? Die Rangliste des mächtigsten „Falken' in der Geschichte ist fraglich. Fu Yao hat sieben Codezeilen persönlich getestet und LeCun hat sie als „Gefällt mir' weitergeleitet

LLaMA schlagen? Die Rangliste des mächtigsten „Falken' in der Geschichte ist fraglich. Fu Yao hat sieben Codezeilen persönlich getestet und LeCun hat sie als „Gefällt mir' weitergeleitet

LLaMA schlagen? Die Rangliste des mächtigsten „Falken' in der Geschichte ist fraglich. Fu Yao hat sieben Codezeilen persönlich getestet und LeCun hat sie als „Gefällt mir' weitergeleitet

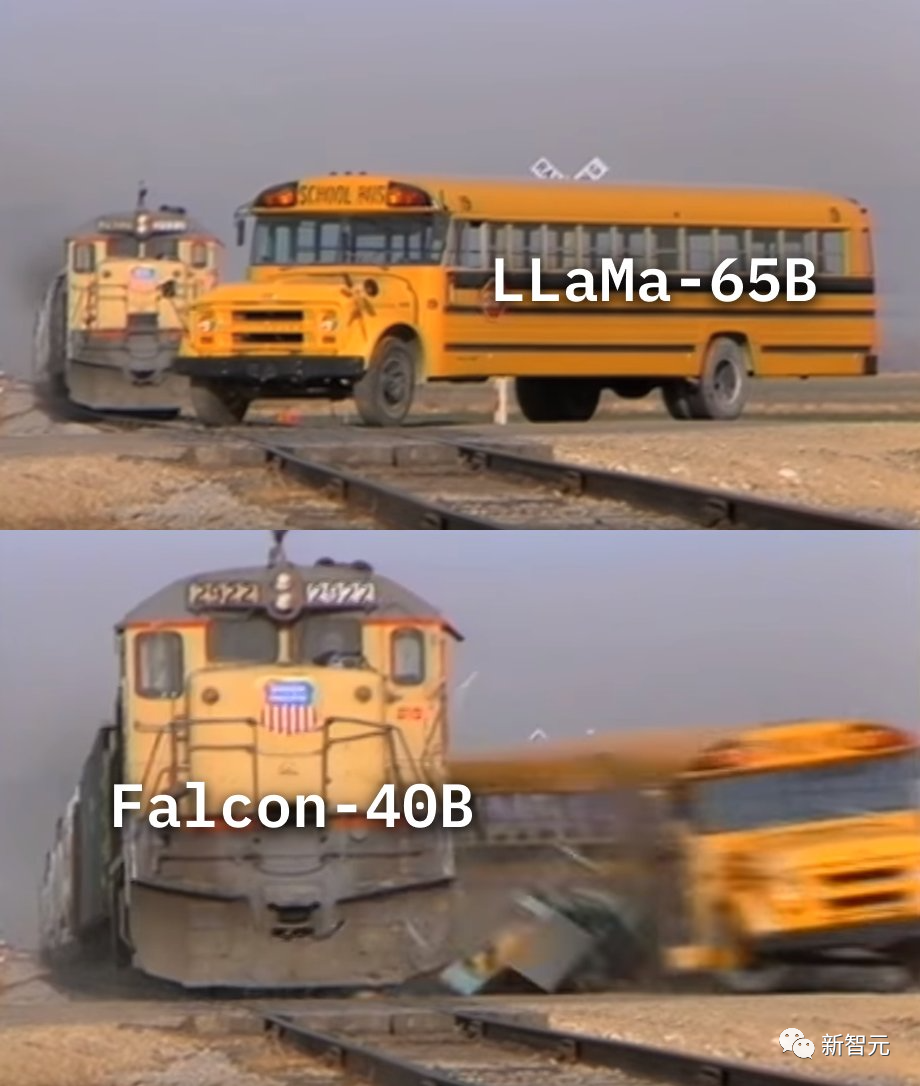

Vor einiger Zeit verdrängte der junge Falcon LLaMA in der LLM-Rangliste und löste damit Wellen in der gesamten Community aus.

Aber ist Falcon wirklich besser als LLaMA?

Kurze Antwort: Wahrscheinlich nicht.

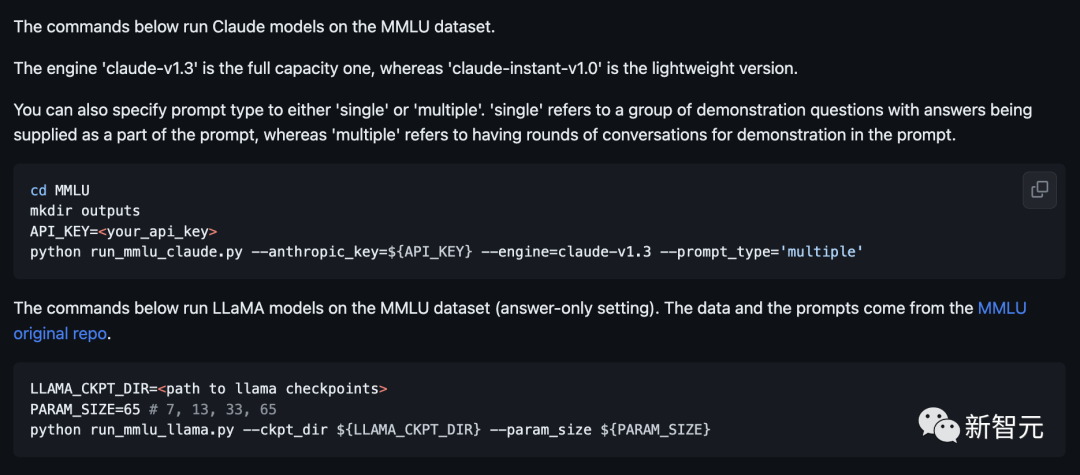

Das Team von Fu Yao hat eine detailliertere Bewertung des Modells vorgenommen:

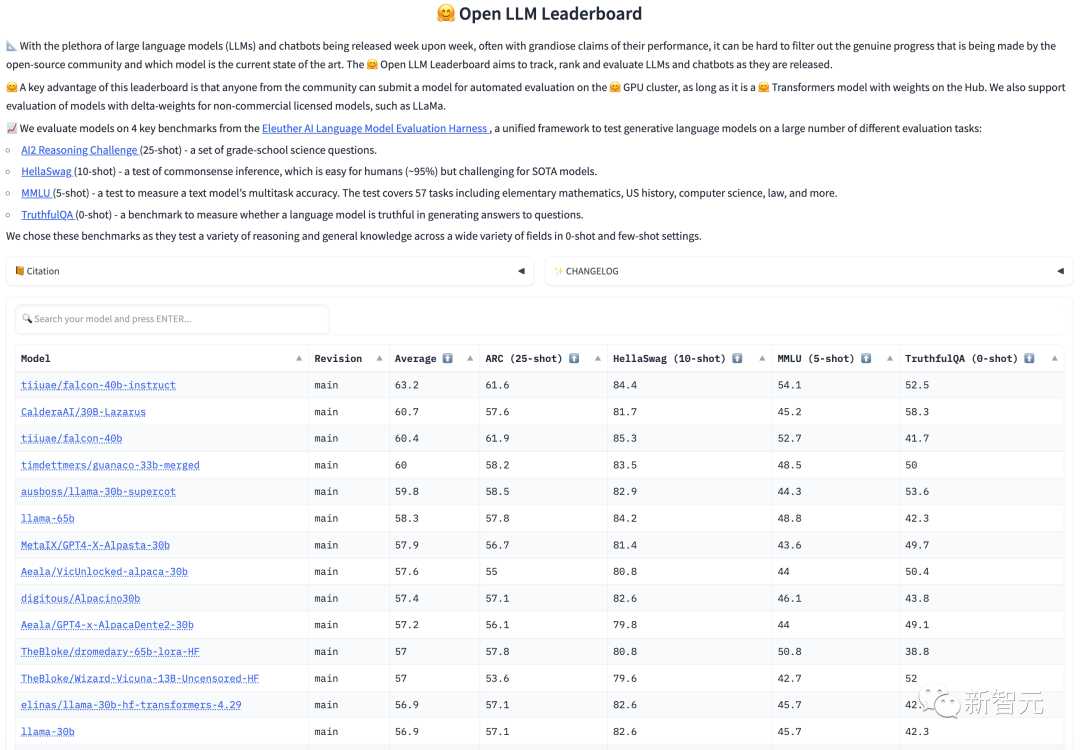

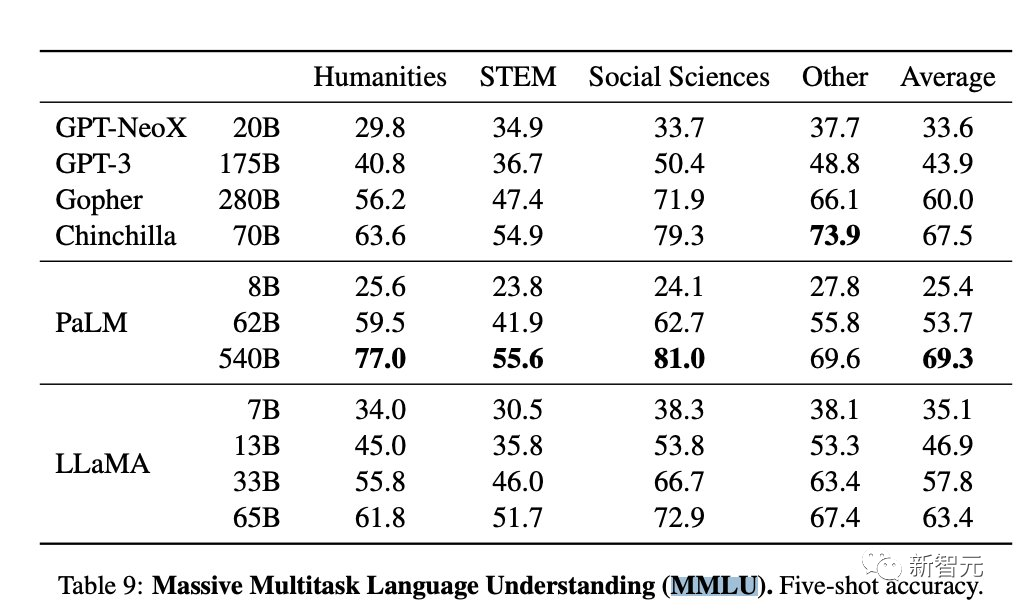

„Wir haben die Bewertung von LLaMA 65B auf MMLU reproduziert und einen Wert von 61,4 erhalten, was nahe am offiziellen Wert liegt.“ (63,4). Viel höher als die Punktzahl im Open LLM Leaderboard (48,8) und deutlich höher als die des Falcon (52,7).

Derzeit wurden der Code und die Testmethoden auf Github veröffentlicht.

Es bestehen Zweifel daran, dass Falcon LLaMA übertrifft, LeCun äußerte seine Position, das Problem des Testskripts ...

Die wahre Stärke von LLaMA

Manche Menschen haben jedoch ihre Zweifel.

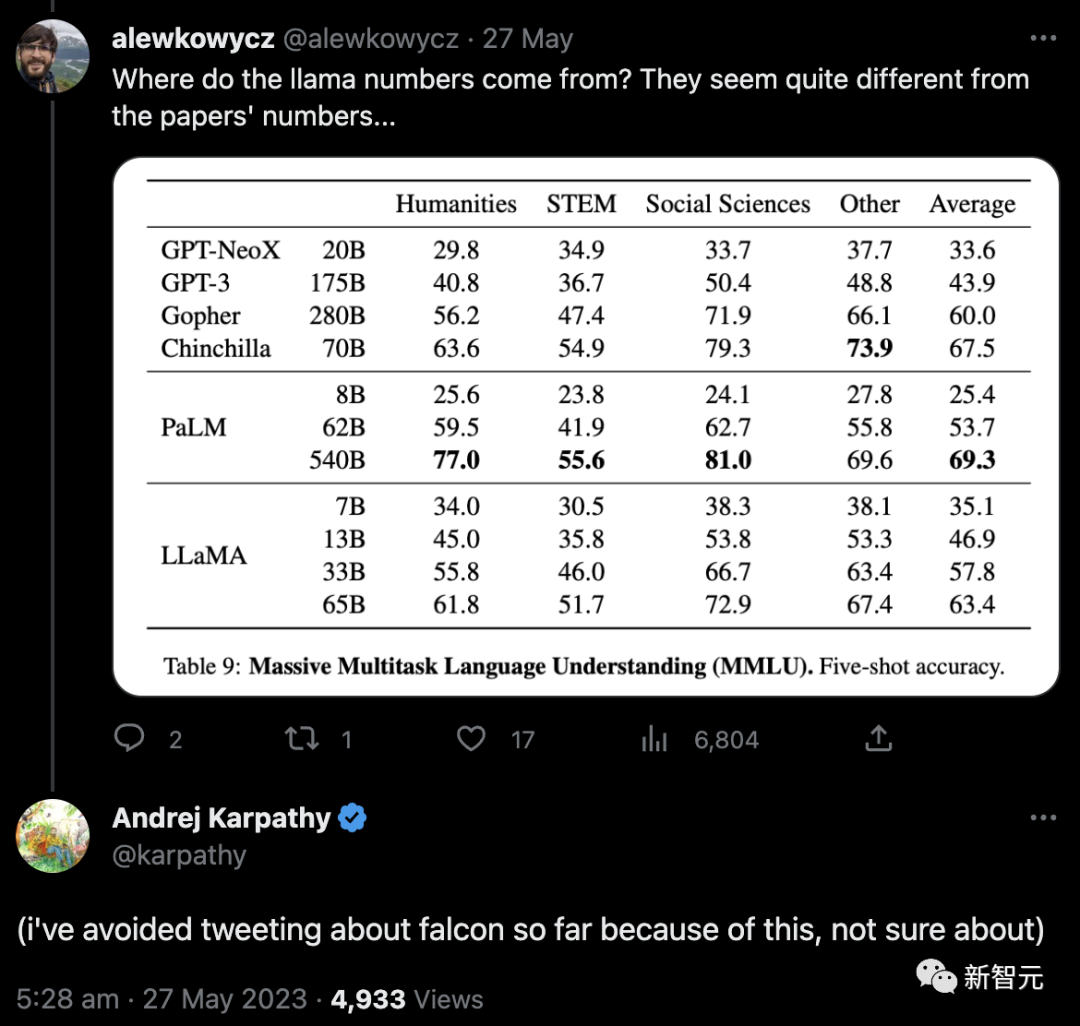

Zuerst fragte ein Internetnutzer, woher diese LLaMA-Zahlen kämen. Sie schienen nicht mit den Papierzahlen übereinzustimmen ...

Später fragte OpenAI-Wissenschaftler Andrej Karpathy auch, warum LLaMA 65B in der Open LLM-Rangliste steht Die Punktzahl lag deutlich unter der offiziellen (48,8 vs. 63,4), um ihre Besorgnis auszudrücken.

Und beim Posten habe ich es aus diesem Grund bisher vermieden, über Falcons zu twittern, ich bin mir nicht sicher.

Um dieses Problem zu klären, beschlossen Fu Yao und seine Teammitglieder, einen öffentlichen Test auf LLaMA 65B durchzuführen, und das Ergebnis war 61,4 Punkte.

Im Test verwendeten die Forscher keinen besonderen Mechanismus und LLaMA 65B konnte diesen Wert erreichen.

Dieses Ergebnis beweist nur, dass es am besten ist, RLHF auf LLaMA 65B zu verwenden, wenn Sie möchten, dass das Modell ein Niveau nahe GPT-3,5 erreicht.

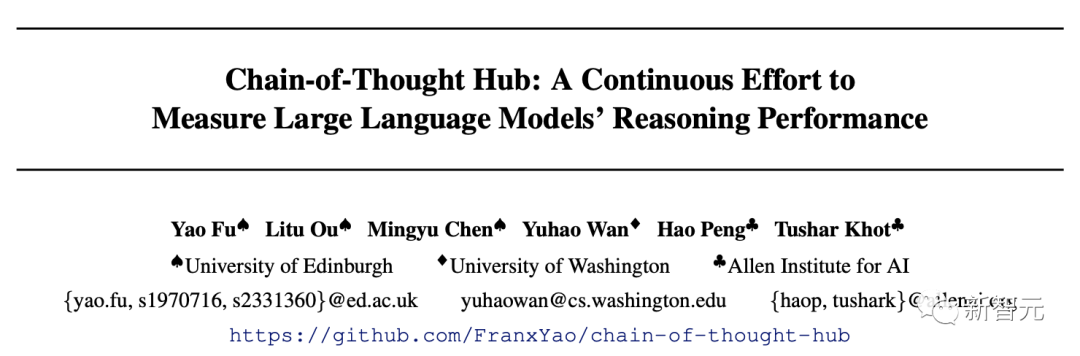

Basierend auf den Ergebnissen eines Chain-of-Thought Hub-Artikels, der kürzlich von Fu Yaos Team veröffentlicht wurde.

Natürlich sagte Fu Yao, dass ihre Bewertung nicht dazu gedacht war, einen Streit zwischen LLaMA und Falcon auszulösen. Schließlich handelt es sich um großartige Open-Source-Modelle, die einen wesentlichen Beitrag zu diesem Bereich geleistet haben!

Darüber hinaus verfügt Falcon über eine komfortablere Lizenz, was ihm auch großes Entwicklungspotenzial bietet.

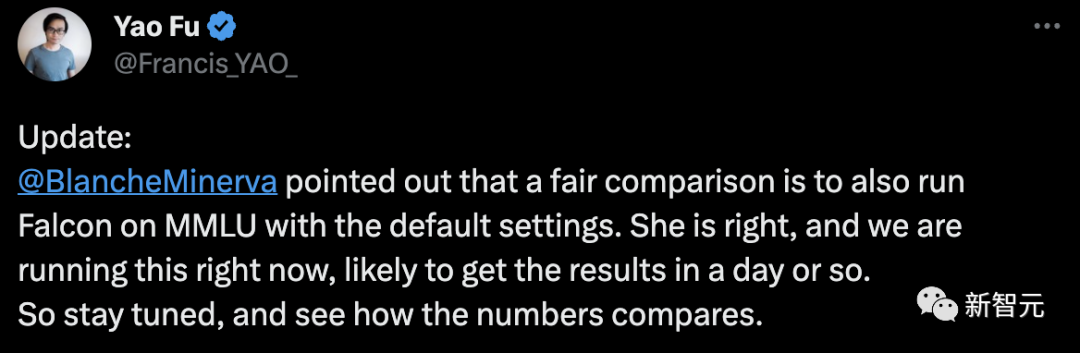

Für diese neueste Rezension wies Netizen BlancheMinerva darauf hin, dass ein fairer Vergleich darin bestehen würde, Falcon auf MMLU mit Standardeinstellungen auszuführen.

Als Antwort sagte Fu Yao, dass dies richtig sei und daran gearbeitet werde und dass die Ergebnisse voraussichtlich in einem Tag vorliegen würden.

Egal wie das Endergebnis ausfällt, Sie müssen wissen, dass der Berg von GPT-4 das Ziel ist, das die Open-Source-Community wirklich verfolgen möchte.

OpenLLM-Ranking-Problem

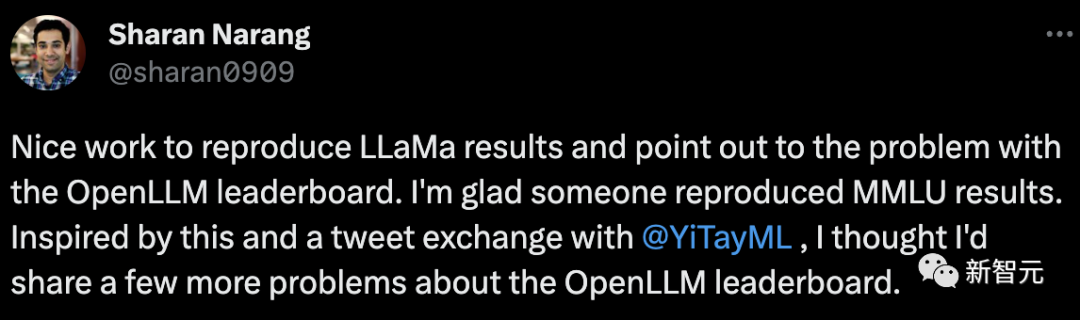

Forscher von Meta lobten Fu Yao für die gute Wiedergabe der Ergebnisse von LLaMa und wiesen auf das Problem des OpenLLM-Rankings hin.

Gleichzeitig stellte er auch einige Fragen zum OpenLLM-Ranking.

Erstens die MMLU-Ergebnisse: LLaMa 65B MMLU-Ergebnisse sind 15 Punkte auf der Bestenliste, aber das Gleiche gilt für das 7B-Modell. Es gibt auch einen kleinen Leistungsunterschied zwischen den Modellen 13B und 30B.

OpenLLM muss sich das unbedingt ansehen, bevor es bekannt gibt, welches Modell das beste ist.

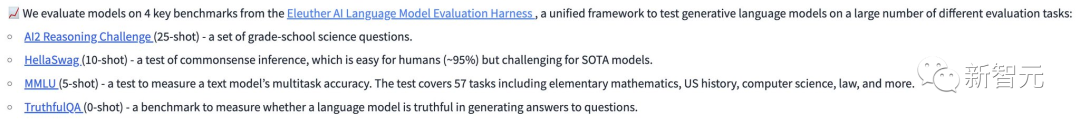

Benchmarks: Wie werden diese Benchmarks ausgewählt?

ARC 25-Schuss und Hellaswag 10-Schuss scheinen für LLM nicht besonders relevant zu sein. Noch besser wäre es, wenn einige generative Benchmarks einbezogen werden könnten. Obwohl generative Benchmarks ihre Grenzen haben, können sie dennoch nützlich sein.

Einzelne Durchschnittspunktzahl: Es ist immer verlockend, die Ergebnisse auf eine einzige Punktzahl zu reduzieren, und die Durchschnittspunktzahl ist am einfachsten.

Aber ist in diesem Fall der Durchschnitt von 4 Benchmarks wirklich nützlich? Ist 1 Punkt bei MMLU dasselbe wie 1 Punkt bei HellaSwag?

In der Welt der schnellen Iteration von LLM ist die Entwicklung einer solchen Rangliste definitiv von Nutzen.

Und auch Lucas Beyer, ein Forscher von Google, äußerte seine Meinung:

Das Verrückte ist, dass NLP-Forscher unterschiedliche Verständnisse für denselben Maßstab haben und dadurch zu völlig unterschiedlichen Ergebnissen führen. Gleichzeitig frage ich einen meiner Kollegen jedes Mal, wenn er eine Metrik implementiert, sofort, ob er tatsächlich prüft, ob der offizielle Code perfekt reproduziert wird, und wenn nicht, verwerfe ich seine Ergebnisse.

Außerdem sagte er, dass meines Wissens unabhängig vom Modell die Ergebnisse des ursprünglichen Benchmarks nicht wirklich reproduziert werden.

Die Internetnutzer wiederholten, dass dies die Realität des LLM-Benchmarks sei …

Falcon – Open Source, im Handel erhältlich, starke Leistung

Apropos Falcon: Es ist tatsächlich unserer Bewertung wert .

Laut LeCun ist Open Source im Zeitalter großer Modelle am wichtigsten.

Nachdem der LLaMA-Code von Meta durchgesickert war, begannen Entwickler aus allen Gesellschaftsschichten, ihn eifrig auszuprobieren.

Falcon ist eine erstaunliche Waffe, die vom Technology Innovation Institute (TII) in Abu Dhabi, Vereinigte Arabische Emirate, entwickelt wurde.

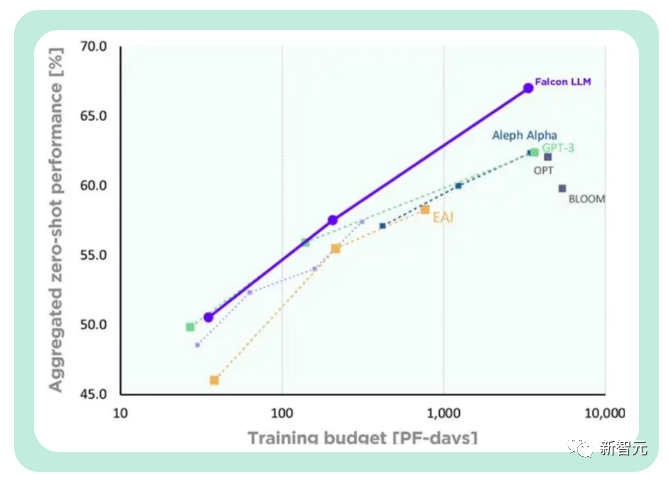

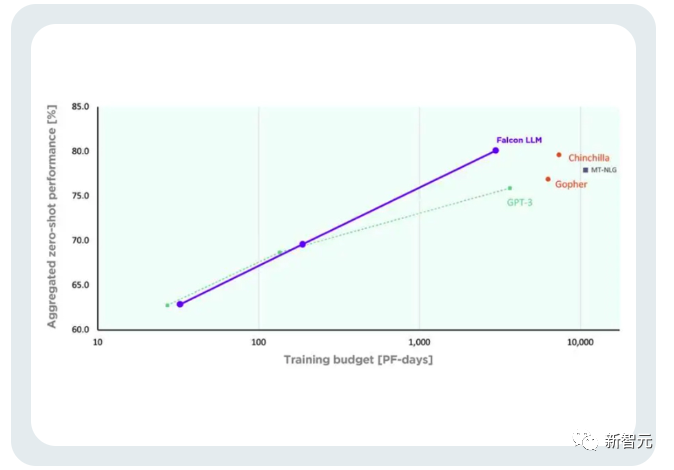

In Bezug auf die Leistung schnitt Falcon bei der Erstveröffentlichung besser ab als LLaMA.

Derzeit gibt es „Falcon“ in drei Versionen – 1B, 7B und 40B.

TII sagte, Falcon sei das bislang leistungsstärkste Open-Source-Sprachmodell. Seine größte Version, Falcon 40B, verfügt über 40 Milliarden Parameter und ist damit immer noch etwas kleiner als LLaMA mit 65 Milliarden Parametern.

Allerdings hat TII zuvor erklärt, dass Falcon trotz seiner geringen Größe eine großartige Leistung bietet.

Faisal Al Bannai, Generalsekretär des Advanced Technology Research Council (ATRC), glaubt, dass die Veröffentlichung von „Falcon“ die Erwerbsmethode von LLM durchbrechen und es Forschern und Unternehmern ermöglichen wird, die innovativsten Anwendungsfälle vorzuschlagen.

Zwei Versionen von FalconLM, Falcon 40B Instruct und Falcon 40B, belegen die ersten beiden der Hugging Face OpenLLM-Rangliste, während Metas LLaMA auf dem dritten Platz liegt.

Und genau das ist das Problem mit den oben genannten Rankings.

Obwohl das „Falcon“-Papier noch nicht öffentlich veröffentlicht wurde, wurde Falcon 40B umfassend anhand eines sorgfältig geprüften 1-Billion-Token-Netzwerkdatensatzes trainiert.

Forscher haben herausgefunden, dass „Falcon“ großen Wert darauf legt, während des Trainingsprozesses eine hohe Leistung bei großen Datenmengen zu erzielen.

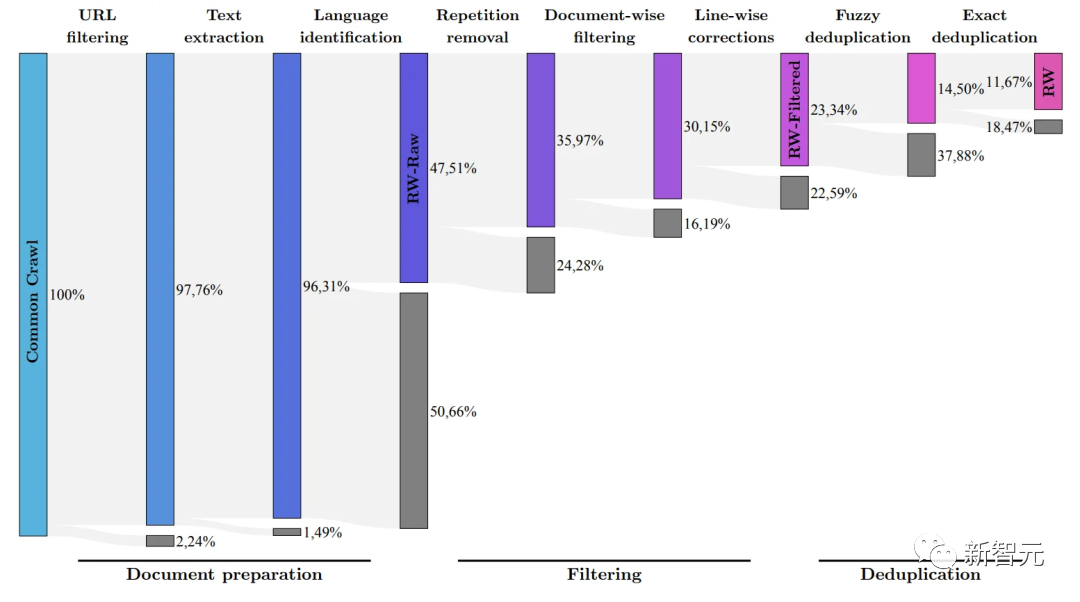

Was wir alle wissen ist, dass LLM sehr empfindlich auf die Qualität von Trainingsdaten reagiert, weshalb Forscher viel Mühe darauf verwenden, eine Datenpipeline aufzubauen, die eine effiziente Verarbeitung auf Zehntausenden von CPU-Kernen durchführen kann.

Der Zweck besteht darin, durch Filterung und Deduplizierung hochwertige Inhalte aus dem Internet zu extrahieren.

Derzeit hat TII einen verfeinerten Netzwerkdatensatz veröffentlicht, bei dem es sich um einen sorgfältig gefilterten und deduplizierten Datensatz handelt. Die Praxis hat gezeigt, dass es sehr effektiv ist.

Das Modell, das nur mit diesem Datensatz trainiert wird, kann mit anderen LLMs mithalten oder diese sogar in der Leistung übertreffen. Dies zeigt die hervorragende Qualität und den Einfluss von „Falcon“.

Darüber hinaus ist das Falcon-Modell auch mehrsprachig.

Es versteht Englisch, Deutsch, Spanisch und Französisch und beherrscht auch einige kleine europäische Sprachen wie Niederländisch, Italienisch, Rumänisch, Portugiesisch, Tschechisch, Polnisch und Schwedisch.

Falcon 40B ist nach der Veröffentlichung des H2O.ai-Modells auch das zweite wirklich Open-Source-Modell.

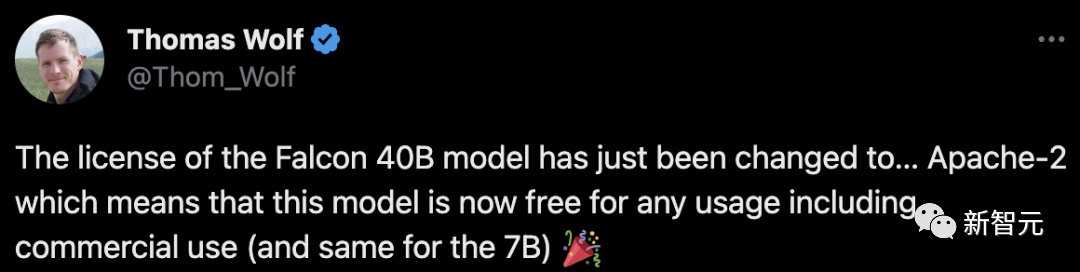

Darüber hinaus gibt es noch einen weiteren sehr wichtigen Punkt – Falcon ist derzeit das einzige Open-Source-Modell, das kommerziell kostenlos genutzt werden kann.

Zu Beginn verlangte TII, dass eine „Nutzungssteuer“ von 10 % erhoben wird, wenn Falcon für kommerzielle Zwecke genutzt wird und mehr als 1 Million US-Dollar an anrechenbarem Einkommen generiert.

Aber es dauerte nicht lange, bis die reichen Magnaten des Nahen Ostens diese Einschränkung aufhoben.

Zumindest vorerst wird die gesamte kommerzielle Nutzung und Feinabstimmung von Falcon kostenlos sein.

Die Reichen sagten, dass sie mit diesem Modell vorerst kein Geld verdienen müssen.

Darüber hinaus wirbt TII auch um Kommerzialisierungspläne aus der ganzen Welt.

Für potenzielle wissenschaftliche Forschungs- und Kommerzialisierungslösungen werden sie auch mehr „Trainingsrechenleistungsunterstützung“ bereitstellen oder weitere Kommerzialisierungsmöglichkeiten bieten.

Das heißt einfach: Solange das Projekt gut ist, ist das Modell kostenlos! Genug Rechenleistung! Wenn Sie nicht genug Geld haben, können wir es trotzdem für Sie einsammeln!

Für Start-ups ist dies einfach eine „One-Stop-Lösung für KI-Großmodell-Unternehmertum“ vom Nahost-Tycoon.

Ein wichtiger Aspekt des Wettbewerbsvorteils von FalconLM ist laut dem Entwicklungsteam die Auswahl der Trainingsdaten.

Das Forschungsteam hat einen Prozess entwickelt, um hochwertige Daten aus öffentlich gecrawlten Datensätzen zu extrahieren und doppelte Daten zu entfernen.

Nach der gründlichen Bereinigung redundanter und doppelter Inhalte blieben 5 Billionen Token erhalten – genug, um ein leistungsstarkes Sprachmodell zu trainieren.

Der 40B Falcon LM verwendet 1 Billion Token für das Training, und die 7B-Version des Modell-Trainingstokens erreicht 1,5 Billionen.

(Ziel des Forschungsteams ist es, mithilfe des RefinedWeb-Datensatzes nur Rohdaten höchster Qualität aus Common Crawl herauszufiltern)

Darüber hinaus sind die Trainingskosten von Falcon relativ besser kontrollierbar.

TII sagte, dass Falcon im Vergleich zu GPT-3 erhebliche Leistungsverbesserungen erzielte und dabei nur 75 % des Trainings-Rechenbudgets nutzte.

Und während der Inferenz werden nur 20 % der Rechenzeit benötigt, wodurch eine effiziente Nutzung der Rechenressourcen erfolgreich erreicht wird.

Das obige ist der detaillierte Inhalt vonLLaMA schlagen? Die Rangliste des mächtigsten „Falken' in der Geschichte ist fraglich. Fu Yao hat sieben Codezeilen persönlich getestet und LeCun hat sie als „Gefällt mir' weitergeleitet. Für weitere Informationen folgen Sie bitte anderen verwandten Artikeln auf der PHP chinesischen Website!

Heiße KI -Werkzeuge

Undresser.AI Undress

KI-gestützte App zum Erstellen realistischer Aktfotos

AI Clothes Remover

Online-KI-Tool zum Entfernen von Kleidung aus Fotos.

Undress AI Tool

Ausziehbilder kostenlos

Clothoff.io

KI-Kleiderentferner

AI Hentai Generator

Erstellen Sie kostenlos Ai Hentai.

Heißer Artikel

Heiße Werkzeuge

Notepad++7.3.1

Einfach zu bedienender und kostenloser Code-Editor

SublimeText3 chinesische Version

Chinesische Version, sehr einfach zu bedienen

Senden Sie Studio 13.0.1

Leistungsstarke integrierte PHP-Entwicklungsumgebung

Dreamweaver CS6

Visuelle Webentwicklungstools

SublimeText3 Mac-Version

Codebearbeitungssoftware auf Gottesniveau (SublimeText3)

Heiße Themen

1377

1377

52

52

Das weltweit leistungsstärkste Open-Source-MoE-Modell ist da, mit chinesischen Fähigkeiten, die mit GPT-4 vergleichbar sind, und der Preis beträgt nur fast ein Prozent von GPT-4-Turbo

May 07, 2024 pm 04:13 PM

Das weltweit leistungsstärkste Open-Source-MoE-Modell ist da, mit chinesischen Fähigkeiten, die mit GPT-4 vergleichbar sind, und der Preis beträgt nur fast ein Prozent von GPT-4-Turbo

May 07, 2024 pm 04:13 PM

Stellen Sie sich ein Modell der künstlichen Intelligenz vor, das nicht nur die Fähigkeit besitzt, die traditionelle Datenverarbeitung zu übertreffen, sondern auch eine effizientere Leistung zu geringeren Kosten erzielt. Dies ist keine Science-Fiction, DeepSeek-V2[1], das weltweit leistungsstärkste Open-Source-MoE-Modell, ist da. DeepSeek-V2 ist ein leistungsstarkes MoE-Sprachmodell (Mix of Experts) mit den Merkmalen eines wirtschaftlichen Trainings und einer effizienten Inferenz. Es besteht aus 236B Parametern, von denen 21B zur Aktivierung jedes Markers verwendet werden. Im Vergleich zu DeepSeek67B bietet DeepSeek-V2 eine stärkere Leistung, spart gleichzeitig 42,5 % der Trainingskosten, reduziert den KV-Cache um 93,3 % und erhöht den maximalen Generierungsdurchsatz auf das 5,76-fache. DeepSeek ist ein Unternehmen, das sich mit allgemeiner künstlicher Intelligenz beschäftigt

KI untergräbt die mathematische Forschung! Der Gewinner der Fields-Medaille und der chinesisch-amerikanische Mathematiker führten 11 hochrangige Arbeiten an | Gefällt mir bei Terence Tao

Apr 09, 2024 am 11:52 AM

KI untergräbt die mathematische Forschung! Der Gewinner der Fields-Medaille und der chinesisch-amerikanische Mathematiker führten 11 hochrangige Arbeiten an | Gefällt mir bei Terence Tao

Apr 09, 2024 am 11:52 AM

KI verändert tatsächlich die Mathematik. Vor kurzem hat Tao Zhexuan, der diesem Thema große Aufmerksamkeit gewidmet hat, die neueste Ausgabe des „Bulletin of the American Mathematical Society“ (Bulletin der American Mathematical Society) weitergeleitet. Zum Thema „Werden Maschinen die Mathematik verändern?“ äußerten viele Mathematiker ihre Meinung. Der gesamte Prozess war voller Funken, knallhart und aufregend. Der Autor verfügt über eine starke Besetzung, darunter der Fields-Medaillengewinner Akshay Venkatesh, der chinesische Mathematiker Zheng Lejun, der NYU-Informatiker Ernest Davis und viele andere bekannte Wissenschaftler der Branche. Die Welt der KI hat sich dramatisch verändert. Viele dieser Artikel wurden vor einem Jahr eingereicht.

Hallo, elektrischer Atlas! Der Boston Dynamics-Roboter erwacht wieder zum Leben, seltsame 180-Grad-Bewegungen machen Musk Angst

Apr 18, 2024 pm 07:58 PM

Hallo, elektrischer Atlas! Der Boston Dynamics-Roboter erwacht wieder zum Leben, seltsame 180-Grad-Bewegungen machen Musk Angst

Apr 18, 2024 pm 07:58 PM

Boston Dynamics Atlas tritt offiziell in die Ära der Elektroroboter ein! Gestern hat sich der hydraulische Atlas einfach „unter Tränen“ von der Bühne der Geschichte zurückgezogen. Heute gab Boston Dynamics bekannt, dass der elektrische Atlas im Einsatz ist. Es scheint, dass Boston Dynamics im Bereich kommerzieller humanoider Roboter entschlossen ist, mit Tesla zu konkurrieren. Nach der Veröffentlichung des neuen Videos wurde es innerhalb von nur zehn Stunden bereits von mehr als einer Million Menschen angesehen. Die alten Leute gehen und neue Rollen entstehen. Das ist eine historische Notwendigkeit. Es besteht kein Zweifel, dass dieses Jahr das explosive Jahr der humanoiden Roboter ist. Netizens kommentierten: Die Weiterentwicklung der Roboter hat dazu geführt, dass die diesjährige Eröffnungsfeier wie Menschen aussieht, und der Freiheitsgrad ist weitaus größer als der von Menschen. Aber ist das wirklich kein Horrorfilm? Zu Beginn des Videos liegt Atlas ruhig auf dem Boden, scheinbar auf dem Rücken. Was folgt, ist atemberaubend

KAN, das MLP ersetzt, wurde durch Open-Source-Projekte auf Faltung erweitert

Jun 01, 2024 pm 10:03 PM

KAN, das MLP ersetzt, wurde durch Open-Source-Projekte auf Faltung erweitert

Jun 01, 2024 pm 10:03 PM

Anfang dieses Monats schlugen Forscher des MIT und anderer Institutionen eine vielversprechende Alternative zu MLP vor – KAN. KAN übertrifft MLP in Bezug auf Genauigkeit und Interpretierbarkeit. Und es kann MLP, das mit einer größeren Anzahl von Parametern ausgeführt wird, mit einer sehr kleinen Anzahl von Parametern übertreffen. Beispielsweise gaben die Autoren an, dass sie KAN nutzten, um die Ergebnisse von DeepMind mit einem kleineren Netzwerk und einem höheren Automatisierungsgrad zu reproduzieren. Konkret verfügt DeepMinds MLP über etwa 300.000 Parameter, während KAN nur etwa 200 Parameter hat. KAN hat eine starke mathematische Grundlage wie MLP und basiert auf dem universellen Approximationssatz, während KAN auf dem Kolmogorov-Arnold-Darstellungssatz basiert. Wie in der folgenden Abbildung gezeigt, hat KAN

Google ist begeistert: JAX-Leistung übertrifft Pytorch und TensorFlow! Es könnte die schnellste Wahl für das GPU-Inferenztraining werden

Apr 01, 2024 pm 07:46 PM

Google ist begeistert: JAX-Leistung übertrifft Pytorch und TensorFlow! Es könnte die schnellste Wahl für das GPU-Inferenztraining werden

Apr 01, 2024 pm 07:46 PM

Die von Google geförderte Leistung von JAX hat in jüngsten Benchmark-Tests die von Pytorch und TensorFlow übertroffen und belegt bei 7 Indikatoren den ersten Platz. Und der Test wurde nicht auf der TPU mit der besten JAX-Leistung durchgeführt. Obwohl unter Entwicklern Pytorch immer noch beliebter ist als Tensorflow. Aber in Zukunft werden möglicherweise mehr große Modelle auf Basis der JAX-Plattform trainiert und ausgeführt. Modelle Kürzlich hat das Keras-Team drei Backends (TensorFlow, JAX, PyTorch) mit der nativen PyTorch-Implementierung und Keras2 mit TensorFlow verglichen. Zunächst wählen sie eine Reihe von Mainstream-Inhalten aus

Tesla-Roboter arbeiten in Fabriken, Musk: Der Freiheitsgrad der Hände wird dieses Jahr 22 erreichen!

May 06, 2024 pm 04:13 PM

Tesla-Roboter arbeiten in Fabriken, Musk: Der Freiheitsgrad der Hände wird dieses Jahr 22 erreichen!

May 06, 2024 pm 04:13 PM

Das neueste Video von Teslas Roboter Optimus ist veröffentlicht und er kann bereits in der Fabrik arbeiten. Bei normaler Geschwindigkeit sortiert es Batterien (Teslas 4680-Batterien) so: Der Beamte hat auch veröffentlicht, wie es bei 20-facher Geschwindigkeit aussieht – auf einer kleinen „Workstation“, pflücken und pflücken und pflücken: Dieses Mal wird es freigegeben. Eines der Highlights Der Vorteil des Videos besteht darin, dass Optimus diese Arbeit in der Fabrik völlig autonom und ohne menschliches Eingreifen während des gesamten Prozesses erledigt. Und aus Sicht von Optimus kann es auch die krumme Batterie aufnehmen und platzieren, wobei der Schwerpunkt auf der automatischen Fehlerkorrektur liegt: In Bezug auf die Hand von Optimus gab der NVIDIA-Wissenschaftler Jim Fan eine hohe Bewertung ab: Die Hand von Optimus ist der fünffingrige Roboter der Welt am geschicktesten. Seine Hände sind nicht nur taktil

FisheyeDetNet: der erste Zielerkennungsalgorithmus basierend auf einer Fischaugenkamera

Apr 26, 2024 am 11:37 AM

FisheyeDetNet: der erste Zielerkennungsalgorithmus basierend auf einer Fischaugenkamera

Apr 26, 2024 am 11:37 AM

Die Zielerkennung ist ein relativ ausgereiftes Problem in autonomen Fahrsystemen, wobei die Fußgängererkennung einer der ersten Algorithmen ist, die eingesetzt werden. In den meisten Arbeiten wurde eine sehr umfassende Recherche durchgeführt. Die Entfernungswahrnehmung mithilfe von Fischaugenkameras für die Rundumsicht ist jedoch relativ wenig untersucht. Aufgrund der großen radialen Verzerrung ist es schwierig, die standardmäßige Bounding-Box-Darstellung in Fischaugenkameras zu implementieren. Um die obige Beschreibung zu vereinfachen, untersuchen wir erweiterte Begrenzungsrahmen-, Ellipsen- und allgemeine Polygondesigns in Polar-/Winkeldarstellungen und definieren eine mIOU-Metrik für die Instanzsegmentierung, um diese Darstellungen zu analysieren. Das vorgeschlagene Modell „fisheyeDetNet“ mit polygonaler Form übertrifft andere Modelle und erreicht gleichzeitig 49,5 % mAP auf dem Valeo-Fisheye-Kameradatensatz für autonomes Fahren

DualBEV: BEVFormer und BEVDet4D deutlich übertreffen, öffnen Sie das Buch!

Mar 21, 2024 pm 05:21 PM

DualBEV: BEVFormer und BEVDet4D deutlich übertreffen, öffnen Sie das Buch!

Mar 21, 2024 pm 05:21 PM

In diesem Artikel wird das Problem der genauen Erkennung von Objekten aus verschiedenen Blickwinkeln (z. B. Perspektive und Vogelperspektive) beim autonomen Fahren untersucht, insbesondere wie die Transformation von Merkmalen aus der Perspektive (PV) in den Raum aus der Vogelperspektive (BEV) effektiv ist implementiert über das Modul Visual Transformation (VT). Bestehende Methoden lassen sich grob in zwei Strategien unterteilen: 2D-zu-3D- und 3D-zu-2D-Konvertierung. 2D-zu-3D-Methoden verbessern dichte 2D-Merkmale durch die Vorhersage von Tiefenwahrscheinlichkeiten, aber die inhärente Unsicherheit von Tiefenvorhersagen, insbesondere in entfernten Regionen, kann zu Ungenauigkeiten führen. Während 3D-zu-2D-Methoden normalerweise 3D-Abfragen verwenden, um 2D-Features abzutasten und die Aufmerksamkeitsgewichte der Korrespondenz zwischen 3D- und 2D-Features über einen Transformer zu lernen, erhöht sich die Rechen- und Bereitstellungszeit.