Technologie-Peripheriegeräte

Technologie-Peripheriegeräte

KI

KI

Apples Headset kommt. Ist es der Retter der virtuellen KI-Menschen oder ein Meteor?

Apples Headset kommt. Ist es der Retter der virtuellen KI-Menschen oder ein Meteor?

Apples Headset kommt. Ist es der Retter der virtuellen KI-Menschen oder ein Meteor?

Autor|Su Xiaoru

AIGC ist so beliebt, wurde das Metaverse vergessen?

Mit der Veröffentlichung von Apples neuer AR-Brille Vision Pro zum Preis von 24.000 Yuan sind AR und VR, die seit einiger Zeit inaktiv waren, wieder in den Mittelpunkt aller Aufmerksamkeit gerückt.

Wer bereitet sich als Erster auf AR und VR vor und ist als Erster wieder begeistert? Natürlich handelt es sich um eine Reihe von Unternehmen, die virtuelle und digitale Menschen herstellen. Virtuelle menschliche Technologie ist eine Technologie, die sehr eng mit der Unterhaltung verknüpft ist. Nach dem früheren Konzept des Metaversums und der aktuellen AIGC-Ära haben virtuelle Menschen viele Orte, an denen sie in Hotspots integriert werden können.

In Kombination mit dem AIGC-Konzept ist es das größte Thema der Branche im ersten Halbjahr dieses Jahres. Anfang dieses Monats wurde der digitale Klon des Internet-Stars „Hanzo Forest“ auf den Markt gebracht. Benutzer können monatlich oder jährlich Sprach-, Anruf- und andere Dienste genießen. Da KI menschliche Fahrer ersetzt, können digitale Menschen rund um die Uhr arbeiten und so die Produktionskapazität erheblich steigern.

Der hier erwähnte Live-Übertragungsprozess basiert auf der Leistung realer Menschen, also der „People in the Middle“, einem der „traditionellen Genres“ virtueller Menschen. Mit der kontinuierlichen Weiterentwicklung der künstlichen Intelligenz, die vollständig durch Programme oder KI gesteuert wird, ist die Bereitstellung von Fragen und Antworten auf Einzelfallbasis zu einer weiteren wichtigen Entwicklungsrichtung der virtuellen menschlichen Industrie geworden.

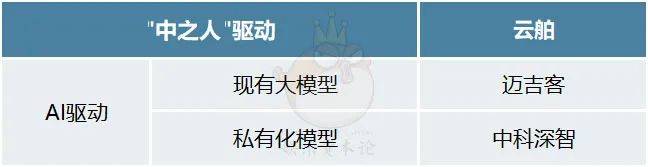

Der technische Weg zur Realisierung virtueller KI-Menschen ist derzeit in zwei Typen unterteilt: Der eine besteht in der Privatisierung und Bereitstellung großer Modelle und der andere darin, eine gezielte Sekundärentwicklung auf der Grundlage vorhandener Open-Source-Modelle durchzuführen.

Tabelle 1 Typklassifizierung der drei in diesem Artikel befragten virtuellen menschlichen Unternehmen Tabellierung/Unterhaltungskapitalismus

Tabelle 1 Typklassifizierung der drei in diesem Artikel befragten virtuellen menschlichen Unternehmen Tabellierung/Unterhaltungskapitalismus

In diesem Artikel führt Sie Entertainment Capitalism zu drei typischen Entwicklern virtueller menschlicher Technologie, um die Veränderungen zu erkunden, die KI für ihre Produktentwicklung und Geschäftsmodelle mit sich gebracht hat.

Die virtuelle Content-Plattform AIGC Yunbo nutzt den „Little K Live Broadcaster“ für Live-Sender als Träger, um auf spielerische Weise ein umfassendes Live-Broadcast-Ökosystem zu erkunden und aufzubauen

Zhongke Shenzhi, das sich auf die durchgängige generative KI-Technologie für virtuelle Menschen konzentriert, konzentriert sich auf die „automatische Übertragung“ von Waren für Händler. Es hat gerade ein eigenes großes Modell veröffentlicht, um die Wirkung der virtuellen menschlichen Frage- und Antwortinteraktion erheblich zu verbessern.Mejike, ein modalübergreifendes, intelligentes Softwaredienstleistungsunternehmen, stellt nicht nur vollautomatische virtuelle Anker für Unternehmen bereit, sondern nutzt auch die internen Daten des Unternehmens, um proprietäre Modelle zu trainieren und die unternehmensinterne Datenbank und Suchmaschine zu pflegen.

Vier Möglichkeiten, AIGC zu öffnen

Viele Moderatoren und Zuschauer der Live-Übertragung von Station B werden Xiao Ks Live-Übertragungsmädchen nie unbekannt sein. Xiao K Live Ji verwendet eine RGB-Kamera, um 2D-Bildaktionsdaten zu sammeln, und verwendet Algorithmen, um 3D-Aktionsdaten zu generieren, wodurch ein technischer Wassergraben entsteht. Benutzer können Xiao K Live Ji direkt verwenden, um ihre eigene virtuelle Live-Übertragungsperson zu erstellen.„Wir haben 3 Jahre gebraucht, um den zugrunde liegenden Algorithmus zu entwickeln, über einen privaten Trainingsdatensatz zu verfügen und das Produkt hat erste Ergebnisse erzielt.“

Im Jahr 2017 kündigte Mei Song seinen Job als Produzent von Linekong Interactive-Spielen und stieg in die Branche der künstlichen Intelligenz ein. Er gründete Yunbo Technology, den Entwickler von Xiao K Live Broadcasting Girl. Der doppelte Hintergrund der Gaming- und KI-Branche macht das Geschäftsmodell von Yunbo ebenfalls einzigartig.

KI-Mapping von Entertainment Capital „Der Geschäftsumfang unseres Unternehmens umfasst sowohl ToB als auch ToC. Zu den Produkten gehören Xiao K AI Motion Capture, AI Drawing, Virtual Human Engine usw. Wir haben auch eine selbst betriebene MCN-Gilde und Ankerbasis. Darüber hinaus ist das Unternehmen auch live vertreten Rundfunk, Spiele, Fernsehen. Es bietet Unternehmen drei Kerngeschäftsszenarien: virtuelle Menschen und virtuelle Inhaltsdienste.“

„Der Geschäftsumfang unseres Unternehmens umfasst sowohl ToB als auch ToC. Zu den Produkten gehören Xiao K AI Motion Capture, AI Drawing, Virtual Human Engine usw. Wir haben auch eine selbst betriebene MCN-Gilde und Ankerbasis. Darüber hinaus ist das Unternehmen auch live vertreten Rundfunk, Spiele, Fernsehen. Es bietet Unternehmen drei Kerngeschäftsszenarien: virtuelle Menschen und virtuelle Inhaltsdienste.“

Zhongke GenSense, das sich auf die durchgängige generative KI-Technologie für virtuelle Menschen konzentriert, hat am 10. Mai offiziell sein eigenes großes Modell mit dem Namen „GenSense Digital Intelligence Jiang Shang“ veröffentlicht.

„Nachdem Open AI die Trainingsmethode angekündigt hat, ist die Schwierigkeit der Zulassung zu großen Modellen geringer geworden. Ob Unternehmen selbst große Modelle bauen wollen, hängt hauptsächlich vom kommerziellen Raum großer Modelle ab.“ erklären. „Anfang 2020 haben wir mit der modalübergreifenden Schulungsarbeit auf Basis von Transformer begonnen und verfügen auch über Erfahrung in der Datenbereinigung.“

„Wir entwickeln große Modelle hauptsächlich aus zwei Aspekten: Erstens wird das zukünftige multimodale Training auf großen Sprachmodellen basieren, und die zugrunde liegenden Algorithmen in vertikalen Bereichen müssen sich auf große Modelle stützen. Dies erfordert eine Berechnung. Wenn wir eine Verbindung zu anderen großen Modellen herstellen, können wir den Quellcode und die Datensätze nicht abrufen

Derzeit machen die „Automatic Broadcast“-Kunden von Zhongke Shenzhi mehr als 70 % der Markenhändler der mittleren bis unteren Preisklasse aus, die virtuelle KI-Menschen auf Tmall, Taobao, JD.com und anderen Plattformen einsetzen. Sie haben kürzlich ein virtuelles Assistentenprodukt auf den Markt gebracht, das es realen und virtuellen Menschen ermöglicht, gleichzeitig zu erscheinen.

Ein Label, das sich Maijike Technology gibt, ist „cross-modal“. Das Unternehmen konzentriert sich auf die Bereiche intelligente digitale Assets und intelligente Generierung. Seine Hauptprodukte sind intelligente Inhaltsproduktion, intelligente virtuelle Live-Übertragung und personalisierte intelligente Interaktion für Tausende von Menschen Und das neue Produkt, das kürzlich im Zhongguancun Forum vorgestellt wurde – die Raumstation für digitale Intelligenz – ist dreidimensional, in Echtzeit und intelligent.

Bereits im Jahr 2016 begann Maijike Technology, in den AIGC-Bereich einzusteigen, sagte Gründer und Vorsitzender Fu Yingna.

„Wir verwenden keinen manuellen Kalibrierungsdatenkorpus, sondern erstellen Daten auf Basis unstrukturierter Technologie. Beispielsweise können wir verschiedene Datendokumente im Unternehmen hierarchisch verarbeiten, eine modalübergreifende Suchmaschine für das Unternehmen erstellen und die Unternehmensdaten intelligent verwalten.“ Inhalte generieren, einfach Interaktion erreichen.“

Es gibt viele Unternehmen, die Privatisierungen für Unternehmen durchführen, aber für kleine und mittlere Unternehmen ist es schwierig, große Modelle aufzubauen. Fu Yingna glaubt, dass ihr Burggraben in kombinatorischen Innovationen liegt, die auf großen Open-Source-Modellen basieren Modelle können in der Anwendung parallel oder seriell kombiniert werden.“ Die zugrunde liegende Technologie der Maijike-Technologie ist ein hierarchischer Algorithmus. Eine solche Algorithmuskombination erfordert eine geringe Rechenleistung und kann mit geringen Kosten und hoher Effizienz erstellt werden. Sie kann Ressourcen auf der Grundlage kleiner Stichprobendaten iterieren und letztendlich evolvierbare Intelligenz bilden.“

Wo ist der Raum für Gewinn?

Virtuelle menschliche Live-Übertragungen werden hauptsächlich in drei Typen unterteilt: Unterhaltungsübertragungen, Spielübertragungen und E-Commerce-Live-Übertragungen. Mei Song von Yunbo glaubt: „Vom Wert her sind virtuelle Menschen für die ersten beiden besser geeignet. Der Kern des Warentransports ist die Ware. Solange etwas billig ist, wird es definitiv jemand kaufen.“ , es wird für niemanden schwierig sein, es zu verkaufen. Live-Streaming kann das Problem der Waren nicht lösen.“„Virtuelle Live-Übertragungen können die Unfähigkeit verbessern, während Live-Übertragungen sofort mit Fans zu interagieren. Fans können virtuelle Moderatoren jederzeit belohnen und ihre Kostüme wechseln, und der Inhalt der virtuellen Live-Übertragung ist interaktiver und reichhaltiger.“ -Qualitäts-Live-Inhalte erfordern auf jeden Fall die Teilnahme echter Menschen.“

Öffnen Sie Station B und Sie können überall die „Leitungswasser“-Benutzer von Xiao K sehen. Mei Song gab bekannt, dass die Marktbindungsrate von Xiao K Live Ji im Bereich der virtuellen 3D-Moderatoren 90 % erreicht hat, wobei mehr als 400.000 Moderatoren das gesamte Netzwerk bedienen und mehr als 5.000 Moderatoren täglich aktive Übertragungen durchführen. Unter allen Motion-Capture-Liveübertragungstools ist Xiao K das einzige, das auf der C-Seite völlig kostenlos ist.

„Ich erwarte nicht, dass ich mich auf die Produkte von Xiao K Live verlassen werde. Ich hoffe, dass ich in Zukunft mehr Anker dafür gewinnen kann, es zu nutzen.“ Verwenden Sie Weltraumszenen, um interaktive Spiele zu erstellen und die Monetarisierung des Content-Verkehrs durchzuführen, ähnelt dem intermodalen Modell von Spielen.“

Mei Song glaubt, dass die virtuelle Live-Interaktion in drei Phasen unterteilt wird. Die 1.0-Ära war eine tägliche Live-Übertragung mit echten Menschen, die Geschenke machten, Spezialeffekte spielten und Sperrfeuer veranstalteten. 2.0 Fans können den virtuellen Inhalt im Live-Übertragungsraum beeinflussen oder durch Sperrgeschenke Charaktere erstellen, aber Fans haben keine Kontrolle. 3.0 ist der Metaverse-Raum. Fans können in Live-Übertragungen frei interagieren und haben eine völlig unabhängige Kontrolle, z. B. beim Abhalten von Konzerten, beim Spielen von PK usw. In der zweiten Hälfte dieses Jahres wird Yunbo die „Little K Space Station“ ähnlich dem „Metaverse“ starten, um die dritte Generation interaktiver Live-Szenen umzusetzen.

Fu Yingna von Maijike Technology glaubt, dass verschiedene Plattformen unterschiedliche Richtlinien für virtuelle Live-Übertragungen haben. „Douyin wird es nicht fördern, aber Bilibili wird es wahrscheinlich fördern. Schließlich sind die Nutzer unterschiedlich. In Zukunft kann die Plattform einen separaten virtuellen Live-Übertragungsbereich haben, schließlich gibt es ein Publikum.“

Andererseits: „Wenn virtuelle Menschen reale Menschen ersetzen, verdrängen sie die Plattform und verletzen die Interessen der Plattform. Sie werden in Zukunft definitiv verboten.“ Cheng Weizhong, ein weiser Mann aus Zhongke sagte, dass frühere Live-Übertragungen von digitalen Menschen, die Waren bringen, explodiert seien. Das sei beliebt, weil Douyin das Leben vor Ort unterstützen möchte.

KI+VR: Wie rosig ist die Zukunft

In Bezug auf große Modelle sagte Cheng Weizhong: „Das Training tiefer KI erfordert eine große Menge an Korpus, das sind alles bestehende Anwendungsszenarien von OpenAI. Noch wichtiger: Wann kann die tiefe KI-Technologie die Schwelle durchbrechen, und kann es neue geben?“ Anwendungsszenarien. Ebenso streben die großen Modelle, die wir entwickeln, nach Durchbrüchen bei virtuellen Menschen, und wir gehen davon aus, dass wir in einem Jahr Fortschritte bei der Interaktion zwischen virtuellen Menschen machen werden.“Neben der ChatGPT-Welle hat Cheng Weizhong auch auf Apple Glasses geachtet. „Ob sich Apples AR-Brille auf lange Sicht weiterentwickeln kann, hängt nicht nur davon ab, ob sie AR und VR technisch integrieren kann, sondern vor allem vom Geschäftsmodell, ob sie Geld mit Entwicklern teilen kann, um Entwickler zum Mitmachen zu bewegen.“ Gemeinsam ein Ökosystem schaffen.“

„Mit der Entwicklung von AR-Brillen wird sich auch die Art und Weise ändern, wie Inhalte ausgedrückt werden, was auch größere Möglichkeiten für Unternehmen mit sich bringt, die 3D-Inhalte und virtuelle Menschen generieren. Es ist eine gute Chance für Unternehmer.“Wenn es um Apple Glasses geht, glaubt Mei Song, dass die besten Implementierungsszenarien für VR und das Metaverse in Spielen im Frühstadium liegen. „Warum sind die Penetrationsrate und die Nutzerzahl von VR nicht gestiegen? Der Hauptgrund ist, dass es keine guten Inhalte auf VR-Basis gibt.“

Yunbo investierte 30 Millionen Yuan in den Aufbau der 3D-Assets von Xiao K Live Broadcast Ji Zhong. „Einerseits sind es die Kosten. Andererseits haben wir selbst entwickelte Technologien wie die Xiao K-Video-Engine Nach jahrelanger Forschung haben wir unseren eigenen Graben geformt.“

„In der zweiten Jahreshälfte werden wir mit der Entwicklung multimodaler AIGC-Konvertierungsprodukte wie KI-Musik und KI-Stimme beginnen; Xiao K Live Ji wird eine Ganzkörper-Motion-Capture-Version mit einer Kamera auf den Markt bringen; das Produkt wird auch in den Produktionsprozess von Spielanimationen integriert, um Benutzern die Generierung nutzbarer Animationsdaten zu erleichtern. Darüber hinaus werden auch E-Commerce- und Spielversionen der Zeichnungen von Little K eingeführt.“

Natürlich erfordern diese Pläne auch die Unterstützung großer Modelle, daher wird Yunbo auch eine große Datenmenge verwenden, um das Modell zu trainieren. Das Unternehmen verfügt bereits über ein Etikettierungsteam von Dutzenden von Mitarbeitern.

Fu Yingna verwendete den Begriff „Upgrade“ auch, um die Situation zu beschreiben, nachdem AR/VR populär geworden ist. „In der ersten Generation des Internets hat jedes Unternehmen seine eigene Website. In der zweiten Generation des Internets hat jedes Unternehmen seine eigene APP. Die dritte Generation des Internets wird ein vierdimensionales Raum-Zeit-Erlebnis sein, und das wird auch so sein.“ Auf die intelligente Generierung von 3D-Inhalten aufgerüstet werden, ermöglicht die Integration von Zeit- und Raumfaltung die Ausgabe intelligenter 3D-Inhalte in H5-Form und kann auf Webseiten, Clients und anderen Orten für Echtzeitinteraktion angezeigt werden.

Die neueste „Digitale Raumstation“ von Maijike Technology kann eine „digitale Visitenkarte“ für Unternehmen im virtuellen Raum etablieren. Sie kann dreidimensional, visuell und intelligent präsentiert werden und über die Grenzen realer physischer Zeit und Raum hinausgehen Bereitstellung personalisierter, intelligenter Dienstleistungen für alle Menschen. Dieser Inhaltsvorgang kann durch private Bereitstellung oder SaaS erreicht werden. Dies ist der Schlüssel zum Aufbau einer neuen Generation von Content-Produktivität und immersivem Erlebnis. Es ist auch ein wichtiges Werkzeug und eine wichtige Plattform im Zeitalter der digitalen Wirtschaft.

Während die AIGC-Technologie weiterhin die Wahrnehmung der Branche revolutioniert, bringt sie auch eine Revolution für die virtuelle menschliche Technologie mit sich. Für Praktiker der virtuellen menschlichen Technologie hat der durch ChatGPT ausgelöste KI-Wahn in Verbindung mit den neuen Hotspots von AR/VR doppelte Aufregung ausgelöst.

Während die AIGC-Technologie weiterhin die Wahrnehmung der Branche revolutioniert, bringt sie auch eine Revolution für die virtuelle menschliche Technologie mit sich. Für Praktiker der virtuellen menschlichen Technologie hat der durch ChatGPT ausgelöste KI-Wahn in Verbindung mit den neuen Hotspots von AR/VR doppelte Aufregung ausgelöst.

Wenn es zu viel Neues zu sehen und zu viel zu tun gibt, ist es wahrscheinlich das, was Technologieanbieter und B-Side-Kunden brauchen, um mithilfe von KI endlose Content-Konsumprodukte zu generieren und die Tür zu einer neuen Welt zu öffnen zusammen.

Das obige ist der detaillierte Inhalt vonApples Headset kommt. Ist es der Retter der virtuellen KI-Menschen oder ein Meteor?. Für weitere Informationen folgen Sie bitte anderen verwandten Artikeln auf der PHP chinesischen Website!

Heiße KI -Werkzeuge

Undresser.AI Undress

KI-gestützte App zum Erstellen realistischer Aktfotos

AI Clothes Remover

Online-KI-Tool zum Entfernen von Kleidung aus Fotos.

Undress AI Tool

Ausziehbilder kostenlos

Clothoff.io

KI-Kleiderentferner

AI Hentai Generator

Erstellen Sie kostenlos Ai Hentai.

Heißer Artikel

Heiße Werkzeuge

Notepad++7.3.1

Einfach zu bedienender und kostenloser Code-Editor

SublimeText3 chinesische Version

Chinesische Version, sehr einfach zu bedienen

Senden Sie Studio 13.0.1

Leistungsstarke integrierte PHP-Entwicklungsumgebung

Dreamweaver CS6

Visuelle Webentwicklungstools

SublimeText3 Mac-Version

Codebearbeitungssoftware auf Gottesniveau (SublimeText3)

Heiße Themen

1371

1371

52

52

Ich habe versucht, die Vibe -Codierung mit Cursor AI und es ist erstaunlich!

Mar 20, 2025 pm 03:34 PM

Ich habe versucht, die Vibe -Codierung mit Cursor AI und es ist erstaunlich!

Mar 20, 2025 pm 03:34 PM

Die Vibe -Codierung verändert die Welt der Softwareentwicklung, indem wir Anwendungen mit natürlicher Sprache anstelle von endlosen Codezeilen erstellen können. Inspiriert von Visionären wie Andrej Karpathy, lässt dieser innovative Ansatz Dev

Top 5 Genai Starts vom Februar 2025: GPT-4,5, GROK-3 & MEHR!

Mar 22, 2025 am 10:58 AM

Top 5 Genai Starts vom Februar 2025: GPT-4,5, GROK-3 & MEHR!

Mar 22, 2025 am 10:58 AM

Februar 2025 war ein weiterer bahnbrechender Monat für die Generative KI, die uns einige der am meisten erwarteten Modell-Upgrades und bahnbrechenden neuen Funktionen gebracht hat. Von Xais Grok 3 und Anthropics Claude 3.7 -Sonett, um g zu eröffnen

Wie benutze ich Yolo V12 zur Objekterkennung?

Mar 22, 2025 am 11:07 AM

Wie benutze ich Yolo V12 zur Objekterkennung?

Mar 22, 2025 am 11:07 AM

Yolo (Sie schauen nur einmal) war ein führender Echtzeit-Objekterkennungsrahmen, wobei jede Iteration die vorherigen Versionen verbessert. Die neueste Version Yolo V12 führt Fortschritte vor, die die Genauigkeit erheblich verbessern

Sora vs Veo 2: Welches erstellt realistischere Videos?

Mar 10, 2025 pm 12:22 PM

Sora vs Veo 2: Welches erstellt realistischere Videos?

Mar 10, 2025 pm 12:22 PM

Google's Veo 2 und Openais Sora: Welcher AI -Videogenerator regiert oberste? Beide Plattformen erzeugen beeindruckende KI -Videos, aber ihre Stärken liegen in verschiedenen Bereichen. Dieser Vergleich unter Verwendung verschiedener Eingabeaufforderungen zeigt, welches Werkzeug Ihren Anforderungen am besten entspricht. T

Gencast von Google: Wettervorhersage mit Gencast Mini Demo

Mar 16, 2025 pm 01:46 PM

Gencast von Google: Wettervorhersage mit Gencast Mini Demo

Mar 16, 2025 pm 01:46 PM

Gencast von Google Deepmind: Eine revolutionäre KI für die Wettervorhersage Die Wettervorhersage wurde einer dramatischen Transformation unterzogen, die sich von rudimentären Beobachtungen zu ausgefeilten AI-angetriebenen Vorhersagen überschreitet. Google DeepMinds Gencast, ein Bodenbrei

Ist Chatgpt 4 o verfügbar?

Mar 28, 2025 pm 05:29 PM

Ist Chatgpt 4 o verfügbar?

Mar 28, 2025 pm 05:29 PM

Chatgpt 4 ist derzeit verfügbar und weit verbreitet, wodurch im Vergleich zu seinen Vorgängern wie ChatGPT 3.5 signifikante Verbesserungen beim Verständnis des Kontextes und des Generierens kohärenter Antworten zeigt. Zukünftige Entwicklungen können mehr personalisierte Inters umfassen

Welche KI ist besser als Chatgpt?

Mar 18, 2025 pm 06:05 PM

Welche KI ist besser als Chatgpt?

Mar 18, 2025 pm 06:05 PM

Der Artikel erörtert KI -Modelle, die Chatgpt wie Lamda, Lama und Grok übertreffen und ihre Vorteile in Bezug auf Genauigkeit, Verständnis und Branchenauswirkungen hervorheben. (159 Charaktere)

O1 gegen GPT-4O: Ist OpenAIs neues Modell besser als GPT-4O?

Mar 16, 2025 am 11:47 AM

O1 gegen GPT-4O: Ist OpenAIs neues Modell besser als GPT-4O?

Mar 16, 2025 am 11:47 AM

Openais O1: Ein 12-tägiger Geschenkbummel beginnt mit ihrem bisher mächtigsten Modell Die Ankunft im Dezember bringt eine globale Verlangsamung, Schneeflocken in einigen Teilen der Welt, aber Openai fängt gerade erst an. Sam Altman und sein Team starten ein 12-tägiges Geschenk Ex