Technologie-Peripheriegeräte

Technologie-Peripheriegeräte

KI

KI

Ein Artikel zum Verständnis der Lidar- und visuellen Fusionswahrnehmung des autonomen Fahrens

Ein Artikel zum Verständnis der Lidar- und visuellen Fusionswahrnehmung des autonomen Fahrens

Ein Artikel zum Verständnis der Lidar- und visuellen Fusionswahrnehmung des autonomen Fahrens

2022 ist das Zeitfenster für den Übergang von L2 zu L3/L4. Immer mehr Automobilhersteller haben begonnen, die Massenproduktion von intelligentem Fahren auf höherem Niveau zu planen.

Mit der technischen Verbesserung der Lidar-Hardware, der Massenproduktion auf Fahrzeugebene und der Kostensenkung haben intelligente Fahrfunktionen auf hohem Niveau die Massenproduktion von Lidar im Bereich der Personenkraftwagen vorangetrieben wird dieses Jahr ausgeliefert, und 2022 wird auch als „das erste Jahr von Lidar auf der Straße“ bezeichnet.

01 Lidar-Sensor vs. Bildsensor

Lidar ist ein Sensor, der zur genauen Erfassung der dreidimensionalen Position von Objekten verwendet wird. Es handelt sich im Wesentlichen um eine Lasererkennung und -entfernung. Mit seiner hervorragenden Leistung bei der Zielkonturmessung und der universellen Hinderniserkennung wird es zur Kernkonfiguration des autonomen L4-Fahrens.

Der Reichweitenmessbereich von Lidar (im Allgemeinen etwa 200 Meter, Serienmodelle verschiedener Hersteller haben unterschiedliche Indikatoren) führt jedoch zu einem Wahrnehmungsbereich, der viel kleiner ist als der von Bildsensoren.

Und aufgrund seiner relativ geringen Winkelauflösung (im Allgemeinen 0,1° oder 0,2°) ist die Auflösung der Punktwolke viel kleiner als die des Bildsensors. Bei der Erfassung der auf das Ziel projizierten Punkte aus großer Entfernung kann extrem spärlich sein. Für die Punktwolken-Zielerkennung beträgt die effektive Punktwolkenentfernung, die der Algorithmus wirklich nutzen kann, nur etwa 100 Meter.

Bildsensoren können komplexe Umgebungsinformationen mit hohen Bildraten und hohen Auflösungen erfassen und sind kostengünstig. Für die visuelle Wahrnehmung in unterschiedlichen Entfernungen und Entfernungen können mehrere Sensoren eingesetzt werden.

Der Bildsensor ist jedoch ein passiver Sensor mit unzureichender Tiefenwahrnehmung und schlechter Entfernungsgenauigkeit. Insbesondere in rauen Umgebungen erhöht sich die Schwierigkeit, Erfassungsaufgaben zu erfüllen.

Angesichts von starkem Licht, geringer Beleuchtung in der Nacht, Regen, Schnee, Nebel und anderen Wetter- und Lichtumgebungen stellt intelligentes Fahren hohe Anforderungen an Sensoralgorithmen. Obwohl Lidar nicht empfindlich auf den Einfluss von Umgebungslicht reagiert, wird die Entfernungsmessung durch wassergefüllte Straßen, Glaswände usw. stark beeinträchtigt.

Man erkennt, dass Lidar- und Bildsensoren jeweils ihre eigenen Vor- und Nachteile haben. Die meisten Personenkraftwagen mit intelligentem Fahrverhalten auf hohem Niveau entscheiden sich für die Integration verschiedener Sensoren, um die Vorteile der anderen zu ergänzen und redundant zu integrieren.

Eine solche Fused-Sensing-Lösung ist auch zu einer der Schlüsseltechnologien für autonomes Fahren auf hohem Niveau geworden.

02 Punktwolken- und Bildfusionswahrnehmung basierend auf Deep Learning

Die Fusion von Punktwolke und Bild gehört zum technischen Bereich der Multisensorfusion (MSF). Es gibt traditionelle Zufallsmethoden und Deep-Learning-Methoden. Entsprechend der Abstraktionsebene der Informationsverarbeitung im Fusionssystem ist sie hauptsächlich in drei Ebenen unterteilt:

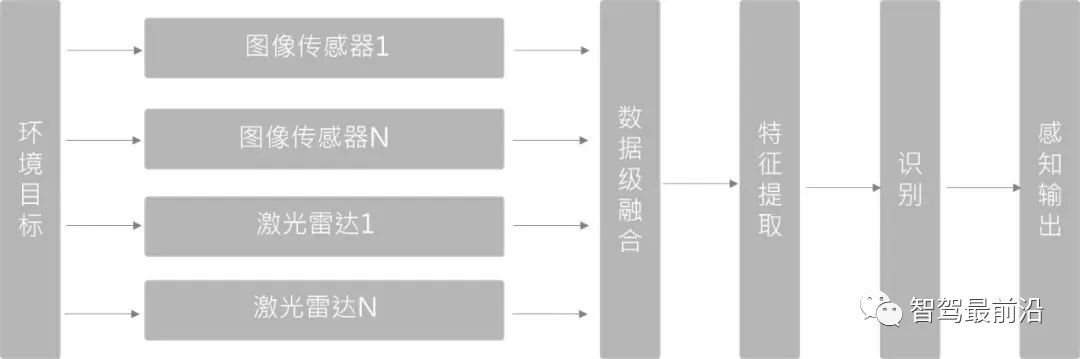

Datenschichtfusion (frühe Fusion)

Zuerst werden die Sensorbeobachtungsdaten fusioniert und Anschließend werden aus den fusionierten Daten Merkmale zur Identifizierung extrahiert. Bei der 3D-Zielerkennung übernimmt PointPainting (CVPR20) diese Methode. Die PointPainting-Methode führt zunächst eine semantische Segmentierung des Bildes durch, ordnet die segmentierten Merkmale der Punktwolke über eine Punkt-zu-Bild-Pixelmatrix zu und „zeichnet dann den Punkt“. Die Punktwolke wird an den 3D-Punktwolkendetektor gesendet, um eine Regression für die Zielbox durchzuführen.

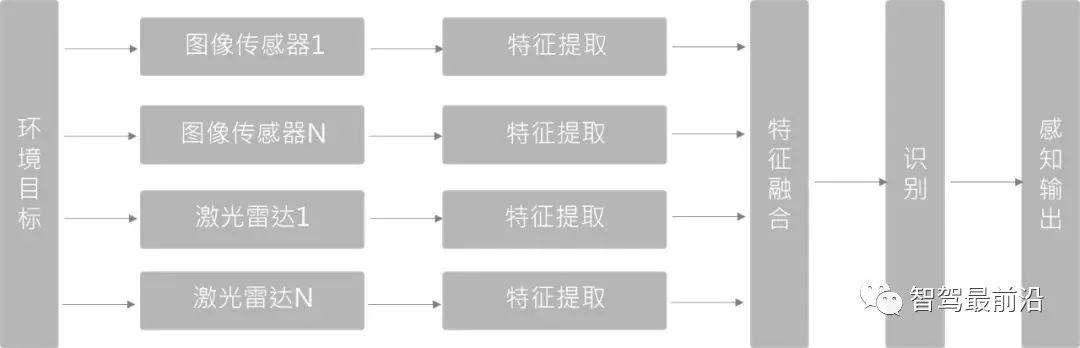

Feature-Layer-Fusion (Deep Fusion)

Extrahieren Sie zunächst natürliche Datenmerkmale aus den von jedem Sensor bereitgestellten Beobachtungsdaten und identifizieren Sie diese Merkmale dann nach der Fusion. Bei der auf Deep Learning basierenden Fusionsmethode verwendet diese Methode Merkmalsextraktoren sowohl für die Punktwolke als auch für den Bildzweig. Die Netzwerke des Bildzweigs und des Punktwolkenzweigs werden in der Vorwärts-Feedback-Ebene semantisch fusioniert, um eine Multifunktionalität zu erreichen. Skaleninformationen.

Die auf Deep Learning basierende Feature-Layer-Fusion-Methode stellt hohe Anforderungen an die räumlich-zeitliche Synchronisation zwischen mehreren Sensoren. Sobald die Synchronisierung nicht gut ist, wirkt sich dies direkt auf die Wirkung der Feature-Fusion aus. Gleichzeitig ist es aufgrund der Unterschiede im Maßstab und Betrachtungswinkel schwierig, den 1+1>2-Effekt der Merkmalsfusion zwischen LiDAR und Bildern zu erreichen.

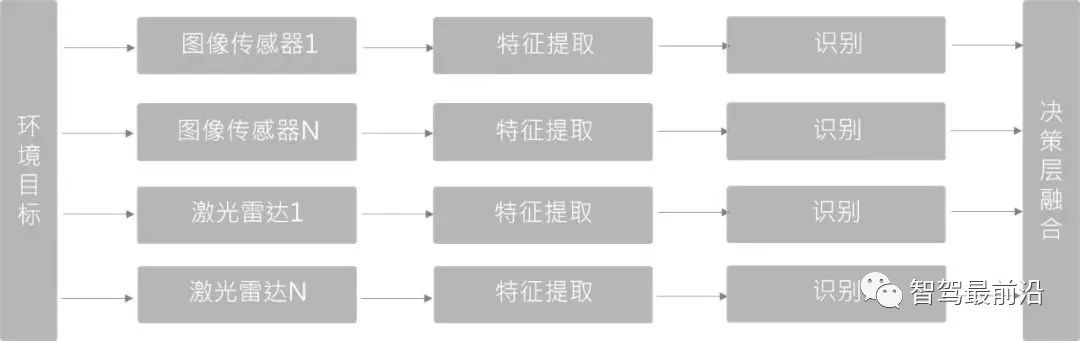

Entscheidende Schichtfusion (Late Fusion)

Im Vergleich zu den ersten beiden ist es die am wenigsten komplexe Fusionsmethode. Es erfolgt keine Fusion auf der Daten- oder Feature-Ebene, sondern es handelt sich um eine Fusion verschiedener Sensornetzwerkstrukturen, die sich gegenseitig nicht beeinflussen und unabhängig voneinander trainiert und kombiniert werden können.

Da die beiden Arten von Sensoren und Detektoren, die auf der Entscheidungsebene verschmolzen sind, unabhängig voneinander sind, kann bei einem Sensorausfall die Sensorredundanzverarbeitung weiterhin durchgeführt werden und die technische Robustheit ist besser.

Mit der kontinuierlichen Iteration der Lidar- und Visual-Fusion-Wahrnehmungstechnologie sowie der kontinuierlichen Anhäufung von Wissensszenarien und -fällen scheinen immer mehr Full-Stack-Fusion-Computing-Lösungen mehr Vorteile für die Autonomie zu bringen Autofahren. Eine sichere Zukunft.

Das obige ist der detaillierte Inhalt vonEin Artikel zum Verständnis der Lidar- und visuellen Fusionswahrnehmung des autonomen Fahrens. Für weitere Informationen folgen Sie bitte anderen verwandten Artikeln auf der PHP chinesischen Website!

Heiße KI -Werkzeuge

Undresser.AI Undress

KI-gestützte App zum Erstellen realistischer Aktfotos

AI Clothes Remover

Online-KI-Tool zum Entfernen von Kleidung aus Fotos.

Undress AI Tool

Ausziehbilder kostenlos

Clothoff.io

KI-Kleiderentferner

AI Hentai Generator

Erstellen Sie kostenlos Ai Hentai.

Heißer Artikel

Heiße Werkzeuge

Notepad++7.3.1

Einfach zu bedienender und kostenloser Code-Editor

SublimeText3 chinesische Version

Chinesische Version, sehr einfach zu bedienen

Senden Sie Studio 13.0.1

Leistungsstarke integrierte PHP-Entwicklungsumgebung

Dreamweaver CS6

Visuelle Webentwicklungstools

SublimeText3 Mac-Version

Codebearbeitungssoftware auf Gottesniveau (SublimeText3)

Heiße Themen

1376

1376

52

52

Warum ist Gaussian Splatting beim autonomen Fahren so beliebt, dass NeRF allmählich aufgegeben wird?

Jan 17, 2024 pm 02:57 PM

Warum ist Gaussian Splatting beim autonomen Fahren so beliebt, dass NeRF allmählich aufgegeben wird?

Jan 17, 2024 pm 02:57 PM

Oben geschrieben und persönliches Verständnis des Autors. Dreidimensionales Gaussplatting (3DGS) ist eine transformative Technologie, die in den letzten Jahren in den Bereichen explizite Strahlungsfelder und Computergrafik entstanden ist. Diese innovative Methode zeichnet sich durch die Verwendung von Millionen von 3D-Gaußkurven aus, was sich stark von der Neural Radiation Field (NeRF)-Methode unterscheidet, die hauptsächlich ein implizites koordinatenbasiertes Modell verwendet, um räumliche Koordinaten auf Pixelwerte abzubilden. Mit seiner expliziten Szenendarstellung und differenzierbaren Rendering-Algorithmen garantiert 3DGS nicht nur Echtzeit-Rendering-Fähigkeiten, sondern führt auch ein beispielloses Maß an Kontrolle und Szenenbearbeitung ein. Dies positioniert 3DGS als potenziellen Game-Changer für die 3D-Rekonstruktion und -Darstellung der nächsten Generation. Zu diesem Zweck geben wir erstmals einen systematischen Überblick über die neuesten Entwicklungen und Anliegen im Bereich 3DGS.

Wie lässt sich das Long-Tail-Problem in autonomen Fahrszenarien lösen?

Jun 02, 2024 pm 02:44 PM

Wie lässt sich das Long-Tail-Problem in autonomen Fahrszenarien lösen?

Jun 02, 2024 pm 02:44 PM

Gestern wurde ich während des Interviews gefragt, ob ich irgendwelche Long-Tail-Fragen gestellt hätte, also dachte ich, ich würde eine kurze Zusammenfassung geben. Das Long-Tail-Problem des autonomen Fahrens bezieht sich auf Randfälle bei autonomen Fahrzeugen, also mögliche Szenarien mit geringer Eintrittswahrscheinlichkeit. Das wahrgenommene Long-Tail-Problem ist einer der Hauptgründe, die derzeit den betrieblichen Designbereich intelligenter autonomer Einzelfahrzeugfahrzeuge einschränken. Die zugrunde liegende Architektur und die meisten technischen Probleme des autonomen Fahrens wurden gelöst, und die verbleibenden 5 % der Long-Tail-Probleme wurden nach und nach zum Schlüssel zur Einschränkung der Entwicklung des autonomen Fahrens. Zu diesen Problemen gehören eine Vielzahl fragmentierter Szenarien, Extremsituationen und unvorhersehbares menschliches Verhalten. Der „Long Tail“ von Randszenarien beim autonomen Fahren bezieht sich auf Randfälle in autonomen Fahrzeugen (AVs). Randfälle sind mögliche Szenarien mit geringer Eintrittswahrscheinlichkeit. diese seltenen Ereignisse

Kamera oder Lidar wählen? Eine aktuelle Übersicht über die Erzielung einer robusten 3D-Objekterkennung

Jan 26, 2024 am 11:18 AM

Kamera oder Lidar wählen? Eine aktuelle Übersicht über die Erzielung einer robusten 3D-Objekterkennung

Jan 26, 2024 am 11:18 AM

0. Vorab geschrieben&& Persönliches Verständnis, dass autonome Fahrsysteme auf fortschrittlichen Wahrnehmungs-, Entscheidungs- und Steuerungstechnologien beruhen, indem sie verschiedene Sensoren (wie Kameras, Lidar, Radar usw.) verwenden, um die Umgebung wahrzunehmen, und Algorithmen und Modelle verwenden für Echtzeitanalysen und Entscheidungsfindung. Dies ermöglicht es Fahrzeugen, Verkehrszeichen zu erkennen, andere Fahrzeuge zu erkennen und zu verfolgen, das Verhalten von Fußgängern vorherzusagen usw. und sich so sicher an komplexe Verkehrsumgebungen anzupassen. Diese Technologie erregt derzeit große Aufmerksamkeit und gilt als wichtiger Entwicklungsbereich für die Zukunft des Transportwesens . eins. Aber was autonomes Fahren schwierig macht, ist herauszufinden, wie man dem Auto klarmachen kann, was um es herum passiert. Dies erfordert, dass der dreidimensionale Objekterkennungsalgorithmus im autonomen Fahrsystem Objekte in der Umgebung, einschließlich ihrer Standorte, genau wahrnehmen und beschreiben kann.

Das Stable Diffusion 3-Papier wird endlich veröffentlicht und die architektonischen Details werden enthüllt. Wird es helfen, Sora zu reproduzieren?

Mar 06, 2024 pm 05:34 PM

Das Stable Diffusion 3-Papier wird endlich veröffentlicht und die architektonischen Details werden enthüllt. Wird es helfen, Sora zu reproduzieren?

Mar 06, 2024 pm 05:34 PM

Der Artikel von StableDiffusion3 ist endlich da! Dieses Modell wurde vor zwei Wochen veröffentlicht und verwendet die gleiche DiT-Architektur (DiffusionTransformer) wie Sora. Nach seiner Veröffentlichung sorgte es für großes Aufsehen. Im Vergleich zur Vorgängerversion wurde die Qualität der von StableDiffusion3 generierten Bilder erheblich verbessert. Es unterstützt jetzt Eingabeaufforderungen mit mehreren Themen, und der Textschreibeffekt wurde ebenfalls verbessert, und es werden keine verstümmelten Zeichen mehr angezeigt. StabilityAI wies darauf hin, dass es sich bei StableDiffusion3 um eine Reihe von Modellen mit Parametergrößen von 800 M bis 8 B handelt. Durch diesen Parameterbereich kann das Modell direkt auf vielen tragbaren Geräten ausgeführt werden, wodurch der Einsatz von KI deutlich reduziert wird

Dieser Artikel reicht aus, um etwas über autonomes Fahren und Flugbahnvorhersage zu lesen!

Feb 28, 2024 pm 07:20 PM

Dieser Artikel reicht aus, um etwas über autonomes Fahren und Flugbahnvorhersage zu lesen!

Feb 28, 2024 pm 07:20 PM

Die Trajektorienvorhersage spielt eine wichtige Rolle beim autonomen Fahren. Unter autonomer Fahrtrajektorienvorhersage versteht man die Vorhersage der zukünftigen Fahrtrajektorie des Fahrzeugs durch die Analyse verschiedener Daten während des Fahrvorgangs. Als Kernmodul des autonomen Fahrens ist die Qualität der Trajektorienvorhersage von entscheidender Bedeutung für die nachgelagerte Planungssteuerung. Die Trajektorienvorhersageaufgabe verfügt über einen umfangreichen Technologie-Stack und erfordert Vertrautheit mit der dynamischen/statischen Wahrnehmung des autonomen Fahrens, hochpräzisen Karten, Fahrspurlinien, Fähigkeiten in der neuronalen Netzwerkarchitektur (CNN&GNN&Transformer) usw. Der Einstieg ist sehr schwierig! Viele Fans hoffen, so schnell wie möglich mit der Flugbahnvorhersage beginnen zu können und Fallstricke zu vermeiden. Heute werde ich eine Bestandsaufnahme einiger häufiger Probleme und einführender Lernmethoden für die Flugbahnvorhersage machen! Einführungsbezogenes Wissen 1. Sind die Vorschaupapiere in Ordnung? A: Schauen Sie sich zuerst die Umfrage an, S

SIMPL: Ein einfacher und effizienter Multi-Agent-Benchmark zur Bewegungsvorhersage für autonomes Fahren

Feb 20, 2024 am 11:48 AM

SIMPL: Ein einfacher und effizienter Multi-Agent-Benchmark zur Bewegungsvorhersage für autonomes Fahren

Feb 20, 2024 am 11:48 AM

Originaltitel: SIMPL: ASimpleandEfficientMulti-agentMotionPredictionBaselineforAutonomousDriving Paper-Link: https://arxiv.org/pdf/2402.02519.pdf Code-Link: https://github.com/HKUST-Aerial-Robotics/SIMPL Autor: Hong Kong University of Science und Technologie DJI-Papieridee: Dieses Papier schlägt eine einfache und effiziente Bewegungsvorhersagebasislinie (SIMPL) für autonome Fahrzeuge vor. Im Vergleich zum herkömmlichen Agent-Cent

nuScenes' neuestes SOTA |. SparseAD: Sparse-Abfrage hilft effizientes durchgängiges autonomes Fahren!

Apr 17, 2024 pm 06:22 PM

nuScenes' neuestes SOTA |. SparseAD: Sparse-Abfrage hilft effizientes durchgängiges autonomes Fahren!

Apr 17, 2024 pm 06:22 PM

Vorab geschrieben und Ausgangspunkt Das End-to-End-Paradigma verwendet ein einheitliches Framework, um Multitasking in autonomen Fahrsystemen zu erreichen. Trotz der Einfachheit und Klarheit dieses Paradigmas bleibt die Leistung von End-to-End-Methoden für das autonome Fahren bei Teilaufgaben immer noch weit hinter Methoden für einzelne Aufgaben zurück. Gleichzeitig erschweren die in früheren End-to-End-Methoden weit verbreiteten Funktionen der dichten Vogelperspektive (BEV) die Skalierung auf mehr Modalitäten oder Aufgaben. Hier wird ein Sparse-Search-zentriertes End-to-End-Paradigma für autonomes Fahren (SparseAD) vorgeschlagen, bei dem die Sparse-Suche das gesamte Fahrszenario, einschließlich Raum, Zeit und Aufgaben, ohne dichte BEV-Darstellung vollständig abbildet. Insbesondere ist eine einheitliche, spärliche Architektur für die Aufgabenerkennung einschließlich Erkennung, Verfolgung und Online-Zuordnung konzipiert. Zudem schwer

Sprechen wir über End-to-End- und autonome Fahrsysteme der nächsten Generation sowie über einige Missverständnisse über End-to-End-Autonomes Fahren?

Apr 15, 2024 pm 04:13 PM

Sprechen wir über End-to-End- und autonome Fahrsysteme der nächsten Generation sowie über einige Missverständnisse über End-to-End-Autonomes Fahren?

Apr 15, 2024 pm 04:13 PM

Im vergangenen Monat hatte ich aus bekannten Gründen einen sehr intensiven Austausch mit verschiedenen Lehrern und Mitschülern der Branche. Ein unvermeidliches Thema im Austausch ist natürlich End-to-End und der beliebte Tesla FSDV12. Ich möchte diese Gelegenheit nutzen, einige meiner aktuellen Gedanken und Meinungen als Referenz und Diskussion darzulegen. Wie definiert man ein durchgängiges autonomes Fahrsystem und welche Probleme sollten voraussichtlich durchgängig gelöst werden? Gemäß der traditionellsten Definition bezieht sich ein End-to-End-System auf ein System, das Rohinformationen von Sensoren eingibt und für die Aufgabe relevante Variablen direkt ausgibt. Bei der Bilderkennung kann CNN beispielsweise als End-to-End bezeichnet werden, verglichen mit der herkömmlichen Methode zum Extrahieren von Merkmalen + Klassifizieren. Bei autonomen Fahraufgaben werden Eingabedaten verschiedener Sensoren (Kamera/LiDAR) benötigt