Technologie-Peripheriegeräte

Technologie-Peripheriegeräte

KI

KI

In diesem Artikel lernen Sie das von Tencent unabhängig entwickelte universelle große Sprachmodell kennen – das große Hunyuan-Modell.

In diesem Artikel lernen Sie das von Tencent unabhängig entwickelte universelle große Sprachmodell kennen – das große Hunyuan-Modell.

In diesem Artikel lernen Sie das von Tencent unabhängig entwickelte universelle große Sprachmodell kennen – das große Hunyuan-Modell.

Am Morgen des 7. September 2023 kündigte Tang Daosheng, Senior Executive Vice President der Tencent Group und CEO der Tencent Cloud and Smart Industry Group, auf der Tencent Global Digital Ecology Conference an, dass Tencent in die Ära der „vollständigen Akzeptanz des Großen“ eintreten wird Modelle“ und gab gleichzeitig auch bekannt, dass Hunyuan, ein von Tencent unabhängig entwickeltes Allzweck-Großsprachenmodell, offiziell der Branche vorgestellt wurde. Laut Tencent-Beamten übertreffen die chinesischen Fähigkeiten des Hunyuan-Modells GPT3.5

Nach der Veröffentlichung wird das Hunyuan-Modell als Basis für Tencent Cloud MaaS-Dienste dienen. Benutzer können es über die offizielle Website von Tencent Cloud erleben und direkt unterstützen Sie können Hunyuan auch als Basismodell verwenden und es in der öffentlichen Cloud entsprechend den tatsächlichen Anforderungen des Unternehmens anpassen.

1. Einführung in das Hunyuan-Modell

2. Das Tencent-Hunyuan-Modell stellt insgesamt 100.000 kostenlose Anruftoken für Tencent Cloud-Unternehmenskonten bereit, die in der Whitelist authentifiziert wurden. Nachdem das Unternehmen den Dienst aktiviert hat, kann es das entsprechende kostenlose Kontingent nutzen. Auf diese Weise können Sie es zunächst testen, um sicherzustellen, dass es Ihren Anforderungen entspricht, und dann die späteren Abrechnungskosten berücksichtigen.

Der aktuelle Preis der Schnittstelle ist immer noch recht angemessen. Wenn das kostenlose Kontingent des Unternehmens aufgebraucht ist, wird ihm folgender Preis in Rechnung gestellt: Tencent Hunyuan Large Model Premium Edition berechnet 0,14 Yuan pro 1.000 Token. (Ein Token entspricht etwa 1 chinesischen Schriftzeichen oder 3 englischen Buchstaben. Insgesamt können mit 14 Cent etwa zwei oder drei Schnittstellenaufrufe abgeschlossen werden.)

Die Zahlungsmethode übernimmt den Postpaid-Tagesabrechnungsmodus. Der Benutzer reicht einen Aktivierungsantrag ein und danach Wenn Sie den Dienst übergeben, können Sie den Dienst gemäß den Dienstregeln von Tencent Cloud nutzen. Die Abrechnung erfolgt entsprechend der tatsächlichen Nutzung und der entsprechende Betrag wird direkt vom Konto abgezogen.

3. Rechenleistung

Laut offiziellen Nachrichten hat das Hunyuan-Großmodell von Tencent derzeit eine Parameterskala von über 100 Milliarden, und der Pre-Training-Korpus übersteigt 2 Billionen Token. Immerhin handelt es sich um einen großen inländischen Hersteller mit sehr leistungsstarken Chinesen Verständnis, Kreativität und logisches Denken sowie andere Fähigkeiten.

Bilder 4. Aktuelle Zugangsszenarien

4. Aktuelle Zugangsszenarien

Tencent Group Vizepräsident Jiang Jie sagte in einem Interview mit den Medien, dass derzeit Tencent Cloud, Tencent Advertising, Tencent Games, Tencent Financial Technology, Tencent Conference, Tencent Documents More Mehr als 50 Tencent-Unternehmen und -Produkte, darunter WeChat Search, QQ Browser usw., wurden alle zum Testen mit dem Tencent Hunyuan-Großmodell verbunden und haben vorläufige Ergebnisse erzielt. Die zukünftigen Entwicklungsaussichten sind sehr vielversprechend.

5. Vorteile des Hunyuan Large Model

In vielen Szenarien konnte das Hunyuan Large Model durch die Positionskodierungsoptimierungstechnologie die Wirkung und Leistung der Langtextverarbeitung verbessern. Darüber hinaus verfügt das große Hunyuan-Modell auch über die Fähigkeit, „Fallen“ zu identifizieren. Einfach ausgedrückt weigert es sich, durch Methoden des verstärkenden Lernens „induziert“ zu werden.

Ein einfaches Beispiel: Wenn Benutzer Fragen stellen, die schwer oder gar nicht zu beantworten sind, kann die Ablehnungsrate für solche Fragen zu Sicherheitshinweisen um 20 % erhöht werden. Dadurch können Fehler und ungültige Antworten erheblich reduziert werden, wodurch die vom Tencent AI-Modell selbst beantworteten Inhalte glaubwürdiger werden. Dies ist auch ein Highlight des großen Modells von Tencent AI.

6. Typische Anwendung des großen Modells von Hunyuan – Tencent Hunyuan Assistant. Benutzer können Warteschlangenerfahrung beantragen und werden bei Genehmigung per SMS daran erinnert. Wer Interesse hat, kann sich vorab im Miniprogramm umsehen und sich schnellstmöglich bewerben. Denn die Anzahl der Plätze für interne Tests ist begrenzt.

Bilder Die Bewerbungsmethode ist sehr einfach: Suchen Sie einfach nach [Tencent Hunyuan Assistant] im WeChat-Miniprogramm, und nachdem Sie das Miniprogramm aufgerufen haben, können Sie sich für interne Tests bewerben

Die Bewerbungsmethode ist sehr einfach: Suchen Sie einfach nach [Tencent Hunyuan Assistant] im WeChat-Miniprogramm, und nachdem Sie das Miniprogramm aufgerufen haben, können Sie sich für interne Tests bewerben

Funktionseinführung

AI-Fragen und Antworten: Dieses und die aktuellen Mainstream-KI-Dialogmodelle haben ähnliche Funktionen und ermöglichen es der KI, Textinhalte einzugeben und dann entsprechende Antworten zu geben.  KI-Malerei ist derzeit eine der beliebtesten Technologien für künstliche Intelligenz. Benutzer können den Inhalt des Bildschirms beschreiben und dann anhand von Schlüsselwörtern ein schönes Gemälde erstellen

KI-Malerei ist derzeit eine der beliebtesten Technologien für künstliche Intelligenz. Benutzer können den Inhalt des Bildschirms beschreiben und dann anhand von Schlüsselwörtern ein schönes Gemälde erstellen

Das obige ist der detaillierte Inhalt vonIn diesem Artikel lernen Sie das von Tencent unabhängig entwickelte universelle große Sprachmodell kennen – das große Hunyuan-Modell.. Für weitere Informationen folgen Sie bitte anderen verwandten Artikeln auf der PHP chinesischen Website!

Heiße KI -Werkzeuge

Undresser.AI Undress

KI-gestützte App zum Erstellen realistischer Aktfotos

AI Clothes Remover

Online-KI-Tool zum Entfernen von Kleidung aus Fotos.

Undress AI Tool

Ausziehbilder kostenlos

Clothoff.io

KI-Kleiderentferner

AI Hentai Generator

Erstellen Sie kostenlos Ai Hentai.

Heißer Artikel

Heiße Werkzeuge

Notepad++7.3.1

Einfach zu bedienender und kostenloser Code-Editor

SublimeText3 chinesische Version

Chinesische Version, sehr einfach zu bedienen

Senden Sie Studio 13.0.1

Leistungsstarke integrierte PHP-Entwicklungsumgebung

Dreamweaver CS6

Visuelle Webentwicklungstools

SublimeText3 Mac-Version

Codebearbeitungssoftware auf Gottesniveau (SublimeText3)

Heiße Themen

1379

1379

52

52

Die große Model-App Tencent Yuanbao ist online! Hunyuan wird zu einem Allround-KI-Assistenten aufgerüstet, der überall hin mitgenommen werden kann

Jun 09, 2024 pm 10:38 PM

Die große Model-App Tencent Yuanbao ist online! Hunyuan wird zu einem Allround-KI-Assistenten aufgerüstet, der überall hin mitgenommen werden kann

Jun 09, 2024 pm 10:38 PM

Am 30. Mai kündigte Tencent ein umfassendes Upgrade seines Hunyuan-Modells an. Die auf dem Hunyuan-Modell basierende App „Tencent Yuanbao“ wurde offiziell eingeführt und kann in den App-Stores von Apple und Android heruntergeladen werden. Im Vergleich zur Hunyuan-Applet-Version in der vorherigen Testphase bietet Tencent Yuanbao Kernfunktionen wie KI-Suche, KI-Zusammenfassung und KI-Schreiben für Arbeitseffizienzszenarien. Yuanbaos Gameplay ist außerdem umfangreicher und bietet mehrere Funktionen für KI-Anwendungen , und neue Spielmethoden wie das Erstellen persönlicher Agenten werden hinzugefügt. „Tencent strebt nicht danach, der Erste zu sein, der große Modelle herstellt.“ Liu Yuhong, Vizepräsident von Tencent Cloud und Leiter des großen Modells von Tencent Hunyuan, sagte: „Im vergangenen Jahr haben wir die Fähigkeiten des großen Modells von Tencent Hunyuan weiter gefördert.“ . In die reichhaltige und umfangreiche polnische Technologie in Geschäftsszenarien eintauchen und gleichzeitig Einblicke in die tatsächlichen Bedürfnisse der Benutzer gewinnen

Das große Bytedance Beanbao-Modell wurde veröffentlicht. Der Full-Stack-KI-Dienst Volcano Engine unterstützt Unternehmen bei der intelligenten Transformation

Jun 05, 2024 pm 07:59 PM

Das große Bytedance Beanbao-Modell wurde veröffentlicht. Der Full-Stack-KI-Dienst Volcano Engine unterstützt Unternehmen bei der intelligenten Transformation

Jun 05, 2024 pm 07:59 PM

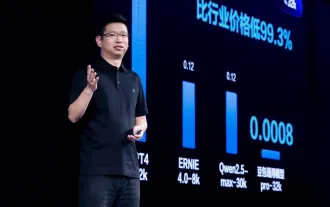

Tan Dai, Präsident von Volcano Engine, sagte, dass Unternehmen, die große Modelle gut implementieren wollen, vor drei zentralen Herausforderungen stehen: Modelleffekt, Inferenzkosten und Implementierungsschwierigkeiten: Sie müssen über eine gute Basisunterstützung für große Modelle verfügen, um komplexe Probleme zu lösen, und das müssen sie auch Dank der kostengünstigen Inferenzdienste können große Modelle weit verbreitet verwendet werden, und es werden mehr Tools, Plattformen und Anwendungen benötigt, um Unternehmen bei der Implementierung von Szenarien zu unterstützen. ——Tan Dai, Präsident von Huoshan Engine 01. Das große Sitzsackmodell feiert sein Debüt und wird häufig genutzt. Das Polieren des Modelleffekts ist die größte Herausforderung für die Implementierung von KI. Tan Dai wies darauf hin, dass ein gutes Modell nur durch ausgiebigen Gebrauch poliert werden kann. Derzeit verarbeitet das Doubao-Modell täglich 120 Milliarden Text-Tokens und generiert 30 Millionen Bilder. Um Unternehmen bei der Umsetzung groß angelegter Modellszenarien zu unterstützen, wird das von ByteDance unabhängig entwickelte Beanbao-Großmodell durch den Vulkan gestartet

Benchmark GPT-4! Das große Jiutian-Modell von China Mobile hat die doppelte Registrierung bestanden

Apr 04, 2024 am 09:31 AM

Benchmark GPT-4! Das große Jiutian-Modell von China Mobile hat die doppelte Registrierung bestanden

Apr 04, 2024 am 09:31 AM

Laut Nachrichten vom 4. April hat die Cyberspace Administration of China kürzlich eine Liste registrierter großer Modelle veröffentlicht, in der das „Jiutian Natural Language Interaction Large Model“ von China Mobile enthalten ist, was darauf hinweist, dass das große Jiutian AI-Modell von China Mobile offiziell generative künstliche Intelligenz bereitstellen kann Geheimdienste nach außen. China Mobile gab an, dass dies das erste groß angelegte Modell sei, das von einem zentralen Unternehmen entwickelt wurde und sowohl die nationale Doppelregistrierung „Generative Artificial Intelligence Service Registration“ als auch die „Domestic Deep Synthetic Service Algorithm Registration“ bestanden habe. Berichten zufolge zeichnet sich Jiutians großes Modell für die Interaktion mit natürlicher Sprache durch verbesserte Branchenfähigkeiten, Sicherheit und Glaubwürdigkeit aus und unterstützt die vollständige Lokalisierung. Es hat mehrere Parameterversionen wie 9 Milliarden, 13,9 Milliarden, 57 Milliarden und 100 Milliarden gebildet. und kann flexibel in der Cloud eingesetzt werden, Edge und End sind unterschiedliche Situationen

Fortgeschrittene Praxis des industriellen Wissensgraphen

Jun 13, 2024 am 11:59 AM

Fortgeschrittene Praxis des industriellen Wissensgraphen

Jun 13, 2024 am 11:59 AM

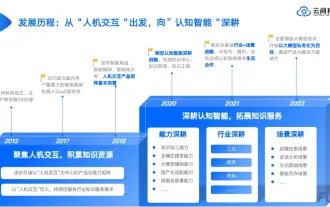

1. Einführung in den Hintergrund Lassen Sie uns zunächst die Entwicklungsgeschichte von Yunwen Technology vorstellen. Yunwen Technology Company ... 2023 ist die Zeit, in der große Modelle vorherrschen. Viele Unternehmen glauben, dass die Bedeutung von Diagrammen nach großen Modellen stark abgenommen hat und die zuvor untersuchten voreingestellten Informationssysteme nicht mehr wichtig sind. Mit der Förderung von RAG und der Verbreitung von Data Governance haben wir jedoch festgestellt, dass eine effizientere Datenverwaltung und qualitativ hochwertige Daten wichtige Voraussetzungen für die Verbesserung der Wirksamkeit privatisierter Großmodelle sind. Deshalb beginnen immer mehr Unternehmen, darauf zu achten zu wissenskonstruktionsbezogenen Inhalten. Dies fördert auch den Aufbau und die Verarbeitung von Wissen auf einer höheren Ebene, wo es viele Techniken und Methoden gibt, die erforscht werden können. Es ist ersichtlich, dass das Aufkommen einer neuen Technologie nicht alle alten Technologien besiegt, sondern auch neue und alte Technologien integrieren kann.

Neuer Test-Benchmark veröffentlicht, der leistungsstärkste Open-Source-Llama 3 ist peinlich

Apr 23, 2024 pm 12:13 PM

Neuer Test-Benchmark veröffentlicht, der leistungsstärkste Open-Source-Llama 3 ist peinlich

Apr 23, 2024 pm 12:13 PM

Wenn die Testfragen zu einfach sind, können sowohl Spitzenschüler als auch schlechte Schüler 90 Punkte erreichen, und der Abstand kann nicht vergrößert werden ... Mit der Veröffentlichung stärkerer Modelle wie Claude3, Llama3 und später sogar GPT-5 ist die Branche in Bewegung Dringender Bedarf an einem schwierigeren und differenzierteren Benchmark-Modell. LMSYS, die Organisation hinter der großen Modellarena, brachte den Benchmark der nächsten Generation, Arena-Hard, auf den Markt, der große Aufmerksamkeit erregte. Es gibt auch die neueste Referenz zur Stärke der beiden fein abgestimmten Versionen der Llama3-Anweisungen. Im Vergleich zu MTBench, das zuvor ähnliche Ergebnisse erzielte, stieg die Arena-Hard-Diskriminierung von 22,6 % auf 87,4 %, was auf den ersten Blick stärker und schwächer ist. Arena-Hard basiert auf menschlichen Echtzeitdaten aus der Arena und seine Übereinstimmungsrate mit menschlichen Vorlieben liegt bei bis zu 89,1 %.

Der Speicheroptimierungsfortschritt der Tencent QQ NT-Architekturversion wurde angekündigt, Chat-Szenen werden innerhalb von 300 MB gesteuert

Mar 05, 2024 pm 03:52 PM

Der Speicheroptimierungsfortschritt der Tencent QQ NT-Architekturversion wurde angekündigt, Chat-Szenen werden innerhalb von 300 MB gesteuert

Mar 05, 2024 pm 03:52 PM

Es wird davon ausgegangen, dass der Tencent QQ-Desktop-Client einer Reihe drastischer Reformen unterzogen wurde. Als Reaktion auf Benutzerprobleme wie hohe Speichernutzung, übergroße Installationspakete und langsamer Start hat das QQ-Technikteam spezielle Optimierungen am Speicher vorgenommen und schrittweise Fortschritte erzielt. Kürzlich hat das QQ-Technikteam einen Einführungsartikel zur InfoQ-Plattform veröffentlicht, in dem es über die schrittweisen Fortschritte bei der speziellen Speicheroptimierung berichtet. Berichten zufolge spiegeln sich die Speicherherausforderungen der neuen Version von QQ hauptsächlich in den folgenden vier Aspekten wider: Produktform: Es besteht aus einem komplexen großen Panel (über 100 Module unterschiedlicher Komplexität) und einer Reihe unabhängiger Funktionsfenster. Es besteht eine Eins-zu-eins-Entsprechung zwischen Fenstern und Renderprozessen. Die Anzahl der Fensterprozesse hat großen Einfluss auf die Speichernutzung von Electron. Für dieses komplexe große Panel gibt es einmal keine

Xiaomi Byte schließt sich zusammen! Ein großes Modell von Xiao Ais Zugang zu Doubao: bereits auf Mobiltelefonen und SU7 installiert

Jun 13, 2024 pm 05:11 PM

Xiaomi Byte schließt sich zusammen! Ein großes Modell von Xiao Ais Zugang zu Doubao: bereits auf Mobiltelefonen und SU7 installiert

Jun 13, 2024 pm 05:11 PM

Laut Nachrichten vom 13. Juni hat Xiaomis Assistent für künstliche Intelligenz „Xiao Ai“ laut Bytes öffentlichem Bericht „Volcano Engine“ eine Zusammenarbeit mit Volcano Engine erzielt. Die beiden Parteien werden ein intelligenteres interaktives KI-Erlebnis auf der Grundlage des großen Beanbao-Modells erzielen . Berichten zufolge kann das von ByteDance erstellte groß angelegte Beanbao-Modell bis zu 120 Milliarden Text-Tokens effizient verarbeiten und täglich 30 Millionen Inhalte generieren. Xiaomi nutzte das große Doubao-Modell, um die Lern- und Denkfähigkeiten seines eigenen Modells zu verbessern und einen neuen „Xiao Ai Classmate“ zu schaffen, der nicht nur die Benutzerbedürfnisse genauer erfasst, sondern auch eine schnellere Reaktionsgeschwindigkeit und umfassendere Inhaltsdienste bietet. Wenn ein Benutzer beispielsweise nach einem komplexen wissenschaftlichen Konzept fragt, &ldq

Um ein neues wissenschaftliches und komplexes Frage-Antwort-Benchmark- und Bewertungssystem für große Modelle bereitzustellen, haben UNSW, Argonne, die University of Chicago und andere Institutionen gemeinsam das SciQAG-Framework eingeführt

Jul 25, 2024 am 06:42 AM

Um ein neues wissenschaftliches und komplexes Frage-Antwort-Benchmark- und Bewertungssystem für große Modelle bereitzustellen, haben UNSW, Argonne, die University of Chicago und andere Institutionen gemeinsam das SciQAG-Framework eingeführt

Jul 25, 2024 am 06:42 AM

Herausgeber | Der Frage-Antwort-Datensatz (QA) von ScienceAI spielt eine entscheidende Rolle bei der Förderung der Forschung zur Verarbeitung natürlicher Sprache (NLP). Hochwertige QS-Datensätze können nicht nur zur Feinabstimmung von Modellen verwendet werden, sondern auch effektiv die Fähigkeiten großer Sprachmodelle (LLMs) bewerten, insbesondere die Fähigkeit, wissenschaftliche Erkenntnisse zu verstehen und zu begründen. Obwohl es derzeit viele wissenschaftliche QS-Datensätze aus den Bereichen Medizin, Chemie, Biologie und anderen Bereichen gibt, weisen diese Datensätze immer noch einige Mängel auf. Erstens ist das Datenformular relativ einfach, die meisten davon sind Multiple-Choice-Fragen. Sie sind leicht auszuwerten, schränken jedoch den Antwortauswahlbereich des Modells ein und können die Fähigkeit des Modells zur Beantwortung wissenschaftlicher Fragen nicht vollständig testen. Im Gegensatz dazu offene Fragen und Antworten