Technologie-Peripheriegeräte

Technologie-Peripheriegeräte

KI

KI

Meta-Open-Source-FACET-Tool zur Bewertung rassistischer und geschlechtsspezifischer Vorurteile in KI-Modellen

Meta-Open-Source-FACET-Tool zur Bewertung rassistischer und geschlechtsspezifischer Vorurteile in KI-Modellen

Meta-Open-Source-FACET-Tool zur Bewertung rassistischer und geschlechtsspezifischer Vorurteile in KI-Modellen

Neuigkeiten vom 2. September: Um das Problem der systemischen Voreingenommenheit gegenüber Frauen und farbigen Menschen in vielen aktuellen Computer-Vision-Modellen zu lindern, hat Meta kürzlich ein neues KI-Tool namens FACET auf den Markt gebracht, um Rasse und Geschlecht in Computer-Vision-Systemen zu identifizieren.

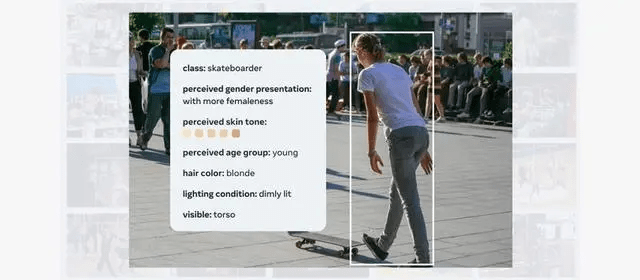

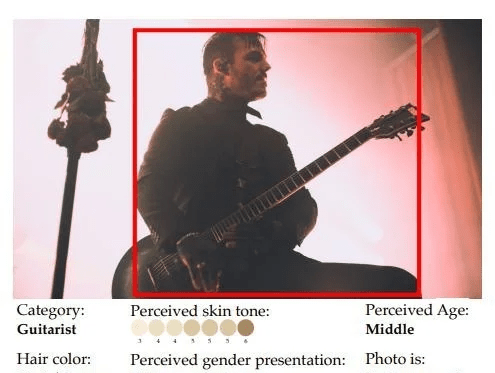

Das FACET-Tool ist derzeit auf 30.000 Bilder trainiert, darunter Bilder von 50.000 Personen. Es verbessert insbesondere die Wahrnehmung von Geschlecht und Hautfarbe und kann zur Bewertung verschiedener Merkmale von Computer-Vision-Modellen verwendet werden.

Das FACET-Tool kann komplexe Fragen nach dem Training beantworten. Beispielsweise kann es nach der Identifizierung des Probanden als Mann weitere Skateboarder sowie helle und dunkle Haut identifizieren.

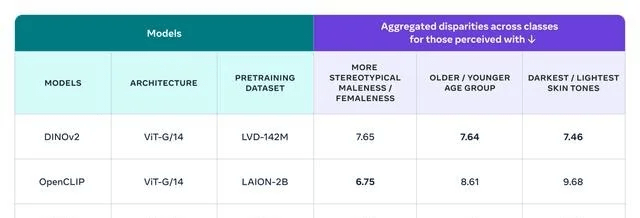

Meta verwendet FACET, um das vom Unternehmen entwickelte Modell DINOv2 und SEERv2 sowie das OpenCLIP-Modell von OpenAI zu bewerten. Insgesamt schneidet OpenCLIP in Bezug auf Geschlecht besser ab, während DINOv eine bessere Leistung bei der Beurteilung von Alter und Hautfarbe aufweist.

Open Sourcing FACET wird Forschern dabei helfen, ein ähnliches Benchmarking durchzuführen, um Verzerrungen in ihren eigenen Modellen zu verstehen und die Auswirkungen von Abhilfemaßnahmen zur Lösung von Gerechtigkeitsproblemen zu überwachen. IT House fügt hier die Adresse der Meta-Pressemitteilung bei, und interessierte Benutzer können sie ausführlich lesen.

【Quelle: IT Home】

Das obige ist der detaillierte Inhalt vonMeta-Open-Source-FACET-Tool zur Bewertung rassistischer und geschlechtsspezifischer Vorurteile in KI-Modellen. Für weitere Informationen folgen Sie bitte anderen verwandten Artikeln auf der PHP chinesischen Website!

Heiße KI -Werkzeuge

Undresser.AI Undress

KI-gestützte App zum Erstellen realistischer Aktfotos

AI Clothes Remover

Online-KI-Tool zum Entfernen von Kleidung aus Fotos.

Undress AI Tool

Ausziehbilder kostenlos

Clothoff.io

KI-Kleiderentferner

Video Face Swap

Tauschen Sie Gesichter in jedem Video mühelos mit unserem völlig kostenlosen KI-Gesichtstausch-Tool aus!

Heißer Artikel

Heiße Werkzeuge

Notepad++7.3.1

Einfach zu bedienender und kostenloser Code-Editor

SublimeText3 chinesische Version

Chinesische Version, sehr einfach zu bedienen

Senden Sie Studio 13.0.1

Leistungsstarke integrierte PHP-Entwicklungsumgebung

Dreamweaver CS6

Visuelle Webentwicklungstools

SublimeText3 Mac-Version

Codebearbeitungssoftware auf Gottesniveau (SublimeText3)

Heiße Themen

1389

1389

52

52

Top 5 Genai Starts vom Februar 2025: GPT-4,5, GROK-3 & MEHR!

Mar 22, 2025 am 10:58 AM

Top 5 Genai Starts vom Februar 2025: GPT-4,5, GROK-3 & MEHR!

Mar 22, 2025 am 10:58 AM

Februar 2025 war ein weiterer bahnbrechender Monat für die Generative KI, die uns einige der am meisten erwarteten Modell-Upgrades und bahnbrechenden neuen Funktionen gebracht hat. Von Xais Grok 3 und Anthropics Claude 3.7 -Sonett, um g zu eröffnen

Wie benutze ich Yolo V12 zur Objekterkennung?

Mar 22, 2025 am 11:07 AM

Wie benutze ich Yolo V12 zur Objekterkennung?

Mar 22, 2025 am 11:07 AM

Yolo (Sie schauen nur einmal) war ein führender Echtzeit-Objekterkennungsrahmen, wobei jede Iteration die vorherigen Versionen verbessert. Die neueste Version Yolo V12 führt Fortschritte vor, die die Genauigkeit erheblich verbessern

Beste KI -Kunstgeneratoren (kostenlos & amp; bezahlt) für kreative Projekte

Apr 02, 2025 pm 06:10 PM

Beste KI -Kunstgeneratoren (kostenlos & amp; bezahlt) für kreative Projekte

Apr 02, 2025 pm 06:10 PM

Der Artikel überprüft Top -KI -Kunstgeneratoren, diskutiert ihre Funktionen, Eignung für kreative Projekte und Wert. Es zeigt MidJourney als den besten Wert für Fachkräfte und empfiehlt Dall-E 2 für hochwertige, anpassbare Kunst.

Ist Chatgpt 4 o verfügbar?

Mar 28, 2025 pm 05:29 PM

Ist Chatgpt 4 o verfügbar?

Mar 28, 2025 pm 05:29 PM

Chatgpt 4 ist derzeit verfügbar und weit verbreitet, wodurch im Vergleich zu seinen Vorgängern wie ChatGPT 3.5 signifikante Verbesserungen beim Verständnis des Kontextes und des Generierens kohärenter Antworten zeigt. Zukünftige Entwicklungen können mehr personalisierte Inters umfassen

Beste AI -Chatbots verglichen (Chatgpt, Gemini, Claude & amp; mehr)

Apr 02, 2025 pm 06:09 PM

Beste AI -Chatbots verglichen (Chatgpt, Gemini, Claude & amp; mehr)

Apr 02, 2025 pm 06:09 PM

Der Artikel vergleicht Top -KI -Chatbots wie Chatgpt, Gemini und Claude und konzentriert sich auf ihre einzigartigen Funktionen, Anpassungsoptionen und Leistung in der Verarbeitung und Zuverlässigkeit natürlicher Sprache.

Erste Schritte mit Meta Lama 3.2 - Analytics Vidhya

Apr 11, 2025 pm 12:04 PM

Erste Schritte mit Meta Lama 3.2 - Analytics Vidhya

Apr 11, 2025 pm 12:04 PM

Metas Lama 3.2: Ein Sprung nach vorne in der multimodalen und mobilen KI Meta hat kürzlich Lama 3.2 vorgestellt, ein bedeutender Fortschritt in der KI mit leistungsstarken Sichtfunktionen und leichten Textmodellen, die für mobile Geräte optimiert sind. Aufbau auf dem Erfolg o

Top -KI -Schreibassistenten, um Ihre Inhaltserstellung zu steigern

Apr 02, 2025 pm 06:11 PM

Top -KI -Schreibassistenten, um Ihre Inhaltserstellung zu steigern

Apr 02, 2025 pm 06:11 PM

In dem Artikel werden Top -KI -Schreibassistenten wie Grammarly, Jasper, Copy.ai, Writesonic und RYTR erläutert und sich auf ihre einzigartigen Funktionen für die Erstellung von Inhalten konzentrieren. Es wird argumentiert, dass Jasper in der SEO -Optimierung auszeichnet, während KI -Tools dazu beitragen, den Ton zu erhalten

Leitfaden für die räumliche Indexierung von Uber ' s H3

Mar 22, 2025 am 10:54 AM

Leitfaden für die räumliche Indexierung von Uber ' s H3

Mar 22, 2025 am 10:54 AM

In der heutigen datengesteuerten Welt ist eine effiziente Geospatial-Indexierung für Anwendungen, die von Mitfahrgelegenheiten und Logistik bis hin zu Umweltüberwachung und Katastrophenreaktion reichen, von entscheidender Bedeutung. Ubers H3, ein mächtiger Open-Source-Spucke