Technologie-Peripheriegeräte

Technologie-Peripheriegeräte

KI

KI

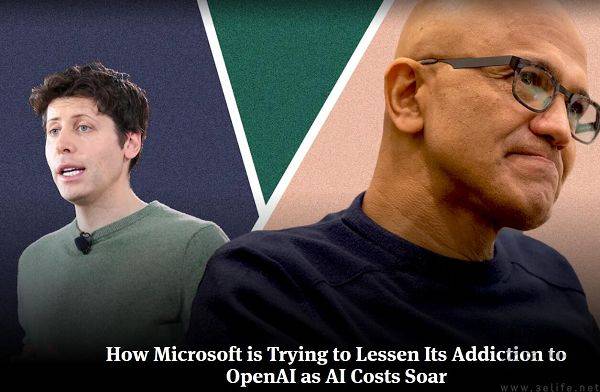

Microsoft bringt kleines KI-Modell auf den Markt, führt heimlich „Plan B' durch, hat nichts mit OpenAI zu tun

Microsoft bringt kleines KI-Modell auf den Markt, führt heimlich „Plan B' durch, hat nichts mit OpenAI zu tun

Microsoft bringt kleines KI-Modell auf den Markt, führt heimlich „Plan B' durch, hat nichts mit OpenAI zu tun

Große KI-Modelle werden im Jahr 2023 zu einem Schlüsselwort und es ist auch ein heißer Wettbewerbsbereich zwischen großen Technologieunternehmen. Allerdings sind die Kosten für dieses große KI-Modell, das die Zukunft symbolisiert, zu hoch, sodass selbst wohlhabende Unternehmen wie Microsoft beginnen, über Alternativen nachzudenken. Jüngste Enthüllungen zeigen, dass sich einige Mitglieder des 1.500-köpfigen Forschungsteams von Microsoft unter der Leitung von Peter Lee der Entwicklung eines neuen LLM zugewandt haben, das kleiner ist und niedrigere Betriebskosten aufweist

Bezüglich des kleinen KI-Modells von Microsoft tauchten vor drei Monaten erste Hinweise auf. Im Juni dieses Jahres veröffentlichte Microsoft ein Papier mit dem Titel „Textbooks Are All You Need“, in dem Daten auf „Lehrbuchebene“ von nur 7 Milliarden Token verwendet wurden, um ein 1,3 Milliarden Parameter umfassendes Phi-1-Modell zu trainieren, was beweist, dass selbst in kleinem Maßstab High- Hochwertige Daten können dem Modell auch eine gute Leistung ermöglichen. Darüber hinaus hat Microsoft Research auch ein neues vorab trainiertes Sprachmodell namens Phi-1.5 veröffentlicht, das auf Phi-1 basiert und für QA-Fragen und Antworten, Chat-Formate und Codeszenarien geeignet ist

Laut Microsoft übertrifft phi-1.5 eine beträchtliche Anzahl großer Modelle bei Benchmarks, die den gesunden Menschenverstand, das Sprachverständnis und das logische Denken testen. In der GPT4AL-Running-Score-Suite mit LM-Eval Harness ist phi-1.5 mit 7 Milliarden Parametern mit Metas Open-Source-Großmodell llama-2 vergleichbar und übertrifft sogar llama-2 im AGIEval-Score.

Warum entwickelt Microsoft plötzlich kleine KI-Modelle? Es wird allgemein angenommen, dass dies mit Problemen zwischen OpenAI zusammenhängt. Microsoft ist ein großer Investor in OpenAI und kann daher das bestehende geistige Eigentum von OpenAI dauerhaft nutzen, aber die Entscheidungsfindung von OpenAI nicht kontrollieren. Daher ist es für einen Giganten wie Microsoft unerlässlich, qualitativ hochwertige, kleine KI-Modelle zu entwickeln, sei es aus eigenen strategischen Sicherheitsüberlegungen oder um eine günstige Position in der Zusammenarbeit mit OpenAI zu behaupten

Natürlich ist der aktuelle Energieverbrauch großer KI-Modelle ein entscheidender Faktor. Auf der Design Automation Conference Anfang des Jahres zeigte Mark Papermaster, Chief Technology Officer von AMD, eine Folie, in der er den Energieverbrauch maschineller Lernsysteme mit der globalen Stromerzeugung vergleicht. Schätzungen der Internationalen Energieagentur zufolge sind Rechenzentren, in denen große Modelle trainiert werden, immer energieintensiver und machen 1,5 bis 2 % des weltweiten Stromverbrauchs aus, was dem Stromverbrauch des gesamten Vereinigten Königreichs entspricht. Es wird erwartet, dass dieser Anteil bis 2030 auf 4 % steigen wird

Laut einem relevanten Bericht von Digital Information World wird der Energieverbrauch von Rechenzentren für das Training von KI-Modellen dreimal so hoch sein wie bei herkömmlichen Cloud-Diensten. Bis 2028 wird der Stromverbrauch von Rechenzentren fast 4.250 Megawatt betragen 212 Mal ab 2023. Der Stromverbrauch des OpenAI-Trainings GPT-3 beträgt 1,287 Gigawattstunden, was ungefähr dem Stromverbrauch von 120 amerikanischen Haushalten für ein Jahr entspricht. Dies ist jedoch nur der anfängliche Stromverbrauch beim Training des KI-Modells, der nur 40 % des Stromverbrauchs ausmacht, wenn das Modell tatsächlich verwendet wird.

Laut dem von Google veröffentlichten Umweltbericht 2023 wird das Training großer KI-Modelle nicht nur viel Energie, sondern auch viele Wasserressourcen verbrauchen. Dem Bericht zufolge verbrauchte Google im Jahr 2022 5,6 Milliarden Gallonen (ca. 21,2 Milliarden Liter) Wasser, was dem Wasserverbrauch von 37 Golfplätzen entspricht. Davon werden 5,2 Milliarden Gallonen in den Rechenzentren von Google verbraucht, ein Anstieg von 20 % gegenüber 2021

Hoher Energieverbrauch großer KI-Modelle ist normal. Mit den Worten von Ian Bratt, Senior Technical Director bei ARM: „Der KI-Computing-Bedarf kann nicht gedeckt werden. Je größer die Netzwerkgröße, desto besser die Ergebnisse, desto mehr Probleme können gelöst werden, und der Stromverbrauch ist proportional zur Netzwerkgröße.“

Einige Praktiker der künstlichen Intelligenz sagten, dass vor der Epidemie der Energieverbrauch zum Trainieren eines Transformer-Modells im Bereich von 27 Kilowattstunden lag. Mittlerweile ist jedoch die Anzahl der Parameter des Transformer-Modells von 50 Millionen auf 200 Millionen gestiegen und der Energieverbrauch hat 500.000 Kilowattstunden überschritten. Mit anderen Worten: Die Anzahl der Parameter hat sich vervierfacht, der Energieverbrauch jedoch um mehr als das 18.000-fache. In gewisser Weise gehen die verschiedenen innovativen Funktionen, die große Modelle der künstlichen Intelligenz mit sich bringen, tatsächlich auf Kosten einer hohen Rechenleistung und eines hohen Energieverbrauchs

Mehr Strom treibt mehr GPUs für das KI-Training an und es wird viel Wasser verbraucht, um die GPUs zu kühlen. Das ist das Problem. So sehr, dass bekannt wurde, dass Microsoft einen Fahrplan für den Betrieb von Rechenzentren mit Strom aus kleinen Kernreaktoren entwickelt. Darüber hinaus ist es wertvoll, kleine Modelle rein aus der Kostenperspektive zu untersuchen, auch ohne ESG („Environmental, Social and Governance“) zu erwähnen.

Wie wir alle wissen, ist NVIDIA, das das CUDA-Ökosystem aufgebaut hat, der größte Nutznießer dieser Runde des KI-Booms und hat bereits 70 % des KI-Chipmarktes besetzt. Heutzutage sind es Computerkarten wie H100 und A100 schwer zu finden. Die aktuelle Situation ist jedoch, dass der Kauf von Rechenleistung von NVIDIA zu einem wichtigen Faktor geworden ist, der die Kosten für KI-Hersteller in die Höhe treibt. Daher bedeutet ein kleines Modell, dass es weniger Rechenressourcen benötigt und Sie nur weniger GPUs kaufen müssen, um das Problem zu lösen.

Obwohl die leistungsstärkeren Großmodelle in der Tat hervorragend sind, steckt die Kommerzialisierung von Großmodellen noch in den Kinderschuhen, und der einzige, der viel Geld verdient, ist NVIDIAs Rolle als „Schaufelverkäufer“. Daher beabsichtigt Microsoft in diesem Fall natürlich, den Status Quo zu ändern

Das obige ist der detaillierte Inhalt vonMicrosoft bringt kleines KI-Modell auf den Markt, führt heimlich „Plan B' durch, hat nichts mit OpenAI zu tun. Für weitere Informationen folgen Sie bitte anderen verwandten Artikeln auf der PHP chinesischen Website!

Heiße KI -Werkzeuge

Undresser.AI Undress

KI-gestützte App zum Erstellen realistischer Aktfotos

AI Clothes Remover

Online-KI-Tool zum Entfernen von Kleidung aus Fotos.

Undress AI Tool

Ausziehbilder kostenlos

Clothoff.io

KI-Kleiderentferner

AI Hentai Generator

Erstellen Sie kostenlos Ai Hentai.

Heißer Artikel

Heiße Werkzeuge

Notepad++7.3.1

Einfach zu bedienender und kostenloser Code-Editor

SublimeText3 chinesische Version

Chinesische Version, sehr einfach zu bedienen

Senden Sie Studio 13.0.1

Leistungsstarke integrierte PHP-Entwicklungsumgebung

Dreamweaver CS6

Visuelle Webentwicklungstools

SublimeText3 Mac-Version

Codebearbeitungssoftware auf Gottesniveau (SublimeText3)

Heiße Themen

1376

1376

52

52

Die Nachfrage nach Rechenleistung ist im Zuge der Welle großer KI-Modelle explodiert. „Großes Modell + große Rechenleistung' von SenseTime ermöglicht die Entwicklung mehrerer Branchen.

Jun 09, 2023 pm 07:35 PM

Die Nachfrage nach Rechenleistung ist im Zuge der Welle großer KI-Modelle explodiert. „Großes Modell + große Rechenleistung' von SenseTime ermöglicht die Entwicklung mehrerer Branchen.

Jun 09, 2023 pm 07:35 PM

Kürzlich fand die „Lingang New Area Intelligent Computing Conference“ mit dem Thema „KI führt die Ära an, Rechenleistung treibt die Zukunft“ statt. Bei dem Treffen wurde die New Area Intelligent Computing Industry Alliance offiziell als Anbieter von Rechenleistung gegründet. Gleichzeitig wurde SenseTime der Titel „New Area Intelligent Computing Industry Chain Master“ verliehen. Als aktiver Teilnehmer am Lingang-Rechenleistungs-Ökosystem hat SenseTime derzeit eine der größten intelligenten Computerplattformen Asiens aufgebaut – SenseTime AIDC, die eine Gesamtrechenleistung von 5.000 Petaflops ausgeben und 20 ultragroße Modelle mit Hunderten von Milliarden Parametern unterstützen kann. Trainiere gleichzeitig. SenseCore, ein auf AIDC basierendes und zukunftsorientiertes Großgerät, hat sich zum Ziel gesetzt, eine hocheffiziente, kostengünstige und groß angelegte KI-Infrastruktur und -Dienste der nächsten Generation zu schaffen, um künstliche Intelligenz zu stärken.

Forscher: KI-Modellinferenz verbraucht mehr Strom und der Stromverbrauch der Industrie wird im Jahr 2027 mit dem der Niederlande vergleichbar sein

Oct 14, 2023 am 08:25 AM

Forscher: KI-Modellinferenz verbraucht mehr Strom und der Stromverbrauch der Industrie wird im Jahr 2027 mit dem der Niederlande vergleichbar sein

Oct 14, 2023 am 08:25 AM

IT House berichtete am 13. Oktober, dass „Joule“, eine Schwesterzeitschrift von „Cell“, diese Woche einen Artikel mit dem Titel „Der wachsende Energie-Fußabdruck künstlicher Intelligenz“ veröffentlicht hat. Durch Nachfragen erfuhren wir, dass dieses Papier von Alex DeVries, dem Gründer der wissenschaftlichen Forschungseinrichtung Digiconomist, veröffentlicht wurde. Er behauptete, dass die Denkleistung der künstlichen Intelligenz in Zukunft viel Strom verbrauchen könnte. Schätzungen zufolge könnte der Stromverbrauch der künstlichen Intelligenz bis 2027 dem Stromverbrauch der Niederlande für ein Jahr entsprechen Die Außenwelt hat immer geglaubt, dass das Training eines KI-Modells „das Wichtigste in der KI“ sei.

Wenn sie anderer Meinung sind, werden sie punkten. Warum sind große inländische KI-Modelle süchtig danach, „die Rangliste zu klauen'?

Dec 02, 2023 am 08:53 AM

Wenn sie anderer Meinung sind, werden sie punkten. Warum sind große inländische KI-Modelle süchtig danach, „die Rangliste zu klauen'?

Dec 02, 2023 am 08:53 AM

Ich glaube, dass Freunden, die dem Handykreis folgen, der Satz „Bekomme eine Punktzahl, wenn du sie nicht akzeptierst“ nicht unbekannt sein wird. Beispielsweise haben theoretische Leistungstestsoftware wie AnTuTu und GeekBench große Aufmerksamkeit bei Spielern auf sich gezogen, da sie die Leistung von Mobiltelefonen bis zu einem gewissen Grad widerspiegeln können. Ebenso gibt es entsprechende Benchmarking-Software für PC-Prozessoren und Grafikkarten, um deren Leistung zu messen. Da „alles bewertet werden kann“, nehmen auch die beliebtesten großen KI-Modelle an Benchmarking-Wettbewerben teil, insbesondere an den „Hundert Modellen“. Der „Krieg“ begann, fast jeden Tag gab es Durchbrüche. Die großen inländischen KI-Modelle fielen in Bezug auf die Leistungswerte fast nie zurück, waren jedoch nie in der Lage, GP zu übertreffen der Benutzererfahrung.

China Unicom veröffentlicht ein KI-Modell für große Bilder und Texte, das Bilder und Videoclips aus Text generieren kann

Jun 29, 2023 am 09:26 AM

China Unicom veröffentlicht ein KI-Modell für große Bilder und Texte, das Bilder und Videoclips aus Text generieren kann

Jun 29, 2023 am 09:26 AM

Driving China News am 28. Juni 2023, heute während des Mobile World Congress in Shanghai, veröffentlichte China Unicom das Grafikmodell „Honghu Graphic Model 1.0“. China Unicom sagte, dass das Honghu-Grafikmodell das erste große Modell für Mehrwertdienste von Betreibern sei. Ein Reporter von China Business News erfuhr, dass das Grafikmodell von Honghu derzeit über zwei Versionen von 800 Millionen Trainingsparametern und 2 Milliarden Trainingsparametern verfügt, mit denen Funktionen wie textbasierte Bilder, Videobearbeitung und bildbasierte Bilder realisiert werden können. Darüber hinaus sagte Liu Liehong, Vorsitzender von China Unicom, in seiner heutigen Grundsatzrede, dass generative KI eine einzigartige Entwicklung einleitet und 50 % der Arbeitsplätze in den nächsten zwei Jahren stark von künstlicher Intelligenz betroffen sein werden.

Das Netzwerkzentrum des Joint Institute of Physics der Chinesischen Akademie der Wissenschaften veröffentlicht das KI-Modell MatChat

Nov 03, 2023 pm 08:13 PM

Das Netzwerkzentrum des Joint Institute of Physics der Chinesischen Akademie der Wissenschaften veröffentlicht das KI-Modell MatChat

Nov 03, 2023 pm 08:13 PM

IT House berichtete am 3. November, dass auf der offiziellen Website des Instituts für Physik der Chinesischen Akademie der Wissenschaften kürzlich ein Artikel der SF10-Gruppe des Instituts für Physik der Chinesischen Akademie der Wissenschaften/Beijing National Research Center for Condensed Matter Physics veröffentlicht wurde und das Computer Network Information Center der Chinesischen Akademie der Wissenschaften haben zusammengearbeitet, um große KI-Modelle auf die Materialwissenschaft anzuwenden. Vor Ort werden Zehntausende von Daten zu chemischen Synthesewegen in das große Sprachmodell LLAMA2-7b eingespeist, wodurch ein MatChat-Modell entsteht , mit deren Hilfe die Synthesewege anorganischer Materialien vorhergesagt werden können. IT House stellte fest, dass das Modell logische Überlegungen basierend auf der abgefragten Struktur durchführen und den entsprechenden Vorbereitungsprozess und die entsprechende Formel ausgeben kann. Es wurde online bereitgestellt und steht allen Materialforschern offen und bringt neue Inspiration und neue Ideen in die Materialforschung und -innovation. Diese Arbeit konzentriert sich auf große Sprachmodelle im Bereich der segmentierten Wissenschaft

Viermal schneller, enthüllte ByteDances Open-Source-Hochleistungs-Trainings-Inferenz-Engine LightSeq-Technologie

May 02, 2023 pm 05:52 PM

Viermal schneller, enthüllte ByteDances Open-Source-Hochleistungs-Trainings-Inferenz-Engine LightSeq-Technologie

May 02, 2023 pm 05:52 PM

Das Transformer-Modell stammt aus dem vom Google-Team im Jahr 2017 veröffentlichten Artikel „Attentionisallyouneed“. In diesem Artikel wurde zunächst das Konzept vorgeschlagen, Aufmerksamkeit als Ersatz für die zyklische Struktur des Seq2Seq-Modells zu verwenden, was große Auswirkungen auf den NLP-Bereich hatte. Und mit der kontinuierlichen Weiterentwicklung der Forschung in den letzten Jahren sind Transformer-bezogene Technologien nach und nach von der Verarbeitung natürlicher Sprache auf andere Bereiche übergegangen. Bisher sind die Modelle der Transformer-Serie zu Mainstream-Modellen in NLP, CV, ASR und anderen Bereichen geworden. Daher ist die Frage, wie Transformer-Modelle schneller trainiert und abgeleitet werden können, zu einer wichtigen Forschungsrichtung in der Branche geworden. Quantisierungstechniken mit geringer Präzision können

Metaforscher unternehmen einen neuen Versuch der KI: Sie bringen Robotern das physische Navigieren bei, ohne Karten oder Training

Apr 09, 2023 pm 08:31 PM

Metaforscher unternehmen einen neuen Versuch der KI: Sie bringen Robotern das physische Navigieren bei, ohne Karten oder Training

Apr 09, 2023 pm 08:31 PM

Die Abteilung für künstliche Intelligenz von Meta Platforms erklärte kürzlich, dass sie KI-Modellen mit Unterstützung einer kleinen Menge an Trainingsdaten das Laufenlernen in der physischen Welt beibringen und dabei schnelle Fortschritte gemacht haben. Diese Forschung kann die Zeit, die KI-Modelle benötigen, um visuelle Navigationsfähigkeiten zu erwerben, erheblich verkürzen. Bisher war zum Erreichen solcher Ziele wiederholtes „Reinforcement Learning“ unter Verwendung großer Datensätze erforderlich. Meta-KI-Forscher sagten, dass diese Erforschung der visuellen KI-Navigation erhebliche Auswirkungen auf die virtuelle Welt haben wird. Die Grundidee des Projekts ist nicht kompliziert: der KI dabei zu helfen, sich genauso wie Menschen durch den physischen Raum zu bewegen, einfach durch Beobachtung und Erkundung. Die Meta-KI-Abteilung erklärte: „Wenn wir beispielsweise möchten, dass uns eine AR-Brille beim Auffinden von Schlüsseln hilft, müssen wir das tun.“

Nvidia veröffentlicht die Open-Source-Software TensorRT-LLM, um die Leistung von KI-Modellen auf High-End-GPU-Chips zu verbessern

Sep 14, 2023 pm 12:29 PM

Nvidia veröffentlicht die Open-Source-Software TensorRT-LLM, um die Leistung von KI-Modellen auf High-End-GPU-Chips zu verbessern

Sep 14, 2023 pm 12:29 PM

Nvidia hat kürzlich die Einführung einer neuen Open-Source-Software-Suite namens TensorRT-LLM angekündigt, die die Möglichkeiten der Optimierung großer Sprachmodelle auf Nvidia-GPUs erweitert und nach der Bereitstellung die Grenzen der Inferenzleistung künstlicher Intelligenz sprengt. Generative KI-Modelle für große Sprachen erfreuen sich aufgrund ihrer beeindruckenden Fähigkeiten großer Beliebtheit. Es erweitert die Möglichkeiten der künstlichen Intelligenz und findet breite Anwendung in verschiedenen Branchen. Benutzer können Informationen erhalten, indem sie mit Chatbots sprechen, große Dokumente zusammenfassen, Softwarecode schreiben und neue Wege zum Verständnis von Informationen entdecken, sagte Ian Buck, Vizepräsident für Hyperscale und High Performance Computing bei Nvidia Corporation: „Die Inferenz großer Sprachmodelle wird immer beliebter.“ schwierig. Die Komplexität des Modells nimmt weiter zu, das Modell wird immer intelligenter