Technologie-Peripheriegeräte

Technologie-Peripheriegeräte

KI

KI

Probleme bei der Algorithmenauswahl beim Reinforcement Learning

Probleme bei der Algorithmenauswahl beim Reinforcement Learning

Probleme bei der Algorithmenauswahl beim Reinforcement Learning

Das Problem der Algorithmenauswahl beim Reinforcement Learning erfordert spezifische Codebeispiele

Reinforcement Learning ist ein Bereich des maschinellen Lernens, das durch die Interaktion zwischen dem Agenten und der Umgebung optimale Strategien lernt. Beim Reinforcement Learning ist die Wahl eines geeigneten Algorithmus entscheidend für den Lerneffekt. In diesem Artikel untersuchen wir Probleme bei der Algorithmusauswahl beim Reinforcement Learning und stellen konkrete Codebeispiele bereit.

Beim Reinforcement Learning stehen viele Algorithmen zur Auswahl, z. B. Q-Learning, Deep Q Network (DQN), Actor-Critic usw. Die Auswahl eines geeigneten Algorithmus hängt von Faktoren wie der Komplexität des Problems, der Größe des Zustands- und Aktionsraums sowie der Verfügbarkeit von Rechenressourcen ab.

Schauen wir uns zunächst ein einfaches Problem des Verstärkungslernens an, das Labyrinthproblem. Bei diesem Problem muss der Agent den kürzesten Weg vom Startpunkt zum Endpunkt finden. Wir können den Q-Learning-Algorithmus verwenden, um dieses Problem zu lösen. Das Folgende ist ein Beispielcode:

import numpy as np

# 创建迷宫

maze = np.array([

[1, 1, 1, 1, 1, 1, 1, 1, 1, 1],

[1, 0, 0, 1, 0, 0, 0, 1, 0, 1],

[1, 0, 0, 1, 0, 0, 0, 1, 0, 1],

[1, 0, 0, 0, 0, 1, 1, 0, 0, 1],

[1, 0, 1, 1, 1, 0, 0, 0, 0, 1],

[1, 0, 0, 0, 1, 0, 0, 0, 1, 1],

[1, 1, 1, 1, 1, 1, 1, 1, 1, 1]

])

# 定义Q表格

Q = np.zeros((maze.shape[0], maze.shape[1], 4))

# 设置超参数

epochs = 5000

epsilon = 0.9

alpha = 0.1

gamma = 0.6

# Q-Learning算法

for episode in range(epochs):

state = (1, 1) # 设置起点

while state != (6, 8): # 终点

x, y = state

possible_actions = np.where(maze[x, y] == 0)[0] # 可能的动作

action = np.random.choice(possible_actions) # 选择动作

next_state = None

if action == 0:

next_state = (x - 1, y)

elif action == 1:

next_state = (x + 1, y)

elif action == 2:

next_state = (x, y - 1)

elif action == 3:

next_state = (x, y + 1)

reward = -1 if next_state == (6, 8) else 0 # 终点奖励为0,其他状态奖励为-1

Q[x, y, action] = (1 - alpha) * Q[x, y, action] + alpha * (reward + gamma * np.max(Q[next_state]))

state = next_state

print(Q)Der Q-Learning-Algorithmus im obigen Code lernt die optimale Richtlinie durch Aktualisieren der Q-Tabelle. Die Abmessungen der Q-Tabelle entsprechen den Abmessungen des Labyrinths, wobei jedes Element den Vorteil darstellt, den der Agent durch die Ausführung verschiedener Aktionen in einem bestimmten Zustand erfährt.

Neben Q-Learning können auch andere Algorithmen zur Lösung komplexerer Reinforcement-Learning-Probleme eingesetzt werden. Wenn beispielsweise der Zustandsraum und der Aktionsraum des Problems groß sind, können tiefgreifende Reinforcement-Learning-Algorithmen wie DQN verwendet werden. Das Folgende ist ein einfacher DQN-Beispielcode:

import torch

import torch.nn as nn

import torch.optim as optim

import random

# 创建神经网络

class DQN(nn.Module):

def __init__(self, input_size, output_size):

super(DQN, self).__init__()

self.fc1 = nn.Linear(input_size, 16)

self.fc2 = nn.Linear(16, output_size)

def forward(self, x):

x = torch.relu(self.fc1(x))

x = self.fc2(x)

return x

# 定义超参数

input_size = 4

output_size = 2

epochs = 1000

batch_size = 128

gamma = 0.99

epsilon = 0.2

# 创建经验回放内存

memory = []

capacity = 10000

# 创建神经网络和优化器

model = DQN(input_size, output_size)

optimizer = optim.Adam(model.parameters(), lr=0.001)

# 定义经验回放函数

def append_memory(state, action, next_state, reward):

memory.append((state, action, next_state, reward))

if len(memory) > capacity:

del memory[0]

# 定义训练函数

def train():

if len(memory) < batch_size:

return

batch = random.sample(memory, batch_size)

state_batch, action_batch, next_state_batch, reward_batch = zip(*batch)

state_batch = torch.tensor(state_batch, dtype=torch.float)

action_batch = torch.tensor(action_batch, dtype=torch.long)

next_state_batch = torch.tensor(next_state_batch, dtype=torch.float)

reward_batch = torch.tensor(reward_batch, dtype=torch.float)

current_q = model(state_batch).gather(1, action_batch.unsqueeze(1))

next_q = model(next_state_batch).max(1)[0].detach()

target_q = reward_batch + gamma * next_q

loss = nn.MSELoss()(current_q, target_q.unsqueeze(1))

optimizer.zero_grad()

loss.backward()

optimizer.step()

# DQN算法

for episode in range(epochs):

state = env.reset()

total_reward = 0

while True:

if random.random() < epsilon:

action = env.action_space.sample()

else:

action = model(torch.tensor(state, dtype=torch.float)).argmax().item()

next_state, reward, done, _ = env.step(action)

append_memory(state, action, next_state, reward)

train()

state = next_state

total_reward += reward

if done:

break

if episode % 100 == 0:

print("Episode: ", episode, " Total Reward: ", total_reward)

print("Training finished.")Der DQN-Algorithmus im obigen Code verwendet ein neuronales Netzwerk, um die Q-Funktion anzunähern, und trainiert das Netzwerk durch Interaktion mit der Umgebung, um die optimale Richtlinie zu lernen.

Anhand der obigen Codebeispiele können wir sehen, dass beim verstärkenden Lernen verschiedene Algorithmen ausgewählt werden können, um das Problem entsprechend den Merkmalen des Problems zu lösen. Q-Learning eignet sich für Probleme, bei denen der Zustandsraum und der Aktionsraum klein sind, während DQN für komplexe Probleme geeignet ist, bei denen der Zustandsraum und der Aktionsraum groß sind.

In praktischen Anwendungen ist die Auswahl eines Algorithmus jedoch keine leichte Aufgabe. Abhängig von den Merkmalen des Problems können wir verschiedene Algorithmen ausprobieren und anhand der Ergebnisse den am besten geeigneten Algorithmus auswählen. Bei der Auswahl eines Algorithmus müssen Sie auch auf Faktoren wie Konvergenz, Stabilität und Rechenkomplexität des Algorithmus achten und auf der Grundlage spezifischer Anforderungen Kompromisse eingehen.

Kurz gesagt, beim Reinforcement Learning ist die Auswahl des Algorithmus ein Schlüsselelement. Indem wir den Algorithmus rational auswählen und entsprechend spezifischer Probleme optimieren und verbessern, können wir in praktischen Anwendungen bessere Ergebnisse des verstärkenden Lernens erzielen.

Das obige ist der detaillierte Inhalt vonProbleme bei der Algorithmenauswahl beim Reinforcement Learning. Für weitere Informationen folgen Sie bitte anderen verwandten Artikeln auf der PHP chinesischen Website!

Heiße KI -Werkzeuge

Undresser.AI Undress

KI-gestützte App zum Erstellen realistischer Aktfotos

AI Clothes Remover

Online-KI-Tool zum Entfernen von Kleidung aus Fotos.

Undress AI Tool

Ausziehbilder kostenlos

Clothoff.io

KI-Kleiderentferner

AI Hentai Generator

Erstellen Sie kostenlos Ai Hentai.

Heißer Artikel

Heiße Werkzeuge

Notepad++7.3.1

Einfach zu bedienender und kostenloser Code-Editor

SublimeText3 chinesische Version

Chinesische Version, sehr einfach zu bedienen

Senden Sie Studio 13.0.1

Leistungsstarke integrierte PHP-Entwicklungsumgebung

Dreamweaver CS6

Visuelle Webentwicklungstools

SublimeText3 Mac-Version

Codebearbeitungssoftware auf Gottesniveau (SublimeText3)

Heiße Themen

Deep-Reinforcement-Learning-Technologie in C++

Aug 21, 2023 pm 11:33 PM

Deep-Reinforcement-Learning-Technologie in C++

Aug 21, 2023 pm 11:33 PM

Die Deep-Reinforcement-Learning-Technologie ist ein Zweig der künstlichen Intelligenz, der viel Aufmerksamkeit erregt hat. Sie hat mehrere internationale Wettbewerbe gewonnen und wird auch häufig in persönlichen Assistenten, autonomem Fahren, Spielintelligenz und anderen Bereichen eingesetzt. Bei der Umsetzung von Deep Reinforcement Learning ist C++ als effiziente und hervorragende Programmiersprache besonders wichtig, wenn die Hardwareressourcen begrenzt sind. Deep Reinforcement Learning kombiniert, wie der Name schon sagt, Technologien aus den beiden Bereichen Deep Learning und Reinforcement Learning. Um es einfach zu verstehen: Deep Learning bezieht sich auf das Lernen von Funktionen aus Daten und das Treffen von Entscheidungen durch den Aufbau eines mehrschichtigen neuronalen Netzwerks.

Probleme beim Design von Belohnungsfunktionen beim verstärkenden Lernen

Oct 09, 2023 am 11:58 AM

Probleme beim Design von Belohnungsfunktionen beim verstärkenden Lernen

Oct 09, 2023 am 11:58 AM

Probleme beim Design von Belohnungsfunktionen beim Reinforcement Learning Einführung Reinforcement Learning ist eine Methode, die optimale Strategien durch die Interaktion zwischen einem Agenten und der Umgebung lernt. Beim verstärkenden Lernen ist die Gestaltung der Belohnungsfunktion entscheidend für den Lerneffekt des Agenten. In diesem Artikel werden Probleme beim Design von Belohnungsfunktionen beim Reinforcement Learning untersucht und spezifische Codebeispiele bereitgestellt. Die Rolle der Belohnungsfunktion und der Zielbelohnungsfunktion sind ein wichtiger Teil des Verstärkungslernens und werden zur Bewertung des Belohnungswerts verwendet, den der Agent in einem bestimmten Zustand erhält. Sein Design hilft dem Agenten dabei, die langfristige Ermüdung durch die Auswahl optimaler Maßnahmen zu maximieren.

Tiefgreifendes Q-Learning-Verstärkungslernen mit der Roboterarmsimulation von Panda-Gym

Oct 31, 2023 pm 05:57 PM

Tiefgreifendes Q-Learning-Verstärkungslernen mit der Roboterarmsimulation von Panda-Gym

Oct 31, 2023 pm 05:57 PM

Reinforcement Learning (RL) ist eine Methode des maschinellen Lernens, die es einem Agenten ermöglicht, durch Versuch und Irrtum zu lernen, wie er sich in seiner Umgebung verhält. Agenten werden dafür belohnt oder bestraft, dass sie Maßnahmen ergreifen, die zu den gewünschten Ergebnissen führen. Im Laufe der Zeit lernt der Agent, Maßnahmen zu ergreifen, die seine erwartete Belohnung maximieren. RL-Agenten werden normalerweise mithilfe eines Markov-Entscheidungsprozesses (MDP) trainiert, einem mathematischen Rahmen zur Modellierung sequentieller Entscheidungsprobleme. MDP besteht aus vier Teilen: Zustand: eine Reihe möglicher Zustände der Umgebung. Aktion: Eine Reihe von Aktionen, die ein Agent ausführen kann. Übergangsfunktion: Eine Funktion, die die Wahrscheinlichkeit des Übergangs in einen neuen Zustand anhand des aktuellen Zustands und der aktuellen Aktion vorhersagt. Belohnungsfunktion: Eine Funktion, die dem Agenten für jede Conversion eine Belohnung zuweist. Das Ziel des Agenten besteht darin, eine Richtlinienfunktion zu erlernen.

Eine weitere Revolution im Reinforcement Learning! DeepMind schlägt eine „Algorithmus-Destillation' vor: einen erforschbaren, vorab trainierten Reinforcement-Learning-Transformer

Apr 12, 2023 pm 06:58 PM

Eine weitere Revolution im Reinforcement Learning! DeepMind schlägt eine „Algorithmus-Destillation' vor: einen erforschbaren, vorab trainierten Reinforcement-Learning-Transformer

Apr 12, 2023 pm 06:58 PM

Bei aktuellen Sequenzmodellierungsaufgaben kann Transformer als die leistungsstärkste neuronale Netzwerkarchitektur bezeichnet werden, und das vorab trainierte Transformer-Modell kann Eingabeaufforderungen als Bedingungen oder In-Context-Lernen verwenden, um sich an verschiedene nachgelagerte Aufgaben anzupassen. Die Generalisierungsfähigkeit groß angelegter vorab trainierter Transformer-Modelle wurde in mehreren Bereichen überprüft, z. B. Textvervollständigung, Sprachverständnis, Bilderzeugung usw. Seit letztem Jahr gibt es relevante Arbeiten, die belegen, dass das Modell durch die Behandlung von Offline-Reinforcement-Learning (Offline-RL) als Sequenzvorhersageproblem Richtlinien aus Offline-Daten lernen kann. Aber aktuelle Ansätze lernen Richtlinien entweder aus Daten, die kein Lernen enthalten

Wie kann man die Go-Sprache verwenden, um tiefgreifende Forschung zum verstärkten Lernen durchzuführen?

Jun 10, 2023 pm 02:15 PM

Wie kann man die Go-Sprache verwenden, um tiefgreifende Forschung zum verstärkten Lernen durchzuführen?

Jun 10, 2023 pm 02:15 PM

Deep Reinforcement Learning (DeepReinforcementLearning) ist eine fortschrittliche Technologie, die Deep Learning und Reinforcement Learning kombiniert. Sie wird häufig in der Spracherkennung, Bilderkennung, Verarbeitung natürlicher Sprache und anderen Bereichen eingesetzt. Als schnelle, effiziente und zuverlässige Programmiersprache kann die Go-Sprache bei der tiefgreifenden Forschung zum Reinforcement Learning hilfreich sein. In diesem Artikel wird erläutert, wie Sie mithilfe der Go-Sprache tiefgreifende Forschung zum verstärkten Lernen durchführen können. 1. Installieren Sie die Go-Sprache und die zugehörigen Bibliotheken und beginnen Sie mit der Verwendung der Go-Sprache für tiefgreifendes, verstärkendes Lernen.

Steuerung eines doppelgelenkigen Roboterarms mit dem DDPG-Lernalgorithmus von Actor-Critic

May 12, 2023 pm 09:55 PM

Steuerung eines doppelgelenkigen Roboterarms mit dem DDPG-Lernalgorithmus von Actor-Critic

May 12, 2023 pm 09:55 PM

In diesem Artikel stellen wir das Training intelligenter Agenten zur Steuerung eines zweigelenkigen Roboterarms in der Reacher-Umgebung vor, einem Unity-basierten Simulationsprogramm, das mit dem UnityML-Agents-Toolkit entwickelt wurde. Unser Ziel ist es, die Zielposition mit hoher Genauigkeit zu erreichen, daher können wir hier den hochmodernen DeepDeterministicPolicyGradient (DDPG)-Algorithmus verwenden, der für kontinuierliche Zustands- und Aktionsräume entwickelt wurde. Praxisnahe Anwendungen Roboterarme spielen eine entscheidende Rolle in der Fertigung, in Produktionsanlagen, bei der Erforschung des Weltraums sowie bei Such- und Rettungseinsätzen. Es ist sehr wichtig, den Roboterarm mit hoher Präzision und Flexibilität zu steuern. Durch den Einsatz verstärkender Lerntechniken können diese Robotersysteme in die Lage versetzt werden, ihr Verhalten in Echtzeit zu lernen und anzupassen.

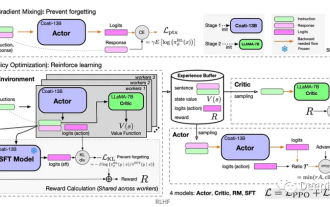

Wie kann man Reinforcement Learning nutzen, um die Benutzerbindung von Kuaishou zu verbessern?

May 07, 2023 pm 06:31 PM

Wie kann man Reinforcement Learning nutzen, um die Benutzerbindung von Kuaishou zu verbessern?

May 07, 2023 pm 06:31 PM

Das Hauptziel des Kurzvideo-Empfehlungssystems besteht darin, das DAU-Wachstum durch eine verbesserte Benutzerbindung voranzutreiben. Daher ist die Kundenbindung einer der wichtigsten Indikatoren für die Geschäftsoptimierung jeder APP. Bei der Aufbewahrung handelt es sich jedoch um eine langfristige Rückmeldung nach mehreren Interaktionen zwischen Benutzern und dem System, und es ist schwierig, sie in ein einzelnes Element oder eine einzelne Liste zu zerlegen. Daher ist es schwierig, die Aufbewahrung mithilfe herkömmlicher Punkt- und Listenfunktionen direkt zu optimieren. weise Modelle. Methoden des Reinforcement Learning (RL) optimieren langfristige Belohnungen durch die Interaktion mit der Umgebung und eignen sich zur direkten Optimierung der Nutzerbindung. Diese Arbeit modelliert das Aufbewahrungsoptimierungsproblem als Markov-Entscheidungsprozess (MDP) mit unendlicher Horizontanforderungsgranularität. Jedes Mal, wenn der Benutzer das Empfehlungssystem auffordert, über eine Aktion zu entscheiden, wird es verwendet, um mehrere verschiedene kurzfristige Feedbackschätzungen (Beobachtungsdauer,

Lernen Sie, eine Leiterplatte in 20 Minuten zusammenzubauen! Das Open-Source-SERL-Framework weist eine Erfolgsquote bei der Präzisionskontrolle von 100 % auf und ist dreimal schneller als Menschen

Feb 21, 2024 pm 03:31 PM

Lernen Sie, eine Leiterplatte in 20 Minuten zusammenzubauen! Das Open-Source-SERL-Framework weist eine Erfolgsquote bei der Präzisionskontrolle von 100 % auf und ist dreimal schneller als Menschen

Feb 21, 2024 pm 03:31 PM

Jetzt können Roboter Präzisionsaufgaben in der Fabriksteuerung erlernen. In den letzten Jahren wurden auf dem Gebiet der Lerntechnologie zur Verstärkung von Robotern erhebliche Fortschritte erzielt, z. B. beim Gehen im Vierfüßlerstand, beim Greifen, bei der geschickten Manipulation usw., die meisten davon beschränken sich jedoch auf die Labordemonstrationsphase. Die umfassende Anwendung der Robotic Reinforcement Learning-Technologie in tatsächlichen Produktionsumgebungen steht noch vor vielen Herausforderungen, was ihren Anwendungsbereich in realen Szenarien bis zu einem gewissen Grad einschränkt. Im Prozess der praktischen Anwendung der Reinforcement-Learning-Technologie ist es notwendig, mehrere komplexe Probleme zu überwinden, darunter die Einstellung des Belohnungsmechanismus, das Zurücksetzen der Umgebung, die Verbesserung der Probeneffizienz und die Gewährleistung der Aktionssicherheit. Branchenexperten betonen, dass die Lösung der vielen Probleme bei der tatsächlichen Implementierung der Reinforcement-Learning-Technologie ebenso wichtig ist wie die kontinuierliche Innovation des Algorithmus selbst. Vor dieser Herausforderung standen Forscher der University of California, Berkeley, der Stanford University, der University of Washington und