Backend-Entwicklung

Backend-Entwicklung

PHP-Tutorial

PHP-Tutorial

Dynamische Fehlererkennung und Strategie zur Lastgewichtsanpassung in der Nginx-Lastausgleichslösung

Dynamische Fehlererkennung und Strategie zur Lastgewichtsanpassung in der Nginx-Lastausgleichslösung

Dynamische Fehlererkennung und Strategie zur Lastgewichtsanpassung in der Nginx-Lastausgleichslösung

Die Strategie zur dynamischen Fehlererkennung und Lastgewichtsanpassung in der Nginx-Lastausgleichslösung erfordert spezifische Codebeispiele.

Einführung: In Netzwerkumgebungen mit hoher Parallelität ist der Lastausgleich eine gängige Lösung, mit der die Verfügbarkeit und Leistung der Website effektiv verbessert werden kann. Nginx ist ein Open-Source-Hochleistungs-Webserver, der leistungsstarke Lastausgleichsfunktionen bietet. In diesem Artikel werden zwei wichtige Funktionen des Nginx-Lastausgleichs, die dynamische Fehlererkennung und die Strategie zur Anpassung des Lastgewichts, vorgestellt und spezifische Codebeispiele bereitgestellt.

Dynamische Fehlererkennung bedeutet, dass Nginx die Anfrage automatisch an andere verfügbare Server weiterleiten kann, wenn der Backend-Server ausfällt oder nicht verfügbar ist. Nginx implementiert die dynamische Fehlererkennung mithilfe des Healthcheck-Moduls.

- Konfigurieren Sie das Healthcheck-Modul

- Zunächst müssen Sie das Healthcheck-Modul in der Nginx-Konfigurationsdatei aktivieren. Fügen Sie die folgende Konfiguration im http-Block hinzu:

http {

# 启用http_healthcheck模块

healthcheck {

# 检查间隔为5秒

interval=5s;

# 超时时间为2秒

timeout=2s;

# 失败的最大次数为3次

fails=3;

# 检查的URI路径

uri=/healthcheck;

}

# 其他配置项...

}- Konfigurieren Sie Upstream und Server.

- Konfigurieren Sie dann die Liste der Backend-Server im Upstream-Block. Jeder Server muss den entsprechenden Sicherungsserver konfigurieren, d Geben Sie den Weg zur dynamischen Fehlererkennung an. Das folgende Beispiel verwendet die Lastausgleichsstrategie „least_conn“ und aktiviert das Healthcheck-Modul:

upstream backend {

# 主服务器

server backend1.example.com;

# 备用服务器

server backup.backend1.example.com backup;

server backup.backend2.example.com backup;

# 其他服务器...

}- Die Lastgewichtsanpassung bezieht sich auf die dynamische Anpassung der Gewichtung weitergeleiteter Anforderungen basierend auf der Leistung und Auslastung des Backend-Servers . , um einen Lastausgleich zu erreichen.

location / {

# 使用least_conn负载均衡策略

proxy_pass http://backend;

# healthcheck模块配置

proxy_next_upstream error timeout invalid_header http_500;

proxy_connect_timeout 2s;

proxy_set_header Host $host;

}- Konfigurieren Sie die Lastausgleichsrichtlinie.

- Geben Sie dann die Lastausgleichsrichtlinie im Standortblock an. Das folgende Beispiel verwendet die Lastausgleichsstrategie „ip_hash“ mit aktivierter Lastgewichtsanpassung:

upstream backend {

# 主服务器,权重为5

server backend1.example.com weight=5;

# 其他服务器...

}Das obige ist der detaillierte Inhalt vonDynamische Fehlererkennung und Strategie zur Lastgewichtsanpassung in der Nginx-Lastausgleichslösung. Für weitere Informationen folgen Sie bitte anderen verwandten Artikeln auf der PHP chinesischen Website!

Heiße KI -Werkzeuge

Undresser.AI Undress

KI-gestützte App zum Erstellen realistischer Aktfotos

AI Clothes Remover

Online-KI-Tool zum Entfernen von Kleidung aus Fotos.

Undress AI Tool

Ausziehbilder kostenlos

Clothoff.io

KI-Kleiderentferner

AI Hentai Generator

Erstellen Sie kostenlos Ai Hentai.

Heißer Artikel

Heiße Werkzeuge

Notepad++7.3.1

Einfach zu bedienender und kostenloser Code-Editor

SublimeText3 chinesische Version

Chinesische Version, sehr einfach zu bedienen

Senden Sie Studio 13.0.1

Leistungsstarke integrierte PHP-Entwicklungsumgebung

Dreamweaver CS6

Visuelle Webentwicklungstools

SublimeText3 Mac-Version

Codebearbeitungssoftware auf Gottesniveau (SublimeText3)

Heiße Themen

1377

1377

52

52

So erlauben Sie den externen Netzwerkzugriff auf den Tomcat-Server

Apr 21, 2024 am 07:22 AM

So erlauben Sie den externen Netzwerkzugriff auf den Tomcat-Server

Apr 21, 2024 am 07:22 AM

Um dem Tomcat-Server den Zugriff auf das externe Netzwerk zu ermöglichen, müssen Sie Folgendes tun: Ändern Sie die Tomcat-Konfigurationsdatei, um externe Verbindungen zuzulassen. Fügen Sie eine Firewallregel hinzu, um den Zugriff auf den Tomcat-Server-Port zu ermöglichen. Erstellen Sie einen DNS-Eintrag, der den Domänennamen auf die öffentliche IP des Tomcat-Servers verweist. Optional: Verwenden Sie einen Reverse-Proxy, um Sicherheit und Leistung zu verbessern. Optional: Richten Sie HTTPS für mehr Sicherheit ein.

So generieren Sie eine URL aus einer HTML-Datei

Apr 21, 2024 pm 12:57 PM

So generieren Sie eine URL aus einer HTML-Datei

Apr 21, 2024 pm 12:57 PM

Für die Konvertierung einer HTML-Datei in eine URL ist ein Webserver erforderlich. Dazu sind die folgenden Schritte erforderlich: Besorgen Sie sich einen Webserver. Richten Sie einen Webserver ein. Laden Sie eine HTML-Datei hoch. Erstellen Sie einen Domainnamen. Leiten Sie die Anfrage weiter.

So stellen Sie das NodeJS-Projekt auf dem Server bereit

Apr 21, 2024 am 04:40 AM

So stellen Sie das NodeJS-Projekt auf dem Server bereit

Apr 21, 2024 am 04:40 AM

Serverbereitstellungsschritte für ein Node.js-Projekt: Bereiten Sie die Bereitstellungsumgebung vor: Erhalten Sie Serverzugriff, installieren Sie Node.js, richten Sie ein Git-Repository ein. Erstellen Sie die Anwendung: Verwenden Sie npm run build, um bereitstellbaren Code und Abhängigkeiten zu generieren. Code auf den Server hochladen: über Git oder File Transfer Protocol. Abhängigkeiten installieren: Stellen Sie eine SSH-Verbindung zum Server her und installieren Sie Anwendungsabhängigkeiten mit npm install. Starten Sie die Anwendung: Verwenden Sie einen Befehl wie node index.js, um die Anwendung zu starten, oder verwenden Sie einen Prozessmanager wie pm2. Konfigurieren Sie einen Reverse-Proxy (optional): Verwenden Sie einen Reverse-Proxy wie Nginx oder Apache, um den Datenverkehr an Ihre Anwendung weiterzuleiten

Anwendung der Lastausgleichsstrategie bei der Leistungsoptimierung des Java-Frameworks

May 31, 2024 pm 08:02 PM

Anwendung der Lastausgleichsstrategie bei der Leistungsoptimierung des Java-Frameworks

May 31, 2024 pm 08:02 PM

Lastausgleichsstrategien sind in Java-Frameworks für eine effiziente Verteilung von Anforderungen von entscheidender Bedeutung. Abhängig von der Parallelitätssituation weisen verschiedene Strategien unterschiedliche Leistungen auf: Abfragemethode: Stabile Leistung bei geringer Parallelität. Gewichtete Abfragemethode: Die Leistung ähnelt der Abfragemethode bei geringer Parallelität. Methode mit der geringsten Anzahl von Verbindungen: beste Leistung bei hoher Parallelität. Zufallsmethode: einfach, aber schlechte Leistung. Konsistentes Hashing: Serverlast ausgleichen. In Kombination mit praktischen Fällen erklärt dieser Artikel, wie Sie auf der Grundlage von Leistungsdaten geeignete Strategien auswählen, um die Anwendungsleistung deutlich zu verbessern.

Kann von außen auf Nodejs zugegriffen werden?

Apr 21, 2024 am 04:43 AM

Kann von außen auf Nodejs zugegriffen werden?

Apr 21, 2024 am 04:43 AM

Ja, auf Node.js kann von außen zugegriffen werden. Sie können die folgenden Methoden verwenden: Verwenden Sie Cloud Functions, um die Funktion bereitzustellen und öffentlich zugänglich zu machen. Verwenden Sie das Express-Framework, um Routen zu erstellen und Endpunkte zu definieren. Verwenden Sie Nginx, um Proxy-Anfragen an Node.js-Anwendungen umzukehren. Verwenden Sie Docker-Container, um Node.js-Anwendungen auszuführen und sie über Port-Mapping verfügbar zu machen.

So stellen Sie eine Website mit PHP bereit und pflegen sie

May 03, 2024 am 08:54 AM

So stellen Sie eine Website mit PHP bereit und pflegen sie

May 03, 2024 am 08:54 AM

Um eine PHP-Website erfolgreich bereitzustellen und zu warten, müssen Sie die folgenden Schritte ausführen: Wählen Sie einen Webserver (z. B. Apache oder Nginx). Installieren Sie PHP. Erstellen Sie eine Datenbank und verbinden Sie PHP. Laden Sie Code auf den Server hoch. Richten Sie den Domänennamen und die DNS-Überwachung der Website-Wartung ein Zu den Schritten gehören die Aktualisierung von PHP und Webservern sowie die Sicherung der Website, die Überwachung von Fehlerprotokollen und die Aktualisierung von Inhalten.

So schützen Sie Ihren Server mit Fail2Ban vor Brute-Force-Angriffen

Apr 27, 2024 am 08:34 AM

So schützen Sie Ihren Server mit Fail2Ban vor Brute-Force-Angriffen

Apr 27, 2024 am 08:34 AM

Eine wichtige Aufgabe für Linux-Administratoren besteht darin, den Server vor illegalen Angriffen oder Zugriffen zu schützen. Linux-Systeme verfügen standardmäßig über gut konfigurierte Firewalls wie iptables, Uncomplicated Firewall (UFW), ConfigServerSecurityFirewall (CSF) usw., die eine Vielzahl von Angriffen verhindern können. Jeder mit dem Internet verbundene Computer ist ein potenzielles Ziel für böswillige Angriffe. Es gibt ein Tool namens Fail2Ban, mit dem illegale Zugriffe auf den Server eingedämmt werden können. Was ist Fail2Ban? Fail2Ban[1] ist eine Intrusion-Prevention-Software, die Server vor Brute-Force-Angriffen schützt. Es ist in der Programmiersprache Python geschrieben

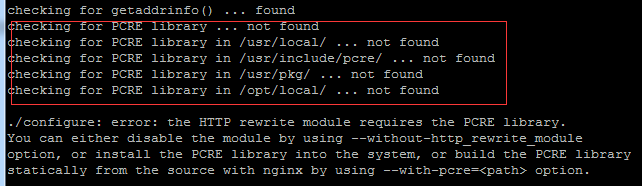

Kommen Sie mit, um Linux zu lernen und Nginx zu installieren

Apr 28, 2024 pm 03:10 PM

Kommen Sie mit, um Linux zu lernen und Nginx zu installieren

Apr 28, 2024 pm 03:10 PM

Heute werde ich Sie durch die Installation von Nginx in einer Linux-Umgebung führen. Das hier verwendete Linux-System ist CentOS7.2. Bereiten Sie die Installationstools vor. 1. Laden Sie Nginx von der offiziellen Nginx-Website herunter. Die hier verwendete Version ist: 1.13.6.2. Laden Sie das heruntergeladene Nginx auf Linux hoch. Hier wird das Verzeichnis /opt/nginx verwendet. Führen Sie zum Dekomprimieren „tar-zxvfnginx-1.13.6.tar.gz“ aus. 3. Wechseln Sie in das Verzeichnis /opt/nginx/nginx-1.13.6 und führen Sie ./configure für die Erstkonfiguration aus. Wenn die folgende Eingabeaufforderung erscheint, bedeutet dies, dass PCRE nicht auf dem Computer installiert ist und Nginx dies tun muss