Technologie-Peripheriegeräte

Technologie-Peripheriegeräte

KI

KI

„Sehr schockiert' ein CTO: GPT-4V-Test zum autonomen Fahren zum fünften Mal in Folge

„Sehr schockiert' ein CTO: GPT-4V-Test zum autonomen Fahren zum fünften Mal in Folge

„Sehr schockiert' ein CTO: GPT-4V-Test zum autonomen Fahren zum fünften Mal in Folge

Dieser Artikel wird mit Genehmigung von AI New Media Qubit (öffentliche Konto-ID: QbitAI) nachgedruckt. Bitte wenden Sie sich für einen Nachdruck an die Quelle.

Unter großer Aufmerksamkeit hat GPT4 heute endlich visionsbezogene Funktionen eingeführt.

Ich habe heute Nachmittag mit meinen Freunden schnell die Bildwahrnehmungsfähigkeiten von GPT getestet. Obwohl wir Erwartungen hatten, waren wir dennoch sehr schockiert.

Kernstandpunkt:

Ich denke, dass die semantischen Probleme beim autonomen Fahren durch große Modelle gut gelöst werden sollten, aber die Glaubwürdigkeit und räumliche Wahrnehmungsfähigkeit großer Modelle ist immer noch nicht zufriedenstellend.

Es sollte mehr als ausreichen, um einige sogenannte Eckfälle im Zusammenhang mit der Effizienz zu lösen, aber es ist noch sehr weit entfernt, sich vollständig auf große Modelle zu verlassen, um das Fahren selbstständig durchzuführen und die Sicherheit zu gewährleisten.

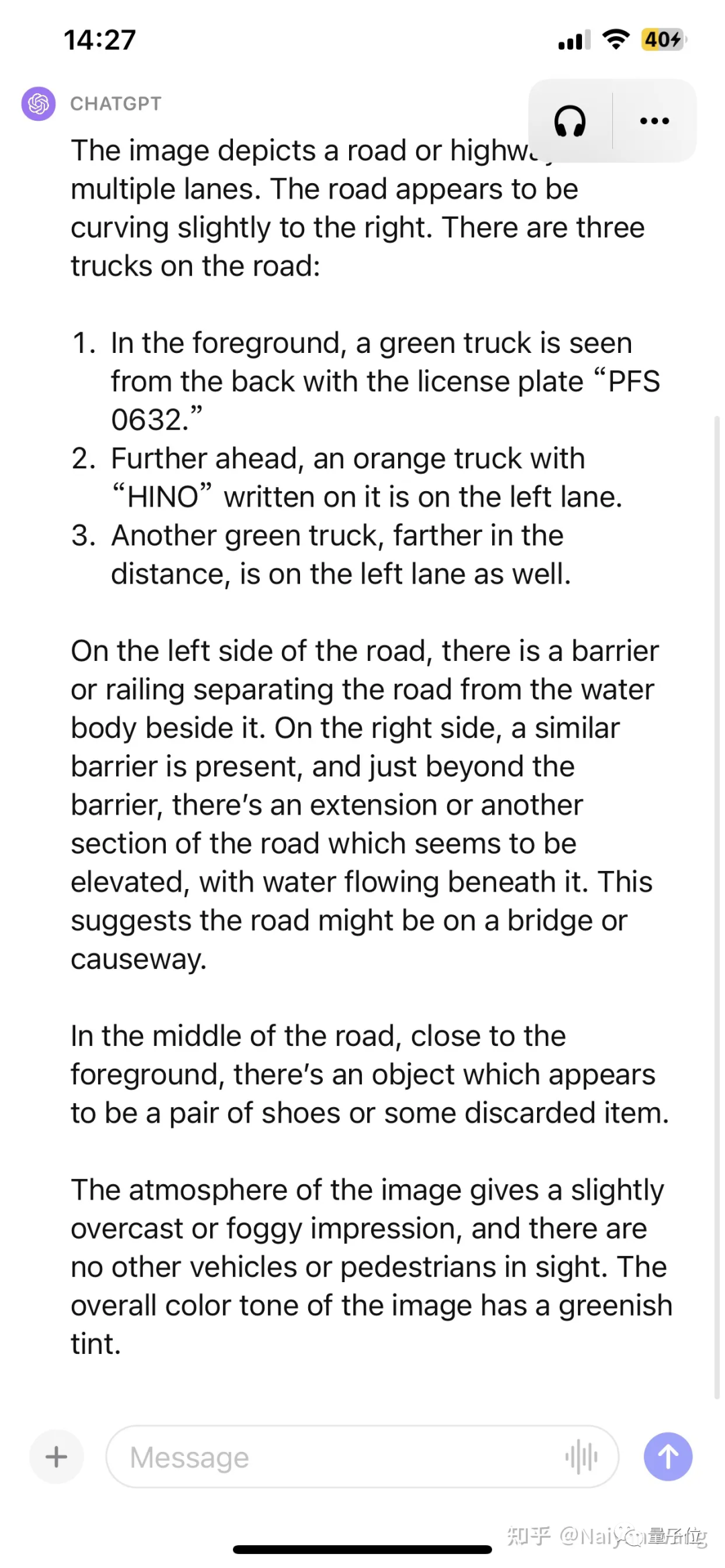

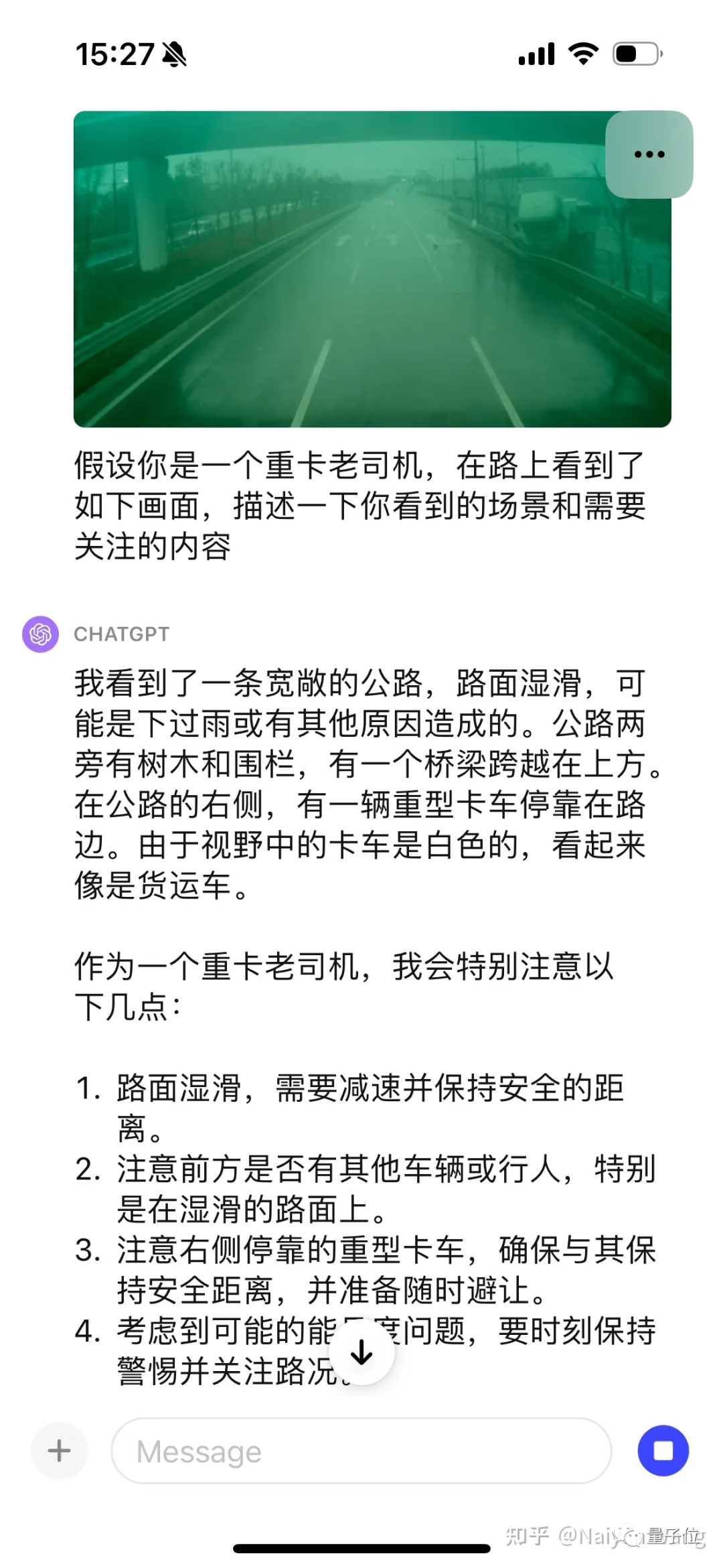

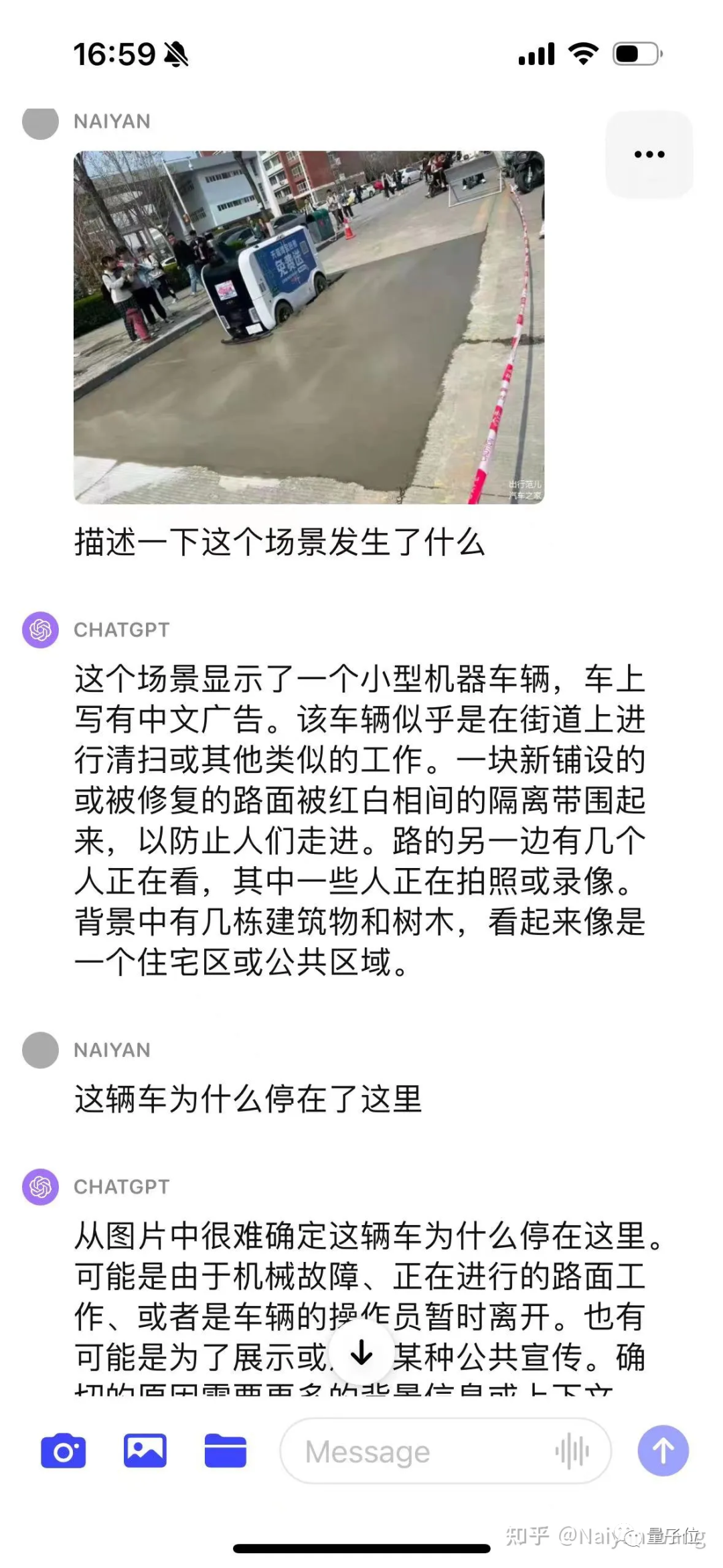

Beispiel 1: Einige unbekannte Hindernisse tauchten auf der Straße auf

△GPT4-Beschreibung

Genauer Teil: 3 LKWs wurden erkannt, das Kennzeichen des vorderen Fahrzeugs war grundsätzlich korrekt (wird ignoriert, wenn chinesische Schriftzeichen vorhanden sind). ), Wetter Korrekt mit der Umgebung, unbekannte Hindernisse vor Ihnen ohne Aufforderung genau identifiziert .

Ungenaue Teile: Die Position des dritten Lastwagens ist von links nach rechts nicht zu unterscheiden, und der Text über dem Kopf des zweiten Lastwagens ist eine zufällige Schätzung (wegen unzureichender Auflösung?).

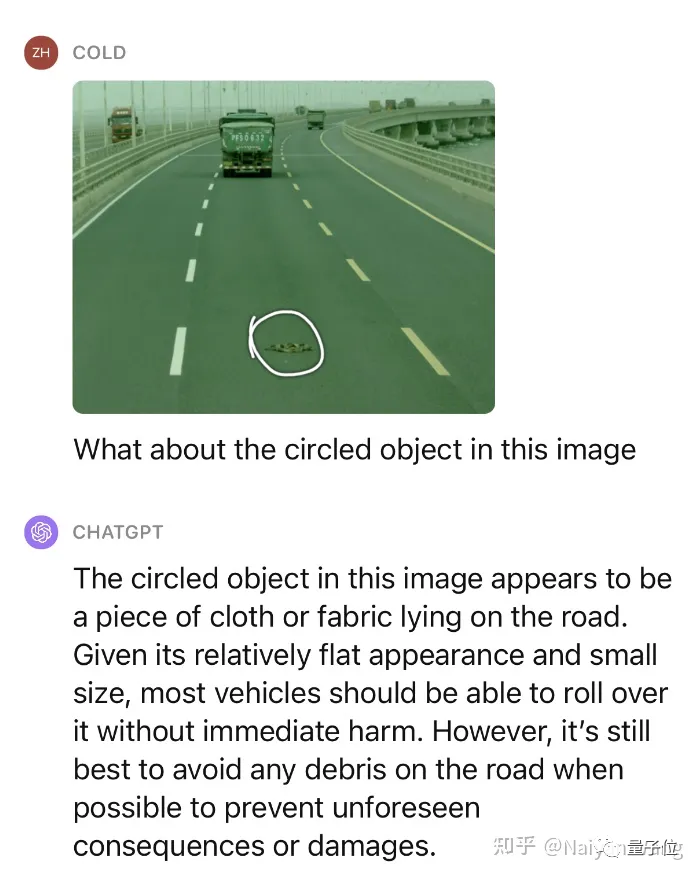

Damit das nicht reicht, geben wir noch einen kleinen Hinweis und fragen, was das für ein Gegenstand ist und ob man ihn drüberdrücken kann.

Beeindruckend! Wir haben mehrere ähnliche Szenarien getestet und die Leistung bei unbekannten Hindernissen kann als sehr erstaunlich bezeichnet werden.

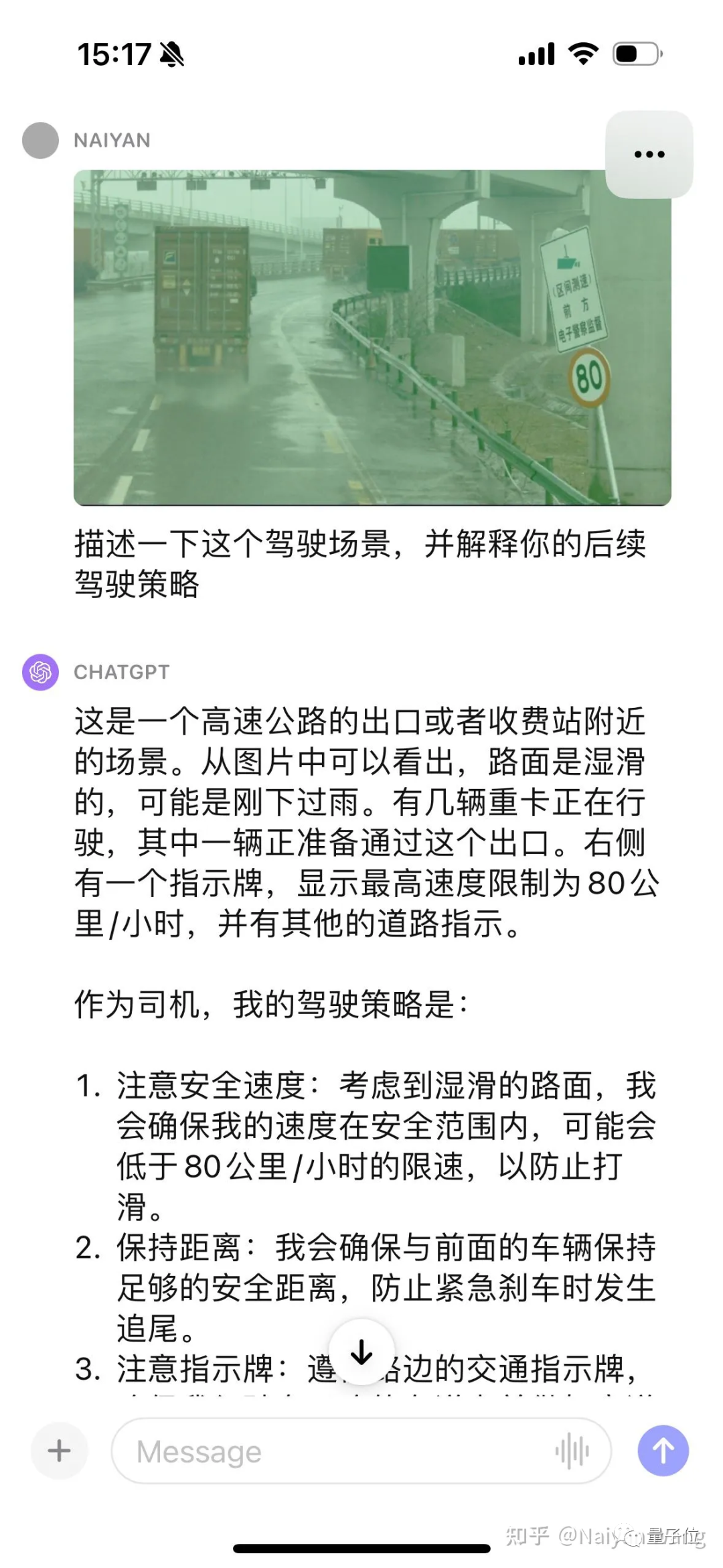

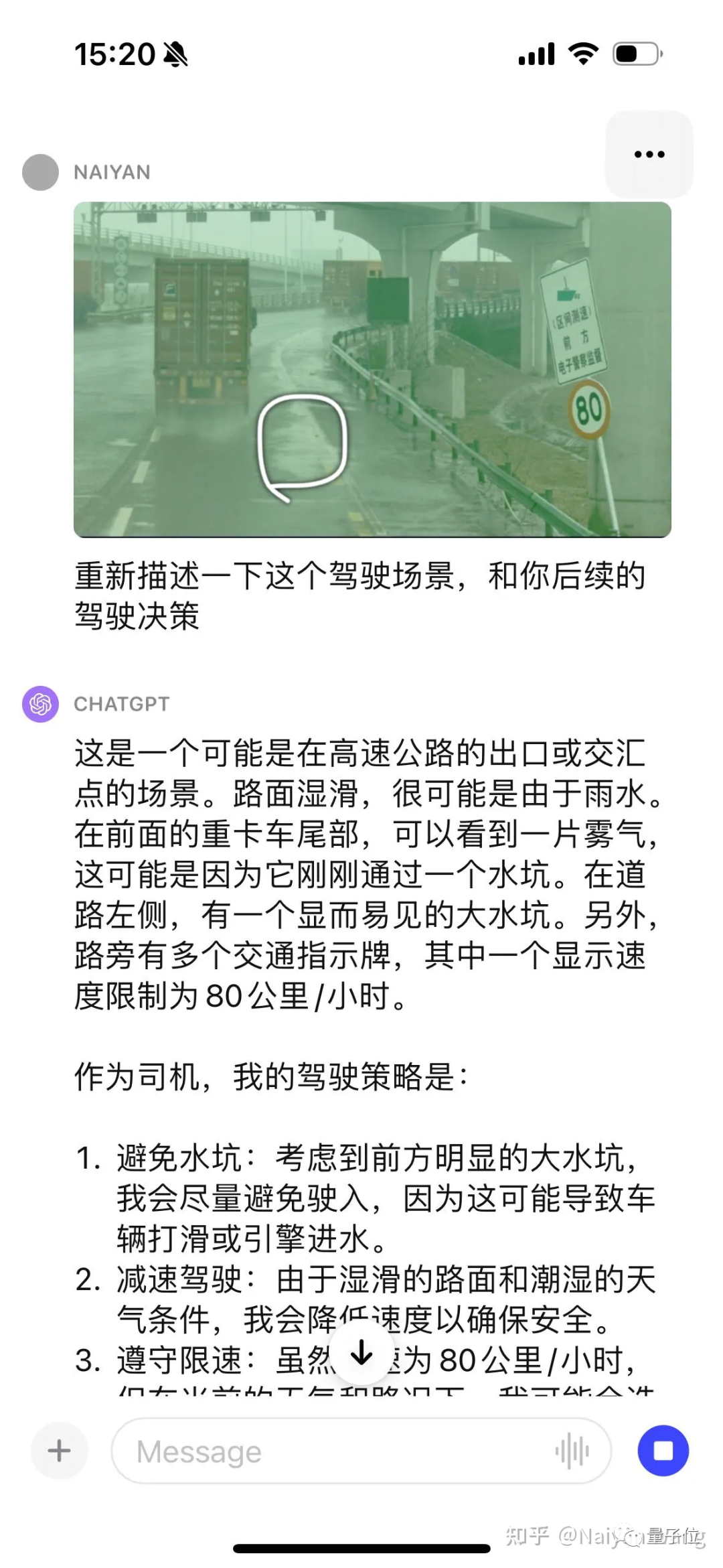

Beispiel 2: Verständnis der Wasseransammlung auf der Straße

Es gibt keine Aufforderung, das Schild automatisch zu erkennen. Dies sollte grundlegend sein. Lassen Sie uns weiterhin einige Hinweise geben.

Ich war wieder schockiert. . . Er erkannte automatisch den Nebel hinter dem LKW und erwähnte auch die Pfütze, sagte aber noch einmal, die Richtung sei nach links. . . Ich bin der Meinung, dass hier eine schnelle technische Umsetzung erforderlich sein könnte, damit GPT die Position und Richtung besser ausgeben kann.

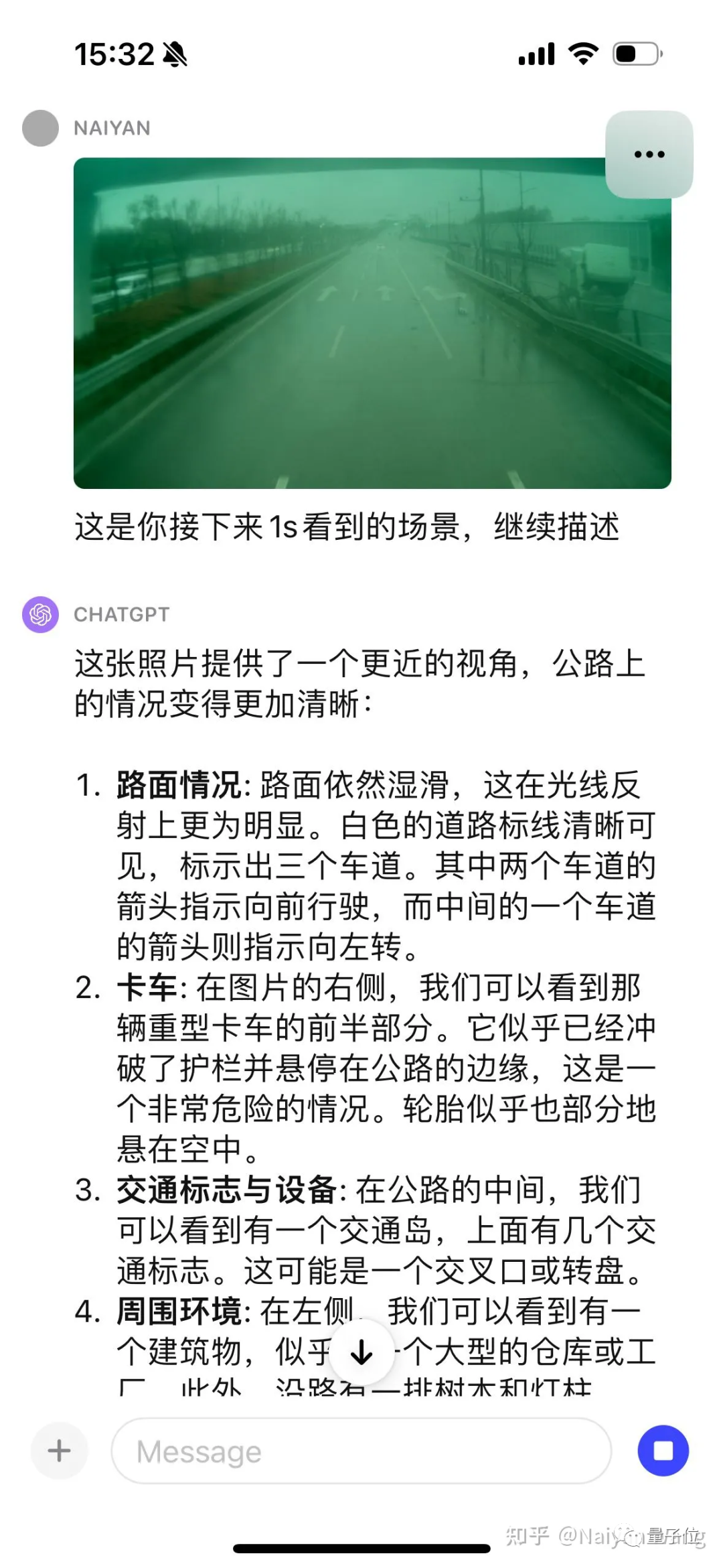

Beispiel 3: Ein Fahrzeug drehte sich um und prallte direkt gegen die Leitplanke

Da der erste Frame eingegeben wurde, wurde der LKW auf der rechten Seite einfach als geparkt betrachtet. Hier also ein weiterer Rahmen:

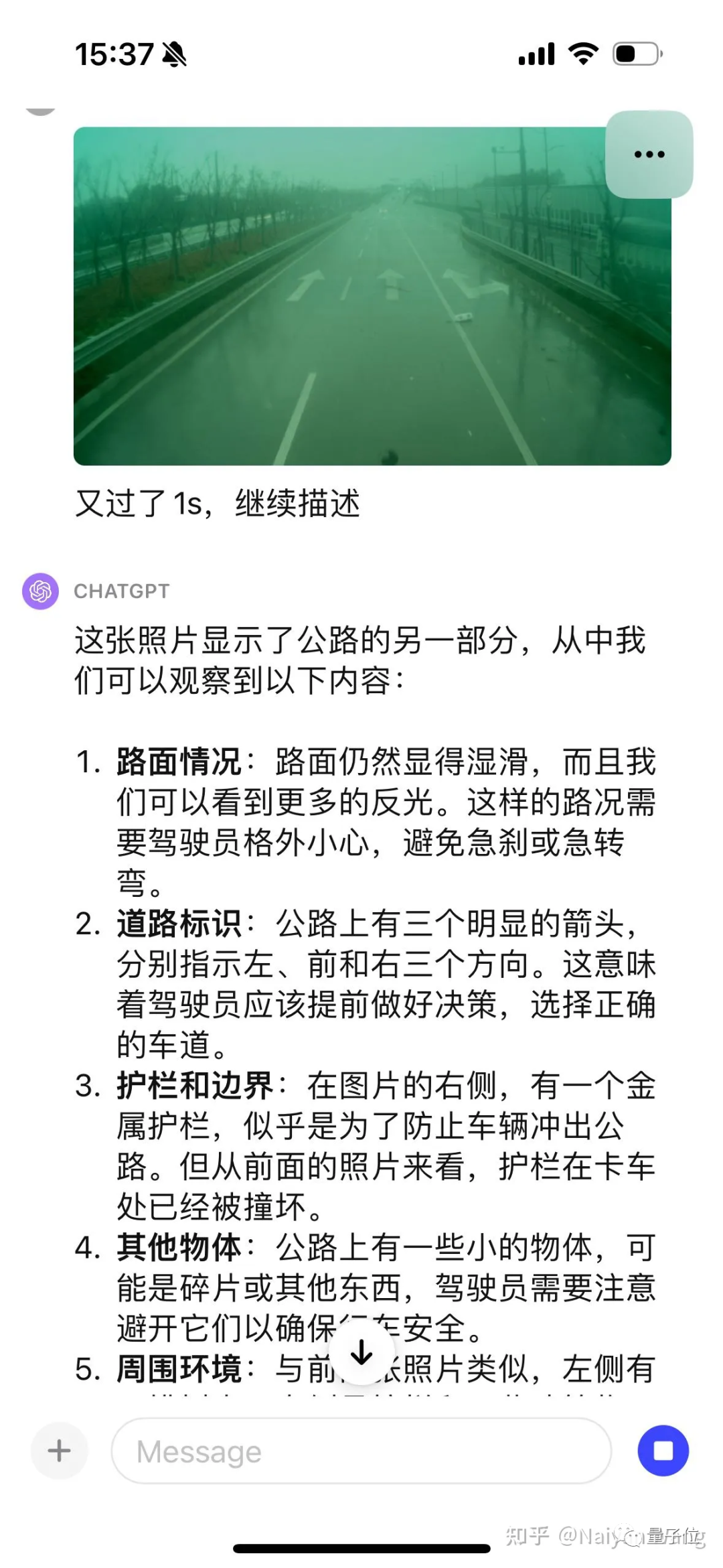

Dieses Auto ist durch die Leitplanke gekracht und am Straßenrand geschwebt. . . Aber stattdessen waren die Verkehrsschilder, die einfacher aussahen, falsch. . . Ich kann nur sagen, dass dies ein riesiges Modell ist. Es wird Sie immer schockieren und Sie wissen nie, wann es Sie zum Weinen bringt. . . Ein weiterer Rahmen:

Diesmal geht es direkt um die Trümmer auf der Straße, und ich bewundere ihn wieder. . . Aber einmal habe ich den Pfeil auf der Straße falsch benannt. . . Im Allgemeinen werden die Informationen, die in dieser Szene besondere Aufmerksamkeit erfordern, abgedeckt. Bei Themen wie Verkehrsschildern werden die Mängel nicht verborgen.

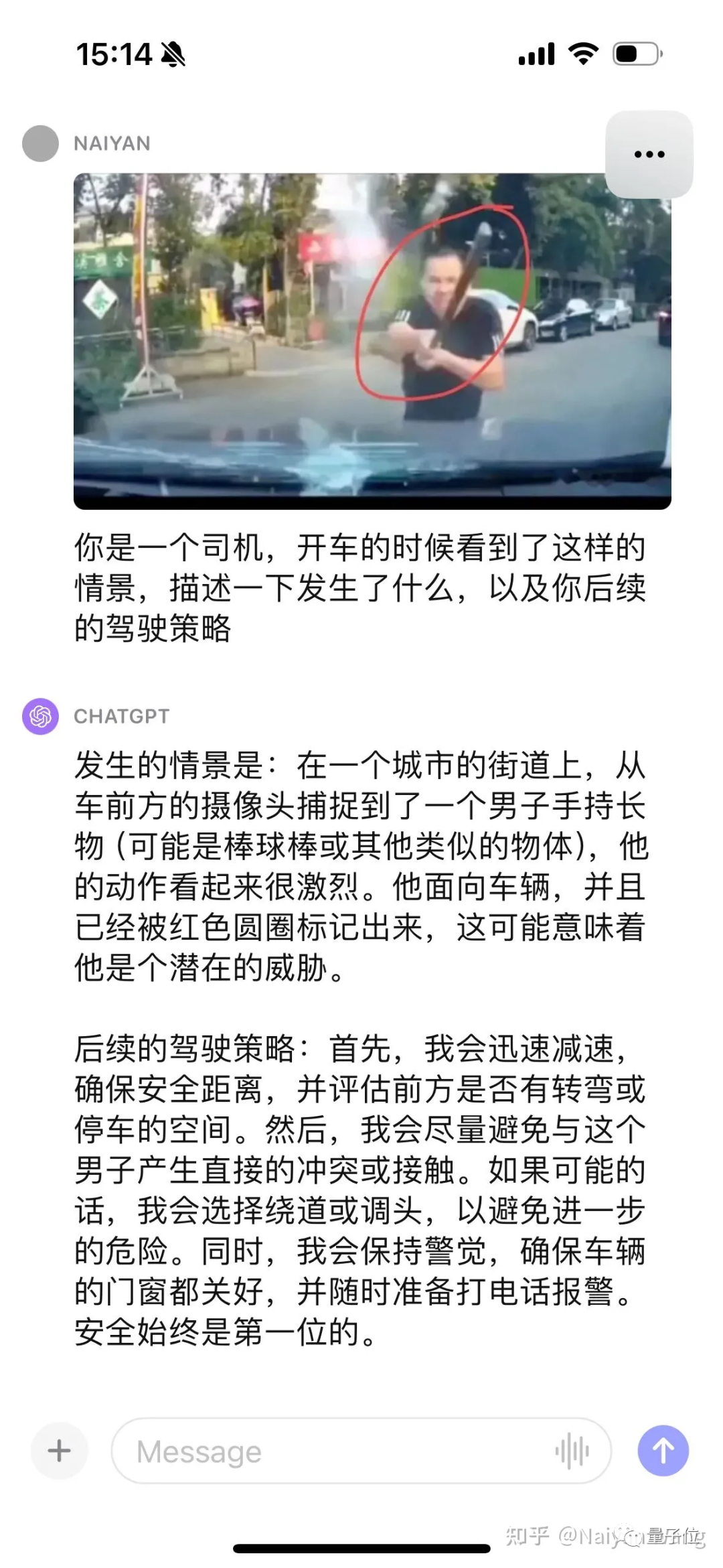

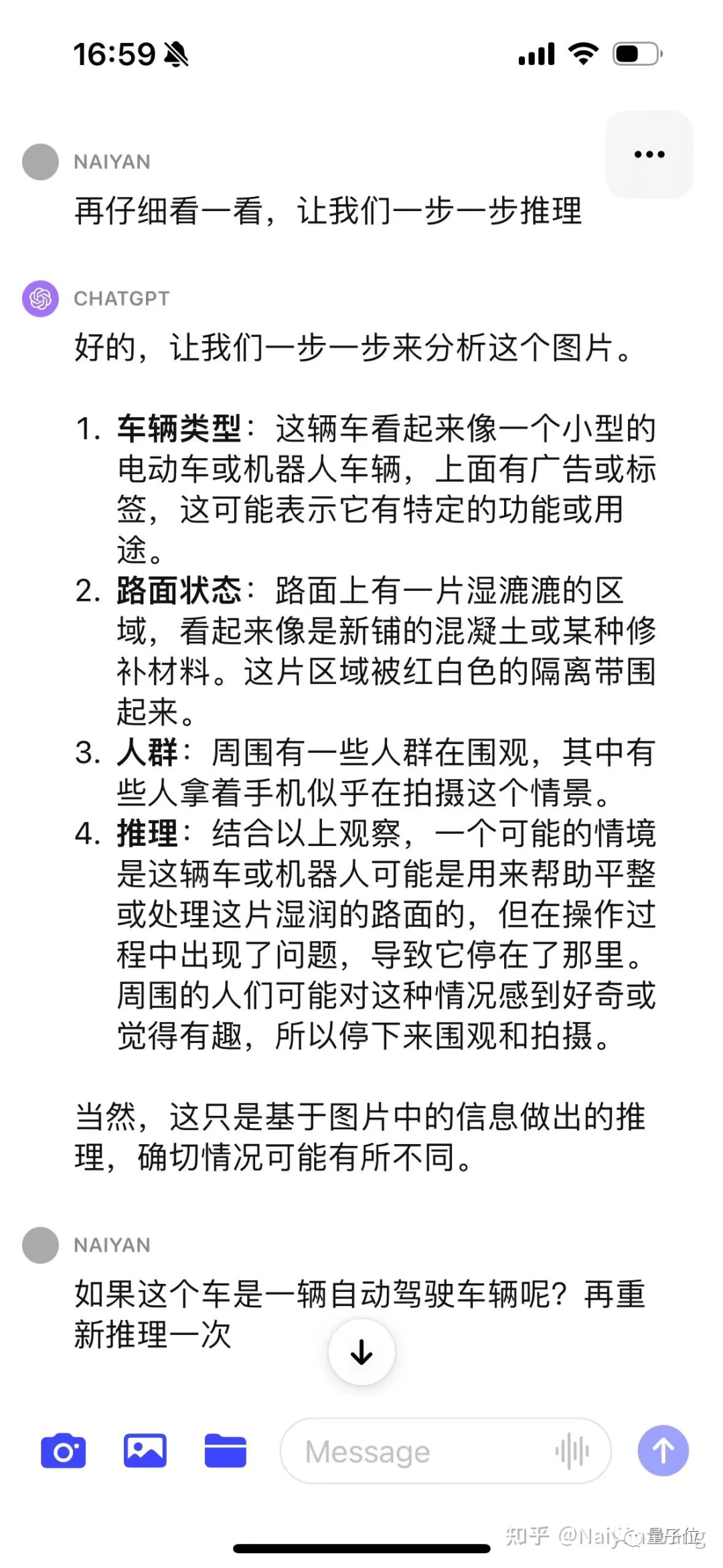

Beispiel 4: Lass uns etwas Lustiges machen

Man kann nur sagen, dass es im Vergleich zu den bisher schwierigen Fällen wie „Jemand hat dir zugewinkt“ sehr genau ist und mit semantischen Eckfällen wie ein Kinderspiel gelöst werden kann.

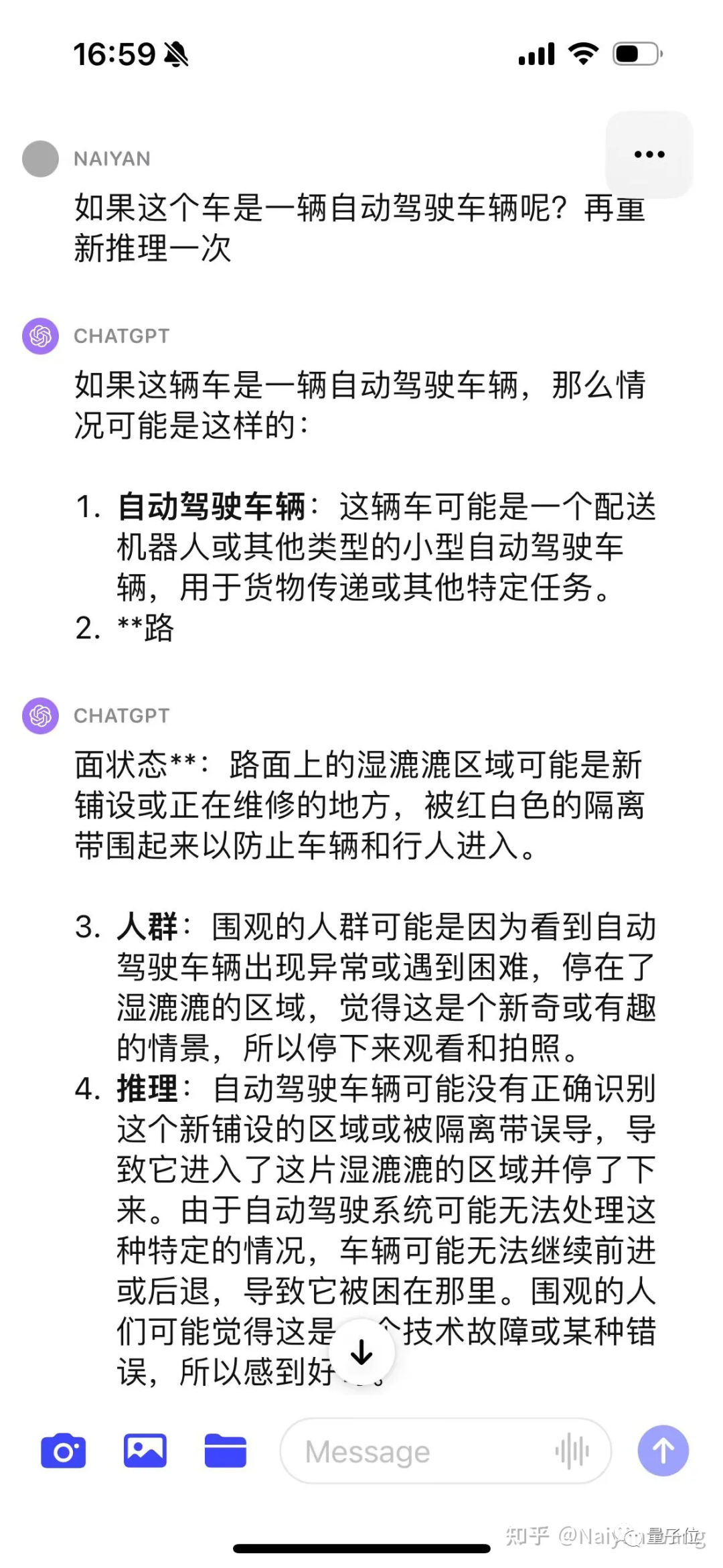

Beispiel 5 Lassen Sie uns eine berühmte Szene haben. . . Der Lieferwagen fuhr versehentlich auf die neu gebaute Straße. Ich war zunächst relativ konservativ und habe die Ursache nicht direkt erraten die Ziele der Ausrichtung.

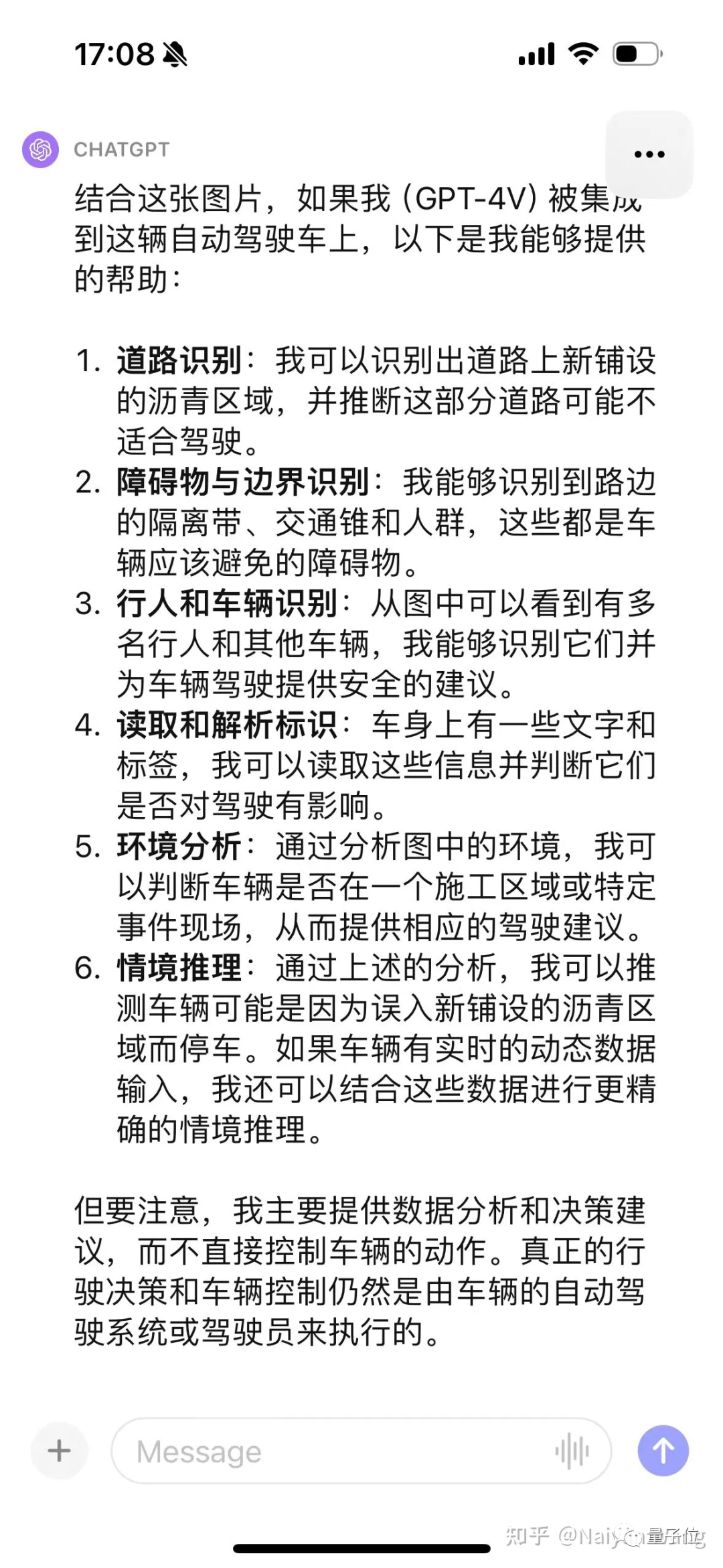

Nach der Verwendung von CoT wurde festgestellt, dass das Problem darin bestand, dass das Auto nicht als selbstfahrendes Fahrzeug angesehen wurde, sodass die Angabe dieser Informationen durch Eingabeaufforderung genauere Informationen liefern kann.

Dieser Grund kann auch darin liegen, dass das Bild nicht aus der ersten Perspektive stammt und nur aus der dritten Perspektive erschlossen werden kann. Dieses Beispiel ist also nicht sehr präzise.

Dieser Grund kann auch darin liegen, dass das Bild nicht aus der ersten Perspektive stammt und nur aus der dritten Perspektive erschlossen werden kann. Dieses Beispiel ist also nicht sehr präzise.

Zusammenfassung

Es sollte sehr vielversprechend sein, den semantischen Eckfall zu lösen, aber das Problem der Illusion wird einige Anwendungen in sicherheitsrelevanten Szenarien immer noch plagen.

Es sollte sehr vielversprechend sein, den semantischen Eckfall zu lösen, aber das Problem der Illusion wird einige Anwendungen in sicherheitsrelevanten Szenarien immer noch plagen.

Sehr spannend finde ich persönlich, dass der rationelle Einsatz solch großer Modelle die Entwicklung des autonomen L4- und sogar L5-Fahrens erheblich beschleunigen kann. Insbesondere das durchgehende Fahren bleibt ein umstrittenes Thema.

Das obige ist der detaillierte Inhalt von„Sehr schockiert' ein CTO: GPT-4V-Test zum autonomen Fahren zum fünften Mal in Folge. Für weitere Informationen folgen Sie bitte anderen verwandten Artikeln auf der PHP chinesischen Website!

Heiße KI -Werkzeuge

Undresser.AI Undress

KI-gestützte App zum Erstellen realistischer Aktfotos

AI Clothes Remover

Online-KI-Tool zum Entfernen von Kleidung aus Fotos.

Undress AI Tool

Ausziehbilder kostenlos

Clothoff.io

KI-Kleiderentferner

AI Hentai Generator

Erstellen Sie kostenlos Ai Hentai.

Heißer Artikel

Heiße Werkzeuge

Notepad++7.3.1

Einfach zu bedienender und kostenloser Code-Editor

SublimeText3 chinesische Version

Chinesische Version, sehr einfach zu bedienen

Senden Sie Studio 13.0.1

Leistungsstarke integrierte PHP-Entwicklungsumgebung

Dreamweaver CS6

Visuelle Webentwicklungstools

SublimeText3 Mac-Version

Codebearbeitungssoftware auf Gottesniveau (SublimeText3)

Heiße Themen

1374

1374

52

52

Warum ist Gaussian Splatting beim autonomen Fahren so beliebt, dass NeRF allmählich aufgegeben wird?

Jan 17, 2024 pm 02:57 PM

Warum ist Gaussian Splatting beim autonomen Fahren so beliebt, dass NeRF allmählich aufgegeben wird?

Jan 17, 2024 pm 02:57 PM

Oben geschrieben und persönliches Verständnis des Autors. Dreidimensionales Gaussplatting (3DGS) ist eine transformative Technologie, die in den letzten Jahren in den Bereichen explizite Strahlungsfelder und Computergrafik entstanden ist. Diese innovative Methode zeichnet sich durch die Verwendung von Millionen von 3D-Gaußkurven aus, was sich stark von der Neural Radiation Field (NeRF)-Methode unterscheidet, die hauptsächlich ein implizites koordinatenbasiertes Modell verwendet, um räumliche Koordinaten auf Pixelwerte abzubilden. Mit seiner expliziten Szenendarstellung und differenzierbaren Rendering-Algorithmen garantiert 3DGS nicht nur Echtzeit-Rendering-Fähigkeiten, sondern führt auch ein beispielloses Maß an Kontrolle und Szenenbearbeitung ein. Dies positioniert 3DGS als potenziellen Game-Changer für die 3D-Rekonstruktion und -Darstellung der nächsten Generation. Zu diesem Zweck geben wir erstmals einen systematischen Überblick über die neuesten Entwicklungen und Anliegen im Bereich 3DGS.

Wie lässt sich das Long-Tail-Problem in autonomen Fahrszenarien lösen?

Jun 02, 2024 pm 02:44 PM

Wie lässt sich das Long-Tail-Problem in autonomen Fahrszenarien lösen?

Jun 02, 2024 pm 02:44 PM

Gestern wurde ich während des Interviews gefragt, ob ich irgendwelche Long-Tail-Fragen gestellt hätte, also dachte ich, ich würde eine kurze Zusammenfassung geben. Das Long-Tail-Problem des autonomen Fahrens bezieht sich auf Randfälle bei autonomen Fahrzeugen, also mögliche Szenarien mit geringer Eintrittswahrscheinlichkeit. Das wahrgenommene Long-Tail-Problem ist einer der Hauptgründe, die derzeit den betrieblichen Designbereich intelligenter autonomer Einzelfahrzeugfahrzeuge einschränken. Die zugrunde liegende Architektur und die meisten technischen Probleme des autonomen Fahrens wurden gelöst, und die verbleibenden 5 % der Long-Tail-Probleme wurden nach und nach zum Schlüssel zur Einschränkung der Entwicklung des autonomen Fahrens. Zu diesen Problemen gehören eine Vielzahl fragmentierter Szenarien, Extremsituationen und unvorhersehbares menschliches Verhalten. Der „Long Tail“ von Randszenarien beim autonomen Fahren bezieht sich auf Randfälle in autonomen Fahrzeugen (AVs). Randfälle sind mögliche Szenarien mit geringer Eintrittswahrscheinlichkeit. diese seltenen Ereignisse

Kamera oder Lidar wählen? Eine aktuelle Übersicht über die Erzielung einer robusten 3D-Objekterkennung

Jan 26, 2024 am 11:18 AM

Kamera oder Lidar wählen? Eine aktuelle Übersicht über die Erzielung einer robusten 3D-Objekterkennung

Jan 26, 2024 am 11:18 AM

0. Vorab geschrieben&& Persönliches Verständnis, dass autonome Fahrsysteme auf fortschrittlichen Wahrnehmungs-, Entscheidungs- und Steuerungstechnologien beruhen, indem sie verschiedene Sensoren (wie Kameras, Lidar, Radar usw.) verwenden, um die Umgebung wahrzunehmen, und Algorithmen und Modelle verwenden für Echtzeitanalysen und Entscheidungsfindung. Dies ermöglicht es Fahrzeugen, Verkehrszeichen zu erkennen, andere Fahrzeuge zu erkennen und zu verfolgen, das Verhalten von Fußgängern vorherzusagen usw. und sich so sicher an komplexe Verkehrsumgebungen anzupassen. Diese Technologie erregt derzeit große Aufmerksamkeit und gilt als wichtiger Entwicklungsbereich für die Zukunft des Transportwesens . eins. Aber was autonomes Fahren schwierig macht, ist herauszufinden, wie man dem Auto klarmachen kann, was um es herum passiert. Dies erfordert, dass der dreidimensionale Objekterkennungsalgorithmus im autonomen Fahrsystem Objekte in der Umgebung, einschließlich ihrer Standorte, genau wahrnehmen und beschreiben kann.

Das Stable Diffusion 3-Papier wird endlich veröffentlicht und die architektonischen Details werden enthüllt. Wird es helfen, Sora zu reproduzieren?

Mar 06, 2024 pm 05:34 PM

Das Stable Diffusion 3-Papier wird endlich veröffentlicht und die architektonischen Details werden enthüllt. Wird es helfen, Sora zu reproduzieren?

Mar 06, 2024 pm 05:34 PM

Der Artikel von StableDiffusion3 ist endlich da! Dieses Modell wurde vor zwei Wochen veröffentlicht und verwendet die gleiche DiT-Architektur (DiffusionTransformer) wie Sora. Nach seiner Veröffentlichung sorgte es für großes Aufsehen. Im Vergleich zur Vorgängerversion wurde die Qualität der von StableDiffusion3 generierten Bilder erheblich verbessert. Es unterstützt jetzt Eingabeaufforderungen mit mehreren Themen, und der Textschreibeffekt wurde ebenfalls verbessert, und es werden keine verstümmelten Zeichen mehr angezeigt. StabilityAI wies darauf hin, dass es sich bei StableDiffusion3 um eine Reihe von Modellen mit Parametergrößen von 800 M bis 8 B handelt. Durch diesen Parameterbereich kann das Modell direkt auf vielen tragbaren Geräten ausgeführt werden, wodurch der Einsatz von KI deutlich reduziert wird

Dieser Artikel reicht aus, um etwas über autonomes Fahren und Flugbahnvorhersage zu lesen!

Feb 28, 2024 pm 07:20 PM

Dieser Artikel reicht aus, um etwas über autonomes Fahren und Flugbahnvorhersage zu lesen!

Feb 28, 2024 pm 07:20 PM

Die Trajektorienvorhersage spielt eine wichtige Rolle beim autonomen Fahren. Unter autonomer Fahrtrajektorienvorhersage versteht man die Vorhersage der zukünftigen Fahrtrajektorie des Fahrzeugs durch die Analyse verschiedener Daten während des Fahrvorgangs. Als Kernmodul des autonomen Fahrens ist die Qualität der Trajektorienvorhersage von entscheidender Bedeutung für die nachgelagerte Planungssteuerung. Die Trajektorienvorhersageaufgabe verfügt über einen umfangreichen Technologie-Stack und erfordert Vertrautheit mit der dynamischen/statischen Wahrnehmung des autonomen Fahrens, hochpräzisen Karten, Fahrspurlinien, Fähigkeiten in der neuronalen Netzwerkarchitektur (CNN&GNN&Transformer) usw. Der Einstieg ist sehr schwierig! Viele Fans hoffen, so schnell wie möglich mit der Flugbahnvorhersage beginnen zu können und Fallstricke zu vermeiden. Heute werde ich eine Bestandsaufnahme einiger häufiger Probleme und einführender Lernmethoden für die Flugbahnvorhersage machen! Einführungsbezogenes Wissen 1. Sind die Vorschaupapiere in Ordnung? A: Schauen Sie sich zuerst die Umfrage an, S

SIMPL: Ein einfacher und effizienter Multi-Agent-Benchmark zur Bewegungsvorhersage für autonomes Fahren

Feb 20, 2024 am 11:48 AM

SIMPL: Ein einfacher und effizienter Multi-Agent-Benchmark zur Bewegungsvorhersage für autonomes Fahren

Feb 20, 2024 am 11:48 AM

Originaltitel: SIMPL: ASimpleandEfficientMulti-agentMotionPredictionBaselineforAutonomousDriving Paper-Link: https://arxiv.org/pdf/2402.02519.pdf Code-Link: https://github.com/HKUST-Aerial-Robotics/SIMPL Autor: Hong Kong University of Science und Technologie DJI-Papieridee: Dieses Papier schlägt eine einfache und effiziente Bewegungsvorhersagebasislinie (SIMPL) für autonome Fahrzeuge vor. Im Vergleich zum herkömmlichen Agent-Cent

nuScenes' neuestes SOTA |. SparseAD: Sparse-Abfrage hilft effizientes durchgängiges autonomes Fahren!

Apr 17, 2024 pm 06:22 PM

nuScenes' neuestes SOTA |. SparseAD: Sparse-Abfrage hilft effizientes durchgängiges autonomes Fahren!

Apr 17, 2024 pm 06:22 PM

Vorab geschrieben und Ausgangspunkt Das End-to-End-Paradigma verwendet ein einheitliches Framework, um Multitasking in autonomen Fahrsystemen zu erreichen. Trotz der Einfachheit und Klarheit dieses Paradigmas bleibt die Leistung von End-to-End-Methoden für das autonome Fahren bei Teilaufgaben immer noch weit hinter Methoden für einzelne Aufgaben zurück. Gleichzeitig erschweren die in früheren End-to-End-Methoden weit verbreiteten Funktionen der dichten Vogelperspektive (BEV) die Skalierung auf mehr Modalitäten oder Aufgaben. Hier wird ein Sparse-Search-zentriertes End-to-End-Paradigma für autonomes Fahren (SparseAD) vorgeschlagen, bei dem die Sparse-Suche das gesamte Fahrszenario, einschließlich Raum, Zeit und Aufgaben, ohne dichte BEV-Darstellung vollständig abbildet. Insbesondere ist eine einheitliche, spärliche Architektur für die Aufgabenerkennung einschließlich Erkennung, Verfolgung und Online-Zuordnung konzipiert. Zudem schwer

Sprechen wir über End-to-End- und autonome Fahrsysteme der nächsten Generation sowie über einige Missverständnisse über End-to-End-Autonomes Fahren?

Apr 15, 2024 pm 04:13 PM

Sprechen wir über End-to-End- und autonome Fahrsysteme der nächsten Generation sowie über einige Missverständnisse über End-to-End-Autonomes Fahren?

Apr 15, 2024 pm 04:13 PM

Im vergangenen Monat hatte ich aus bekannten Gründen einen sehr intensiven Austausch mit verschiedenen Lehrern und Mitschülern der Branche. Ein unvermeidliches Thema im Austausch ist natürlich End-to-End und der beliebte Tesla FSDV12. Ich möchte diese Gelegenheit nutzen, einige meiner aktuellen Gedanken und Meinungen als Referenz und Diskussion darzulegen. Wie definiert man ein durchgängiges autonomes Fahrsystem und welche Probleme sollten voraussichtlich durchgängig gelöst werden? Gemäß der traditionellsten Definition bezieht sich ein End-to-End-System auf ein System, das Rohinformationen von Sensoren eingibt und für die Aufgabe relevante Variablen direkt ausgibt. Bei der Bilderkennung kann CNN beispielsweise als End-to-End bezeichnet werden, verglichen mit der herkömmlichen Methode zum Extrahieren von Merkmalen + Klassifizieren. Bei autonomen Fahraufgaben werden Eingabedaten verschiedener Sensoren (Kamera/LiDAR) benötigt