Technologie-Peripheriegeräte

Technologie-Peripheriegeräte

KI

KI

Betrachten Sie LLM als ein Betriebssystem, es verfügt über unbegrenzten „virtuellen' Kontext, Berkeleys neues Werk hat 1,7.000 Sterne erhalten

Betrachten Sie LLM als ein Betriebssystem, es verfügt über unbegrenzten „virtuellen' Kontext, Berkeleys neues Werk hat 1,7.000 Sterne erhalten

Betrachten Sie LLM als ein Betriebssystem, es verfügt über unbegrenzten „virtuellen' Kontext, Berkeleys neues Werk hat 1,7.000 Sterne erhalten

In den letzten Jahren sind große Sprachmodelle (LLMs) und die ihnen zugrunde liegende Transformatorarchitektur zum Eckpfeiler der Konversations-KI geworden und haben eine breite Palette von Verbraucher- und Unternehmensanwendungen hervorgebracht. Trotz erheblicher Fortschritte schränkt das von LLM verwendete Kontextfenster mit fester Länge die Anwendbarkeit auf lange Gespräche oder lange Dokumentbegründungen erheblich ein. Selbst bei den am weitesten verbreiteten Open-Source-LLMs ermöglicht ihre maximale Eingabelänge nur die Unterstützung einiger Dutzend Nachrichtenantworten oder kurzer Dokumentinferenzen.

Gleichzeitig führt die einfache Erweiterung der Kontextlänge des Transformators, begrenzt durch den Selbstaufmerksamkeitsmechanismus der Transformatorarchitektur, auch dazu, dass die Berechnungszeit und die Speicherkosten exponentiell ansteigen, was die neue Architektur mit langem Kontext zu einer dringenden Forschung macht Thema.

Selbst wenn wir die rechnerischen Herausforderungen der Kontextskalierung bewältigen können, zeigen neuere Untersuchungen, dass Modelle mit langem Kontext Schwierigkeiten haben, den zusätzlichen Kontext effektiv zu nutzen.

Wie kann man das lösen? Angesichts der enormen Ressourcen, die für das Training von SOTA LLM erforderlich sind, und der offensichtlich abnehmenden Erträge der Kontextskalierung benötigen wir dringend alternative Techniken, die lange Kontexte unterstützen. Forscher der University of California in Berkeley haben diesbezüglich neue Fortschritte erzielt.

In diesem Artikel untersuchen Forscher, wie man die Illusion eines unendlichen Kontexts erzeugen und gleichzeitig ein festes Kontextmodell verwenden kann. Ihr Ansatz greift Ideen aus dem Paging des virtuellen Speichers auf und ermöglicht es Anwendungen, Datensätze zu verarbeiten, die den verfügbaren Speicher bei weitem überschreiten.

Basierend auf dieser Idee nutzten die Forscher die neuesten Fortschritte bei den Funktionsaufruffunktionen von LLM-Agenten, um ein vom Betriebssystem inspiriertes LLM-System für die virtuelle Kontextverwaltung zu entwerfen – MemGPT.

Papier-Homepage: https://memgpt.ai/

arXiv-Adresse: https://arxiv.org/pdf/2310.08560.pdf

Das Projekt ist Open Source und hat 1,7.000 Sterne auf GitHub erhalten Menge.

GitHub-Adresse: https://github.com/cpacker/MemGPT

Methodenübersicht

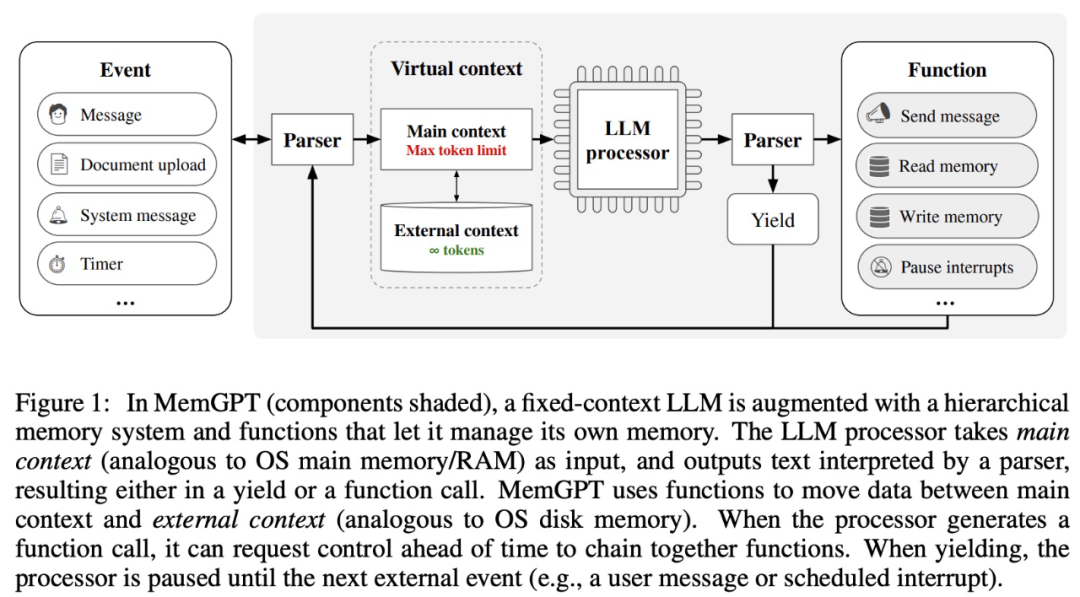

Diese Forschung lässt sich von der hierarchischen Speicherverwaltung herkömmlicher Betriebssysteme in Kontextfenstern (ähnlich wie bei Betriebssystemen) inspirieren „Seiten“-Informationen zwischen „Hauptspeicher“) und externem Speicher ein- und auslagern. MemGPT ist für die Verwaltung des Kontrollflusses zwischen Speicher, LLM-Verarbeitungsmodulen und Benutzern verantwortlich. Dieses Design ermöglicht eine iterative Kontextänderung während einer einzelnen Aufgabe, sodass der Agent sein begrenztes Kontextfenster effizienter nutzen kann.

MemGPT behandelt Kontextfenster als eingeschränkte Speicherressourcen und entwirft eine hierarchische Struktur für LLM, ähnlich dem hierarchischen Speicher in herkömmlichen Betriebssystemen (Patterson et al., 1988). Um eine längere Kontextlänge bereitzustellen, ermöglicht diese Forschung LLM, in seinem Kontextfenster platzierte Inhalte über „LLM OS“ – MemGPT – zu verwalten. MemGPT ermöglicht es LLM, relevante historische Daten abzurufen, die im Kontext verloren gehen, ähnlich wie bei Seitenfehlern in Betriebssystemen. Darüber hinaus können Agenten den Inhalt eines einzelnen Aufgabenkontextfensters iterativ ändern, so wie ein Prozess wiederholt auf den virtuellen Speicher zugreifen kann.

MemGPT ermöglicht es LLM, unbegrenzte Kontexte zu verarbeiten, wenn das Kontextfenster begrenzt ist. Die Komponenten von MemGPT sind in Abbildung 1 unten dargestellt.

MemGPT koordiniert die Datenbewegung zwischen dem Hauptkontext (Inhalt im Kontextfenster) und dem externen Kontext durch Funktionsaufrufe, die automatisch auf der Grundlage des aktuellen Kontexts aktualisiert und abgerufen werden.

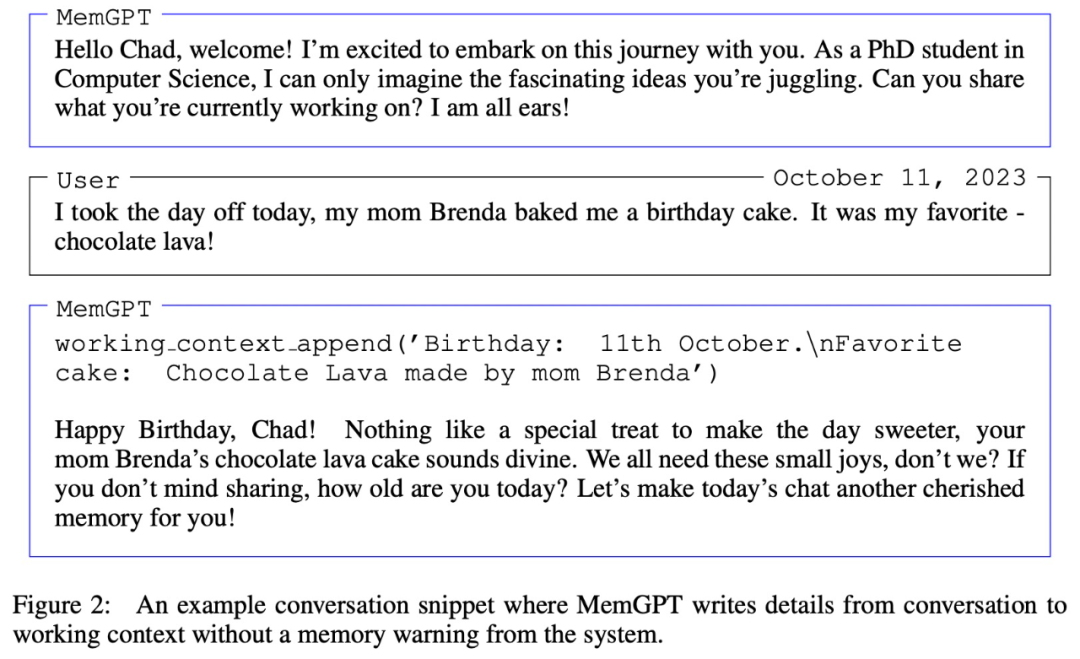

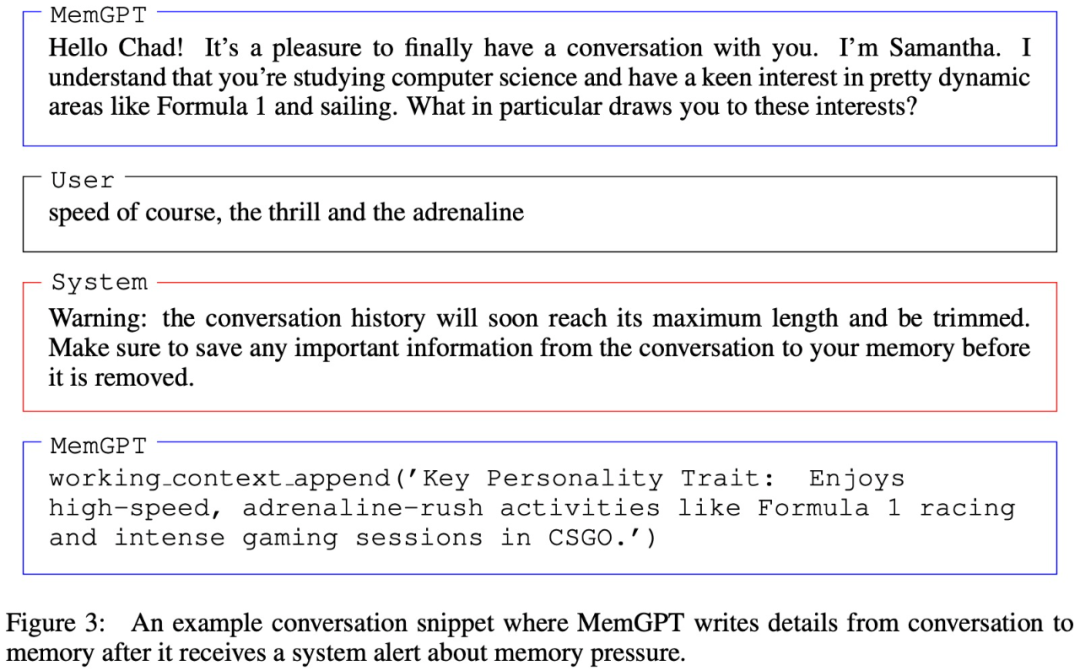

Es ist erwähnenswert, dass das Kontextfenster ein Warntoken verwenden muss, um seine Einschränkungen zu kennzeichnen, wie in Abbildung 3 unten dargestellt:

Experimente und Ergebnisse

Im experimentellen Teil bewerteten die Forscher MemGPT in zwei langen Kontextbereichen, nämlich Konversationsagenten und Dokumentenverarbeitung. Für Konversationsagenten erweiterten sie den bestehenden Multisitzungs-Chat-Datensatz (Xu et al. (2021)) und führten zwei neue Konversationsaufgaben ein, um die Fähigkeit des Agenten zu bewerten, Wissen in langen Gesprächen zu behalten. Für die Dokumentenanalyse vergleichen sie MemGPT mit den von Liu et al. (2023a) vorgeschlagenen Aufgaben, einschließlich der Beantwortung von Fragen und dem Abrufen von Schlüsselwerten langer Dokumente.

MemGPT für Konversationsagenten

Beim Gespräch mit dem Benutzer muss der Agent die folgenden zwei Schlüsselkriterien erfüllen.

Eine davon ist Konsistenz, das heißt, der Agent sollte die Kohärenz des Gesprächs aufrechterhalten und die bereitgestellten neuen Fakten, Referenzen und Ereignisse sollten mit den vorherigen Aussagen des Benutzers und des Agenten übereinstimmen.

Die zweite Möglichkeit ist die Teilnahme, das heißt, der Agent sollte das Langzeitwissen des Benutzers nutzen, um die Antwort zu personalisieren. Wenn Sie sich auf frühere Gespräche beziehen, kann das Gespräch natürlicher und spannender werden.

Daher bewerteten Forscher MemGPT anhand dieser beiden Kriterien:

Kann MemGPT sein Gedächtnis nutzen, um die Konversationskonsistenz zu verbessern? Können Sie sich an relevante Fakten, Zitate und Ereignisse aus vergangenen Interaktionen erinnern, um die Kohärenz aufrechtzuerhalten?

Kann MemGPT den Speicher nutzen, um spannendere Gespräche zu generieren? Informationen von Remote-Benutzern spontan zusammenführen, um Informationen zu personalisieren?

In Bezug auf den verwendeten Datensatz bewerteten und verglichen die Forscher MemGPT- und Fixed-Context-Baseline-Modelle auf dem von Xu et al. (2021) vorgeschlagenen Multi-Session-Chat (MSC).

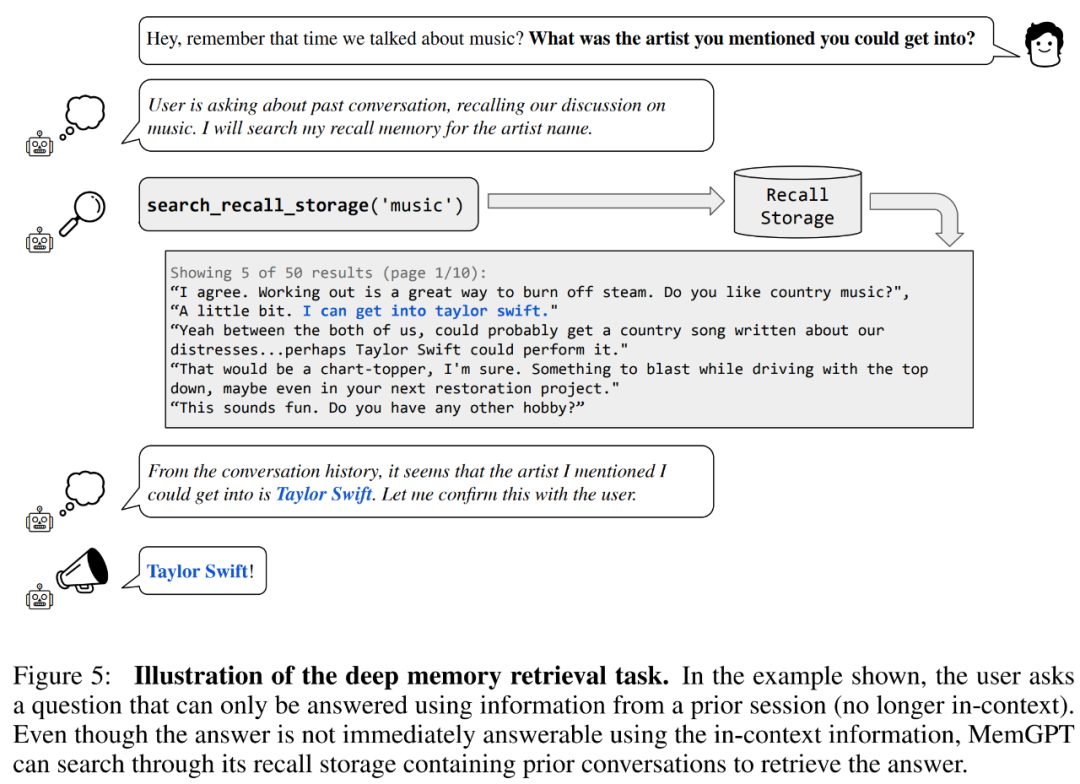

Lass uns zunächst die Konsistenzbewertung durchführen. Die Forscher führten eine DMR-Aufgabe (Deep Memory Retrieval) basierend auf dem MSC-Datensatz ein, um die Konsistenz des Konversationsagenten zu testen. Bei DMR stellt ein Benutzer einem Gesprächsagenten eine Frage und die Frage bezieht sich explizit auf ein früheres Gespräch, wobei erwartet wird, dass der Antwortbereich sehr eng ist. Einzelheiten finden Sie im Beispiel in Abbildung 5 unten.

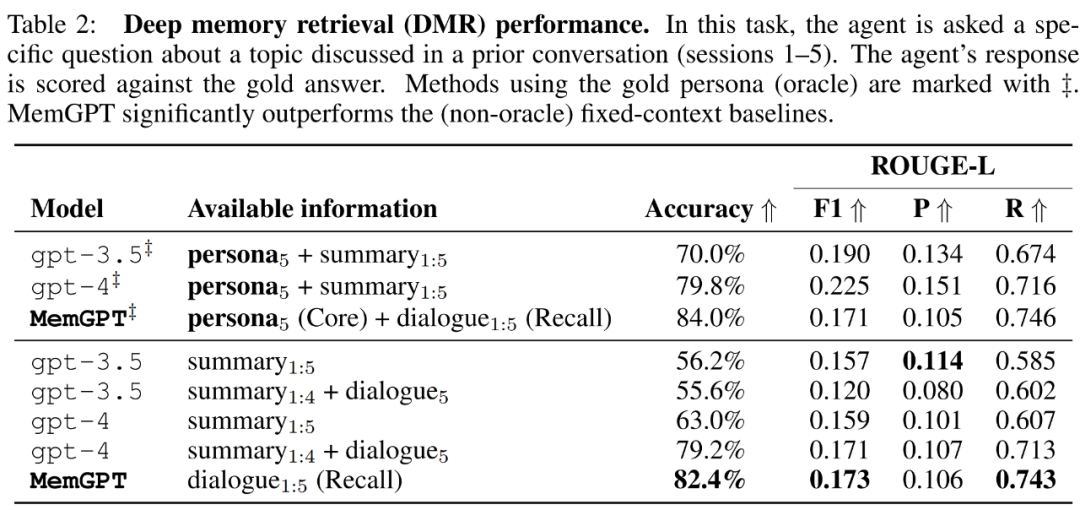

MemGPT nutzt den Speicher, um die Konsistenz aufrechtzuerhalten. Tabelle 2 unten zeigt den Leistungsvergleich von MemGPT mit Basismodellen mit festem Speicher, einschließlich GPT-3.5 und GPT-4.

Es ist ersichtlich, dass MemGPT in Bezug auf die LLM-Beurteilungsgenauigkeit und den ROUGE-L-Score deutlich besser ist als GPT-3.5 und GPT-4. MemGPT kann den Rückrufspeicher verwenden, um den Verlauf vergangener Konversationen abzufragen und DMR-Fragen zu beantworten, anstatt sich auf eine rekursive Zusammenfassung zu verlassen, um den Kontext zu erweitern.

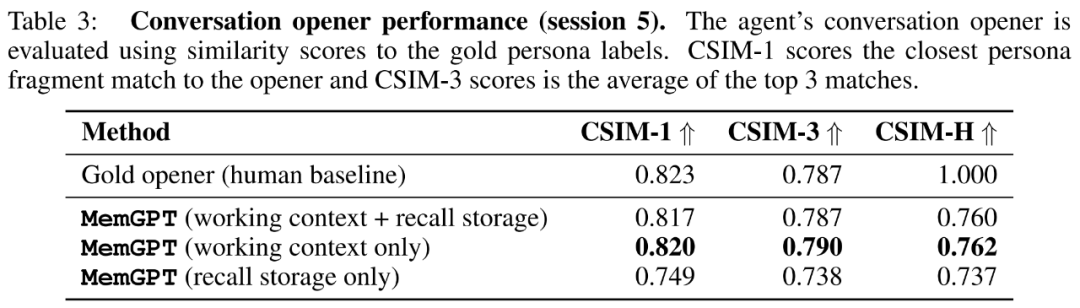

Dann bewerteten die Forscher in der Aufgabe „Konversationsstarter“ die Fähigkeit des Agenten, ansprechende Nachrichten aus dem in früheren Gesprächen gesammelten Wissen zu extrahieren und sie dem Benutzer zu übermitteln.

Die Forscher zeigen die CSIM-Werte der Eröffnungsbemerkungen von MemGPT in Tabelle 3 unten. Die Ergebnisse zeigen, dass MemGPT in der Lage ist, ansprechende Intros zu erstellen, deren Leistung genauso gut oder sogar besser ist als von Menschenhand geschriebene Intros. Es wurde auch beobachtet, dass MemGPT dazu neigt, Eröffnungen zu erzeugen, die länger sind und mehr Charakterinformationen abdecken als die menschliche Grundlinie. Abbildung 6 unten ist ein Beispiel.

MemGPT für die Dokumentenanalyse

Um die Fähigkeit von MemGPT zur Analyse von Dokumenten zu bewerten, führten Forscher MemGPT und Fixierung an der Retriever-Reader-Dokument-QS-Aufgabe von Liu et al. (2023a) durch. Es werden kontextbezogene Basismodelle verglichen.

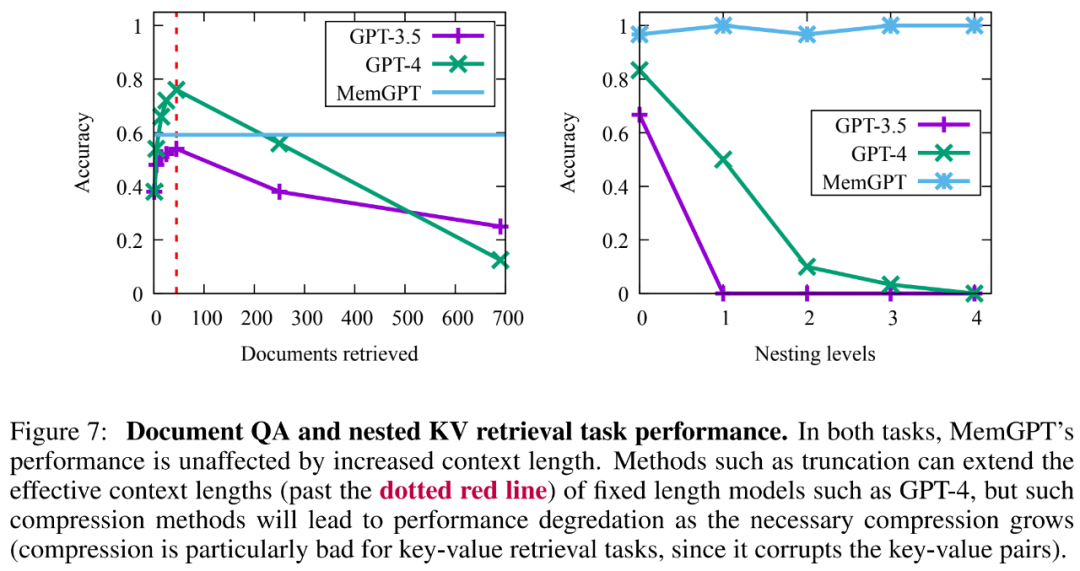

Die Ergebnisse zeigen, dass MemGPT in der Lage ist, durch Abfragen des Archivspeichers effizient mehrere Aufrufe an den Retriever zu tätigen, wodurch eine Skalierung auf größere effektive Kontextlängen ermöglicht wird. MemGPT ruft aktiv Dokumente aus dem Archivspeicher ab und kann die Ergebnisse iterativ durchblättern, sodass die Gesamtzahl der verfügbaren Dokumente nicht mehr durch die Anzahl der Dokumente im entsprechenden LLM-Prozessor-Kontextfenster begrenzt ist.

Aufgrund der Einschränkungen der einbettungsbasierten Ähnlichkeitssuche stellt die Dokumenten-QS-Aufgabe eine große Herausforderung für alle Methoden dar. Forscher beobachteten, dass MemGPT die Paginierung der Crawler-Ergebnisse stoppt, bevor die Crawler-Datenbank erschöpft ist.

Darüber hinaus gibt es einen Kompromiss bei der Kapazität der abgerufenen Dokumente, die durch komplexere Vorgänge von MemGPT erstellt wurden, wie in Abbildung 7 unten dargestellt. Die durchschnittliche Genauigkeit ist geringer als bei GPT-4 (höher als GPT-3.5), aber Es kann problemlos auf größere Dokumente skaliert werden.

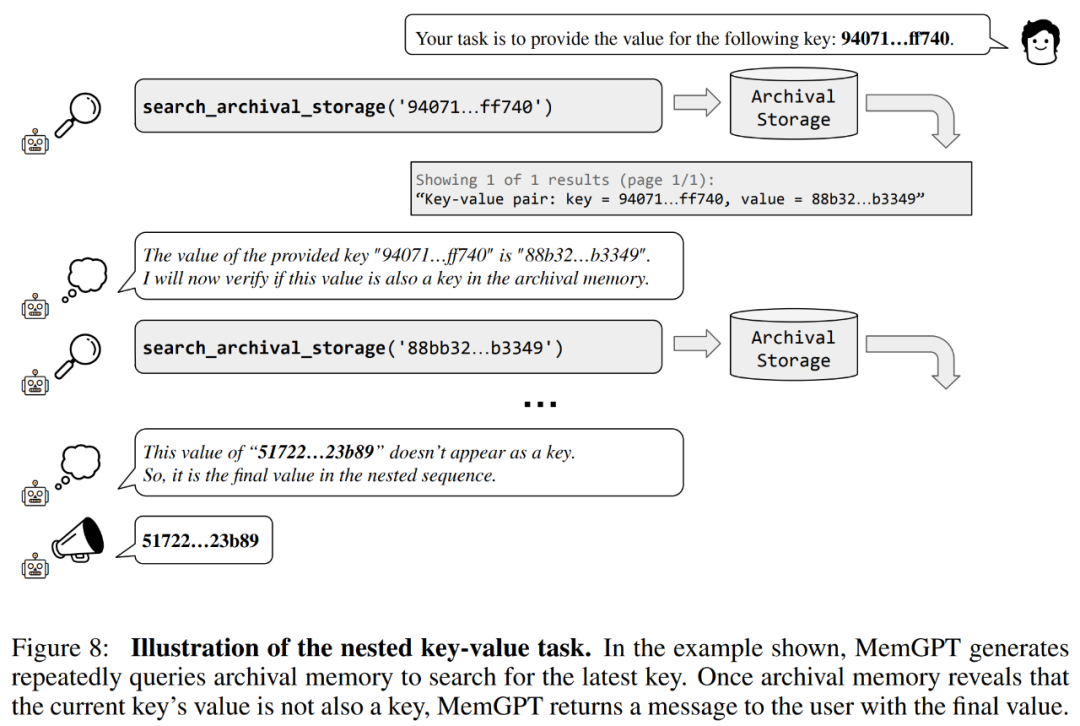

Die Forscher führten außerdem eine neue Aufgabe ein, die auf dem Abruf synthetischer Schlüsselwerte basiert, nämlich Nested Key-Value Retrieval, um zu demonstrieren, wie MemGPT Informationen aus mehreren Datenquellen organisiert.

Aus den Ergebnissen geht hervor, dass GPT-3.5 und GPT-4 zwar eine gute Leistung bei der ursprünglichen Schlüsselwertaufgabe zeigten, bei der Aufgabe zum Abruf verschachtelter Schlüsselwerte jedoch eine schlechte Leistung zeigten. MemGPT wird von der Anzahl der Verschachtelungsebenen nicht beeinflusst und kann verschachtelte Suchvorgänge durchführen, indem über Funktionsabfragen wiederholt auf im Hauptspeicher gespeicherte Schlüssel-Wert-Paare zugegriffen wird.

Die Leistung von MemGPT bei verschachtelten Schlüsselwert-Abrufaufgaben zeigt seine Fähigkeit, mehrere Suchvorgänge mithilfe einer Kombination mehrerer Abfragen durchzuführen.

Weitere technische Details und experimentelle Ergebnisse finden Sie im Originalpapier.

Das obige ist der detaillierte Inhalt vonBetrachten Sie LLM als ein Betriebssystem, es verfügt über unbegrenzten „virtuellen' Kontext, Berkeleys neues Werk hat 1,7.000 Sterne erhalten. Für weitere Informationen folgen Sie bitte anderen verwandten Artikeln auf der PHP chinesischen Website!

Heiße KI -Werkzeuge

Undresser.AI Undress

KI-gestützte App zum Erstellen realistischer Aktfotos

AI Clothes Remover

Online-KI-Tool zum Entfernen von Kleidung aus Fotos.

Undress AI Tool

Ausziehbilder kostenlos

Clothoff.io

KI-Kleiderentferner

AI Hentai Generator

Erstellen Sie kostenlos Ai Hentai.

Heißer Artikel

Heiße Werkzeuge

Notepad++7.3.1

Einfach zu bedienender und kostenloser Code-Editor

SublimeText3 chinesische Version

Chinesische Version, sehr einfach zu bedienen

Senden Sie Studio 13.0.1

Leistungsstarke integrierte PHP-Entwicklungsumgebung

Dreamweaver CS6

Visuelle Webentwicklungstools

SublimeText3 Mac-Version

Codebearbeitungssoftware auf Gottesniveau (SublimeText3)

Heiße Themen

1375

1375

52

52

„Defect Spectrum' durchbricht die Grenzen der herkömmlichen Fehlererkennung und erreicht erstmals eine hochpräzise und umfassende semantische Fehlererkennung in der Industrie.

Jul 26, 2024 pm 05:38 PM

„Defect Spectrum' durchbricht die Grenzen der herkömmlichen Fehlererkennung und erreicht erstmals eine hochpräzise und umfassende semantische Fehlererkennung in der Industrie.

Jul 26, 2024 pm 05:38 PM

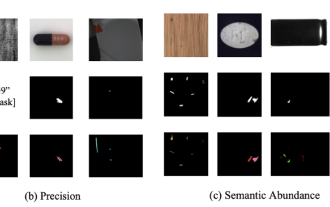

In der modernen Fertigung ist die genaue Fehlererkennung nicht nur der Schlüssel zur Sicherstellung der Produktqualität, sondern auch der Kern für die Verbesserung der Produktionseffizienz. Allerdings mangelt es vorhandenen Datensätzen zur Fehlererkennung häufig an der Genauigkeit und dem semantischen Reichtum, die für praktische Anwendungen erforderlich sind, was dazu führt, dass Modelle bestimmte Fehlerkategorien oder -orte nicht identifizieren können. Um dieses Problem zu lösen, hat ein Spitzenforschungsteam bestehend aus der Hong Kong University of Science and Technology Guangzhou und Simou Technology innovativ den „DefectSpectrum“-Datensatz entwickelt, der eine detaillierte und semantisch reichhaltige groß angelegte Annotation von Industriedefekten ermöglicht. Wie in Tabelle 1 gezeigt, bietet der Datensatz „DefectSpectrum“ im Vergleich zu anderen Industriedatensätzen die meisten Fehleranmerkungen (5438 Fehlerproben) und die detaillierteste Fehlerklassifizierung (125 Fehlerkategorien).

Das NVIDIA-Dialogmodell ChatQA wurde auf Version 2.0 weiterentwickelt, wobei die angegebene Kontextlänge 128 KB beträgt

Jul 26, 2024 am 08:40 AM

Das NVIDIA-Dialogmodell ChatQA wurde auf Version 2.0 weiterentwickelt, wobei die angegebene Kontextlänge 128 KB beträgt

Jul 26, 2024 am 08:40 AM

Die offene LLM-Community ist eine Ära, in der hundert Blumen blühen und konkurrieren. Sie können Llama-3-70B-Instruct, QWen2-72B-Instruct, Nemotron-4-340B-Instruct, Mixtral-8x22BInstruct-v0.1 und viele andere sehen hervorragende Darsteller. Allerdings weisen offene Modelle im Vergleich zu den proprietären Großmodellen GPT-4-Turbo in vielen Bereichen noch erhebliche Lücken auf. Zusätzlich zu allgemeinen Modellen wurden einige offene Modelle entwickelt, die sich auf Schlüsselbereiche spezialisieren, wie etwa DeepSeek-Coder-V2 für Programmierung und Mathematik und InternVL für visuelle Sprachaufgaben.

Google AI gewann die Silbermedaille der IMO Mathematical Olympiad, das mathematische Argumentationsmodell AlphaProof wurde eingeführt und Reinforcement Learning ist zurück

Jul 26, 2024 pm 02:40 PM

Google AI gewann die Silbermedaille der IMO Mathematical Olympiad, das mathematische Argumentationsmodell AlphaProof wurde eingeführt und Reinforcement Learning ist zurück

Jul 26, 2024 pm 02:40 PM

Für KI ist die Mathematikolympiade kein Problem mehr. Am Donnerstag hat die künstliche Intelligenz von Google DeepMind eine Meisterleistung vollbracht: Sie nutzte KI, um meiner Meinung nach die eigentliche Frage der diesjährigen Internationalen Mathematikolympiade zu lösen, und war nur einen Schritt davon entfernt, die Goldmedaille zu gewinnen. Der IMO-Wettbewerb, der gerade letzte Woche zu Ende ging, hatte sechs Fragen zu Algebra, Kombinatorik, Geometrie und Zahlentheorie. Das von Google vorgeschlagene hybride KI-System beantwortete vier Fragen richtig und erzielte 28 Punkte und erreichte damit die Silbermedaillenstufe. Anfang dieses Monats hatte der UCLA-Professor Terence Tao gerade die KI-Mathematische Olympiade (AIMO Progress Award) mit einem Millionenpreis gefördert. Unerwarteterweise hatte sich das Niveau der KI-Problemlösung vor Juli auf dieses Niveau verbessert. Beantworten Sie die Fragen meiner Meinung nach gleichzeitig. Am schwierigsten ist es meiner Meinung nach, da sie die längste Geschichte, den größten Umfang und die negativsten Fragen haben

Der Standpunkt der Natur: Die Erprobung künstlicher Intelligenz in der Medizin ist im Chaos. Was ist zu tun?

Aug 22, 2024 pm 04:37 PM

Der Standpunkt der Natur: Die Erprobung künstlicher Intelligenz in der Medizin ist im Chaos. Was ist zu tun?

Aug 22, 2024 pm 04:37 PM

Herausgeber | ScienceAI Basierend auf begrenzten klinischen Daten wurden Hunderte medizinischer Algorithmen genehmigt. Wissenschaftler diskutieren darüber, wer die Werkzeuge testen soll und wie dies am besten geschieht. Devin Singh wurde Zeuge, wie ein pädiatrischer Patient in der Notaufnahme einen Herzstillstand erlitt, während er lange auf eine Behandlung wartete, was ihn dazu veranlasste, den Einsatz von KI zu erforschen, um Wartezeiten zu verkürzen. Mithilfe von Triage-Daten aus den Notaufnahmen von SickKids erstellten Singh und Kollegen eine Reihe von KI-Modellen, um mögliche Diagnosen zu stellen und Tests zu empfehlen. Eine Studie zeigte, dass diese Modelle die Zahl der Arztbesuche um 22,3 % verkürzen können und die Verarbeitung der Ergebnisse pro Patient, der einen medizinischen Test benötigt, um fast drei Stunden beschleunigt. Der Erfolg von Algorithmen der künstlichen Intelligenz in der Forschung bestätigt dies jedoch nur

Training mit Millionen von Kristalldaten zur Lösung kristallographischer Phasenprobleme, die Deep-Learning-Methode PhAI wird in Science veröffentlicht

Aug 08, 2024 pm 09:22 PM

Training mit Millionen von Kristalldaten zur Lösung kristallographischer Phasenprobleme, die Deep-Learning-Methode PhAI wird in Science veröffentlicht

Aug 08, 2024 pm 09:22 PM

Herausgeber |KX Bis heute sind die durch die Kristallographie ermittelten Strukturdetails und Präzision, von einfachen Metallen bis hin zu großen Membranproteinen, mit keiner anderen Methode zu erreichen. Die größte Herausforderung, das sogenannte Phasenproblem, bleibt jedoch die Gewinnung von Phaseninformationen aus experimentell bestimmten Amplituden. Forscher der Universität Kopenhagen in Dänemark haben eine Deep-Learning-Methode namens PhAI entwickelt, um Kristallphasenprobleme zu lösen. Ein Deep-Learning-Neuronales Netzwerk, das mithilfe von Millionen künstlicher Kristallstrukturen und den entsprechenden synthetischen Beugungsdaten trainiert wird, kann genaue Elektronendichtekarten erstellen. Die Studie zeigt, dass diese Deep-Learning-basierte Ab-initio-Strukturlösungsmethode das Phasenproblem mit einer Auflösung von nur 2 Angström lösen kann, was nur 10 bis 20 % der bei atomarer Auflösung verfügbaren Daten im Vergleich zur herkömmlichen Ab-initio-Berechnung entspricht

Um ein neues wissenschaftliches und komplexes Frage-Antwort-Benchmark- und Bewertungssystem für große Modelle bereitzustellen, haben UNSW, Argonne, die University of Chicago und andere Institutionen gemeinsam das SciQAG-Framework eingeführt

Jul 25, 2024 am 06:42 AM

Um ein neues wissenschaftliches und komplexes Frage-Antwort-Benchmark- und Bewertungssystem für große Modelle bereitzustellen, haben UNSW, Argonne, die University of Chicago und andere Institutionen gemeinsam das SciQAG-Framework eingeführt

Jul 25, 2024 am 06:42 AM

Herausgeber | Der Frage-Antwort-Datensatz (QA) von ScienceAI spielt eine entscheidende Rolle bei der Förderung der Forschung zur Verarbeitung natürlicher Sprache (NLP). Hochwertige QS-Datensätze können nicht nur zur Feinabstimmung von Modellen verwendet werden, sondern auch effektiv die Fähigkeiten großer Sprachmodelle (LLMs) bewerten, insbesondere die Fähigkeit, wissenschaftliche Erkenntnisse zu verstehen und zu begründen. Obwohl es derzeit viele wissenschaftliche QS-Datensätze aus den Bereichen Medizin, Chemie, Biologie und anderen Bereichen gibt, weisen diese Datensätze immer noch einige Mängel auf. Erstens ist das Datenformular relativ einfach, die meisten davon sind Multiple-Choice-Fragen. Sie sind leicht auszuwerten, schränken jedoch den Antwortauswahlbereich des Modells ein und können die Fähigkeit des Modells zur Beantwortung wissenschaftlicher Fragen nicht vollständig testen. Im Gegensatz dazu offene Fragen und Antworten

Identifizieren Sie automatisch die besten Moleküle und reduzieren Sie die Synthesekosten. Das MIT entwickelt ein Algorithmus-Framework für die Entscheidungsfindung im molekularen Design

Jun 22, 2024 am 06:43 AM

Identifizieren Sie automatisch die besten Moleküle und reduzieren Sie die Synthesekosten. Das MIT entwickelt ein Algorithmus-Framework für die Entscheidungsfindung im molekularen Design

Jun 22, 2024 am 06:43 AM

Herausgeber |. Der Einsatz von Ziluo AI bei der Rationalisierung der Arzneimittelforschung nimmt explosionsartig zu. Durchsuchen Sie Milliarden von Kandidatenmolekülen nach solchen, die möglicherweise über Eigenschaften verfügen, die für die Entwicklung neuer Medikamente erforderlich sind. Es sind so viele Variablen zu berücksichtigen, von Materialpreisen bis hin zum Fehlerrisiko, dass es keine leichte Aufgabe ist, die Kosten für die Synthese der besten Kandidatenmoleküle abzuwägen, selbst wenn Wissenschaftler KI einsetzen. Hier entwickelten MIT-Forscher SPARROW, ein quantitatives Entscheidungsalgorithmus-Framework, um automatisch die besten molekularen Kandidaten zu identifizieren und so die Synthesekosten zu minimieren und gleichzeitig die Wahrscheinlichkeit zu maximieren, dass die Kandidaten die gewünschten Eigenschaften aufweisen. Der Algorithmus bestimmte auch die Materialien und experimentellen Schritte, die zur Synthese dieser Moleküle erforderlich sind. SPARROW berücksichtigt die Kosten für die gleichzeitige Synthese einer Charge von Molekülen, da häufig mehrere Kandidatenmoleküle verfügbar sind

SOTA Performance, eine multimodale KI-Methode zur Vorhersage der Protein-Ligand-Affinität in Xiamen, kombiniert erstmals molekulare Oberflächeninformationen

Jul 17, 2024 pm 06:37 PM

SOTA Performance, eine multimodale KI-Methode zur Vorhersage der Protein-Ligand-Affinität in Xiamen, kombiniert erstmals molekulare Oberflächeninformationen

Jul 17, 2024 pm 06:37 PM

Herausgeber |. KX Im Bereich der Arzneimittelforschung und -entwicklung ist die genaue und effektive Vorhersage der Bindungsaffinität von Proteinen und Liganden für das Arzneimittelscreening und die Arzneimitteloptimierung von entscheidender Bedeutung. Aktuelle Studien berücksichtigen jedoch nicht die wichtige Rolle molekularer Oberflächeninformationen bei Protein-Ligand-Wechselwirkungen. Auf dieser Grundlage schlugen Forscher der Universität Xiamen ein neuartiges Framework zur multimodalen Merkmalsextraktion (MFE) vor, das erstmals Informationen über Proteinoberfläche, 3D-Struktur und -Sequenz kombiniert und einen Kreuzaufmerksamkeitsmechanismus verwendet, um verschiedene Modalitäten zu vergleichen Ausrichtung. Experimentelle Ergebnisse zeigen, dass diese Methode bei der Vorhersage von Protein-Ligand-Bindungsaffinitäten Spitzenleistungen erbringt. Darüber hinaus belegen Ablationsstudien die Wirksamkeit und Notwendigkeit der Proteinoberflächeninformation und der multimodalen Merkmalsausrichtung innerhalb dieses Rahmens. Verwandte Forschungen beginnen mit „S