Technologie-Peripheriegeräte

Technologie-Peripheriegeräte

KI

KI

OpenAI-Bilderkennungstool enthüllt, CTO: 99 % der von KI generierten Bilder können erkannt werden

OpenAI-Bilderkennungstool enthüllt, CTO: 99 % der von KI generierten Bilder können erkannt werden

OpenAI-Bilderkennungstool enthüllt, CTO: 99 % der von KI generierten Bilder können erkannt werden

OpenAI wird die KI-Bilderkennung einführen.

Neueste Nachrichten: Ihr Unternehmen entwickelt ein Erkennungstool.

Laut Chief Technology Officer Mira Murat:

Dieses Tool verfügt über eine sehr hohe Genauigkeit mit einer Genauigkeitsrate von bis zu 99 %.

Es befindet sich derzeit im internen Testprozess und wird bald der Öffentlichkeit zugänglich gemacht.

Ich muss sagen, dass diese Genauigkeitsrate immer noch etwas aufregend ist. Schließlich sind die bisherigen Bemühungen von OpenAI in der KI-Texterkennung mit einer „Genauigkeitsrate von 26 %“ kläglich gescheitert.

Die Erkennung von KI-Inhalten ist nicht einfach

OpenAI verfügt bereits über ein Layout im Bereich der Erkennung von KI-Inhalten.

Im Januar dieses Jahres haben sie einen KI-Textdetektor auf den Markt gebracht, um KI-Inhalte von von Menschen erstellten Inhalten zu unterscheiden und so den Missbrauch von KI-Texten zu verhindern.

Dieses Tool wurde jedoch im Juli leider eingestellt: Ohne Ankündigung wurde die Seite direkt 404.

Der Grund ist, dass die Genauigkeitsrate zu niedrig ist, „fast wie beim Raten“.

Laut von OpenAI selbst veröffentlichten Daten:

Es kann nur 26 % des KI-generierten Textes korrekt identifizieren, während 9 % des von Menschen geschriebenen Textes falsch identifiziert werden.

Nach diesem überstürzten Ende erklärte OpenAI, dass es Benutzerfeedback aufnehmen, sich um Verbesserungen bemühen und effektivere Textquellentechnologie erforschen werde.

Gleichzeitig kündigten sie auch an, dass auch Tools entwickelt werden, um festzustellen, ob Bilder, Audio und Video von KI erzeugt werden.

Mit der Einführung von DALL-E 3 und der kontinuierlichen Weiterentwicklung ähnlicher Tools wie Midjourney werden die KI-Malfunktionen immer stärker.

Die größte Sorge besteht darin, dass es zur Herstellung gefälschter Nachrichtenbilder auf der ganzen Welt verwendet wird.

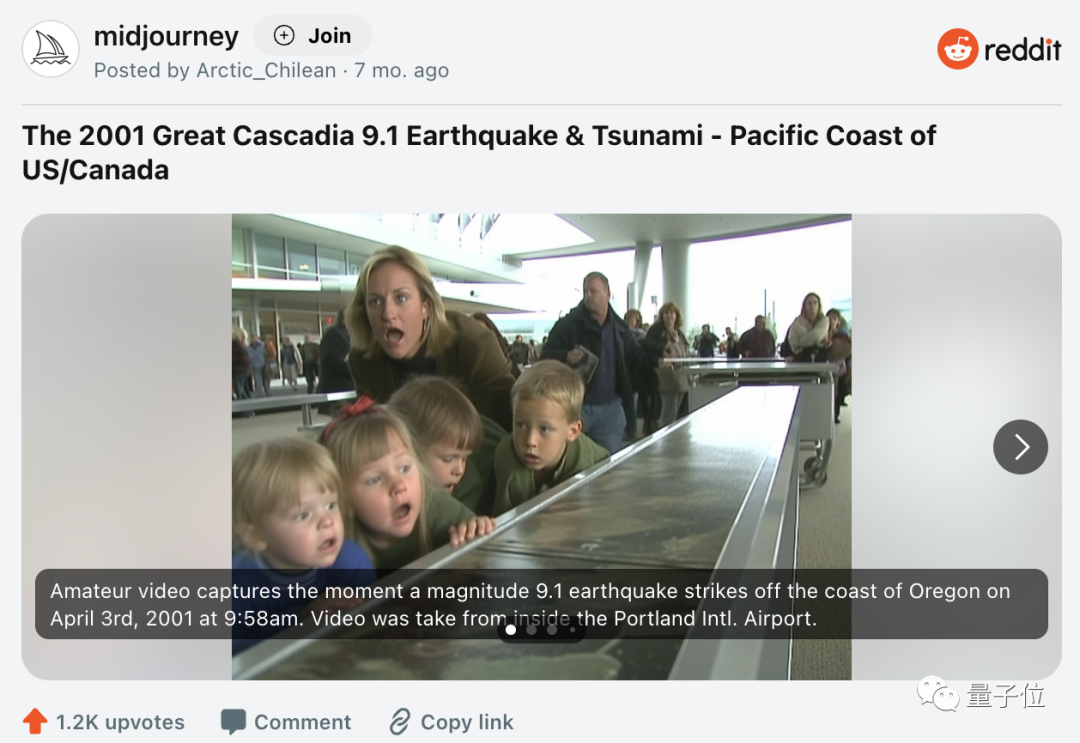

Zum Beispiel gibt es auf Reddit eine KI-gefälschte „Szene“ des „Erdbebens und Tsunamis der Stärke 9,1 in Cascadia 2001“, die mehr als 1,2.000 Internetnutzern gefallen hat.

Im Vergleich zu KI-Texterkennungstools ist die Entwicklung von KI-Zeichnungserkennungstools offensichtlich dringender (wahrscheinlich, weil „es niemanden interessiert, ob die Rede von ihm selbst oder von einer Sekretärin geschrieben wird“, aber „bei Bildern schon Wahrheit“ Es ist schwer, den Inhalt nicht zu glauben).

Aber gerade als das KI-Texterkennungstool von OpenAI offline war, wiesen einige Internetnutzer darauf hin:

Die gleichzeitige Entwicklung von Generierungs- und Erkennungstools ist von Natur aus widersprüchlich.

Wenn es einer Seite gut geht, bedeutet das, dass es der anderen Seite nicht gut geht, und es kann auch ein Interessenkonflikt vorliegen.

Die einfachere Idee ist die Übergabe an einen Dritten.

Aber die Leistung Dritter bei KI-Texten war bisher nicht gut.

Was die Technologie selbst betrifft, besteht eine weitere praktikable Methode darin, das Wasserzeichen zu verbergen, wenn KI Inhalte generiert.

Das macht Google.

Vor ein paar Tagen (Ende August dieses Jahres) hat Google vor OpenAI eine KI-Bilderkennungstechnologie eingeführt:

SynthID.

Es arbeitet derzeit mit Googles Bildmodell Imagen zusammen, sodass jedes vom Modell generierte Bild mit einer „von KI generierten Metadaten-ID“ eingebettet ist –

Auch wenn das Bild zugeschnitten ist, werden Filter hinzugefügt, eine Reihe von Modifikationen, wie z B. wechselnde Farben oder gar verlustbehaftete Komprimierung, haben keinen Einfluss auf die Erkennung.

In internen Tests hat SynthID eine große Anzahl bearbeiteter KI-Bilder genau identifiziert, die genaue Genauigkeitsrate wurde jedoch nicht bekannt gegeben.

Ich weiß nicht, welche Technologie das kommende Tool von OpenAI verwenden wird und ob es das mit der höchsten Genauigkeit auf dem Markt sein wird.

Ultraman antwortet auf den „Core Building Plan“

Die oben genannten Nachrichten stammen aus den Reden, die OpenAI CTO und Ultraman diese Woche auf der Tech Live-Konferenz des Wall Street Journal gehalten haben.

Bei dem Treffen verrieten die beiden auch weitere Neuigkeiten zu OpenAI.

So könnte beispielsweise bald die nächste Generation großer Modelle auf den Markt kommen.

Der Name wird nicht bekannt gegeben, aber OpenAI hat im Juli dieses Jahres die Marke GPT-5 angemeldet.

Manche Leute sind besorgt über die Genauigkeit von „GPT-5“ und fragen sich, ob es nicht mehr zu Fehlern oder falschen Inhalten führen kann.

In dieser Hinsicht war der CTO vorsichtiger und sagte nur „vielleicht“.

Sie erklärte:

Wir haben beim Halluzinationsproblem bei GPT-4 große Fortschritte gemacht, aber es ist noch nicht dort, wo wir sein müssen.

Ultraman sprach über den „Core Building Plan“.

Nach seinen ursprünglichen Worten zu urteilen, gibt es keine „Bestätigung“, aber es lässt auch unbegrenzten Raum für Fantasie:

Wenn wir dem Standardpfad folgen, werden wir dies definitiv nicht tun, aber ich werde diese Möglichkeit niemals ausschließen. .

Im Vergleich zum „Kernherstellungsplan“ reagierte Ultraman ganz einfach auf die Gerüchte über die Herstellung von Mobiltelefonen.

Im September dieses Jahres wurde bekannt, dass Apples ehemaliger Chief Design Officer Jony Ive (der seit 27 Jahren bei Apple arbeitet) mit OpenAI in Kontakt stand. Quellen sagten, dass Altman ein Hardwaregerät entwickeln wollte, um ein natürlicheres und realistischeres Design zu ermöglichen Interaktive Möglichkeit, mit KI zu interagieren. Auf intuitive Weise kann es als „iPhone der KI-Welt“ bezeichnet werden.

Jetzt sagte er allen:Ich bin mir noch nicht sicher, was ich tun möchte, ich habe nur ein paar vage Vorstellungen.Und:

Kein KI-Gerät wird die Popularität des iPhones in den Schatten stellen, und ich habe kein Interesse daran, mit irgendeinem Smartphone zu konkurrieren.

Referenzlink:

[1]https://finance.yahoo.com/news/openai-claims-tool-detect-ai-051511179.html?guccounter=1.

[2]https://gizmodo.com/openais-sam-altman-says-he-has-no-interest-in-competing-1850937333.

Das obige ist der detaillierte Inhalt vonOpenAI-Bilderkennungstool enthüllt, CTO: 99 % der von KI generierten Bilder können erkannt werden. Für weitere Informationen folgen Sie bitte anderen verwandten Artikeln auf der PHP chinesischen Website!

Heiße KI -Werkzeuge

Undresser.AI Undress

KI-gestützte App zum Erstellen realistischer Aktfotos

AI Clothes Remover

Online-KI-Tool zum Entfernen von Kleidung aus Fotos.

Undress AI Tool

Ausziehbilder kostenlos

Clothoff.io

KI-Kleiderentferner

Video Face Swap

Tauschen Sie Gesichter in jedem Video mühelos mit unserem völlig kostenlosen KI-Gesichtstausch-Tool aus!

Heißer Artikel

Heiße Werkzeuge

Notepad++7.3.1

Einfach zu bedienender und kostenloser Code-Editor

SublimeText3 chinesische Version

Chinesische Version, sehr einfach zu bedienen

Senden Sie Studio 13.0.1

Leistungsstarke integrierte PHP-Entwicklungsumgebung

Dreamweaver CS6

Visuelle Webentwicklungstools

SublimeText3 Mac-Version

Codebearbeitungssoftware auf Gottesniveau (SublimeText3)

Heiße Themen

1393

1393

52

52

1206

1206

24

24

Web3 Trading Platform Ranking_Web3 Globale Top Ten Summary Top Ten Summary

Apr 21, 2025 am 10:45 AM

Web3 Trading Platform Ranking_Web3 Globale Top Ten Summary Top Ten Summary

Apr 21, 2025 am 10:45 AM

Binance ist der Overlord des Global Digital Asset Trading -Ökosystems, und seine Merkmale umfassen: 1. Das durchschnittliche tägliche Handelsvolumen übersteigt 150 Milliarden US -Dollar, unterstützt 500 Handelspaare, die 98% der Mainstream -Währungen abdecken. 2. Die Innovationsmatrix deckt den Markt für Derivate, das Web3 -Layout und den Bildungssystem ab; 3. Die technischen Vorteile sind Millisekunden -Matching -Engines mit Spitzenvolumina von 1,4 Millionen Transaktionen pro Sekunde. 4. Compliance Progress hält 15 Länderlizenzen und legt konforme Einheiten in Europa und den Vereinigten Staaten ein.

Was bedeutet Cross-Chain-Transaktion? Was sind die Cross-Chain-Transaktionen?

Apr 21, 2025 pm 11:39 PM

Was bedeutet Cross-Chain-Transaktion? Was sind die Cross-Chain-Transaktionen?

Apr 21, 2025 pm 11:39 PM

Börsen, die Cross-Chain-Transaktionen unterstützen: 1. Binance, 2. Uniswap, 3. Sushiswap, 4. Kurvenfinanzierung, 5. Thorchain, 6. 1inch Exchange, 7. DLN-Handel, diese Plattformen unterstützen Multi-Chain-Asset-Transaktionen durch verschiedene Technologien.

Top 10 Cryptocurrency Exchange -Plattformen Die weltweit größte Liste der digitalen Währung

Apr 21, 2025 pm 07:15 PM

Top 10 Cryptocurrency Exchange -Plattformen Die weltweit größte Liste der digitalen Währung

Apr 21, 2025 pm 07:15 PM

Börsen spielen eine wichtige Rolle auf dem heutigen Kryptowährungsmarkt. Sie sind nicht nur Plattformen, an denen Investoren handeln, sondern auch wichtige Quellen für Marktliquidität und Preisentdeckung. Der weltweit größte virtuelle Währungsbörsen gehören zu den Top Ten, und diese Börsen sind nicht nur im Handelsvolumen weit voraus, sondern haben auch ihre eigenen Vorteile in Bezug auf Benutzererfahrung, Sicherheit und innovative Dienste. Börsen, die über die Liste stehen, haben normalerweise eine große Benutzerbasis und einen umfangreichen Markteinfluss, und deren Handelsvolumen und Vermögenstypen sind häufig mit anderen Börsen schwer zu erreichen.

Rangliste der Hebelbörsen im Währungskreis Die neuesten Empfehlungen der zehn meistgezogenen Börsen im Währungskreis

Apr 21, 2025 pm 11:24 PM

Rangliste der Hebelbörsen im Währungskreis Die neuesten Empfehlungen der zehn meistgezogenen Börsen im Währungskreis

Apr 21, 2025 pm 11:24 PM

Die Plattformen, die im Jahr 2025 im Leveraged Trading, Security und Benutzererfahrung hervorragende Leistung haben, sind: 1. OKX, geeignet für Hochfrequenzhändler und bieten bis zu 100-fache Hebelwirkung; 2. Binance, geeignet für Mehrwährungshändler auf der ganzen Welt und bietet 125-mal hohe Hebelwirkung; 3. Gate.io, geeignet für professionelle Derivate Spieler, die 100 -fache Hebelwirkung bietet; 4. Bitget, geeignet für Anfänger und Sozialhändler, die bis zu 100 -fache Hebelwirkung bieten; 5. Kraken, geeignet für stetige Anleger, die fünfmal Hebelwirkung liefert; 6. Bybit, geeignet für Altcoin -Entdecker, die 20 -fache Hebelwirkung bietet; 7. Kucoin, geeignet für kostengünstige Händler, die 10-fache Hebelwirkung bietet; 8. Bitfinex, geeignet für das Seniorenspiel

Warum ist der Anstieg oder Abfall der virtuellen Währungspreise? Warum ist der Anstieg oder Abfall der virtuellen Währungspreise?

Apr 21, 2025 am 08:57 AM

Warum ist der Anstieg oder Abfall der virtuellen Währungspreise? Warum ist der Anstieg oder Abfall der virtuellen Währungspreise?

Apr 21, 2025 am 08:57 AM

Faktoren der steigenden Preise für virtuelle Währung sind: 1. Erhöhte Marktnachfrage, 2. Verringertes Angebot, 3.. Rückgangsfaktoren umfassen: 1. Verringerte Marktnachfrage, 2. Erhöhtes Angebot, 3. Streik der negativen Nachrichten, 4. Pessimistische Marktstimmung, 5. makroökonomisches Umfeld.

Wie man Verluste nach dem ETH -Upgrade vermeidet

Apr 21, 2025 am 10:03 AM

Wie man Verluste nach dem ETH -Upgrade vermeidet

Apr 21, 2025 am 10:03 AM

Nach dem ETH -Upgrade sollten Anfänger die folgenden Strategien anwenden, um Verluste zu vermeiden: 1. Machen Sie ihre Hausaufgaben und verstehen Sie das Grundwissen und aktualisieren Sie Inhalte von ETH; 2. Kontrollpositionen, testen Sie die Gewässer in kleinen Mengen und diversifizieren Investitionen; 3. Machen Sie einen Handelsplan, klären Sie die Ziele und setzen Sie Stop -Loss -Punkte. 4. Profile rational und vermeiden emotionale Entscheidungen; 5. Wählen Sie eine formelle und zuverlässige Handelsplattform; 6. Betrachten Sie die langfristige Beteiligung, um die Auswirkungen kurzfristiger Schwankungen zu vermeiden.

Was sind die zehn besten Plattformen im Währungsaustauschkreis?

Apr 21, 2025 pm 12:21 PM

Was sind die zehn besten Plattformen im Währungsaustauschkreis?

Apr 21, 2025 pm 12:21 PM

Zu den Top -Börsen gehören: 1. Binance, das weltweit größte Handelsvolumen, unterstützt 600 Währungen und die Spot -Handhabungsgebühr beträgt 0,1%. 2. OKX, eine ausgewogene Plattform, unterstützt 708 Handelspaare, und die dauerhafte Vertragsabwicklungsgebühr beträgt 0,05%. 3. Gate.io deckt 2700 kleine Währungen ab, und die Gebühr für die Spot-Handhabung beträgt 0,1%-0,3%; 4. Coinbase, der US -Konformitäts -Benchmark, die Spot -Handhabungsgebühr beträgt 0,5%; 5. Kraken, die Top -Sicherheit und regelmäßige Reserveprüfung.

So gewinnen Sie Kernel Airdrop -Belohnungen für Binance vollständige Prozessstrategie

Apr 21, 2025 pm 01:03 PM

So gewinnen Sie Kernel Airdrop -Belohnungen für Binance vollständige Prozessstrategie

Apr 21, 2025 pm 01:03 PM

In der geschäftigen Welt der Kryptowährungen entstehen immer neue Möglichkeiten. Gegenwärtig zieht Kerneldao (Kernel) Airdrop -Aktivität viel Aufmerksamkeit auf sich und zieht die Aufmerksamkeit vieler Investoren auf sich. Also, was ist der Ursprung dieses Projekts? Welche Vorteile können BNB -Inhaber davon bekommen? Machen Sie sich keine Sorgen, das Folgende wird es einzeln für Sie enthüllen.