Technologie-Peripheriegeräte

Technologie-Peripheriegeräte

KI

KI

Die LLaMA2-Kontextlänge steigt sprunghaft auf 1 Million Token, wobei nur ein Hyperparameter angepasst werden muss.

Die LLaMA2-Kontextlänge steigt sprunghaft auf 1 Million Token, wobei nur ein Hyperparameter angepasst werden muss.

Die LLaMA2-Kontextlänge steigt sprunghaft auf 1 Million Token, wobei nur ein Hyperparameter angepasst werden muss.

Mit nur wenigen Änderungen kann die Kontextgröße für die Unterstützung großer Modelle von 16.000 Token auf 1 Million erweitert werden? !

Immer noch auf LLaMA 2, das nur 7 Milliarden Parameter hat.

Sie müssen wissen, dass selbst die derzeit beliebten Claude 2 und GPT-4 Kontextlängen von nur 100.000 und 32.000 unterstützen. Über diesen Bereich hinaus werden große Modelle anfangen, Unsinn zu reden und sich nicht mehr an Dinge erinnern zu können.

Jetzt hat eine neue Studie der Fudan-Universität und des Shanghai Artificial Intelligence Laboratory nicht nur einen Weg gefunden, die Länge des Kontextfensters für eine Reihe großer Modelle zu erhöhen, sondern auch die Regeln entdeckt.

Gemäß dieser Regel muss nur 1 Hyperparameter angepasst werden, kann den Ausgabeeffekt sicherstellen und gleichzeitig die Extrapolationsleistung großer Modelle stabil verbessern.

Extrapolation bezieht sich auf die Änderung der Ausgabeleistung, wenn die Eingabelänge des großen Modells die Länge des vorab trainierten Textes überschreitet. Wenn die Extrapolationsfähigkeit nicht gut ist, wird das große Modell „Unsinn reden“, sobald die Eingabelänge die Länge des vorab trainierten Textes überschreitet.

Was genau kann es also die Extrapolationsfähigkeiten großer Modelle verbessern und wie gelingt das?

„Mechanismus“ zur Verbesserung der Extrapolationsfähigkeiten großer Modelle

Diese Methode zur Verbesserung der Extrapolationsfähigkeiten großer Modelle hängt mit dem Modul „Positional Encoding“ in der Transformer-Architektur zusammen. Tatsächlich kann das Modul des einfachen Aufmerksamkeitsmechanismus (Aufmerksamkeit) keine Token in unterschiedlichen Positionen unterscheiden. Beispielsweise gibt es in seinen Augen keinen Unterschied zwischen „Ich esse Äpfel“ und „Äpfel fressen mich“.

Daher muss eine Positionskodierung hinzugefügt werden, damit die Informationen zur Wortreihenfolge verstanden und die Bedeutung eines Satzes wirklich verstanden werden können.

Die aktuellen Transformer-Positionskodierungsmethoden umfassen die absolute Positionskodierung (Integration von Positionsinformationen in die Eingabe), die relative Positionskodierung (Schreiben von Positionsinformationen in die Berechnung des Aufmerksamkeitswerts) und die Rotationspositionskodierung. Unter ihnen ist die Rotationspositionskodierung am beliebtesten, nämlich

RoPE. RoPE erreicht den Effekt der relativen Positionscodierung durch absolute Positionscodierung, kann jedoch im Vergleich zur relativen Positionscodierung das Extrapolationspotenzial großer Modelle besser verbessern.

Wie man die Extrapolationsfähigkeiten großer Modelle mithilfe der RoPE-Positionscodierung weiter stimulieren kann, ist ebenfalls zu einer neuen Richtung vieler neuerer Studien geworden.

Diese Studien sind hauptsächlich in zwei große Schulen unterteilt:

Aufmerksamkeit einschränkenund Drehwinkel anpassen. Repräsentative Forschung zur Einschränkung der Aufmerksamkeit umfasst ALiBi, xPos, BCA usw. Das kürzlich vom MIT vorgeschlagene StreamingLLM kann es großen Modellen ermöglichen, eine unendliche Eingabelänge zu erreichen (erhöht jedoch nicht die Länge des Kontextfensters), was zu der Art der Forschung in dieser Richtung gehört.

△Der Autor der Bildquelle

△Der Autor der Bildquelle

hat mehr Arbeit, um den Drehwinkel anzupassen. Typische Vertreter wie lineare Interpolation, Giraffe, Code LLaMA, LLaMA2 Long usw. gehören alle zu dieser Art von Forschung.

△Bildquellenautor

△Bildquellenautor

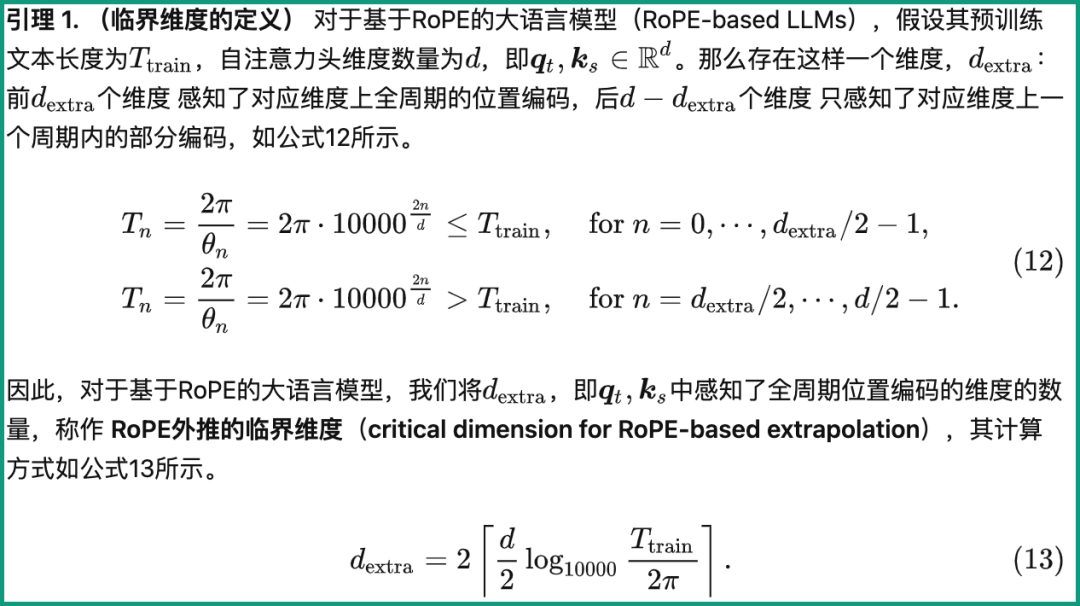

Am Beispiel von Metas kürzlich beliebter LLaMA2 Long-Forschung wurde eine Methode namens RoPE ABF vorgeschlagen, die die Kontextlänge großer Modelle durch Modifizieren eines Hyperparameters erfolgreich auf

32.000 Token verlängerte .Dieser Hyperparameter ist genau der „Schalter“

, der von Studien wie Code LLaMA und LLaMA2 Long entdeckt wurde –die Basis des Rotationswinkels

(Basis).Nehmen Sie einfach eine Feinabstimmung vor, um eine verbesserte Extrapolationsleistung großer Modelle sicherzustellen.

Aber egal, ob es sich um Code LLaMA oder LLaMA2 Long handelt, sie werden nur auf einer bestimmten Basis und fortlaufenden Trainingsdauer feinabgestimmt, um ihre Extrapolationsfähigkeiten zu verbessern. Können wir eine Regel finden, um sicherzustellen, dassalle

großen Modelle, die die RoPE-Positionscodierung verwenden, die Extrapolationsleistung stabil verbessern können?Beherrschen Sie diese Regel, der Kontext ist einfach 100w+

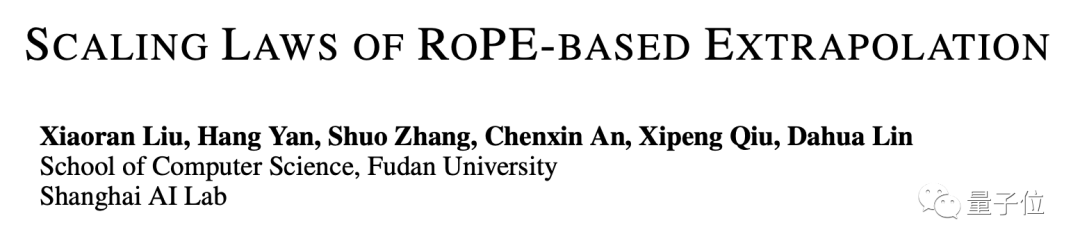

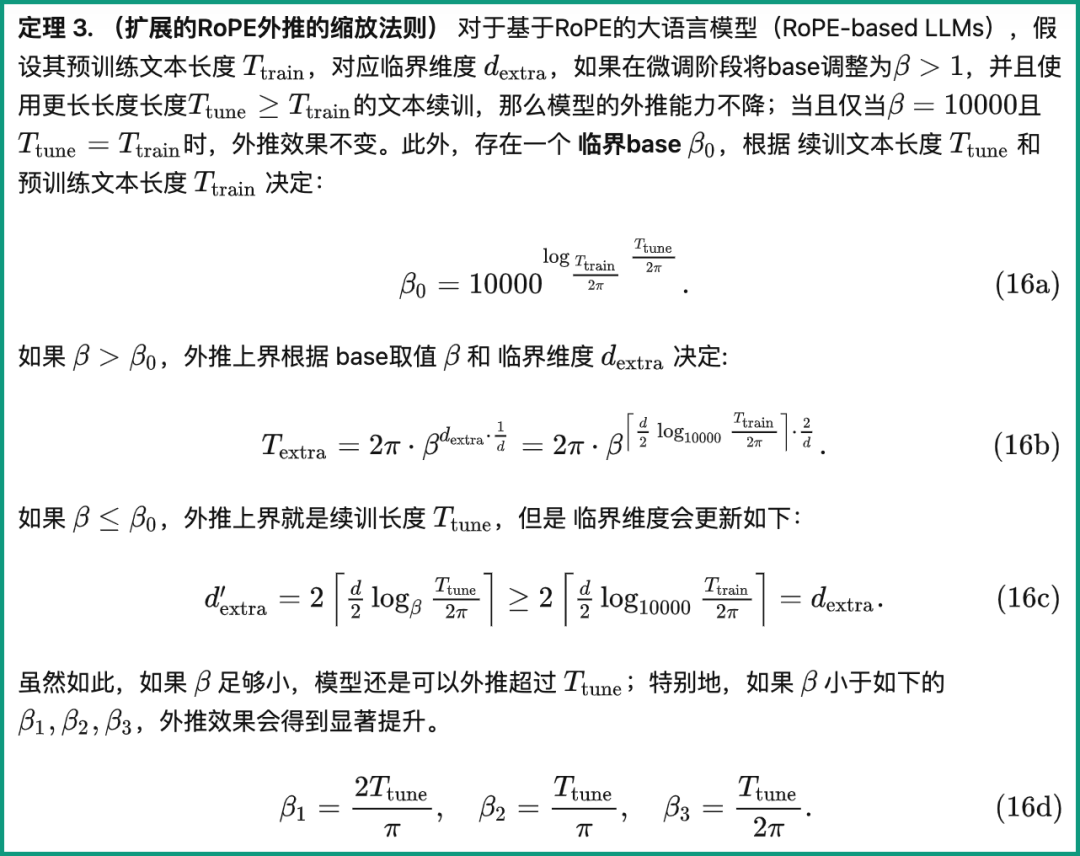

Forscher der Fudan-Universität und des Shanghai AI Research Institute führten Experimente zu diesem Problem durch. Sie analysierten zunächst mehrere Parameter, die sich auf die RoPE-Extrapolationsfähigkeiten auswirken, und schlugen ein Konzept namensCritical Dimension

(Kritische Dimension) vor. Anschließend fassten sie auf der Grundlage dieses Konzepts eine Reihe vonRoPE-Extrapolationsskalierungsgesetzen der RoPE-basierten Extrapolation zusammen. Wenden Sie einfach dieses Gesetz an, um sicherzustellen, dass jedes große Modell, das auf der RoPE-Positionskodierung basiert, die Extrapolationsfähigkeiten verbessern kann.

Schauen wir uns zunächst an, was die kritische Dimension ist.

Aus der Definition geht hervor, dass es mit der Textlänge Ttrain vor dem Training, der Anzahl der Selbstaufmerksamkeitskopfdimensionen d und anderen Parametern zusammenhängt. Die spezifische Berechnungsmethode ist wie folgt:

Unter diesen ist 10000 der „Anfangswert“ des Hyperparameters und der Rotationswinkelbasis.

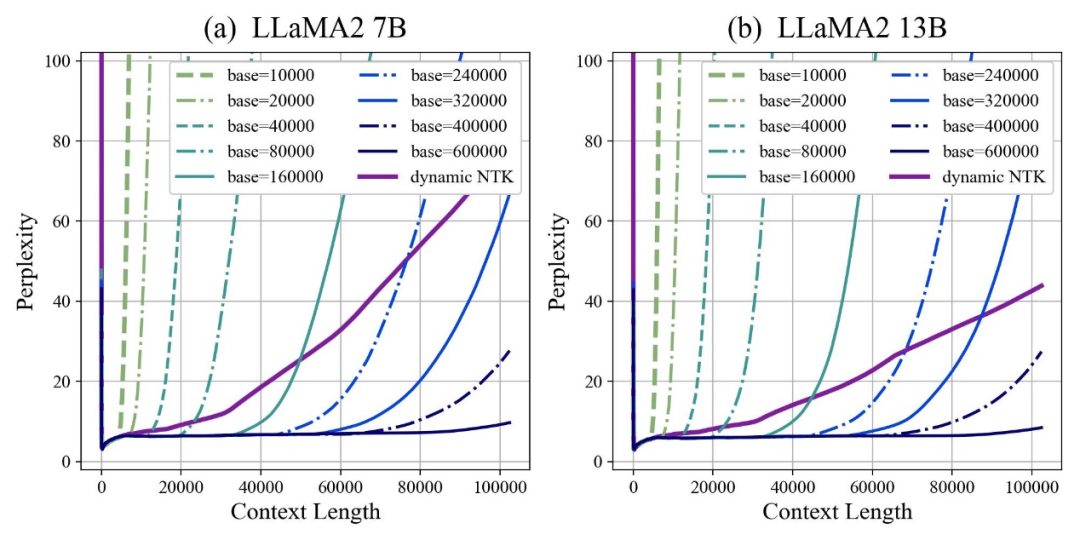

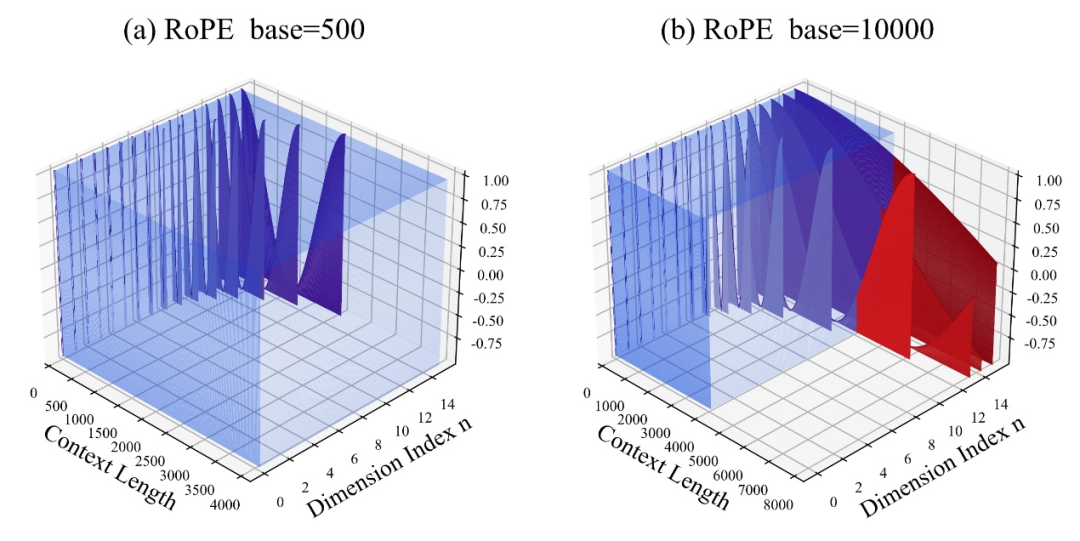

Der Autor stellte fest, dass unabhängig davon, ob die Basis vergrößert oder verkleinert wird, die Extrapolationsfähigkeit des großen Modells basierend auf RoPE letztendlich verbessert werden kann. Wenn die Rotationswinkelbasis dagegen 10000 beträgt, beträgt die Extrapolationsfähigkeit des großen Modells das Schlimmste.

In diesem Artikel wird davon ausgegangen, dass eine kleinere Basis des Rotationswinkels die Wahrnehmung von Positionsinformationen in mehr Dimensionen ermöglichen kann und eine größere Basis des Rotationswinkels längere Positionsinformationen ausdrücken kann.

In diesem Fall sollte bei kontinuierlichen Trainingskorpora unterschiedlicher Länge um wie viel Rotationswinkelbasis verkleinert und vergrößert werden, um sicherzustellen, dass die Extrapolationsfähigkeit großer Modelle maximiert wird?

Das Papier gibt eine Skalierungsregel für die erweiterte RoPE-Extrapolation an, die sich auf Parameter wie kritische Abmessungen, fortlaufende Trainingstextlänge und Vortrainingstextlänge großer Modelle bezieht:

Basierend auf dieser Regel werden verschiedene Vor- Durch Training und Fortsetzen des Trainings kann die Textlänge direkt berechnet werden, um die Extrapolationsleistung des großen Modells direkt zu berechnen, mit anderen Worten, um die vom großen Modell unterstützte Kontextlänge vorherzusagen.

Umgekehrt kann man anhand dieser Regel schnell ableiten, wie man die Drehwinkelbasis am besten anpasst und so die Extrapolationsleistung großer Modelle verbessert.

Der Autor hat diese Aufgabenreihe getestet und festgestellt, dass experimentell die Eingabe einer Länge von 100.000, 500.000 oder sogar 1 Million Token sicherstellen kann, dass die Extrapolation ohne zusätzliche Aufmerksamkeitseinschränkungen erreicht werden kann.

Gleichzeitig hat die Arbeit an der Verbesserung der Extrapolationsfähigkeiten großer Modelle, einschließlich Code LLaMA und LLaMA2 Long, bewiesen, dass diese Regel tatsächlich sinnvoll und effektiv ist.

Auf diese Weise müssen Sie nur „einen Parameter anpassen“ gemäß dieser Regel und können die Kontextfensterlänge des großen Modells basierend auf RoPE problemlos erweitern und die Extrapolationsfähigkeit verbessern.

Liu Xiaoran, der erste Autor des Papiers, sagte, dass diese Forschung derzeit die Auswirkungen auf nachgelagerte Aufgaben durch die Verbesserung des kontinuierlichen Trainingskorpus verbessert. Nach Abschluss werden der Code und das Modell als Open Source verfügbar sein

Papieradresse:

https://arxiv.org/abs/2310.05209

Github-Repository:

https://github.com/OpenLMLab/scaling-rope

Papieranalyse Blog:

https:// zhuanlan.zhihu.com/p/660073229

Das obige ist der detaillierte Inhalt vonDie LLaMA2-Kontextlänge steigt sprunghaft auf 1 Million Token, wobei nur ein Hyperparameter angepasst werden muss.. Für weitere Informationen folgen Sie bitte anderen verwandten Artikeln auf der PHP chinesischen Website!

Heiße KI -Werkzeuge

Undresser.AI Undress

KI-gestützte App zum Erstellen realistischer Aktfotos

AI Clothes Remover

Online-KI-Tool zum Entfernen von Kleidung aus Fotos.

Undress AI Tool

Ausziehbilder kostenlos

Clothoff.io

KI-Kleiderentferner

AI Hentai Generator

Erstellen Sie kostenlos Ai Hentai.

Heißer Artikel

Heiße Werkzeuge

Notepad++7.3.1

Einfach zu bedienender und kostenloser Code-Editor

SublimeText3 chinesische Version

Chinesische Version, sehr einfach zu bedienen

Senden Sie Studio 13.0.1

Leistungsstarke integrierte PHP-Entwicklungsumgebung

Dreamweaver CS6

Visuelle Webentwicklungstools

SublimeText3 Mac-Version

Codebearbeitungssoftware auf Gottesniveau (SublimeText3)

Heiße Themen

Verwenden Sie ddrescue, um Daten unter Linux wiederherzustellen

Mar 20, 2024 pm 01:37 PM

Verwenden Sie ddrescue, um Daten unter Linux wiederherzustellen

Mar 20, 2024 pm 01:37 PM

DDREASE ist ein Tool zum Wiederherstellen von Daten von Datei- oder Blockgeräten wie Festplatten, SSDs, RAM-Disks, CDs, DVDs und USB-Speichergeräten. Es kopiert Daten von einem Blockgerät auf ein anderes, wobei beschädigte Blöcke zurückbleiben und nur gute Blöcke verschoben werden. ddreasue ist ein leistungsstarkes Wiederherstellungstool, das vollständig automatisiert ist, da es während der Wiederherstellungsvorgänge keine Unterbrechungen erfordert. Darüber hinaus kann es dank der ddasue-Map-Datei jederzeit gestoppt und fortgesetzt werden. Weitere wichtige Funktionen von DDREASE sind: Es überschreibt die wiederhergestellten Daten nicht, füllt aber die Lücken im Falle einer iterativen Wiederherstellung. Es kann jedoch gekürzt werden, wenn das Tool explizit dazu aufgefordert wird. Stellen Sie Daten aus mehreren Dateien oder Blöcken in einer einzigen wieder her

Open Source! Jenseits von ZoeDepth! DepthFM: Schnelle und genaue monokulare Tiefenschätzung!

Apr 03, 2024 pm 12:04 PM

Open Source! Jenseits von ZoeDepth! DepthFM: Schnelle und genaue monokulare Tiefenschätzung!

Apr 03, 2024 pm 12:04 PM

0.Was bewirkt dieser Artikel? Wir schlagen DepthFM vor: ein vielseitiges und schnelles generatives monokulares Tiefenschätzungsmodell auf dem neuesten Stand der Technik. Zusätzlich zu herkömmlichen Tiefenschätzungsaufgaben demonstriert DepthFM auch hochmoderne Fähigkeiten bei nachgelagerten Aufgaben wie dem Tiefen-Inpainting. DepthFM ist effizient und kann Tiefenkarten innerhalb weniger Inferenzschritte synthetisieren. Lassen Sie uns diese Arbeit gemeinsam lesen ~ 1. Titel der Papierinformationen: DepthFM: FastMonocularDepthEstimationwithFlowMatching Autor: MingGui, JohannesS.Fischer, UlrichPrestel, PingchuanMa, Dmytr

So verwenden Sie die Excel-Filterfunktion mit mehreren Bedingungen

Feb 26, 2024 am 10:19 AM

So verwenden Sie die Excel-Filterfunktion mit mehreren Bedingungen

Feb 26, 2024 am 10:19 AM

Wenn Sie wissen müssen, wie Sie die Filterung mit mehreren Kriterien in Excel verwenden, führt Sie das folgende Tutorial durch die Schritte, um sicherzustellen, dass Sie Ihre Daten effektiv filtern und sortieren können. Die Filterfunktion von Excel ist sehr leistungsstark und kann Ihnen dabei helfen, aus großen Datenmengen die benötigten Informationen zu extrahieren. Diese Funktion kann Daten entsprechend den von Ihnen festgelegten Bedingungen filtern und nur die Teile anzeigen, die die Bedingungen erfüllen, wodurch die Datenverwaltung effizienter wird. Mithilfe der Filterfunktion können Sie Zieldaten schnell finden und so Zeit beim Suchen und Organisieren von Daten sparen. Diese Funktion kann nicht nur auf einfache Datenlisten angewendet werden, sondern auch nach mehreren Bedingungen gefiltert werden, um Ihnen dabei zu helfen, die benötigten Informationen genauer zu finden. Insgesamt ist die Filterfunktion von Excel sehr praktisch

Google ist begeistert: JAX-Leistung übertrifft Pytorch und TensorFlow! Es könnte die schnellste Wahl für das GPU-Inferenztraining werden

Apr 01, 2024 pm 07:46 PM

Google ist begeistert: JAX-Leistung übertrifft Pytorch und TensorFlow! Es könnte die schnellste Wahl für das GPU-Inferenztraining werden

Apr 01, 2024 pm 07:46 PM

Die von Google geförderte Leistung von JAX hat in jüngsten Benchmark-Tests die von Pytorch und TensorFlow übertroffen und belegt bei 7 Indikatoren den ersten Platz. Und der Test wurde nicht auf der TPU mit der besten JAX-Leistung durchgeführt. Obwohl unter Entwicklern Pytorch immer noch beliebter ist als Tensorflow. Aber in Zukunft werden möglicherweise mehr große Modelle auf Basis der JAX-Plattform trainiert und ausgeführt. Modelle Kürzlich hat das Keras-Team drei Backends (TensorFlow, JAX, PyTorch) mit der nativen PyTorch-Implementierung und Keras2 mit TensorFlow verglichen. Zunächst wählen sie eine Reihe von Mainstream-Inhalten aus

Die Vitalität der Superintelligenz erwacht! Aber mit der Einführung der sich selbst aktualisierenden KI müssen sich Mütter keine Sorgen mehr über Datenengpässe machen

Apr 29, 2024 pm 06:55 PM

Die Vitalität der Superintelligenz erwacht! Aber mit der Einführung der sich selbst aktualisierenden KI müssen sich Mütter keine Sorgen mehr über Datenengpässe machen

Apr 29, 2024 pm 06:55 PM

Ich weine zu Tode. Die Daten im Internet reichen überhaupt nicht aus. Das Trainingsmodell sieht aus wie „Die Tribute von Panem“, und KI-Forscher auf der ganzen Welt machen sich Gedanken darüber, wie sie diese datenhungrigen Esser ernähren sollen. Dieses Problem tritt insbesondere bei multimodalen Aufgaben auf. Zu einer Zeit, als sie ratlos waren, nutzte ein Start-up-Team der Abteilung der Renmin-Universität von China sein eigenes neues Modell, um als erstes in China einen „modellgenerierten Datenfeed selbst“ in die Realität umzusetzen. Darüber hinaus handelt es sich um einen zweigleisigen Ansatz auf der Verständnisseite und der Generierungsseite. Beide Seiten können hochwertige, multimodale neue Daten generieren und Datenrückmeldungen an das Modell selbst liefern. Was ist ein Modell? Awaker 1.0, ein großes multimodales Modell, das gerade im Zhongguancun-Forum erschienen ist. Wer ist das Team? Sophon-Motor. Gegründet von Gao Yizhao, einem Doktoranden an der Hillhouse School of Artificial Intelligence der Renmin University.

Langsame Internetgeschwindigkeiten für Mobilfunkdaten auf dem iPhone: Korrekturen

May 03, 2024 pm 09:01 PM

Langsame Internetgeschwindigkeiten für Mobilfunkdaten auf dem iPhone: Korrekturen

May 03, 2024 pm 09:01 PM

Stehen Sie vor einer Verzögerung oder einer langsamen mobilen Datenverbindung auf dem iPhone? Normalerweise hängt die Stärke des Mobilfunk-Internets auf Ihrem Telefon von mehreren Faktoren ab, wie z. B. der Region, dem Mobilfunknetztyp, dem Roaming-Typ usw. Es gibt einige Dinge, die Sie tun können, um eine schnellere und zuverlässigere Mobilfunk-Internetverbindung zu erhalten. Fix 1 – Neustart des iPhone erzwingen Manchmal werden durch einen erzwungenen Neustart Ihres Geräts viele Dinge zurückgesetzt, einschließlich der Mobilfunkverbindung. Schritt 1 – Drücken Sie einfach einmal die Lauter-Taste und lassen Sie sie los. Drücken Sie anschließend die Leiser-Taste und lassen Sie sie wieder los. Schritt 2 – Der nächste Teil des Prozesses besteht darin, die Taste auf der rechten Seite gedrückt zu halten. Lassen Sie das iPhone den Neustart abschließen. Aktivieren Sie Mobilfunkdaten und überprüfen Sie die Netzwerkgeschwindigkeit. Überprüfen Sie es erneut. Fix 2 – Datenmodus ändern 5G bietet zwar bessere Netzwerkgeschwindigkeiten, funktioniert jedoch besser, wenn das Signal schwächer ist

Die U.S. Air Force präsentiert ihren ersten KI-Kampfjet mit großem Aufsehen! Der Minister führte die Testfahrt persönlich durch, ohne in den gesamten Prozess einzugreifen, und 100.000 Codezeilen wurden 21 Mal getestet.

May 07, 2024 pm 05:00 PM

Die U.S. Air Force präsentiert ihren ersten KI-Kampfjet mit großem Aufsehen! Der Minister führte die Testfahrt persönlich durch, ohne in den gesamten Prozess einzugreifen, und 100.000 Codezeilen wurden 21 Mal getestet.

May 07, 2024 pm 05:00 PM

Kürzlich wurde die Militärwelt von der Nachricht überwältigt: US-Militärkampfflugzeuge können jetzt mithilfe von KI vollautomatische Luftkämpfe absolvieren. Ja, erst kürzlich wurde der KI-Kampfjet des US-Militärs zum ersten Mal der Öffentlichkeit zugänglich gemacht und sein Geheimnis gelüftet. Der vollständige Name dieses Jägers lautet „Variable Stability Simulator Test Aircraft“ (VISTA). Er wurde vom Minister der US-Luftwaffe persönlich geflogen, um einen Eins-gegen-eins-Luftkampf zu simulieren. Am 2. Mai startete US-Luftwaffenminister Frank Kendall mit einer X-62AVISTA auf der Edwards Air Force Base. Beachten Sie, dass während des einstündigen Fluges alle Flugaktionen autonom von der KI durchgeführt wurden! Kendall sagte: „In den letzten Jahrzehnten haben wir über das unbegrenzte Potenzial des autonomen Luft-Luft-Kampfes nachgedacht, aber es schien immer unerreichbar.“ Nun jedoch,

Der erste Roboter erscheint, der menschliche Aufgaben autonom erledigt, mit fünf flexiblen Fingern und übermenschlicher Geschwindigkeit, und große Modelle unterstützen das Training im virtuellen Raum

Mar 11, 2024 pm 12:10 PM

Der erste Roboter erscheint, der menschliche Aufgaben autonom erledigt, mit fünf flexiblen Fingern und übermenschlicher Geschwindigkeit, und große Modelle unterstützen das Training im virtuellen Raum

Mar 11, 2024 pm 12:10 PM

Diese Woche gab FigureAI, ein Robotikunternehmen, an dem OpenAI, Microsoft, Bezos und Nvidia beteiligt sind, bekannt, dass es fast 700 Millionen US-Dollar an Finanzmitteln erhalten hat und plant, im nächsten Jahr einen humanoiden Roboter zu entwickeln, der selbstständig gehen kann. Und Teslas Optimus Prime hat immer wieder gute Nachrichten erhalten. Niemand zweifelt daran, dass dieses Jahr das Jahr sein wird, in dem humanoide Roboter explodieren. SanctuaryAI, ein in Kanada ansässiges Robotikunternehmen, hat kürzlich einen neuen humanoiden Roboter auf den Markt gebracht: Phoenix. Beamte behaupten, dass es viele Aufgaben autonom und mit der gleichen Geschwindigkeit wie Menschen erledigen kann. Pheonix, der weltweit erste Roboter, der Aufgaben autonom in menschlicher Geschwindigkeit erledigen kann, kann jedes Objekt sanft greifen, bewegen und elegant auf der linken und rechten Seite platzieren. Es kann Objekte autonom identifizieren

△Der Autor der Bildquelle

△Der Autor der Bildquelle  △Bildquellenautor

△Bildquellenautor