Wie wird KI das Plattform-Engineering und DevEx verbessern?

Autorin |. Heather Joslyn

Bitte schreiben Sie den folgenden Inhalt ins Chinesische um: Star Swirl

Für viele Unternehmen, die DevOps einführen, ist die Skalierung und Wertschöpfung durch Steigerung der Entwicklerproduktivität eine große Herausforderung. In diesem Artikel diskutieren wir die neuesten KI-gesteuerten Ansätze im Plattform-Engineering.

1. KI-gesteuerte DevOps-Plattform

Digital.ai ist ein branchenführendes KI-gesteuertes Technologieunternehmen, das sich der Unterstützung globaler Unternehmen bei der digitalen Transformation verschrieben hat. Zu den Kunden zählen große Unternehmen: Finanzinstitute, Versicherungsorganisationen und Glücksspielunternehmen. Eines der größten Probleme, mit denen sie konfrontiert sind, ist die Größe.

Heute möchte ich Ihnen verraten, wie die DevOps-Plattform in einem KI-gesteuerten Unternehmen implementiert wird

Natürlich, so die Digital.ai Value Stream Delivery Platform und DevOps Engineering Vice President und DevOps General Manager Wing To, in a Ausländische Medien-Podcasts Der Aussage zufolge übernehmen sie alle moderne Entwicklungsmethoden wie agiles DevOps. In großen Organisationen (wie Tausenden von Entwicklern) besteht die eigentliche Herausforderung jedoch darin, wie sie skalieren können, um die Vorteile einer schnellen Bereitstellung zu nutzen und nahe an den Endbenutzern zu bleiben, während sie dies dennoch in großem Maßstab tun können

Dieser Artikel wird mit besprochen Sie informieren sich über die neuesten Fortschritte im Plattform-Engineering und darüber, wie künstliche Intelligenz zur Verbesserung der Automatisierung beitragen kann.

Wing To sagte: „Natürlich nutzen sie alle moderne Entwicklungsmethoden wie agile DevOps.“ VP of Value Stream Delivery Platform und DevOps Engineering bei Digital.ai fügte hinzu: „In großen Organisationen, insbesondere Tausenden, sind wir die eigentliche Herausforderung.“ Bei der Organisation von Entwicklern geht es darum, bei der Skalierung schnell zu liefern, nah am Endbenutzer zu bleiben und dies dann trotzdem in großem Maßstab tun zu können. In dieser Ausgabe von Makers diskutieren To und Heather Joslyn von TNS die neuesten Fortschritte in der Plattformtechnik und wie künstliche Intelligenz zur Verbesserung der Automatisierung beitragen kann

2. Produktivität verbessern, wo liegt der Wert?

Zusätzlich zu den Herausforderungen bei der Förderung von DevOps-Praktiken gibt es noch eine weitere Frage zu berücksichtigen: Wenn diese Praktiken Entwicklern helfen können, mehr Code zu schreiben und häufiger zu veröffentlichen, ist das eine gute Sache?

Es gibt auch eine neue Herausforderung, fügte er hinzu. „Ich glaube, alle reden über die Entwicklung von KI-gestützter oder KI-erweiterter Technologie, insbesondere in großen Unternehmen, wo sie das Potenzial sehen, die Produktivität zu verbessern. Aber wie setzt man dies im gesamten Unternehmen um?“ Das Unternehmen verfügt über hochproduktive Entwickler, kann aber nicht mit ihnen mithalten, wenn es darum geht, was passiert, nachdem die Software erstellt wurde? Zu sagen: „Wie wir alle wissen, geht es bei der Codebereitstellung nicht nur um das Schreiben von Code. Es gibt auch viele weitere Prozesse, die im gleichen Rhythmus bleiben müssen.“

3 Intelligenz

Plattform-Engineering ist eine Reihe von Praktiken und Tools, die entwickelt wurden, um Entwickler davon zu befreien, sich so viele Sorgen um Kubernetes und die Infrastruktur zu machen und Betriebsingenieure mit sich wiederholenden Aufgaben bei der Betreuung dieser Entwickler zu belasten. „Die Herausforderung, vor der wir stehen, wenn das Team wächst, besteht darin, dass die neuen Junior-Entwickler (und) Entwickler auf mittlerer Ebene nicht sehr kompetent sind und wir nicht möchten, dass unsere Senior-Entwickler ihre ganze Zeit mit der Infrastruktur verbringen“, sagte To. „

Digital.ai konzentriert sich auf die Integration künstlicher Intelligenz in die Automatisierung, um Entwicklern bei der Erstellung und Bereitstellung von Code zu helfen und Organisationen dabei zu helfen, mehr Geschäftswert aus der Softwareproduktion zu ziehen. Wie skalieren wir also? Wie ordnen wir die Dinge so an, dass wir eine wiederverwendbare, gemeinsame Orchestrierung erreichen können? Die aktuelle Arbeit von

Digital.ai umfasst Folgendes: Anwenden von Vorlagen zur Erfassung und Replikation schwer zu ändernder Teile des Softwarebereitstellungsprozesses einer Organisation. Darüber hinaus nutzen sie auch die Technologie der künstlichen Intelligenz, um dabei zu helfen, die Entwicklerumgebung schnell und automatisch einzurichten und Tools für Entwickler zu erstellen

Nach meinem Verständnis bedeutet dieser Satz, dass Digital.ai hart daran arbeitet, seine „interne Entwicklerplattform“ zu verbessern. Und sie nutzen dazu eine Vielzahl unterschiedlicher Tools, wie zum Beispiel das Erstellen von Pipelines, das Ausführen einzelner Aufgaben oder das Einrichten von

Das obige ist der detaillierte Inhalt vonWie wird KI das Plattform-Engineering und DevEx verbessern?. Für weitere Informationen folgen Sie bitte anderen verwandten Artikeln auf der PHP chinesischen Website!

Heiße KI -Werkzeuge

Undresser.AI Undress

KI-gestützte App zum Erstellen realistischer Aktfotos

AI Clothes Remover

Online-KI-Tool zum Entfernen von Kleidung aus Fotos.

Undress AI Tool

Ausziehbilder kostenlos

Clothoff.io

KI-Kleiderentferner

AI Hentai Generator

Erstellen Sie kostenlos Ai Hentai.

Heißer Artikel

Heiße Werkzeuge

Notepad++7.3.1

Einfach zu bedienender und kostenloser Code-Editor

SublimeText3 chinesische Version

Chinesische Version, sehr einfach zu bedienen

Senden Sie Studio 13.0.1

Leistungsstarke integrierte PHP-Entwicklungsumgebung

Dreamweaver CS6

Visuelle Webentwicklungstools

SublimeText3 Mac-Version

Codebearbeitungssoftware auf Gottesniveau (SublimeText3)

Heiße Themen

1377

1377

52

52

Die agentenlose Lösung von UIUC steht ganz oben auf der Liste der Open-Source-KI-Softwareentwickler und löst problemlos echte Programmierprobleme im SWE-Bench

Jul 17, 2024 pm 10:02 PM

Die agentenlose Lösung von UIUC steht ganz oben auf der Liste der Open-Source-KI-Softwareentwickler und löst problemlos echte Programmierprobleme im SWE-Bench

Jul 17, 2024 pm 10:02 PM

Die AIxiv-Kolumne ist eine Kolumne, in der diese Website akademische und technische Inhalte veröffentlicht. In den letzten Jahren sind in der AIxiv-Kolumne dieser Website mehr als 2.000 Berichte eingegangen, die Spitzenlabore großer Universitäten und Unternehmen auf der ganzen Welt abdecken und so den akademischen Austausch und die Verbreitung wirksam fördern. Wenn Sie hervorragende Arbeiten haben, die Sie teilen möchten, können Sie gerne einen Beitrag leisten oder uns für die Berichterstattung kontaktieren. Einreichungs-E-Mail: liyazhou@jiqizhixin.com; zhaoyunfeng@jiqizhixin.com Die Autoren dieses Artikels stammen alle aus dem Team von Lehrer Zhang Lingming an der University of Illinois in Urbana-Champaign, darunter: Steven Code Repair; Doktorand im vierten Jahr, Forscher

Posthume Arbeit des OpenAI Super Alignment Teams: Zwei große Modelle spielen ein Spiel und die Ausgabe wird verständlicher

Jul 19, 2024 am 01:29 AM

Posthume Arbeit des OpenAI Super Alignment Teams: Zwei große Modelle spielen ein Spiel und die Ausgabe wird verständlicher

Jul 19, 2024 am 01:29 AM

Wenn die Antwort des KI-Modells überhaupt unverständlich ist, würden Sie es wagen, sie zu verwenden? Da maschinelle Lernsysteme in immer wichtigeren Bereichen eingesetzt werden, wird es immer wichtiger zu zeigen, warum wir ihren Ergebnissen vertrauen können und wann wir ihnen nicht vertrauen sollten. Eine Möglichkeit, Vertrauen in die Ausgabe eines komplexen Systems zu gewinnen, besteht darin, vom System zu verlangen, dass es eine Interpretation seiner Ausgabe erstellt, die für einen Menschen oder ein anderes vertrauenswürdiges System lesbar ist, d. h. so vollständig verständlich, dass mögliche Fehler erkannt werden können gefunden. Um beispielsweise Vertrauen in das Justizsystem aufzubauen, verlangen wir von den Gerichten, dass sie klare und lesbare schriftliche Stellungnahmen abgeben, die ihre Entscheidungen erläutern und stützen. Für große Sprachmodelle können wir auch einen ähnlichen Ansatz verfolgen. Stellen Sie bei diesem Ansatz jedoch sicher, dass das Sprachmodell generiert wird

arXiv-Artikel können als „Barrage' gepostet werden, die Diskussionsplattform von Stanford alphaXiv ist online, LeCun gefällt es

Aug 01, 2024 pm 05:18 PM

arXiv-Artikel können als „Barrage' gepostet werden, die Diskussionsplattform von Stanford alphaXiv ist online, LeCun gefällt es

Aug 01, 2024 pm 05:18 PM

Prost! Wie ist es, wenn es bei einer Papierdiskussion auf Worte ankommt? Kürzlich haben Studenten der Stanford University alphaXiv erstellt, ein offenes Diskussionsforum für arXiv-Artikel, das es ermöglicht, Fragen und Kommentare direkt zu jedem arXiv-Artikel zu posten. Website-Link: https://alphaxiv.org/ Tatsächlich ist es nicht erforderlich, diese Website speziell zu besuchen. Ändern Sie einfach arXiv in einer beliebigen URL in alphaXiv, um den entsprechenden Artikel direkt im alphaXiv-Forum zu öffnen: Sie können die Absätze darin genau lokalisieren das Papier, Satz: Im Diskussionsbereich auf der rechten Seite können Benutzer Fragen stellen, um dem Autor Fragen zu den Ideen und Details des Papiers zu stellen. Sie können beispielsweise auch den Inhalt des Papiers kommentieren, wie zum Beispiel: „Gegeben an.“

Axiomatisches Training ermöglicht es LLM, kausales Denken zu erlernen: Das 67-Millionen-Parameter-Modell ist vergleichbar mit der Billionen-Parameter-Ebene GPT-4

Jul 17, 2024 am 10:14 AM

Axiomatisches Training ermöglicht es LLM, kausales Denken zu erlernen: Das 67-Millionen-Parameter-Modell ist vergleichbar mit der Billionen-Parameter-Ebene GPT-4

Jul 17, 2024 am 10:14 AM

Zeigen Sie LLM die Kausalkette und es lernt die Axiome. KI hilft Mathematikern und Wissenschaftlern bereits bei der Forschung. Beispielsweise hat der berühmte Mathematiker Terence Tao wiederholt seine Forschungs- und Forschungserfahrungen mit Hilfe von KI-Tools wie GPT geteilt. Damit KI in diesen Bereichen konkurrenzfähig sein kann, sind starke und zuverlässige Fähigkeiten zum kausalen Denken unerlässlich. Die in diesem Artikel vorgestellte Forschung ergab, dass ein Transformer-Modell, das auf die Demonstration des kausalen Transitivitätsaxioms für kleine Graphen trainiert wurde, auf das Transitivitätsaxiom für große Graphen verallgemeinern kann. Mit anderen Worten: Wenn der Transformer lernt, einfache kausale Überlegungen anzustellen, kann er für komplexere kausale Überlegungen verwendet werden. Der vom Team vorgeschlagene axiomatische Trainingsrahmen ist ein neues Paradigma zum Erlernen des kausalen Denkens auf der Grundlage passiver Daten, nur mit Demonstrationen

Ein bedeutender Durchbruch in der Riemann-Hypothese! Tao Zhexuan empfiehlt dringend neue Arbeiten vom MIT und Oxford, und der 37-jährige Fields-Medaillengewinner nahm daran teil

Aug 05, 2024 pm 03:32 PM

Ein bedeutender Durchbruch in der Riemann-Hypothese! Tao Zhexuan empfiehlt dringend neue Arbeiten vom MIT und Oxford, und der 37-jährige Fields-Medaillengewinner nahm daran teil

Aug 05, 2024 pm 03:32 PM

Kürzlich gelang der Riemann-Hypothese, die als eines der sieben großen Probleme des Jahrtausends bekannt ist, ein neuer Durchbruch. Die Riemann-Hypothese ist ein sehr wichtiges ungelöstes Problem in der Mathematik, das sich auf die genauen Eigenschaften der Verteilung von Primzahlen bezieht (Primzahlen sind Zahlen, die nur durch 1 und sich selbst teilbar sind, und sie spielen eine grundlegende Rolle in der Zahlentheorie). In der heutigen mathematischen Literatur gibt es mehr als tausend mathematische Thesen, die auf der Aufstellung der Riemann-Hypothese (oder ihrer verallgemeinerten Form) basieren. Mit anderen Worten: Sobald die Riemann-Hypothese und ihre verallgemeinerte Form bewiesen sind, werden diese mehr als tausend Sätze als Theoreme etabliert, die einen tiefgreifenden Einfluss auf das Gebiet der Mathematik haben werden, und wenn sich die Riemann-Hypothese als falsch erweist, dann unter anderem Auch diese Sätze werden teilweise ihre Gültigkeit verlieren. Neuer Durchbruch kommt von MIT-Mathematikprofessor Larry Guth und der Universität Oxford

Um ein neues wissenschaftliches und komplexes Frage-Antwort-Benchmark- und Bewertungssystem für große Modelle bereitzustellen, haben UNSW, Argonne, die University of Chicago und andere Institutionen gemeinsam das SciQAG-Framework eingeführt

Jul 25, 2024 am 06:42 AM

Um ein neues wissenschaftliches und komplexes Frage-Antwort-Benchmark- und Bewertungssystem für große Modelle bereitzustellen, haben UNSW, Argonne, die University of Chicago und andere Institutionen gemeinsam das SciQAG-Framework eingeführt

Jul 25, 2024 am 06:42 AM

Herausgeber | Der Frage-Antwort-Datensatz (QA) von ScienceAI spielt eine entscheidende Rolle bei der Förderung der Forschung zur Verarbeitung natürlicher Sprache (NLP). Hochwertige QS-Datensätze können nicht nur zur Feinabstimmung von Modellen verwendet werden, sondern auch effektiv die Fähigkeiten großer Sprachmodelle (LLMs) bewerten, insbesondere die Fähigkeit, wissenschaftliche Erkenntnisse zu verstehen und zu begründen. Obwohl es derzeit viele wissenschaftliche QS-Datensätze aus den Bereichen Medizin, Chemie, Biologie und anderen Bereichen gibt, weisen diese Datensätze immer noch einige Mängel auf. Erstens ist das Datenformular relativ einfach, die meisten davon sind Multiple-Choice-Fragen. Sie sind leicht auszuwerten, schränken jedoch den Antwortauswahlbereich des Modells ein und können die Fähigkeit des Modells zur Beantwortung wissenschaftlicher Fragen nicht vollständig testen. Im Gegensatz dazu offene Fragen und Antworten

Das erste Mamba-basierte MLLM ist da! Modellgewichte, Trainingscode usw. waren alle Open Source

Jul 17, 2024 am 02:46 AM

Das erste Mamba-basierte MLLM ist da! Modellgewichte, Trainingscode usw. waren alle Open Source

Jul 17, 2024 am 02:46 AM

Die AIxiv-Kolumne ist eine Kolumne, in der diese Website akademische und technische Inhalte veröffentlicht. In den letzten Jahren sind in der AIxiv-Kolumne dieser Website mehr als 2.000 Berichte eingegangen, die Spitzenlabore großer Universitäten und Unternehmen auf der ganzen Welt abdecken und so den akademischen Austausch und die Verbreitung wirksam fördern. Wenn Sie hervorragende Arbeiten haben, die Sie teilen möchten, können Sie gerne einen Beitrag leisten oder uns für die Berichterstattung kontaktieren. E-Mail-Adresse: liyazhou@jiqizhixin.com; zhaoyunfeng@jiqizhixin.com. Einleitung In den letzten Jahren hat die Anwendung multimodaler großer Sprachmodelle (MLLM) in verschiedenen Bereichen bemerkenswerte Erfolge erzielt. Als Grundmodell für viele nachgelagerte Aufgaben besteht aktuelles MLLM jedoch aus dem bekannten Transformer-Netzwerk, das

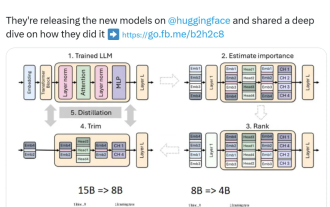

Nvidia spielt mit Beschneidung und Destillation: Halbierung der Llama 3.1 8B-Parameter, um bei gleicher Größe eine bessere Leistung zu erzielen

Aug 16, 2024 pm 04:42 PM

Nvidia spielt mit Beschneidung und Destillation: Halbierung der Llama 3.1 8B-Parameter, um bei gleicher Größe eine bessere Leistung zu erzielen

Aug 16, 2024 pm 04:42 PM

Der Aufstieg kleiner Modelle. Letzten Monat veröffentlichte Meta die Modellreihe Llama3.1, zu der das bisher größte Modell von Meta, das 405B-Modell, und zwei kleinere Modelle mit Parameterbeträgen von 70 Milliarden bzw. 8 Milliarden gehören. Llama3.1 gilt als der Beginn einer neuen Ära von Open Source. Obwohl die Modelle der neuen Generation leistungsstark sind, erfordern sie bei der Bereitstellung immer noch große Mengen an Rechenressourcen. Daher hat sich in der Branche ein weiterer Trend herausgebildet, der darin besteht, kleine Sprachmodelle (SLM) zu entwickeln, die bei vielen Sprachaufgaben eine ausreichende Leistung erbringen und zudem sehr kostengünstig in der Bereitstellung sind. Kürzlich haben Untersuchungen von NVIDIA gezeigt, dass durch strukturierte Gewichtsbereinigung in Kombination mit Wissensdestillation nach und nach kleinere Sprachmodelle aus einem zunächst größeren Modell gewonnen werden können. Turing-Preisträger, Meta Chief A