Technologie-Peripheriegeräte

Technologie-Peripheriegeräte

KI

KI

Nimmt das große Model Abkürzungen, um „die Rangliste zu übertreffen'? Das Problem der Datenverschmutzung verdient Aufmerksamkeit

Nimmt das große Model Abkürzungen, um „die Rangliste zu übertreffen'? Das Problem der Datenverschmutzung verdient Aufmerksamkeit

Nimmt das große Model Abkürzungen, um „die Rangliste zu übertreffen'? Das Problem der Datenverschmutzung verdient Aufmerksamkeit

Im ersten Jahr der generativen KI ist das Arbeitstempo aller viel schneller geworden.

Besonders in diesem Jahr arbeiten alle hart daran, große Modelle auf den Markt zu bringen: In letzter Zeit haben in- und ausländische Technologieriesen und Start-up-Unternehmen abwechselnd große Modelle auf den Markt gebracht. Sobald die Pressekonferenz begann, waren sie alle dabei große Durchbrüche und jede aktualisierte wichtige Benchmark-Liste, entweder auf dem ersten Platz oder in der ersten Stufe.

Nachdem sie sich über den rasanten Fortschritt der Technologie aufgeregt haben, stellen viele Menschen fest, dass etwas nicht stimmt: Warum haben alle einen Anteil an der Nummer eins im Ranking? Was ist dieser Mechanismus?

Seitdem erregt auch das Thema „List-Swiping“ zunehmend Aufmerksamkeit.

In letzter Zeit stellen wir fest, dass es in WeChat Moments- und Zhihu-Communitys immer mehr Diskussionen zum Thema „Swiping in den Rankings“ großer Models gibt. Insbesondere ein Beitrag auf Zhihu: Wie bewerten Sie das Phänomen, dass im Tiangong Large Model Technical Report darauf hingewiesen wurde, dass viele große Modelle Daten vor Ort nutzen, um das Ranking zu verbessern? Es löste bei allen eine Diskussion aus.

Link: https://www.zhihu.com/question/628957425

Viele große Modell-Ranking-Mechanismen wurden aufgedeckt

Diese Forschung stammt von der „Tiangong“-Universität von Kunlun Wanwei. Das Modell Das Forschungsteam veröffentlichte Ende letzten Monats einen technischen Bericht über die Preprint-Papierplattform arXiv.

Link zum Papier: https://arxiv.org/abs/2310.19341

Das Papier selbst ist eine Einführung in Skywork-13B, eine große Sprachmodellreihe (LLM) von Tiangong. Die Autoren stellen eine zweistufige Trainingsmethode vor, die segmentierte Korpora verwendet und auf allgemeines Training bzw. domänenspezifisches erweitertes Training abzielt.

Wie bei neuen Untersuchungen zu großen Modellen üblich, gaben die Autoren an, dass ihr Modell bei beliebten Testbenchmarks nicht nur eine gute Leistung erbrachte, sondern auch bei vielen Aufgaben der chinesischen Branche das State-of-Art-Niveau (das beste in der Branche) erreichte . Gut).

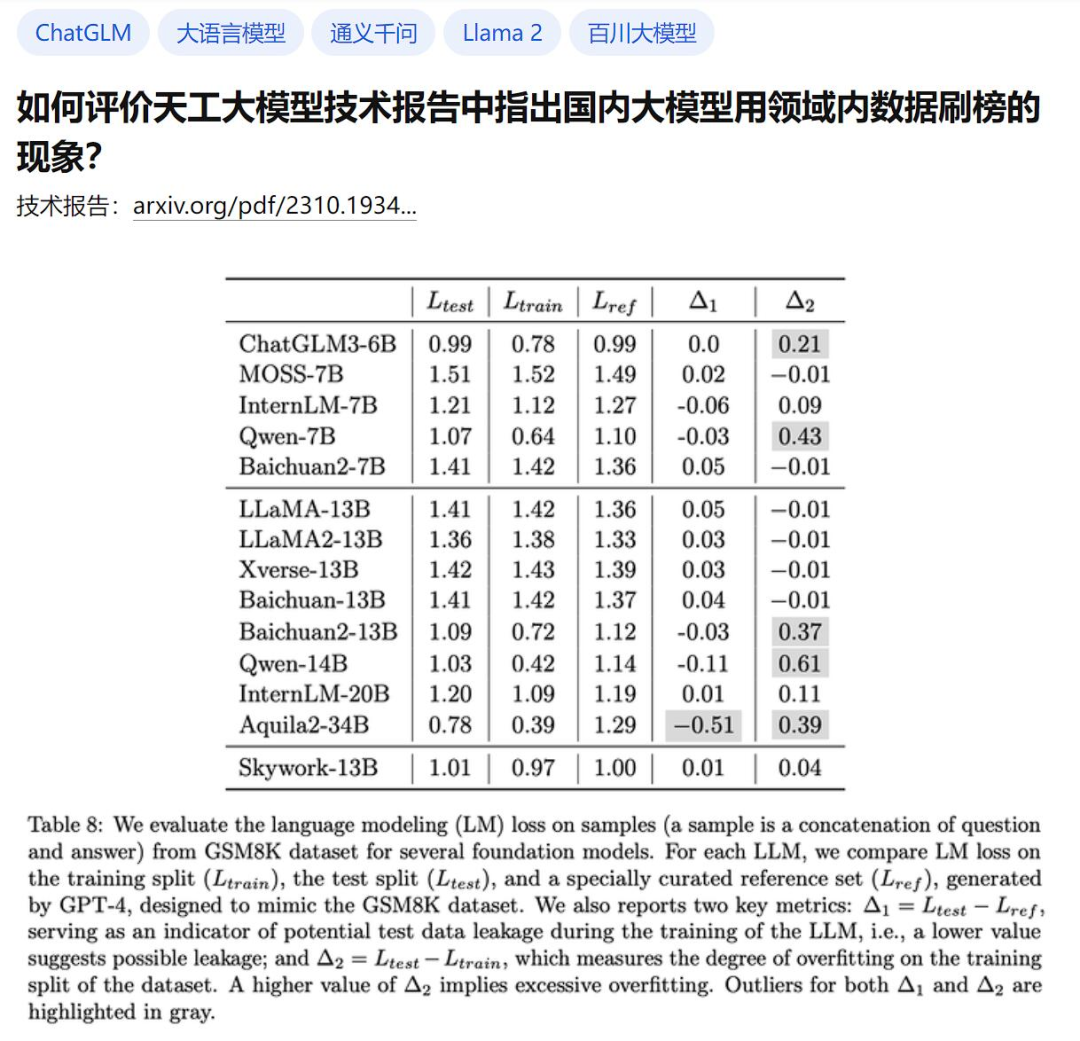

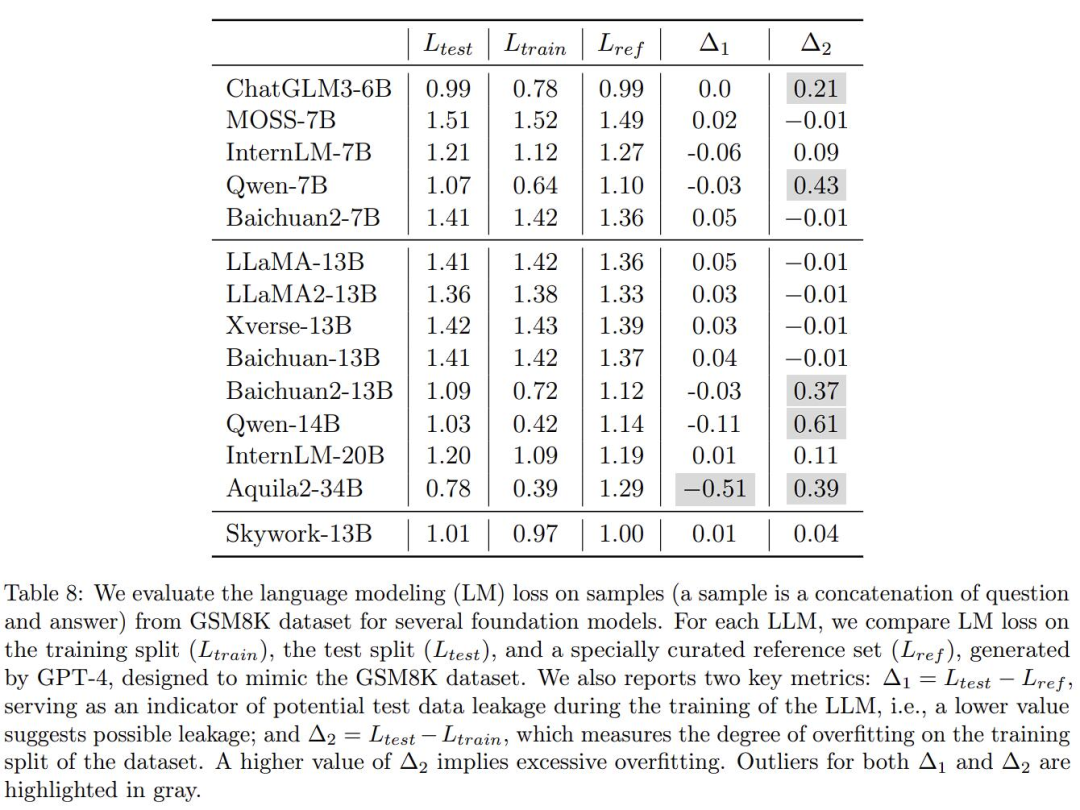

Der entscheidende Punkt ist, dass der Bericht auch die tatsächlichen Auswirkungen vieler großer Modelle überprüft und darauf hinweist, dass einige andere große inländische Modelle im Verdacht stehen, opportunistisch zu sein. Dies ist Tabelle 8:

Hier verwendete der Autor GPT-4, um einige GSM8K-Beispiele zu generieren, um den Überanpassungsgrad mehrerer gängiger großer Modelle in der Branche anhand des mathematischen Anwendungsproblem-Benchmarks GSM8K zu überprüfen mit derselben Form wurden manuell auf Richtigkeit überprüft und diese Modelle anhand des generierten Datensatzes mit dem ursprünglichen Trainingssatz und Testsatz von GSM8K verglichen und der Verlust berechnet. Dann gibt es zwei Metriken:

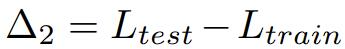

Δ1 dient als Indikator für potenzielle Testdatenlecks während des Modelltrainings, wobei niedrigere Werte auf mögliche Lecks hinweisen. Ohne Training am Testsatz sollte der Wert Null sein.

Δ2 misst den Grad der Überanpassung der Trainingsaufteilung des Datensatzes. Ein höherer Δ2-Wert bedeutet Überanpassung. Wenn es nicht auf dem Trainingssatz trainiert wurde, sollte der Wert Null sein.

Um es mit einfachen Worten zu erklären: Wenn ein Modell während des Trainings direkt die „echten Fragen“ und „Antworten“ im Benchmark-Test als Lernmaterialien verwendet und diese nutzen möchte, um Punkte zu erzielen, dann wird es hier abnormal sein.

Okay, die problematischen Bereiche von Δ1 und Δ2 sind oben sorgfältig grau hervorgehoben.

Netizens kommentierten, dass endlich jemand das offene Geheimnis der „Datensatzverschmutzung“ gelüftet habe.

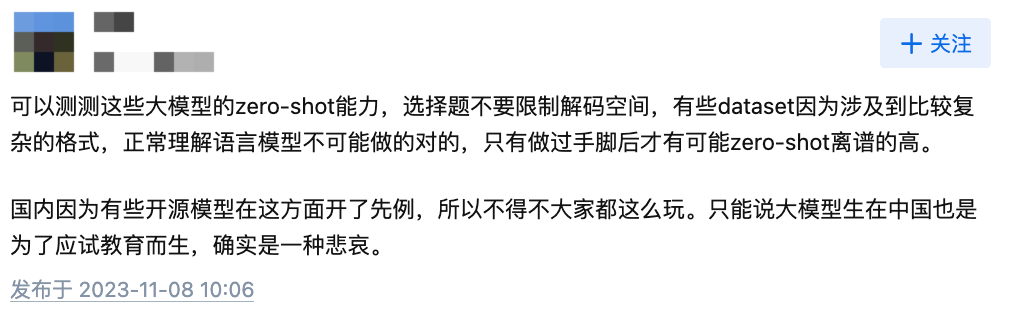

Einige Internetnutzer sagten auch, dass der Intelligenzgrad großer Modelle immer noch von der Zero-Shot-Fähigkeit abhängt, die mit bestehenden Testbenchmarks nicht erreicht werden kann.

Bild: Screenshot aus Zhihu-Netizen-Kommentaren

In der Interaktion zwischen dem Autor und den Lesern sagte der Autor auch, dass er hofft, „jeder das Thema Betrug rationaler betrachten zu lassen. Es gibt immer noch eine große Lücke zwischen vielen Modellen und GPT4.“

Bild: Screenshot des Zhizhihu-Artikels https://zhuanlan.zhihu.com/p/664985891

Das Problem der Datenverschmutzung verdient Aufmerksamkeit

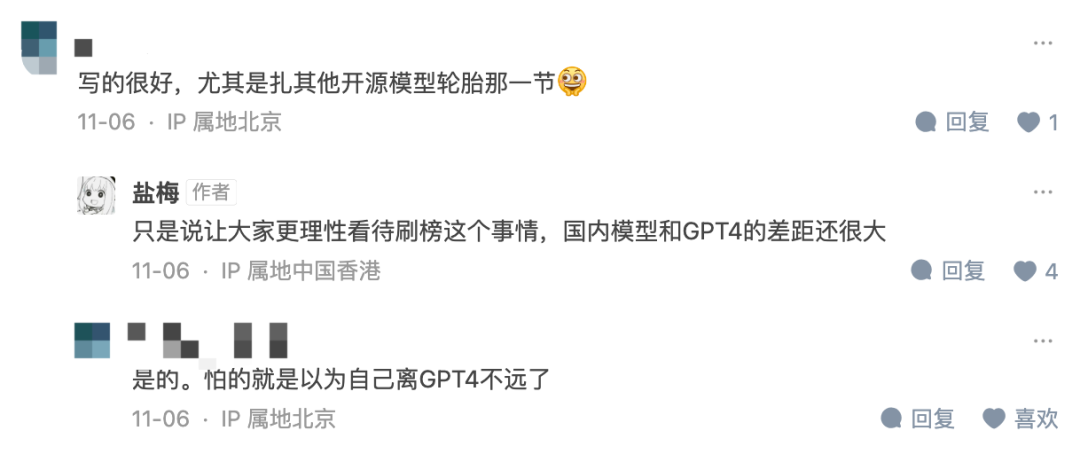

Tatsächlich ist dies kein vorübergehendes Phänomen . Seit der Einführung von Benchmark sind solche Probleme von Zeit zu Zeit aufgetreten, wie der Titel eines sehr ironischen Artikels auf arXiv im September dieses Jahres verdeutlichte: „Pretraining on the Test Set Is All You Need“.

Darüber hinaus wies eine aktuelle formelle Studie der Renmin University und der University of Illinois at Urbana-Champaign auch auf Probleme bei der Bewertung großer Modelle hin. Der Titel ist sehr auffällig: „Machen Sie Ihr LLM nicht zu einem Evaluations-Benchmark-Betrüger“:

Link zum Papier: https://arxiv.org/abs/2311.01964

Das Papier weist darauf hin Das aktuelle heiße Feld großer Modelle ist den Menschen wichtig für Benchmark-Rankings, aber ihre Fairness und Zuverlässigkeit werden in Frage gestellt. Das Hauptproblem ist die Kontamination und Leckage von Daten, die unbeabsichtigt ausgelöst werden können, da wir bei der Vorbereitung des Korpus vor dem Training möglicherweise nicht den zukünftigen Bewertungsdatensatz kennen. GPT-3 stellte beispielsweise fest, dass der Datensatz „Children's Book Test“ im Pre-Training-Korpus enthalten war, und im LLaMA-2-Papier wurde erwähnt, dass kontextbezogene Webseiteninhalte aus dem BoolQ-Datensatz extrahiert werden.

Das Sammeln, Organisieren und Kennzeichnen von Datensätzen erfordert für viele Menschen einen hohen Aufwand. Wenn ein qualitativ hochwertiger Datensatz gut genug ist, um für die Auswertung verwendet zu werden, kann er natürlich auch von anderen zum Trainieren großer Modelle verwendet werden.

Andererseits wurden bei der Bewertung anhand vorhandener Benchmarks die Ergebnisse für die von uns bewerteten großen Modelle größtenteils durch die Ausführung auf einem lokalen Server oder durch API-Aufrufe erzielt. Während dieses Prozesses wurden alle unzulässigen Mittel (z. B. Datenkontamination), die zu abnormalen Verbesserungen der Bewertungsleistung führen könnten, nicht eingehend untersucht.

Was noch schlimmer ist, ist, dass die detaillierte Zusammensetzung des Trainingskorpus (z. B. Datenquellen) oft als das zentrale „Geheimnis“ bestehender großer Modelle angesehen wird. Dies erschwert die Untersuchung des Problems der Datenverschmutzung.

Mit anderen Worten, die Menge an hervorragenden Daten ist begrenzt und bei vielen Testsätzen sind GPT-4 und Llama-2 nicht unbedingt kein Problem. Beispielsweise wurde GSM8K im ersten Artikel erwähnt und GPT-4 erwähnte die Verwendung seines Trainingssatzes im offiziellen technischen Bericht.

Meinen Sie nicht, dass Daten sehr wichtig sind? Wird die Leistung eines großen Modells, das „echte Fragen“ verwendet, besser, weil die Trainingsdaten besser sind? Die Antwort ist nein.

Forscher haben experimentell herausgefunden, dass Benchmark-Lecks dazu führen können, dass große Modelle übertriebene Ergebnisse liefern: Beispielsweise kann ein 1,3-B-Modell bei einigen Aufgaben ein zehnmal so großes Modell übertreffen. Der Nebeneffekt besteht jedoch darin, dass die Leistung dieser großen testspezifischen Modelle bei anderen normalen Testaufgaben möglicherweise beeinträchtigt wird, wenn wir diese durchgesickerten Daten nur zur Feinabstimmung oder zum Training des Modells verwenden.

Daher schlägt der Autor vor, dass Forscher in Zukunft, wenn sie große Modelle bewerten oder neue Technologien untersuchen, Folgendes tun sollten:

- Verwenden Sie weitere Benchmarks aus verschiedenen Quellen, die grundlegende Fähigkeiten (z. B. Textgenerierung) und erweiterte Fähigkeiten (z. B. komplexes Denken) abdecken, um die Fähigkeiten von LLM vollständig zu bewerten.

- Bei der Verwendung eines Bewertungsbenchmarks ist es wichtig, Datenbereinigungsprüfungen zwischen den Daten vor dem Training und allen zugehörigen Daten (z. B. Trainings- und Testsätzen) durchzuführen. Darüber hinaus müssen die Ergebnisse der Schadstoffanalyse für die Bewertungsgrundlage als Referenz angegeben werden. Wenn möglich, wird empfohlen, die detaillierte Zusammensetzung der Pre-Training-Daten zu veröffentlichen.

- Es wird empfohlen, unterschiedliche Testaufforderungen zu verwenden, um die Auswirkungen der Aufforderungsempfindlichkeit zu verringern. Es wäre auch sinnvoll, eine Kontaminationsanalyse zwischen den Basisdaten und vorhandenen Korpora vor dem Training durchzuführen, um auf mögliche Kontaminationsrisiken aufmerksam zu machen. Für die Bewertung wird empfohlen, jeder Einreichung einen speziellen Kontaminationsanalysebericht beizufügen.

Glücklicherweise hat dieses Thema begonnen, die Aufmerksamkeit aller auf sich zu ziehen, egal ob es sich um technische Berichte, Papierrecherchen oder Community-Diskussionen handelt, jeder hat begonnen, dem Thema „Swiping in der Rangliste“ großer Modelle Aufmerksamkeit zu schenken.

Was sind eure Meinungen und wirksamen Vorschläge dazu?

Das obige ist der detaillierte Inhalt vonNimmt das große Model Abkürzungen, um „die Rangliste zu übertreffen'? Das Problem der Datenverschmutzung verdient Aufmerksamkeit. Für weitere Informationen folgen Sie bitte anderen verwandten Artikeln auf der PHP chinesischen Website!

Heiße KI -Werkzeuge

Undresser.AI Undress

KI-gestützte App zum Erstellen realistischer Aktfotos

AI Clothes Remover

Online-KI-Tool zum Entfernen von Kleidung aus Fotos.

Undress AI Tool

Ausziehbilder kostenlos

Clothoff.io

KI-Kleiderentferner

AI Hentai Generator

Erstellen Sie kostenlos Ai Hentai.

Heißer Artikel

Heiße Werkzeuge

Notepad++7.3.1

Einfach zu bedienender und kostenloser Code-Editor

SublimeText3 chinesische Version

Chinesische Version, sehr einfach zu bedienen

Senden Sie Studio 13.0.1

Leistungsstarke integrierte PHP-Entwicklungsumgebung

Dreamweaver CS6

Visuelle Webentwicklungstools

SublimeText3 Mac-Version

Codebearbeitungssoftware auf Gottesniveau (SublimeText3)

Heiße Themen

1359

1359

52

52

Open Source! Jenseits von ZoeDepth! DepthFM: Schnelle und genaue monokulare Tiefenschätzung!

Apr 03, 2024 pm 12:04 PM

Open Source! Jenseits von ZoeDepth! DepthFM: Schnelle und genaue monokulare Tiefenschätzung!

Apr 03, 2024 pm 12:04 PM

0.Was bewirkt dieser Artikel? Wir schlagen DepthFM vor: ein vielseitiges und schnelles generatives monokulares Tiefenschätzungsmodell auf dem neuesten Stand der Technik. Zusätzlich zu herkömmlichen Tiefenschätzungsaufgaben demonstriert DepthFM auch hochmoderne Fähigkeiten bei nachgelagerten Aufgaben wie dem Tiefen-Inpainting. DepthFM ist effizient und kann Tiefenkarten innerhalb weniger Inferenzschritte synthetisieren. Lassen Sie uns diese Arbeit gemeinsam lesen ~ 1. Titel der Papierinformationen: DepthFM: FastMonocularDepthEstimationwithFlowMatching Autor: MingGui, JohannesS.Fischer, UlrichPrestel, PingchuanMa, Dmytr

Das weltweit leistungsstärkste Open-Source-MoE-Modell ist da, mit chinesischen Fähigkeiten, die mit GPT-4 vergleichbar sind, und der Preis beträgt nur fast ein Prozent von GPT-4-Turbo

May 07, 2024 pm 04:13 PM

Das weltweit leistungsstärkste Open-Source-MoE-Modell ist da, mit chinesischen Fähigkeiten, die mit GPT-4 vergleichbar sind, und der Preis beträgt nur fast ein Prozent von GPT-4-Turbo

May 07, 2024 pm 04:13 PM

Stellen Sie sich ein Modell der künstlichen Intelligenz vor, das nicht nur die Fähigkeit besitzt, die traditionelle Datenverarbeitung zu übertreffen, sondern auch eine effizientere Leistung zu geringeren Kosten erzielt. Dies ist keine Science-Fiction, DeepSeek-V2[1], das weltweit leistungsstärkste Open-Source-MoE-Modell, ist da. DeepSeek-V2 ist ein leistungsstarkes MoE-Sprachmodell (Mix of Experts) mit den Merkmalen eines wirtschaftlichen Trainings und einer effizienten Inferenz. Es besteht aus 236B Parametern, von denen 21B zur Aktivierung jedes Markers verwendet werden. Im Vergleich zu DeepSeek67B bietet DeepSeek-V2 eine stärkere Leistung, spart gleichzeitig 42,5 % der Trainingskosten, reduziert den KV-Cache um 93,3 % und erhöht den maximalen Generierungsdurchsatz auf das 5,76-fache. DeepSeek ist ein Unternehmen, das sich mit allgemeiner künstlicher Intelligenz beschäftigt

KAN, das MLP ersetzt, wurde durch Open-Source-Projekte auf Faltung erweitert

Jun 01, 2024 pm 10:03 PM

KAN, das MLP ersetzt, wurde durch Open-Source-Projekte auf Faltung erweitert

Jun 01, 2024 pm 10:03 PM

Anfang dieses Monats schlugen Forscher des MIT und anderer Institutionen eine vielversprechende Alternative zu MLP vor – KAN. KAN übertrifft MLP in Bezug auf Genauigkeit und Interpretierbarkeit. Und es kann MLP, das mit einer größeren Anzahl von Parametern ausgeführt wird, mit einer sehr kleinen Anzahl von Parametern übertreffen. Beispielsweise gaben die Autoren an, dass sie KAN nutzten, um die Ergebnisse von DeepMind mit einem kleineren Netzwerk und einem höheren Automatisierungsgrad zu reproduzieren. Konkret verfügt DeepMinds MLP über etwa 300.000 Parameter, während KAN nur etwa 200 Parameter hat. KAN hat eine starke mathematische Grundlage wie MLP und basiert auf dem universellen Approximationssatz, während KAN auf dem Kolmogorov-Arnold-Darstellungssatz basiert. Wie in der folgenden Abbildung gezeigt, hat KAN

Hallo, elektrischer Atlas! Der Boston Dynamics-Roboter erwacht wieder zum Leben, seltsame 180-Grad-Bewegungen machen Musk Angst

Apr 18, 2024 pm 07:58 PM

Hallo, elektrischer Atlas! Der Boston Dynamics-Roboter erwacht wieder zum Leben, seltsame 180-Grad-Bewegungen machen Musk Angst

Apr 18, 2024 pm 07:58 PM

Boston Dynamics Atlas tritt offiziell in die Ära der Elektroroboter ein! Gestern hat sich der hydraulische Atlas einfach „unter Tränen“ von der Bühne der Geschichte zurückgezogen. Heute gab Boston Dynamics bekannt, dass der elektrische Atlas im Einsatz ist. Es scheint, dass Boston Dynamics im Bereich kommerzieller humanoider Roboter entschlossen ist, mit Tesla zu konkurrieren. Nach der Veröffentlichung des neuen Videos wurde es innerhalb von nur zehn Stunden bereits von mehr als einer Million Menschen angesehen. Die alten Leute gehen und neue Rollen entstehen. Das ist eine historische Notwendigkeit. Es besteht kein Zweifel, dass dieses Jahr das explosive Jahr der humanoiden Roboter ist. Netizens kommentierten: Die Weiterentwicklung der Roboter hat dazu geführt, dass die diesjährige Eröffnungsfeier wie Menschen aussieht, und der Freiheitsgrad ist weitaus größer als der von Menschen. Aber ist das wirklich kein Horrorfilm? Zu Beginn des Videos liegt Atlas ruhig auf dem Boden, scheinbar auf dem Rücken. Was folgt, ist atemberaubend

KI untergräbt die mathematische Forschung! Der Gewinner der Fields-Medaille und der chinesisch-amerikanische Mathematiker führten 11 hochrangige Arbeiten an | Gefällt mir bei Terence Tao

Apr 09, 2024 am 11:52 AM

KI untergräbt die mathematische Forschung! Der Gewinner der Fields-Medaille und der chinesisch-amerikanische Mathematiker führten 11 hochrangige Arbeiten an | Gefällt mir bei Terence Tao

Apr 09, 2024 am 11:52 AM

KI verändert tatsächlich die Mathematik. Vor kurzem hat Tao Zhexuan, der diesem Thema große Aufmerksamkeit gewidmet hat, die neueste Ausgabe des „Bulletin of the American Mathematical Society“ (Bulletin der American Mathematical Society) weitergeleitet. Zum Thema „Werden Maschinen die Mathematik verändern?“ äußerten viele Mathematiker ihre Meinung. Der gesamte Prozess war voller Funken, knallhart und aufregend. Der Autor verfügt über eine starke Besetzung, darunter der Fields-Medaillengewinner Akshay Venkatesh, der chinesische Mathematiker Zheng Lejun, der NYU-Informatiker Ernest Davis und viele andere bekannte Wissenschaftler der Branche. Die Welt der KI hat sich dramatisch verändert. Viele dieser Artikel wurden vor einem Jahr eingereicht.

Langsame Internetgeschwindigkeiten für Mobilfunkdaten auf dem iPhone: Korrekturen

May 03, 2024 pm 09:01 PM

Langsame Internetgeschwindigkeiten für Mobilfunkdaten auf dem iPhone: Korrekturen

May 03, 2024 pm 09:01 PM

Stehen Sie vor einer Verzögerung oder einer langsamen mobilen Datenverbindung auf dem iPhone? Normalerweise hängt die Stärke des Mobilfunk-Internets auf Ihrem Telefon von mehreren Faktoren ab, wie z. B. der Region, dem Mobilfunknetztyp, dem Roaming-Typ usw. Es gibt einige Dinge, die Sie tun können, um eine schnellere und zuverlässigere Mobilfunk-Internetverbindung zu erhalten. Fix 1 – Neustart des iPhone erzwingen Manchmal werden durch einen erzwungenen Neustart Ihres Geräts viele Dinge zurückgesetzt, einschließlich der Mobilfunkverbindung. Schritt 1 – Drücken Sie einfach einmal die Lauter-Taste und lassen Sie sie los. Drücken Sie anschließend die Leiser-Taste und lassen Sie sie wieder los. Schritt 2 – Der nächste Teil des Prozesses besteht darin, die Taste auf der rechten Seite gedrückt zu halten. Lassen Sie das iPhone den Neustart abschließen. Aktivieren Sie Mobilfunkdaten und überprüfen Sie die Netzwerkgeschwindigkeit. Überprüfen Sie es erneut. Fix 2 – Datenmodus ändern 5G bietet zwar bessere Netzwerkgeschwindigkeiten, funktioniert jedoch besser, wenn das Signal schwächer ist

Die Vitalität der Superintelligenz erwacht! Aber mit der Einführung der sich selbst aktualisierenden KI müssen sich Mütter keine Sorgen mehr über Datenengpässe machen

Apr 29, 2024 pm 06:55 PM

Die Vitalität der Superintelligenz erwacht! Aber mit der Einführung der sich selbst aktualisierenden KI müssen sich Mütter keine Sorgen mehr über Datenengpässe machen

Apr 29, 2024 pm 06:55 PM

Ich weine zu Tode. Die Daten im Internet reichen überhaupt nicht aus. Das Trainingsmodell sieht aus wie „Die Tribute von Panem“, und KI-Forscher auf der ganzen Welt machen sich Gedanken darüber, wie sie diese datenhungrigen Esser ernähren sollen. Dieses Problem tritt insbesondere bei multimodalen Aufgaben auf. Zu einer Zeit, als sie ratlos waren, nutzte ein Start-up-Team der Abteilung der Renmin-Universität von China sein eigenes neues Modell, um als erstes in China einen „modellgenerierten Datenfeed selbst“ in die Realität umzusetzen. Darüber hinaus handelt es sich um einen zweigleisigen Ansatz auf der Verständnisseite und der Generierungsseite. Beide Seiten können hochwertige, multimodale neue Daten generieren und Datenrückmeldungen an das Modell selbst liefern. Was ist ein Modell? Awaker 1.0, ein großes multimodales Modell, das gerade im Zhongguancun-Forum erschienen ist. Wer ist das Team? Sophon-Motor. Gegründet von Gao Yizhao, einem Doktoranden an der Hillhouse School of Artificial Intelligence der Renmin University.

Die U.S. Air Force präsentiert ihren ersten KI-Kampfjet mit großem Aufsehen! Der Minister führte die Testfahrt persönlich durch, ohne in den gesamten Prozess einzugreifen, und 100.000 Codezeilen wurden 21 Mal getestet.

May 07, 2024 pm 05:00 PM

Die U.S. Air Force präsentiert ihren ersten KI-Kampfjet mit großem Aufsehen! Der Minister führte die Testfahrt persönlich durch, ohne in den gesamten Prozess einzugreifen, und 100.000 Codezeilen wurden 21 Mal getestet.

May 07, 2024 pm 05:00 PM

Kürzlich wurde die Militärwelt von der Nachricht überwältigt: US-Militärkampfflugzeuge können jetzt mithilfe von KI vollautomatische Luftkämpfe absolvieren. Ja, erst kürzlich wurde der KI-Kampfjet des US-Militärs zum ersten Mal der Öffentlichkeit zugänglich gemacht und sein Geheimnis gelüftet. Der vollständige Name dieses Jägers lautet „Variable Stability Simulator Test Aircraft“ (VISTA). Er wurde vom Minister der US-Luftwaffe persönlich geflogen, um einen Eins-gegen-eins-Luftkampf zu simulieren. Am 2. Mai startete US-Luftwaffenminister Frank Kendall mit einer X-62AVISTA auf der Edwards Air Force Base. Beachten Sie, dass während des einstündigen Fluges alle Flugaktionen autonom von der KI durchgeführt wurden! Kendall sagte: „In den letzten Jahrzehnten haben wir über das unbegrenzte Potenzial des autonomen Luft-Luft-Kampfes nachgedacht, aber es schien immer unerreichbar.“ Nun jedoch,