Technologie-Peripheriegeräte

Technologie-Peripheriegeräte

KI

KI

Sparse4D v3 ist da! Weiterentwicklung der End-to-End-3D-Erkennung und -Verfolgung

Sparse4D v3 ist da! Weiterentwicklung der End-to-End-3D-Erkennung und -Verfolgung

Sparse4D v3 ist da! Weiterentwicklung der End-to-End-3D-Erkennung und -Verfolgung

Neuer Titel: Sparse4D v3: Weiterentwicklung der End-to-End-3D-Erkennungs- und Tracking-Technologie

Papierlink: https://arxiv.org/pdf/2311.11722.pdf

Der Inhalt, der neu geschrieben werden muss, ist: Code-Link: https://github.com/linxuewu/Sparse4D

Umgeschriebener Inhalt: Die Zugehörigkeit des Autors ist Horizon Corporation

Thesis-Idee:

Im autonomen Fahrerkennungssystem sind 3D-Erkennung und -Verfolgung zwei grundlegende Aufgaben. Dieser Artikel befasst sich eingehender mit diesem Bereich basierend auf dem Sparse4D-Framework. In diesem Artikel werden zwei zusätzliche Trainingsaufgaben vorgestellt (Temporal Instance Denoising und Quality Estimation) und eine entkoppelte Aufmerksamkeit vorgeschlagen, um die Struktur zu verbessern und dadurch die Erkennungsleistung erheblich zu verbessern. Darüber hinaus erweitert dieser Artikel den Detektor auf den Tracker, indem er eine einfache Methode verwendet, die während der Inferenz Instanz-IDs zuweist, was die Vorteile abfragebasierter Algorithmen weiter hervorhebt. Umfangreiche Experimente zum nuScenes-Benchmark bestätigen die Wirksamkeit der vorgeschlagenen Verbesserungen. Mit ResNet50 als Rückgrat stiegen mAP, NDS und AMOTA um 3,0 %, 2,2 % bzw. 7,6 % und erreichten 46,9 %, 56,1 % bzw. 49,0 %. Das beste Modell in diesem Artikel erreichte 71,9 % NDS und 67,7 % AMOTA auf dem nuScenes-Testset Schätzung und Entkopplung der Aufmerksamkeit

Dieses Papier erweitert Sparse4D zu einem End-to-End-Tracking-Modell. Dieses Dokument zeigt die Wirksamkeit der nuScenes-Verbesserungen und die Erzielung modernster Leistung bei Erkennungs- und Verfolgungsaufgaben.

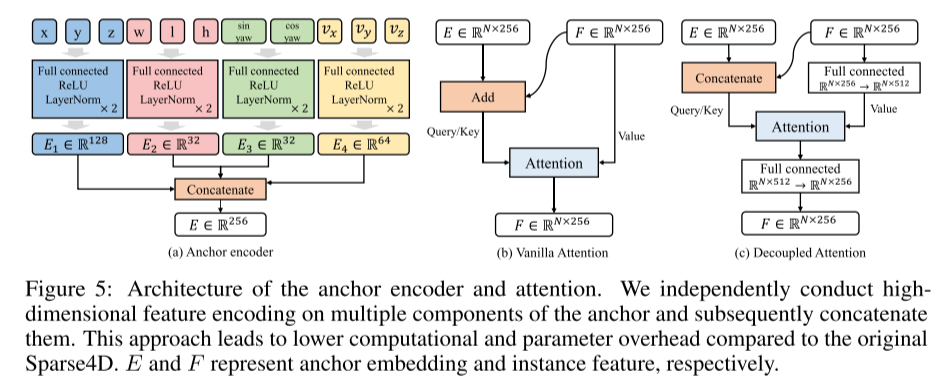

Netzwerkdesign:Erstens wird beobachtet, dass spärliche Algorithmen im Vergleich zu dichten Algorithmen größeren Herausforderungen bei der Konvergenz gegenüberstehen, was sich auf die endgültige Leistung auswirkt. Dieses Problem wurde im Bereich der 2D-Erkennung gut untersucht [17, 48, 53], hauptsächlich weil spärliche Algorithmen eine Eins-zu-eins-positive Stichprobenübereinstimmung verwenden. Diese Matching-Methode ist in den frühen Phasen des Trainings instabil und im Vergleich zum Eins-zu-viele-Matching ist die Anzahl positiver Proben begrenzt, wodurch die Effizienz des Decoder-Trainings verringert wird. Darüber hinaus verwendet Sparse4D ein spärliches Feature-Sampling anstelle einer globalen Queraufmerksamkeit, was die Konvergenz des Encoders aufgrund der Knappheit positiver Samples weiter behindert. In Sparse4Dv2 wird eine dichte Tiefenüberwachung eingeführt, um diese Konvergenzprobleme, mit denen Bildencoder konfrontiert sind, teilweise zu lindern. Das Hauptziel dieses Artikels besteht darin, die Modellleistung zu verbessern, indem der Schwerpunkt auf der Stabilität des Decodertrainings liegt. In diesem Artikel wird die Rauschunterdrückungsaufgabe als Hilfsüberwachung verwendet und die Rauschunterdrückungstechnologie von der 2D-Einzelbilderkennung auf die zeitliche 3D-Erkennung erweitert. Dadurch wird nicht nur ein stabiler positiver Probenabgleich gewährleistet, sondern auch die Anzahl positiver Proben deutlich erhöht. Darüber hinaus wird in diesem Artikel auch eine Qualitätsbewertungsaufgabe als Hilfsaufsicht vorgestellt. Dadurch wird der Konfidenzwert der Ausgabe angemessener, die Genauigkeit der Rangfolge der Erkennungsergebnisse verbessert und somit höhere Bewertungsindikatoren erzielt. Darüber hinaus verbessert dieser Artikel die Struktur der Instanz-Selbstaufmerksamkeits- und zeitlichen Queraufmerksamkeitsmodule in Sparse4D und stellt einen entkoppelten Aufmerksamkeitsmechanismus vor, der darauf abzielt, Funktionsinterferenzen im Aufmerksamkeitsgewichtungsberechnungsprozess zu reduzieren. Durch die Verwendung von Ankereinbettungen und Instanzmerkmalen als Eingaben für die Aufmerksamkeitsberechnung können Instanzen mit Ausreißern in den Aufmerksamkeitsgewichten reduziert werden. Dadurch kann die Korrelation zwischen Zielmerkmalen genauer wiedergegeben werden, wodurch eine korrekte Merkmalsaggregation erreicht wird. In diesem Artikel werden Verbindungen anstelle von Aufmerksamkeitsmechanismen verwendet, um diesen Fehler erheblich zu reduzieren. Diese Erweiterungsmethode weist Ähnlichkeiten mit dem bedingten DETR auf, der Hauptunterschied besteht jedoch darin, dass in diesem Artikel die Aufmerksamkeit zwischen Abfragen betont wird, während sich das bedingte DETR auf die gegenseitige Aufmerksamkeit zwischen Abfragen und Bildmerkmalen konzentriert. Darüber hinaus beinhaltet dieser Artikel auch eine einzigartige Codierungsmethode

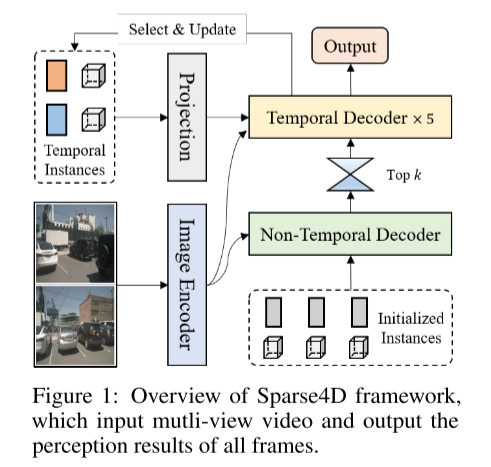

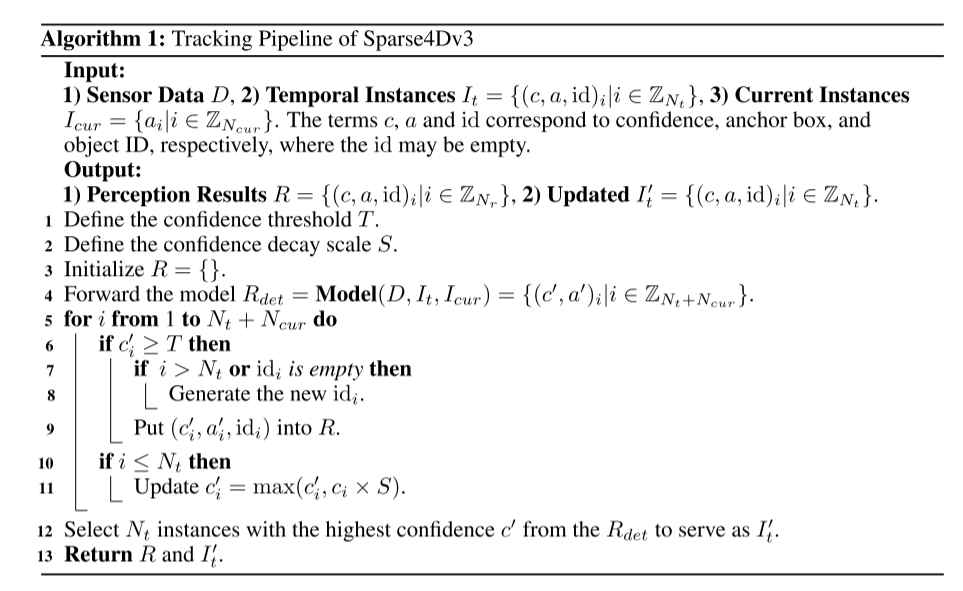

Um die End-to-End-Funktionen des Wahrnehmungssystems zu verbessern, untersucht dieser Artikel die Methode zur Integration von 3D-Multi-Target-Tracking-Aufgaben in das Sparse4D-Framework, um die direkt auszugeben Bewegungsbahn des Ziels. Im Gegensatz zu erkennungsbasierten Tracking-Methoden integriert dieses Dokument alle Tracking-Funktionen in den Detektor, indem die Notwendigkeit einer Datenzuordnung und -filterung entfällt. Darüber hinaus erfordert unser Tracker im Gegensatz zu bestehenden Methoden zur Gelenkerkennung und -verfolgung keine Modifikation oder Anpassung der Verlustfunktion während des Trainings. Es erfordert keine Bereitstellung von Ground-Truth-IDs, implementiert jedoch eine vordefinierte Instanz-zu-Track-Regression. Die Tracking-Implementierung dieses Artikels integriert den Detektor und den Tracker vollständig, ohne den Trainingsprozess des Detektors zu ändern und ohne zusätzliche Feinabstimmung. Dies ist Abbildung 1 über die Übersicht über das Sparse4D-Framework. Die Eingabe ist a Multi-View-Video und die Ausgabe sind alle Wahrnehmungsergebnisse von Frames

Abbildung 2: Inferenzeffizienz (FPS) – Wahrnehmungsleistung (mAP) auf dem nuScenes-Validierungsdatensatz verschiedener Algorithmen.

Abbildung 3: Visualisierung der Aufmerksamkeitsgewichte bei der Instanz-Selbstaufmerksamkeit: 1) Die erste Zeile zeigt die Aufmerksamkeitsgewichte bei der normalen Selbstaufmerksamkeit, wobei der Fußgänger im roten Kreis einen Unfall mit dem Zielfahrzeug (grünes Kästchen) zeigt. Korrelation. 2) Die zweite Zeile zeigt das Aufmerksamkeitsgewicht bei entkoppelter Aufmerksamkeit, wodurch dieses Problem effektiv gelöst wird.

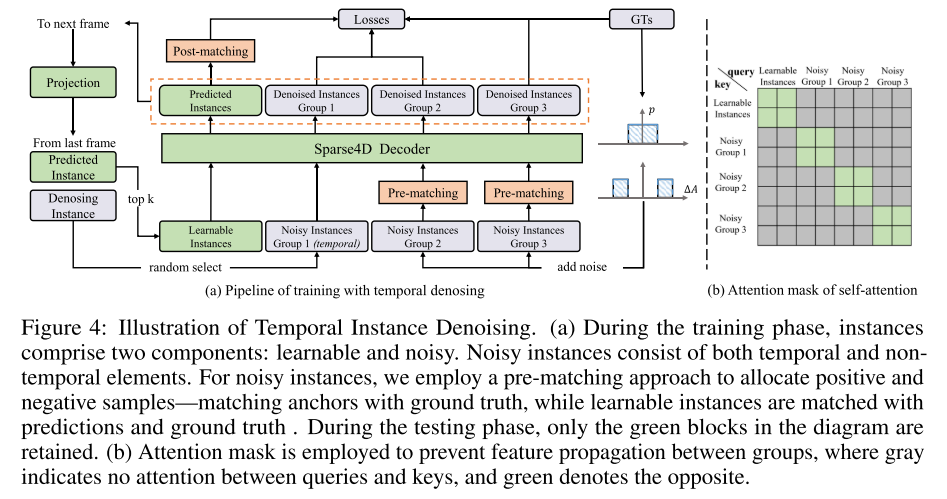

Das vierte Bild zeigt ein Beispiel für die Entrauschung von Zeitreiheninstanzen. Während der Trainingsphase bestehen Instanzen aus zwei Teilen: lernbar und laut. Rauschinstanzen bestehen aus zeitlichen und nichtzeitlichen Elementen. In diesem Artikel wird eine Pre-Matching-Methode verwendet, um positive und negative Stichproben zuzuordnen, d. h. Anker werden mit der Grundwahrheit abgeglichen, während lernbare Instanzen mit Vorhersagen und der Grundwahrheit abgeglichen werden. Während der Testphase bleiben nur grüne Blöcke übrig. Um zu verhindern, dass sich Features zwischen Gruppen ausbreiten, wird eine Aufmerksamkeitsmaske verwendet. Grau bedeutet, dass es keine Aufmerksamkeit zwischen Abfragen und Schlüsseln gibt. Grün bedeutet das Gegenteil. Siehe Abbildung 5: Architektur von Anker-Encoder und Aufmerksamkeit. In diesem Artikel werden hochdimensionale Merkmale mehrerer Ankerkomponenten unabhängig voneinander codiert und anschließend verkettet. Dieser Ansatz reduziert den Rechen- und Parameteraufwand im Vergleich zum ursprünglichen Sparse4D. E und F repräsentieren Ankereinbettungs- und Instanzfunktionen die Erkennungsleistung von Sparse4D . Diese Verbesserung umfasst hauptsächlich drei Aspekte: zeitliche Instanzentrauschung, Qualitätsschätzung und entkoppelte Aufmerksamkeit. Anschließend erläutert der Artikel den Prozess der Erweiterung von Sparse4D zu einem End-to-End-Tracking-Modell. Die Experimente dieses Artikels zu nuScenes zeigen, dass diese Verbesserungen die Leistung erheblich verbessern und Sparse4Dv3 an die Spitze des Feldes bringen.

Zitat:

Zitat:

ArXiv. /abs/2311.11722

ArXiv. /abs/2311.11722

Das obige ist der detaillierte Inhalt vonSparse4D v3 ist da! Weiterentwicklung der End-to-End-3D-Erkennung und -Verfolgung. Für weitere Informationen folgen Sie bitte anderen verwandten Artikeln auf der PHP chinesischen Website!

Heiße KI -Werkzeuge

Undresser.AI Undress

KI-gestützte App zum Erstellen realistischer Aktfotos

AI Clothes Remover

Online-KI-Tool zum Entfernen von Kleidung aus Fotos.

Undress AI Tool

Ausziehbilder kostenlos

Clothoff.io

KI-Kleiderentferner

AI Hentai Generator

Erstellen Sie kostenlos Ai Hentai.

Heißer Artikel

Heiße Werkzeuge

Notepad++7.3.1

Einfach zu bedienender und kostenloser Code-Editor

SublimeText3 chinesische Version

Chinesische Version, sehr einfach zu bedienen

Senden Sie Studio 13.0.1

Leistungsstarke integrierte PHP-Entwicklungsumgebung

Dreamweaver CS6

Visuelle Webentwicklungstools

SublimeText3 Mac-Version

Codebearbeitungssoftware auf Gottesniveau (SublimeText3)

Heiße Themen

Open Source! Jenseits von ZoeDepth! DepthFM: Schnelle und genaue monokulare Tiefenschätzung!

Apr 03, 2024 pm 12:04 PM

Open Source! Jenseits von ZoeDepth! DepthFM: Schnelle und genaue monokulare Tiefenschätzung!

Apr 03, 2024 pm 12:04 PM

0.Was bewirkt dieser Artikel? Wir schlagen DepthFM vor: ein vielseitiges und schnelles generatives monokulares Tiefenschätzungsmodell auf dem neuesten Stand der Technik. Zusätzlich zu herkömmlichen Tiefenschätzungsaufgaben demonstriert DepthFM auch hochmoderne Fähigkeiten bei nachgelagerten Aufgaben wie dem Tiefen-Inpainting. DepthFM ist effizient und kann Tiefenkarten innerhalb weniger Inferenzschritte synthetisieren. Lassen Sie uns diese Arbeit gemeinsam lesen ~ 1. Titel der Papierinformationen: DepthFM: FastMonocularDepthEstimationwithFlowMatching Autor: MingGui, JohannesS.Fischer, UlrichPrestel, PingchuanMa, Dmytr

Wie lässt sich das Long-Tail-Problem in autonomen Fahrszenarien lösen?

Jun 02, 2024 pm 02:44 PM

Wie lässt sich das Long-Tail-Problem in autonomen Fahrszenarien lösen?

Jun 02, 2024 pm 02:44 PM

Gestern wurde ich während des Interviews gefragt, ob ich irgendwelche Long-Tail-Fragen gestellt hätte, also dachte ich, ich würde eine kurze Zusammenfassung geben. Das Long-Tail-Problem des autonomen Fahrens bezieht sich auf Randfälle bei autonomen Fahrzeugen, also mögliche Szenarien mit geringer Eintrittswahrscheinlichkeit. Das wahrgenommene Long-Tail-Problem ist einer der Hauptgründe, die derzeit den betrieblichen Designbereich intelligenter autonomer Einzelfahrzeugfahrzeuge einschränken. Die zugrunde liegende Architektur und die meisten technischen Probleme des autonomen Fahrens wurden gelöst, und die verbleibenden 5 % der Long-Tail-Probleme wurden nach und nach zum Schlüssel zur Einschränkung der Entwicklung des autonomen Fahrens. Zu diesen Problemen gehören eine Vielzahl fragmentierter Szenarien, Extremsituationen und unvorhersehbares menschliches Verhalten. Der „Long Tail“ von Randszenarien beim autonomen Fahren bezieht sich auf Randfälle in autonomen Fahrzeugen (AVs). Randfälle sind mögliche Szenarien mit geringer Eintrittswahrscheinlichkeit. diese seltenen Ereignisse

Hallo, elektrischer Atlas! Der Boston Dynamics-Roboter erwacht wieder zum Leben, seltsame 180-Grad-Bewegungen machen Musk Angst

Apr 18, 2024 pm 07:58 PM

Hallo, elektrischer Atlas! Der Boston Dynamics-Roboter erwacht wieder zum Leben, seltsame 180-Grad-Bewegungen machen Musk Angst

Apr 18, 2024 pm 07:58 PM

Boston Dynamics Atlas tritt offiziell in die Ära der Elektroroboter ein! Gestern hat sich der hydraulische Atlas einfach „unter Tränen“ von der Bühne der Geschichte zurückgezogen. Heute gab Boston Dynamics bekannt, dass der elektrische Atlas im Einsatz ist. Es scheint, dass Boston Dynamics im Bereich kommerzieller humanoider Roboter entschlossen ist, mit Tesla zu konkurrieren. Nach der Veröffentlichung des neuen Videos wurde es innerhalb von nur zehn Stunden bereits von mehr als einer Million Menschen angesehen. Die alten Leute gehen und neue Rollen entstehen. Das ist eine historische Notwendigkeit. Es besteht kein Zweifel, dass dieses Jahr das explosive Jahr der humanoiden Roboter ist. Netizens kommentierten: Die Weiterentwicklung der Roboter hat dazu geführt, dass die diesjährige Eröffnungsfeier wie Menschen aussieht, und der Freiheitsgrad ist weitaus größer als der von Menschen. Aber ist das wirklich kein Horrorfilm? Zu Beginn des Videos liegt Atlas ruhig auf dem Boden, scheinbar auf dem Rücken. Was folgt, ist atemberaubend

Die Vitalität der Superintelligenz erwacht! Aber mit der Einführung der sich selbst aktualisierenden KI müssen sich Mütter keine Sorgen mehr über Datenengpässe machen

Apr 29, 2024 pm 06:55 PM

Die Vitalität der Superintelligenz erwacht! Aber mit der Einführung der sich selbst aktualisierenden KI müssen sich Mütter keine Sorgen mehr über Datenengpässe machen

Apr 29, 2024 pm 06:55 PM

Ich weine zu Tode. Die Daten im Internet reichen überhaupt nicht aus. Das Trainingsmodell sieht aus wie „Die Tribute von Panem“, und KI-Forscher auf der ganzen Welt machen sich Gedanken darüber, wie sie diese datenhungrigen Esser ernähren sollen. Dieses Problem tritt insbesondere bei multimodalen Aufgaben auf. Zu einer Zeit, als sie ratlos waren, nutzte ein Start-up-Team der Abteilung der Renmin-Universität von China sein eigenes neues Modell, um als erstes in China einen „modellgenerierten Datenfeed selbst“ in die Realität umzusetzen. Darüber hinaus handelt es sich um einen zweigleisigen Ansatz auf der Verständnisseite und der Generierungsseite. Beide Seiten können hochwertige, multimodale neue Daten generieren und Datenrückmeldungen an das Modell selbst liefern. Was ist ein Modell? Awaker 1.0, ein großes multimodales Modell, das gerade im Zhongguancun-Forum erschienen ist. Wer ist das Team? Sophon-Motor. Gegründet von Gao Yizhao, einem Doktoranden an der Hillhouse School of Artificial Intelligence der Renmin University.

Die Kuaishou-Version von Sora „Ke Ling' steht zum Testen offen: Sie generiert über 120 Sekunden Videos, versteht die Physik besser und kann komplexe Bewegungen genau modellieren

Jun 11, 2024 am 09:51 AM

Die Kuaishou-Version von Sora „Ke Ling' steht zum Testen offen: Sie generiert über 120 Sekunden Videos, versteht die Physik besser und kann komplexe Bewegungen genau modellieren

Jun 11, 2024 am 09:51 AM

Was? Wird Zootopia durch heimische KI in die Realität umgesetzt? Zusammen mit dem Video wird ein neues groß angelegtes inländisches Videogenerationsmodell namens „Keling“ vorgestellt. Sora geht einen ähnlichen technischen Weg und kombiniert eine Reihe selbst entwickelter technologischer Innovationen, um Videos zu produzieren, die nicht nur große und vernünftige Bewegungen aufweisen, sondern auch die Eigenschaften der physischen Welt simulieren und über starke konzeptionelle Kombinationsfähigkeiten und Vorstellungskraft verfügen. Den Daten zufolge unterstützt Keling die Erstellung ultralanger Videos von bis zu 2 Minuten mit 30 Bildern pro Sekunde, mit Auflösungen von bis zu 1080p und unterstützt mehrere Seitenverhältnisse. Ein weiterer wichtiger Punkt ist, dass es sich bei Keling nicht um eine vom Labor veröffentlichte Demo oder Video-Ergebnisdemonstration handelt, sondern um eine Anwendung auf Produktebene, die von Kuaishou, einem führenden Anbieter im Bereich Kurzvideos, gestartet wurde. Darüber hinaus liegt das Hauptaugenmerk darauf, pragmatisch zu sein, keine Blankoschecks auszustellen und sofort nach der Veröffentlichung online zu gehen. Das große Modell von Ke Ling wurde bereits in Kuaiying veröffentlicht.

Die U.S. Air Force präsentiert ihren ersten KI-Kampfjet mit großem Aufsehen! Der Minister führte die Testfahrt persönlich durch, ohne in den gesamten Prozess einzugreifen, und 100.000 Codezeilen wurden 21 Mal getestet.

May 07, 2024 pm 05:00 PM

Die U.S. Air Force präsentiert ihren ersten KI-Kampfjet mit großem Aufsehen! Der Minister führte die Testfahrt persönlich durch, ohne in den gesamten Prozess einzugreifen, und 100.000 Codezeilen wurden 21 Mal getestet.

May 07, 2024 pm 05:00 PM

Kürzlich wurde die Militärwelt von der Nachricht überwältigt: US-Militärkampfflugzeuge können jetzt mithilfe von KI vollautomatische Luftkämpfe absolvieren. Ja, erst kürzlich wurde der KI-Kampfjet des US-Militärs zum ersten Mal der Öffentlichkeit zugänglich gemacht und sein Geheimnis gelüftet. Der vollständige Name dieses Jägers lautet „Variable Stability Simulator Test Aircraft“ (VISTA). Er wurde vom Minister der US-Luftwaffe persönlich geflogen, um einen Eins-gegen-eins-Luftkampf zu simulieren. Am 2. Mai startete US-Luftwaffenminister Frank Kendall mit einer X-62AVISTA auf der Edwards Air Force Base. Beachten Sie, dass während des einstündigen Fluges alle Flugaktionen autonom von der KI durchgeführt wurden! Kendall sagte: „In den letzten Jahrzehnten haben wir über das unbegrenzte Potenzial des autonomen Luft-Luft-Kampfes nachgedacht, aber es schien immer unerreichbar.“ Nun jedoch,

nuScenes' neuestes SOTA |. SparseAD: Sparse-Abfrage hilft effizientes durchgängiges autonomes Fahren!

Apr 17, 2024 pm 06:22 PM

nuScenes' neuestes SOTA |. SparseAD: Sparse-Abfrage hilft effizientes durchgängiges autonomes Fahren!

Apr 17, 2024 pm 06:22 PM

Vorab geschrieben und Ausgangspunkt Das End-to-End-Paradigma verwendet ein einheitliches Framework, um Multitasking in autonomen Fahrsystemen zu erreichen. Trotz der Einfachheit und Klarheit dieses Paradigmas bleibt die Leistung von End-to-End-Methoden für das autonome Fahren bei Teilaufgaben immer noch weit hinter Methoden für einzelne Aufgaben zurück. Gleichzeitig erschweren die in früheren End-to-End-Methoden weit verbreiteten Funktionen der dichten Vogelperspektive (BEV) die Skalierung auf mehr Modalitäten oder Aufgaben. Hier wird ein Sparse-Search-zentriertes End-to-End-Paradigma für autonomes Fahren (SparseAD) vorgeschlagen, bei dem die Sparse-Suche das gesamte Fahrszenario, einschließlich Raum, Zeit und Aufgaben, ohne dichte BEV-Darstellung vollständig abbildet. Insbesondere ist eine einheitliche, spärliche Architektur für die Aufgabenerkennung einschließlich Erkennung, Verfolgung und Online-Zuordnung konzipiert. Zudem schwer

Sprechen wir über End-to-End- und autonome Fahrsysteme der nächsten Generation sowie über einige Missverständnisse über End-to-End-Autonomes Fahren?

Apr 15, 2024 pm 04:13 PM

Sprechen wir über End-to-End- und autonome Fahrsysteme der nächsten Generation sowie über einige Missverständnisse über End-to-End-Autonomes Fahren?

Apr 15, 2024 pm 04:13 PM

Im vergangenen Monat hatte ich aus bekannten Gründen einen sehr intensiven Austausch mit verschiedenen Lehrern und Mitschülern der Branche. Ein unvermeidliches Thema im Austausch ist natürlich End-to-End und der beliebte Tesla FSDV12. Ich möchte diese Gelegenheit nutzen, einige meiner aktuellen Gedanken und Meinungen als Referenz und Diskussion darzulegen. Wie definiert man ein durchgängiges autonomes Fahrsystem und welche Probleme sollten voraussichtlich durchgängig gelöst werden? Gemäß der traditionellsten Definition bezieht sich ein End-to-End-System auf ein System, das Rohinformationen von Sensoren eingibt und für die Aufgabe relevante Variablen direkt ausgibt. Bei der Bilderkennung kann CNN beispielsweise als End-to-End bezeichnet werden, verglichen mit der herkömmlichen Methode zum Extrahieren von Merkmalen + Klassifizieren. Bei autonomen Fahraufgaben werden Eingabedaten verschiedener Sensoren (Kamera/LiDAR) benötigt