Technologie-Peripheriegeräte

Technologie-Peripheriegeräte

KI

KI

Stability AI bringt das Stable Diffusion XL Turbo-Modell auf den Markt

Stability AI bringt das Stable Diffusion XL Turbo-Modell auf den Markt

Stability AI bringt das Stable Diffusion XL Turbo-Modell auf den Markt

IT House berichtete am 30. November, dass Stability AI kürzlich Stable Diffusion XL Turbo (SDXL Turbo) auf den Markt gebracht hat, eine verbesserte Version des vorherigen SDXL-Modells. Es wird gesagt, dass SDXL Turbo die „Adversarial Diffusion Distillation-Technologie“ verwendet, um die Iterationsschritte der Bilderzeugung von ursprünglich 50 Schritten auf einen Schritt zu reduzieren. Es wird gesagt, dass „nur ein Iterationsschritt erforderlich ist, um qualitativ hochwertige Bilder zu erzeugen“.

Es wird berichtet, dass das größte Merkmal des Stable Diffusion XL Turbo-Modells das oben erwähnte „Generieren von Bildern in einer Iteration“ ist, das angeblich in der Lage ist, eine „sofortige Text-zu-Bild-Ausgabe“ durchzuführen und die Qualität sicherzustellen die Bilder.

Was neu geschrieben werden muss, ist: Eine davon heißt „Adversarial Diffusion Destillation Technology“, eine Technologie, die das vorhandene groß angelegte Bilddiffusionsmodell als „Lehrernetzwerk“ nutzt, um den Generierungsprozess zu steuern. Diese Technologie kombiniert „Destillationstechnologie“ und „kontradiktorisches Training“, wobei sich „Destillationstechnologie“ auf die Verdichtung des Wissens eines großen Modells in einem kleineren Modell bezieht, um die Ausgabe des Modells zu optimieren. Und kontradiktorisches Training kann das Modell verbessern, sodass es die Ergebnisse des Lehrermodells besser nachahmen kann

Bei der Destillationstechnologie früherer Modelle war es schwierig, Effizienz und Qualität in Einklang zu bringen, da eine schnelle Abtastung normalerweise die Ausgabequalität schwächt. Daher ist dieses Stable Diffusion XL Turbo-Modell eine effektive Möglichkeit, mithilfe der „kontradiktorischen Diffusionsdestillationstechnologie“ effizient Bilder zu erzeugen .

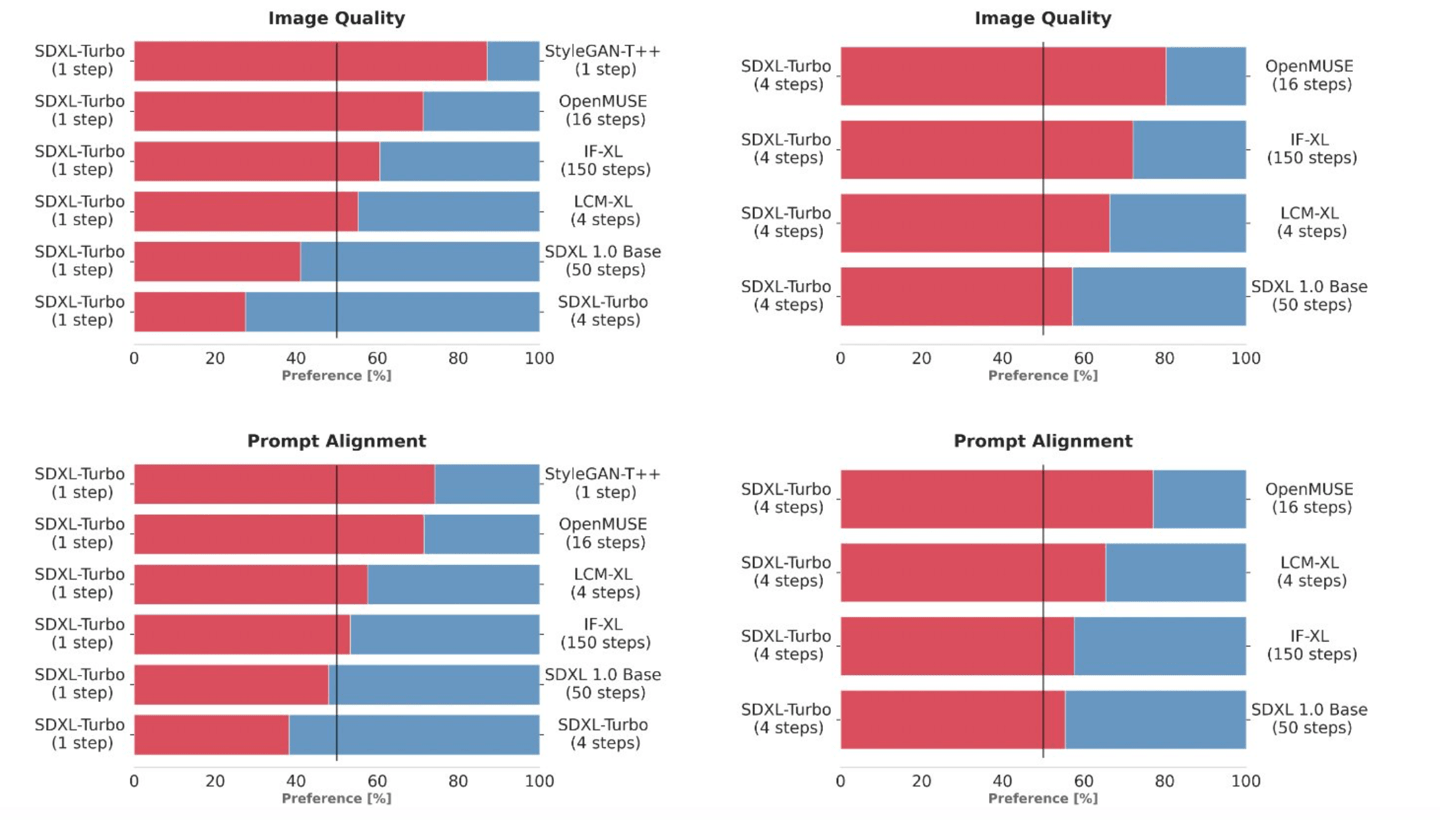

Verglich Stable Diffusion XL Turbo offiziell mit mehreren verschiedenen Modellvarianten, darunter StyleGAN-T++, OpenMUSE, IF-XL, SDXL und LCM-XL, und führte zwei Experimente durch, von denen das erste Modellevaluatoren erforderte. Die Ausgabe der beiden Modelle wurde zufällig angezeigt und wählen Sie das Ausgabebild aus, das am besten zum Eingabewort passt. Das zweite Experiment wird ungefähr genauso durchgeführt wie das erste Experiment. Die Modellbewertung erfordert die Auswahl des Bildes mit der besten Bildqualität im Modell.

▲ Bilder vom Stability AI-Blog

Experimentelle Ergebnisse zeigen, dass Stable Diffusion XL Turbo den Rechenaufwand erheblich reduzieren kann und gleichzeitig eine hervorragende Bilderzeugungsqualität beibehält. Dieses Modell kann LCM-XL in nur einer Iteration übertreffen, verglichen mit LCM-XL, das vier Iterationen erforderte. Der Stable Diffusion XL Turbo, der 4 Iterationen durchlaufen hat, kann den Stable Diffusion XL, dessen Konfiguration zuvor 50 Iterationen erforderte, problemlos schlagen. Bei Verwendung der A100-GPU für die Bildberechnung mit einer Auflösung von 512 x 512 dauert die Fertigstellung nur 207 Millisekunden

IT House hat festgestellt, dass Stability AI derzeit den entsprechenden Code auf Hugging Face für den persönlichen und nicht kommerziellen Gebrauch veröffentlicht hat, um ihn zu besuchen.

Das obige ist der detaillierte Inhalt vonStability AI bringt das Stable Diffusion XL Turbo-Modell auf den Markt. Für weitere Informationen folgen Sie bitte anderen verwandten Artikeln auf der PHP chinesischen Website!

Heiße KI -Werkzeuge

Undresser.AI Undress

KI-gestützte App zum Erstellen realistischer Aktfotos

AI Clothes Remover

Online-KI-Tool zum Entfernen von Kleidung aus Fotos.

Undress AI Tool

Ausziehbilder kostenlos

Clothoff.io

KI-Kleiderentferner

AI Hentai Generator

Erstellen Sie kostenlos Ai Hentai.

Heißer Artikel

Heiße Werkzeuge

Notepad++7.3.1

Einfach zu bedienender und kostenloser Code-Editor

SublimeText3 chinesische Version

Chinesische Version, sehr einfach zu bedienen

Senden Sie Studio 13.0.1

Leistungsstarke integrierte PHP-Entwicklungsumgebung

Dreamweaver CS6

Visuelle Webentwicklungstools

SublimeText3 Mac-Version

Codebearbeitungssoftware auf Gottesniveau (SublimeText3)

Heiße Themen

1377

1377

52

52

Ich habe versucht, die Vibe -Codierung mit Cursor AI und es ist erstaunlich!

Mar 20, 2025 pm 03:34 PM

Ich habe versucht, die Vibe -Codierung mit Cursor AI und es ist erstaunlich!

Mar 20, 2025 pm 03:34 PM

Die Vibe -Codierung verändert die Welt der Softwareentwicklung, indem wir Anwendungen mit natürlicher Sprache anstelle von endlosen Codezeilen erstellen können. Inspiriert von Visionären wie Andrej Karpathy, lässt dieser innovative Ansatz Dev

Top 5 Genai Starts vom Februar 2025: GPT-4,5, GROK-3 & MEHR!

Mar 22, 2025 am 10:58 AM

Top 5 Genai Starts vom Februar 2025: GPT-4,5, GROK-3 & MEHR!

Mar 22, 2025 am 10:58 AM

Februar 2025 war ein weiterer bahnbrechender Monat für die Generative KI, die uns einige der am meisten erwarteten Modell-Upgrades und bahnbrechenden neuen Funktionen gebracht hat. Von Xais Grok 3 und Anthropics Claude 3.7 -Sonett, um g zu eröffnen

Wie benutze ich Yolo V12 zur Objekterkennung?

Mar 22, 2025 am 11:07 AM

Wie benutze ich Yolo V12 zur Objekterkennung?

Mar 22, 2025 am 11:07 AM

Yolo (Sie schauen nur einmal) war ein führender Echtzeit-Objekterkennungsrahmen, wobei jede Iteration die vorherigen Versionen verbessert. Die neueste Version Yolo V12 führt Fortschritte vor, die die Genauigkeit erheblich verbessern

Ist Chatgpt 4 o verfügbar?

Mar 28, 2025 pm 05:29 PM

Ist Chatgpt 4 o verfügbar?

Mar 28, 2025 pm 05:29 PM

Chatgpt 4 ist derzeit verfügbar und weit verbreitet, wodurch im Vergleich zu seinen Vorgängern wie ChatGPT 3.5 signifikante Verbesserungen beim Verständnis des Kontextes und des Generierens kohärenter Antworten zeigt. Zukünftige Entwicklungen können mehr personalisierte Inters umfassen

Gencast von Google: Wettervorhersage mit Gencast Mini Demo

Mar 16, 2025 pm 01:46 PM

Gencast von Google: Wettervorhersage mit Gencast Mini Demo

Mar 16, 2025 pm 01:46 PM

Gencast von Google Deepmind: Eine revolutionäre KI für die Wettervorhersage Die Wettervorhersage wurde einer dramatischen Transformation unterzogen, die sich von rudimentären Beobachtungen zu ausgefeilten AI-angetriebenen Vorhersagen überschreitet. Google DeepMinds Gencast, ein Bodenbrei

Welche KI ist besser als Chatgpt?

Mar 18, 2025 pm 06:05 PM

Welche KI ist besser als Chatgpt?

Mar 18, 2025 pm 06:05 PM

Der Artikel erörtert KI -Modelle, die Chatgpt wie Lamda, Lama und Grok übertreffen und ihre Vorteile in Bezug auf Genauigkeit, Verständnis und Branchenauswirkungen hervorheben. (159 Charaktere)

Beste KI -Kunstgeneratoren (kostenlos & amp; bezahlt) für kreative Projekte

Apr 02, 2025 pm 06:10 PM

Beste KI -Kunstgeneratoren (kostenlos & amp; bezahlt) für kreative Projekte

Apr 02, 2025 pm 06:10 PM

Der Artikel überprüft Top -KI -Kunstgeneratoren, diskutiert ihre Funktionen, Eignung für kreative Projekte und Wert. Es zeigt MidJourney als den besten Wert für Fachkräfte und empfiehlt Dall-E 2 für hochwertige, anpassbare Kunst.

O1 gegen GPT-4O: Ist OpenAIs neues Modell besser als GPT-4O?

Mar 16, 2025 am 11:47 AM

O1 gegen GPT-4O: Ist OpenAIs neues Modell besser als GPT-4O?

Mar 16, 2025 am 11:47 AM

Openais O1: Ein 12-tägiger Geschenkbummel beginnt mit ihrem bisher mächtigsten Modell Die Ankunft im Dezember bringt eine globale Verlangsamung, Schneeflocken in einigen Teilen der Welt, aber Openai fängt gerade erst an. Sam Altman und sein Team starten ein 12-tägiges Geschenk Ex