Technologie-Peripheriegeräte

Technologie-Peripheriegeräte

KI

KI

Durchbrechen der Auflösungsgrenze: Byte und die University of Science and Technology of China enthüllen ein großes multimodales Dokumentenmodell

Durchbrechen der Auflösungsgrenze: Byte und die University of Science and Technology of China enthüllen ein großes multimodales Dokumentenmodell

Durchbrechen der Auflösungsgrenze: Byte und die University of Science and Technology of China enthüllen ein großes multimodales Dokumentenmodell

Jetzt gibt es sogar große multimodale hochauflösende Dokumente!

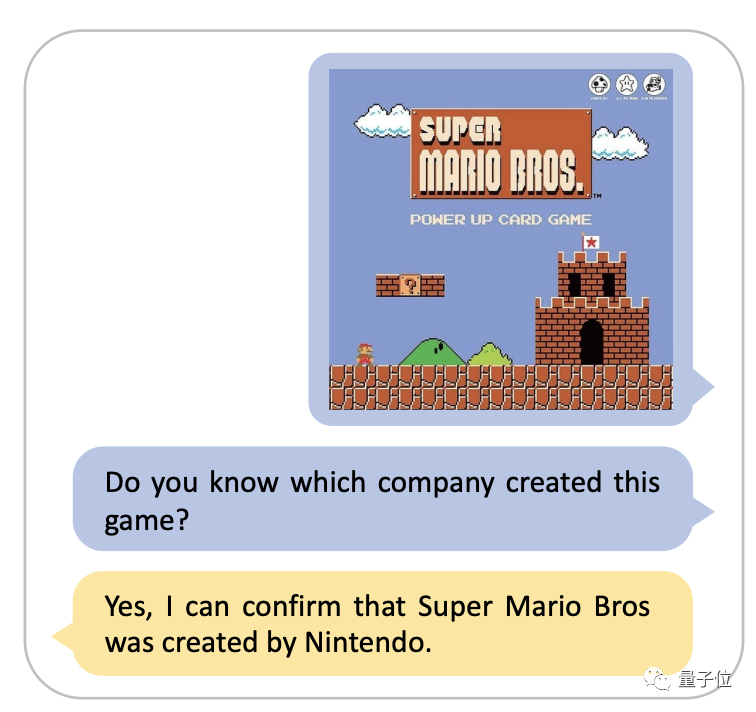

Diese Technologie kann nicht nur Informationen in Bildern genau identifizieren, sondern auch eine eigene Wissensdatenbank aufrufen, um Fragen entsprechend den Benutzeranforderungen zu beantworten.

Wenn Sie beispielsweise die Mario-Benutzeroberfläche auf dem Bild sehen, können Sie direkt antworten, von wo sie stammt Nintendo-Arbeit.

Dieses Modell wurde gemeinsam von ByteDance und der University of Science and Technology of China erforscht und am 24. November 2023 auf arXiv hochgeladen

In dieser Forschung schlug das Autorenteam DocPedia vor, ein einheitliches hochauflösendes Multimodales Dokument-Großmodell DocPedia.

In dieser Studie verwendete der Autor eine neue Methode, um die Mängel bestehender Modelle zu beheben, die hochauflösende Dokumentbilder nicht analysieren können.

DocPedia hat eine Auflösung von bis zu 2560 x 2560. Die fortschrittlichen multimodalen Großmodelle der Branche wie LLaVA und MiniGPT-4 haben jedoch eine Obergrenze der Bildverarbeitungsauflösung von 336 x 336 und können keine hochauflösenden Dokumente analysieren Bilder.

Wie funktioniert dieses Modell und welche Optimierungsmethode wird verwendet?

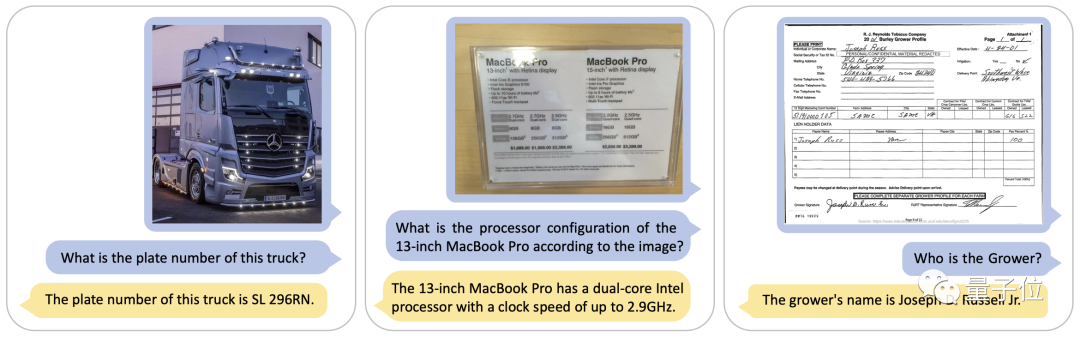

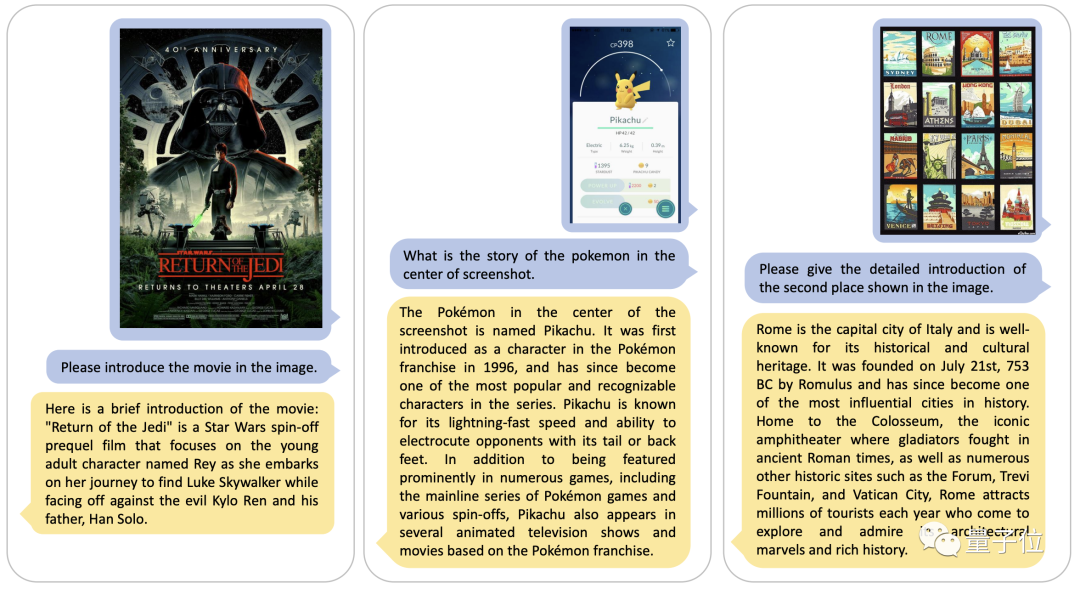

Deutliche Verbesserung verschiedener Bewertungsergebnisse

In diesem Artikel zeigt der Autor ein Beispiel für das Verständnis hochauflösender Bilder und Texte von DocPedia. Es ist zu beobachten, dass DocPedia in der Lage ist, den Befehlsinhalt zu verstehen und relevante Grafik- und Textinformationen aus hochauflösenden Dokumentbildern und natürlichen Szenenbildern genau zu extrahieren. In diesem Satz von Bildern konnte DocPedia beispielsweise problemlos das Nummernschild ermitteln. Textinformationen wie Computerkonfiguration und sogar handgeschriebener Text können genau beurteilt werden.

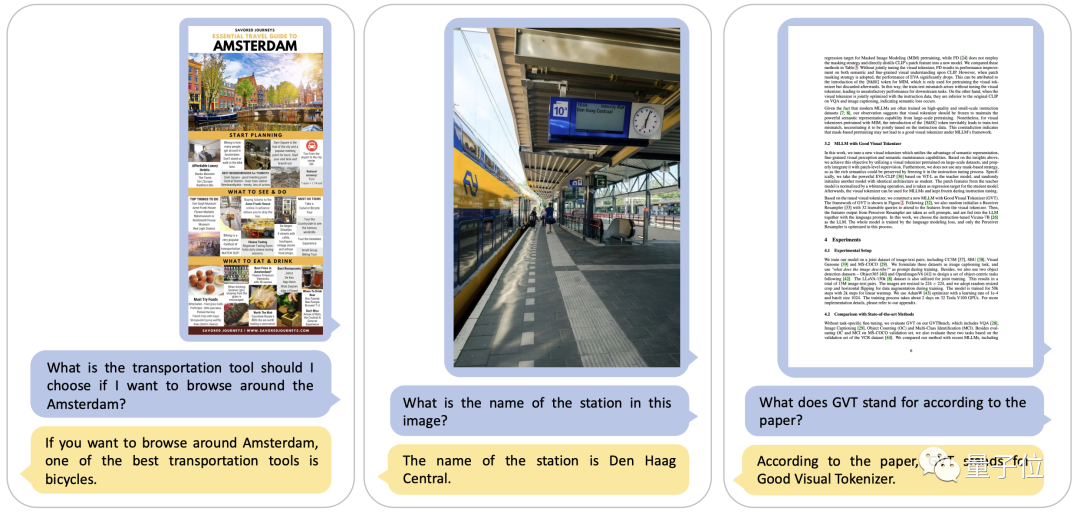

In Kombination mit Textinformationen in Bildern kann DocPedia auch umfangreiche Modellschlussfolgerungsfunktionen nutzen, um Probleme basierend auf dem Kontext zu analysieren.

In Kombination mit Textinformationen in Bildern kann DocPedia auch umfangreiche Modellschlussfolgerungsfunktionen nutzen, um Probleme basierend auf dem Kontext zu analysieren.

Nach dem Lesen der Bildinformationen wird DocPedia auf der Grundlage seiner umfangreichen Weltwissensdatenbank auch auf den erweiterten Inhalt antworten, der nicht im Bild angezeigt wird.

Nach dem Lesen der Bildinformationen wird DocPedia auf der Grundlage seiner umfangreichen Weltwissensdatenbank auch auf den erweiterten Inhalt antworten, der nicht im Bild angezeigt wird.

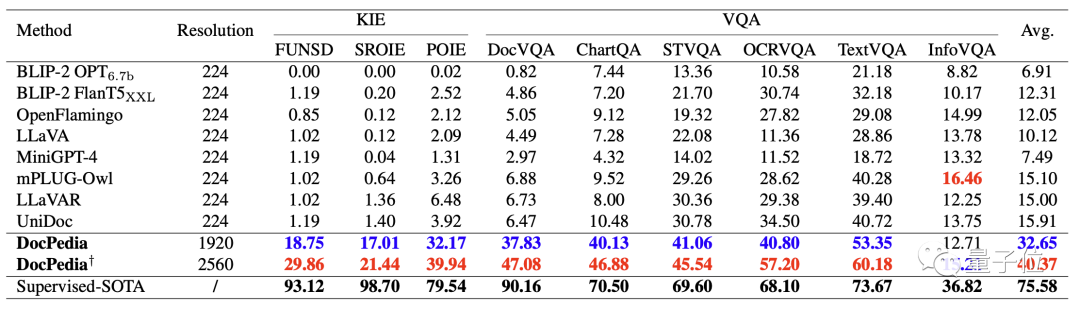

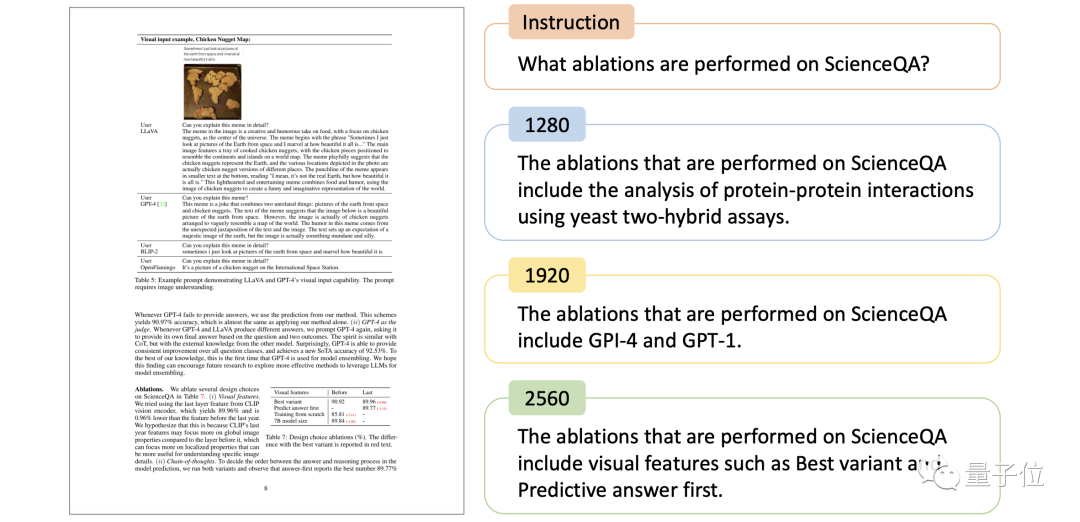

In der folgenden Tabelle werden einige vorhandene multimodale große Modelle und der Schlüssel von DocPedia quantitativ verglichen Informationsextraktion (KIE) und visuelle Fragebeantwortung (VQA).

In der folgenden Tabelle werden einige vorhandene multimodale große Modelle und der Schlüssel von DocPedia quantitativ verglichen Informationsextraktion (KIE) und visuelle Fragebeantwortung (VQA).

Durch die Erhöhung der Auflösung und die Einführung effektiver Trainingsmethoden können wir sehen, dass DocPedia in verschiedenen Test-Benchmarks deutliche Verbesserungen erzielt hat

Wie erzielt DocPedia also einen solchen Effekt?

Wie erzielt DocPedia also einen solchen Effekt?

Lösen Sie das Auflösungsproblem aus dem Frequenzbereich.

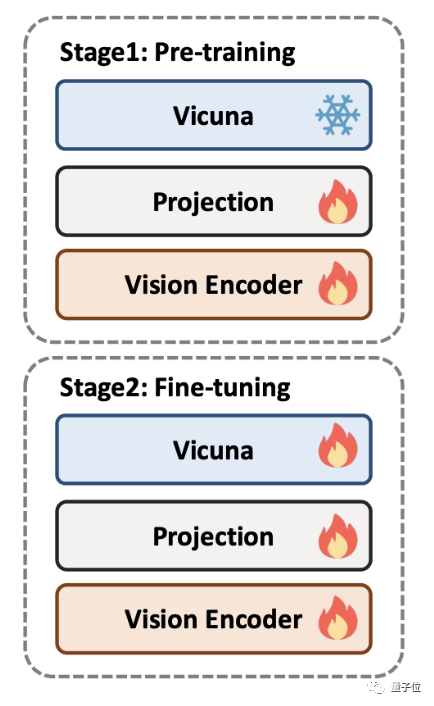

Das Training von DocPedia ist in zwei Phasen unterteilt: Vortraining und Feinabstimmung. Um DocPedia zu trainieren, sammelte das Autorenteam eine große Menge an Grafikdaten mit verschiedenen Dokumenttypen und erstellte einen Datensatz zur Feinabstimmung der Anweisungen.

In der Vortrainingsphase wird das große Sprachmodell eingefroren und nur der Teil des visuellen Encoders wird optimiert, um seinen Ausgabe-Token-Darstellungsraum mit dem großen Sprachmodell in Einklang zu bringen.

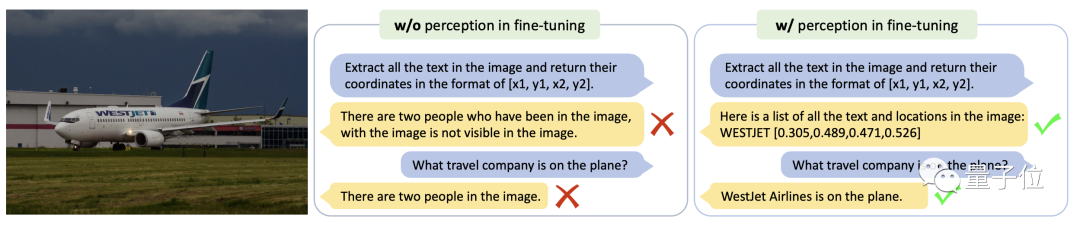

In dieser Phase hat das Autorenteam schlägt vor, hauptsächlich die Wahrnehmungsfähigkeiten von DocPedia zu trainieren, einschließlich der Wahrnehmung von Text und natürlichen Szenen.

Zu den Aufgaben vor dem Training gehören Texterkennung, Texterkennung, End-to-End-OCR, Absatzlesen, Volltextlesen und Bildunterschriften.

In der Feinabstimmungsphase wird das groß angelegte Sprachmodell aufgehoben und eine durchgängige Gesamtoptimierung durchgeführt

Das Autorenteam schlug eine gemeinsame Trainingsstrategie für Wahrnehmung und Verständnis vor: basierend auf den ursprünglichen Wahrnehmungsaufgaben auf niedriger Ebene Es wurden zwei Arten von Dokumentenverständnis und Szenenbildern hinzugefügt. Aufgaben zum partiellen semantischen Verständnis höherer Ordnung

Eine solche gemeinsame Trainingsstrategie für Wahrnehmung und Verständnis verbessert die Leistung von DocPedia weiter.

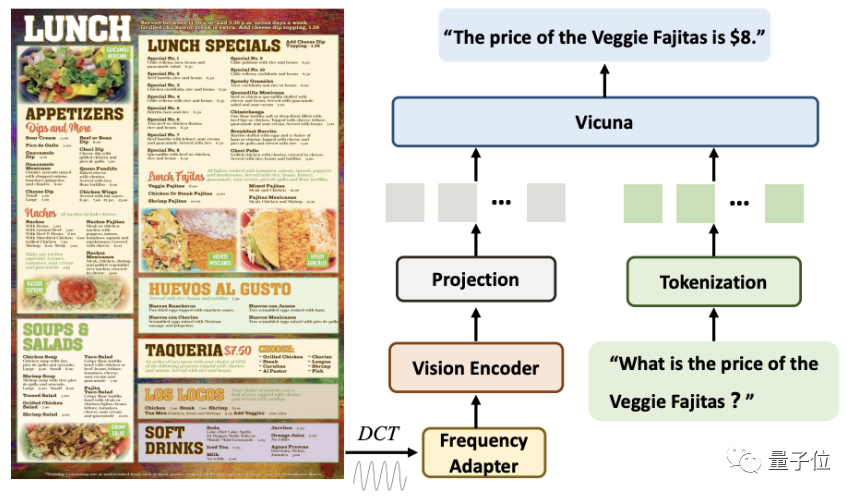

In Bezug auf die Strategie zur Lösung von Problemen löst DocPedia diese im Gegensatz zu bestehenden Methoden aus der Perspektive des

In Bezug auf die Strategie zur Lösung von Problemen löst DocPedia diese im Gegensatz zu bestehenden Methoden aus der Perspektive des

. Bei der Verarbeitung hochauflösender Dokumentbilder extrahiert DocPedia zunächst seine DCT-Koeffizientenmatrix. Diese Matrix kann die räumliche Auflösung um das Achtfache heruntersampeln, ohne die Textinformationen des Originalbilds zu verlieren. Nach diesem Schritt verwenden wir den kaskadierten Frequenzbereichsadapter (Frequenzadapter), um das Eingangssignal für eine tiefere Auflösungskomprimierung zu übertragen und Feature-Extraktion

Mit dieser Methode kann ein 2560×2560-Bild durch 1600 Token dargestellt werden.

Verglichen mit der direkten Eingabe des Originalbilds in einen visuellen Encoder (z. B. Swin Transformer) reduziert diese Methode die Anzahl der Token um das Vierfache.

Abschließend werden diese Token mit den aus den Anweisungen in der Sequenzdimension konvertierten Token verkettet und zur Antwort in das große Modell eingegeben.

Die Ergebnisse des Ablationsexperiments zeigen, dass die Erhöhung der Auflösung und die Durchführung einer gemeinsamen Feinabstimmung von Wahrnehmung und Verständnis zwei wichtige Faktoren zur Verbesserung der Leistung von DocPedia sind.

Die folgende Abbildung vergleicht die Leistung von DocPedia auf einem Papierbild und einem ähnlichen Bild Befehl auf verschiedenen Eingängen. Antworten auf der Skala. Es ist ersichtlich, dass DocPedia genau dann richtig antwortet, wenn die Auflösung auf 2560×2560 erhöht wird.

Das Bild unten vergleicht die Modellreaktionen von DocPedia auf dasselbe Szenentextbild und dieselbe Anweisung unter verschiedenen Feinabstimmungsstrategien.

Aus diesem Beispiel geht hervor, dass das durch Wahrnehmung und Verständnis gemeinsam verfeinerte Modell eine genaue Texterkennung und semantische Frage und Antwort durchführen kann

Bitte klicken Sie auf den folgenden Link, um das Papier anzuzeigen: https ://arxiv.org/abs/ 2311.11810

Das obige ist der detaillierte Inhalt vonDurchbrechen der Auflösungsgrenze: Byte und die University of Science and Technology of China enthüllen ein großes multimodales Dokumentenmodell. Für weitere Informationen folgen Sie bitte anderen verwandten Artikeln auf der PHP chinesischen Website!

Heiße KI -Werkzeuge

Undresser.AI Undress

KI-gestützte App zum Erstellen realistischer Aktfotos

AI Clothes Remover

Online-KI-Tool zum Entfernen von Kleidung aus Fotos.

Undress AI Tool

Ausziehbilder kostenlos

Clothoff.io

KI-Kleiderentferner

AI Hentai Generator

Erstellen Sie kostenlos Ai Hentai.

Heißer Artikel

Heiße Werkzeuge

Notepad++7.3.1

Einfach zu bedienender und kostenloser Code-Editor

SublimeText3 chinesische Version

Chinesische Version, sehr einfach zu bedienen

Senden Sie Studio 13.0.1

Leistungsstarke integrierte PHP-Entwicklungsumgebung

Dreamweaver CS6

Visuelle Webentwicklungstools

SublimeText3 Mac-Version

Codebearbeitungssoftware auf Gottesniveau (SublimeText3)

Heiße Themen

1376

1376

52

52

Verwenden Sie ddrescue, um Daten unter Linux wiederherzustellen

Mar 20, 2024 pm 01:37 PM

Verwenden Sie ddrescue, um Daten unter Linux wiederherzustellen

Mar 20, 2024 pm 01:37 PM

DDREASE ist ein Tool zum Wiederherstellen von Daten von Datei- oder Blockgeräten wie Festplatten, SSDs, RAM-Disks, CDs, DVDs und USB-Speichergeräten. Es kopiert Daten von einem Blockgerät auf ein anderes, wobei beschädigte Blöcke zurückbleiben und nur gute Blöcke verschoben werden. ddreasue ist ein leistungsstarkes Wiederherstellungstool, das vollständig automatisiert ist, da es während der Wiederherstellungsvorgänge keine Unterbrechungen erfordert. Darüber hinaus kann es dank der ddasue-Map-Datei jederzeit gestoppt und fortgesetzt werden. Weitere wichtige Funktionen von DDREASE sind: Es überschreibt die wiederhergestellten Daten nicht, füllt aber die Lücken im Falle einer iterativen Wiederherstellung. Es kann jedoch gekürzt werden, wenn das Tool explizit dazu aufgefordert wird. Stellen Sie Daten aus mehreren Dateien oder Blöcken in einer einzigen wieder her

Open Source! Jenseits von ZoeDepth! DepthFM: Schnelle und genaue monokulare Tiefenschätzung!

Apr 03, 2024 pm 12:04 PM

Open Source! Jenseits von ZoeDepth! DepthFM: Schnelle und genaue monokulare Tiefenschätzung!

Apr 03, 2024 pm 12:04 PM

0.Was bewirkt dieser Artikel? Wir schlagen DepthFM vor: ein vielseitiges und schnelles generatives monokulares Tiefenschätzungsmodell auf dem neuesten Stand der Technik. Zusätzlich zu herkömmlichen Tiefenschätzungsaufgaben demonstriert DepthFM auch hochmoderne Fähigkeiten bei nachgelagerten Aufgaben wie dem Tiefen-Inpainting. DepthFM ist effizient und kann Tiefenkarten innerhalb weniger Inferenzschritte synthetisieren. Lassen Sie uns diese Arbeit gemeinsam lesen ~ 1. Titel der Papierinformationen: DepthFM: FastMonocularDepthEstimationwithFlowMatching Autor: MingGui, JohannesS.Fischer, UlrichPrestel, PingchuanMa, Dmytr

Hallo, elektrischer Atlas! Der Boston Dynamics-Roboter erwacht wieder zum Leben, seltsame 180-Grad-Bewegungen machen Musk Angst

Apr 18, 2024 pm 07:58 PM

Hallo, elektrischer Atlas! Der Boston Dynamics-Roboter erwacht wieder zum Leben, seltsame 180-Grad-Bewegungen machen Musk Angst

Apr 18, 2024 pm 07:58 PM

Boston Dynamics Atlas tritt offiziell in die Ära der Elektroroboter ein! Gestern hat sich der hydraulische Atlas einfach „unter Tränen“ von der Bühne der Geschichte zurückgezogen. Heute gab Boston Dynamics bekannt, dass der elektrische Atlas im Einsatz ist. Es scheint, dass Boston Dynamics im Bereich kommerzieller humanoider Roboter entschlossen ist, mit Tesla zu konkurrieren. Nach der Veröffentlichung des neuen Videos wurde es innerhalb von nur zehn Stunden bereits von mehr als einer Million Menschen angesehen. Die alten Leute gehen und neue Rollen entstehen. Das ist eine historische Notwendigkeit. Es besteht kein Zweifel, dass dieses Jahr das explosive Jahr der humanoiden Roboter ist. Netizens kommentierten: Die Weiterentwicklung der Roboter hat dazu geführt, dass die diesjährige Eröffnungsfeier wie Menschen aussieht, und der Freiheitsgrad ist weitaus größer als der von Menschen. Aber ist das wirklich kein Horrorfilm? Zu Beginn des Videos liegt Atlas ruhig auf dem Boden, scheinbar auf dem Rücken. Was folgt, ist atemberaubend

Google ist begeistert: JAX-Leistung übertrifft Pytorch und TensorFlow! Es könnte die schnellste Wahl für das GPU-Inferenztraining werden

Apr 01, 2024 pm 07:46 PM

Google ist begeistert: JAX-Leistung übertrifft Pytorch und TensorFlow! Es könnte die schnellste Wahl für das GPU-Inferenztraining werden

Apr 01, 2024 pm 07:46 PM

Die von Google geförderte Leistung von JAX hat in jüngsten Benchmark-Tests die von Pytorch und TensorFlow übertroffen und belegt bei 7 Indikatoren den ersten Platz. Und der Test wurde nicht auf der TPU mit der besten JAX-Leistung durchgeführt. Obwohl unter Entwicklern Pytorch immer noch beliebter ist als Tensorflow. Aber in Zukunft werden möglicherweise mehr große Modelle auf Basis der JAX-Plattform trainiert und ausgeführt. Modelle Kürzlich hat das Keras-Team drei Backends (TensorFlow, JAX, PyTorch) mit der nativen PyTorch-Implementierung und Keras2 mit TensorFlow verglichen. Zunächst wählen sie eine Reihe von Mainstream-Inhalten aus

Langsame Internetgeschwindigkeiten für Mobilfunkdaten auf dem iPhone: Korrekturen

May 03, 2024 pm 09:01 PM

Langsame Internetgeschwindigkeiten für Mobilfunkdaten auf dem iPhone: Korrekturen

May 03, 2024 pm 09:01 PM

Stehen Sie vor einer Verzögerung oder einer langsamen mobilen Datenverbindung auf dem iPhone? Normalerweise hängt die Stärke des Mobilfunk-Internets auf Ihrem Telefon von mehreren Faktoren ab, wie z. B. der Region, dem Mobilfunknetztyp, dem Roaming-Typ usw. Es gibt einige Dinge, die Sie tun können, um eine schnellere und zuverlässigere Mobilfunk-Internetverbindung zu erhalten. Fix 1 – Neustart des iPhone erzwingen Manchmal werden durch einen erzwungenen Neustart Ihres Geräts viele Dinge zurückgesetzt, einschließlich der Mobilfunkverbindung. Schritt 1 – Drücken Sie einfach einmal die Lauter-Taste und lassen Sie sie los. Drücken Sie anschließend die Leiser-Taste und lassen Sie sie wieder los. Schritt 2 – Der nächste Teil des Prozesses besteht darin, die Taste auf der rechten Seite gedrückt zu halten. Lassen Sie das iPhone den Neustart abschließen. Aktivieren Sie Mobilfunkdaten und überprüfen Sie die Netzwerkgeschwindigkeit. Überprüfen Sie es erneut. Fix 2 – Datenmodus ändern 5G bietet zwar bessere Netzwerkgeschwindigkeiten, funktioniert jedoch besser, wenn das Signal schwächer ist

Die Kuaishou-Version von Sora „Ke Ling' steht zum Testen offen: Sie generiert über 120 Sekunden Videos, versteht die Physik besser und kann komplexe Bewegungen genau modellieren

Jun 11, 2024 am 09:51 AM

Die Kuaishou-Version von Sora „Ke Ling' steht zum Testen offen: Sie generiert über 120 Sekunden Videos, versteht die Physik besser und kann komplexe Bewegungen genau modellieren

Jun 11, 2024 am 09:51 AM

Was? Wird Zootopia durch heimische KI in die Realität umgesetzt? Zusammen mit dem Video wird ein neues groß angelegtes inländisches Videogenerationsmodell namens „Keling“ vorgestellt. Sora geht einen ähnlichen technischen Weg und kombiniert eine Reihe selbst entwickelter technologischer Innovationen, um Videos zu produzieren, die nicht nur große und vernünftige Bewegungen aufweisen, sondern auch die Eigenschaften der physischen Welt simulieren und über starke konzeptionelle Kombinationsfähigkeiten und Vorstellungskraft verfügen. Den Daten zufolge unterstützt Keling die Erstellung ultralanger Videos von bis zu 2 Minuten mit 30 Bildern pro Sekunde, mit Auflösungen von bis zu 1080p und unterstützt mehrere Seitenverhältnisse. Ein weiterer wichtiger Punkt ist, dass es sich bei Keling nicht um eine vom Labor veröffentlichte Demo oder Video-Ergebnisdemonstration handelt, sondern um eine Anwendung auf Produktebene, die von Kuaishou, einem führenden Anbieter im Bereich Kurzvideos, gestartet wurde. Darüber hinaus liegt das Hauptaugenmerk darauf, pragmatisch zu sein, keine Blankoschecks auszustellen und sofort nach der Veröffentlichung online zu gehen. Das große Modell von Ke Ling wurde bereits in Kuaiying veröffentlicht.

Die Vitalität der Superintelligenz erwacht! Aber mit der Einführung der sich selbst aktualisierenden KI müssen sich Mütter keine Sorgen mehr über Datenengpässe machen

Apr 29, 2024 pm 06:55 PM

Die Vitalität der Superintelligenz erwacht! Aber mit der Einführung der sich selbst aktualisierenden KI müssen sich Mütter keine Sorgen mehr über Datenengpässe machen

Apr 29, 2024 pm 06:55 PM

Ich weine zu Tode. Die Daten im Internet reichen überhaupt nicht aus. Das Trainingsmodell sieht aus wie „Die Tribute von Panem“, und KI-Forscher auf der ganzen Welt machen sich Gedanken darüber, wie sie diese datenhungrigen Esser ernähren sollen. Dieses Problem tritt insbesondere bei multimodalen Aufgaben auf. Zu einer Zeit, als sie ratlos waren, nutzte ein Start-up-Team der Abteilung der Renmin-Universität von China sein eigenes neues Modell, um als erstes in China einen „modellgenerierten Datenfeed selbst“ in die Realität umzusetzen. Darüber hinaus handelt es sich um einen zweigleisigen Ansatz auf der Verständnisseite und der Generierungsseite. Beide Seiten können hochwertige, multimodale neue Daten generieren und Datenrückmeldungen an das Modell selbst liefern. Was ist ein Modell? Awaker 1.0, ein großes multimodales Modell, das gerade im Zhongguancun-Forum erschienen ist. Wer ist das Team? Sophon-Motor. Gegründet von Gao Yizhao, einem Doktoranden an der Hillhouse School of Artificial Intelligence der Renmin University.

Die U.S. Air Force präsentiert ihren ersten KI-Kampfjet mit großem Aufsehen! Der Minister führte die Testfahrt persönlich durch, ohne in den gesamten Prozess einzugreifen, und 100.000 Codezeilen wurden 21 Mal getestet.

May 07, 2024 pm 05:00 PM

Die U.S. Air Force präsentiert ihren ersten KI-Kampfjet mit großem Aufsehen! Der Minister führte die Testfahrt persönlich durch, ohne in den gesamten Prozess einzugreifen, und 100.000 Codezeilen wurden 21 Mal getestet.

May 07, 2024 pm 05:00 PM

Kürzlich wurde die Militärwelt von der Nachricht überwältigt: US-Militärkampfflugzeuge können jetzt mithilfe von KI vollautomatische Luftkämpfe absolvieren. Ja, erst kürzlich wurde der KI-Kampfjet des US-Militärs zum ersten Mal der Öffentlichkeit zugänglich gemacht und sein Geheimnis gelüftet. Der vollständige Name dieses Jägers lautet „Variable Stability Simulator Test Aircraft“ (VISTA). Er wurde vom Minister der US-Luftwaffe persönlich geflogen, um einen Eins-gegen-eins-Luftkampf zu simulieren. Am 2. Mai startete US-Luftwaffenminister Frank Kendall mit einer X-62AVISTA auf der Edwards Air Force Base. Beachten Sie, dass während des einstündigen Fluges alle Flugaktionen autonom von der KI durchgeführt wurden! Kendall sagte: „In den letzten Jahrzehnten haben wir über das unbegrenzte Potenzial des autonomen Luft-Luft-Kampfes nachgedacht, aber es schien immer unerreichbar.“ Nun jedoch,