Technologie-Peripheriegeräte

Technologie-Peripheriegeräte

KI

KI

Die herumfliegenden Gesichtszüge, das Öffnen des Mundes, das Starren und das Hochziehen der Augenbrauen können von der KI perfekt nachgeahmt werden, sodass Videobetrug nicht verhindert werden kann

Die herumfliegenden Gesichtszüge, das Öffnen des Mundes, das Starren und das Hochziehen der Augenbrauen können von der KI perfekt nachgeahmt werden, sodass Videobetrug nicht verhindert werden kann

Die herumfliegenden Gesichtszüge, das Öffnen des Mundes, das Starren und das Hochziehen der Augenbrauen können von der KI perfekt nachgeahmt werden, sodass Videobetrug nicht verhindert werden kann

So eine mächtige Fähigkeit zur KI-Nachahmung, es ist wirklich unmöglich, sich davor zu schützen, es ist völlig unmöglich, sich davor zu schützen. Hat die Entwicklung der KI mittlerweile dieses Niveau erreicht?

Sie bewegen Ihren Vorderfuß, um Ihre Gesichtszüge fliegen zu lassen, und der exakt gleiche Ausdruck wird auf Ihrem Hinterfuß reproduziert. Starren, Augenbrauen hochziehen, Schmollen, egal wie übertrieben der Ausdruck ist, alles wird perfekt nachgeahmt.

Erhöhen Sie den Schwierigkeitsgrad, heben Sie die Augenbrauen höher, öffnen Sie die Augen weiter, sogar die Mundform ist schief und der virtuelle Charakter-Avatar kann den Ausdruck perfekt reproduzieren.

Wenn Sie die Parameter auf der linken Seite anpassen, ändert auch der virtuelle Avatar auf der rechten Seite seine Bewegungen entsprechend.

Eine Nahaufnahme von Mund und Augen kann nicht sein sagen, dass sie genau gleich sind, es kann nur sein, dass die Ausdrücke genau gleich sind (ganz rechts).

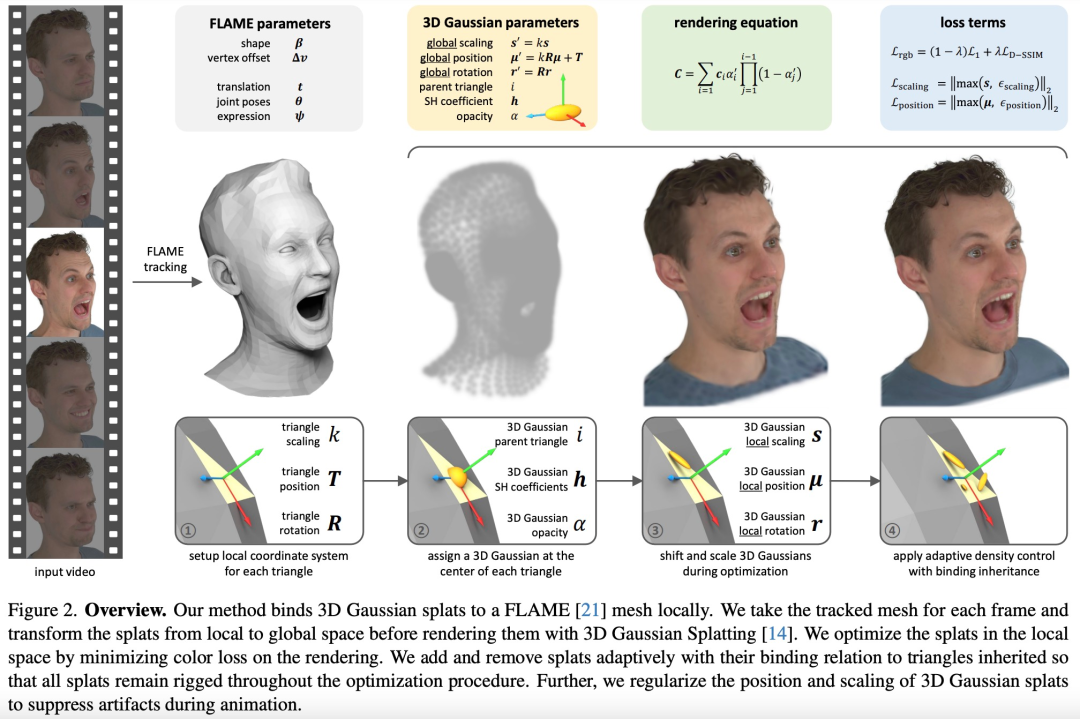

Diese Forschung stammt von Institutionen wie der Technischen Universität München, die GaussianAvatars vorgeschlagen haben, eine Methode, mit der realistische Kopf-Avatare erstellt werden können, die hinsichtlich Ausdruck, Haltung und Standpunkt (Blickwinkel) vollständig kontrollierbar sind. .

- Papieradresse: https://arxiv.org/pdf/2312.02069.pdf

- Papierhomepage: https://shenhanqian.github.io/gaussian-avatars

In den Bereichen Computer Vision und Grafik war die Schaffung eines virtuellen Kopfes, der einen Menschen dynamisch darstellen kann, schon immer ein herausforderndes Problem. Insbesondere im Hinblick auf die Darstellung extremer Gesichtsausdrücke und Details ist es ziemlich schwierig, Details wie Falten und Haare zu erfassen, und die generierten virtuellen Charaktere leiden oft unter visuellen Artefakten

In der vergangenen Zeit war das neuronale Strahlungsfeld ( NeRF) ) und seine Varianten haben beeindruckende Ergebnisse bei der Rekonstruktion statischer Szenen aus Beobachtungen mit mehreren Ansichten erzielt. Nachfolgende Forschungen erweiterten diese Methoden und ermöglichten die Verwendung von NeRF für die dynamische Szenenmodellierung von auf den Menschen zugeschnittenen Szenarien. Ein Nachteil dieser Methoden ist jedoch die mangelnde Steuerbarkeit und damit die Unfähigkeit, sich gut an neue Posen und Ausdrücke anzupassen

Die kürzlich entwickelte Methode „3D Gaussian Spray“ erreicht eine höhere Rendering-Qualität als NeRF und kann in Echtzeit verwendet werden Zusammensetzung anzeigen. Diese Methode unterstützt jedoch keine Animation der rekonstruierten Ausgabe

In diesem Artikel wird GaussianAvatars vorgeschlagen, eine dynamische 3D-Kopfdarstellungsmethode, die auf dreidimensionalen Gaußschen Splats basiert.

Konkret haben sie bei einem FLAME-Netz (Modellierung des gesamten Kopfes) eine 3D-Gaußsche Funktion in der Mitte jedes Dreiecks initialisiert. Wenn ein FLAME-Netz animiert wird, wird jedes Gaußsche Modell basierend auf seinem übergeordneten Dreieck verschoben, gedreht und skaliert. Der 3D-Gauß-Effekt erzeugt dann ein Strahlungsfeld auf dem Netz und gleicht Bereiche aus, in denen das Netz nicht genau ausgerichtet ist oder bestimmte visuelle Elemente nicht reproduziert.

Um ein hohes Maß an Realismus der virtuellen Charaktere aufrechtzuerhalten, wird in diesem Artikel eine verbindliche Vererbungsstrategie angewendet. Gleichzeitig untersucht dieser Artikel auch, wie ein Gleichgewicht zwischen der Wahrung von Realismus und Stabilität gefunden werden kann, um neuartige Ausdrücke und Körperhaltungen virtueller Charaktere zu animieren. Die Forschungsergebnisse zeigen, dass GaussianAvatars im Vergleich zu bestehenden Forschungsergebnissen beim Rendern neuartiger Ansichten und bei der Steuerung der Videowiedergabe eine gute Leistung erbringt Multi-View-Videoaufnahme eines menschlichen Kopfes. Für jeden Zeitschritt verwendet GaussianAvatars einen photometrischen Headtracker, um FLAME-Parameter mit Multi-View-Beobachtungen und bekannten Kameraparametern abzugleichen.

FLAME-Netze haben unterschiedliche Scheitelpunktpositionen, aber die gleiche Topologie, sodass das Team konsistente Verbindungen zwischen Netzdreiecken und 3D-Gaußschen Flächen erstellen kann. Rendern Sie Splat mit einem differenzierbaren Kachelraster in ein Bild. Dann werden mit echter Bildüberwachung realistische menschliche Kopf-Avatare erlernt

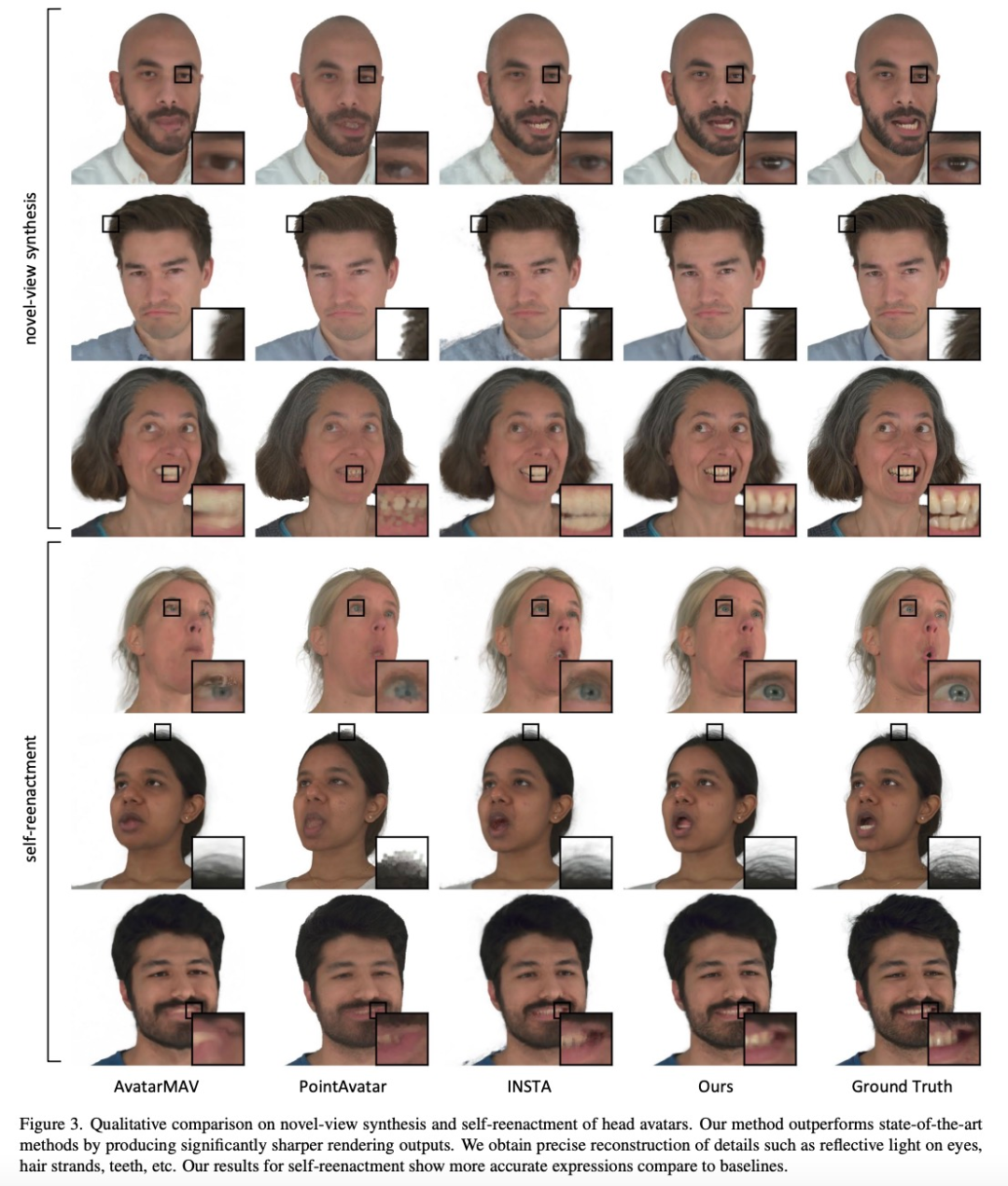

Für eine optimale Qualität müssen statische Szenen durch Gaußsche Splats durch eine Reihe adaptiver Dichtekontrolloperationen komprimiert und beschnitten werden. Um dies zu erreichen, hat das Forschungsteam eine verbindliche Vererbungsstrategie entwickelt, die neue Gaußsche Punkte an das FLAME-Netz gebunden hält, ohne die Verbindung zwischen dem Dreieck und dem Splat zu zerstören Bewertung der Rekonstruktionsqualität und Bewertung der Animationstreue durch Selbstwiederholung. Abbildung 3 unten zeigt die Ergebnisse eines qualitativen Vergleichs zwischen verschiedenen Methoden. Im Hinblick auf die Synthese neuer Perspektiven sind alle Methoden in der Lage, vernünftige Rendering-Ergebnisse zu erzielen. Bei näherer Betrachtung der Ergebnisse von PointAvatar ist jedoch zu erkennen, dass aufgrund der festen Punktgröße Punktartefakte auftreten. Gaußsche Avatare, die die 3D-Gaußsche anisotrope Skalierungstechnologie verwenden, können dieses Problem lindern

Wir können ähnliche Schlussfolgerungen aus dem quantitativen Vergleich in Tabelle 1 ziehen. Im Vergleich zu anderen Methoden schneidet GaussianAvatars gut bei der Synthese neuer Ansichten ab, ist auch hervorragend bei der Selbstnachstellung und hat die Wahrnehmungsunterschiede bei LPIPS deutlich reduziert. Es ist zu beachten, dass die Selbstnachstellung auf der FLAME-Rasterverfolgung basiert und möglicherweise nicht vollständig mit dem Zielbild übereinstimmt Identitätsreproduktion. Die Ergebnisse zeigten, dass der Avatar die Blinzel- und Mundbewegungen des Quellschauspielers genau reproduzierte und lebendige und komplexe Dynamiken wie Falten usw. darstellte In der Studie wurden auch Ablationsexperimente durchgeführt. Die Ergebnisse sind unten aufgeführt.

Das obige ist der detaillierte Inhalt vonDie herumfliegenden Gesichtszüge, das Öffnen des Mundes, das Starren und das Hochziehen der Augenbrauen können von der KI perfekt nachgeahmt werden, sodass Videobetrug nicht verhindert werden kann. Für weitere Informationen folgen Sie bitte anderen verwandten Artikeln auf der PHP chinesischen Website!

Heiße KI -Werkzeuge

Undresser.AI Undress

KI-gestützte App zum Erstellen realistischer Aktfotos

AI Clothes Remover

Online-KI-Tool zum Entfernen von Kleidung aus Fotos.

Undress AI Tool

Ausziehbilder kostenlos

Clothoff.io

KI-Kleiderentferner

AI Hentai Generator

Erstellen Sie kostenlos Ai Hentai.

Heißer Artikel

Heiße Werkzeuge

Notepad++7.3.1

Einfach zu bedienender und kostenloser Code-Editor

SublimeText3 chinesische Version

Chinesische Version, sehr einfach zu bedienen

Senden Sie Studio 13.0.1

Leistungsstarke integrierte PHP-Entwicklungsumgebung

Dreamweaver CS6

Visuelle Webentwicklungstools

SublimeText3 Mac-Version

Codebearbeitungssoftware auf Gottesniveau (SublimeText3)

Heiße Themen

1376

1376

52

52

Verwenden Sie ddrescue, um Daten unter Linux wiederherzustellen

Mar 20, 2024 pm 01:37 PM

Verwenden Sie ddrescue, um Daten unter Linux wiederherzustellen

Mar 20, 2024 pm 01:37 PM

DDREASE ist ein Tool zum Wiederherstellen von Daten von Datei- oder Blockgeräten wie Festplatten, SSDs, RAM-Disks, CDs, DVDs und USB-Speichergeräten. Es kopiert Daten von einem Blockgerät auf ein anderes, wobei beschädigte Blöcke zurückbleiben und nur gute Blöcke verschoben werden. ddreasue ist ein leistungsstarkes Wiederherstellungstool, das vollständig automatisiert ist, da es während der Wiederherstellungsvorgänge keine Unterbrechungen erfordert. Darüber hinaus kann es dank der ddasue-Map-Datei jederzeit gestoppt und fortgesetzt werden. Weitere wichtige Funktionen von DDREASE sind: Es überschreibt die wiederhergestellten Daten nicht, füllt aber die Lücken im Falle einer iterativen Wiederherstellung. Es kann jedoch gekürzt werden, wenn das Tool explizit dazu aufgefordert wird. Stellen Sie Daten aus mehreren Dateien oder Blöcken in einer einzigen wieder her

Open Source! Jenseits von ZoeDepth! DepthFM: Schnelle und genaue monokulare Tiefenschätzung!

Apr 03, 2024 pm 12:04 PM

Open Source! Jenseits von ZoeDepth! DepthFM: Schnelle und genaue monokulare Tiefenschätzung!

Apr 03, 2024 pm 12:04 PM

0.Was bewirkt dieser Artikel? Wir schlagen DepthFM vor: ein vielseitiges und schnelles generatives monokulares Tiefenschätzungsmodell auf dem neuesten Stand der Technik. Zusätzlich zu herkömmlichen Tiefenschätzungsaufgaben demonstriert DepthFM auch hochmoderne Fähigkeiten bei nachgelagerten Aufgaben wie dem Tiefen-Inpainting. DepthFM ist effizient und kann Tiefenkarten innerhalb weniger Inferenzschritte synthetisieren. Lassen Sie uns diese Arbeit gemeinsam lesen ~ 1. Titel der Papierinformationen: DepthFM: FastMonocularDepthEstimationwithFlowMatching Autor: MingGui, JohannesS.Fischer, UlrichPrestel, PingchuanMa, Dmytr

Google ist begeistert: JAX-Leistung übertrifft Pytorch und TensorFlow! Es könnte die schnellste Wahl für das GPU-Inferenztraining werden

Apr 01, 2024 pm 07:46 PM

Google ist begeistert: JAX-Leistung übertrifft Pytorch und TensorFlow! Es könnte die schnellste Wahl für das GPU-Inferenztraining werden

Apr 01, 2024 pm 07:46 PM

Die von Google geförderte Leistung von JAX hat in jüngsten Benchmark-Tests die von Pytorch und TensorFlow übertroffen und belegt bei 7 Indikatoren den ersten Platz. Und der Test wurde nicht auf der TPU mit der besten JAX-Leistung durchgeführt. Obwohl unter Entwicklern Pytorch immer noch beliebter ist als Tensorflow. Aber in Zukunft werden möglicherweise mehr große Modelle auf Basis der JAX-Plattform trainiert und ausgeführt. Modelle Kürzlich hat das Keras-Team drei Backends (TensorFlow, JAX, PyTorch) mit der nativen PyTorch-Implementierung und Keras2 mit TensorFlow verglichen. Zunächst wählen sie eine Reihe von Mainstream-Inhalten aus

Langsame Internetgeschwindigkeiten für Mobilfunkdaten auf dem iPhone: Korrekturen

May 03, 2024 pm 09:01 PM

Langsame Internetgeschwindigkeiten für Mobilfunkdaten auf dem iPhone: Korrekturen

May 03, 2024 pm 09:01 PM

Stehen Sie vor einer Verzögerung oder einer langsamen mobilen Datenverbindung auf dem iPhone? Normalerweise hängt die Stärke des Mobilfunk-Internets auf Ihrem Telefon von mehreren Faktoren ab, wie z. B. der Region, dem Mobilfunknetztyp, dem Roaming-Typ usw. Es gibt einige Dinge, die Sie tun können, um eine schnellere und zuverlässigere Mobilfunk-Internetverbindung zu erhalten. Fix 1 – Neustart des iPhone erzwingen Manchmal werden durch einen erzwungenen Neustart Ihres Geräts viele Dinge zurückgesetzt, einschließlich der Mobilfunkverbindung. Schritt 1 – Drücken Sie einfach einmal die Lauter-Taste und lassen Sie sie los. Drücken Sie anschließend die Leiser-Taste und lassen Sie sie wieder los. Schritt 2 – Der nächste Teil des Prozesses besteht darin, die Taste auf der rechten Seite gedrückt zu halten. Lassen Sie das iPhone den Neustart abschließen. Aktivieren Sie Mobilfunkdaten und überprüfen Sie die Netzwerkgeschwindigkeit. Überprüfen Sie es erneut. Fix 2 – Datenmodus ändern 5G bietet zwar bessere Netzwerkgeschwindigkeiten, funktioniert jedoch besser, wenn das Signal schwächer ist

Die Vitalität der Superintelligenz erwacht! Aber mit der Einführung der sich selbst aktualisierenden KI müssen sich Mütter keine Sorgen mehr über Datenengpässe machen

Apr 29, 2024 pm 06:55 PM

Die Vitalität der Superintelligenz erwacht! Aber mit der Einführung der sich selbst aktualisierenden KI müssen sich Mütter keine Sorgen mehr über Datenengpässe machen

Apr 29, 2024 pm 06:55 PM

Ich weine zu Tode. Die Daten im Internet reichen überhaupt nicht aus. Das Trainingsmodell sieht aus wie „Die Tribute von Panem“, und KI-Forscher auf der ganzen Welt machen sich Gedanken darüber, wie sie diese datenhungrigen Esser ernähren sollen. Dieses Problem tritt insbesondere bei multimodalen Aufgaben auf. Zu einer Zeit, als sie ratlos waren, nutzte ein Start-up-Team der Abteilung der Renmin-Universität von China sein eigenes neues Modell, um als erstes in China einen „modellgenerierten Datenfeed selbst“ in die Realität umzusetzen. Darüber hinaus handelt es sich um einen zweigleisigen Ansatz auf der Verständnisseite und der Generierungsseite. Beide Seiten können hochwertige, multimodale neue Daten generieren und Datenrückmeldungen an das Modell selbst liefern. Was ist ein Modell? Awaker 1.0, ein großes multimodales Modell, das gerade im Zhongguancun-Forum erschienen ist. Wer ist das Team? Sophon-Motor. Gegründet von Gao Yizhao, einem Doktoranden an der Hillhouse School of Artificial Intelligence der Renmin University.

Die U.S. Air Force präsentiert ihren ersten KI-Kampfjet mit großem Aufsehen! Der Minister führte die Testfahrt persönlich durch, ohne in den gesamten Prozess einzugreifen, und 100.000 Codezeilen wurden 21 Mal getestet.

May 07, 2024 pm 05:00 PM

Die U.S. Air Force präsentiert ihren ersten KI-Kampfjet mit großem Aufsehen! Der Minister führte die Testfahrt persönlich durch, ohne in den gesamten Prozess einzugreifen, und 100.000 Codezeilen wurden 21 Mal getestet.

May 07, 2024 pm 05:00 PM

Kürzlich wurde die Militärwelt von der Nachricht überwältigt: US-Militärkampfflugzeuge können jetzt mithilfe von KI vollautomatische Luftkämpfe absolvieren. Ja, erst kürzlich wurde der KI-Kampfjet des US-Militärs zum ersten Mal der Öffentlichkeit zugänglich gemacht und sein Geheimnis gelüftet. Der vollständige Name dieses Jägers lautet „Variable Stability Simulator Test Aircraft“ (VISTA). Er wurde vom Minister der US-Luftwaffe persönlich geflogen, um einen Eins-gegen-eins-Luftkampf zu simulieren. Am 2. Mai startete US-Luftwaffenminister Frank Kendall mit einer X-62AVISTA auf der Edwards Air Force Base. Beachten Sie, dass während des einstündigen Fluges alle Flugaktionen autonom von der KI durchgeführt wurden! Kendall sagte: „In den letzten Jahrzehnten haben wir über das unbegrenzte Potenzial des autonomen Luft-Luft-Kampfes nachgedacht, aber es schien immer unerreichbar.“ Nun jedoch,

Der erste Roboter erscheint, der menschliche Aufgaben autonom erledigt, mit fünf flexiblen Fingern und übermenschlicher Geschwindigkeit, und große Modelle unterstützen das Training im virtuellen Raum

Mar 11, 2024 pm 12:10 PM

Der erste Roboter erscheint, der menschliche Aufgaben autonom erledigt, mit fünf flexiblen Fingern und übermenschlicher Geschwindigkeit, und große Modelle unterstützen das Training im virtuellen Raum

Mar 11, 2024 pm 12:10 PM

Diese Woche gab FigureAI, ein Robotikunternehmen, an dem OpenAI, Microsoft, Bezos und Nvidia beteiligt sind, bekannt, dass es fast 700 Millionen US-Dollar an Finanzmitteln erhalten hat und plant, im nächsten Jahr einen humanoiden Roboter zu entwickeln, der selbstständig gehen kann. Und Teslas Optimus Prime hat immer wieder gute Nachrichten erhalten. Niemand zweifelt daran, dass dieses Jahr das Jahr sein wird, in dem humanoide Roboter explodieren. SanctuaryAI, ein in Kanada ansässiges Robotikunternehmen, hat kürzlich einen neuen humanoiden Roboter auf den Markt gebracht: Phoenix. Beamte behaupten, dass es viele Aufgaben autonom und mit der gleichen Geschwindigkeit wie Menschen erledigen kann. Pheonix, der weltweit erste Roboter, der Aufgaben autonom in menschlicher Geschwindigkeit erledigen kann, kann jedes Objekt sanft greifen, bewegen und elegant auf der linken und rechten Seite platzieren. Es kann Objekte autonom identifizieren

Das multimodale Dokumentenverständnis-Großmodell Alibaba 7B gewinnt neue SOTA

Apr 02, 2024 am 11:31 AM

Das multimodale Dokumentenverständnis-Großmodell Alibaba 7B gewinnt neue SOTA

Apr 02, 2024 am 11:31 AM

Neues SOTA für multimodale Dokumentverständnisfunktionen! Das Alibaba mPLUG-Team hat die neueste Open-Source-Arbeit mPLUG-DocOwl1.5 veröffentlicht, die eine Reihe von Lösungen zur Bewältigung der vier großen Herausforderungen der hochauflösenden Bildtexterkennung, des allgemeinen Verständnisses der Dokumentstruktur, der Befolgung von Anweisungen und der Einführung externen Wissens vorschlägt. Schauen wir uns ohne weitere Umschweife zunächst die Auswirkungen an. Ein-Klick-Erkennung und Konvertierung von Diagrammen mit komplexen Strukturen in das Markdown-Format: Es stehen Diagramme verschiedener Stile zur Verfügung: Auch eine detailliertere Texterkennung und -positionierung ist einfach zu handhaben: Auch ausführliche Erläuterungen zum Dokumentverständnis können gegeben werden: Sie wissen schon, „Document Understanding“. " ist derzeit ein wichtiges Szenario für die Implementierung großer Sprachmodelle. Es gibt viele Produkte auf dem Markt, die das Lesen von Dokumenten unterstützen. Einige von ihnen verwenden hauptsächlich OCR-Systeme zur Texterkennung und arbeiten mit LLM zur Textverarbeitung zusammen.