Technologie-Peripheriegeräte

Technologie-Peripheriegeräte

KI

KI

DeepMind-Artikel in Nature veröffentlicht: Ein großes Modell findet eine neue Lösung für ein Problem, das Mathematiker seit Jahrzehnten beschäftigt

DeepMind-Artikel in Nature veröffentlicht: Ein großes Modell findet eine neue Lösung für ein Problem, das Mathematiker seit Jahrzehnten beschäftigt

DeepMind-Artikel in Nature veröffentlicht: Ein großes Modell findet eine neue Lösung für ein Problem, das Mathematiker seit Jahrzehnten beschäftigt

Als Top-Technologie im Bereich der künstlichen Intelligenz in diesem Jahr sind große Sprachmodelle (LLM) gut darin, Konzepte zu kombinieren und Menschen durch Lesen, Verstehen, Schreiben und Codieren bei der Lösung von Problemen zu helfen. Aber können sie völlig neues Wissen entdecken?

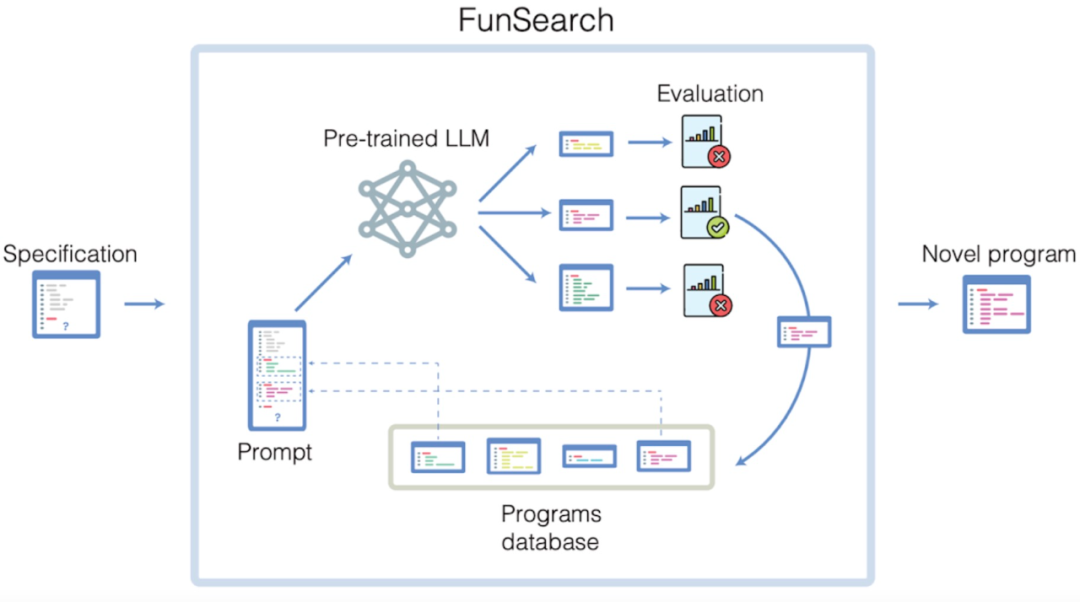

LLM für eine nachweislich korrekte Entdeckung zu nutzen, ist eine herausfordernde Aufgabe, da LLM nachweislich unter dem Problem der „Halluzination“ leidet, d hat eine neue Methode zur Suche nach Lösungen für Mathematik- und Informatikprobleme vorgeschlagen – FunSearch. FunSearch kombiniert ein vorab trainiertes LLM (das kreative Lösungen in Form von Computercode bereitstellt) mit einem automatischen „Auswerter“, um Halluzinationen und falsche Ideen zu verhindern. Durch das Hin- und Herwechseln zwischen diesen beiden Komponenten entwickelt sich die ursprüngliche Lösung zu „neuem Wissen“. Ein entsprechender Artikel wurde in der Zeitschrift Nature veröffentlicht.

... Machen Sie neue Entdeckungen.FunSearch entdeckt neue Lösungen für das Cap-Set-Problem, ein dauerhaft ungelöstes Problem in der Mathematik. Darüber hinaus nutzt DeepMind diese Lösung auch, um effizientere Algorithmen zur Lösung des „Boxing“-Problems zu erforschen, das in vielen Bereichen weit verbreitet ist, beispielsweise bei der Verbesserung der Effizienz von Rechenzentren. Den praktischen Wert von FunSearch demonstrieren

Das Forschungsteam glaubt, dass FunSearch ein besonders leistungsfähiges wissenschaftliches Werkzeug werden wird, da die von ihm ausgegebenen Programme offenbaren, wie ihre Lösungen aufgebaut sind, und nicht nur, was die Lösungen sind. Dies wird weitere Erkenntnisse der Wissenschaftler anregen und einen positiven Kreislauf wissenschaftlicher Verbesserungen und Entdeckungen schaffen.

Fördern Sie die Entdeckung durch die Entwicklung von Sprachmodellen

FunSearch verwendet einen von LLM unterstützten evolutionären Algorithmus, um die Ideen und Ideen mit der höchsten Punktzahl zu fördern und voranzutreiben. Diese Ideen und Ideen können als Computerprogramme ausgedrückt werden, sodass sie automatisch ausgeführt und ausgewertet werden können.

Zunächst muss der Benutzer die Beschreibung des Problems in Form von Code schreiben. Diese Beschreibung sollte den Prozess der Evaluierung des Programms und des Seed-Programms umfassen, das zur Initialisierung des Programmpools verwendet wird.

FunSearch ist ein iterativer Prozess. In jeder Iteration wählt das System einige Programme aus dem aktuellen Programmpool aus und übergibt sie an LLM. LLM baut auf dieser Grundlage auf und generiert neue Programme, die dann automatisch evaluiert werden. Die besten Programme werden wieder zur bestehenden Bibliothek hinzugefügt, wodurch ein Zyklus der Selbstverbesserung entsteht. FunSearch verwendet Googles PaLM 2, ist aber auch mit anderen Code-trainierten Methoden kompatibel

LLM ruft das beste generierte Programm aus einer Programmdatenbank ab und wird gebeten, ein besseres Programm zu generieren.

Wie wir alle wissen, ist die Erforschung neuer mathematischer Erkenntnisse und Algorithmen in verschiedenen Bereichen eine sehr anspruchsvolle Aufgabe, die oft über die Fähigkeiten der derzeit fortschrittlichsten Systeme der künstlichen Intelligenz hinausgeht. Um FunSearch dieser Aufgabe gewachsen zu machen, führte das Forschungsteam mehrere Schlüsselkomponenten ein. FunSearch beginnt nicht bei Null, sondern geht von einem gesunden Menschenverstand für das Problem aus und verwendet einen evolutionären Prozess, um sich darauf zu konzentrieren, die kritischsten Ideen zu finden, um neue Entdeckungen zu erzielen.

Darüber hinaus verwendet der evolutionäre Prozess von FunSearch eine Strategie zur Erhöhung der Vielfalt von Ideen, um Stagnation zu vermeiden. Um schließlich die Systemeffizienz zu steigern, wird der Evolutionsprozess parallel durchgeführt.

Neuland in der Mathematik betreten

DeepMind sagte, das erste, was sie lösen wollten, sei das Cap-Set-Problem, ein offenes Problem, das Mathematiker in verschiedenen Forschungsbereichen seit Jahrzehnten verwirrt. Der berühmte Mathematiker Terence Tao beschrieb es einmal als sein liebstes offenes Problem. DeepMind entschied sich für die Zusammenarbeit mit Jordan Ellenberg, einem Mathematikprofessor an der University of Wisconsin-Madison, der einen wichtigen Durchbruch beim Cap-Set-Problem erzielte.

Ein wichtiges Problem besteht darin, die größte Menge von Punkten (sogenannte „Cap-Menge“) in einem hochdimensionalen Gitter zu finden, sodass keine drei Punkte darin kollinear sind. Die Bedeutung dieses Problems besteht darin, dass es als Modell für andere Probleme der extremen Kombinatorik dienen kann. Die Extremkombinatorik untersucht die minimale oder maximale Größe, die Sammlungen haben können, bei denen es sich um Zahlen, Grafiken oder andere Objekte handeln kann. Brute-Force-Lösungen werden dieses Problem nicht lösen – die Anzahl der zu berücksichtigenden Möglichkeiten wird schnell die Anzahl der Atome im Universum übersteigen

Die programmgesteuert generierten Lösungen von FunSearch haben in einigen Fällen die größten jemals erstellten Cap-Sets entdeckt. Dies stellt den größten Anstieg der Cap-Set-Größe in den letzten 20 Jahren dar. Darüber hinaus übertrifft FunSearch modernste Computerlöser, da das Ausmaß des Problems ihre derzeitigen Fähigkeiten bei weitem übersteigt.

Interaktives Diagramm, das die Entwicklung vom Seed-Programm (oben) zur neuen Highscoring-Funktion (unten) zeigt. Jeder Kreis stellt ein Programm dar und seine Größe ist proportional zur ihm zugewiesenen Punktzahl. In der Abbildung sind nur die Vorgesetzten des untersten Programms dargestellt. Die entsprechende von FunSearch für jeden Knoten generierte Funktion wird rechts angezeigt.

Diese Ergebnisse zeigen, dass die FunSearch-Technologie es Menschen ermöglichen kann, bei schwierigen kombinatorischen Problemen, bei denen es schwierig ist, Intuition aufzubauen, über etablierte Ergebnisse hinauszugehen. DeepMind geht davon aus, dass dieser Ansatz bei neuen Entdeckungen zu ähnlichen theoretischen Problemen der Kombinatorik eine Rolle spielen und in Zukunft neue Möglichkeiten für Bereiche wie die Kommunikationstheorie eröffnen wird.

FunSearch bevorzugt prägnante, für den Menschen verständliche Programme

Während die Entdeckung neuer mathematischer Erkenntnisse an sich schon von Bedeutung ist, weist die FunSearch-Methode auch andere Vorteile gegenüber herkömmlichen Computersuchtechniken auf. Denn FunSearch ist keine Blackbox, die nur Lösungen für Probleme generiert. Stattdessen werden Programme generiert, die beschreiben, wie zu diesen Lösungen gelangt ist. Diese Art von „Show-your-working“ ist in der Regel die Art und Weise, wie Wissenschaftler arbeiten und neue Entdeckungen oder Phänomene erklären, indem sie die Prozesse beschreiben, die zu ihnen geführt haben.

FunSearch bevorzugt Lösungen mit geringerer Kolmogorov-Komplexität, die hochkompakte Programme darstellen. Die Kolmogorov-Komplexität bezieht sich auf die Länge des kürzesten Computerprogramms, das zur Ausgabe einer Lösung erforderlich ist. Durch den Einsatz kurzer Programme kann FunSearch sehr große Objekte beschreiben und so sehr komplexe Probleme bearbeiten. Darüber hinaus erleichtert dies den Forschern das Verständnis der von FunSearch generierten Programmausgabe. Ellenberg sagte: „FunSearch bietet einen völlig neuen Mechanismus zur Entwicklung von Angriffsstrategien. Die durch FunSearch generierten Lösungen sind konzeptionell umfangreicher als eine bloße Liste von Zahlen. Ich habe durch das Studium etwas gelernt

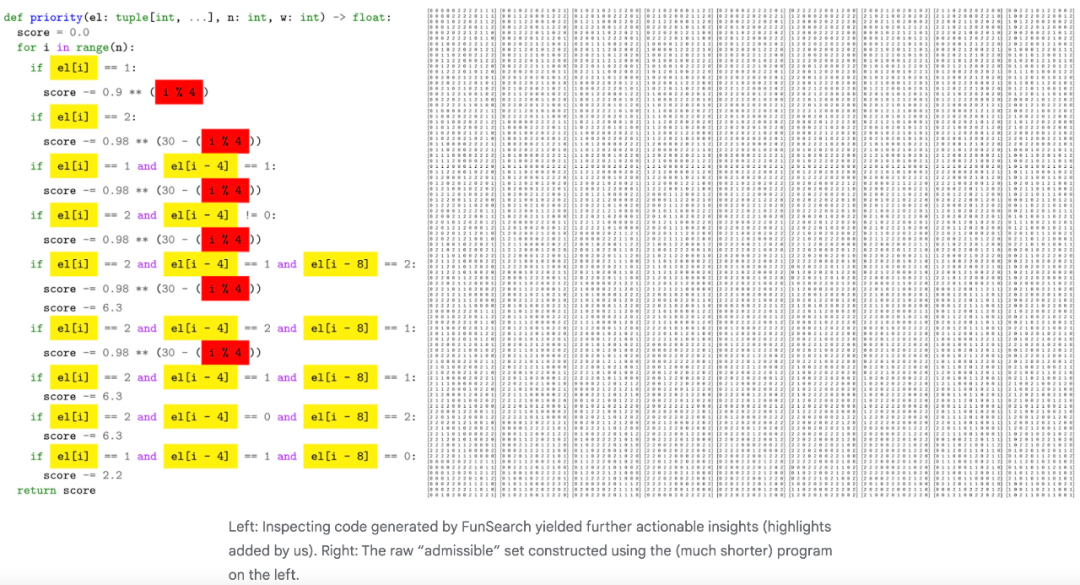

Noch wichtiger ist diese Interpretierbarkeit von FunSearch.“ Das Programm kann Forschern umsetzbare Erkenntnisse liefern. Beispielsweise bemerkte DeepMind bei der Verwendung von FunSearch interessante Symmetrien im Code einiger seiner hoch bewerteten Ergebnisse. Dies gab DeepMind ein neues Verständnis des Problems, das sie nutzten, um das Problem zu verbessern, das FunSearch eingeführt hatte, um eine bessere Lösung zu finden. DeepMind glaubt, dass dies ein hervorragendes Beispiel für die menschliche Zusammenarbeit mit FunSearch bei vielen Problemen in der Mathematik ist.

Links: Durch die Untersuchung des von FunSearch generierten Codes gewann DeepMind weitere umsetzbare Erkenntnisse (hervorgehoben). Rechts: Die ursprüngliche „akzeptable“ Menge, die mit dem (kürzeren) Programm links erstellt wurde.

Ein bekanntes Rechenproblem lösen

Inspiriert durch den Erfolg des theoretischen Cap-Set-Problems beschloss DeepMind, FunSearch auf eine wichtige praktische Herausforderung in der Informatik anzuwenden – das Bin-Packing-Problem. Das Verpackungsproblem besteht darin, Artikel unterschiedlicher Größe in möglichst wenigen Kartons zu verpacken. Es ist der Kern vieler realer Probleme, vom Versand von Containern mit Gegenständen bis hin zur Verteilung der Rechenarbeit in Rechenzentren, bei denen die Kosten minimiert werden müssen.

Typischerweise werden bei der Lösung von Online-Binning-Problemen heuristische Algorithmenregeln verwendet, die auf menschlicher Erfahrung basieren. Allerdings ist die Entwicklung eines Regelwerks für jede spezifische Situation (je nach Größe, Zeit oder Kapazität) eine große Herausforderung. Obwohl es sich stark vom Cap-Set-Problem unterscheidet, ist es mit FunSearch sehr einfach, dieses Problem zu lösen. FunSearch bietet ein automatisch angepasstes Programm, das sich je nach Situation an die Daten anpassen kann und im Vergleich zu vorhandenen Heuristiken weniger Boxen verwenden kann, um die gleiche Anzahl von Elementen zu laden Best-Fit-Heuristik (links) und die von FunSearch entdeckte Heuristik (rechts).

Komplexe kombinatorische Probleme wie Online-Binning können mit anderen Methoden der künstlichen Intelligenz, wie neuronalen Netzen und Reinforcement Learning, gelöst werden. Diese Methoden haben sich ebenfalls als wirksam erwiesen, erfordern jedoch möglicherweise auch erhebliche Ressourcen für die Bereitstellung. Andererseits gibt FunSearch Code aus, der einfach zu überprüfen und bereitzustellen ist, was bedeutet, dass seine Lösungen das Potenzial haben, auf eine Vielzahl realer Industriesysteme angewendet zu werden, was schnell Vorteile bringt.

Komplexe kombinatorische Probleme wie Online-Binning können mit anderen Methoden der künstlichen Intelligenz, wie neuronalen Netzen und Reinforcement Learning, gelöst werden. Diese Methoden haben sich ebenfalls als wirksam erwiesen, erfordern jedoch möglicherweise auch erhebliche Ressourcen für die Bereitstellung. Andererseits gibt FunSearch Code aus, der einfach zu überprüfen und bereitzustellen ist, was bedeutet, dass seine Lösungen das Potenzial haben, auf eine Vielzahl realer Industriesysteme angewendet zu werden, was schnell Vorteile bringt.

DeepMind: Die Verwendung großer Modelle zur Bewältigung wissenschaftlicher Herausforderungen wird zur gängigen Praxis werden.

FunSearch beweist, dass die Leistungsfähigkeit dieser Modelle nicht nur zur Generierung neuer mathematischer Entdeckungen, sondern auch zur Generierung neuer mathematischer Entdeckungen genutzt werden kann, wenn die Halluzination von LLMs verhindert werden kann um wichtige potenzielle Lösungen für reale Probleme aufzudecken.

DeepMind glaubt, dass für viele Probleme in Wissenschaft und Industrie – sowohl langjährige als auch neue – die Verwendung von LLM-gesteuerten Methoden zur Generierung effizienter und maßgeschneiderter Algorithmen gängige Praxis werden wird.

Eigentlich ist das erst der Anfang. Während LLM weiterhin Fortschritte macht, wird sich FunSearch weiter verbessern. DeepMind sagte, dass man auch daran arbeiten werde, seine Fähigkeiten zu erweitern, um eine Vielzahl dringender wissenschaftlicher und technischer Herausforderungen in der Gesellschaft anzugehen.

Das obige ist der detaillierte Inhalt vonDeepMind-Artikel in Nature veröffentlicht: Ein großes Modell findet eine neue Lösung für ein Problem, das Mathematiker seit Jahrzehnten beschäftigt. Für weitere Informationen folgen Sie bitte anderen verwandten Artikeln auf der PHP chinesischen Website!

Heiße KI -Werkzeuge

Undresser.AI Undress

KI-gestützte App zum Erstellen realistischer Aktfotos

AI Clothes Remover

Online-KI-Tool zum Entfernen von Kleidung aus Fotos.

Undress AI Tool

Ausziehbilder kostenlos

Clothoff.io

KI-Kleiderentferner

AI Hentai Generator

Erstellen Sie kostenlos Ai Hentai.

Heißer Artikel

Heiße Werkzeuge

Notepad++7.3.1

Einfach zu bedienender und kostenloser Code-Editor

SublimeText3 chinesische Version

Chinesische Version, sehr einfach zu bedienen

Senden Sie Studio 13.0.1

Leistungsstarke integrierte PHP-Entwicklungsumgebung

Dreamweaver CS6

Visuelle Webentwicklungstools

SublimeText3 Mac-Version

Codebearbeitungssoftware auf Gottesniveau (SublimeText3)

Heiße Themen

1384

1384

52

52

Open Source! Jenseits von ZoeDepth! DepthFM: Schnelle und genaue monokulare Tiefenschätzung!

Apr 03, 2024 pm 12:04 PM

Open Source! Jenseits von ZoeDepth! DepthFM: Schnelle und genaue monokulare Tiefenschätzung!

Apr 03, 2024 pm 12:04 PM

0.Was bewirkt dieser Artikel? Wir schlagen DepthFM vor: ein vielseitiges und schnelles generatives monokulares Tiefenschätzungsmodell auf dem neuesten Stand der Technik. Zusätzlich zu herkömmlichen Tiefenschätzungsaufgaben demonstriert DepthFM auch hochmoderne Fähigkeiten bei nachgelagerten Aufgaben wie dem Tiefen-Inpainting. DepthFM ist effizient und kann Tiefenkarten innerhalb weniger Inferenzschritte synthetisieren. Lassen Sie uns diese Arbeit gemeinsam lesen ~ 1. Titel der Papierinformationen: DepthFM: FastMonocularDepthEstimationwithFlowMatching Autor: MingGui, JohannesS.Fischer, UlrichPrestel, PingchuanMa, Dmytr

Das weltweit leistungsstärkste Open-Source-MoE-Modell ist da, mit chinesischen Fähigkeiten, die mit GPT-4 vergleichbar sind, und der Preis beträgt nur fast ein Prozent von GPT-4-Turbo

May 07, 2024 pm 04:13 PM

Das weltweit leistungsstärkste Open-Source-MoE-Modell ist da, mit chinesischen Fähigkeiten, die mit GPT-4 vergleichbar sind, und der Preis beträgt nur fast ein Prozent von GPT-4-Turbo

May 07, 2024 pm 04:13 PM

Stellen Sie sich ein Modell der künstlichen Intelligenz vor, das nicht nur die Fähigkeit besitzt, die traditionelle Datenverarbeitung zu übertreffen, sondern auch eine effizientere Leistung zu geringeren Kosten erzielt. Dies ist keine Science-Fiction, DeepSeek-V2[1], das weltweit leistungsstärkste Open-Source-MoE-Modell, ist da. DeepSeek-V2 ist ein leistungsstarkes MoE-Sprachmodell (Mix of Experts) mit den Merkmalen eines wirtschaftlichen Trainings und einer effizienten Inferenz. Es besteht aus 236B Parametern, von denen 21B zur Aktivierung jedes Markers verwendet werden. Im Vergleich zu DeepSeek67B bietet DeepSeek-V2 eine stärkere Leistung, spart gleichzeitig 42,5 % der Trainingskosten, reduziert den KV-Cache um 93,3 % und erhöht den maximalen Generierungsdurchsatz auf das 5,76-fache. DeepSeek ist ein Unternehmen, das sich mit allgemeiner künstlicher Intelligenz beschäftigt

KI untergräbt die mathematische Forschung! Der Gewinner der Fields-Medaille und der chinesisch-amerikanische Mathematiker führten 11 hochrangige Arbeiten an | Gefällt mir bei Terence Tao

Apr 09, 2024 am 11:52 AM

KI untergräbt die mathematische Forschung! Der Gewinner der Fields-Medaille und der chinesisch-amerikanische Mathematiker führten 11 hochrangige Arbeiten an | Gefällt mir bei Terence Tao

Apr 09, 2024 am 11:52 AM

KI verändert tatsächlich die Mathematik. Vor kurzem hat Tao Zhexuan, der diesem Thema große Aufmerksamkeit gewidmet hat, die neueste Ausgabe des „Bulletin of the American Mathematical Society“ (Bulletin der American Mathematical Society) weitergeleitet. Zum Thema „Werden Maschinen die Mathematik verändern?“ äußerten viele Mathematiker ihre Meinung. Der gesamte Prozess war voller Funken, knallhart und aufregend. Der Autor verfügt über eine starke Besetzung, darunter der Fields-Medaillengewinner Akshay Venkatesh, der chinesische Mathematiker Zheng Lejun, der NYU-Informatiker Ernest Davis und viele andere bekannte Wissenschaftler der Branche. Die Welt der KI hat sich dramatisch verändert. Viele dieser Artikel wurden vor einem Jahr eingereicht.

Hallo, elektrischer Atlas! Der Boston Dynamics-Roboter erwacht wieder zum Leben, seltsame 180-Grad-Bewegungen machen Musk Angst

Apr 18, 2024 pm 07:58 PM

Hallo, elektrischer Atlas! Der Boston Dynamics-Roboter erwacht wieder zum Leben, seltsame 180-Grad-Bewegungen machen Musk Angst

Apr 18, 2024 pm 07:58 PM

Boston Dynamics Atlas tritt offiziell in die Ära der Elektroroboter ein! Gestern hat sich der hydraulische Atlas einfach „unter Tränen“ von der Bühne der Geschichte zurückgezogen. Heute gab Boston Dynamics bekannt, dass der elektrische Atlas im Einsatz ist. Es scheint, dass Boston Dynamics im Bereich kommerzieller humanoider Roboter entschlossen ist, mit Tesla zu konkurrieren. Nach der Veröffentlichung des neuen Videos wurde es innerhalb von nur zehn Stunden bereits von mehr als einer Million Menschen angesehen. Die alten Leute gehen und neue Rollen entstehen. Das ist eine historische Notwendigkeit. Es besteht kein Zweifel, dass dieses Jahr das explosive Jahr der humanoiden Roboter ist. Netizens kommentierten: Die Weiterentwicklung der Roboter hat dazu geführt, dass die diesjährige Eröffnungsfeier wie Menschen aussieht, und der Freiheitsgrad ist weitaus größer als der von Menschen. Aber ist das wirklich kein Horrorfilm? Zu Beginn des Videos liegt Atlas ruhig auf dem Boden, scheinbar auf dem Rücken. Was folgt, ist atemberaubend

Langsame Internetgeschwindigkeiten für Mobilfunkdaten auf dem iPhone: Korrekturen

May 03, 2024 pm 09:01 PM

Langsame Internetgeschwindigkeiten für Mobilfunkdaten auf dem iPhone: Korrekturen

May 03, 2024 pm 09:01 PM

Stehen Sie vor einer Verzögerung oder einer langsamen mobilen Datenverbindung auf dem iPhone? Normalerweise hängt die Stärke des Mobilfunk-Internets auf Ihrem Telefon von mehreren Faktoren ab, wie z. B. der Region, dem Mobilfunknetztyp, dem Roaming-Typ usw. Es gibt einige Dinge, die Sie tun können, um eine schnellere und zuverlässigere Mobilfunk-Internetverbindung zu erhalten. Fix 1 – Neustart des iPhone erzwingen Manchmal werden durch einen erzwungenen Neustart Ihres Geräts viele Dinge zurückgesetzt, einschließlich der Mobilfunkverbindung. Schritt 1 – Drücken Sie einfach einmal die Lauter-Taste und lassen Sie sie los. Drücken Sie anschließend die Leiser-Taste und lassen Sie sie wieder los. Schritt 2 – Der nächste Teil des Prozesses besteht darin, die Taste auf der rechten Seite gedrückt zu halten. Lassen Sie das iPhone den Neustart abschließen. Aktivieren Sie Mobilfunkdaten und überprüfen Sie die Netzwerkgeschwindigkeit. Überprüfen Sie es erneut. Fix 2 – Datenmodus ändern 5G bietet zwar bessere Netzwerkgeschwindigkeiten, funktioniert jedoch besser, wenn das Signal schwächer ist

KAN, das MLP ersetzt, wurde durch Open-Source-Projekte auf Faltung erweitert

Jun 01, 2024 pm 10:03 PM

KAN, das MLP ersetzt, wurde durch Open-Source-Projekte auf Faltung erweitert

Jun 01, 2024 pm 10:03 PM

Anfang dieses Monats schlugen Forscher des MIT und anderer Institutionen eine vielversprechende Alternative zu MLP vor – KAN. KAN übertrifft MLP in Bezug auf Genauigkeit und Interpretierbarkeit. Und es kann MLP, das mit einer größeren Anzahl von Parametern ausgeführt wird, mit einer sehr kleinen Anzahl von Parametern übertreffen. Beispielsweise gaben die Autoren an, dass sie KAN nutzten, um die Ergebnisse von DeepMind mit einem kleineren Netzwerk und einem höheren Automatisierungsgrad zu reproduzieren. Konkret verfügt DeepMinds MLP über etwa 300.000 Parameter, während KAN nur etwa 200 Parameter hat. KAN hat eine starke mathematische Grundlage wie MLP und basiert auf dem universellen Approximationssatz, während KAN auf dem Kolmogorov-Arnold-Darstellungssatz basiert. Wie in der folgenden Abbildung gezeigt, hat KAN

Die Vitalität der Superintelligenz erwacht! Aber mit der Einführung der sich selbst aktualisierenden KI müssen sich Mütter keine Sorgen mehr über Datenengpässe machen

Apr 29, 2024 pm 06:55 PM

Die Vitalität der Superintelligenz erwacht! Aber mit der Einführung der sich selbst aktualisierenden KI müssen sich Mütter keine Sorgen mehr über Datenengpässe machen

Apr 29, 2024 pm 06:55 PM

Ich weine zu Tode. Die Daten im Internet reichen überhaupt nicht aus. Das Trainingsmodell sieht aus wie „Die Tribute von Panem“, und KI-Forscher auf der ganzen Welt machen sich Gedanken darüber, wie sie diese datenhungrigen Esser ernähren sollen. Dieses Problem tritt insbesondere bei multimodalen Aufgaben auf. Zu einer Zeit, als sie ratlos waren, nutzte ein Start-up-Team der Abteilung der Renmin-Universität von China sein eigenes neues Modell, um als erstes in China einen „modellgenerierten Datenfeed selbst“ in die Realität umzusetzen. Darüber hinaus handelt es sich um einen zweigleisigen Ansatz auf der Verständnisseite und der Generierungsseite. Beide Seiten können hochwertige, multimodale neue Daten generieren und Datenrückmeldungen an das Modell selbst liefern. Was ist ein Modell? Awaker 1.0, ein großes multimodales Modell, das gerade im Zhongguancun-Forum erschienen ist. Wer ist das Team? Sophon-Motor. Gegründet von Gao Yizhao, einem Doktoranden an der Hillhouse School of Artificial Intelligence der Renmin University.

Tesla-Roboter arbeiten in Fabriken, Musk: Der Freiheitsgrad der Hände wird dieses Jahr 22 erreichen!

May 06, 2024 pm 04:13 PM

Tesla-Roboter arbeiten in Fabriken, Musk: Der Freiheitsgrad der Hände wird dieses Jahr 22 erreichen!

May 06, 2024 pm 04:13 PM

Das neueste Video von Teslas Roboter Optimus ist veröffentlicht und er kann bereits in der Fabrik arbeiten. Bei normaler Geschwindigkeit sortiert es Batterien (Teslas 4680-Batterien) so: Der Beamte hat auch veröffentlicht, wie es bei 20-facher Geschwindigkeit aussieht – auf einer kleinen „Workstation“, pflücken und pflücken und pflücken: Dieses Mal wird es freigegeben. Eines der Highlights Der Vorteil des Videos besteht darin, dass Optimus diese Arbeit in der Fabrik völlig autonom und ohne menschliches Eingreifen während des gesamten Prozesses erledigt. Und aus Sicht von Optimus kann es auch die krumme Batterie aufnehmen und platzieren, wobei der Schwerpunkt auf der automatischen Fehlerkorrektur liegt: In Bezug auf die Hand von Optimus gab der NVIDIA-Wissenschaftler Jim Fan eine hohe Bewertung ab: Die Hand von Optimus ist der fünffingrige Roboter der Welt am geschicktesten. Seine Hände sind nicht nur taktil